Bioinformatics|MARS:基于模体的自回归模型用于逆合成预测

Bioinformatics|MARS:基于模体的自回归模型用于逆合成预测

2024年2月29日,深圳大学欧阳乐老师、腾讯人工智能实验室赵沛霖研究员团队在Bioinformatics上发表文章MARS: a motif-based autoregressive model for retrosynthesis prediction。

作者提出了一种新的基于模体的自回归模型用于逆合成预测(a Motif-based Autoregressive model for RetroSynthesis prediction,MARS),该模型是一个基于图神经网络的端到端图生成模型,可以依次识别产物,生成合成子,并向合成子添加模体以生成底物。实验结果证明了模型在预测逆合成路径方面的有效性,并表明该模型有潜力成为药物发现的有价值的工具。

背景

预测逆合成路径是药物发现中的一项关键任务,旨在寻找合成给定目标分子的可行途径。许多现有的方法将此任务定义为图生成问题。具体来说,这些方法首先确定反应中心,并相应地对目标分子的图进行分解,以生成合成子,通过向合成子依次添加原子或直接添加适当的基团来生成底物。然而,这两种策略都有局限性。添加原子导致预测序列较长,增加了生成的复杂性,而添加剩余基团则使得模型不够精细,导致预测效果差。

方法

MARS模型流程如图1所示。其中编辑(Edit)阶段描述了键和原子从产物(product)到合成子(synthons)的变化,起到反应中心识别的作用,添加模体(AddingMotif)阶段通过向合成子添加合适的模体来完成合成。输入的分子图由图神经网络(GNN)编码,循环神经网络(RNN)依次预测图的变换操作。本文采用图变换网络(GTN)作为图神经网络编码器,使用全局注意力池化作为图的读出函数。在编辑阶段,RNN预测编辑操作的序列,直到结束状态(FinishEdit)。在添加模体阶段,RNN依次添加模体,直到没有附加原子剩余。在图1的示例中,第一个编辑操作应用于S=O绑定,并且新的绑定类型为None,表示删除该绑定。对于添加模体操作,模体中的接口原子和合成子/中间体中的附属原子表示相同的原子,并且在将模体附加到合成子/中间体时合并为单个原子。

图1 MARS结构图

MARS引入了一个连接树来表示合成子和模体之间的连接,这为创建添加模体序列提供了一种有效的方法。为了将编辑和添加模体动作集成到一个完整的转换路径中,MARS定义了四个图变换令牌:开始(Start)、编辑(Edit)、结束编辑(FinishEdit)和添加模体(AddingMotif)。

MARS的编辑阶段包含两种类型的编辑:键编辑和原子编辑。键编辑包括添加或删除键或改变两个重原子之间的键类型,而原子编辑则涉及改变氢原子的数量或原子的电荷。这些编辑被应用于目标分子以产生合成子。在修饰键两端的原子,以及带有改变的氢计数或电荷的原子,被称为附着原子。可以将目标分子的反应中心编码为一个Edit序列,其中每个Edit令牌由一个元组(编辑动作、编辑对象、编辑状态)组成。

在编辑阶段,产物分子图被分解成一组称为合成子的不完整子图。通过结合合适的基序和附着物,合成子可以重构成有效的反应物分子图。模体代表了反应物分子图的子图,提取的细节总结如下:将反应物中连接合成子的键断开以获得一组子图。每个子图在合成子上保留连接到它的附属原子,从而产生粗粒度的模体。如果两个相连的原子属于不同的环,它们之间的键就会断裂,产生两个独立的模体。如果一个原子属于一个环,而另一个原子的度大于1,它们之间的键就会断裂,产生两个独立的模体。

值得注意的是,模体与以往的方法中使用的离去基团有根本区别:(i) 模体与附着原子相连,而离去基团与合成子相关联。因为一个合成子可以包含多个连接原子,而一个离去基可以由多个不相连的子图(即模体)组成。(ii) 模体在合成子上保留相应的连接原子,称为接口原子。值得注意的是,许多添加的离去基团由单个氢原子组成,导致离去基的频率极不平衡。(iii) 一个大的离去基团可能包含多个环或大的支链,这在数据集中很少出现。

根据化学直觉,假设反应物可以分解为合成子和模体,其中合成子表示通过分解产物中的键获得的分子片段,模体表示反应物的子图。为了保持合成子和模体之间的连接,作者引入了连接树方法,将合成子和模体表示为分层树结构,其中合成子组设置为根节点,模体设置为子节点,两个节点之间的连接边表示它们直接连接在反应物中,表示为附加原子-模体-接口原子。使用深度优先搜索(DFS)遍历树以保留节点之间的连接边,并获得训练输入和目标AddingMotif路径。输入路径由每个包含动作AddingMotif和对象附加原子的令牌组成,而对于目标路径,对象由模体和接口原子组成。将上述Edit序列与AddingMotif路径以及其他辅助动作相结合,可以得到每个产物对应的输入路径和目标转换路径。

MARS将逆合成预测建模为一个自回归的条件分子生成任务。基于前面步骤的部分完成图,自回归模型逐步构建一个新的图结构,最终得到反应物图。重要的是,要注意中间图的结构不是由模型直接生成的。相反,模型会生成一个图编辑操作π,一个编辑对象o(即键、原子或模体)及其编辑状态τ(例如,新的键类型或接口原子),然后应用这些操作来创建一个新的图结构。使用门控循环单元(GRU)这种RNN来建模自回归过程中描述的似然函数。GRU有效地捕获前一步的信息,包括对象、状态和不完整图,并将其转换为全局拓扑信息用于后续预测。

生成过程从开始(Start)操作开始,在每个步骤t中,生成图编辑操作。当预测的操作是Edit时,流程进入编辑阶段。在步骤t,模型分配一个编辑分数指向每个键和原子,表明该键或原子是适合编辑的候选对象的可能性。选择编辑分数最大的原子或键作为编辑对象,并将所选键两端的一个或多个原子指定为附加原子。然后该模型预测新的键类型。然后通过应用编辑对象及其新键类型来修改合成子结构。生成的结构使用图神经网络以获得合成子编码。最后,由合成子嵌入的编辑对象及其新的键类型更新。该模型迭代此过程以生成覆盖所有反应中心的Edit序列。

当模型预测动作为FinishEdit时,Edit阶段结束,AddingMotif阶段开始。在此阶段,模型遍历所有附加原子,依次分配适当的模体,确定模体上哪个接口原子与附加原子对应。为了实现这一点,该模型预测了接口原子索引。生成过程不断更新,直到遍历合成子上的所有附加原子和添加的模体。最后,模型生成逆合成路径。

结果

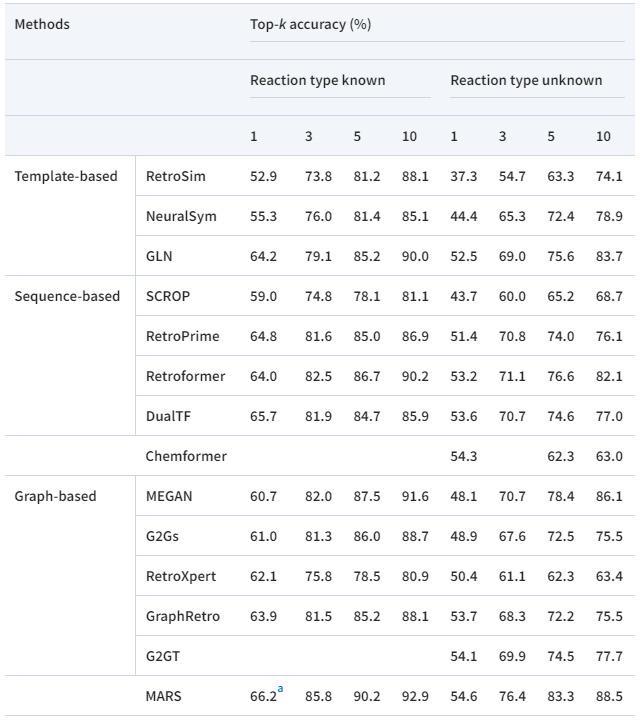

作者将MARS与一些具有代表性的方法进行了比较。如表1所示,采用预测的前k个准确度作为对比。作者在反应类型已知或未知的情况下进行了实验。可见MARS性能超越了现有方法。

表1 与其他方法对比

作者设计了消融实验。为了深入了解合成子编码(synthon embedding)和键特征(bond feature)的重要性,通过分别将其从MARS中移除来进行消融研究,模型分别记作MARS-w/o S和MARS-w/o B。如表2所示,这表明,在生成过程中,合成子编码是至关重要的。合成子结构信息有助于模型确定编辑结束动作,而缺少合成子编码导致在编辑阶段重复预测编辑对象。结合键特征可以使MARS学习更好的分子表征,最终提高下游预测的准确性。

表2 消融实验

作者还进行了案例分析。为了全面了解MARS模型的预测性能,在图2中直观地展示了四种产物对应的真实反应物和MARS预测反应物。在图2a和b中,模型准确地识别了反应中心,并添加了合适的模体,正确地预测了反应物。值得注意的是,模型可以轻松地处理各种大小的模体,展示了它为合成子分配正确模体的能力。与逐个添加原子或苯环的方法相比,MARS模型预测具有较高的准确性和化学合理性。在图2c中,虽然模型正确地预测了反应中心,但添加的模体与事实不同。然而,预测的反应物在化学上是合理的,在某些情况下可以更方便地获得。在图2d中,模型预测了另一个断开位点,并根据预测的合成子添加了相应的模体。实际上,这个预测也是正确的,因为从多步逆合成的角度来看,预测和实际分子只是在化学键断开顺序上有所不同。这些例子表明,模型可以学习潜在的反应规则,提供合理和准确的预测。

图3 案例分析

总结

本研究提出了基于模体的自回归模型MARS,用于逆合成预测。该模型具有预测模体的灵活性和较低的复杂度。它的端到端架构使它能够发现反应中心和模体之间的潜在关系。此外,考虑到模体对应于基本的化学官能团,将其作为基本实体进行逆合成预测是合乎逻辑的,也是可行的。这些方面共同促成了MARS模型所展示的卓越性能。在未来,可探索预训练模型引入MARS模型的可能性,以从现有化合物中获得对模体的更细致的理解。

参考文献

[1] Liu et al. MARS: a motif-based autoregressive model for retrosynthesis prediction. Bioinformatics. 2024

--------- End ---------