跟着我,轻松在腾讯云轻量应用服务器搭建自己的大型语言模型!

原创跟着我,轻松在腾讯云轻量应用服务器搭建自己的大型语言模型!

原创

快乐的小白

发布于 2024-04-16 10:36:28

发布于 2024-04-16 10:36:28

使用腾讯云轻量应用服务器部署大型语言模型

前言

一,ollama介绍

1.Ollama 是一个基于 Go 语言开发的本地大模型运行框架!它可以帮助用户在本地快速运行大模型,通过简单的安装指令,可以用一条命令就在本地运行开源大型语言模型。

2.目前支持以下模型快速部署,都是比较常见的流行模型,通过指令就能快速部署。

Model | Parameters | Size | 下载 |

|---|---|---|---|

Llama 2 | 7B | 3.8GB | ollama run llama2 |

Mistral | 7B | 4.1GB | ollama run mistral |

Dolphin Phi | 2.7B | 1.6GB | ollama run dolphin-phi |

Phi-2 | 2.7B | 1.7GB | ollama run phi |

Neural Chat | 7B | 4.1GB | ollama run neural-chat |

Starling | 7B | 4.1GB | ollama run starling-lm |

Code Llama | 7B | 3.8GB | ollama run codellama |

Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

Llama 2 13B | 13B | 7.3GB | ollama run llama2:13b |

Llama 2 70B | 70B | 39GB | ollama run llama2:70b |

Orca Mini | 3B | 1.9GB | ollama run orca-mini |

Vicuna | 7B | 3.8GB | ollama run vicuna |

LLaVA | 7B | 4.5GB | ollama run llava |

Gemma | 2B | 1.4GB | ollama run gemma:2b |

Gemma | 7B | 4.8GB | ollama run gemma:7b |

二,效果展示

- 部署完成后,就能直接提出问题。

三,部署教程

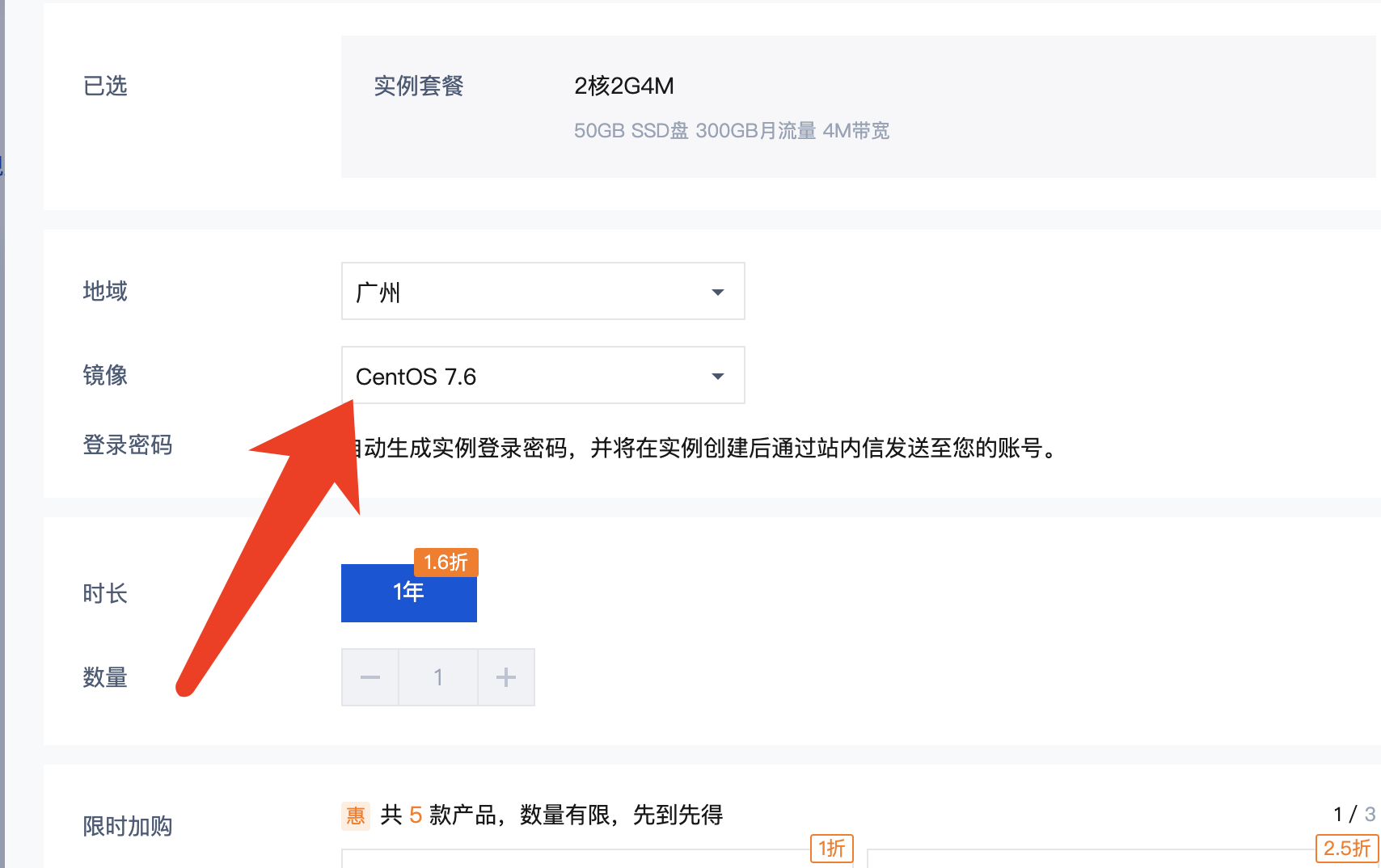

1.首先你需要一台腾讯云轻量服务器,用于模型的搭建,目前轻量活动力度很大,不到100就能买到一年的服务器,更有三年优惠机也可以看看。当然本次项目需要用到cpu,所以尽量使用8核以上的cpu进行体验吧,如果经费不允许的话也可以购买2核或4核。

活动地址https://curl.qcloud.com/rnuXqlNU

2.通过以上的活动地址购买了服务器时,需要选择linux的环境,这里我以centos系统为例,所以大家购买时尽量以centos系统为主。

3.购买成功后,如果找不到轻量的控制台,可以进入下面的链接,直接到服务器管理的控制台(一般购买后五分钟左右服务器就会生产到你的账号)

轻量服务器控制台地址https://console.cloud.tencent.com/lighthouse

4.进入上面的链接后,就会显示你所有的服务器,找到刚才购买的服务器,然后点击登录按钮,进入OrcaTerm输入你的服务器密码

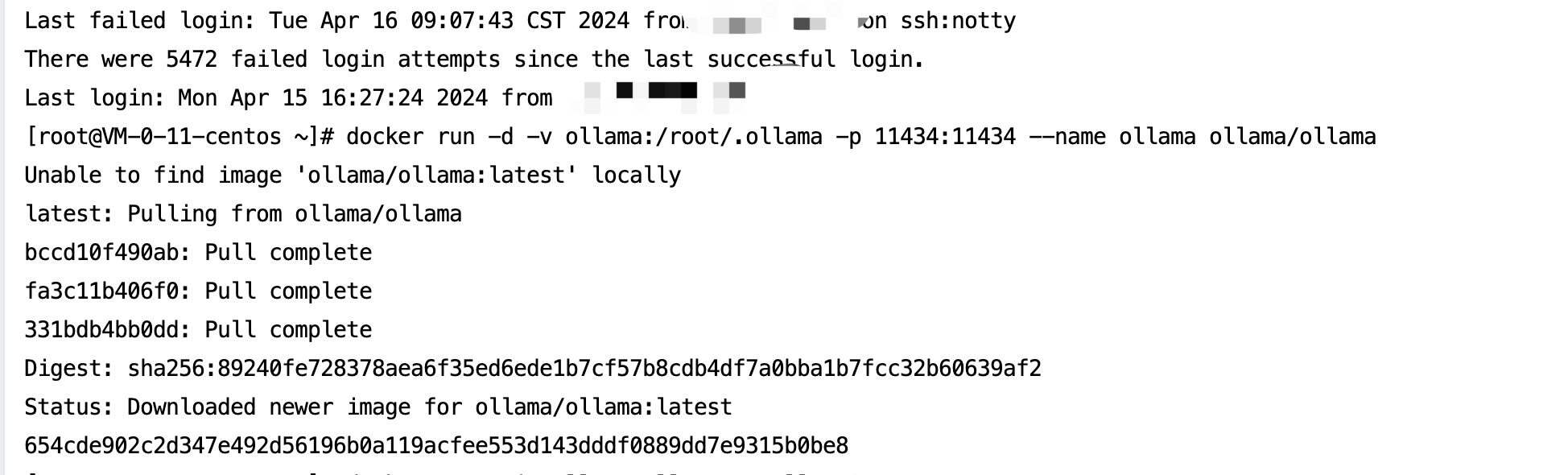

5.请在OrcaTerm控制台下输入下面的一键部署指令,进行在线部署。

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

6.然后运行部署模型部署命令。我这里默认部署了llama2,大家如果需要部署其他的可以看上面介绍里表格,自行替换一下。

docker exec -it ollama ollama run llama2

7.看到success,就表示已经安装成功了,我们可以直接回复问题。

四,日常使用

1.这是几个指令,因为我们是docker安装的,所以下面的指令需要进入docker里去执行。

ollama list:显示模型列表。ollama show:显示模型的信息ollama pull:拉取模型ollama push:推送模型ollama cp:拷贝一个模型ollama rm:删除一个模型ollama run:运行一个模型

2.例如删除模型

docker exec -it ollama ollama rm llama23.服务器本地执行对话命令。

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt": "周树人和鲁迅,这两个人打架,谁会赢?"

}'curl http://localhost:11434/api/chat -d '{

"model": "llama2",

"messages": [

{ "role": "user", "content": "周树人和鲁迅,这两个人打架,谁会赢?" }

]

}'4.外网访问的话,只需要将localhost换成你的ip,然后打开11434的防火墙端口

六,注意事项

- 防火墙端口,如果你要外网访问,一定要注意是否开启,好多次帮别人看项目都是防火墙没开。

- 项目虽然是开源项目,但是如果商业用途还是要联系作者是否能商用。

七,结语

大语言的模型部署已经不再是难以逾越的障碍,简直就是小白都能轻松搞定!现在,只需一键指令,你就能迅速地部署那些最常见的模型。无论你是 AI 的新手还是老手,都能通过简单的试用流程,轻松上手。这个过程简直就是 AI 的入门指南,每个人都能够利用上这项技术,为自己的项目或者兴趣领域注入强大的智能力量。不管你是想要进行自然语言处理、图像识别还是其他领域的探索,现在都变得非常容易。别再犹豫,赶快加入 AI 的行列吧!

希望本部署教程能够为您提供有益的指导,并为您的项目或业务增添价值,欢迎大家在底下积极评论和增添优化意见。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录