高性能应用服务 HAI - DeepSeek-r1 671B满血版

原创高性能应用服务 HAI - DeepSeek-r1 671B满血版

原创geru

修改于 2025-03-04 14:35:42

修改于 2025-03-04 14:35:42

一、环境说明

本环境预装 DeepSeek-r1 671B,仅支持在高性能应用服务HAI“旗舰型”算力套餐上运行。“旗舰型”算力套餐需开白使用,若有使用需求需提工单进行审核申请。

二、使用说明

该环境为基础镜像环境,环境中包含两个容器环境:

1. DeepSeek-r1 671B fp8 模型容器

2. AnythingLLM 项目容器

实例创建后,会自动运行上述两个容器。由于 671B 模型较大,首次加载需1小时左右完成,加载完成后方可开始使用。

2.1 DeepSeek-r1 671B fp8 版本模型容器使用指引

1. DeepSeek容器进入

sudo docker exec -it deepseek-r1 bash2. 模型加载进度查看。模型首次加载耗时约1小时,您可进入容器后输入如下命令查看加载进度。

tail -f /cfs/ds3_infer.log3. 您可输入如下命令查看显存占用情况

nvidia-smi2.2 API调用格式

DeepSeek-r1 671B满血版采用sglang框架部署,兼容openai调用格式,您可在模型加载完成后,使用api进行调用测试。注意,要将127.0.0.1替换为您实例的公网ip。

curl -X POST \

-H "Content-Type: application/json" \

-H "Authorization: Bearer ''" \

-d '{

"model": "/cfs",

"messages": [

{"role": "user", "content": "你好!你是谁!"}

],

"temperature": 0.7

}' \

"http://127.0.0.1:6399/v1/chat/completions"2.2 AnythingLLM使用指引

AnythingLLM提供了可视化模型交互页面,您可使用AnythingLLM快速测试体验模型效果。

实例创建完成后,会自动拉起 AnythingLLM。您可使用实例公网ip:6889端口的方式,连接 AnythingLLM。

启动后,需先进行简单的初始化配置。

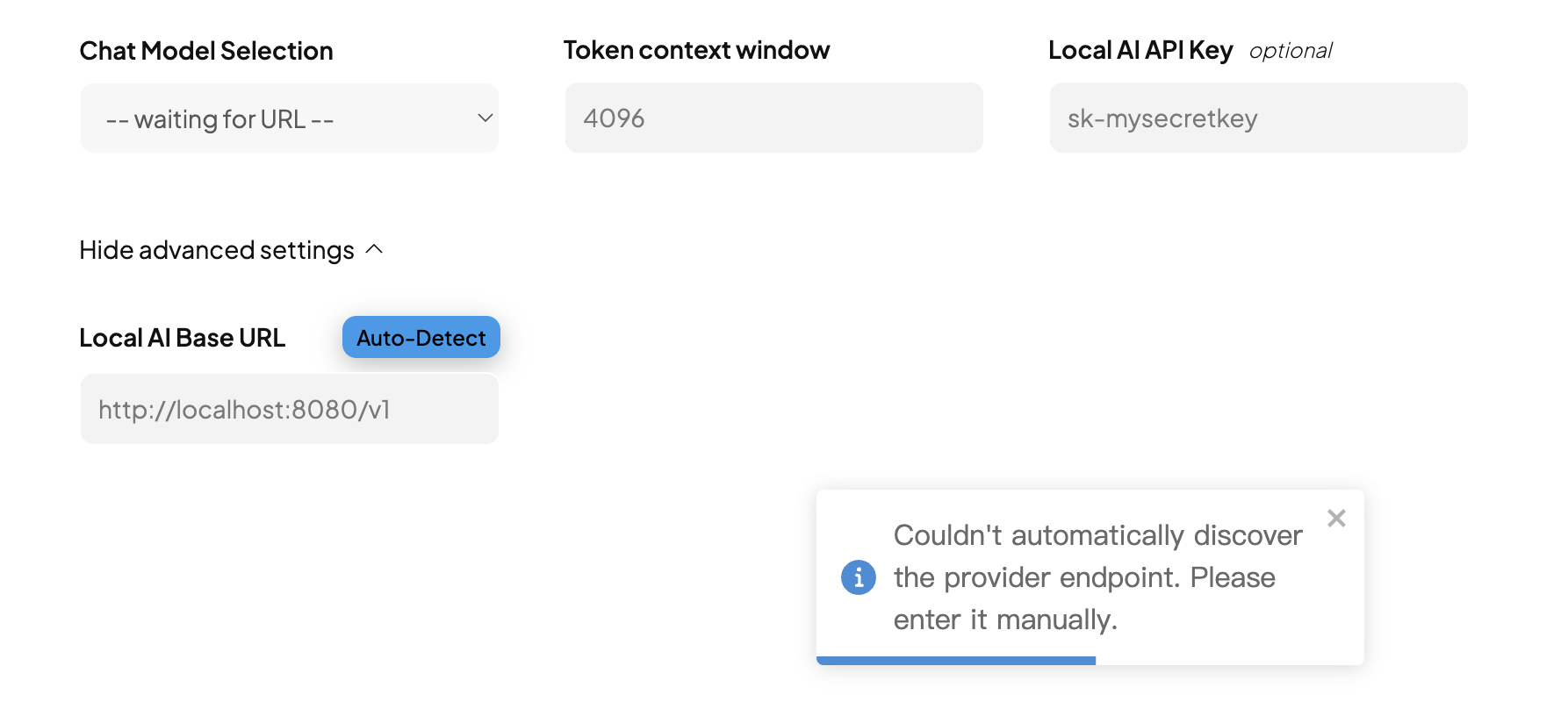

- LLM providers选择 Local AI。

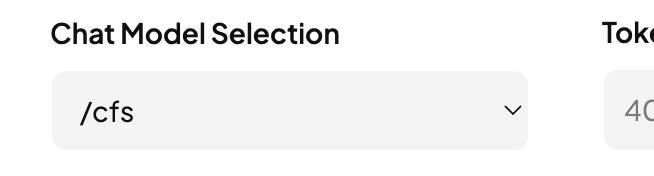

- Local AI Base URL处替换为:本机的实例公网ip:6399/v1,修改完成后会自动选中671B模型。chat model sleelection处展示“/cfs”即符合预期。

http://本机实例公网ip:6399/v1- 其余选项按需配置,注意,若您设定密码,请对密码进行保存,重置密码流程较为复杂。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录