OpenClaw 是一款开源的本地 AI 代理框架,能让 AI 从“回答问题”进化为“动手执行任务”。它支持在 Windows、macOS 和 Linux 上自主运行,通过内置工具和可扩展的插件体系,自动完成文件整理、邮件处理、代码编写等操作。本文以 Hy3 preview 模型为例演示如何将模型接入到 OpenClaw 中使用。

安装方式

获取 API Key

1. 进入 API Key 管理 页面,单击创建 API Key。操作详情请参见 创建 API Key。

注意:

在设置可访问范围时,如果选择“限定范围”,则需要确保勾选 Hy3 preview。

2. 创建完成后,请您务必复制并妥善保管 API Key,在后续配置到工具的流程中将会使用该信息。

配置 OpenClaw

1. 将模型接入 OpenClaw

打开终端,运行以下命令。

openclaw onboard --auth-choice tokenhub-api-key

根据终端显示的提示信息,依次完成相关配置,配置信息参考如下。

基础配置

终端提示信息 | 配置内容 |

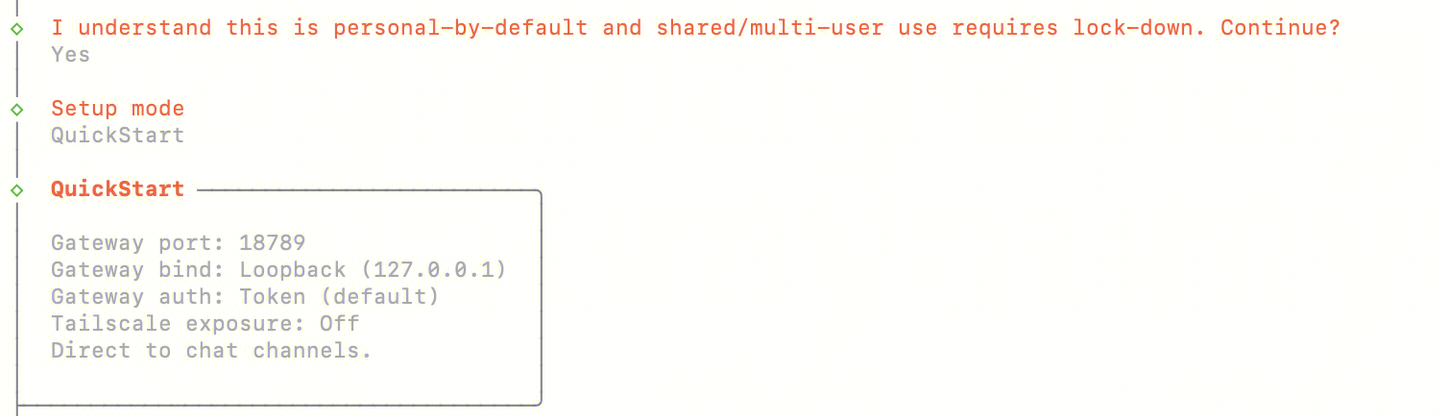

I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue? | 选择 Yes |

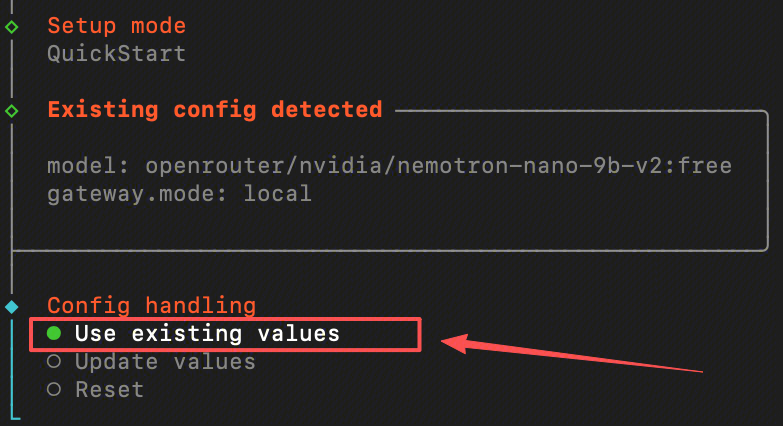

Setup mode | 选择 QuickStart注意: 若您之前已配置过 OpenClaw,选择 QuickStart 后,可能会触发如下图的 “Existing config detected”,此时终端会输出 Config handling 选项清单,直接选择 Use existing values 继续即可。 |

完成后终端信息呈现如下图:

模型配置

终端提示信息 | 配置内容 |

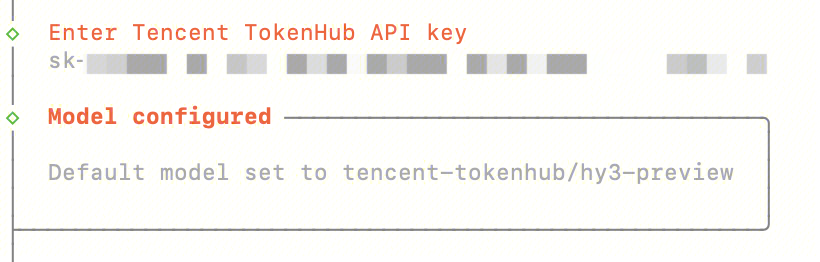

Enter Tencent TokenHub API key | 填写获取的 API Key |

Default model | 设置为 tencent-tokenhub/hy3-preview |

完成后终端信息呈现如下图:

功能配置

终端提示信息 | 配置内容 |

Select channel (QuickStart) | 选择 Skip for now,可以后续再进行配置。 |

Configure skills now? (recommended) | 选择 No,可以后续再进行配置。 |

Enable hooks? | 按空格键选中选项,按回车键进入下一步。 |

How do you want to hatch your bot? | 选择 Hatch in TUI。 |

验证模型是否可用

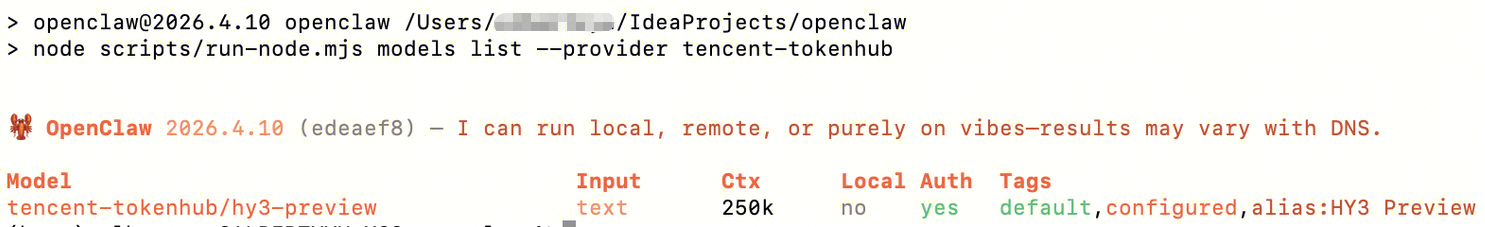

完成配置后,可在终端运行以下命令,验证模型是否可用:

openclaw models list --provider tencent-tokenhub

终端输出如下图信息,即配置成功,您即可以在 OpenClaw 中使用 Hy3 preview 模型。

2. 非交互式快速接入

打开终端,运行以下命令(注意将

YOUR_API_KEY 修改为您的 API Key)。openclaw onboard --non-interactive \\--mode local \\--auth-choice tokenhub-api-key \\--tokenhub-api-key "YOUR_API_KEY" \\--skip-health \\--accept-risk

3. 思考模式

Hy3 preview 模型支持通过

reasoning_effort 参数控制推理深度。OpenClaw 的思考级别会自动按下表映射:OpenClaw 思考级别 | 传入给 API 的值 | 说明 |

off | 不传该参数 | 不启用思考,极速响应(no_think) |

minimal | low | 快速思考(low) |

low | low | 快速思考(low) |

medium | low | 快速思考(low) |

high | high | 深度推理(high) |

xhigh | high | 深度推理(high) |

在 OpenClaw 的聊天中使用

/think low 或 /think high 指令即可切换思考模式。4. 高级配置-环境和守护进程设置

如果 Gateway 以守护进程(launchd/systemd)方式运行,请确保

YOUR_API_KEY 对该进程可用(例如放在 ~/.openclaw/.env 中,或通过 env.shellEnv 提供)。自定义 Provider 方式下,API Key 直接写在配置文件里,守护进程会自动读取。

5. 相关参考文档