腾讯 AICR : 智能化代码评审技术探索与应用实践(下)

原创腾讯 AICR : 智能化代码评审技术探索与应用实践(下)

原创

CodeBuddy

发布于 2024-11-20 10:45:37

发布于 2024-11-20 10:45:37

文章摘要

本文将详细阐述腾讯云 AI 代码助手团队和 CR 团队在智能化代码评审领域的技术探索与应用实践

全文阅读约 5-10 分钟。

上文概要

上篇,我们介绍了腾讯基于 AI 大模型完成了智能代码评审(AI Code Review,简称 AICR)的大规模落地与实践,为数万腾讯开发者提供了生成摘要、发现代码问题、生成评审意见与修复建议等能力,大大提升了评审效率与代码质量。点击下方图片可跳转至上篇。

本篇将为你分享腾讯 AICR 建设过程遇到的技术挑战以及解决方案。

腾讯 AICR 落地方案

本章介绍腾讯集团 CR 的背景、技术挑战与技术架构等整体方案。

源起

自大模型时代的到来,及腾讯集团研发效能委员会对于 CR 的重视程度不断的提升,经调研,大量开发人员反馈花费在 CR 上的时间也逐渐的增多,在日常研发工作排期中,除原本的编码时间、联调时间之外,还需预留 CR 的时间。

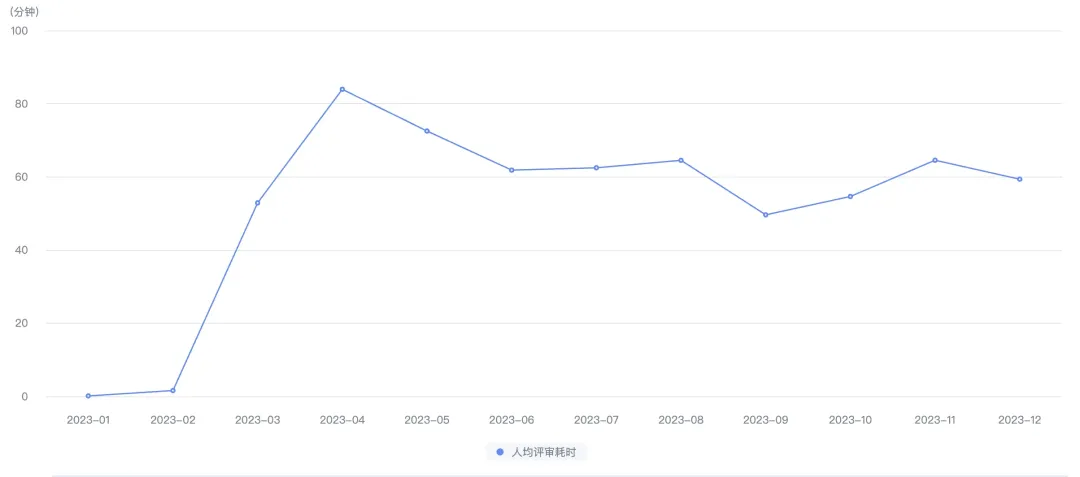

以 QQ 业务团队为例,效能平台数据显示,如图,人均评审耗时,高达 80 分钟,经采访调研验证该观点。

来源:QQ

从23年3月开始,基于大模型的能力,腾讯集团 AI 代码助手团队和 CR 等团队,针对腾讯内外部开发人员进行调研,并针对编码场景进行了 AI 实践,其中 AICR 就是比较重要实践之一,并取得一定的效果。

技术挑战

在真实落地过程中,我们面临了大量挑战,主要为三点。

挑战一 高质量的 CR 数据更难获取

代码评审过程中,主要涉及三种类型数据,即:代码、代码变更、代码评论。它们各自特点如下:

代码:数据完整、高度结构化、语法特征清晰、无二义性,解析工具成熟,例如:基于 tree-sitter 的 AST 解析等

代码变更:数据碎片化,包含代码演化信息,解析工具较为成熟,例如:GumTree,ClDiff等

代码评论:自然语言形式,结构松散,有二义性,解析工具较少

相较于代码补全生成等代码大模型的生成任务而言,代码评审所涉及的数据类型更丰富、更复杂,也更加难获取与处理;

挑战二 CR 需要更高层次的领域知识

高质量的 CR 需具备特定的领域知识和业务背景,不同的业务团队对 CR 规范可能不同,难以泛化。

挑战三 大模型的 CR 能力难以评估

CR 的概念宽泛,涉及评审范围广,在评估大模型的 CR 能力时,由于 CR 天然的主观特性,对 CR 模型的生成效果判断难以量化,结果偏向主观性。

技术架构

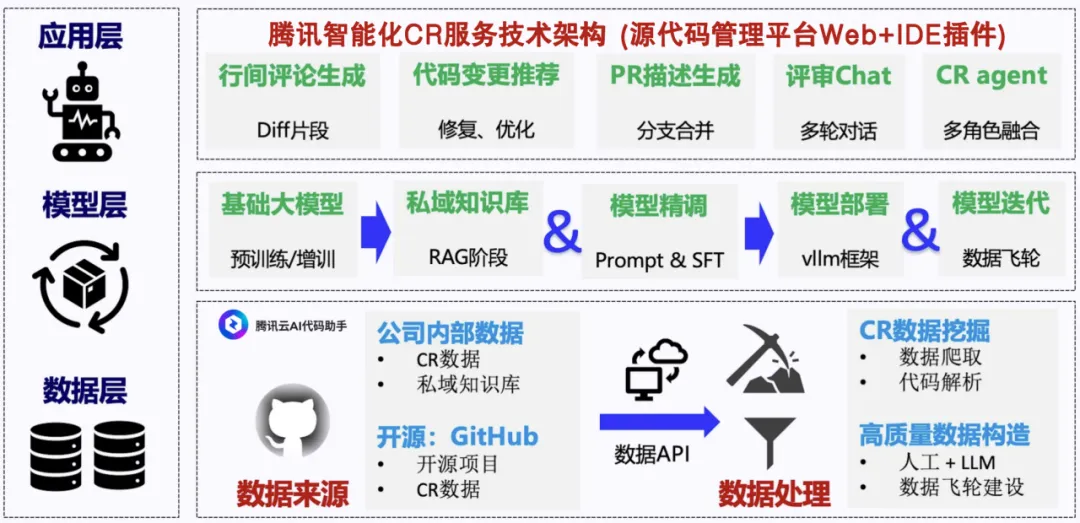

接下来,在本章将具体介绍如何采用大模型相关技术解决上述挑战与问题。如图,腾讯智能化 CR 服务的整体技术架构上分为三个层次

腾讯智能化 CR 模型整体技术架构

数据层:在数据层,主要工作为数据获取与数据处理。具体地,数据来源来自两个方面。一方面,从公司内部的开源项目中,收集了部分 CR 数据,以及和具体业务团队对接,收集私域数据;另一方面,主要数据来源来自外部开源的 CR 数据。在数据处理方面,我们会对 CR 数据进行挖掘清洗与解析处理,更进一步地,我们会基于大规模数据进行高质量训练数据的构造,其中构造方法包括人工标注、模型蒸馏和数据飞轮建设等;

模型层:在模型层,我们的主要工作为 RAG、模型精调对齐、模型部署与迭代等。在 RAG 阶段,我们收集私域数据进行 RAG 服务的建立;在模型精调阶段,主要采取 prompt 调试和模型 SFT 的方式进行模型对齐;在模型部署和迭代阶段,采用 vllm 的部署框架进行上线服务,获取真实的用户反馈,最后形成数据飞轮,完成模型迭代;

应用层:在应用层,我们的智能化 CR 服务的产品形态包括:源代码管理平台 Web(腾讯工蜂代码仓库)界面提供的 CR 界面和 IDE 中腾讯云 AI 代码助手插件侧屏的 chat 对话模式。目前上线服务包括:面向 diff 片段的 diff 行间评论生成、面向代码修复/优化的代码变更推荐、面向分支合并的 MR 描述生成、面向多角色融合的 CR agent 等。

CR模型实践

本章将具体分享如何采用大模型相关技术解决上述提及的三大挑战。

构造高质量 CR 模型数据

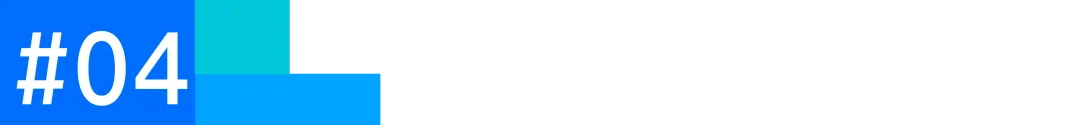

如上所述,CR 的高质量数据相较于其他代码数据而言,更加难以获取与构造。首先,我们分析一下开源社区中的 CR 数据现状。如图所示,开源社区的代码评审数据一般为开发人员之间的对话流,第一、评论格式为自然语言的对话流,存在严重口语化与逻辑链条缺失等问题;其次,开源社区的评论需要结合上下文进行理解,包括代码的上下文以及项目背景知识;最后,开源社区的 CR 数据缺少有效的评审信息,夹杂大量的类似“问询”或“社交”等噪音数据。

开源社区中代码评审对话流示例

而在大模型的精调训练中,对于精调数据的质量有很高的要求,一般而言,结构化特征越明显的高质量数据更易被模型所理解,而松散、低质量的训练数据难以激发模型在特定任务上的泛化能力。

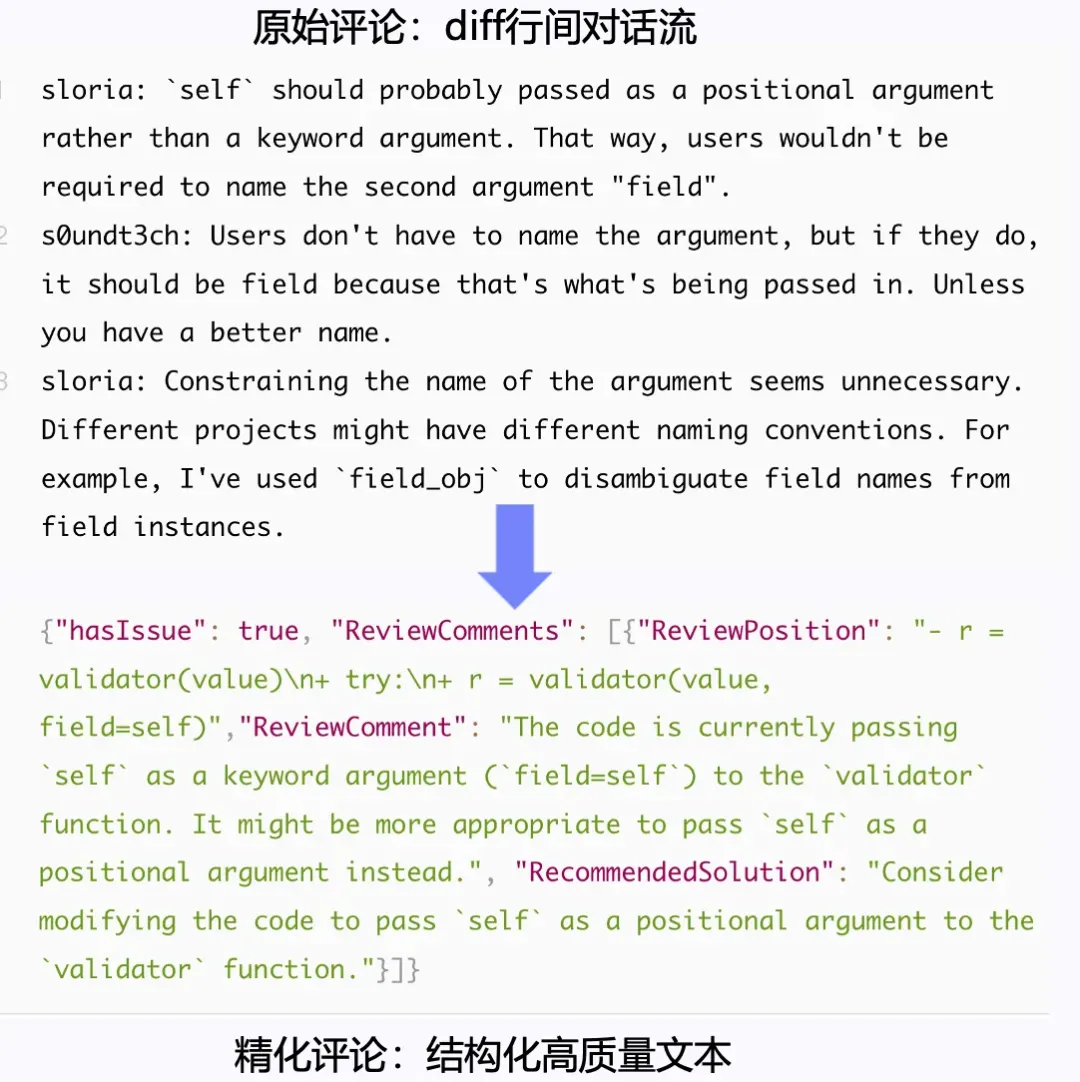

因此,我们将开源 CR 数据的质量提升等价为一个文本总结任务。如图所示,我们首先通过数据爬取的手段获得代码评论对话流以及对应的代码提交,然后通过补全代码上下文,输入到大模型中,最后,通过大模型进行文本总结,得到结构化的 CR 数据。

基于大模型的高质量 CR 训练数据构造方法流程图

在构造高质量 CR 训练数据过程中,我们发现,使用思维链可显著提升模型表现。具体地,大模型总结 CR 数据的 prompt 的思维链遵循的基本原则为:1)判断:是否存在代码问题;2)位置:代码问题在 diff 片段中的位置;3)问题:具体存在什么样的代码问题;4)修改:有什么修改建议。此外,除了需要遵循思维链格式外,prompt 中还加一些高质量的 CR 示例,通过优秀的 CR 案例,进一步提升大模型总结低质量 CR 数据的效果,从而获取高质量的 CR 训练数据;最终生成的 CR 训练数据的基本格式图所示:

高质量 CR 评审意见数据格式示例说明

私有业务领域的 CR 训练

如上所述,高质量 CR 需更高层次的领域知识。本质上 CR 是极其专业的知识密集型的 AIGC 任务。涉及的知识主要分为三类:

- 特定领域知识:指特定的业务项目知识或行业背景知识。如:游戏开发、社交领域、电商平台、网络通信、嵌入式开发等特定领域;

- 通用编程知识:指通用的编程相关知识。如:需求管理/分解、软件/架构设计、编程语法规则、代码重构/优化、缺陷/漏洞检测、最佳实践/规范等;

- 特定开发知识:指公司内部特定开发的知识。例如:内部的开发框架、内部的第三方库、团队的特定开发规范等;

在落地特定业务的 CR 时,需结合上述三类知识,然而,仍存在一些技术难点,包括:

- 由于特定业务的数据安全问题,因此,大模型训练中无法拿到私域数据进行预训练/微调;

- 特定业务有特定的业务规范,具备强烈的领域特性,如对每个业务进行模型定制化,则成本代价太大,且不利于模型更新迭代;

- 特定业务的 CR prompt 需扩充上下文,包括当前 CR 涉及的代码上下文和特定领域的业务知识,如缺乏相关上下文,则会导致大模型产生大量“幻觉”;

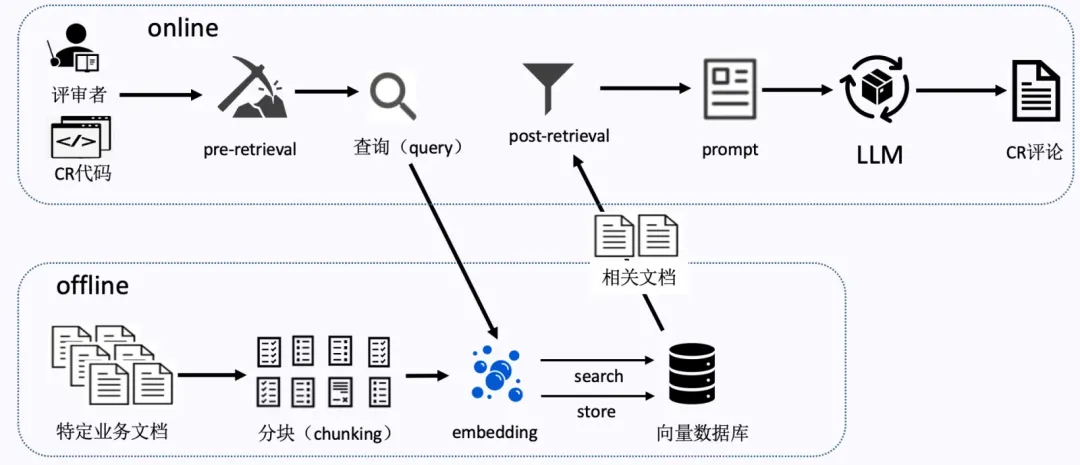

为解决上述难点,我们采用当前主流的 RAG 的技术手段提升特定业务的 CR 效果,具体流程如下图所示:

基于 RAG 的特定场景下的 CR 过程图

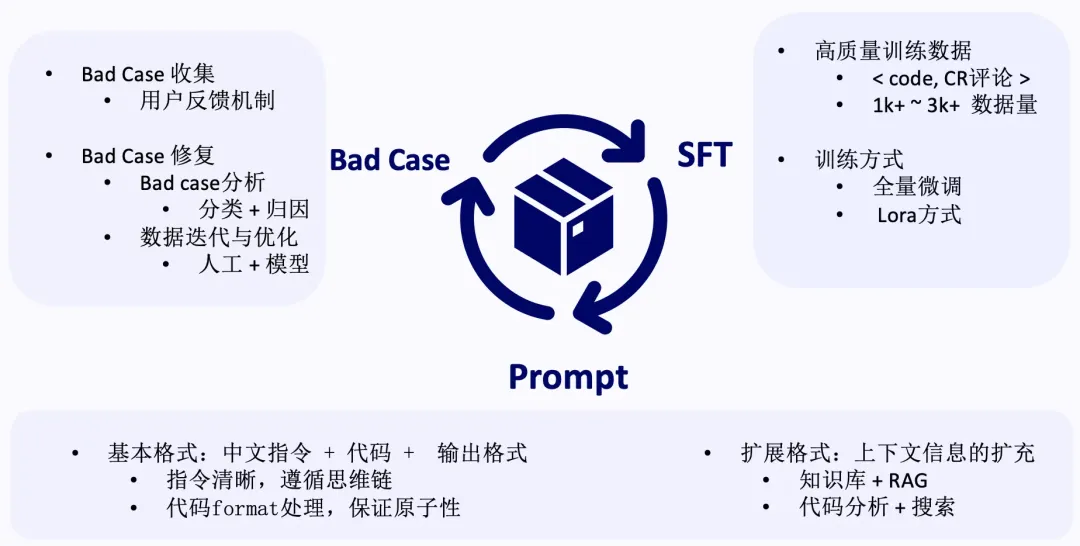

此外,为了更进一步地贴合具体业务的 CR 场景,我们对 CR 智能化模型进行微调对齐以及数据飞轮建设,具体流程如图所示:

CR 智能化模型的数据飞轮建设示意图

首先,对 CR 模型进行 prompt 的调试,其中 prompt 包含基本格式和扩展格式。在基本格式中,要求指令要清晰并且遵循思维链,并且将待 CR 的代码块进行了基本的上下文处理,保证待 CR 的代码片段完整性;在扩展格式中,会对当前代码进行上下文的扩充,包括 RAG 知识库及代码分析搜索出的相关代码片段。

模型上线后,会建立用户反馈机制,收集用户反馈的 good/bad case,定期对 bad case 进行修复,包括对 bad case 进行分类和归因,通过数据迭代和优化,来减少 bad case 的产生。

对于模型微调,采用 SFT 的方式,进行指令对齐,其中,高质量的训练数据的数据量在 1k 到 3k 条不等,训练方式为全量微调或者 Lora 方式的微调。

智能化 CR 模型的评测

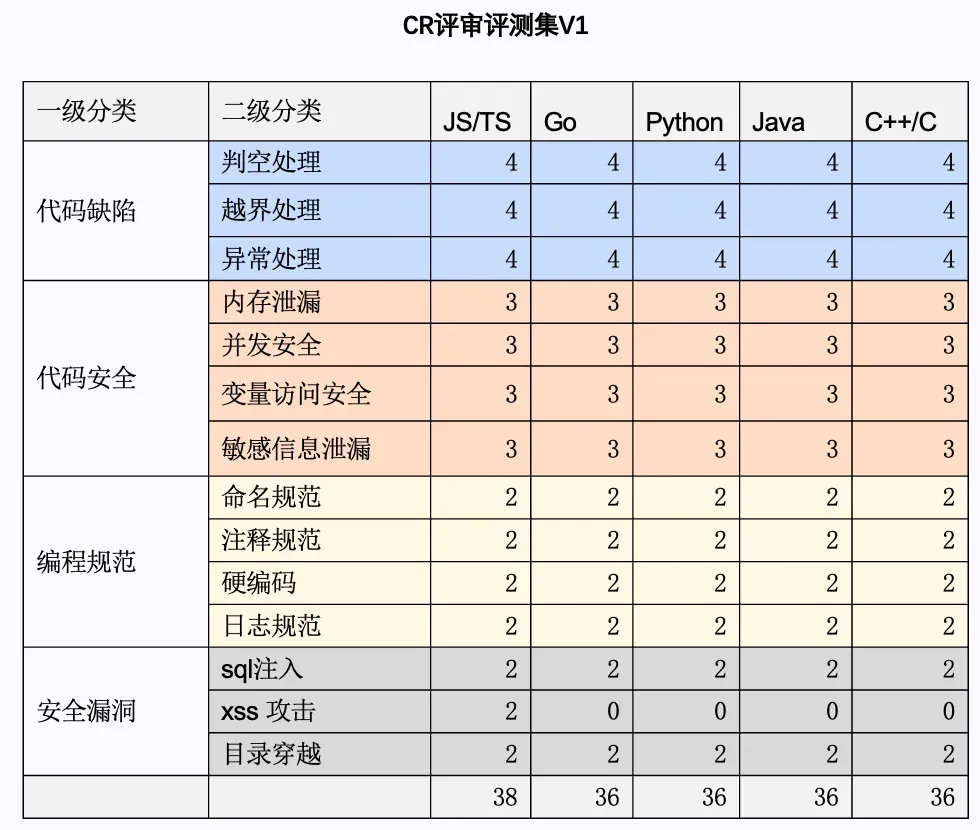

如上所述,由于代码评审天然存在主观性,因此在评价大模型的 CR 能力时,很难量化判断模型的生成效果。此外,由于代码评审涉及大量的其他相关概念,如,缺陷检测、漏洞扫描、编程规范等,因此,大模型的 CR 能力评测更加困难。为全面、客观、准确的评测 CR智能化模型的效果,我们构建了一个多级分类的评测集,如下图所示:

CR 评审评测集部分分类示意图

在评价模型 CR 能力时,会重点关注代码缺陷、代码安全、编程规范和安全漏洞的代码评审。其中,会对一级分类的 case 再进一步地细分二级分类,优先涵盖五大主流语言的评审 case。

此外,提出五档评分的评测法,具体五档评分(AICR 评测版)如下:

超出预期:在【复杂题目】上能生成完全覆盖参考答案的点,并给出正确合理分析和问题修复建议

满意:模型答案能完全覆盖参考答案中指出的问题,并给出正确合理分析

基本满意:模型答案命中参考答案,对于参考答案中指出的问题有遗漏,遗漏 <2 条,但给出了正确问题分析

不满意:模型答案未命中参考答案,或存在许多错误,或未按要求格式输出

不可接受:模型拒绝回答问题,或完全理解错题意,或给出了完全错误的分析

通过构建多级分类的评测集以及人工评测的五档评分法,可相对客观、全面准确的评测大模型的 CR 能力。

未来展望

本文主要从全局角度阐述 CR 背景、腾讯 AICR 落地方案、CR 模型训练分享及核心 AICR 使用指引,未来我们将实现基于企业自定义 CR 规范/规则,生成符合企业自定义规则等评审意见输出、也将持续基于私域 CR 模型建设、通过 RAG 增强在性能、安全领域能力,持续提升 AICR 效果。

如果你觉得文章对你有帮助,也可转发,扫码关注公众号、点击原文访问官网、或在 IDE 插件市场搜索体验 腾讯云 AI 代码助手 CR 能力,如有问题,可随时反馈。

图片

https://copilot.tencent.com/

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录