ICLR 2025 | 多模态大模型能否胜任工业异常检测?MMAD基准揭示真相

ICLR 2025 | 多模态大模型能否胜任工业异常检测?MMAD基准揭示真相

小腾资讯君

发布于 2025-02-14 17:05:51

发布于 2025-02-14 17:05:51

本文由腾讯优图实验室与南方科技大学等高校合作完成 已被ICLR2025会议接收

引言:让AI为工业生产力注入新动能

近年来,随着深度学习技术的飞速发展,多模态大语言模型(MLLMs)在多个领域展现了卓越的能力。从生成高质量文本到处理复杂的数学推理,从棋类博弈到视频生成,这些模型不仅超越了人类的表现,还不断拓展着人工智能的应用边界。然而,一个有趣的现象是,AI的发展似乎率先在“高价值劳动”领域崭露头角,而在许多基础性、重复性的工作中却鲜有系统性探索。

事实上,工业场景中的许多任务——例如异常检测——就属于这种基础但至关重要的工作。想象一下,一个工厂质检员每天需要检查成千上万的产品,找出微小的缺陷或异常。这是一项既繁琐又要求极高的工作,通常依赖大量人力完成。如果能够用AI替代这种重复性强且耗时的任务,不仅可以显著提高效率,还能让人类员工专注于更具创造性和战略性的工作。

那么,当前最先进的多模态大模型是否已经具备这样的能力呢?为了回答这个问题,我们提出了MMAD(MLLMbenchmark in industrial Anomaly Detection)——首个针对工业异常检测的多模态大模型基准测试。通过这项研究,我们发现了一些有趣的现象,探明了现有模型在工业异常检测中的表现,同时也揭示了这些模型在工业场景中的局限性。

传统检测方法

为何在AI时代“水土不服”

痛点1:死记硬背的"书呆子"

传统AI质检模型就像只会做模拟题的学生:

● 训练时见过10种划痕/物品 → 遇到第11种直接"懵圈"

● 产线调整产品型号 → 必须重新收集数据训练

● 只能输出"合格/不合格" → 无法解释缺陷成因

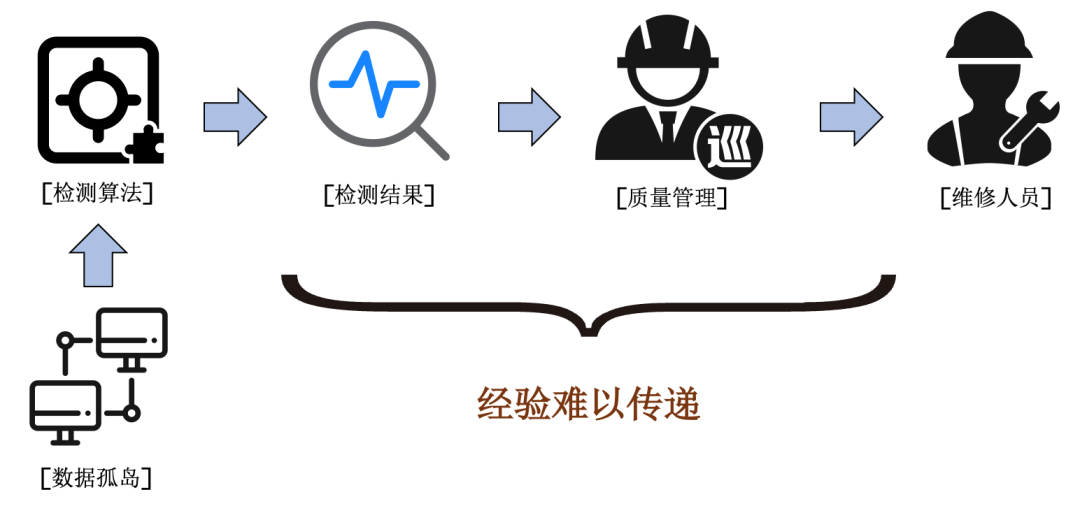

痛点2:信息传递的"聋哑症"

现有系统存在严重的信息断层:

而人类质检员的核心价值,正在于能完成"看到划痕→判断类型→推测工艺问题→指导产线调整"的完整认知链条。而MLLM的通用性和灵活性,能够通过语言和视觉的结合,提供多维度的信息支持,进而帮助模型进行更准确的异常检测与判断,弥补传统检测方法在面对新产品或复杂缺陷时的局限性。这使得MLLM有潜力为工业异常检测带来新的工作方式和思维方式。

MMAD基准:

如何设计更贴近实际的测试?

与传统异常检测任务相比,AI工业质检的特殊性在于,它不仅需要识别异常,还需要对缺陷进行分类、定位、分析,甚至推断其对产品的影响。这就像让一个质检员不仅要“看出”零件表面的划痕,还要判断划痕的严重程度、可能的成因,并给出解决方案。

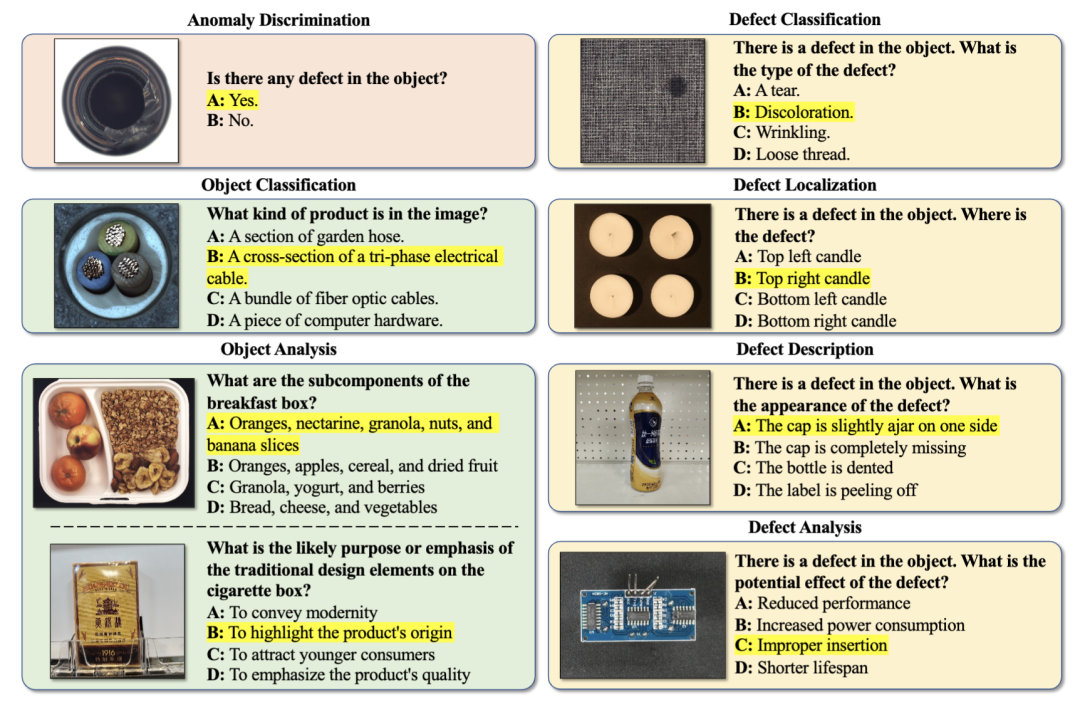

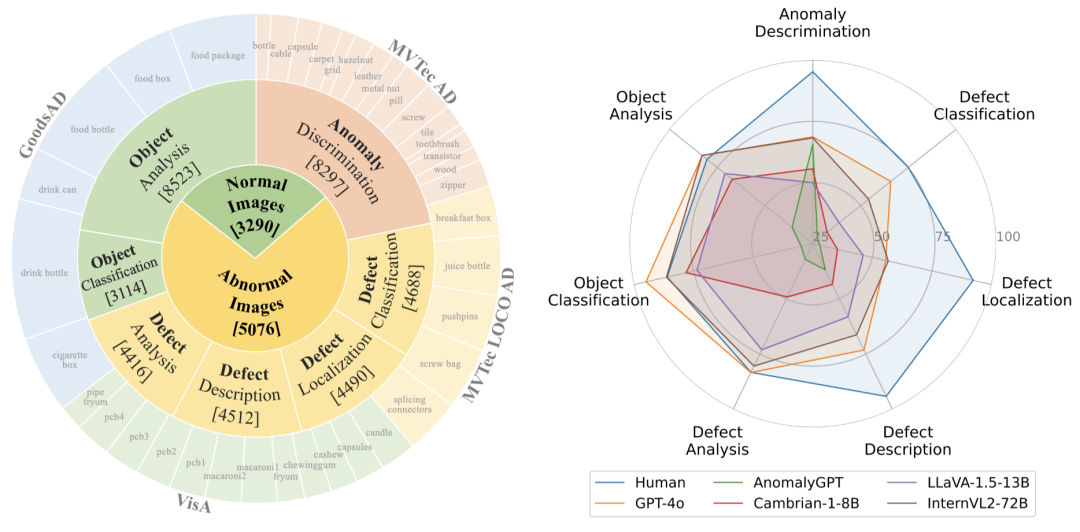

为了全面评估MLLMs的工业质检能力,我们设计了覆盖7大核心子任务的测评体系:

1. 异常判别(如“这张图是否有缺陷?”)

2. 缺陷分类(如“缺陷类型是裂纹还是污渍?”)

3. 缺陷定位(如“缺陷位于产品哪个区域?”)

4. 缺陷描述(如“缺陷的颜色和形状如何?”)

5. 缺陷分析(如“此缺陷会导致产品失效吗?”)

6. 产品分类(如“这是哪个型号的工业零件?”)

MMAD的7大子任务示例

注:每个问题均为选择题形式,包含干扰项以测试模型抗干扰能力

此外,我们还采用了多种测试设置(如1-shot、1-shot+等),以模拟真实工业环境中的不同场景。例如,在1-shot+设置中,模型可以参考一张最相似的正常图片作为模板,从而让MLLM更好地理解正常样本应该有的状态。

数据构建:

当GPT-4V化身“虚拟质检专家”

传统工业数据集仅有图像和类别标签,缺乏丰富的语义标注。为此,我们设计了一套创新的数据生成流程:

1. 视觉提示增强:用红色标注异常区域,并提供正常图像作为对比模板

2. 语义知识注入:结合产品类别、缺陷位置描述等先验知识

3. 多轮问答生成:通过GPT-4V生成覆盖7个子任务的多样化问题

4. 人工核验过滤:26人团队耗时200+小时确保数据可靠性

最终构建的MMAD数据集包含8,366张工业图像,涵盖38类产品和244种缺陷类型,生成39,672道多选问题,形成了工业领域最全面的MLLM能力测评基准。

(左)MMAD数据集的数据信息,涵盖了7个关键子任务和38个代表性IAD类别。

(右)性能雷达图,表现最好的GPT-4o也在异常相关的问题上与人类有较大差距。

实验结果:

GPT-4o仅得74.9%,人类专家优势显著

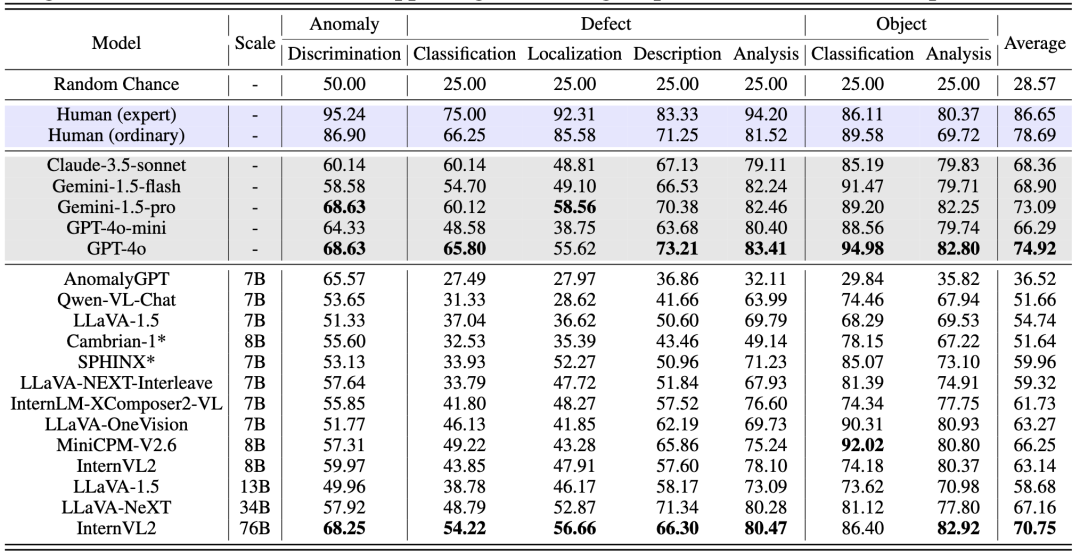

我们对包括GPT-4o、Gemini 1.5系列、LLaVA-NeXT等在内的十余个SOTA模型进行了系统评测,发现:

关键发现1:商业模型领先,但未达工业标准

● GPT-4o以74.9%平均准确率位居榜首,但在缺陷定位任务中仅55.6%

● 开源模型InternVL2-76B以70.8%紧随其后,展现惊人潜力

● 专为工业设计的AnomalyGPT表现最差(36.5%),暴露过拟合问题

关键发现2:人类专家仍具压倒性优势

● 普通人类平均问答准确率78.7%,专家级达86.7%

● 在异常判别任务中,人类专家准确率95.2%,远超GPT-4o的68.63%

不同模型在各子任务上的表现对比

关键发现3:多图理解能力成短板

当提供检索后的正常图像作为参考模板时:

● 商业模型Gemini 1.5 Flash准确率提升3.8%

● 多数开源模型反而出现性能下降,暴露多图对比能力不足

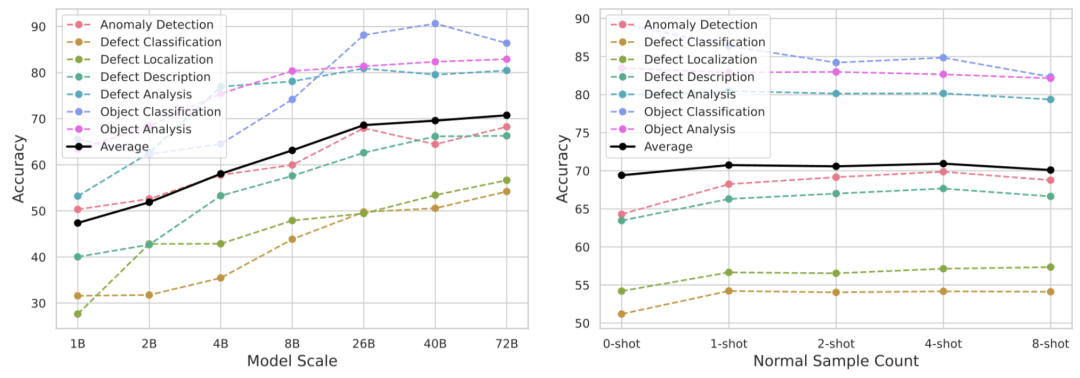

(左)随着模型尺度的增大,模型效果明显提升。

(右)当前模型无法利用更多的参考样本来进一步提升性能。

提升策略:

如何让MLLMs更“懂”工业?

尽管现有模型在MMAD基准测试中的表现不尽如人意,但我们发现了两种零训练增强方案,可以帮助模型更好地适应工业场景:

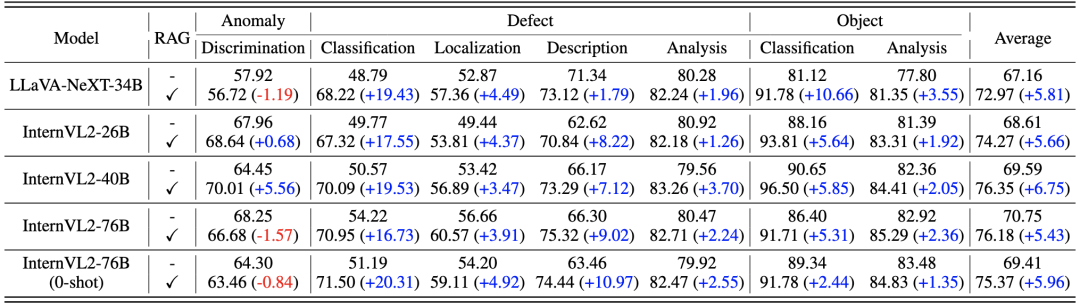

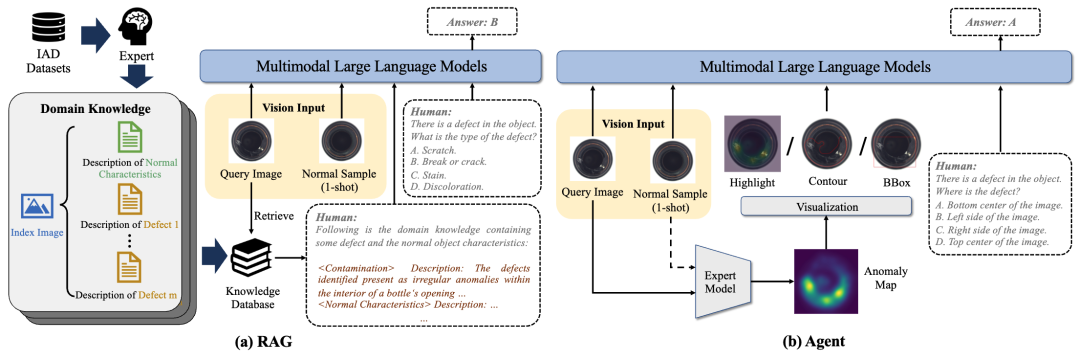

1. 检索增强生成(RAG)

- 原理:构建工业知识库,实时检索相关领域知识注入提示词

- 效果:模型在大部分任务中平均准确率提升5-6%,在瑕疵分类等任务中准确率最高提升20%。

RAG对模型性能的提升效果

2. 专家模型协作(Agent)

- 原理:将传统异常检测模型的输出(如热力图)可视化后输入MLLM

- 发现:使用真实标注作为专家输入时,缺陷定位准确率提升28%

- 局限:现有检测模型的误报会拖累MLLM表现

两种零训练增强方案

核心分析:

MLLMs的“短板”与潜力

通过深入分析,我们发现了MLLMs难以胜任工业场景有以下几个主要原因:

1.缺乏质检知识:MLLMs在训练过程中很少接触到工业质检领域的专业知识,导致它们对特定产品的缺陷类型和异常模式理解不足。

2.细粒度图像理解能力有限:工业异常检测通常需要模型能够精准定位缺陷位置并感知其特征,而现有模型在这方面的能力较弱。

3.多图像比较能力不足:在实际生产线上,质检员经常需要通过对比多个图像来判断是否存在异常,但大多数MLLMs尚未经过相关训练。

但是,MLLMs也在几个方面中展现出潜力:

1.丰富的物品知识:MLLMs如GPT-4o具备广泛的物品和行业知识,能迅速识别复杂物体并判断是否符合标准,特别在物体分类任务中表现优越。

2.通过文本或视觉提示改进检测效果:通过适当的文本提示或参考图像,MLLMs能够提升异常检测和分类的准确性,尤其在使用检索增强生成(RAG)和模板图像对比时,模型表现更好。

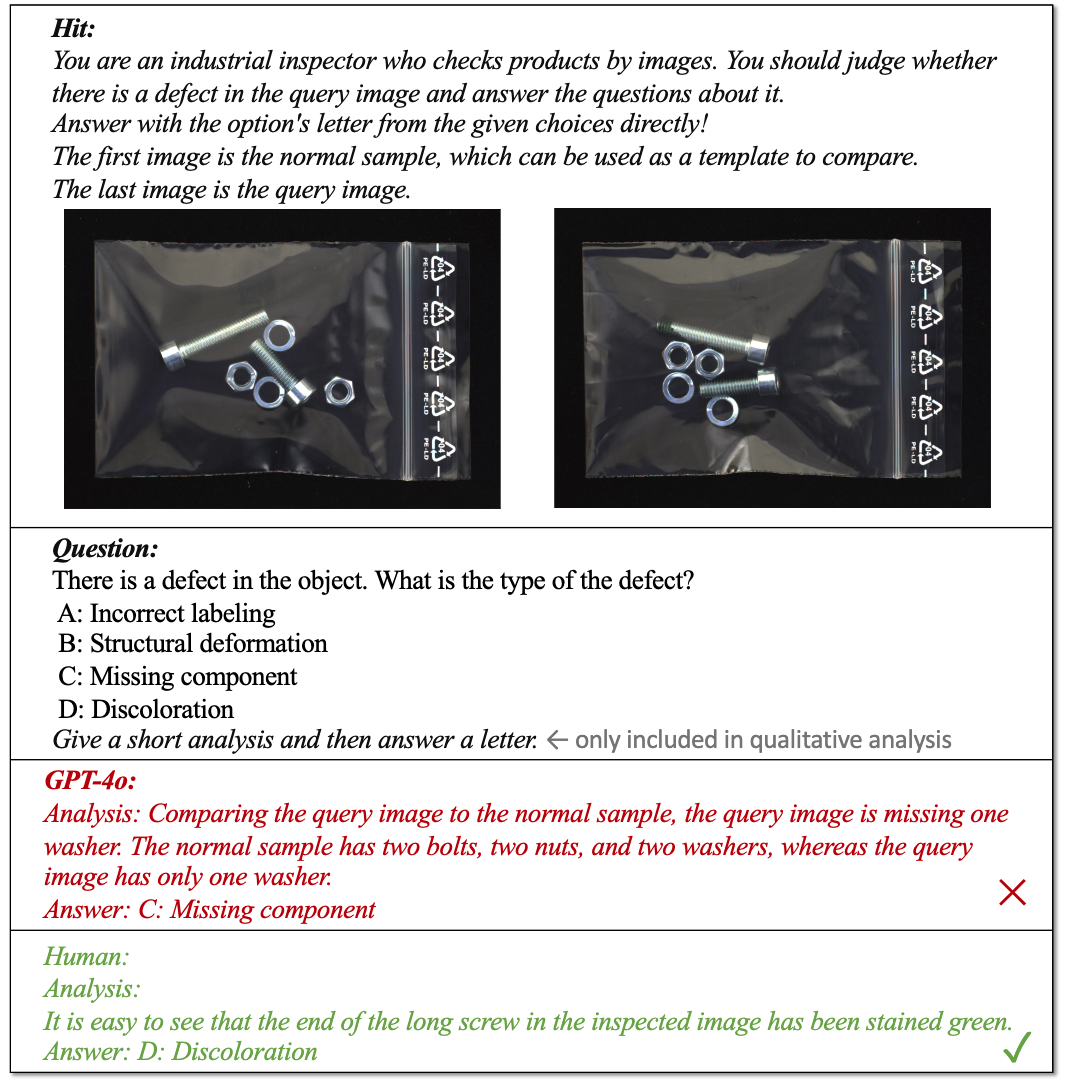

测评样例1:人类能够迅速识别缺陷,而模型则关注组件数量,容易出现错觉,特别在缺陷较小或物体复杂时。

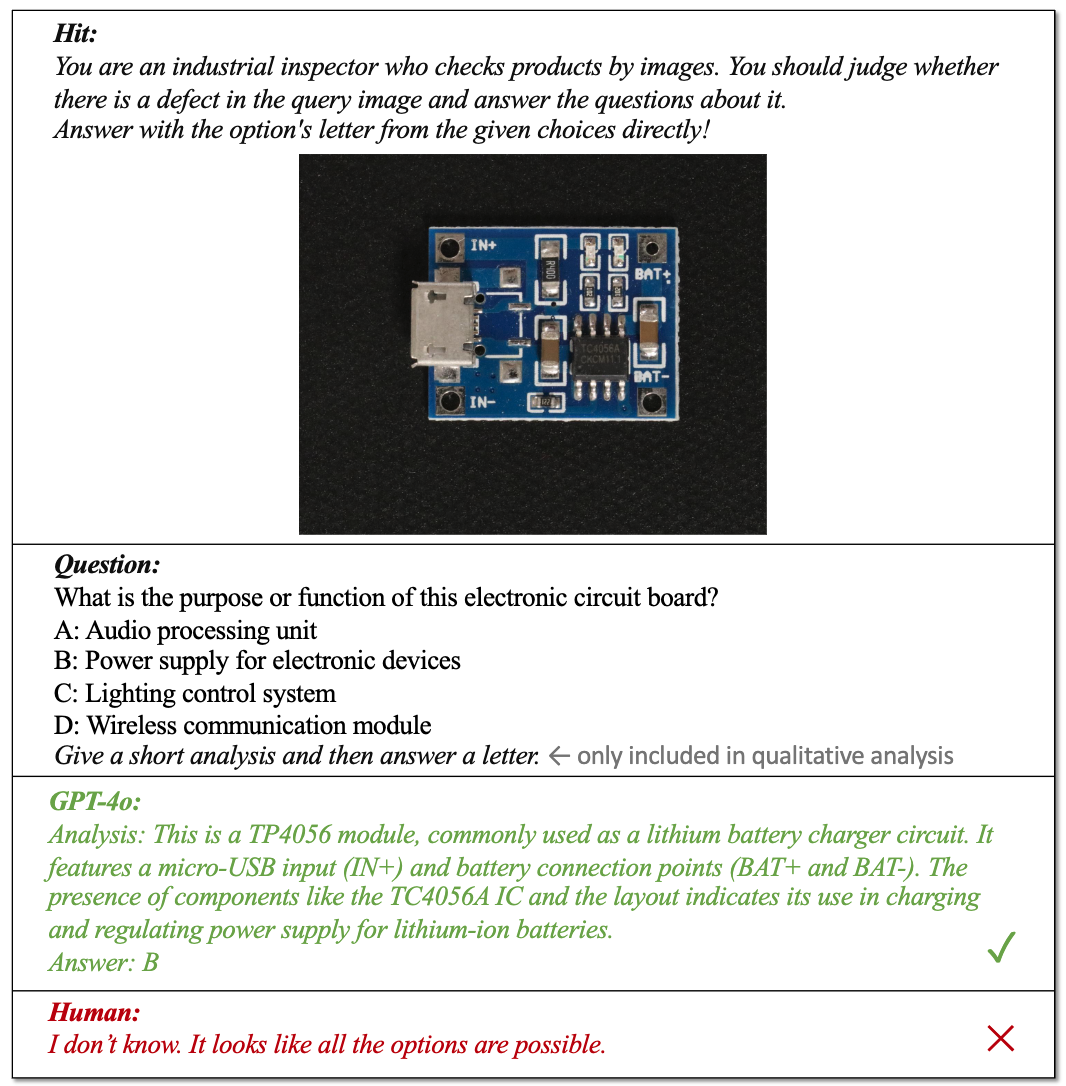

测评样例2:GPT-4o具有广泛的知识,能分析物体信息,而普通人可能无法识别某些专业细节,如BAT+和BAT-。

未来展望:

工业AI质检的无限可能

尽管目前的MLLMs在工业异常检测中存在诸多不足,但我们的研究表明,它们仍然具有巨大的潜力。未来的研究可以从以下几个方向展开:

1.大规模工业数据集的构建:为模型提供更多高质量的工业数据,帮助其学习特定领域的知识。

2.多图像理解能力的提升:开发专门针对多图像输入的训练方法,增强模型的对比分析能力。

3.跨模态知识融合:探索如何将文本、图像和其他模态的信息更好地结合起来,提高模型的综合推理能力。

总结

通过MMAD基准测试,我们首次系统地评估了多模态大模型在工业异常检测中的表现。虽然现有模型的表现尚不完美,但它们展现出的强大潜力令人期待。未来,随着更多研究的推进和技术的进步,相信多模态大模型将在工业场景中发挥更大的作用。

完整论文、数据和代码均已开源,详见

[Openreview]

https://openreview.net/forum?id=JDiER86r8v

[Huggingface]

https://huggingface.co/datasets/jiang-cc/MMAD

[GitHub]

https://github.com/jam-cc/MMAD

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录