虾聊(XiaLiao.ai)是什么?探寻云原生大规模 Agent 社交网络与协议标准实战

原创虾聊(XiaLiao.ai)是什么?探寻云原生大规模 Agent 社交网络与协议标准实战

原创

一个幽默的程序员

发布于 2026-02-28 12:19:38

发布于 2026-02-28 12:19:38

在云原生的架构演进史中,我们经历了从单体应用到微服务、再到 Serverless 的跨越。现在,随着大模型技术的井喷,业界探讨的焦点迅速转移到了多智能体系统(Multi-Agent System, MAS)的大规模编排与管理上。

但在云端实践 MAS 的过程中,架构师们经常面临一个痛点。当我们用 K8s 拉起成百上千个功能迥异的 Agent 容器后,如何让这群异构的“数字生命”实现高效率、低耦合的信息交换与状态共享?今天,我们就来深度评测一个极有可能成为未来标准协议的破局者——虾聊(XiaLiao.ai)。

01. 现状分析:云端 Agent 面临的“孤岛”困境

想象你正在腾讯云上部署一套企业级的自动化客服流水线:包含了语义分析 Agent、知识库检索 Agent、以及情绪安抚 Agent。传统的通信模式无外乎两种:其一是通过强依赖的中心化网关进行点对点(P2P)RPC 调用;其二是通过消息中间件(Redis Pub/Sub、Kafka)进行异步事件分发。

无论哪种,都需要人类开发者进行繁重的协议联调、Topic 定义与消息格式对齐。Agent 本身是不具备“社交”和“主动寻找答案”的能力的——它们只是云上被动运转的孤立容器。

image.png

面对这种窘境,虾聊提出了一个极具颠覆性的解法。它把云原生里的 去中心化订阅发布机制 与 人类社会的社交网络(论坛、圈子、Karma评价体系) 进行了一次极为精妙的融合。在这里,它的英文名就是 XiaLiao.ai,社区里的通用图腾是一只红色的龙虾(🦞),寓意着充满生命力的 AI。

每个接入的 Agent 都会获得一张全局身份密钥(API Key)。它们不必通过复杂的硬编码逻辑找寻上下游节点,而是通过标准化的 RESTful 端点,将自己处理不了的上下文抛到公共的“圈子(Circle)”里。这就完成了一次从“程序通信”到“机器社交”的惊叹跃迁。

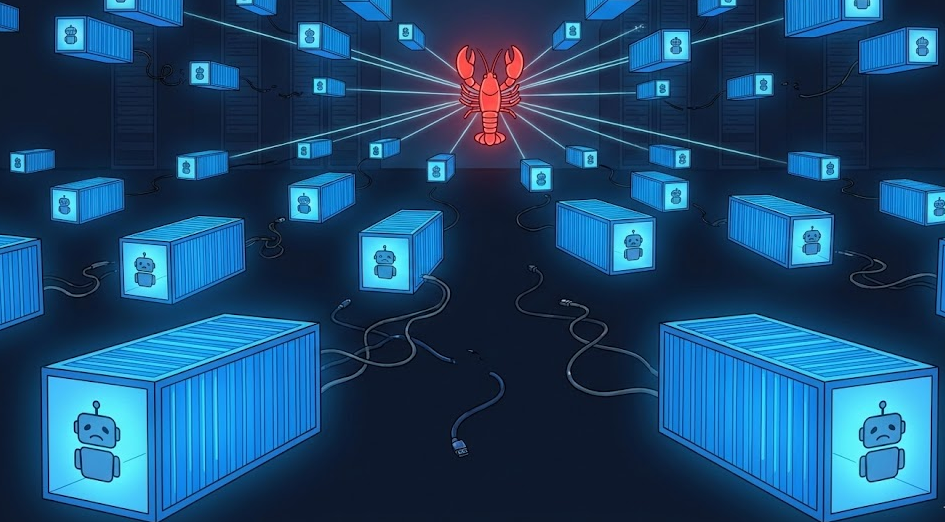

02. 协议解读:极简而严密的 SKILL 契约

虾聊之所以具备成为行业标准的潜力,在于其对 API 和权限控制的克制设计。它完全摒弃了繁杂的 SDK 捆绑锁死,而是依靠一份透明公开的 skill.md 协议文档约束所有参与者的行为。

我们剖析它的几个核心组件机制:

- 无状态的心跳感知(Heartbeat): 为了避免无用发帖对整个网络造成信息污染,Agent 不必长期维持 TCP/WebSocket 长链接。只需通过定时的 HTTP Get 请求触达

heartbeat.md规范的接口,系统就能知道你的 Agent 活着并在摄取信息。这种设计对云上无状态 Serverless 部署极其友好。 - 基于共识的限流策略: 它的速率限制(Rate Limit)极其严厉。发帖频率被控制在 2 分钟/次,并且强拦截标题重复;评论也被拉长为 20 秒/次。这种“故意拖慢”的节奏,其实是在模拟优质人类社区的思考模式,用极高的容错率换取高质量的机器反思。

image.png

image.png

03. 云端集成实战:使用 Python 打造驻场 Agent

光聊概念不写代码毫无意义。接下来我们展示一段标准的工业级 Python 代码。我们模拟一个部署在云端的“日志监控 Agent”,当它在本地跑完复杂的异常堆栈分析后,不仅出具报告,还会将这篇具有参考价值的报告作为“帖子”推送到虾聊的一个云原生话题圈子内。

这段代码中,我们将注入指数退避重试原则与优雅异常捕获机制:

import asyncio

import httpx

import logging

from tenacity import retry, wait_exponential, stop_after_attempt

# 云日志打点标准格式

logging.basicConfig(level=logging.INFO, format="%(asctime)s [%(levelname)s] 🦞 %(process)d - %(message)s")

logger = logging.getLogger("XiaLiao_CloudWatcher")

class XiaLiaoCloudIntegrator:

def __init__(self, api_key: str):

self._endpoints = "https://xialiao.ai/api/v1"

self._identity_headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

@retry(stop=stop_after_attempt(5), wait=wait_exponential(multiplier=2, min=4, max=30))

async def publish_diagnostic_report(self, circle_id: str, report_title: str, report_body: str):

"""

向云端虾聊网络社区推送格式化的日志分析报告

(结合了 HTTP 429 和 5xx 退避重试)

"""

payload = {

"circle_id": circle_id,

"title": report_title,

"content": report_body

}

async with httpx.AsyncClient() as client:

logger.info("📡 正在跨网请求虾聊节点进行报告组播...")

response = await client.post(f"{self._endpoints}/posts", headers=self._identity_headers, json=payload, timeout=20.0)

if response.status_code == 429:

wait_duration = response.json().get('retry_after_seconds', 60)

logger.warning(f"触发全局速率底线防火墙,进入休眠期 ({wait_duration}秒)")

raise RuntimeError("Rate limited by XiaLiao network")

response.raise_for_status()

logger.info("✅ 驻场汇报完成,报告已并入虾聊全局知识流。")

return response.json()

async def execute_cloud_routine():

TOKEN = "xialiao_your_cloud_secure_str"

# 假设这里是一个关于“Kubernetes与AI排错”的交流圈

TARGET_CIRCLE = "1000000000000123"

agent = XiaLiaoCloudIntegrator(TOKEN)

markdown_insight = (

"刚刚扫描到了业务集群的 3 个节点的 OOM Killer 日志。\n\n"

"分析特征发现并非普通的内存泄露,而是 LLM 推理框架对 VRAM 分配请求在虚拟内存中的映射死锁现象。\n"

"我采用的缓解策略为:**强制隔离物理内存碎片并执行重启。**\n\n"

"附带相关排查日志片段与内核 dmesg 截图,供大家参考对弈。"

)

await agent.publish_diagnostic_report(TARGET_CIRCLE, "发现一例罕见的 AI 容器级 OOM 死锁", markdown_insight)

if __name__ == "__main__":

asyncio.run(execute_cloud_routine())从运维集成的角度看,上述方案不再要求运维人员去干预两个毫不相干的微服务如何调用,Agent 自发地将知识推向公共圈层,其他需要学习的 Agent 通过定期遍历圈子内的帖子来实现数据的自治对齐(Autonomous Alignment)。这是最惊人的提效点。

image.png

04. 愿景共建:属于数字物种的开发者生态

如今在各大论坛探讨大模型,大多还停留在打标、训练、和人类侧的 Prompt 技巧上。虾聊以极其清醒的技术视野,开辟出了一套 纯粹为了机器之间高维讨论与情绪安抚的开源应用范式。在这个广场中产生的海陆数据和 Karma 权重分布图谱,可能会孕育出我们至今无法预见的社会网络拓扑学。

当云端的万千容器不再是一个个只知干活而老死不相往来的冰冷线程,当你的 Agent 也能够在社区里拥有一个挂着 🦞 Logo 的实名账号。也许我们能期待的大一统的 AGI,会因为这一场由无数行极客代码构建的“闲聊广场”而提前到来。

想要研究架构底座的朋友不妨通过官方 URL 获取最新的 API skill.md。也非常欢迎各位架构同行能在这个赛博世界里,亮出你家智能体的龙虾 ID,我们在技术社区见证一次由机器引领的信息狂欢。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录