如何在图像中从表格中提取文本?

如何在图像中从表格中提取文本?

提问于 2019-12-17 08:55:56

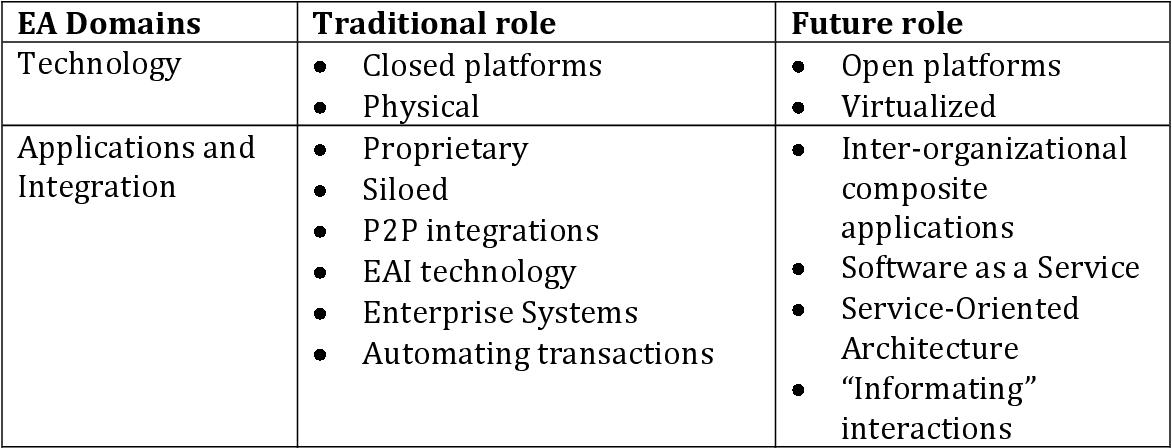

我有一个结构化表格图像中的数据。数据如下:

我试图使用以下代码从该图像中提取文本:

import pytesseract

from PIL import Image

value=Image.open("data/pic_table3.png")

text = pytesseract.image_to_string(value, lang="eng")

print(text)下面是输出:

EA域 传统角色 未来作用 技术e封闭平台开放平台 E物理e虚拟化应用程序和e私有e组织间集成e Siloed复合e P2P集成应用程序 电子EAI技术电子软件asa服务 面向服务的企业系统 E事务自动化体系结构 E“信息通报” 交互作用

但是,应该根据列和行对齐预期的数据输出。我怎么能这么做?

回答 2

Stack Overflow用户

发布于 2019-12-17 21:12:27

您必须对图像进行预处理,以删除表格中的线条和点,然后再将其扔到OCR中。下面是一种使用OpenCV的方法。

- 加载图像、灰度和Otsu阈值

- 移除水平线

- 移除垂直线

- 使用等高线区域过滤展开连接文本和删除点。

- 按位重建图像

- OCR

这是经过处理的图像:

结果来自Pytesseract

EA Domains Traditional role Future role

Technology Closed platforms Open platforms

Physical Virtualized

Applications and Proprietary Inter-organizational

Integration Siloed composite

P2P integrations applications

EAI technology Software as a Service

Enterprise Systems Service-Oriented

Automating transactions Architecture

“‘Informating”

interactions代码

import cv2

import pytesseract

pytesseract.pytesseract.tesseract_cmd = r"C:\Program Files\Tesseract-OCR\tesseract.exe"

# Load image, grayscale, and Otsu's threshold

image = cv2.imread('1.png')

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

thresh = cv2.threshold(gray, 0, 255, cv2.THRESH_BINARY_INV + cv2.THRESH_OTSU)[1]

# Remove horizontal lines

horizontal_kernel = cv2.getStructuringElement(cv2.MORPH_RECT, (50,1))

detect_horizontal = cv2.morphologyEx(thresh, cv2.MORPH_OPEN, horizontal_kernel, iterations=2)

cnts = cv2.findContours(detect_horizontal, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

cnts = cnts[0] if len(cnts) == 2 else cnts[1]

for c in cnts:

cv2.drawContours(thresh, [c], -1, (0,0,0), 2)

# Remove vertical lines

vertical_kernel = cv2.getStructuringElement(cv2.MORPH_RECT, (1,15))

detect_vertical = cv2.morphologyEx(thresh, cv2.MORPH_OPEN, vertical_kernel, iterations=2)

cnts = cv2.findContours(detect_vertical, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

cnts = cnts[0] if len(cnts) == 2 else cnts[1]

for c in cnts:

cv2.drawContours(thresh, [c], -1, (0,0,0), 3)

# Dilate to connect text and remove dots

kernel = cv2.getStructuringElement(cv2.MORPH_RECT, (10,1))

dilate = cv2.dilate(thresh, kernel, iterations=2)

cnts = cv2.findContours(dilate, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

cnts = cnts[0] if len(cnts) == 2 else cnts[1]

for c in cnts:

area = cv2.contourArea(c)

if area < 500:

cv2.drawContours(dilate, [c], -1, (0,0,0), -1)

# Bitwise-and to reconstruct image

result = cv2.bitwise_and(image, image, mask=dilate)

result[dilate==0] = (255,255,255)

# OCR

data = pytesseract.image_to_string(result, lang='eng',config='--psm 6')

print(data)

cv2.imshow('thresh', thresh)

cv2.imshow('result', result)

cv2.imshow('dilate', dilate)

cv2.waitKey()Stack Overflow用户

发布于 2020-06-24 15:56:34

您可能需要首先检测单元格,如此图像所示。您可以使用OpenCV提供的库hough线转换来完成它。之后,您可以使用检测到的行来选择ROI,然后提取每个单元格的文本。

如需详细解释,请访问我的博客

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/59370642

复制相关文章

相似问题