开源LLM评估平台添加福利群:解决AI开发者的「MCP实战痛点」

开源LLM评估平台添加福利群:解决AI开发者的「MCP实战痛点」开源AI可观测性、评估与优化平台

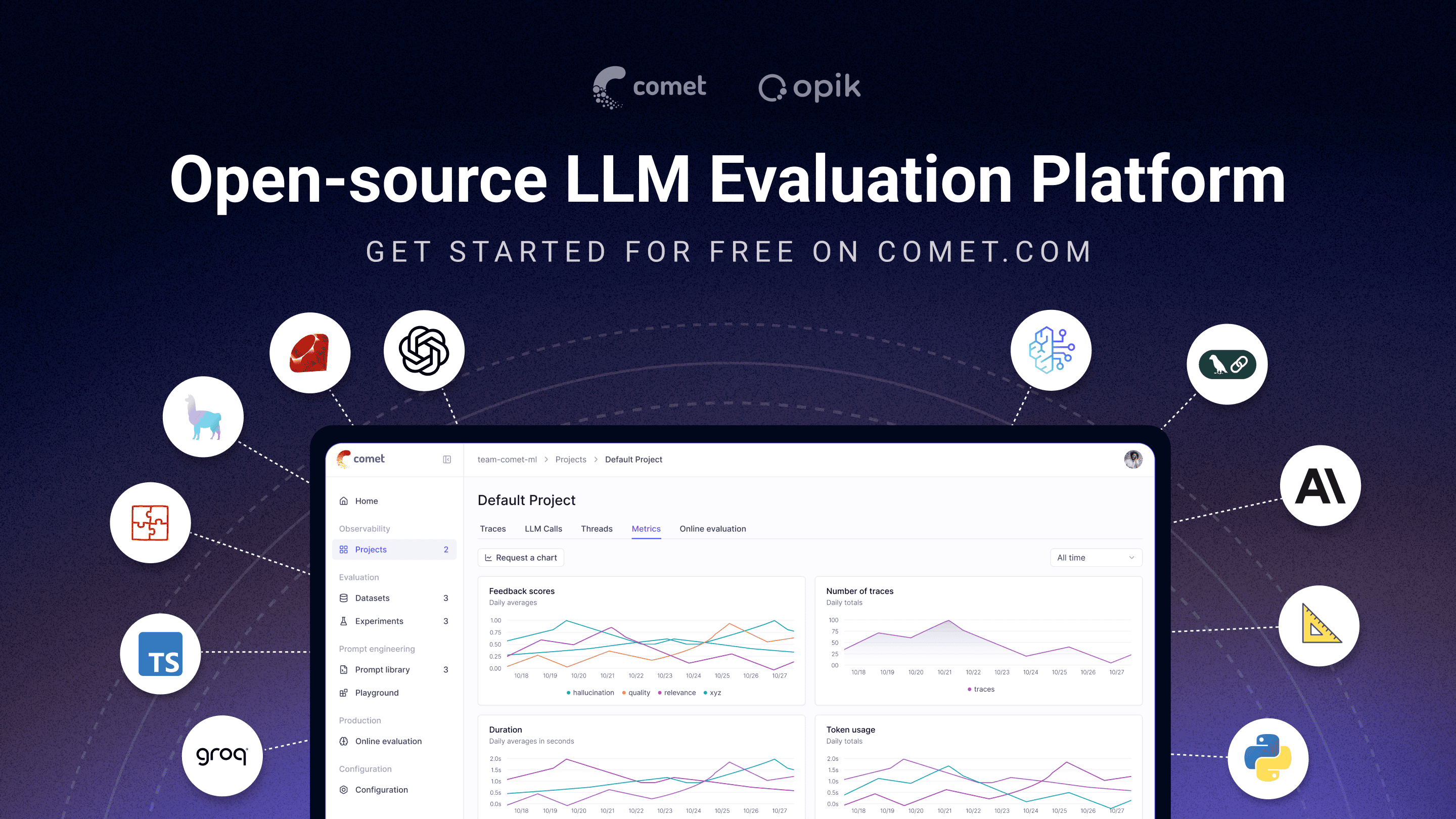

Opik助您构建、测试和优化生成式AI应用,从原型到生产全程提质增效。无论是RAG聊天机器人、代码助手还是复杂智能体系统,Opik提供全链路追踪、评估及自动提示与工具优化功能,消除AI开发中的猜测环节。

官网 • Slack社区 • Twitter • 更新日志 • 文档

🚀 平台介绍

Opik(由Comet构建)是专为LLM应用全生命周期设计的开源平台,提供模型与智能体系统的评估、测试、监控及优化能力。核心功能包括:

- 全景可观测性:深度追踪LLM调用、对话日志与智能体活动

- 进阶评估体系:强大的提示词评估、LLM-as-a-judge及实验管理

- 生产就绪:可扩展的监控看板与在线评估规则

- Opik智能体优化器:专用SDK与优化工具集提升提示词与智能体性能

- Opik安全护栏:实现AI安全与合规的实践方案

核心能力矩阵:

-

开发与追踪:

-

评估与测试:

-

生产监控与优化:

- 高吞吐量生产环境追踪:日处理4000万+追踪记录

- 在Opik仪表盘监控反馈评分、追踪量与token消耗

- 使用在线评估规则结合LLM-as-a-Judge指标识别生产问题

- 通过Opik智能体优化器与Opik安全护栏持续优化生产环境LLM应用

[!TIP] 如需当前版本未包含的功能,欢迎提交功能请求 🚀

🛠️ 服务端安装

快速部署Opik服务端,选择最适合您的方案:

方案一:Comet.com云端服务(推荐)

免部署即时使用,最适合快速入门与免维护场景。

👉 注册免费账户

方案二:自托管部署

在自有环境部署Opik,支持Docker本地开发与Kubernetes生产级扩展。

Docker Compose本地部署(开发测试环境)

最简本地运行方案(新增./opik.sh安装脚本):

Linux/Mac环境:

# 克隆仓库

git clone https://github.com/comet-ml/opik.git

# 进入目录

cd opik

# 启动服务

./opik.sh

Windows环境:

# 克隆仓库

git clone https://github.com/comet-ml/opik.git

# 进入目录

cd opik

# 启动服务

powershell -ExecutionPolicy ByPass -c ".\\opik.ps1"

开发环境服务配置

安装脚本现支持多场景服务配置:

# 启动完整服务(默认模式)

./opik.sh

# 仅启动基础设施(数据库/缓存等)

./opik.sh --infra

# 启动基础设施+后端服务

./opik.sh --backend

# 组合启用安全护栏

./opik.sh --guardrails # 完整服务+护栏

./opik.sh --backend --guardrails # 后端服务+护栏

使用--help或--info参数排查问题。Dockerfile现采用非root用户容器提升安全性。启动完成后访问 localhost:5173。详见本地部署指南。

使用 Kubernetes 和 Helm 实现可扩展的自托管部署

对于生产环境或大规模自托管部署,您可以通过我们的 Helm chart 在 Kubernetes 集群上安装 Opik。点击徽章查看完整的 Helm 版 Kubernetes 安装指南。

[!重要提示] 1.7.0 版本变更:请查看更新日志了解重要更新和破坏性变更。

💻 Opik 客户端 SDK

Opik 提供了一套客户端库和 REST API 用于与 Opik 服务器交互,包括 Python、TypeScript 和 Ruby(通过 OpenTelemetry)的 SDK,可无缝集成到您的工作流中。详细 API 和 SDK 参考请见 Opik 客户端参考文档。

Python SDK 快速入门

开始使用 Python SDK:

安装包:

# 使用 pip 安装

pip install opik

# 或使用 uv 安装

uv pip install opik

通过运行 opik configure 命令配置 Python SDK,该命令将提示您输入 Opik 服务器地址(自托管实例)或 API 密钥和工作区(Comet.com):

opik configure

[!提示] 您还可以在 Python 代码中调用

opik.configure(use_local=True)来配置 SDK 以在本地自托管安装上运行,或直接提供 Comet.com 的 API 密钥和工作区详情。更多配置选项请参考 Python SDK 文档。

现在您已准备好使用 Python SDK 开始记录追踪。

📝 通过集成记录追踪

记录追踪的最简单方式是使用我们的直接集成。Opik 支持多种框架,包括最新添加的 Google ADK、Autogen、AG2 和 Flowise AI:

| 集成 | 描述 | 文档 |

|---|---|---|

| ADK | 记录 Google Agent Development Kit (ADK) 的追踪 | 文档 |

| AG2 | 记录 AG2 LLM 调用的追踪 | 文档 |

| AIsuite | 记录 aisuite LLM 调用的追踪 | 文档 |

| Agno | 记录 Agno 代理编排框架调用的追踪 | 文档 |

| Anthropic | 记录 Anthropic LLM 调用的追踪 | 文档 |

| Autogen | 记录 Autogen 代理工作流的追踪 | 文档 |

| Bedrock | 记录 Amazon Bedrock LLM 调用的追踪 | 文档 |

| BeeAI (Python) | 记录 BeeAI Python 代理框架调用的追踪 | 文档 |

| BeeAI (TypeScript) | 记录 BeeAI TypeScript 代理框架调用的追踪 | 文档 |

| BytePlus | 记录 BytePlus LLM 调用的追踪 | 文档 |

| Cloudflare Workers AI | 记录 Cloudflare Workers AI 调用的追踪 | 文档 |

| Cohere | 记录 Cohere LLM 调用的追踪 | 文档 |

| CrewAI | 记录 CrewAI 调用的追踪 | 文档 |

| Cursor | 记录 Cursor 对话的追踪 | 文档 |

| DeepSeek | 记录 DeepSeek LLM 调用的追踪 | 文档 |

| Dify | 记录 Dify 代理运行的追踪 | 文档 |

| DSPY | 记录 DSPy 运行的追踪 | 文档 |

| Fireworks AI | 记录 Fireworks AI LLM 调用的追踪 | 文档 |

| Flowise AI | 记录 Flowise AI 可视化 LLM 构建器的追踪 | 文档 |

| Gemini (Python) | 记录 Google Gemini LLM 调用的追踪 | 文档 |

| Gemini (TypeScript) | 记录 Google Gemini TypeScript SDK 调用的追踪 | 文档 |

| Groq | 记录 Groq LLM 调用的追踪 | 文档 |

| Guardrails | 记录 Guardrails AI 验证的追踪 | 文档 |

| Haystack | 记录 Haystack 调用的追踪 | 文档 |

| Harbor | 记录 Harbor 基准评估试验的追踪 | 文档 |

| Instructor | 记录使用 Instructor 进行的 LLM 调用的追踪 | 文档 |

| LangChain (Python) | 记录 LangChain LLM 调用的追踪 | 文档 |

| LangChain (JS/TS) | 记录 LangChain JavaScript/TypeScript 调用的追踪 | 文档 |

| LangGraph | 记录 LangGraph 执行的追踪 | 文档 |

| Langflow | 记录 Langflow 可视化 AI 构建器的追踪 | 文档 |

| LiteLLM | 记录 LiteLLM 模型调用的追踪 | 文档 |

| LiveKit Agents | 记录 LiveKit Agents AI 代理框架调用的追踪 | 文档 |

| LlamaIndex | 记录 LlamaIndex LLM 调用的追踪 | 文档 |

| Mastra | 记录 Mastra AI 工作流框架调用的追踪 | 文档 |

| Microsoft Agent Framework (Python) | 记录 Microsoft Agent Framework 调用的追踪 | 文档 |

| Microsoft Agent Framework (.NET) | 记录 Microsoft Agent Framework .NET 调用的追踪 | 文档 |

| Mistral AI | 记录 Mistral AI LLM 调用的追踪 | 文档 |

| n8n | 记录 n8n 工作流执行的追踪 | 文档 |

| Novita AI | 记录 Novita AI LLM 调用的追踪 | 文档 |

| Ollama | 记录 Ollama LLM 调用的追踪 | 文档 |

| OpenAI (Python) | 记录 OpenAI LLM 调用的追踪 | 文档 |

| OpenAI (JS/TS) | 记录 OpenAI JavaScript/TypeScript 调用的追踪 | 文档 |

| OpenAI Agents | 记录 OpenAI Agents SDK 调用的追踪 | 文档 |

| OpenRouter | 记录 OpenRouter LLM 调用的追踪 | 文档 |

| OpenTelemetry | 记录 OpenTelemetry 支持的调用的追踪 | 文档 |

| OpenWebUI | 记录 OpenWebUI 对话的追踪 | 文档 |

| Pipecat | 记录 Pipecat 实时语音代理调用的追踪 | 文档 |

| Predibase | 记录 Predibase LLM 调用的追踪 | 文档 |

| Pydantic AI | 记录 PydanticAI 代理调用的追踪 | 文档 |

| Ragas | 记录 Ragas 评估的追踪 | 文档 |

| Semantic Kernel | 记录 Microsoft Semantic Kernel 调用的追踪 | 文档 |

| Smolagents | 记录 Smolagents 代理的追踪 | 文档 |

| Spring AI | 记录 Spring AI 框架调用的追踪 | 文档 |

| Strands Agents | 记录 Strands 代理调用的追踪 | 文档 |

| Together AI | 记录 Together AI LLM 调用的追踪 | 文档 |

| Vercel AI SDK | 记录 Vercel AI SDK 调用的追踪 | 文档 |

| VoltAgent | 记录 VoltAgent 代理框架调用的追踪 | 文档 |

| WatsonX | 记录 IBM watsonx LLM 调用的追踪 | 文档 |

| xAI Grok | 记录 xAI Grok LLM 调用的追踪 | 文档 |

[!TIP] 若您使用的框架未在上文列出,欢迎提交issue或通过PR提交集成方案。

若未使用上述任何框架,您也可通过track函数装饰器记录调用链:

import opik

opik.configure(use_local=True) # 本地运行模式

@opik.track

def my_llm_function(user_question: str) -> str:

# 在此编写LLM代码

return "Hello"

[!TIP] 该追踪装饰器可与所有集成方案配合使用,亦可用于嵌套函数调用追踪。

🧑⚖️ LLM裁判指标

Python Opik SDK内置多款LLM裁判指标,助您评估大语言模型应用。详见指标文档。

使用方式:导入对应指标后调用score函数:

from opik.evaluation.metrics import Hallucination

metric = Hallucination()

score = metric.score(

input="法国首都是哪里?",

output="巴黎",

context=["法国是欧洲国家"]

)

print(score)

Opik同时提供预设启发式指标及自定义指标功能,详见指标文档。

🔍 评估LLM应用

通过数据集与实验,Opik支持开发阶段的LLM应用评估。Opik仪表盘提供增强型实验图表与大规模调用链处理能力,还可通过PyTest集成在CI/CD流程中运行评估。

⭐ GitHub星标支持

若Opik对您有所帮助,请为我们点亮星标!您的支持将助力社区发展与产品迭代。

🤝 参与贡献

贡献Opik的多种方式:

- 提交缺陷报告与功能建议

- 审阅文档并通过Pull Requests改进

- 技术演讲或文章分享时提及Opik并告知我们

- 为热门功能请求投票助力

更多贡献指南详见贡献说明。

github

github