操作场景

您在企业 AI 智能体管控台 ClawPro 上创建个人 OpenClaw 后,可参考本文接入自定义大模型。

操作步骤

接入自定义 AI 提供商

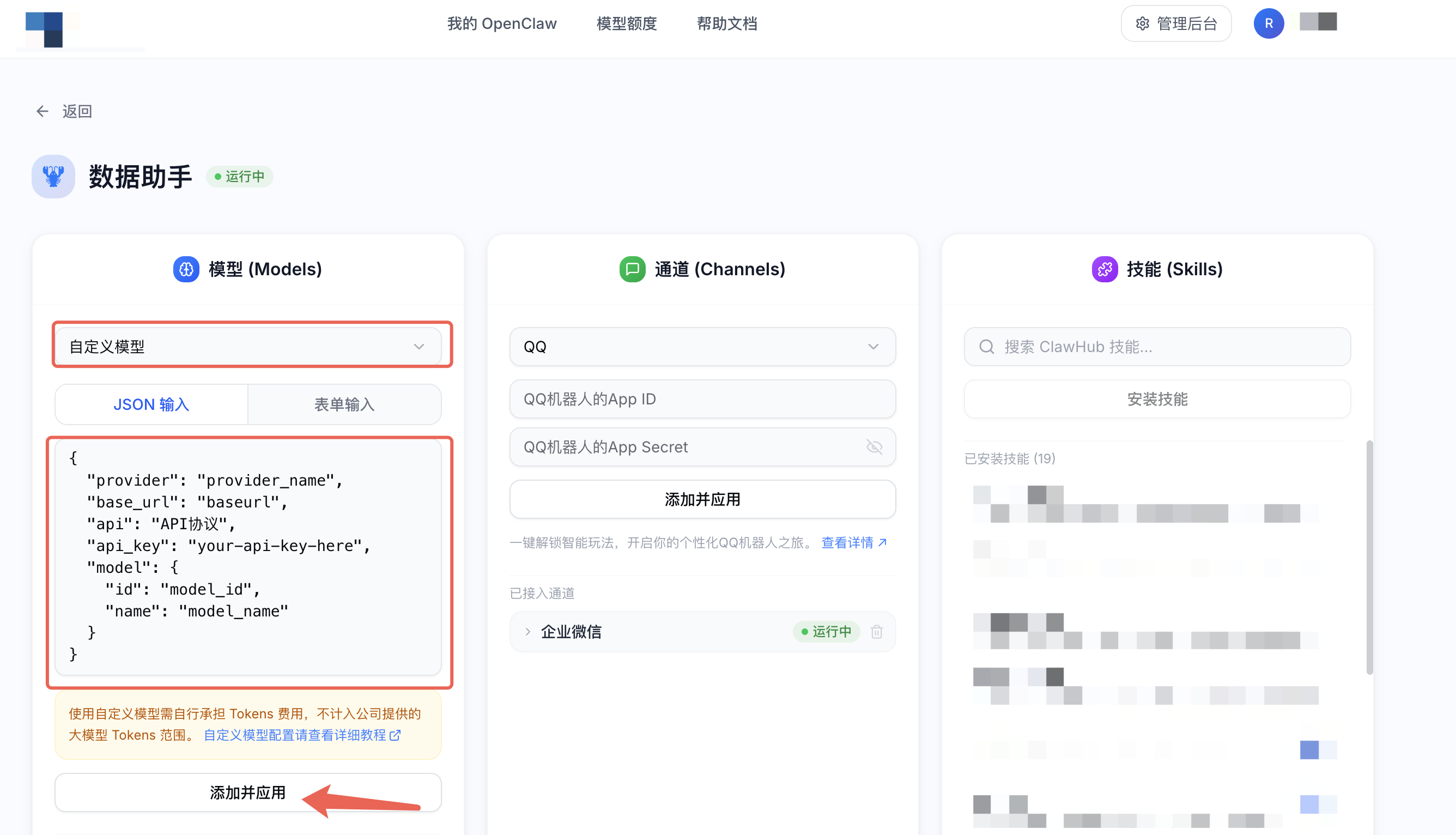

1. 进入 ClawPro 用户端后,找到需要配置的 OpenClaw 实例,选择详细配置。

2. 在模型(Models)中选择自定义模型,参考下方参数说明或示例填写自定义模型相关字段,并单击保存,即可完成自定义模型的配置。

自定义模型参数说明

参数 | 说明 | 示例 |

provider | 提供商名称,您可自定义命名 | siliconflow |

base_url | 模型服务的基础 API 访问地址 | https://api.siliconflow.cn/v1 |

api | API 协议类型: openai-completions 用于兼容 OpenAI Chat Completions API 的模型 anthropic-messages 用于兼容 Anthropic Messages API 的模型 | openai-completions |

api_key | 模型提供商提供的 API KEY | sk-xxx |

model.id | 模型的唯一标识符 | deepseek-ai/DeepSeek-V3.2 |

model.name | 模型在 OpenClaw 内的显示名称 | DeepSeek-V3.2 |

模型接入典型示例

MiniMax 模型

{"provider": "minimax","base_url": "https://api.minimaxi.com/anthropic","api": "anthropic-messages","api_key": "your-api-key-here","model": { "id": "MiniMax-M2.5", "name": "MiniMax M2.5" }}

{"provider": "minimax","base_url": "https://api.minimax.io/anthropic","api": "anthropic-messages","api_key": "your-api-key-here","model": { "id": "MiniMax-M2.5", "name": "MiniMax M2.5" }}

硅基流动模型

本文以使用 DeepSeek V3.2 模型、OpenAI 协议为例,可按照如下代码进行配置:

{"provider": "siliconflow","base_url": "https://api.siliconflow.cn/v1","api": "openai-completions","api_key": "your-api-key-here","model": {"id": "deepseek-ai/DeepSeek-V3.2","name": "DeepSeek-V3.2"}}

Kimi Code 模型

本文以使用 Kimi-K2.5 模型、Anthropic 协议为例,可按照如下代码进行配置:

注意

{"provider": "kimicode","base_url": "https://api.kimi.com/coding","api": "anthropic-messages","api_key": "your-api-key-here","model": {"id": "kimi-k2.5","name": "Kimi K2.5"}}

Google Gemini 模型

本文以使用 Gemini 3 Flash 模型、OpenAI 协议为例,可按照如下代码进行配置:

{"provider": "google","base_url": "https://generativelanguage.googleapis.com/v1beta/openai","api": "openai-completions","api_key": "your-api-key-here","model": {"id": "gemini-3-flash-preview","name": "Gemini 3 Flash"}}

OpenAI (GPT) 模型

以使用 GPT-5.2 模型、OpenAI 协议为例,可按照如下代码进行配置:

{"provider": "openai","base_url": "https://api.openai.com/v1","api": "openai-completions","api_key": "your-api-key-here","model": {"id": "gpt-5.2","name": "GPT-5.2"}}

Anthropic Claude 模型

本文以使用 Claude Opus 4.6 模型、Anthropic 协议为例,可按照如下代码进行配置:

{"provider": "anthropic","base_url": "https://api.anthropic.com","api": "anthropic-messages","api_key": "your-api-key-here","model": {"id": "claude-opus-4-6","name": "Claude Opus 4.6"}}

xAI Grok 模型

本文以使用 Grok 4.1 模型、OpenAI 协议为例,可按照如下代码进行配置:

{"provider": "xai","base_url": "https://api.x.ai/v1","api": "openai-completions","api_key": "your-api-key-here","model": {"id": "grok-4.1","name": "Grok 4.1"}}

OpenRouter 模型

本文以使用 NVIDIA: Nemotron 3 Nano 30B A3B 模型、OpenAI 协议为例,可按照如下代码进行配置:

{"provider": "openrouter","base_url": "https://openrouter.ai/api/v1","api": "openai-completions","api_key": "your-api-key-here","model": {"id": "nvidia/nemotron-3-nano-30b-a3b:free","name": "NVIDIA: Nemotron 3 Nano 30B A3B"}}

其他模型

如上述示例中无期望模型,您也可以使用以下通用模板接入任何兼容 OpenAI/Anthropic 协议的模型:

{"provider": "provider_name","base_url": "baseurl","api": "API协议","api_key": "your-api-key-here","model": {"id": "model_id","name": "model_name"}}

常见错误码

错误码 | 原因 | 解决方案 |

401 not authorized | API-Key 不正确 | 前往模型提供商检查写入的 API-Key 是否正确。 |

429/500 | 余额不足 | 充值或检查 API-Key 是否正确。 |

rate_limit | 速率限制 | 更换提供商,或联系提供商获取更大配额。 名词释义: RPM(Requests Per Minute)表示每分钟请求数。 TPM(Tokens Per Minute)表示每分钟处理的 Tokens 数量。 |

404 | base_url 不正确 | 查看提供商文档寻找兼容 OpenAI Chat Completions API 或 Anthropic Messages API 的 base_url 地址。 |

403 | 该模型不支持此服务器地域 | 更换服务器地域为模型支持的地域或更换模型。 |

注意:

模型响应慢

若您选择了非中国大陆地域的云服务器、通道,或模型提供商,则可能会因跨境网络原因导致延迟较高。若您选择深度思考模型可能因上下文过多导致模型思考时间过长,推荐您选择非思考模型/快思考模型进行替代。

Token 消耗过快

OpenClaw 在调用模型时会携带较多上下文信息,以保证任务连贯性与准确性,因此 Token 消耗可能较高。建议在使用时关注 Token 用量与计费情况。