介绍

您可以在 Oceanus SQL 作业中配置 Paimon Catalog、查看 Paimon 元数据、使用 Paimon Catalog。将元数据信息保存到 Paimon Metastore 以后,在作业中无需再显式声明 DDL 语句,直接三段式引用元数据即可。

版本说明

Flink 版本 | 说明 |

1.13 | 不支持 |

1.14 | 不支持 |

1.16 | 支持 |

1.18 | 支持 |

1.20 | 暂不支持 |

操作说明

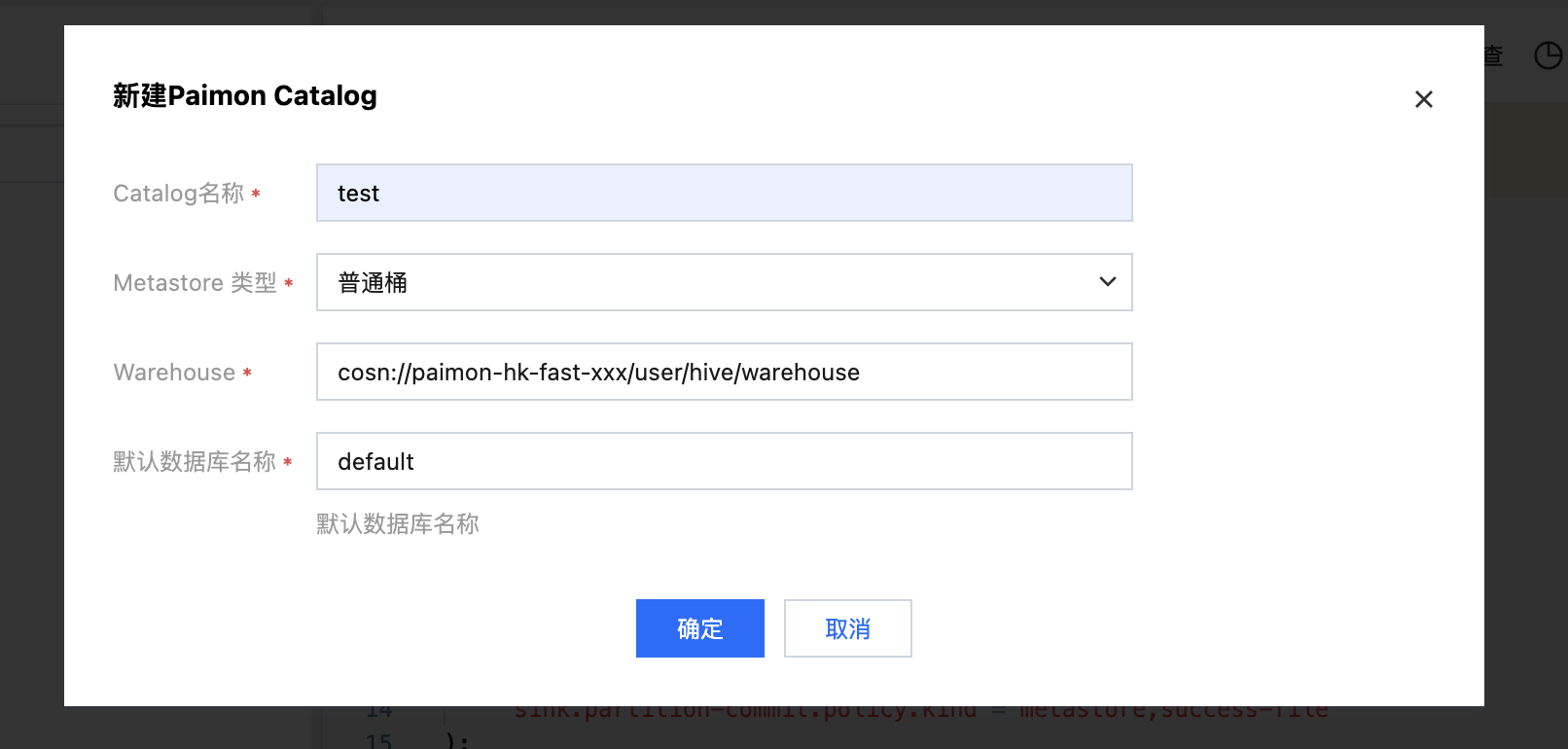

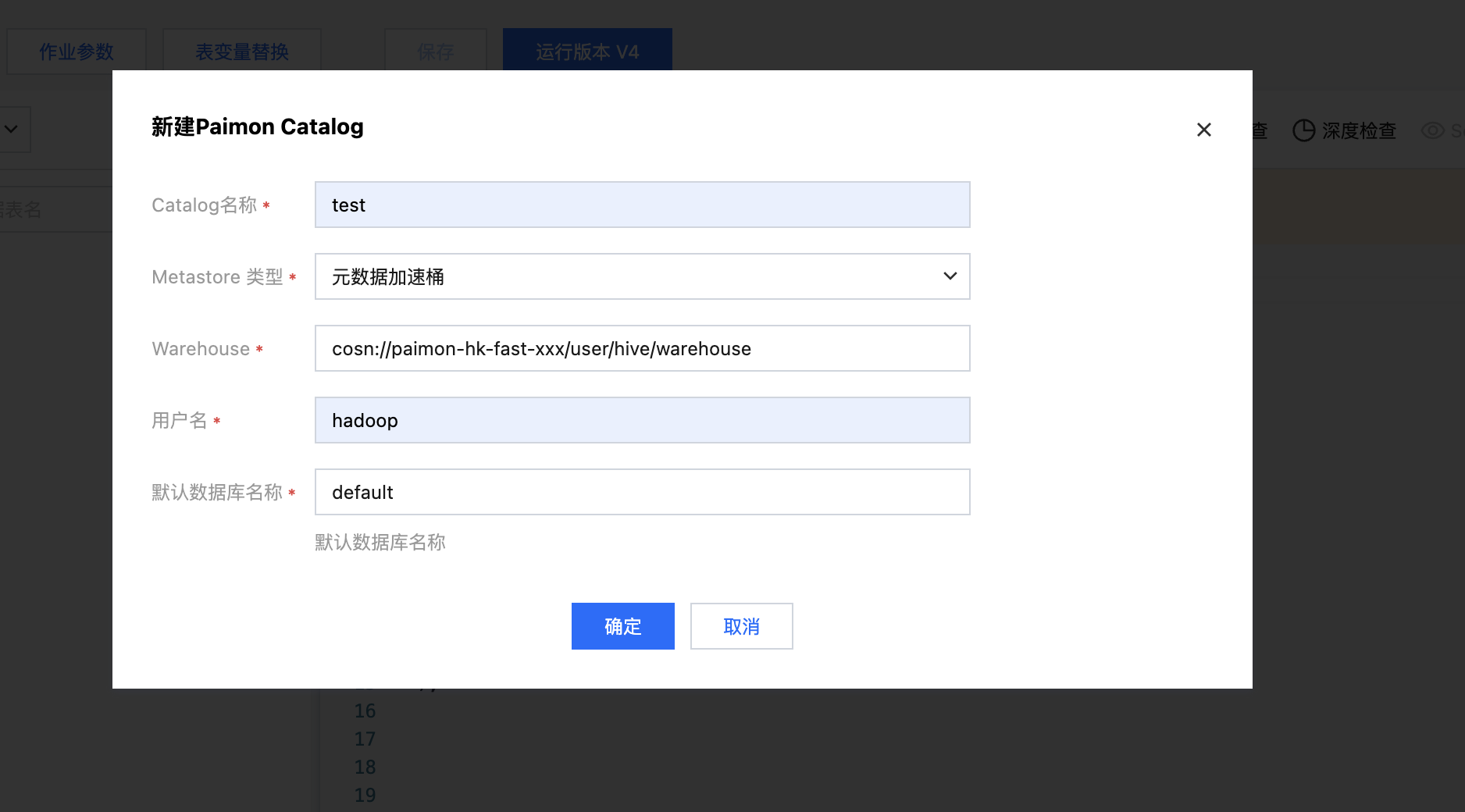

创建 Paimon Catalog

切换到

_dc,单击新建 Paimon Catalog。

普通 COS 桶

COS 元数据加速桶

相比普通 COS 桶,需要填写具有相应 Warehouse 权限的用户名。

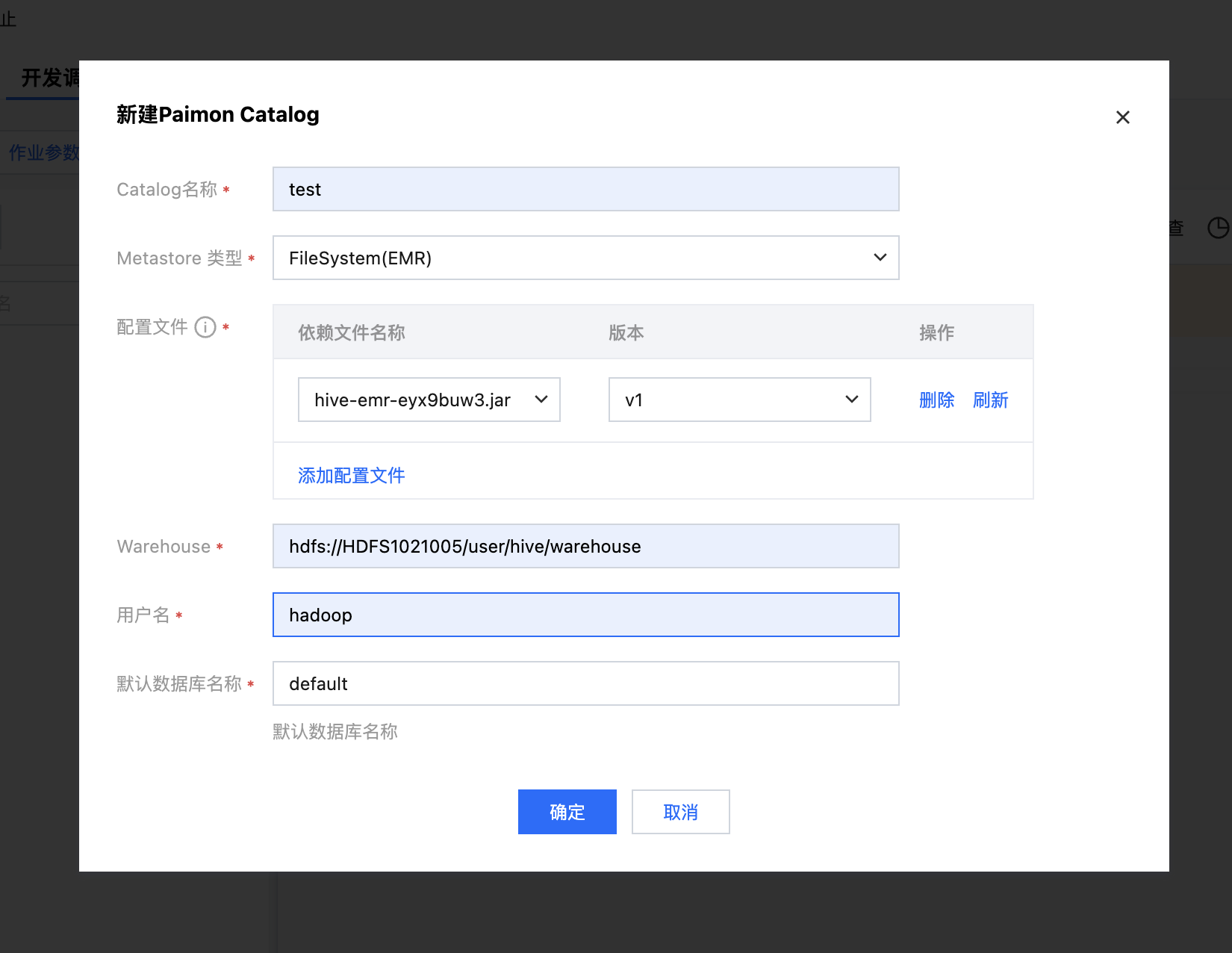

EMR

HDFS 路径的形式为

hdfs://${dfs.nameservices}/${path},${dfs.nameservices} 的值可在 hdfs-site.xml 中查找,${path} 为要写入的数据目录。如果是多 Master 的 EMR 集群需要上传 hdfs-site.xml 可以用下面的命令将它打成 jar 包上传,不能直接上传配置文件。

jar -cvf emr-xxx.jar hdfs-site.xml

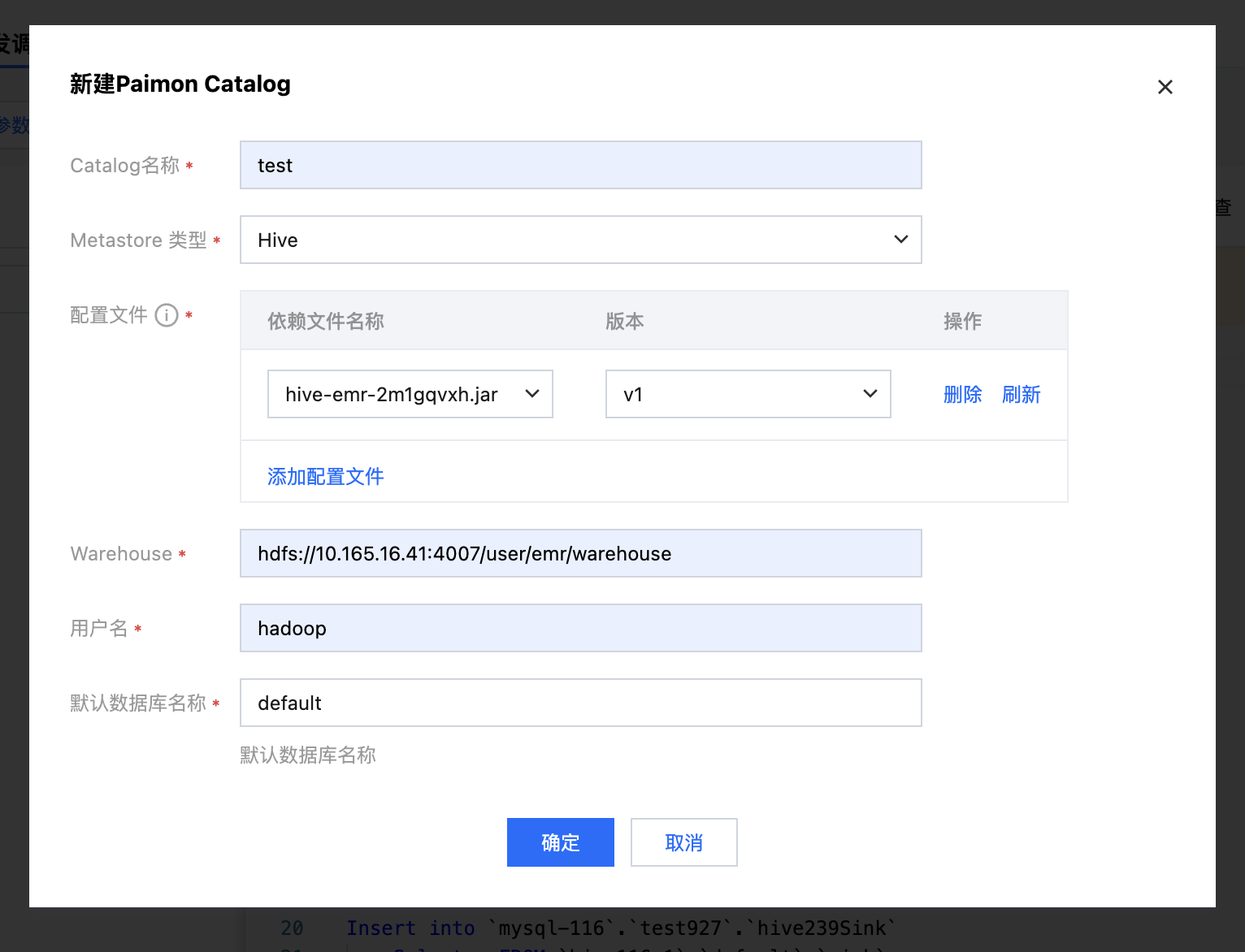

Hive

引用 Paimon Catalog

CREATE TABLE IF NOT EXISTS `116-paimon-sink1`.`default`.`sink1` (id INT PRIMARY KEY NOT ENFORCED, -- Paimon需要主键,id作为主键name STRING) WITH ();Insert into `116-paimon-sink1`.`default`.`sink1`Select * FROM `mysql-116`.`test927`.`test`;

Table Hints(可选)

通过 Hints 动态覆盖表的配置项,无需修改表定义即可临时调整参数。

示例:可设置 local-merge-buffer-size,在数据按桶分区之前对输入记录进行缓冲和合并。

-- Flink 1.13需要开启动态表选项(其他Flink版本不需要)SET 'table.dynamic-table-options.enabled' = 'true';Insert into `116-paimon-sink1`.`default`.`sink1` /*+ OPTIONS('local-merge-buffer-size' = '64mb') */Select * FROM `mysql-116`.`test927`.`test`;

说明:

若需要添加多个参数,使用逗号分隔: /*+ OPTIONS( 'local-merge-buffer-size' = '64mb', 'write-buffer-size' = '256mb' ) */

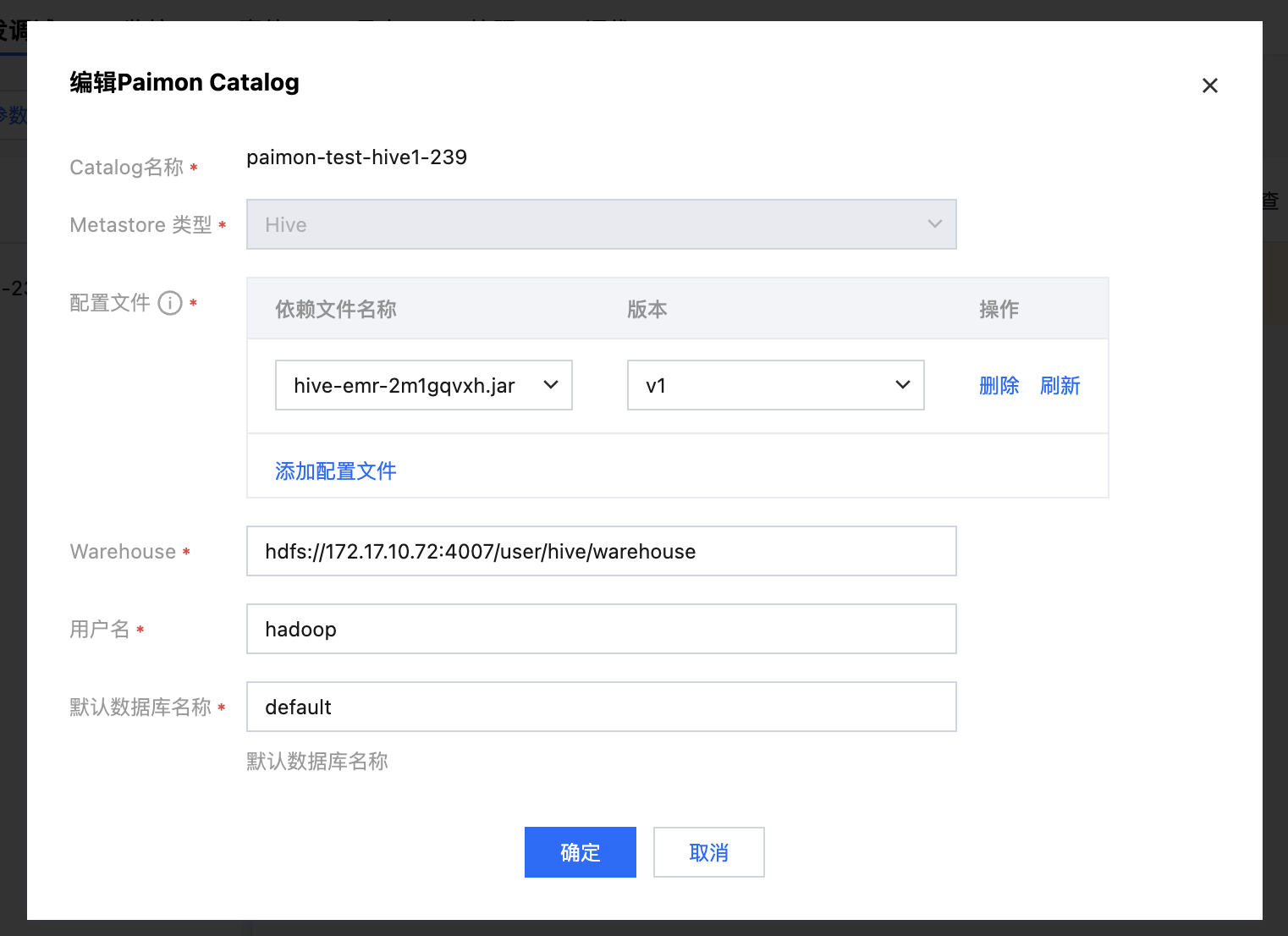

修改 Paimon Catalog

不能修改 Catalog 名字和 Metastore 类型。

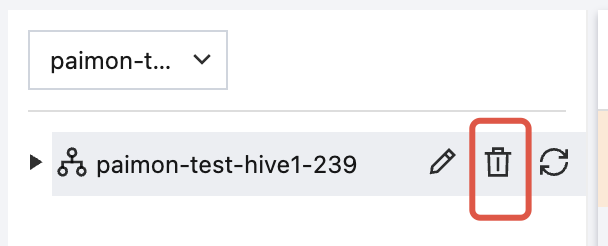

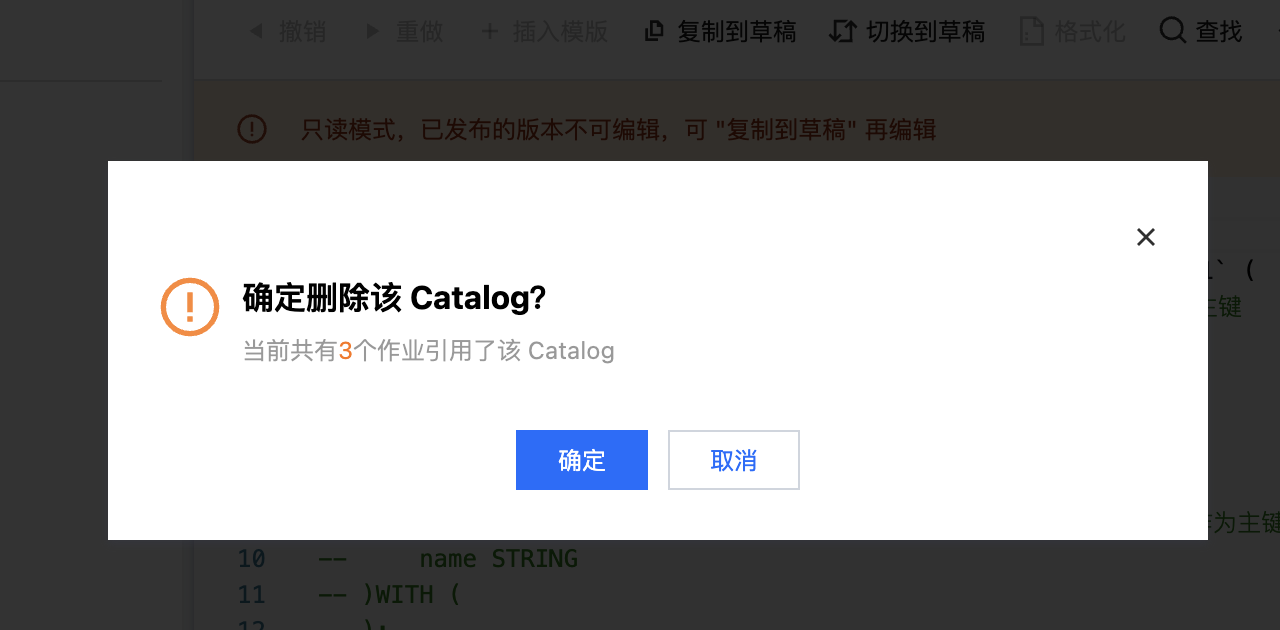

删除 Paimon Catalog

可以单击该按钮进行删除。

注意

删除之后,关联该 Catalog 的作业会出现启动失败。