Kafka客户端开发与生态集成:深入探索ksqlDB的流式SQL魔力

Kafka客户端开发与生态集成:深入探索ksqlDB的流式SQL魔力

用户6320865

发布于 2025-11-28 13:18:26

发布于 2025-11-28 13:18:26

Kafka基础与客户端开发入门

Kafka的核心概念

Apache Kafka作为分布式流处理平台的核心,其设计围绕几个基本构建块:主题(Topic)、分区(Partition)、生产者(Producer)和消费者(Consumer)。理解这些概念是掌握Kafka客户端开发的第一步。

主题(Topic) 是Kafka中数据流的逻辑分类,类似于数据库中的表。每个主题可以进一步划分为一个或多个分区,以实现数据的并行处理和水平扩展。例如,一个名为“user_activity”的主题可能包含用户行为事件,如点击、浏览或购买记录。

分区(Partition) 是主题的物理子单元,每个分区是一个有序、不可变的消息序列。分区不仅允许数据分布式存储 across多个broker(Kafka服务器),还支持高吞吐量的读写操作。每个分区内的消息通过偏移量(Offset)唯一标识,消费者可以通过偏移量来追踪处理进度。

生产者(Producer) 是向Kafka主题发布数据的客户端应用程序。生产者将消息发送到指定主题,并可以选择将消息路由到特定分区(例如基于键或轮询策略)。生产者的设计注重低延迟和高可靠性,支持异步发送和批量处理以优化性能。

消费者(Consumer) 则从主题订阅并处理消息。消费者可以以个体或组(Consumer Group)形式运作,组内消费者共同分担分区负载,实现负载均衡和容错。消费者通过提交偏移量来记录处理进度,确保消息不会重复或丢失。

Kafka在实时数据流中扮演着中枢角色,广泛应用于日志聚合、事件溯源和流处理管道。其持久化、高吞吐和容错特性,使其成为构建实时数据平台的首选。

Kafka客户端开发的基本流程

开发Kafka客户端通常涉及选择编程语言(如Java、Python或Go)、配置客户端库,并实现生产者和消费者逻辑。以下以Java为例,概述基本开发流程。

环境准备与依赖配置 首先,在项目中引入Kafka客户端库。对于Java,可以使用Maven或Gradle添加依赖,建议使用最新版本,例如3.7.1:

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka-clients</artifactId>

<version>3.7.1</version>

</dependency>其他语言如Python可通过confluent-kafka库实现类似功能,该库在2025年已支持更多云原生和AI集成特性。

生产者开发步骤

- 配置生产者属性:设置bootstrap servers(Kafka集群地址)、序列化器(如StringSerializer)和可选参数(如重试机制)。2025年的趋势还包括集成AI驱动的动态路由和自动负载均衡。

- 创建Producer实例:使用

KafkaProducer类初始化生产者。 - 发送消息:构建

ProducerRecord指定主题和消息内容,调用send()方法。支持同步或异步发送,后者可通过回调处理发送结果。

示例代码片段(使用现代语法):

import org.apache.kafka.clients.producer.*;

import java.util.Properties;

import java.util.concurrent.Future;

Properties props = new Properties();

props.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "localhost:9092");

props.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

props.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

// 2025年新增:启用AI优化参数

props.put("smart.routing.enable", "true");

Producer<String, String> producer = new KafkaProducer<>(props);

ProducerRecord<String, String> record = new ProducerRecord<>("user_activity", "user123", "clicked_product");

producer.send(record, (metadata, exception) -> {

if (exception != null) {

System.err.println("发送失败: " + exception.getMessage());

} else {

System.out.println("消息已发送至分区 " + metadata.partition());

}

});

producer.close();Python示例(使用confluent-kafka,2025年版本支持更多云原生特性):

from confluent_kafka import Producer

conf = {

'bootstrap.servers': 'localhost:9092',

'enable.smart.partitioning': True # 2025年新增AI驱动分区功能

}

producer = Producer(conf)

producer.produce('user_activity', key='user123', value='clicked_product')

producer.flush()消费者开发步骤

- 配置消费者属性:设置bootstrap servers、反序列化器(如StringDeserializer)和组ID(group.id)。2025年的消费者API支持自动扩缩容和AI预测性负载调整。

- 创建Consumer实例:使用

KafkaConsumer类初始化消费者,并订阅主题。 - 拉取和处理消息:通过循环调用

poll()方法获取消息批次,处理每条消息后提交偏移量(手动或自动)。

示例代码片段(使用现代语法):

import org.apache.kafka.clients.consumer.*;

import java.time.Duration;

import java.util.Collections;

import java.util.Properties;

Properties props = new Properties();

props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, "localhost:9092");

props.put(ConsumerConfig.GROUP_ID_CONFIG, "activity-monitor");

props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

// 2025年新增:启用智能消费速率控制

props.put("adaptive.fetch.max.bytes", "true");

Consumer<String, String> consumer = new KafkaConsumer<>(props);

consumer.subscribe(Collections.singletonList("user_activity"));

try {

while (true) {

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

System.out.printf("收到消息: key=%s, value=%s, partition=%d%n",

record.key(), record.value(), record.partition());

}

consumer.commitAsync(); // 手动提交偏移量

}

} finally {

consumer.close();

}常用API与最佳实践

Kafka客户端API提供了丰富的功能以适应不同场景。生产者API支持分区选择、压缩和事务消息,适用于高吞吐场景;消费者API则支持手动偏移量控制、再平衡监听器和批量处理。2025年的API更新包括:增强的云原生集成能力、AI驱动的自动优化参数,以及对Kubernetes环境的原生支持。

开发时需注意以下实践:

- 性能调优:调整

batch.size和linger.ms优化生产者吞吐;消费者可通过增加fetch.min.bytes减少网络请求。2025年趋势是使用AI自动调优工具。 - 容错处理:配置重试机制和幂等生产者以避免数据丢失;消费者使用手动提交偏移量确保至少一次语义。最新版本支持更细粒度的错误恢复策略。

- 资源管理:及时关闭Producer和Consumer实例,避免连接泄漏。云原生部署下,建议使用健康检查和无缝重启机制。

对于非Java开发者,Kafka的多语言支持(如Python的confluent-kafka库)提供了类似接口,2025年版本在云原生和AI集成方面有显著增强,但需注意版本兼容性和生态差异。

Kafka客户端开发是构建实时数据应用的基础,后续我们将深入探讨如何通过生态工具如Kafka Connect和ksqlDB进一步扩展数据管道能力。

Kafka生态系统的集成与扩展

在构建现代数据架构时,Apache Kafka 不再仅仅是一个消息队列系统,而是演化为一个完整的流数据平台。其强大的生态系统通过多种组件和工具,实现了数据集成、流处理以及与其他大数据和AI框架的无缝连接,显著提升了数据管道的灵活性与可扩展性。特别是在2025年,Kafka生态进一步扩展至边缘计算和实时AI场景,例如与TensorFlow Serving和边缘设备的深度集成,为智能制造和智能城市等应用提供了强有力的支持。

Kafka Connect与AI集成架构

Kafka Connect:简化数据集成

Kafka Connect 是 Kafka 生态中专门用于数据集成的重要组件,它允许用户以可扩展且可靠的方式,在 Kafka 与其他数据系统(如数据库、数据仓库、文件系统等)之间传输数据。Connect 支持两种类型的连接器:Source 连接器用于将外部数据导入 Kafka,Sink 连接器则将 Kafka 数据导出到外部存储。通过预构建的连接器(例如 JDBC Connector、Elasticsearch Sink Connector 等),用户可以快速实现数据同步,而无需编写复杂的代码。更重要的是,Kafka Connect 支持分布式模式,能够水平扩展以处理海量数据,同时提供 Exactly-Once 语义保证,确保数据传输的可靠性。

Kafka Streams:原生流处理能力

作为 Kafka 自带的流处理库,Kafka Streams 允许开发者以简洁的 API 构建实时流处理应用。它直接集成在应用程序中,无需额外部署集群,降低了运维复杂度。Kafka Streams 提供了丰富的操作符,如过滤、聚合、连接流等,并支持有状态处理与窗口操作,适用于实时监控、事件驱动处理等场景。由于其与 Kafka 的深度集成,Streams 能够充分利用 Kafka 的并行性和容错机制,保证低延迟和高吞吐。对于 Java 和 Scala 开发者而言,Kafka Streams 是一个轻量且强大的选择,尤其适合嵌入到微服务架构中处理流数据。

与外部流处理框架的集成

尽管 Kafka Streams 功能强大,但在某些复杂场景下,用户可能需要更高级的流处理能力,这时与 Apache Flink 或 Apache Spark 等框架的集成显得尤为重要。Kafka 与 Flink 的结合被广泛用于需要精确状态管理和事件时间处理的应用,如实时风控和复杂事件处理(CEP)。Flink 的 Kafka Connector 支持从 Kafka Topic 直接消费数据,并进行高效的计算,其结果也可以写回 Kafka,形成闭环数据处理流水线。

类似地,Apache Spark 的 Structured Streaming 模块也能够与 Kafka 无缝集成,特别适合批流一体场景。用户可以利用 Spark 强大的机器学习与图计算能力,对 Kafka 数据流进行实时分析与建模。这种集成方式常见于需要结合历史数据与实时数据的业务,如推荐系统或用户行为分析。2025年,Kafka与AI框架如TensorFlow的集成也日益成熟,支持实时模型推理和动态特征工程,进一步扩展了流处理的应用边界。

生态集成的优势与挑战

通过 Kafka Connect、Kafka Streams 以及与其他流处理框架的集成,Kafka 生态系统极大地扩展了其应用边界。这种集成不仅提升了数据管道的灵活性——用户可以根据需求选择合适的组件进行组合,还增强了可扩展性,例如通过 Connect 的分布式部署或 Flink 的集群扩展能力处理不断增长的数据量。

然而,集成过程中也可能遇到一些挑战。例如,不同组件之间的版本兼容性需要仔细管理,尤其是在升级 Kafka 或周边工具时。此外,对于多框架集成的场景,运维复杂度可能增加,需要更全面的监控与故障恢复机制。尽管存在这些挑战,但通过合理的架构设计和自动化工具,大多数问题都可以得到有效解决。

总体来看,Kafka 生态系统的强大之处在于其模块化和开放性,用户能够根据具体需求灵活选用不同的工具与框架。这种设计使得 Kafka 不仅仅是一个消息中间件,而是成为了现代数据架构的核心枢纽。

ksqlDB:流式SQL的革命性工具

什么是ksqlDB?

ksqlDB是Confluent公司基于Apache Kafka构建的一款开源流式SQL引擎,它允许用户通过熟悉的SQL语法对Kafka中的实时数据流进行处理和分析。与传统的批处理SQL不同,ksqlDB专注于流式数据,能够持续地查询和处理数据流,而无需将数据先存储到外部数据库中。这种设计使得ksqlDB成为实时数据处理和事件驱动架构中的重要工具。

ksqlDB的核心思想是将SQL的强大表达能力与Kafka的高吞吐、低延迟特性结合,让开发者和数据分析师能够以声明式的方式定义流处理逻辑,而无需编写复杂的代码。无论是过滤、聚合、连接多个数据流,还是构建实时仪表盘和报警系统,ksqlDB都能提供简洁高效的解决方案。

架构与核心组件

ksqlDB的架构设计充分体现了其与Kafka生态系统的深度集成。它由以下几个核心组件构成:

ksqlDB服务器:作为处理引擎,负责解析SQL语句、优化查询计划,并在后台转换为Kafka Streams应用程序执行。服务器可以以独立模式运行,也可以部署为分布式集群,以支持高可用和水平扩展。

ksqlDB CLI和REST API:提供交互式命令行界面和RESTful API,用户可以通过它们提交SQL查询、管理流和表,以及监控查询状态。CLI工具特别适合快速测试和探索数据,而REST API则便于集成到自动化流程和自定义应用中。

流(Streams)和表(Tables):ksqlDB将Kafka主题(Topic)抽象为两种基本数据结构:"流"代表无限的事件序列,每个事件都是不可变的;"表"则代表流的当前状态,是可变的,通常用于聚合操作。例如,用户点击流可以建模为一个流,而用户当前的会话计数可以建模为一个表。

ksqlDB架构与核心组件示意图

持久查询:ksqlDB支持两种类型的查询:持久查询会持续运行并输出结果到新的Kafka主题,适合构建实时数据管道;临时查询则用于一次性检索当前状态,适合调试和即席分析。

核心功能与优势

ksqlDB的核心功能围绕流式SQL展开,主要包括数据定义、数据查询和数据操作。

数据定义语言(DDL):用户可以通过CREATE STREAM或CREATE TABLE语句在Kafka主题上定义流或表。例如,以下语句创建一个流,用于处理用户点击事件:

CREATE STREAM user_clicks (

user_id VARCHAR,

page_url VARCHAR,

click_time TIMESTAMP

) WITH (

KAFKA_TOPIC = 'user-clicks-topic',

VALUE_FORMAT = 'JSON'

);这会将Kafka主题user-clicks-topic映射为一个流,其中每条消息包含用户ID、页面URL和点击时间。

数据查询与操作:ksqlDB支持丰富的SQL操作,包括过滤(WHERE)、聚合(GROUP BY)、连接(JOIN)和窗口函数。2025年最新版本中,ksqlDB增强了窗口函数能力,新增了滑动窗口和会话窗口的智能自适应调整,并集成了轻量级机器学习推理功能,支持在SQL查询中直接调用ONNX格式的预训练模型。例如,以下查询统计每分钟的页面访问量,并实时调用异常检测模型:

SELECT page_url,

COUNT(*) AS click_count,

WINDOWSTART AS window_start,

ML_ANOMALY_DETECT(click_count) AS anomaly_score

FROM user_clicks

WINDOW TUMBLING (SIZE 1 MINUTE)

GROUP BY page_url;这种查询会持续输出每分钟的聚合结果及异常评分,非常适合实时监控和分析。

优势:ksqlDB的主要优势在于简化了流处理开发。传统上,处理Kafka数据流需要编写Java或Scala代码使用Kafka Streams,但ksqlDB通过SQL降低了门槛,让更多角色(如数据分析师和业务人员)也能参与实时数据处理。此外,它与Kafka的无缝集成确保了低延迟和高吞吐,同时支持 exactly-once 语义和容错机制。

安装与配置

ksqlDB的安装过程相对简单,可以通过Docker、Confluent Platform、Kubernetes或独立部署完成。以下以云原生Kubernetes部署为例,介绍基本步骤:

- 使用Helm部署ksqlDB:通过官方Helm chart快速在K8s集群中部署ksqlDB

helm repo add confluentinc https://confluentinc.github.io/cp-helm-charts/

helm install ksqldb confluentinc/cp-ksql-server \

--set kafka.bootstrapServers=kafka:9092 \

--set service.type=LoadBalancer- 配置云原生参数:在values.yaml中设置资源限制、自动扩缩容和监控集成

resources:

requests:

memory: "1Gi"

cpu: "500m"

limits:

memory: "2Gi"

cpu: "1000m"

autoscaling:

enabled: true

minReplicas: 2

maxReplicas: 10对于快速本地开发,仍可使用Docker方式:

docker run -d \

-p 8088:8088 \

-e KSQL_BOOTSTRAP_SERVERS=localhost:9092 \

-e KSQL_LISTENERS=http://0.0.0.0:8088/ \

confluentinc/ksqldb-server:latest配置方面,ksqlDB提供了丰富的参数来优化性能和行为,例如设置处理保证(processing.guarantee)为exactly_once以启用精确一次处理,或调整缓存大小以提高查询效率。这些配置可以通过环境变量、配置文件或Kubernetes ConfigMap指定。

基本操作:创建流和表

使用ksqlDB的第一步通常是在已有的Kafka主题上定义流或表。假设有一个Kafka主题orders-topic,包含JSON格式的订单事件,如下所示:

{"order_id": "123", "product": "laptop", "quantity": 1, "order_time": "2025-07-25T09:54:49Z"}可以通过以下语句创建一个流:

CREATE STREAM orders (

order_id VARCHAR KEY,

product VARCHAR,

quantity INT,

order_time TIMESTAMP

) WITH (

KAFKA_TOPIC = 'orders-topic',

VALUE_FORMAT = 'JSON',

TIMESTAMP = 'order_time'

);这里,TIMESTAMP属性指定了事件时间字段,这对于基于时间的操作(如窗口聚合)至关重要。

类似地,可以创建一个表来跟踪每个产品的总销量:

CREATE TABLE product_sales AS

SELECT product,

SUM(quantity) AS total_sold

FROM orders

GROUP BY product;这条语句会启动一个持久查询,持续聚合数据并将结果写入一个新的Kafka主题(自动创建),同时ksqlDB会维护该表的当前状态。

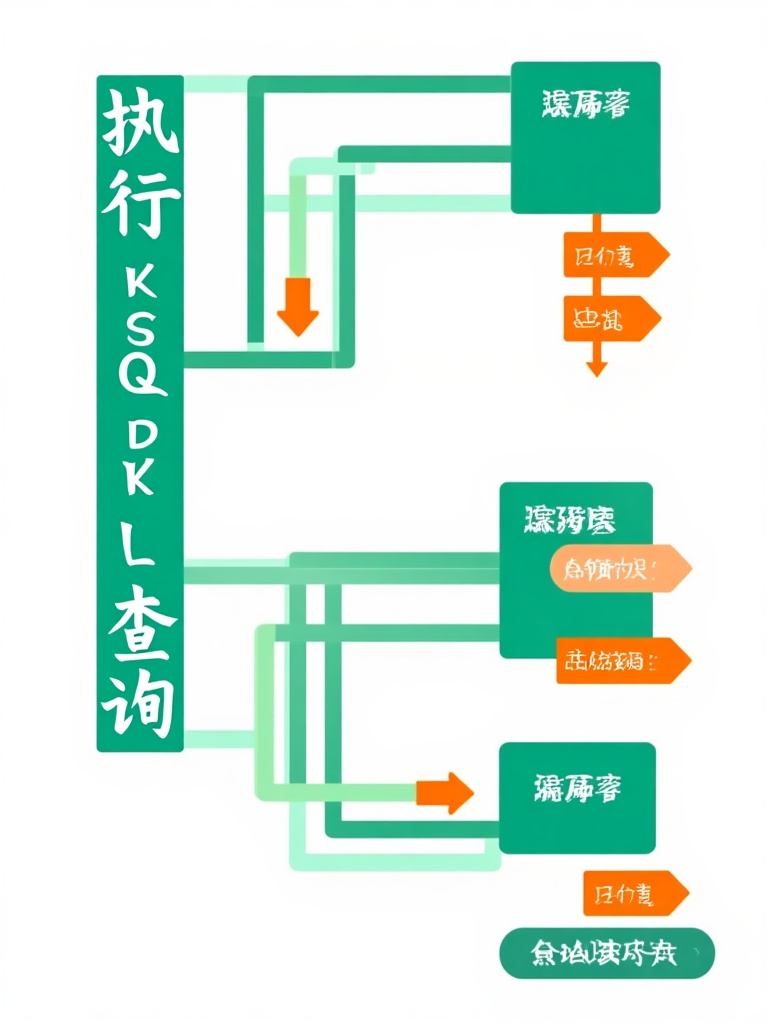

执行查询与流处理

ksqlDB的查询分为持久查询和临时查询。持久查询在后台持续运行,输出结果到Kafka主题,适合构建实时数据管道。例如,以下查询过滤出数量大于2的订单,并输出到新主题:

CREATE STREAM large_orders AS

SELECT *

FROM orders

WHERE quantity > 2;临时查询则用于交互式探索,不会产生持续输出。例如,查看当前产品销量表的内容:

SELECT * FROM product_sales;ksqlDB还支持复杂操作如流-表连接。假设有一个用户表(来自Kafka主题users-topic),可以通过以下查询将订单流与用户表连接,丰富订单数据:

CREATE STREAM enriched_orders AS

SELECT o.order_id, o.product, u.user_name, o.order_time

FROM orders o

LEFT JOIN users u ON o.order_id = u.order_id;这些功能使得ksqlDB能够灵活地处理各种实时场景,从简单过滤到复杂事件处理。

ksqlDB实战:从入门到精通

安装与环境配置

首先,我们需要安装并启动ksqlDB。ksqlDB可以以独立服务器模式运行,也可以集成到Confluent Platform中。以下是基于Docker的快速启动方式,使用2025年最新的镜像版本:

docker run -d \

-p 8088:8088 \

-e KSQL_BOOTSTRAP_SERVERS=localhost:9092 \

-e KSQL_LISTENERS=http://0.0.0.0:8088/ \

confluentinc/ksqldb-server:7.6.0启动后,可以通过ksqlDB CLI或REST API连接到服务器。使用CLI连接:

docker run -it --network host confluentinc/ksqldb-cli:7.6.0 ksql http://localhost:8088为了监控资源使用情况,建议集成2025年流行的监控工具,如Grafana或Prometheus,实时跟踪ksqlDB的CPU、内存及查询延迟。

ksqlDB资源监控面板

创建流与表

假设我们有一个Kafka主题user_activities,其中包含用户行为数据,JSON格式如下:

{

"user_id": 101,

"action": "view",

"timestamp": "2025-07-25T09:54:49Z"

}首先,在ksqlDB中创建一个流来映射这个主题:

CREATE STREAM user_activity_stream (

user_id INT,

action VARCHAR,

timestamp VARCHAR

) WITH (

KAFKA_TOPIC = 'user_activities',

VALUE_FORMAT = 'JSON'

);接下来,我们可以基于这个流创建一个表,用于聚合用户行为次数。例如,按用户和动作类型统计:

CREATE TABLE user_action_counts AS

SELECT

user_id,

action,

COUNT(*) AS count

FROM user_activity_stream

GROUP BY user_id, action;这个表会持续更新,每当有新事件到达user_activities主题时,计数会自动递增。

实时查询示例

ksqlDB支持两种类型的查询:持久化查询(Persistent Query)和临时查询(Transient Query)。持久化查询会持续运行并输出结果到新的Kafka主题,而临时查询则用于一次性或临时分析。

例如,创建一个持久化查询,筛选出所有“购买”行为:

CREATE STREAM purchase_actions AS

SELECT *

FROM user_activity_stream

WHERE action = 'purchase';这条语句会创建一个新的Kafka主题purchase_actions,其中只包含购买行为的事件。

对于临时查询,我们可以直接运行:

SELECT user_id, action, COUNT(*)

FROM user_activity_stream

WINDOW TUMBLING (SIZE 1 HOUR)

GROUP BY user_id, action;这条查询会返回过去一小时内每个用户每种动作的计数,但不会持久化结果。

时间窗口与聚合

ksqlDB支持多种时间窗口,如滚动窗口(TUMBLING)、跳跃窗口(HOPPING)和会话窗口(SESSION)。例如,使用滚动窗口统计每5分钟内的用户活动次数:

CREATE TABLE activity_per_5min AS

SELECT

action,

COUNT(*) AS event_count

FROM user_activity_stream

WINDOW TUMBLING (SIZE 5 MINUTES)

GROUP BY action;连接流与表

ksqlDB允许将流与表进行连接,实现更复杂的逻辑。假设我们有一个用户信息表user_profiles(基于Kafka主题创建),包含user_id和region字段:

CREATE TABLE user_profiles (

user_id INT PRIMARY KEY,

region VARCHAR

) WITH (

KAFKA_TOPIC = 'user_profiles',

VALUE_FORMAT = 'JSON'

);我们可以将用户活动流与用户信息表连接,按区域统计活动:

CREATE STREAM regional_activities AS

SELECT

ua.user_id,

ua.action,

up.region

FROM user_activity_stream ua

LEFT JOIN user_profiles up ON ua.user_id = up.user_id;监控与调试

ksqlDB提供了多种方式来监控查询状态和结果。通过REST API,可以获取运行中的查询列表:

curl -X GET "http://localhost:8088/query"对于持久化查询,结果会写入Kafka主题,因此可以使用标准Kafka工具(如kafka-console-consumer)来消费这些主题:

kafka-console-consumer --bootstrap-server localhost:9092 \

--topic ACTIVITY_PER_5MIN \

--from-beginning此外,ksqlDB CLI中可以使用SHOW QUERIES和EXPLAIN <query_id>来查看查询详情和执行计划。

错误处理与容错

ksqlDB基于Kafka的容错机制,自动处理节点故障。如果某个ksqlDB服务器实例宕机,其他实例会接管其工作负载。对于查询,可以通过设置auto.offset.reset策略来处理偏移量问题:

SET 'auto.offset.reset' = 'earliest';性能优化建议

在实际应用中,优化ksqlDB性能至关重要。以下是一些常见策略:

- 分区策略:确保流和表的分区数与Kafka主题的分区数匹配,以避免数据倾斜。

- 索引使用:在连接操作中,对表的主键字段建立索引可以显著提升性能。

- 窗口大小调整:根据数据流速调整窗口大小,过小的窗口可能导致频繁输出,过大的窗口则增加延迟。

例如,调整窗口大小和缓存设置:

CREATE TABLE optimized_counts AS

SELECT

action,

COUNT(*) AS count

FROM user_activity_stream

WINDOW TUMBLING (SIZE 10 MINUTES)

GROUP BY action

EMIT CHANGES;集成外部系统

ksqlDB可以轻松与Kafka Connect集成,实现数据导入导出。例如,将查询结果输出到Elasticsearch:

首先,配置Kafka Connect的Elasticsearch Sink连接器,然后在ksqlDB中确保结果主题格式兼容:

CREATE STREAM es_sink_stream WITH (

KAFKA_TOPIC = 'es_sink_topic',

VALUE_FORMAT = 'JSON'

) AS

SELECT *

FROM regional_activities;通过以上步骤,ksqlDB能够无缝融入现有数据管道,提升流处理的灵活性和效率。

Kafka与ksqlDB的协同优势

简化流处理流程

Kafka作为分布式事件流平台,其核心价值在于高吞吐、低延迟的数据传输能力,但原生API在处理复杂流逻辑时往往需要开发者编写大量代码。而ksqlDB的出现,将流处理的门槛从代码编写降低到了SQL语句的书写层面。通过ksqlDB,用户可以直接在Kafka数据流上执行类SQL查询,无需关注底层分区、序列化或状态管理细节。例如,一个简单的过滤或聚合操作,在Kafka Streams中可能需要几十行Java代码,但在ksqlDB中只需一行SQL语句即可实现。这种简化不仅提升了开发效率,还降低了团队的技术栈门槛,使得数据分析师或业务人员也能直接参与流处理任务的构建。

ksqlDB通过其内置的流-表二元模型,将Kafka中的topic自动映射为可查询的流(stream)或表(table),用户无需手动定义数据结构和处理逻辑。例如,通过CREATE STREAM语句,可以直接将Kafka中的订单数据流转化为一个可实时查询的抽象对象,并在此基础上执行窗口聚合、连接查询等操作。这种声明式的方式,让开发者从繁琐的流处理框架配置中解脱出来,更专注于业务逻辑本身。

降低开发与运维复杂度

在传统流处理架构中,开发团队通常需要维护多个组件:Kafka集群、流处理应用(如Kafka Streams或Flink作业)、以及可能的数据库或缓存系统。这种多组件协作不仅增加了部署和监控的复杂度,还容易引入数据一致性和延迟问题。而ksqlDB作为Kafka原生的流处理引擎,与Kafka集群深度集成,减少了外部依赖。例如,ksqlDB server可以直接部署在Kafka集群环境中,通过内置的REST API提供服务,无需额外搭建计算框架。

从代码开发角度,ksqlDB消除了对JVM生态的强依赖。虽然Kafka Streams提供了强大的Java API,但对于非JVM语言开发者(如Python或Go团队)来说,集成和调试仍存在一定障碍。ksqlDB通过SQL标准化接口,使得多语言团队可以统一使用熟悉的查询语言操作流数据,减少了技术栈分裂带来的协作成本。此外,ksqlDB的服务器模式支持多用户并发查询,可以通过权限控制实现资源隔离,更适合企业级多租户场景。

运维层面,ksqlDB提供了与Kafka监控工具(如Kafka Connect、Confluent Control Center)的无缝集成。用户可以直接在监控界面查看查询延迟、吞吐量指标,甚至动态调整查询资源分配。例如,通过Confluent Platform,可以实时追踪ksqlDB查询的执行状态和历史性能,快速定位瓶颈。相比之下,自建流处理集群往往需要定制化监控方案,运维负担更重。

常见集成挑战与应对策略

尽管Kafka与ksqlDB的协同优势显著,但在实际集成过程中,团队可能面临若干挑战。首当其冲的是资源竞争问题。ksqlDB作为常驻服务,需要消耗一定的CPU和内存资源,尤其在处理高吞吐数据流时,可能与Kafka broker或其他应用产生资源冲突。例如,一个复杂的跨流连接查询可能导致ksqlDB服务器内存激增,进而影响Kafka集群的稳定性。应对策略包括合理规划集群资源分配、使用资源隔离机制(如Kubernetes容器化部署),以及通过查询优化减少状态存储开销。例如,可以通过设置适当的缓存过期策略(如TTL)来控制状态大小,避免无限增长。

另一个常见挑战是数据语义一致性。ksqlDB的SQL语法虽然简洁,但在流处理场景下,用户需要深刻理解时间窗口、事件时间、处理时间等概念,否则容易产生错误结果。例如,基于事件时间的聚合操作要求数据时间戳有序,但Kafka topic中的数据可能因网络延迟而乱序到达。解决方案是在ksqlDB中显式配置时间戳提取策略和水印机制,确保计算逻辑的正确性。同时,建议团队在开发阶段充分利用ksqlDB的交互式查询功能,通过实时调试和结果验证快速迭代逻辑。

架构扩展性也是需要关注的方面。ksqlDB适合中小规模的流处理场景,但在超大规模数据(如日均千亿级事件)下,其单查询性能可能成为瓶颈。此时,可以考虑将复杂查询拆分为多个ksqlDB任务并行执行,或结合Kafka Streams进行混合部署——使用ksqlDB处理简单过滤和转换,而Kafka Streams处理状态密集型计算。此外,ksqlDB的弹性扩缩容能力依赖于底层Kafka集群的扩展性,因此确保Kafka topic分区数设计合理是关键前提。

安全性集成同样不容忽视。在企业环境中,Kafka集群通常需要启用SSL加密、SASL认证等安全机制,而ksqlDB需与之对齐配置。例如,ksqlDB server需要支持与Kafka broker的双向认证,并通过RBAC控制用户查询权限。Confluent Platform提供了开箱即用的安全集成方案,但自建集群团队需手动配置相关参数,建议参考官方文档逐步实施。

2025年实际协同案例与云环境挑战

在2025年,Kafka与ksqlDB的协同在实时AI应用中展现出强大潜力。例如,某电商平台利用ksqlDB实时处理用户行为数据流,结合内置UDF调用AI模型,实现毫秒级个性化推荐。具体流程为:用户点击流通过Kafka摄取,ksqlDB实时过滤和聚合,并调用预训练的TensorFlow模型进行预测,结果直接反馈到前端界面。这种架构相比传统批处理推荐系统,延迟从分钟级降至秒级,大幅提升用户体验。

然而,在云环境中集成ksqlDB也面临新的挑战。多云和混合云部署成为2025年的主流,ksqlDB需要适应不同云厂商的网络和存储差异。例如,跨云区的数据同步可能引入额外延迟,影响流处理的实时性。解决方案包括采用云原生服务网格(如Istio)优化网络路由,以及利用云厂商提供的托管Kafka服务(如AWS MSK、Confluent Cloud)减少运维负担。此外,云环境下的自动扩缩容和成本控制也成为关键,需要结合Kubernetes HPA和云监控工具实现动态资源调整。

典型应用场景示例

在实际项目中,Kafka与ksqlDB的协同常用于实时ETL、监控告警和用户行为分析等场景。以电商平台为例,订单数据通过Kafka实时采集后,ksqlDB可以实时计算每分钟销售额、热门商品排行,甚至识别异常交易模式(如欺诈检测)。以下是一个简化的代码示例,展示如何通过ksqlDB SQL实现实时聚合:

-- 创建订单数据流

CREATE STREAM orders_stream (

order_id BIGINT,

product_id VARCHAR,

amount DOUBLE,

ts TIMESTAMP

) WITH (

KAFKA_TOPIC = 'orders',

VALUE_FORMAT = 'JSON'

);

-- 计算每分钟销售总额

SELECT

product_id,

WINDOWSTART AS window_start,

SUM(amount) AS total_sales

FROM orders_stream

WINDOW TUMBLING (SIZE 1 MINUTE)

GROUP BY product_id;这种轻量级实现,相比编写等效的Java或Scala代码,节省了大量开发和测试时间。同时,ksqlDB的持久化查询能力允许结果直接写回Kafka topic,供下游仪表板或应用消费,形成闭环流处理管道。

另一个典型场景是物联网数据处理。传感器数据通过Kafka接入后,ksqlDB可以实时过滤异常值(如温度超过阈值)、计算移动平均值,甚至与设备元数据表进行流-表连接(如关联设备ID与位置信息)。这种模式在工业监控、智能家居等领域尤为常见,ksqlDB的SQL接口使得现场工程师也能快速实现实时逻辑,无需依赖后端开发团队。

未来展望与学习资源

流式数据处理的未来趋势

随着企业数字化转型的加速,流式数据处理技术正迎来前所未有的发展机遇。ksqlDB作为Kafka生态中的重要组成部分,其未来演进将紧密围绕几个核心方向展开。根据2025年最新的行业动态和搜索查询“流式SQL未来趋势2025”的热点内容,以下趋势值得重点关注。

AI与机器学习的深度融合 实时数据流与AI的结合正在成为行业焦点。ksqlDB在2025年进一步强化了与主流机器学习框架的集成,特别是对PyTorch和TensorFlow的本地支持。用户现在可以通过扩展的UDF(用户自定义函数)在SQL查询中直接调用预训练的AI模型,实现实时异常检测、动态推荐和预测性维护等场景。这种集成大幅降低了AI落地的技术门槛,让数据工程师能够用熟悉的SQL语句完成端到端的机器学习流水线。

云原生架构的全面适配 随着混合云和多云策略成为企业标配,ksqlDB加速拥抱云原生生态。2025年的版本增强了与Kubernetes的Operator集成,提供了更智能的弹性扩缩容和资源调度能力。用户通过声明式配置即可实现自动化部署和运维,系统能够根据实时负载自动调整节点规模和处理故障恢复。此外,ksqlDB在Serverless架构方面取得重要进展,多家云厂商推出了按实际查询量计费的托管服务,进一步优化了流处理的成本结构。

边缘计算场景的扩展 5G和物联网的普及推动边缘计算场景快速增长。ksqlDB在2025年发布了轻量级边缘版本,针对资源受限的设备优化了内存管理和查询执行引擎。这一版本支持在边缘节点上进行实时流处理,满足了智能制造、智能交通和远程医疗等领域对低延迟和高可靠性的严苛要求。

流批一体化的进一步演进 虽然ksqlDB专注于流处理,但2025年的版本加强了与传统批处理系统的联动。通过深度集成Apache Iceberg和Delta Lake等表格式,ksqlDB实现了真正的流批统一架构。用户可以使用相同的SQL语法无缝查询实时数据流和历史数据湖,支持“一次开发,统一查询”的体验,大大提升了数据平台的灵活性和效率。

学习路径与资源推荐

系统化学习路线 对于想要深入掌握ksqlDB的开发者,建议遵循以下循序渐进的学习路径:

- 先夯实Kafka基础,深入理解主题、分区、副本和消费者组等核心概念

- 通过官方QuickStart指南体验基本操作,创建第一个流和表

- 学习ksqlDB的SQL语法扩展,重点掌握流处理特有的操作符和时间窗口

- 实践真实业务场景,如用户行为分析、实时风控和物联网数据处理

- 深入研究2025年新增的高级特性,如自定义函数、连接器开发和AI集成

官方文档与社区资源 Confluent官方文档(docs.confluent.io)始终是最权威的学习资料,2025年版本包含了最新的API说明和最佳实践案例。特别推荐阅读《ksqlDB in Action 2025》系列教程,其中提供了大量结合AI和云原生的实战案例。社区论坛和Slack频道依然是获取帮助和进行技术交流的重要平台,核心开发团队和行业专家经常参与讨论。

实践环境搭建建议 建议使用Confluent Platform 2025年发布的docker-compose环境进行实验,它提供了开箱即用的ksqlDB服务和预配置的示例数据流。对于希望体验生产环境的用户,可以申请Confluent Cloud的免费额度,体验完全托管的云服务并测试自动扩缩容功能。GitHub上的confluentinc/ksql-recipes仓库已更新至2025版本,包含了数十个结合最新特性的实战案例。

进阶学习资源 对于希望深入理解内部原理的学习者,推荐阅读2025年更新的《Designing Data-Intensive Applications》中关于流处理架构的章节。Confluent官网技术博客定期发布深度文章,如"Under the Hood of ksqlDB 2025"系列详细解析了查询优化器和资源管理器的实现机制。此外,Kafka Summit 2025的演讲视频是了解行业最佳实践的重要渠道,其中多个案例分享了ksqlDB在大型企业中的落地经验。

认证与培训体系 Confluent在2025年更新了认证体系,新推出的ksqlDB Advanced Developer认证全面考核流处理、AI集成和云原生部署等高级技能。官方培训课程提供了从入门到架构师的完整学习路径,其中的实战实验室环节采用最新版本的环境和案例。此外,Udemy和Coursera等平台也提供了2025年更新的视频课程,适合喜欢自主学习的开发者。

保持持续学习的关键是关注GitHub仓库的更新日志和RFC讨论,及时了解新特性的设计思路和演进方向。建议定期参加线上的社区meetup和技术沙龙,与同行交流实战经验,这往往是突破学习瓶颈的有效方式。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-09-04,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录