多系统架构下主数据管理(MDM)难题:如何打破数据孤岛实现实时同步?

原创多系统架构下主数据管理(MDM)难题:如何打破数据孤岛实现实时同步?

原创

KPaaS集成扩展

发布于 2026-03-03 16:12:49

发布于 2026-03-03 16:12:49

作为一名长期奋战在交付一线的主数据管理平台实施工程师,我接触过大量企业的IT架构。客户最常挂在嘴边的痛点不是“系统不够多”,而是“系统太乱”。ERP、CRM、SRM、MES以及各类SaaS应用林立,业务跑得飞快,但数据却成了最大的绊脚石。主数据(Master Data)分散在各个系统中,标准不一、更新不同步,导致“数据孤岛”现象严重。今天,我想抛开那些宏大的理论概念,从实际落地的角度,聊聊在多系统环境下,如何利用技术手段构建一套真正高效、可维护的主数据管理体系。

主数据混乱带来的代价

在项目调研阶段,我们经常会看到这样的场景:销售人员在CRM里更新了客户的联系电话,但财务在ERP里开票时用的还是三个月前的旧号码;仓库在WMS里修改了物料规格,但生产系统在MES里跑的还是老版本参数。

这种数据不一致带来的后果是直接的。首先是业务效率低下,大量时间浪费在人工核对数据和修正错误上。其次是决策失真,管理层看到的报表数据往往滞后于实际业务,甚至因为数据源冲突而相互矛盾。更严重的是合规风险,比如在审计时无法提供唯一、准确的数据来源证明。

很多企业在初期试图通过写死接口来解决这个问题。A系统调B系统,B系统调C系统。但随着系统数量增加,这种网状调用关系会变得极其复杂,牵一发而动全身。一旦某个字段定义变更,所有相关接口都要重新开发测试,维护成本呈指数级上升。这正是我们需要引入专业主数据管理(MDM)策略的根本原因。

实施路径:从模型统一到实时分发

基于我们在多个大型项目中的实施经验,构建高效的主数据管理体系,必须抓好三个核心环节:模型标准化、清洗规则配置化、同步机制自动化。

1.建立独立于业务系统的主数据模型

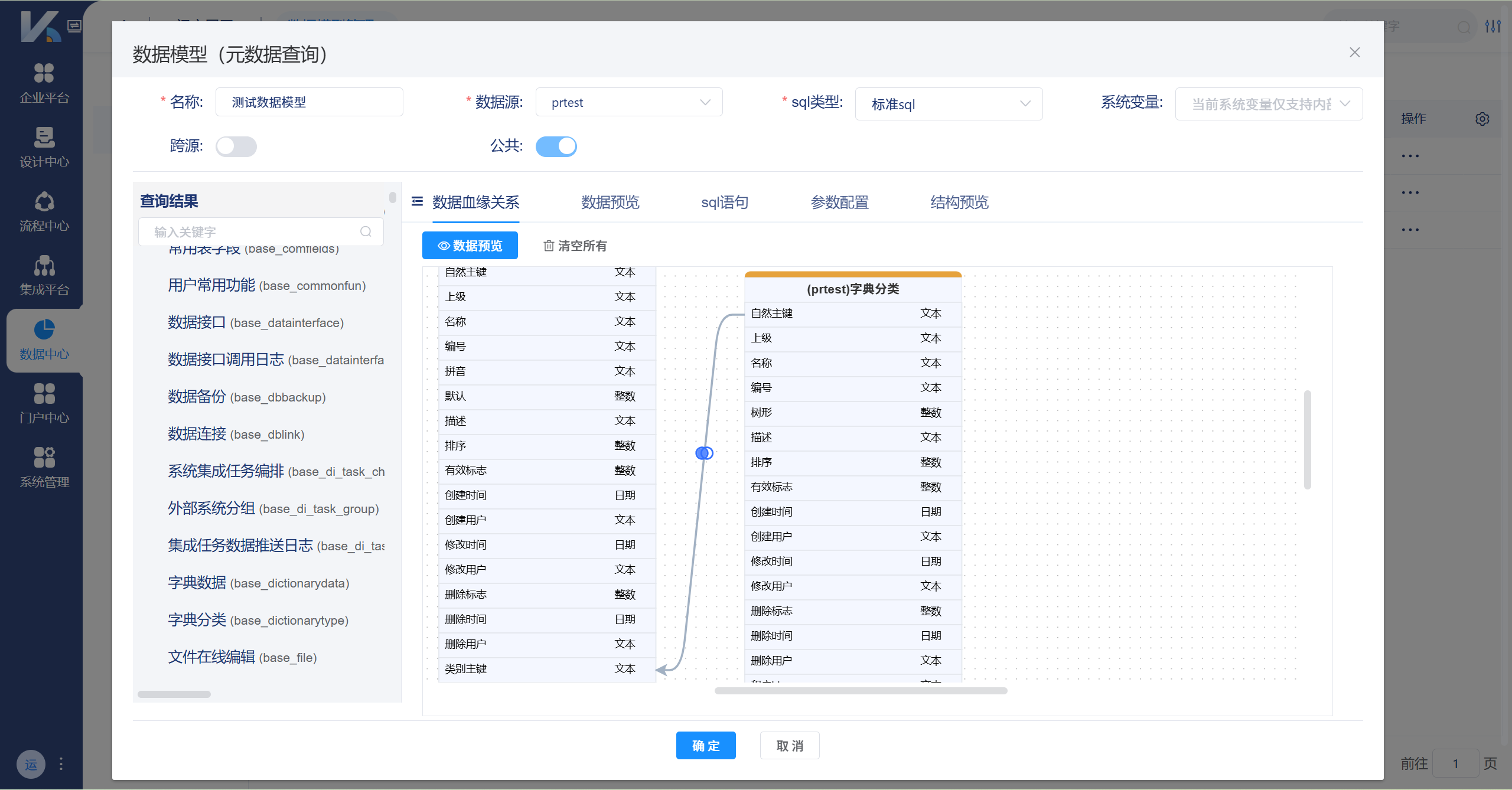

实施的第一步,绝不是急着写代码对接,而是先“定规矩”。我们需要在集成平台层建立一套独立的主数据模型。这套模型不依附于任何特定的ERP或CRM,而是作为企业数据的“黄金记录”。

在主数据管理平台上,我们会利用其可视化的建模工具,定义核心实体(如客户、供应商、物料)的属性、数据类型、必填项约束以及层级关系。例如,规定“统一社会信用代码”必须是18位且符合校验算法,“手机号”必须符合特定正则表达式。这一步看似枯燥,却是后续所有工作的基石。只有模型统一了,不同系统之间的对话才有了共同的“语言”。

可视化的建模工具,用户可以高效定义和管理数据模型,无需复杂编码。

2.配置化数据清洗,拒绝硬编码

数据来源复杂,质量参差不齐是常态。传统的做法是在代码里写大量的if-else逻辑来处理异常数据,但这不仅难维护,而且容易出错。

在平台的实施过程中,我们强烈推荐使用平台内置的“清洗规则引擎”。实施人员可以通过图形化界面,直接配置去重规则、字典映射、格式转换和默认值填充策略。比如,将来自不同系统的“男/女”、“M/F”、“1/0”统一映射为标准代码“MALE/FEMALE”。当业务规则变化时,只需在控制台调整配置,无需重启服务或修改代码。这种“配置即代码”的模式,极大地降低了后期运维的难度,也让业务部门能够参与到数据标准的制定中来。

支持数据库、API、文件等跨源数据集模型配置,并直观展示数据血缘关系。

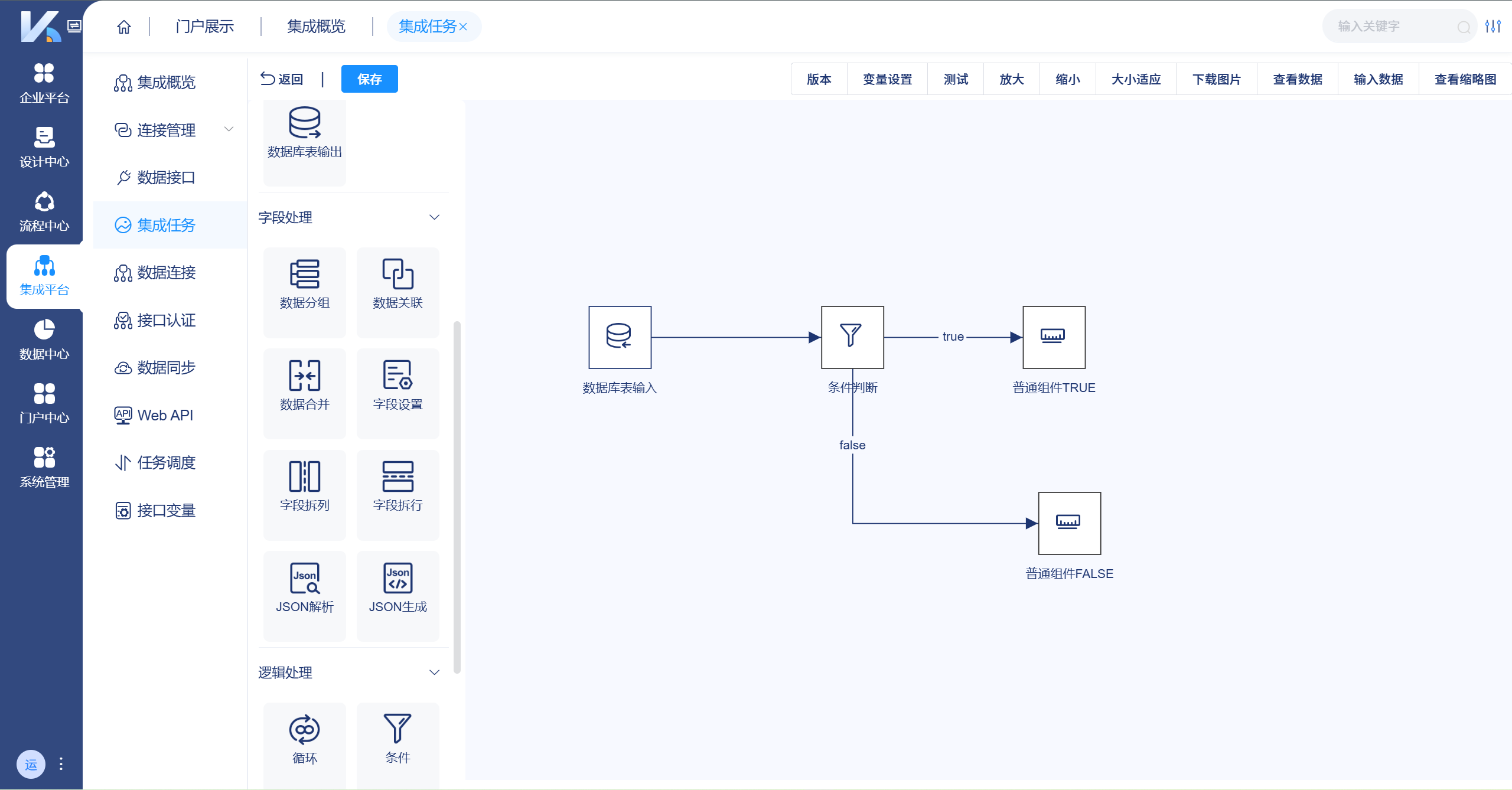

3.“事件驱动 + 定时任务”的双模同步机制

关于数据同步,很多客户会问:“是选实时还是选批量?”我的回答通常是:“都要”。

对于高时效性场景,如订单状态变更、库存扣减、价格调整,我们必须采用事件驱动架构。在主数据管理平台中,我们可以监听源系统的消息队列或数据库日志(CDC),一旦捕获到主数据变更事件,立即触发集成流程,经过转换后分发给所有订阅该数据的下游系统。这种机制能确保数据在秒级内达成一致。

而对于历史数据初始化、夜间大批量对账等非实时场景,则利用平台的定时任务功能,设置Cron表达式进行批量处理。这种“双模”策略既保证了业务的敏捷响应,又避免了实时通道被大批量数据堵塞,实现了系统资源的最优配置。

集成任务调度实时掌握任务详情

写在最后

作为实施工程师,我想给正在规划主数据体系的企业一点建议:不要试图用简单的点对点接口去解决复杂的网状数据问题。那是一条越走越窄的死胡同。

具备强大模型管理能力、灵活清洗规则和双模同步机制的数据集成平台,才是治本之策。它不仅能解决当下的数据一致性难题,更为未来新系统的快速接入预留了标准接口。在主数据管理这件事上,前期的规范化投入,将在后期的运维和业务敏捷性上获得成倍的回报。

构建高效的主数据管理体系,本质上是一场关于“连接”与“标准”的技术实践。只有让数据在多系统间自由、准确、实时地流动,企业的数字化转型才能真正从口号变为生产力。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录