机器学习算法之决策树:随机森林(Random Forest)原理、手动计算与Python/Java双代码实战指南

原创机器学习算法之决策树:随机森林(Random Forest)原理、手动计算与Python/Java双代码实战指南

原创

jack.yang

发布于 2026-03-29 16:49:44

发布于 2026-03-29 16:49:44

关键词:机器学习、随机森林、Random Forest、特征重要性、OOB误差、Bootstrap、决策树集成、Python随机森林、Java Weka RandomForest、sklearn RandomForest

一句话答案:随机森林 = Bagging + 特征随机选择——它通过双重随机性(样本+特征)构建大量去相关的决策树,并集成预测,实现高精度、低过拟合、强鲁棒性,是 Kaggle 与工业界的默认首选!

如果你在搜索:

- “随机森林和普通决策树有什么区别?”

- “为什么随机森林不容易过拟合?”

- “如何计算特征重要性?”

- “OOB 误差是什么?怎么用?”

- “Python 和 Java 怎么实现随机森林?”

那么,这篇文章就是为你写的——从单棵树到森林智慧,一步到位。

一、什么是随机森林?它的双重随机性设计

由 Leo Breiman 和 Adele Cutler 于 2001 年正式提出,随机森林(Random Forest, RF) 是 Bagging 的增强版。

🔑 两大核心创新:

- 样本随机(Bootstrap Aggregating)

- 每棵树使用有放回随机采样的训练子集(约63.2%原始数据)

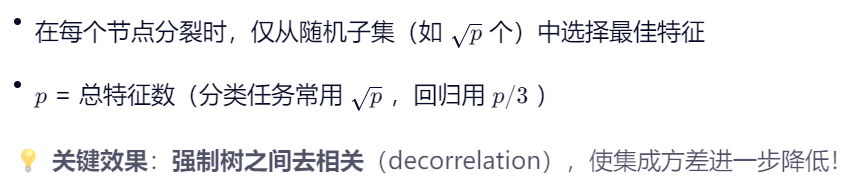

- 特征随机(Feature Randomness)

二、为什么随机森林如此强大?三大优势解析

✅ 1. 抗过拟合能力强

- 单棵深树易过拟合,但平均多棵去相关树显著降低方差

- 即使每棵树“过拟合”,集成后仍泛化良好

✅ 2. 自动处理高维与噪声特征

- 特征随机机制使无关特征难以持续影响多棵树

- 噪声特征在多数树中被忽略

✅ 3. 内置模型评估与解释工具

- OOB(Out-of-Bag)误差:无需验证集即可估计泛化误差

- 特征重要性:量化每个特征对预测的贡献

📊 实验表明:RF 在中小数据集上常优于 XGBoost,且调参简单(默认参数即强)。

三、手工推演:构建一个微型随机森林(分类任务)

📊 原始数据集(5个样本,3个特征)

ID | x₁(收入) | x₂(年龄) | x₃(城市) | y(是否购买) |

|---|---|---|---|---|

A | 高 | 30 | 北京 | 是 |

B | 中 | 25 | 上海 | 否 |

C | 低 | 40 | 广州 | 否 |

D | 高 | 35 | 深圳 | 是 |

E | 中 | 45 | 杭州 | 是 |

目标:用 3棵树 的随机森林预测新样本(收入=中, 年龄=30, 城市=成都)

🌲 步骤1:为每棵树生成 Bootstrap 样本

- 树1样本:[A, A, C, D, E] → y=[是,是,否,是,是]

- 树2样本:[B, C, C, D, E] → y=[否,否,否,是,是]

- 树3样本:[A, B, D, D, E] → y=[是,否,是,是,是]

🔍 步骤2:每棵树分裂时随机选特征子集

假设每节点随机选 2个特征(共3个):

树1根节点候选特征:x₁, x₂

- 测试 x₁(收入):高→[是,是],中/低→[否,是,是] → 纯度提升大

- 选择 x₁ 分裂

树2根节点候选特征:x₂, x₃

- x₂(年龄):≤30→[否],>30→[否,否,是,是] → 有效

- 选择 x₂ 分裂

树3根节点候选特征:x₁, x₃

- x₁:高/中→[是,否,是,是],低→[] → 不理想

- x₃(城市):无明显模式 → 任选 x₁

💡 结果:三棵树使用了不同特征组合,去相关成功!

🗳️ 步骤3:集成预测(多数投票)

新样本:(中, 30, 成都)

- 树1:收入=中 → 落入“中/低”分支 → 预测 是(3是:1否)

- 树2:年龄=30 ≤30 → 预测 否

- 树3:收入=中 → 预测 是(多数为是)

✅ 最终预测:是(2票 vs 1票)

四、随机森林 vs 其他算法

特性 | 决策树 | Bagging | 随机森林 | XGBoost |

|---|---|---|---|---|

样本随机 | ❌ | ✅ | ✅ | ✅(可选) |

特征随机 | ❌ | ❌ | ✅ | ❌(但有列采样) |

训练方式 | 单模型 | 并行 | 并行 | 串行 |

过拟合风险 | 高 | 中 | ✅ 低 | 中(需调参) |

默认性能 | 低 | 中 | ✅ 高 | 高 |

可解释性 | 高 | 中 | 中(需SHAP) | 低 |

🎯 RF 定位:“开箱即用”的高鲁棒性模型,适合快速原型与稳定部署。

五、核心机制详解

🔧 1. OOB(Out-of-Bag)误差

- 每个样本平均在 36.8% 的树中未被使用(袋外)

- 用这些树预测该样本,计算误差 → 无偏泛化误差估计

- 无需交叉验证!

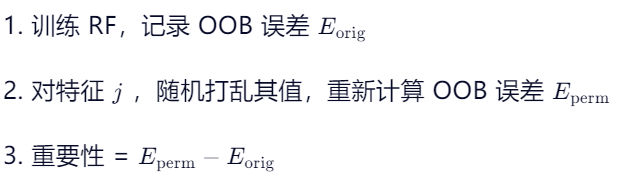

🔧 2. 特征重要性(Permutation Importance)

- 值越大,特征越重要

✅ 比基于分裂增益的重要性更可靠(不受特征基数影响)

六、Python 实现:sklearn + 手写核心逻辑

方案1:sklearn(生产级)

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import make_classification

from sklearn.inspection import permutation_importance

# 生成数据

X, y = make_classification(n_samples=1000, n_features=4, random_state=42)

# 训练

rf = RandomForestClassifier(

n_estimators=100,

max_features='sqrt', # 特征随机

oob_score=True, # 启用OOB

random_state=42

)

rf.fit(X, y)

# 预测 & OOB 误差

print("OOB Score:", rf.oob_score_)

print("预测:", rf.predict(X[:5]))

# 特征重要性(排列法)

perm_imp = permutation_importance(rf, X, y, n_repeats=10, random_state=42)

print("Permutation Importance:", perm_imp.importances_mean)方案2:手写简化版(教学用)

import numpy as np

from sklearn.tree import DecisionTreeClassifier

class SimpleRandomForest:

def __init__(self, n_estimators=10, max_features='sqrt'):

self.n_estimators = n_estimators

self.max_features = max_features

self.trees = []

self.feature_indices = []

def fit(self, X, y):

n_samples, n_features = X.shape

if self.max_features == 'sqrt':

m = int(np.sqrt(n_features))

else:

m = n_features // 3

for _ in range(self.n_estimators):

# Bootstrap 采样

idx = np.random.choice(n_samples, n_samples, replace=True)

X_boot, y_boot = X[idx], y[idx]

# 随机选特征

feat_idx = np.random.choice(n_features, m, replace=False)

self.feature_indices.append(feat_idx)

# 训练树

tree = DecisionTreeClassifier()

tree.fit(X_boot[:, feat_idx], y_boot)

self.trees.append(tree)

def predict(self, X):

predictions = []

for i, tree in enumerate(self.trees):

pred = tree.predict(X[:, self.feature_indices[i]])

predictions.append(pred)

# 多数投票

return np.array([np.bincount(col).argmax() for col in np.array(predictions).T])七、Java 实现:使用 Weka 的 RandomForest

Weka 提供官方 RandomForest 类。

Maven 依赖

<dependency>

<groupId>nz.ac.waikato.cms.weka</groupId>

<artifactId>weka-stable</artifactId>

<version>3.8.6</version>

</dependency>Java 代码

import weka.classifiers.trees.RandomForest;

import weka.core.Instances;

import weka.core.converters.ConverterUtils.DataSource;

public class RandomForestExample {

public static void main(String[] args) throws Exception {

// 加载数据

DataSource source = new DataSource("data.arff");

Instances data = source.getDataSet();

data.setClassIndex(data.numAttributes() - 1);

// 配置随机森林

RandomForest rf = new RandomForest();

rf.setNumIterations(100); // 树的数量

rf.setNumFeatures(0); // 0 = sqrt(numAttributes-1)

rf.setComputeImportances(true); // 计算特征重要性

// 训练

rf.buildClassifier(data);

// 输出模型(含OOB误差和特征重要性)

System.out.println(rf.toString());

// 预测

double pred = rf.classifyInstance(data.instance(0));

System.out.println("预测类别: " + pred);

}

}✅ Weka 自动输出 OOB 误差和特征重要性排名。

八、随机森林的适用场景与调参建议

✅ 最佳应用场景

- 中小数据集(<100万样本)

- 特征工程初步阶段(自动处理缺失值、非线性)

- 需要稳定 baseline(Kaggle 初赛常用)

- 特征重要性分析(业务洞察)

⚙️ 关键超参数

参数 | 默认值 | 调整建议 |

|---|---|---|

n_estimators | 100 | ↑ 直到 OOB 误差稳定 |

max_features | sqrt(p) | 分类用 sqrt,回归用 p/3 |

max_depth | None | 通常不设,靠树数量控制 |

min_samples_split | 2 | 噪声大时可增大(如10) |

💡 经验法则:先用默认参数跑,再微调

n_estimators和max_features。

九、局限性

问题 | 说明 |

|---|---|

❌ 预测速度慢 | 需遍历所有树(不适合实时系统) |

❌ 内存占用大 | 存储多棵树 |

❌ 外推能力弱 | 对训练范围外的输入表现差(如时间序列) |

❌ 不如梯度提升精度高 | 在大型结构化数据上,XGBoost/LightGBM 通常更优 |

✅ 结语

随机森林是优雅与实用的完美结合——它用简单的随机性思想,解决了过拟合、特征选择、模型评估等多个难题。即使在深度学习时代,它仍是数据科学家工具箱中最可靠的“瑞士军刀”。

记住:当你不知道用什么模型时,先试试随机森林。

现在,你已经能:

- 理解双重随机性如何提升性能

- 手动构建微型随机森林

- 在 Python/Java 中训练并解释 RF

- 利用 OOB 和特征重要性进行模型诊断

相关链接

- 📂 大模型技术专栏: 欢迎您到访 「大模型系列」。 在这个由参数驱动、以数据为燃料的新智能时代,大语言模型(LLM)已不再是实验室里的前沿概念,而是正在重塑搜索、办公、编程、教育、医疗乃至整个数字世界的底层引擎。从 GPT 到 Llama,从 Claude 到 Qwen,从推理到多模态,大模型正以前所未有的速度进化——它们既是工具,也是平台,更可能是下一代人机交互的“操作系统”。 本系列将带你:

- 🔍 深入原理:从 Transformer 架构、注意力机制到训练范式(预训练、微调、RLHF);

- ⚙️ 动手实践:本地部署、模型微调、RAG 构建、Agent 设计等实战指南;

- 🧠 理解边界:幻觉、偏见、安全对齐、推理瓶颈与当前能力天花板;

- 🌍 洞察趋势:开源 vs 闭源、端侧部署、MoE 架构、世界模型与 AGI 路径;

- 💼 落地应用:如何在企业中安全、高效、低成本地集成大模型能力。

无论你是想写代码调用 API 的开发者,设计 AI 产品的 PM,评估技术路线的管理者,还是单纯好奇智能本质的思考者,这里都有值得你驻足的内容。 不追 hype,只讲逻辑;不谈玄学,专注可复现的认知。 让我们一起,在这场百年一遇的智能革命中,看得更清,走得更稳 https://cloud.tencent.com/developer/column/107314

- 👤 关于作者: 专注技术落地,深耕硬核干货 本文作者致力于大模型相关技术的生态建设与实战落地。不同于浅层的概念科普,作者坚持 “手算 + 代码” 的深度分享模式,主张通过手动推演理解算法本质,结合生产级代码验证理论可行性。 请关注我主页:https://cloud.tencent.com/developer/user/2276240

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录