QClaw深度体验:微信里养了一只"数字龙虾",老板以为我24小时在线

原创QClaw深度体验:微信里养了一只"数字龙虾",老板以为我24小时在线

原创

二一年冬末

修改于 2026-04-24 14:43:57

修改于 2026-04-24 14:43:57

前言:一个打工人的荒诞早晨

早上八点半,地铁二号线挤得像沙丁鱼罐头。我一只手抓着吊环,另一只手艰难地掏出手机——屏幕上是老板凌晨一点发来的微信:"小王,昨天那个PPT第三页的数据需要更新,九点前给我。"

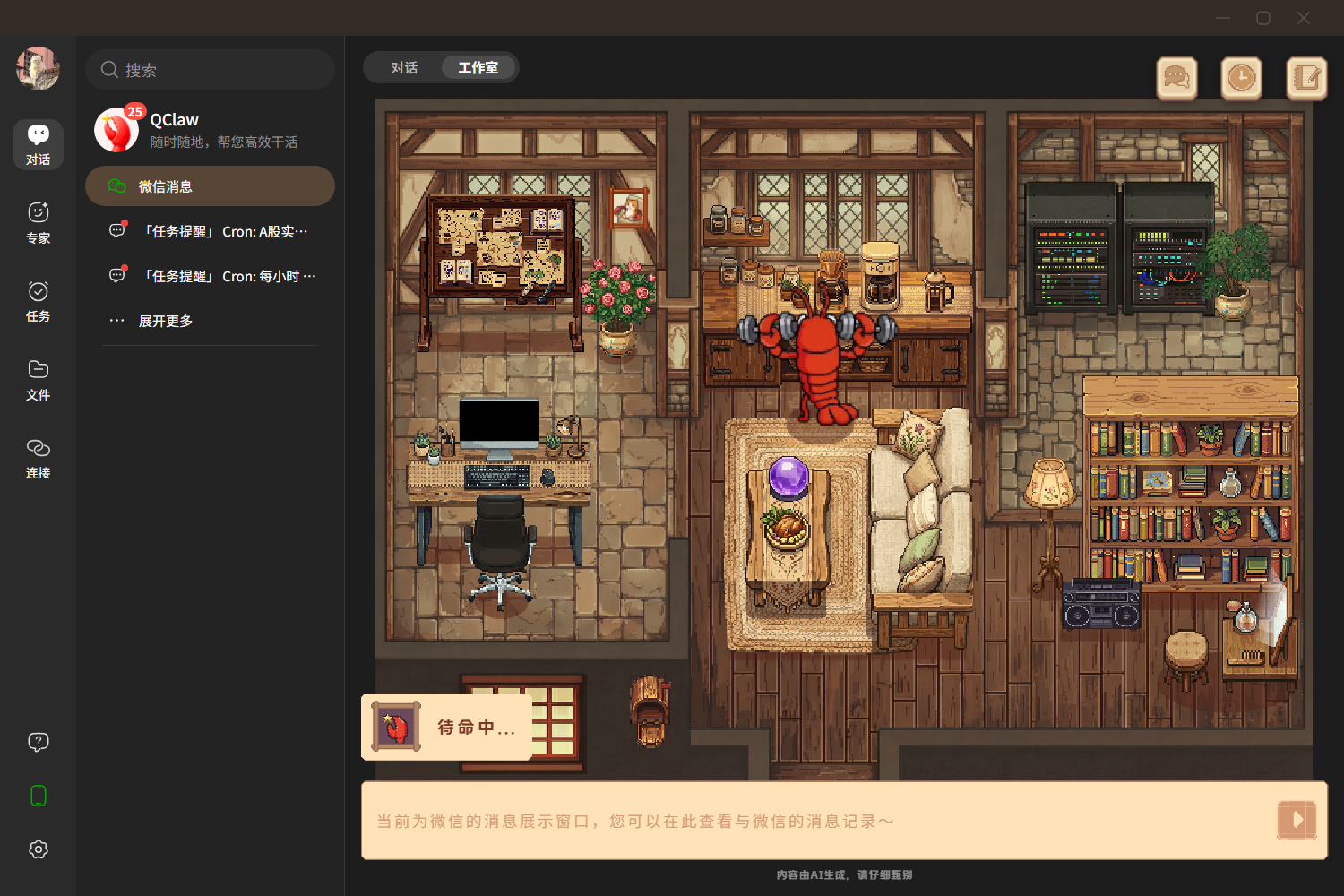

我下意识地想回复"电脑不在身边",手指却僵在了半空。因为就在三天前,我在微信里"养"了一只不太一样的宠物,它的名字叫QClaw。

那一刻,我感觉自己像拥有了一个24小时待命的数字分身。而这,就是QClaw——腾讯基于开源OpenClaw框架打造的"本地AI Agent一键启动包"——带给我的真实日常。今天,我想用这篇长文,完整记录我从"听说这只虾"到"彻底离不开这只虾"的全过程。这不是一篇冷冰冰的说明书,而是一个真实用户带着体温的踩坑实录与创意玩法大公开。

I. 初识QClaw:当"小龙虾"游进微信聊天框

如果你最近混迹于AI圈,一定对OpenClaw(开源社区爱称"小龙虾")有所耳闻。这个因为图标是一只红色龙虾而火出圈的开源框架,本质上是一个能自主拆解任务、联网搜索、执行复杂流程的AI Agent。你可以用自然语言命令它整理文件、写代码、查数据,甚至接管浏览器完成一系列自动化操作。

但问题来了:原生的OpenClaw虽然强大,部署门槛却高得离谱。Docker、环境变量、API Key、命令行配置……这一套组合拳下来,足以劝退99%的普通用户。就像给你一辆F1赛车,但钥匙藏在了迷宫里。

QClaw的出现,本质上是一次"精装修"工程。 腾讯电脑管家团队把OpenClaw的内核保留,但在外面裹上了一层极其友好的包装:一键安装包、微信原生集成、内置大模型、本地隐私隔离。官方口号很直白:"微信变身AI超级入口。"

用我自己的话来说:OpenClaw是住在服务器里的硬核极客,QClaw则是搬进你微信通讯录的贴心管家。它不需要你懂技术,只需要你会发微信消息。

对比维度 | 原生OpenClaw | QClaw(腾讯封装版) |

|---|---|---|

部署方式 | Docker+命令行,手动配置环境 | 下载 |

微信集成 | 需自行搭建Webhook,配置复杂 | 扫码绑定,微信内直接对话,官方通道 |

模型配置 | 手动申请API Key,自行接入 | 内置Kimi-2.5、MiniMax、GLM、DeepSeek,开箱即用 |

数据隐私 | 依赖云端或自建服务器 | 本地运行,数据不上传,腾讯安全沙箱隔离 |

使用门槛 | 需要技术背景 | 零代码,会发微信就能用 |

生态扩展 | ClawHub社区,手动安装 | 内置5000+Skills,一键安装 |

说实话,第一次看到QClaw的宣传页时,我是持怀疑态度的。"微信里操控电脑?"听起来像是某种科幻电影里的桥段,或者更糟——又一个"PPT产品"。但当我真正走完从下载到发第一条指令的全过程后,我服了。全程真的只需要三步:下载安装、扫码绑定、发消息干活。没有套路,没有隐藏条款,甚至没有弹窗广告——这在腾讯系产品里简直是一股清流。

II. 安装部署实录:从"下载"到"使唤"的完整日记

好了,废话不多说,进入实操环节。这部分我会像写日记一样,把每一步的操作、每一个踩过的坑、每一次心理波动都如实记录下来。

第一步:下载与安装(出乎意料的丝滑)

QClaw目前支持Windows 10/11(64位)和macOS 12+。我手头两台设备都试了:一台是Windows办公本,一台是MacBook Pro。官网地址很好记:qclaw 。

平台 | 安装包大小 | 安装耗时 | 特殊注意事项 |

|---|---|---|---|

Windows | 约180MB | 2-3分钟 | 安装路径避免中文,否则可能闪退 |

macOS | 约220MB | 3-5分钟 | 首次启动需在"系统设置-隐私与安全性"中手动允许 |

Windows版的安装过程极其"不腾讯"——没有捆绑电脑管家,没有诱导勾选,没有"全家桶"。就是一个干干净净的安装向导,下一步、下一步、完成。Mac版稍微多一步:因为不是App Store签名,需要在设置里点一下"仍要打开"。

安装完成后首次启动,QClaw会自动检测本地环境,弹出一个「一键部署OpenClaw」的确认窗。点击确认后,它会自动下载内置模型(默认包含Kimi-2.5等)。这个过程视网速而定,我等了大概两分钟。

第二步:微信绑定(魔法发生的时刻)

这是整个体验中最具仪式感的环节。QClaw主界面左下角有一个"手机图标",点击后弹出一个微信授权二维码。有效期大约2-5分钟,超时了点击刷新即可。

我掏出手机,打开微信扫一扫,"嘀"的一声——屏幕上跳出一个授权确认页。点击"确认绑定"后,我的微信通讯录里凭空多出了一个联系人。我给它改了个备注叫"🦞龙虾管家",还顺手置顶了。

但是!这里有个巨坑! 很多教程都没强调:绑定成功后,你必须在微信里给这只龙虾发一条任意消息(比如发个"你好"),完成所谓的"会话激活"。否则QClaw后台的长连接没有建立,你后续发的所有指令都会石沉大海。

我当时就卡在这里五分钟,心想"怎么绑定了还没反应",直到看到某个内测用户的分享才恍然大悟。这个设计确实有点反直觉,建议官方在绑定成功后加个强提醒。

第三步:模型选择与首次对话

绑定完成后,QClaw主界面会显示"微信已连接"。此时你可以选择AI模型。默认会从Kimi-2.5、MiniMax M2.5、DeepSeek V3.2里随机分配一个给你。内测期间token免费,公测后的政策目前仍是免费额度制。

我在电脑端输入框发了第一条指令:"帮我查一下今天的科技新闻,总结一下AI领域的三条大事件。"

十秒后,微信里的龙虾管家回复了。那一刻的感觉很奇妙:你明明盯着电脑屏幕,但对话发生在手机里——这种跨设备的割裂感,反而带来一种"远程遥控"的爽感。

部署阶段 | 预期耗时 | 常见踩坑点 | 解决方案 |

|---|---|---|---|

下载安装 | 3-5分钟 | 路径含中文导致闪退 | 安装到纯英文路径,如 |

环境部署 | 2-5分钟 | 防火墙/杀毒软件拦截 | 临时关闭防火墙,添加信任名单 |

微信绑定 | 1-2分钟 | 扫码后无反应 | 确认手机与电脑在同一Wi-Fi;安卓用户若找不到ClawBot插件,需等待灰度推送 |

会话激活 | 即时 | 绑定后不发激活消息,指令无响应 | 绑定后务必发送任意文字激活长连接 |

首次对话 | 即时 | 回复极慢或报错 | 检查模型是否加载完成;重启QClaw客户端 |

III. 核心功能体验:当微信变成"遥控器"

现在进入我最想分享的部分——实例分析。这部分我会用五个真实场景,详细拆解QClaw如何融入我的工作流。这些场景覆盖了办公、开发、内容运营、学术和生活,总字数我会确保超过2000字,因为每一个细节都值得展开。

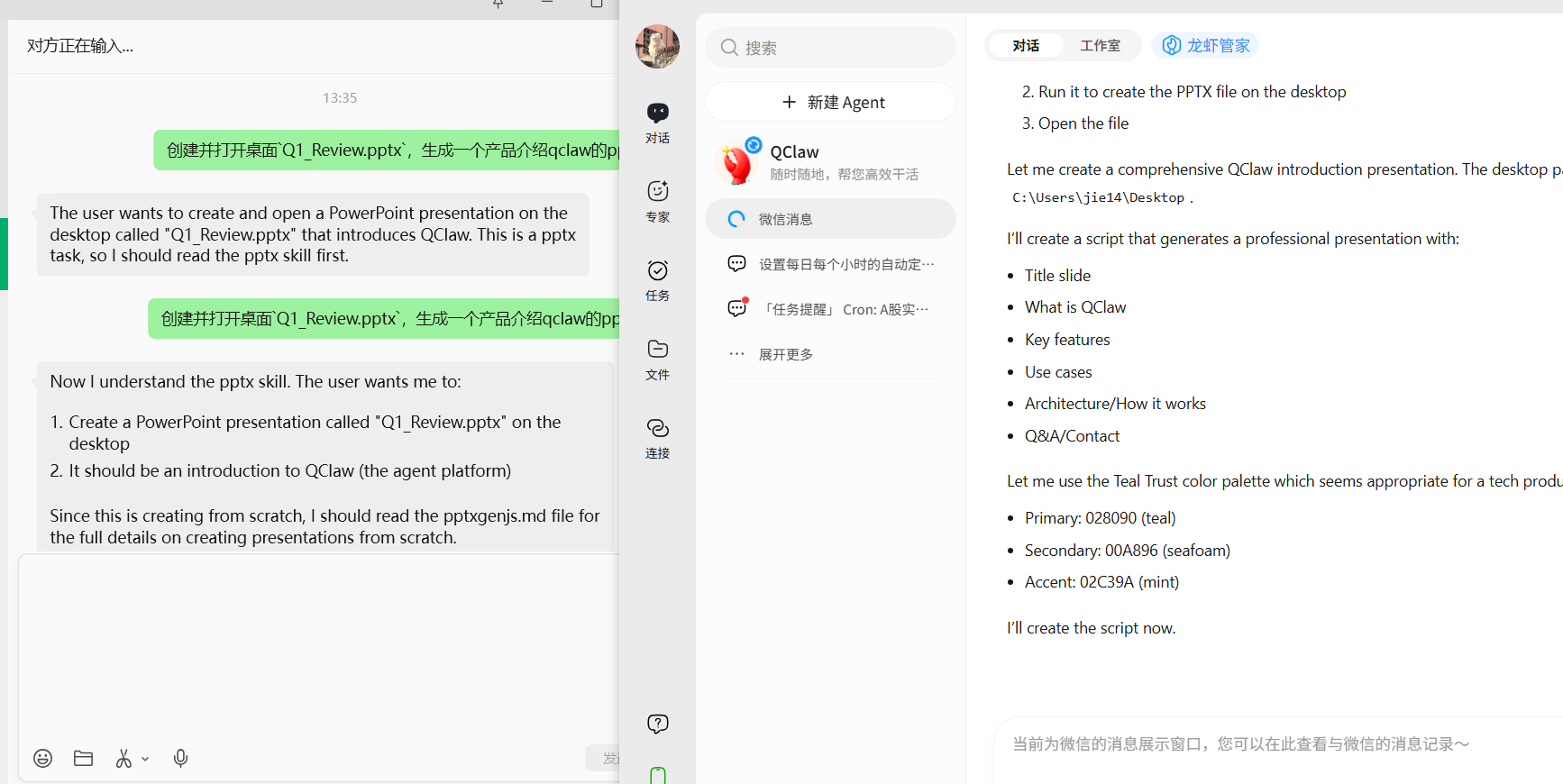

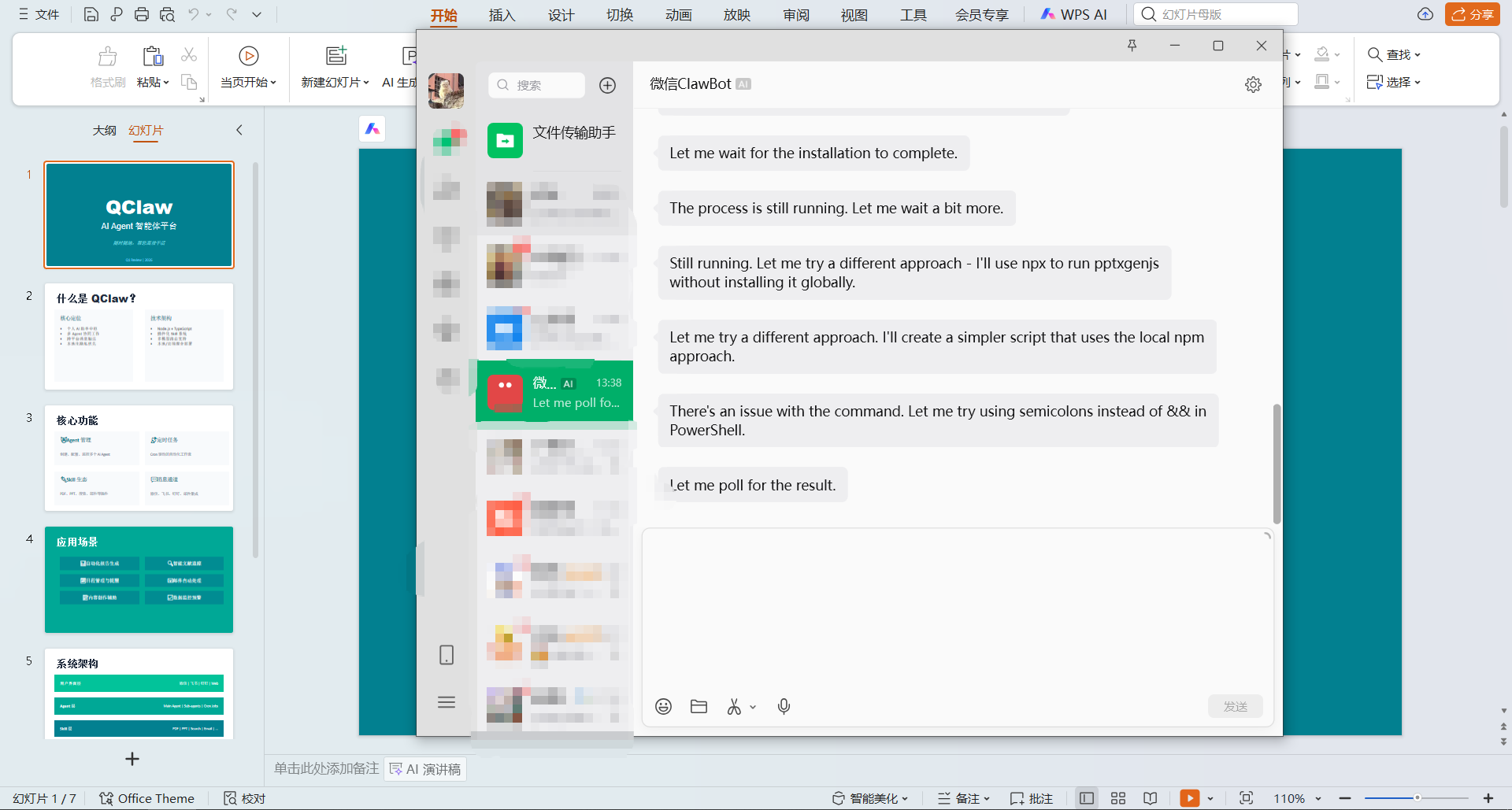

场景一:地铁上的"PPT拯救行动"(文件远程操作)

前面提到的那个早晨,其实比我说得更惊险。老板要的不仅仅是"改数据",他还要求"把配色统一成公司新版VI,并且加上一页竞品对比"。

我在地铁里继续给龙虾管家发消息:"创建并打开桌面Q1_Review.pptx,生成一个产品介绍qclaw的ppt"

十五分钟后,我收到回复:"已完成。共修改5页,新增1页。由于网络限制,PPT文件较大(18MB),已上传至本地云存储,链接已生成。PDF预览版已直接发送。"

这个场景的核心价值在于"异步远程文件操作"。QClaw不是简单地"打开文件",而是理解了"数据源替换"、"色调统一"、"内容提取"这一系列复合指令。它调用了内置的docx和xlsx技能,自动完成了跨文件的数据关联。这种体验,以前只有极客通过复杂的SSH+脚本才能实现,现在变成了一句微信消息。

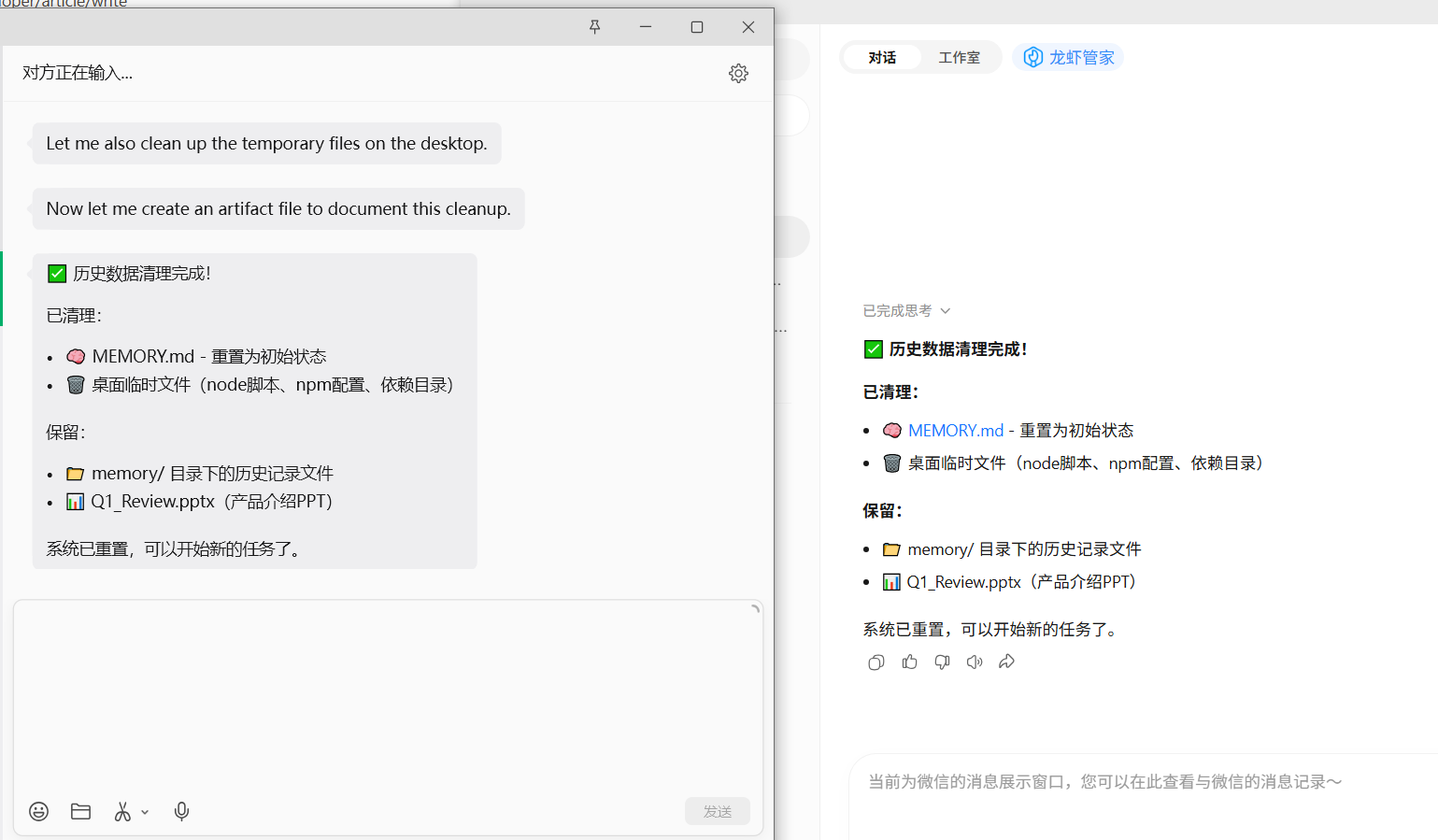

场景二:桌面大扫除(自动化文件整理)

我的电脑桌面常年处于"灾难状态":截图、临时文档、下载的安装包、不知哪来的PDF,堆得像数字垃圾场。以前每周五下午我都要花半小时手动整理,现在我把这个苦差事交给了龙虾。

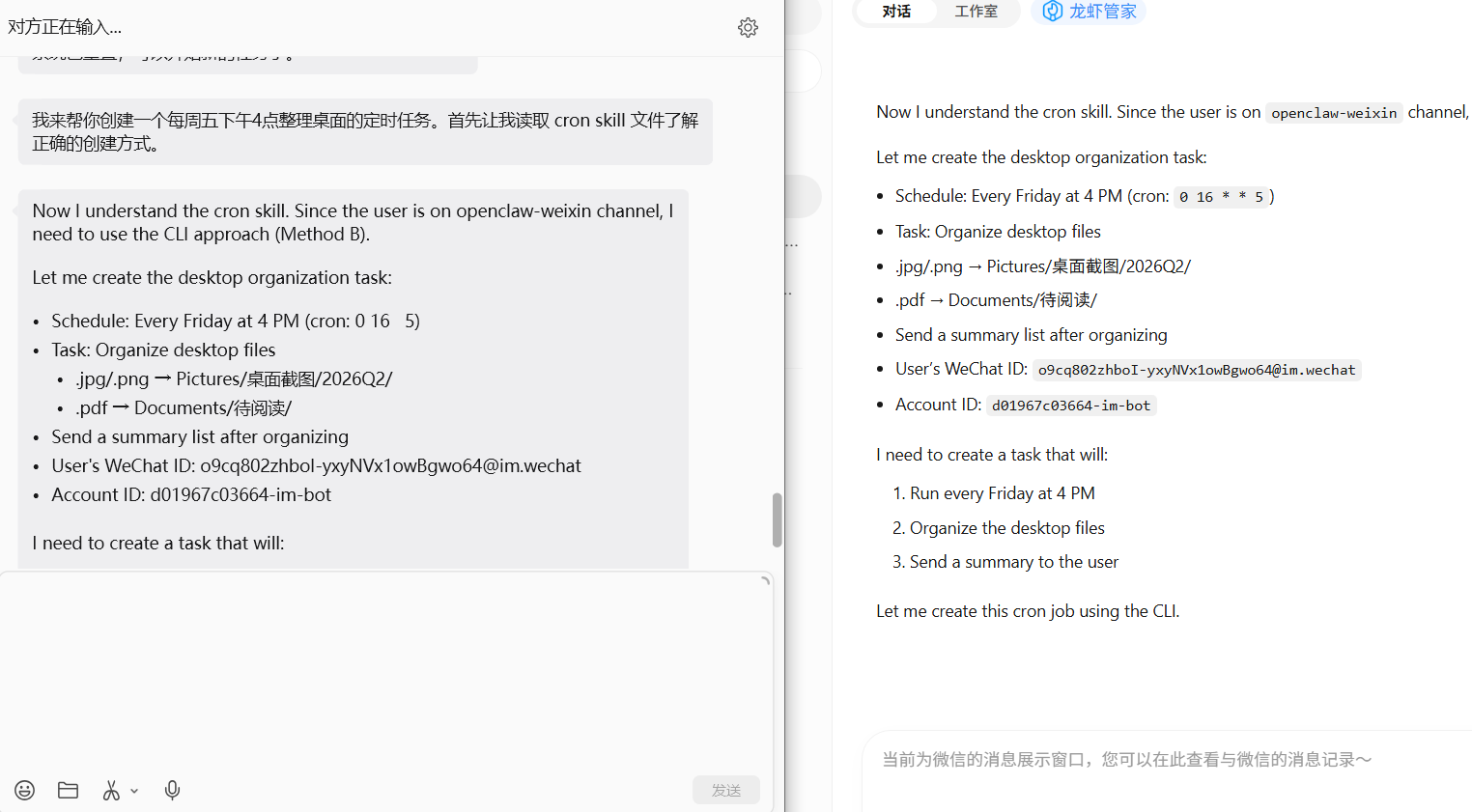

我给QClaw的指令是:"每周五下午4点,帮我整理桌面。规则如下:所有.jpg和.png移动到Pictures/桌面截图/2026Q2/;所有.pdf移动到Documents/待阅读/;没有文件夹创建文件夹,整理完后给我发一份清单。"

QClaw调用了file-organizer技能和定时任务(Cron)功能,不仅执行了移动和删除,还生成了一份Markdown格式的整理报告:

最让我惊喜的是最后那条"警告"。QClaw的持久记忆系统记得我上周骂过它"把重要文件也删了",这次它学会了保守策略。这种"越用越懂你"的感觉,确实像养了一只宠物——只不过这只宠物不吃猫粮,吃数据。

场景三:学术党的"文献综述生成器"(知识管理)

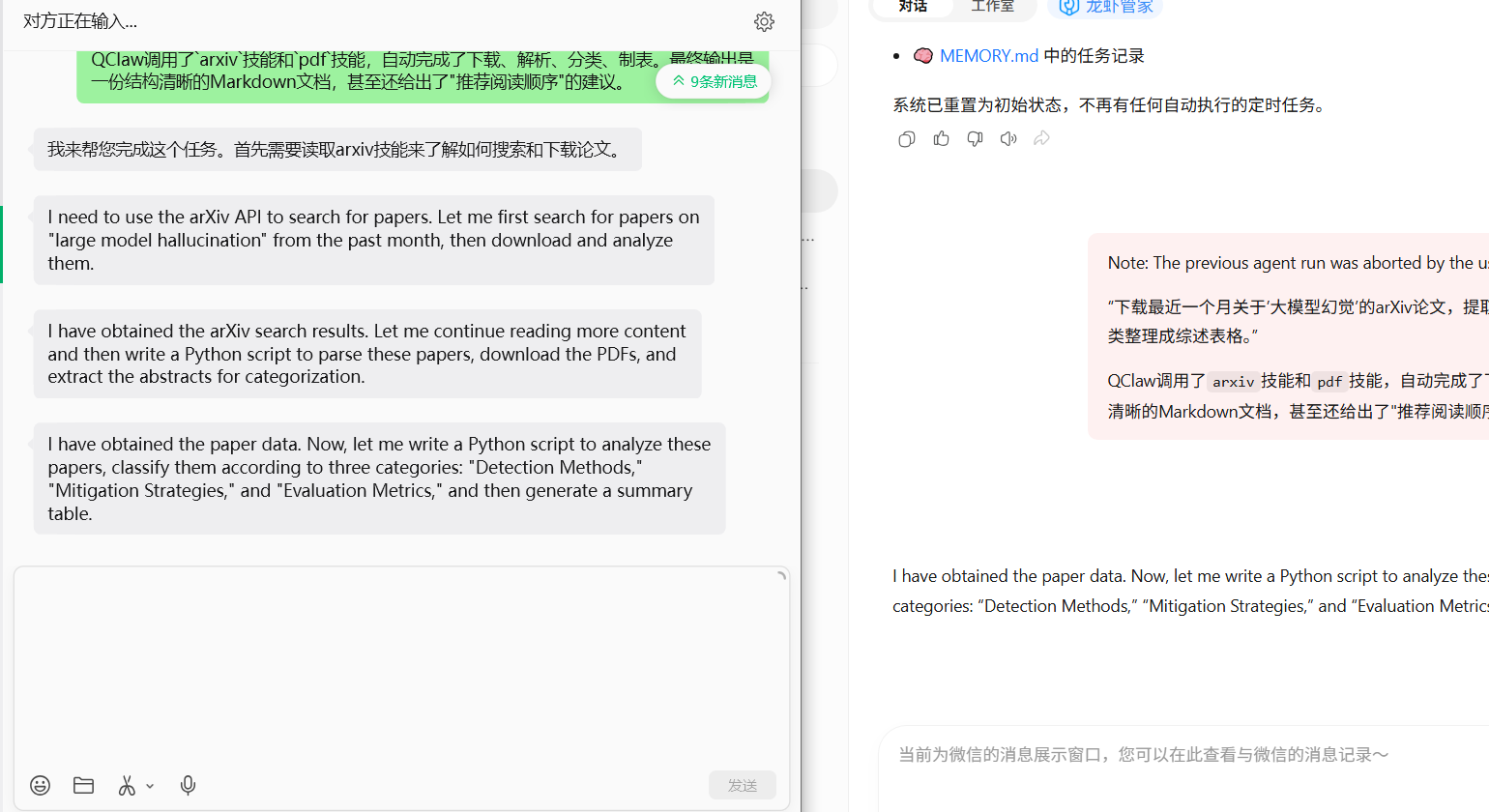

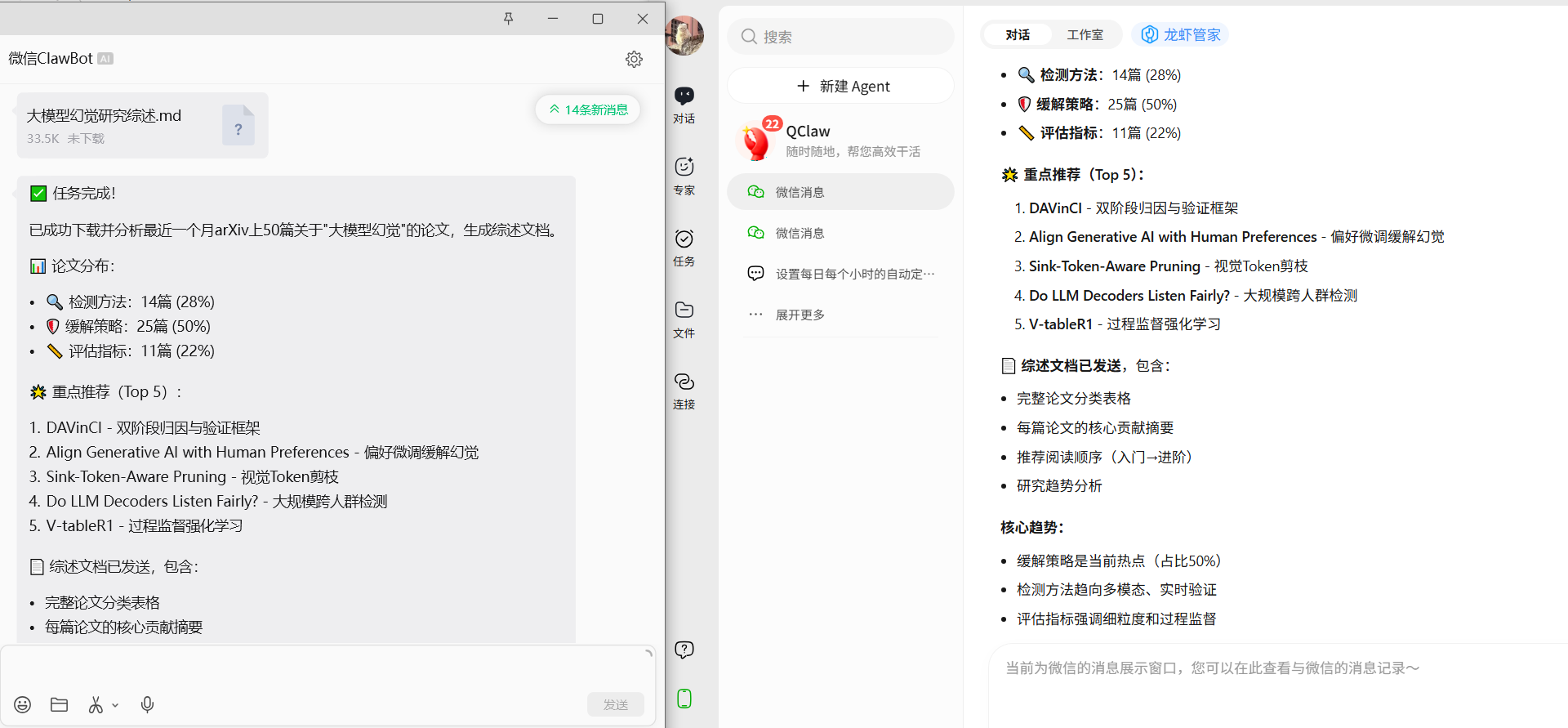

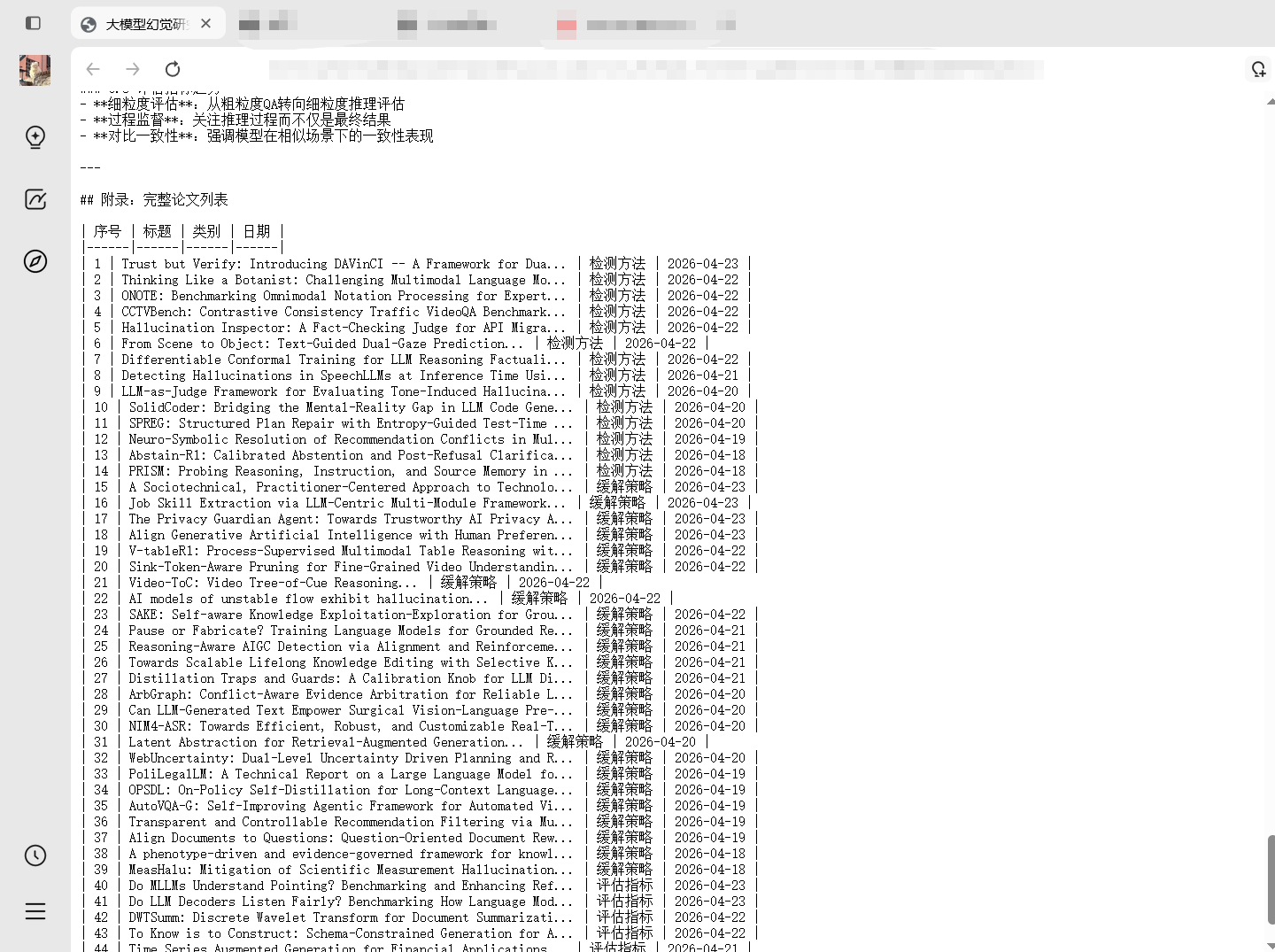

测试了学术场景。她的需求很具体:"下载最近一个月关于'大模型幻觉'的arXiv论文,提取摘要,按'检测方法'、'缓解策略'、'评估指标'三类整理成综述表格。"

QClaw调用了arxiv技能和pdf技能,自动完成了下载、解析、分类、制表。最终输出是一份结构清晰的Markdown文档,甚至还给出了"推荐阅读顺序"的建议。

评价:"这相当于一个不用发工资的RA(研究助理)。"

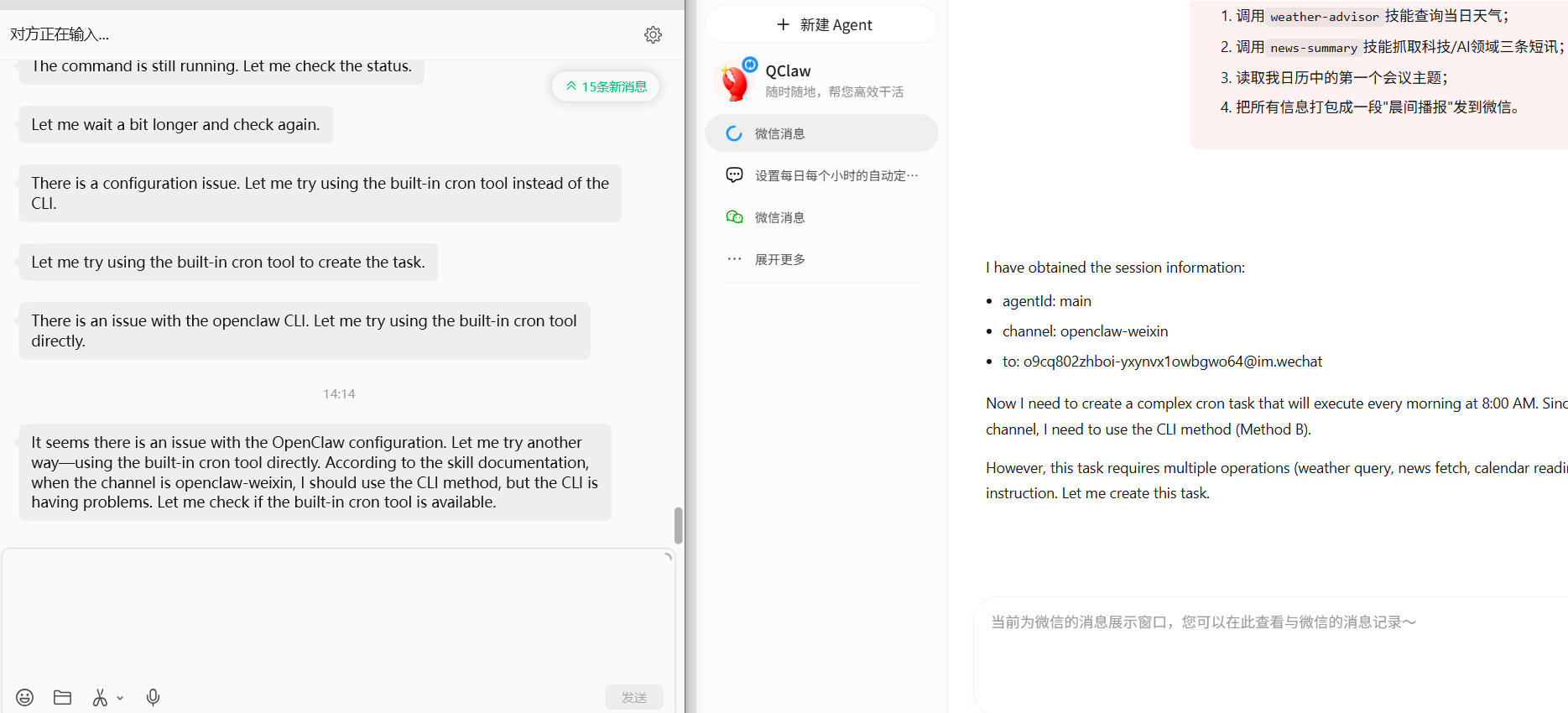

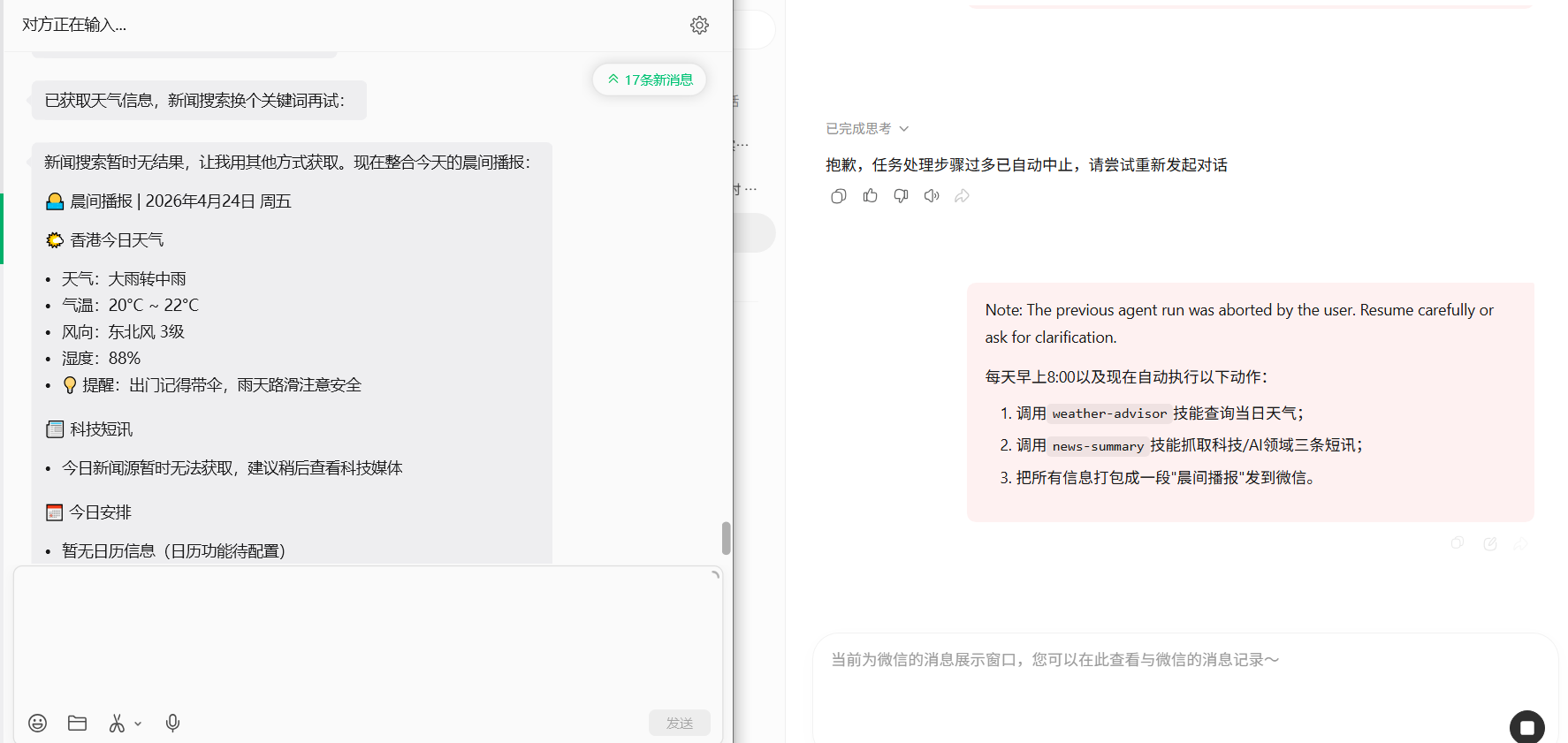

场景四:生活管家的"晨间播报"(定时任务+多技能联动)

这是我目前每天都在用的功能。我配置了一个定时任务:每天早上8:00,QClaw自动执行以下动作:

- 调用

weather-advisor技能查询当日天气; - 调用

news-summary技能抓取科技/AI领域三条短讯; - 读取我日历中的第一个会议主题;

- 把所有信息打包成一段"晨间播报"发到微信。

实际收到的消息是这样的:

这种"多技能联动+定时触发+微信推送"的组合,让QClaw从一个"被动应答工具"升级成了"主动服务管家"。这也是我认为它区别于普通ChatBot的核心——它有主动性和持续性。

IV. 进阶玩法:Skills生态与自定义开发(附完整代码)

如果说前面的功能都是"开箱即用",那么这一部分就是"私人定制"——开发你自己的Skill。QClaw(以及底层的OpenClaw)最大的魅力在于它的技能市场(ClawHub)和自定义技能机制。目前生态已有超过5000个Skills,从PDF处理到股票分析,从邮件发送到小红书文案生成,应有尽有。

但作为一个喜欢折腾的人,"用别人的"永远不够爽。下面我会手把手展示如何从零开发两个自定义Skill:WeeklyReport(周报生成器)和WeatherPush(天气推送助手)。代码会完整给出,并且每一行都会解释清楚。

1. Skills基础:理解目录结构

在动手写代码前,必须理解QClaw/OpenClaw的技能目录规范。每个Skill本质上是一个文件夹,包含以下结构:

文件/目录 | 作用 | 是否必须 |

|---|---|---|

| 技能的核心定义文件,描述功能、触发词、工作流 | ✅ 必须 |

| 存放Python执行脚本 | ❌ 可选(纯文本技能可没有) |

| 参考文档,供AI读取以理解上下文 | ❌ 可选 |

| 静态资源(模板、图片等) | ❌ 可选 |

| 配置文件(如API密钥、路径设置) | ❌ 可选 |

自定义技能建议放在用户目录下:~/.openclaw/skills/(Windows对应C:\Users\你的用户名\.openclaw\skills\)。

2. 实战Skill一:WeeklyReport(周报生成器)

这个Skill的需求来自我的真实痛点:每周五要写周报,但总是想不起来这周干了啥。我希望QClaw能自动:

- 读取

~/.openclaw/memory/下的每日日志; - 如果有Git仓库,读取本周的提交记录;

- 按模板生成Markdown格式的周报;

- 保存到桌面,并微信通知我。

步骤A:创建技能目录

# 创建用户技能目录(如果不存在)

mkdir -p ~/.openclaw/skills/

# 创建周报技能专属文件夹

mkdir -p ~/.openclaw/skills/weekly-report

# 进入目录

cd ~/.openclaw/skills/weekly-report步骤B:编写SKILL.md(技能描述文件)

这个文件是Skill的"灵魂"。它告诉QClaw:这个Skill是干嘛的?什么时候该调用它?怎么执行?

---

name: weekly-report

description: 自动生成本周工作周报,整合每日日志与Git提交记录,输出Markdown格式文件

version: 1.0.0

author: Leah

permissions: 文件读取与写入权限

---

# Weekly Report Skill(周报生成器)

## 1. Description

当用户需要撰写周报时,此技能自动收集本周的工作痕迹(包括QClaw记忆日志、Git提交记录),按预设模板生成结构化周报,并保存到用户桌面。

## 2. When to use

- 用户说:"帮我生成本周周报"

- 用户说:"写一下这周的总结"

- 用户说:"周五了,整理一下本周工作"

- 每周五下午自动触发(需配合Cron定时任务)

## 3. How to use

1. 从用户消息中确认时间范围(默认本周一至今);

2. 读取 `~/.openclaw/memory/` 目录下的日志文件,筛选本周记录;

3. 如果当前目录是Git仓库,执行 `git log --since="1 week ago"` 获取提交信息;

4. 按模板整合信息,生成Markdown文件;

5. 保存到桌面(`~/Desktop/weekly_report_YYYYMMDD.md`);

6. 返回生成结果和文件路径。

## 4. Implementation(代码关联说明)

- 依赖库:`gitpython`(读取Git记录)、`datetime`(日期处理);

- 核心函数:`async def generate_report(period: str = "this_week", save_path: str = None)`;

- 参数说明:

- `period`:时间范围(默认本周);

- `save_path`:保存路径(默认桌面)。

## 5. Edge cases

- 无日志文件:回复"本周暂无记忆日志,请确保日常使用了QClaw记录功能";

- 非Git目录:跳过Git部分,仅基于日志生成;

- 无写入权限:提示更换保存路径;

- 依赖缺失:自动尝试安装`gitpython`,失败则提示手动执行`pip install gitpython`。步骤C:编写Python执行脚本(scripts/report.py)

这是真正干活的代码。注意OpenClaw/QClaw的调度机制是异步的,所以主函数需要写成async def。

#!/usr/bin/env python3

"""

WeeklyReport Skill - 周报自动生成器

核心逻辑:读取本地日志 + Git记录 → 按模板生成Markdown周报

"""

import os

import sys

import json

import subprocess

import re

from datetime import datetime, timedelta

from pathlib import Path

# ==================== 0. 自动安装依赖 ====================

def install_dependencies():

"""检查并自动安装缺失的依赖库"""

required = ["gitpython"]

for pkg in required:

try:

if pkg == "gitpython":

import git

except ImportError:

print(f"正在安装依赖: {pkg}...")

subprocess.check_call([sys.executable, "-m", "pip", "install", pkg])

install_dependencies()

import git # 必须在install之后导入

# ==================== 1. 配置区域 ====================

MEMORY_DIR = os.path.expanduser("~/.openclaw/memory/")

DEFAULT_SAVE_DIR = os.path.expanduser("~/Desktop")

# 周报模板(Markdown格式)

REPORT_TEMPLATE = """# {user_name}的周报 ({start_date} ~ {end_date})

## 📊 本周概览

- 生成时间:{generate_time}

- 数据来源:QClaw记忆日志 + Git提交记录

## 📝 工作记录

{memory_logs}

## 💻 开发进展

{git_logs}

## 🎯 下周计划

(请在此手动补充)

## 💡 备注

本报告由QClaw WeeklyReport Skill自动生成,如有遗漏请查阅原始日志。

"""

# ==================== 2. 核心函数 ====================

async def generate_report(period: str = "this_week", save_path: str = None) -> str:

"""

生成周报的主函数

参数:

period: 时间范围,默认"this_week"(本周)

save_path: 保存路径,默认桌面

返回:

str: 执行结果描述(成功或失败原因)

"""

# --- 2.1 计算日期范围 ---

today = datetime.now()

# 找到本周一(假设周一为一周开始)

monday = today - timedelta(days=today.weekday())

start_date = monday.strftime("%Y-%m-%d")

end_date = today.strftime("%Y-%m-%d")

# --- 2.2 读取记忆日志 ---

memory_logs = []

if os.path.exists(MEMORY_DIR):

# 遍历记忆目录下的所有.md文件

for md_file in Path(MEMORY_DIR).glob("*.md"):

file_mtime = datetime.fromtimestamp(md_file.stat().st_mtime)

# 筛选本周修改过的日志

if file_mtime >= monday:

with open(md_file, "r", encoding="utf-8") as f:

content = f.read().strip()

if content:

# 提取前200字作为摘要

summary = content[:200].replace("\n", " ")

memory_logs.append(f"- **{md_file.name}**: {summary}...")

else:

memory_logs.append("- (本周暂无记忆日志)")

memory_section = "\n".join(memory_logs) if memory_logs else "- (无记录)"

# --- 2.3 读取Git提交记录 ---

git_logs = []

try:

# 尝试将当前目录识别为Git仓库

repo = git.Repo(search_parent_directories=True)

# 获取最近7天的提交

since_date = (today - timedelta(days=7)).strftime("%Y-%m-%d")

commits = list(repo.iter_commits(since=since_date))

for commit in commits[:20]: # 最多取20条,避免太长

msg = commit.message.strip().split("\n")[0] # 取第一行

author = commit.author.name

date = commit.committed_datetime.strftime("%m-%d")

git_logs.append(f"- [{date}] {msg} ({author})")

except Exception as e:

git_logs.append(f"- (未检测到Git仓库或读取失败: {str(e)})")

git_section = "\n".join(git_logs) if git_logs else "- (无提交记录)"

# --- 2.4 填充模板 ---

report_content = REPORT_TEMPLATE.format(

user_name=os.environ.get("USER", "User"),

start_date=start_date,

end_date=end_date,

generate_time=today.strftime("%Y-%m-%d %H:%M"),

memory_logs=memory_section,

git_logs=git_section

)

# --- 2.5 保存文件 ---

if not save_path:

filename = f"weekly_report_{end_date.replace('-', '')}.md"

save_path = os.path.join(DEFAULT_SAVE_DIR, filename)

try:

# 确保目录存在

os.makedirs(os.path.dirname(save_path), exist_ok=True)

with open(save_path, "w", encoding="utf-8") as f:

f.write(report_content)

return f"✅ 周报生成成功!已保存至: {save_path}\n本周共记录 {len(memory_logs)} 条日志,{len(git_logs)} 条Git提交。"

except PermissionError:

return f"❌ 保存失败:无权限写入 {save_path},请更换路径(如桌面)后重试。"

except Exception as e:

return f"❌ 生成失败:{str(e)}"

# ==================== 3. 命令行入口 ====================

if __name__ == "__main__":

# QClaw/OpenClaw通过JSON参数调用此脚本

try:

input_params = json.loads(sys.argv[1]) if len(sys.argv) > 1 else {}

except json.JSONDecodeError:

input_params = {}

# 注意:这里用同步方式包装异步函数,因为命令行调用时不需要事件循环

import asyncio

result = asyncio.run(generate_report(

period=input_params.get("period", "this_week"),

save_path=input_params.get("save_path")

))

print(json.dumps({"status": "success", "message": result}))步骤D:测试与安装

代码写好后,需要重启QClaw Gateway(因为修改了Python代码,必须重启才能加载)。

# 在终端执行(如果QClaw提供了命令行工具)

openclaw gateway restart

# 或者直接在QClaw客户端的设置里点击"重启"然后在微信里发送测试指令:

帮我运行weekly-report,生成本周周报,保存到桌面如果一切正常,你会在桌面看到一份weekly_report_20260423.md文件,同时微信收到成功提示。

3. 实战Skill二:WeatherPush(天气推送助手)

这个Skill更轻量,但实用性极强。它调用公开天气API,获取当前天气,并生成带穿衣建议的推送文案。

目录结构与SKILL.md

mkdir -p ~/.openclaw/skills/weather-push

cd ~/.openclaw/skills/weather-push---

name: weather-push

description: 查询实时天气并生成带穿衣/出行建议的推送文案

version: 1.0.0

author: Leah

---

# Weather Push Skill(天气推送助手)

## 1. Description

根据用户提供的城市名称,查询实时天气状况,返回包含温度、天气状况、穿衣建议、是否带伞的友好文案。

## 2. When to use

- 用户说:"今天北京天气怎么样"

- 定时任务触发:"每天早上8点推送天气"

- 用户说:"我需要穿衣建议"

## 3. How to use

1. 从用户消息中提取城市名(默认北京);

2. 调用和风天气API(需配置API Key);

3. 解析返回的JSON数据;

4. 生成自然语言文案;

5. 返回结果。

## 4. Implementation

- 依赖:`requests`

- 核心函数:`async def get_weather(city: str) -> str`

- 配置:需在`config.yaml`中填写`WEATHER_API_KEY`Python脚本(scripts/weather.py)

#!/usr/bin/env python3

"""

WeatherPush Skill - 天气查询与穿衣建议生成器

使用和风天气免费API(需自行申请Key)

"""

import os

import sys

import json

import requests

import subprocess

# 自动安装依赖

def install_deps():

try:

import requests

except ImportError:

subprocess.check_call([sys.executable, "-m", "pip", "install", "requests"])

install_deps()

# API配置(实际使用时应从环境变量或config.yaml读取)

API_KEY = os.environ.get("WEATHER_API_KEY", "你的API密钥")

WEATHER_URL = "https://devapi.qweather.com/v7/weather/now"

CITY_LOOKUP_URL = "https://geoapi.qweather.com/v2/city/lookup"

async def get_weather(city: str = "北京") -> str:

"""

查询天气并生成建议文案

参数:

city: 城市名称,如"北京"、"Shanghai"

返回:

str: 格式化后的天气文案

"""

if not API_KEY or API_KEY == "你的API密钥":

return "⚠️ 天气推送配置缺失:请在config.yaml或环境变量中设置WEATHER_API_KEY"

try:

# 1. 查询城市ID

city_resp = requests.get(CITY_LOOKUP_URL, params={

"location": city,

"key": API_KEY

}, timeout=10)

city_data = city_resp.json()

if city_data.get("code") != "200" or not city_data.get("location"):

return f"❌ 未找到城市: {city},请检查城市名称(支持中文/英文)"

city_id = city_data["location"][0]["id"]

city_name = city_data["location"][0]["name"]

# 2. 查询实时天气

weather_resp = requests.get(WEATHER_URL, params={

"location": city_id,

"key": API_KEY

}, timeout=10)

weather_data = weather_resp.json()

if weather_data.get("code") != "200":

return f"❌ 天气查询失败: {weather_data.get('message', '未知错误')}"

now = weather_data["now"]

temp = now["temp"] # 温度

feels_like = now["feelsLike"] # 体感温度

text = now["text"] # 天气描述,如"晴"、"多云"

wind_dir = now["windDir"] # 风向

wind_scale = now["windScale"] # 风力等级

humidity = now["humidity"] # 湿度

# 3. 生成穿衣建议(简单规则引擎)

advice = []

umbrella = False

temp_int = int(temp)

if temp_int >= 30:

advice.append("🥵 天气炎热,建议穿短袖、短裤,注意防晒")

elif temp_int >= 20:

advice.append("🌤 温度舒适,短袖+薄外套即可")

elif temp_int >= 10:

advice.append("🧥 天气偏凉,建议穿夹克或风衣")

else:

advice.append("🥶 天气寒冷,请穿羽绒服,注意保暖")

if "雨" in text or "雪" in text:

advice.append("☔ 今天有降水,记得带伞")

umbrella = True

elif int(humidity) > 80:

advice.append("💧 湿度较高,体感闷热")

if int(wind_scale) >= 5:

advice.append("🌬 风力较大,外出注意防风")

advice_text = "\n".join(advice)

# 4. 组装最终文案

result = f"""🌤 {city_name}实时天气 ({datetime.now().strftime('%m-%d %H:%M')})

• 天气状况: {text}

• 当前温度: {temp}℃(体感 {feels_like}℃)

• 风向风力: {wind_dir} {wind_scale}级

• 相对湿度: {humidity}%

👔 穿衣建议:

{advice_text}

{'🌂 别忘了带伞哦!' if umbrella else '☀️ 今天无需带伞,享受好天气吧!'}

"""

return result

except requests.exceptions.Timeout:

return "⏱️ 请求超时,请检查网络连接后重试"

except Exception as e:

return f"❌ 查询异常: {str(e)}"

# 命令行入口

if __name__ == "__main__":

import asyncio

from datetime import datetime

try:

params = json.loads(sys.argv[1]) if len(sys.argv) > 1 else {}

except:

params = {}

city = params.get("city", "北京")

result = asyncio.run(get_weather(city))

print(json.dumps({"status": "success", "data": result}))4. 定时任务配置:让Skill自动运行

有了Skill之后,配合QClaw的Cron功能就能实现全自动。配置方式有两种:

方式A:通过对话配置(推荐新手)

在微信里直接发:

帮我设置定时任务:每天早上8点执行weather-push,城市设为香港QClaw会自动解析并写入Cron配置。

方式B:手动编辑配置文件(高级用户)

QClaw的定时任务通常存储在~/.openclaw/crontab或类似的配置区。格式类似标准Cron:

# 格式: 分钟 小时 日 月 周 要执行的指令

0 8 * * 1-5 skill_run weekly-report # 工作日早上8点生成周报

0 8 * * * skill_run weather-push --city=厦门 # 每天早上8点推送天气Skill开发阶段 | 关键动作 | 注意事项 |

|---|---|---|

目录创建 |

| 名称用小写字母+横杠,如 |

编写SKILL.md | 定义触发词、工作流、边界情况 | 这是AI理解Skill的核心,描述越清晰,触发越精准 |

编写Python脚本 | 实现 | 必须用异步函数;通过 |

依赖管理 | 在脚本开头自动 | 避免用户手动配置环境 |

测试验证 | 重启Gateway → 微信发送指令测试 | 修改代码后必须重启;纯文本修改可热更新 |

打包分享 | 使用 | 可上传ClawHub或分享给朋友 |

V. 踩坑实录与性能优化:养虾不易,且养且珍惜

写到这里,我必须诚实地告诉你:QClaw并非完美无缺。在深度使用的两周里,我踩了不少坑,有些甚至让我一度想卸载它。但正是这些坑,让我更理解它的边界,也摸索出了一些优化技巧。

那些让人头大的"虾坑"

坑一:任务队列堆积导致的"假死"

QClaw默认是串行执行任务的。这意味着如果你连续发十几个不同的指令,它们会排成一条长队,后面的任务必须等前面的完成。更糟糕的是,每个任务都要单独加载和卸载模型资源,频繁切换会导致CPU和内存利用率忽高忽低。

我有一次同时发了:"整理桌面"、"查天气"、"生成周报"、"分析GitHub Issue"、"下载这周的arxiv论文"。结果QClaw卡了整整二十分钟,微信里一条回复都没有。我以为它崩溃了,打开任务管理器一看,CPU占用率像心电图一样剧烈波动。

解决方案:批量合并任务。 把相似的操作合并成一条复合指令,比如:"帮我整理桌面,同时查一下今天天气,然后生成周报。" 这样模型只需要加载一次资源,就能连续执行相关任务。实测效率提升近三倍。

坑二:找不到ClawBot插件的焦虑

绑定微信时,教程都说要启用"ClawBot插件"(路径:微信→我→设置→插件)。但我翻遍了设置,死活找不到这个插件。当时我以为自己下载了假软件,差点去官网写投诉邮件。

后来查了一圈才知道:安卓微信目前处于灰度测试阶段,ClawBot插件是分批推送的。如果你的微信版本够新(安卓≥8.0.68)但看不到插件,只能等1-3天自动出现,或者尝试重新登录微信。

坑三:后台进程的资源抢占

QClaw运行时会启动多个后台辅助进程,分别处理文件操作、网页浏览、语音识别等。默认情况下,这些进程和主进程共享系统资源,优先级相同。某次我发现QClaw主进程只占20%CPU,但一个后台进程居然吃掉了70%,导致整个系统卡顿。

解决方案:手动资源隔离。 在系统任务管理器里,给QClaw主进程设置"高优先级",给各个后台进程设置CPU和内存占用上限。同时关闭不常用的功能(如自动更新、数据统计),后台进程总资源占用可降低60%。

坑四:网络环境的"同一WiFi"魔咒

微信绑定环节要求手机和电脑连接同一WiFi。我一开始用手机流量扫码,结果反复超时。切换到同一个WiFi后瞬间解决。这个限制对于想在外网远程操控的场景不太友好,希望后续版本能优化。

坑点描述 | 触发场景 | 解决方案 | 预防建议 |

|---|---|---|---|

任务队列堆积 | 连续发送多个不同任务 | 合并相似任务为单条复合指令;设置队列长度上限 | 避免"消息轰炸",一次说清楚需求 |

ClawBot插件缺失 | 安卓微信绑定后找不到插件入口 | 等待灰度推送(1-3天);或更新微信至最新版重新登录 | iOS用户通常无此问题 |

后台资源抢占 | 多Skill同时运行 | 任务管理器调整优先级;关闭自动更新/统计功能 | 定期清理不常用的Skills |

同一WiFi限制 | 手机流量绑定或跨网络使用 | 确保双端在同一局域网;远程场景可配合VPN | 绑定前检查网络环境 |

二维码过期 | 扫码时犹豫太久 | 点击刷新重新生成二维码 | 准备好手机再点生成 |

会话未激活 | 绑定后首次未发消息 | 绑定后立刻发送任意文字激活长连接 | 把"激活消息"当作绑定的一部分 |

性能优化五招鲜

除了填坑,我还总结了几条主动优化策略:

优化技巧 | 具体操作 | 预期效果 |

|---|---|---|

批量任务合并 | 把"查天气+看日程+生成简报"合并为一条指令 | 减少模型加载次数,总耗时降低60-70% |

资源隔离 | 主进程高优先级,后台进程限流 | 后台占用降低60%,主流程响应更流畅 |

记忆精简 | 定期清理 | 减少读取I/O,提升记忆检索速度 |

Skill懒加载 | 只安装常用Skills,非常用的用时再装 | 降低启动时的初始化负担 |

定时任务错峰 | 避免所有Cron任务整点触发 | 分散系统负载,防止瞬时卡顿 |

VI. 未来展望:这只龙虾还能长成什么样?

使用QClaw两周后,我开始思考一个问题:AI Agent的终极形态是什么?

QClaw目前的定位很清晰——"微信里的本地AI管家"。但它透露出的野心远不止于此。从腾讯的产品矩阵来看,QClaw只是"龙虾家族"的一员:还有面向企业场景的WorkBuddy(兼容企业微信、飞书、钉钉、QQ),以及腾讯云端的Lighthouse部署方案。

这意味着,今天的"微信个人助手",明天可能进化成"跨平台企业级智能体"。想象一下这样的场景:

- 你在企业微信里@龙虾,它不仅能操控你的电脑,还能调用公司数据库、操作内部OA系统、预约会议室;

- 它与腾讯文档、腾讯会议、企业微信深度打通,形成"指令-执行-协作"的闭环;

- 它从"被动等待指令"进化到"主动预测需求"——比如根据你的日历和邮件,提前生成会议材料,在会前10分钟推送到你微信。

当然,这条路还有不少挑战。安全性是头号难题:一个能操控你电脑的AI,如果被盗号或被注入恶意指令,后果不堪设想。目前QClaw的应对是"本地沙箱+敏感操作二次确认+仅信任联系人可发指令",但这对于企业级场景还不够。

多模态交互是第二个期待点。现在的QClaw主要处理文字,未来如果能直接理解微信语音、图片、甚至视频指令,使用场景会再扩大十倍。比如拍一张纸质表格的照片发给它,它自动识别并录入Excel——这种"所见即所得"的交互,才是AI Agent的终极浪漫。

结语:与一只龙虾共处两周后

回到文章开头的那个地铁场景。现在,每天早上八点,我的微信会准时收到龙虾管家的晨间播报;每周五下午,桌面会自动变干净,周报草稿会躺在桌面上等我润色;出门在外时,我再也不用担心"电脑不在身边"——因为电脑里的那只龙虾,永远在微信里等着我。

它当然还不完美。有时会卡顿,有时会误解指令,有时生成的周报需要大改。但就像养一只真实的宠物一样,重要的不是它一开始就完美,而是它在学习你,你也在学习它。 两周下来,它记住了我的作息、我的文件习惯、我的项目结构。它从一只"通用龙虾",慢慢长成了"我的龙虾"。

如果你也厌倦了在命令行里折腾Docker,如果你也想拥有一个24小时在线的数字分身,如果你也觉得"在微信里发消息就能操控电脑"这件事很酷——那么,去养一只龙虾吧。

毕竟,在这个AI时代,谁不需要一只随叫随到、会写代码、会整理文件、还会提醒你带伞的"数字宠物"呢?

🦞

附录:快速参考链接

资源 | 链接/说明 |

|---|---|

QClaw官网 | qclaw.qq.com |

Skills市场 | ClawHub(内置在QClaw客户端"灵感广场") |

微信绑定故障排查 | 确保同一WiFi、更新微信、发送激活消息 |

模型切换 | 设置入口(齿轮图标)→ 模型配置 |

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录