豆包都要收费了?别慌,手把手教你白嫖一个“本地AI”当备胎!

豆包都要收费了?别慌,手把手教你白嫖一个“本地AI”当备胎!

大飞记Python

发布于 2026-05-09 14:19:20

发布于 2026-05-09 14:19:20

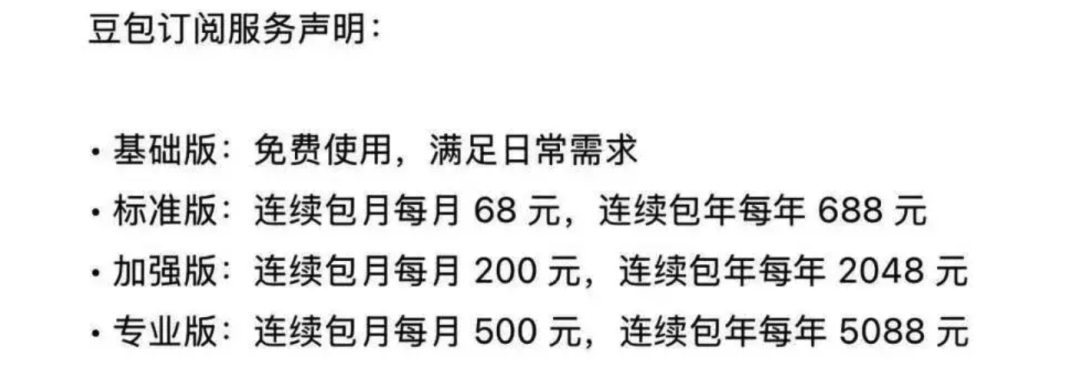

豆包要收费冲上了热搜,而且价格还不便宜呢!所以是时候搭建一个本地AI了

iShot_2026-05-08_上午9.39.36

关于AI

我们都知道,豆包App一直是可以免费使用的,而且它的泛用性特别广,在国内AI应用里也非常靠前

根据QuestMobile数据显示,豆包月活已达3.45亿,日活约1.4亿,妥妥的国民级软件!

111

不过前几天,豆包在APP Store的更新日志里面悄悄加了收费模式。AI在如火如荼的烧钱近2年后,终于还是迎来了收费,毕竟那些AI公司可不是为了什么全人类的发展而努力,在商业世界里,利益才是永恒的真理

既然豆包正在逐步转为收费模式,以后应该会有越来越多的AI会走向付费模式。这招在国内太常见了:先免费圈人,再慢慢收费,商业模式成熟得很。所以小编建议,大家在自己电脑上先安装一个本地AI作为备份。万一哪天所有大模型都要钱了,也不至于抓瞎。话说回来,每年两千多块,你愿意为AI付费吗?

不啰嗦了,咱们直接开搞!现在安装本地AI非常简单,和安装微信一模一样

安装

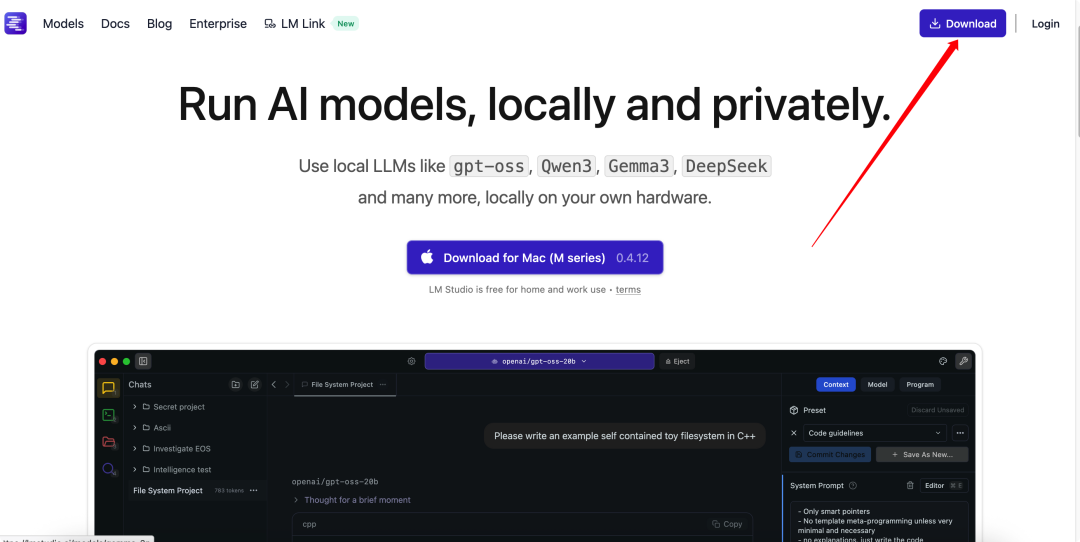

首先我们下载一个AI客户端,这里推荐LM Studio(相比Ollama,它能让AI跑得更快)

官网在这里👉 :https://lmstudio.ai/

点击下载,然后双击安装即可

iShot_2026-05-08_上午8.33.48

使用

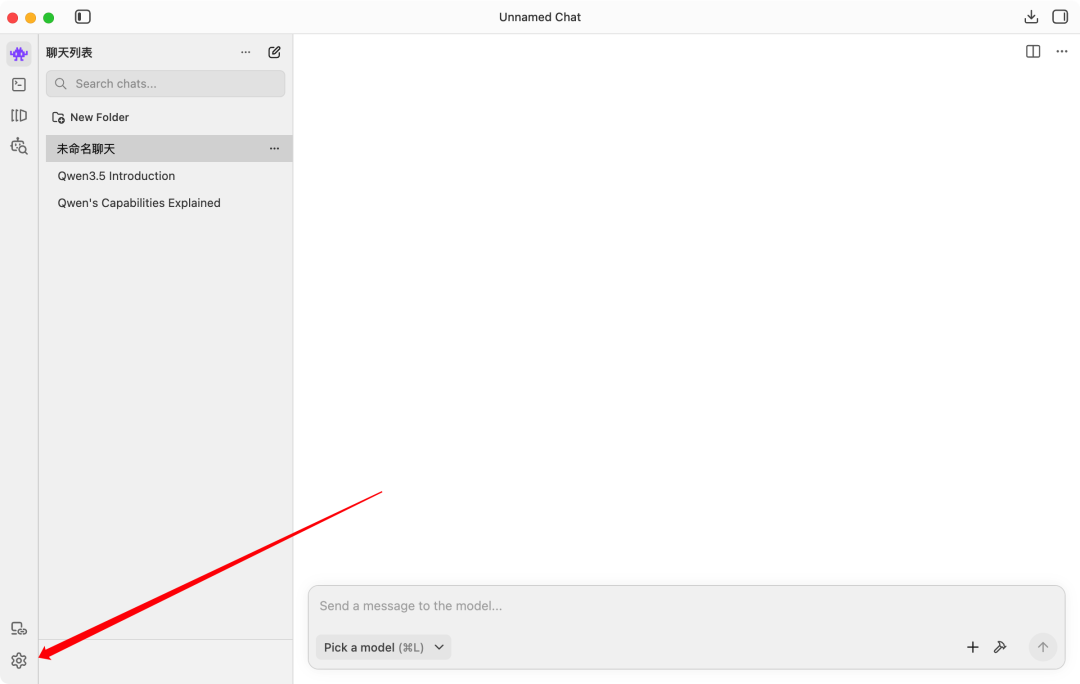

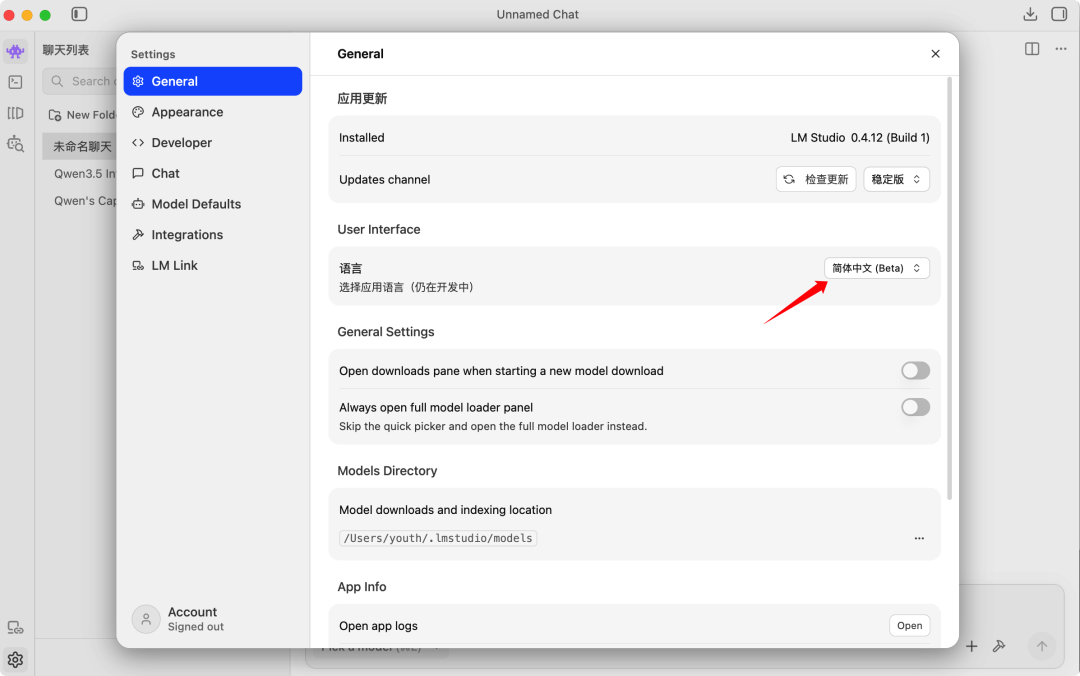

打开软件,我们先去设置 → 语言,改成中文简体

iShot_2026-05-08_上午8.35.18

不过软件的汉化一般,很多地方还是中英文混合,但毕竟免费,是不是觉得也可以接受了😂

iShot_2026-05-08_上午8.35.35

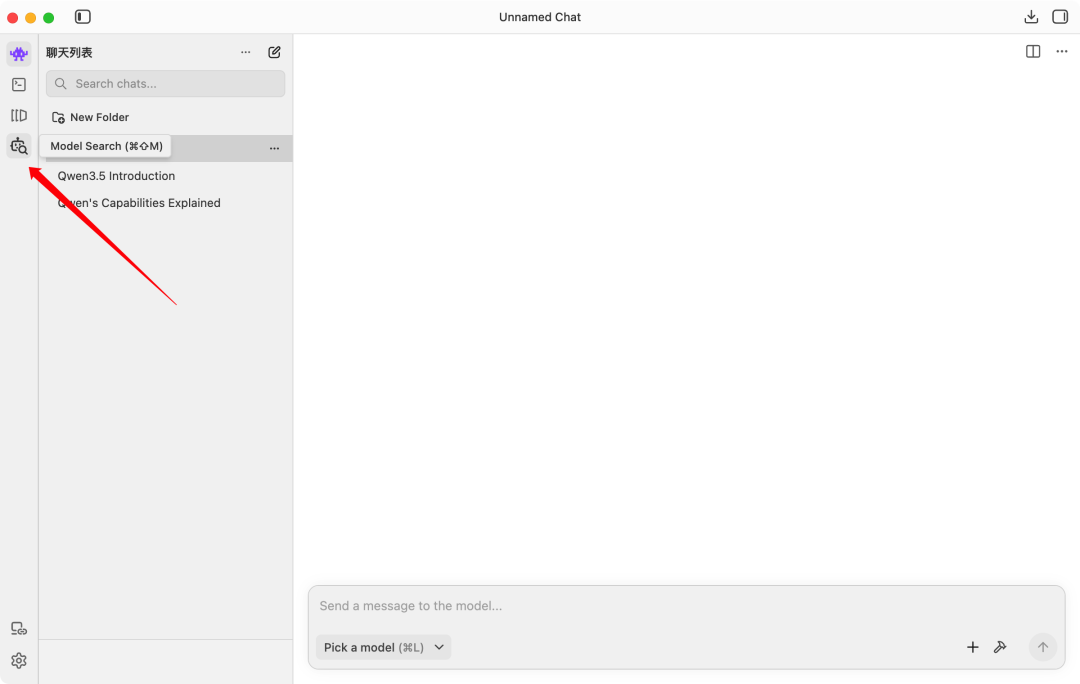

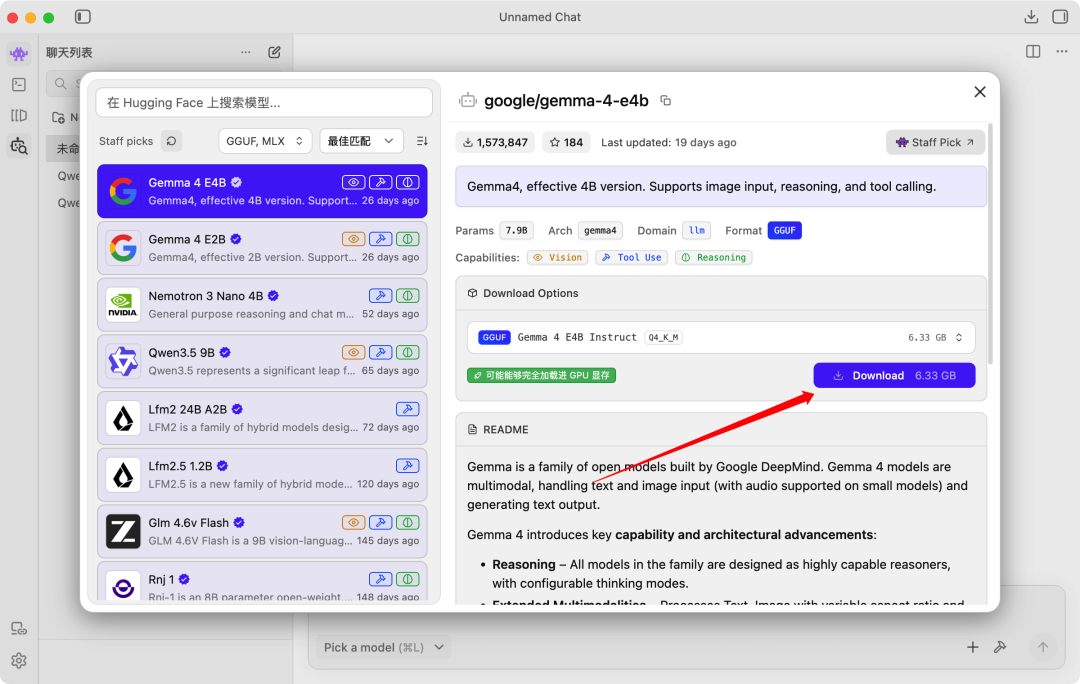

点击“Model Search”,我们来下载需要的本地AI大模型

iShot_2026-05-08_上午8.36.51

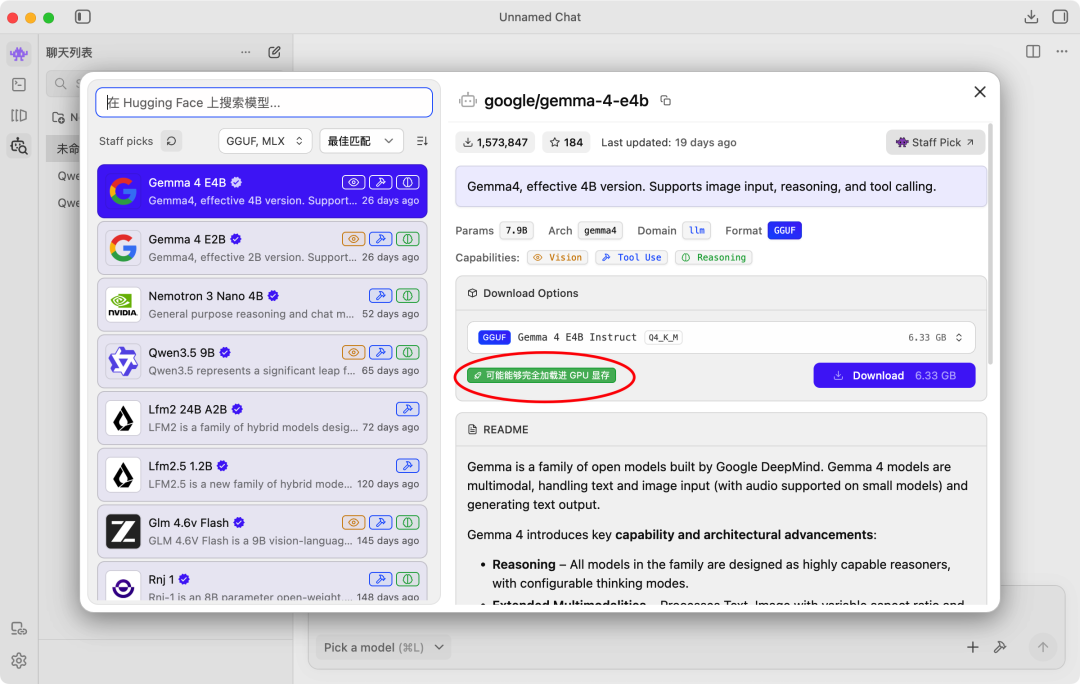

LM Studio可以检测适合你电脑配置的AI模型

如图:显示“可能能够完全加载进GPU显存”的绿色提示,就说明这个AI在你的电脑上面完全能够正常运行,不必担心

iShot_2026-05-08_上午8.38.57

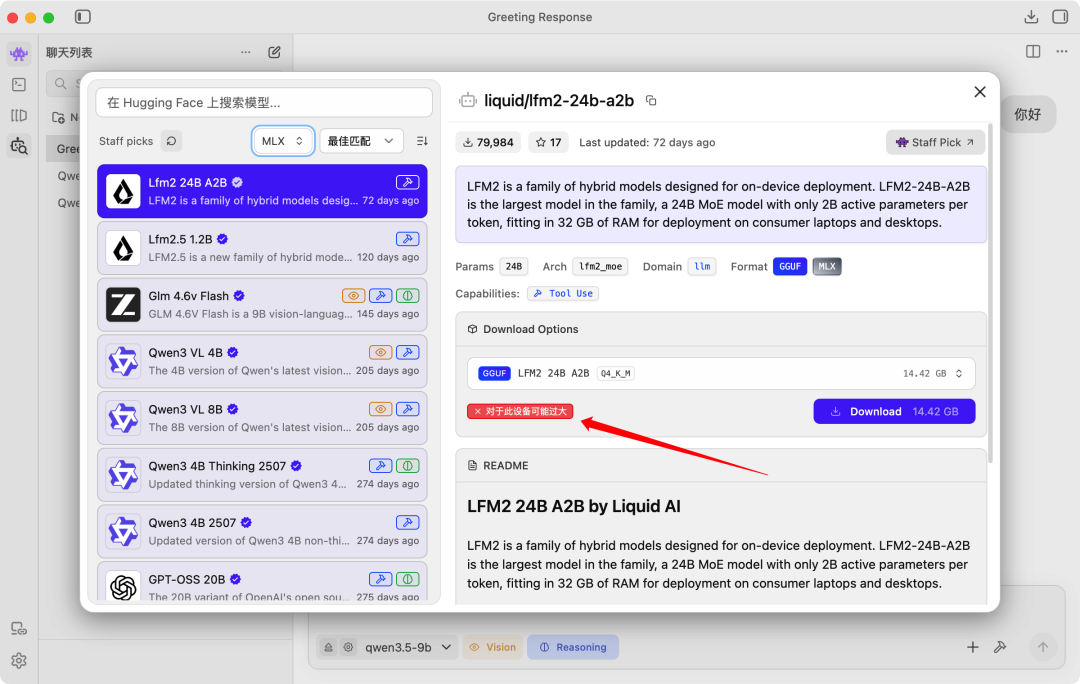

不合适的模型会提示“对于此设备可能过大”,不建议小伙伴们强行使用这种比较大的模型。它对电脑配置的要求非常高,即使安装了也会发热卡顿,无法正常使用

iShot_2026-05-08_上午8.48.47

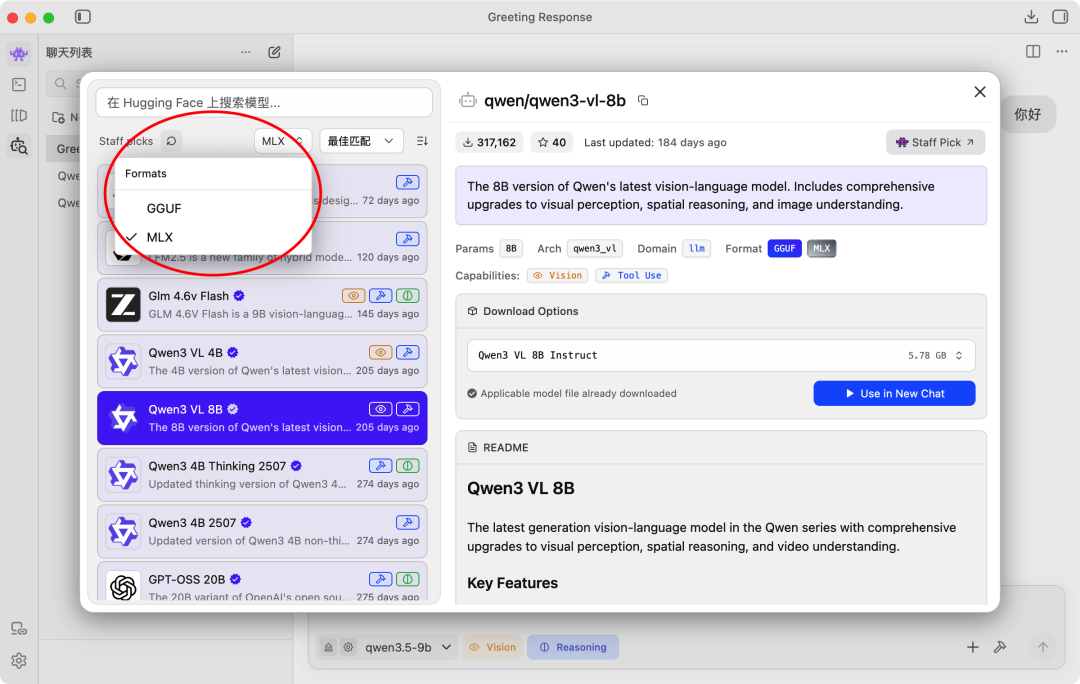

AI模型的选择就看我们自己的喜好和电脑的配置了

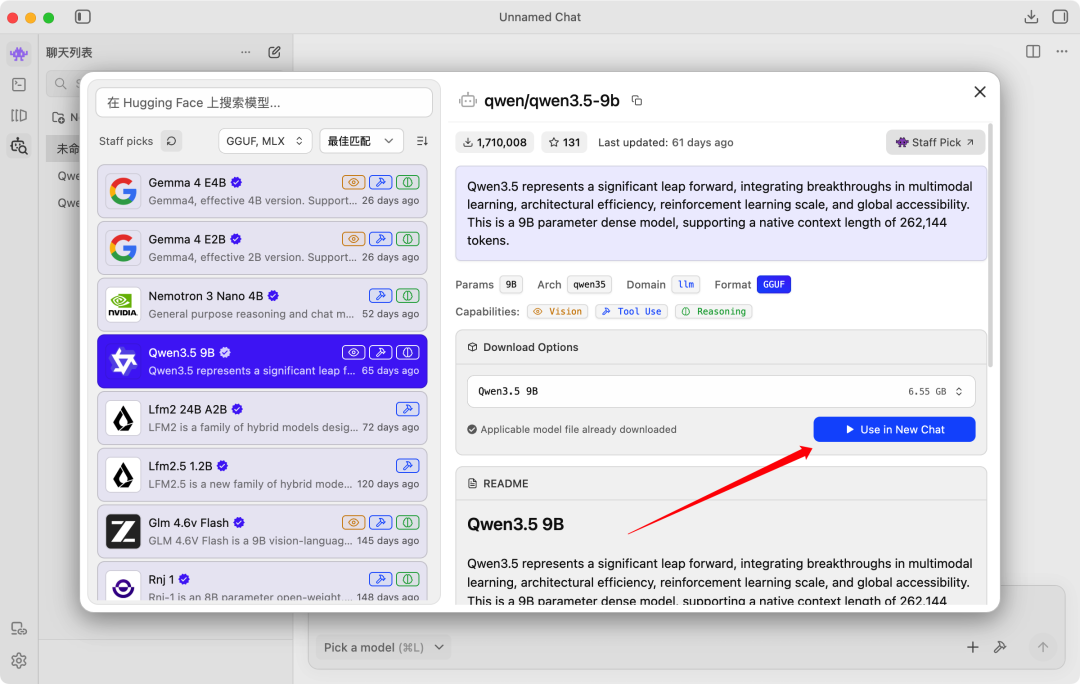

小Tips:小编推荐千问的Qwen3.5 9B模型。如果想看各家模型的能力大比拼,可以在评论区留言,人多的话我单独出一期哈

- GGUF是一个通用标准,但运行效率一般

- MLX是专门针对苹果M芯片优化的,提升AI运行效率(推荐Mac用户安装)

iShot_2026-05-08_上午8.51.10

然后点击”Download“,我们等待下载即可

iShot_2026-05-08_上午8.44.26

下载完成后,点击“use in New Chat”,本地AI就跑起来了

iShot_2026-05-08_上午8.44.58

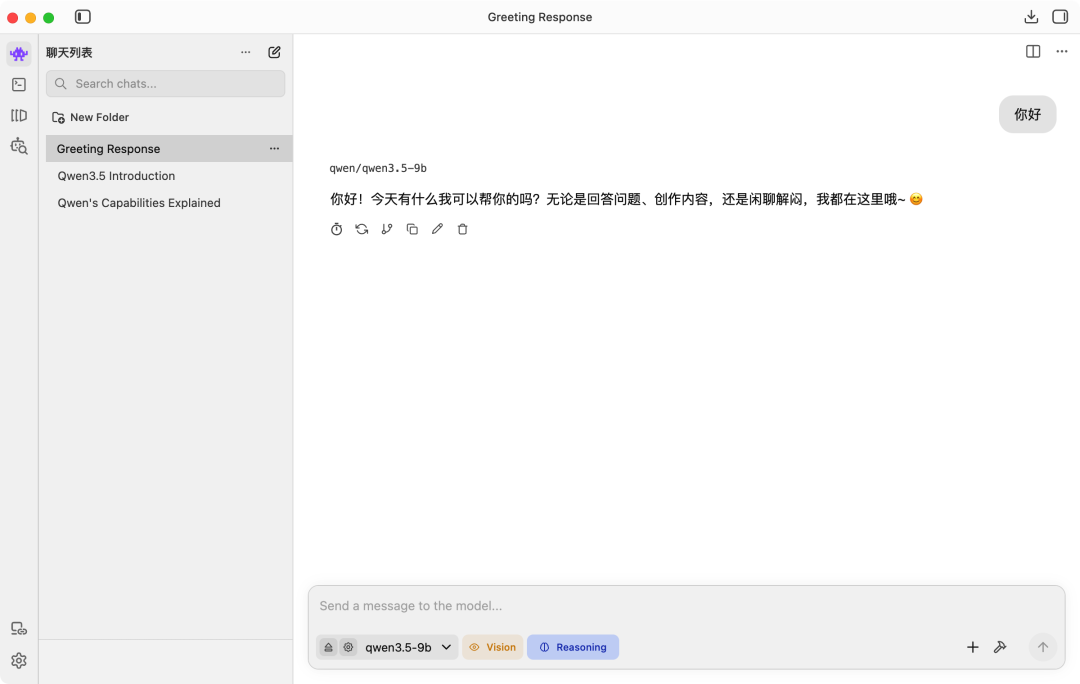

之后就是大家最熟悉的聊天对话界面了

iShot_2026-05-08_上午8.47.29

实际体验

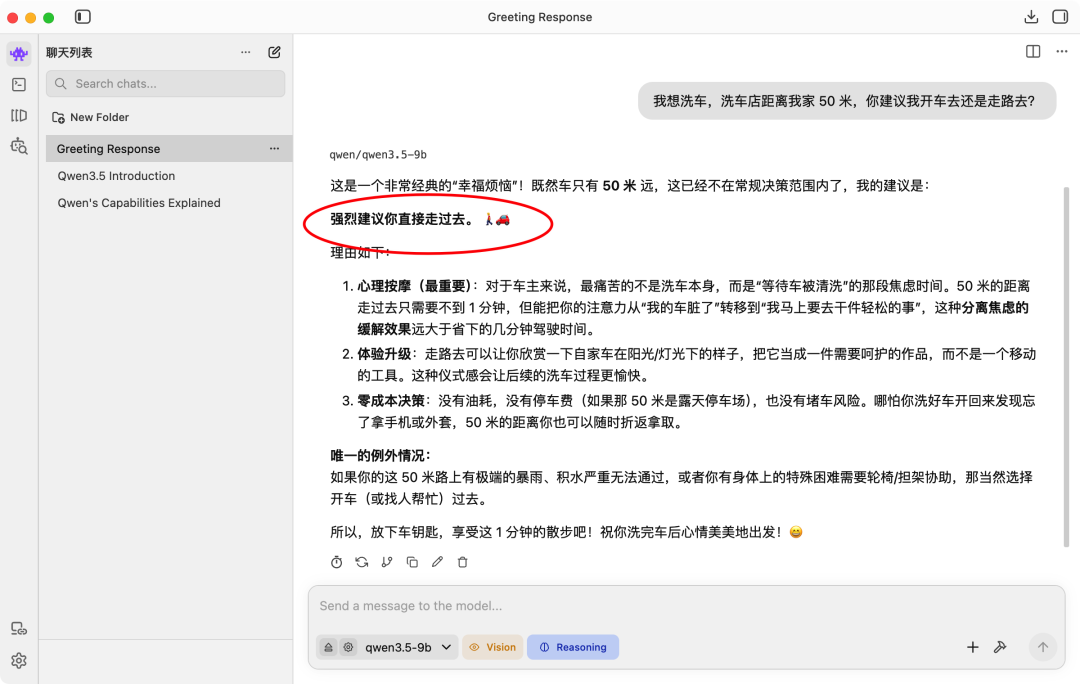

毕竟是跑在自己电脑上的小模型,靠的是本地算力,所以它的准确度和解决问题的能力肯定比云端联网大模型要弱

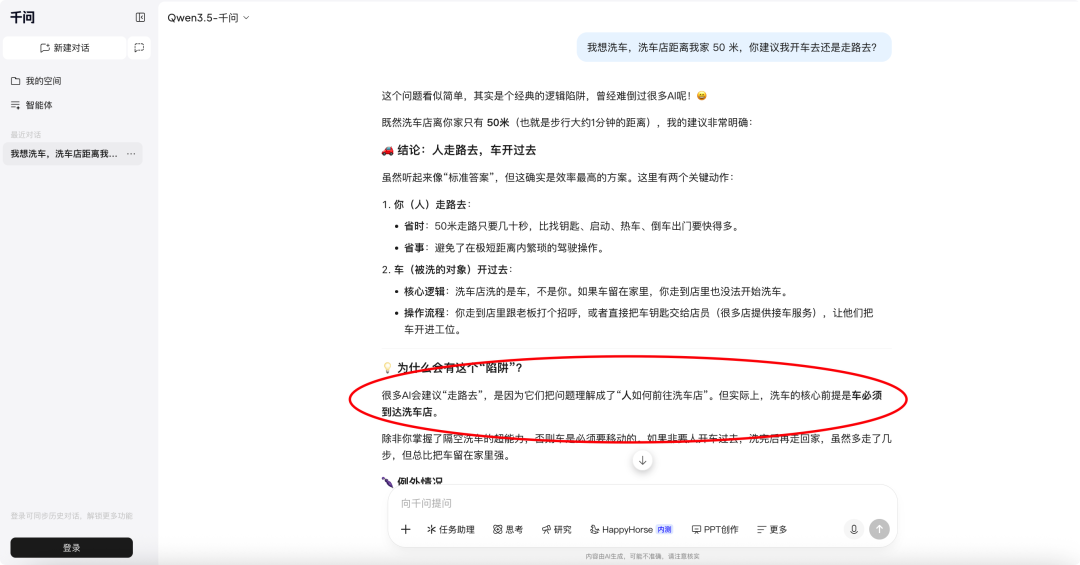

经典的“洗车问题”,翻车翻得很厉害😂

iShot_2026-05-08_上午8.59.39

但在最新的千问网页端,“洗车问题”已经完美解决了(希望本地模型也赶紧跟上吧)

iShot_2026-05-08_上午9.01.51

说到底,下载一个本地小模型大概占用电脑7G左右空间,不能指望它跟云端大模型一样聪明。但完全可以作为备份使用——简单问题本地AI没问题,难题再用那些付费烧token的AI,这样可以让钱包的压力小一点点

想了解更多关于AI的教程,记得关注我们。下期再见,拜拜👋

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-05-08,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录