大模型应用:PCA主成分分析+大模型:解锁高维数据的语义化解读能力.104

原创大模型应用:PCA主成分分析+大模型:解锁高维数据的语义化解读能力.104

原创

未闻花名

修改于 2026-05-12 14:56:45

修改于 2026-05-12 14:56:45

一、前言

在大数据时代,我们每天都会面对海量的高维数据,用户行为数据可能包含上百个特征维度、工业传感器数据动辄数千个监测指标、医疗影像数据更是以像素为单位构成超高维空间。这些数据蕴藏着巨大价值,但直接分析既耗时又难以理解,更无法让擅长文本理解的大模型直接读懂。

PCA主成分分析作为经典的降维算法,能从高维数据中提取核心特征、保留关键信息;而大模型则具备强大的自然语言理解与生成能力。将二者结合,既能用 PCA 解决高维数据的维度灾难问题,又能借助大模型将抽象的降维结果转化为人类可理解的自然语言解释,真正实现让大模型看懂高维数据。今天我们结合实际由浅入深拆解 PCA + 大模型的完整体系,对这一组合方案一探究竟形成系统深入的理解。

二、基础理解

1. 线性代数基础

PCA 的底层是线性代数,我们用最通俗的语言解释核心知识点:

- 向量:可以理解为一组有序的数值,比如用户 A 的特征是 [25, 5000, 15, 90, 8],这就是一个5维向量;

- 矩阵:多个样本的特征向量组合成矩阵,比如1000个用户的5个特征,构成1000×5 的矩阵,其中行 = 样本、列 = 特征;

- 特征值与特征向量:PCA的核心计算对象;

- 特征值对应主成分的方差,特征值越大,方差越大,信息越多;

- 特征向量对应主成分的系数,决定原始特征如何组合成主成分;

- 矩阵转置:将矩阵的行和列互换,比如5×1000的矩阵转置后是1000×5;

- 归一化\标准化:PCA对量纲敏感,比如“年龄”是0-100,“月消费”是0-10000,必须先将数据标准化,使每个特征的均值为 0、方差为1,否则方差大的特征会主导主成分。

2. 直观理解PCA

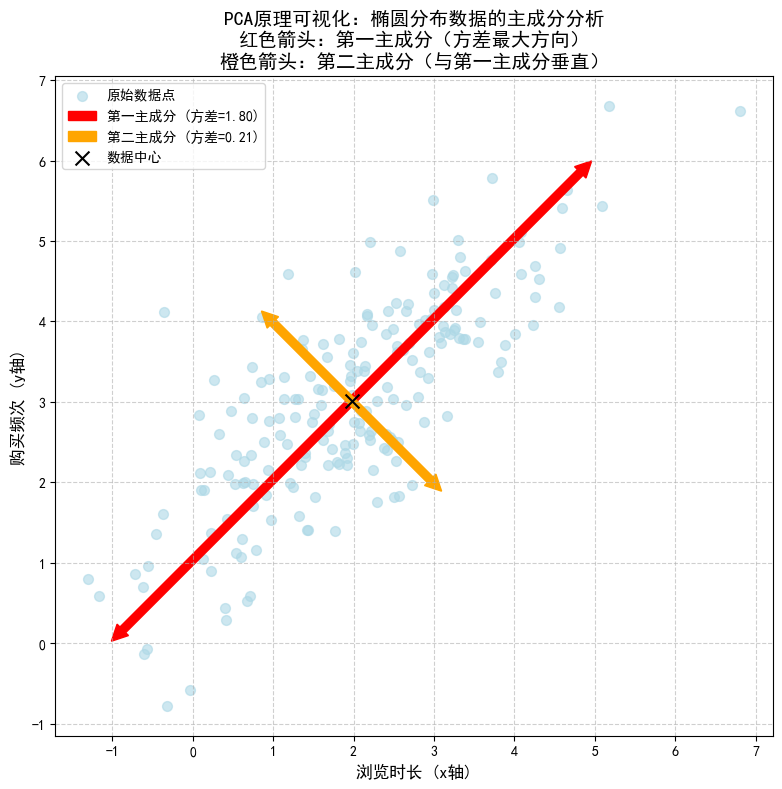

我们用“二维数据降维到一维”的例子,一眼看懂PCA的核心逻辑:

假设我们有一组用户数据,包含“浏览时长(x 轴)”和“购买频次(y 轴)”两个特征,数据分布呈斜向椭圆,说明两个特征正相关。

PCA的目标是:找一条最优直线,将所有数据点投影到这条直线上,即降维到一维,同时满足“投影后的数据方差最大”,因为方差越大,数据的区分度越高,保留的信息越多。

这条"最优直线"就是第一主成分,它的方向由特征向量决定,投影后的方差由特征值决定。如果数据是三维的,PCA 会先找第一主成分(方差最大),再找与第一主成分垂直的第二主成分(方差次大),以此类推。

简单来说:PCA 就是在高维空间中找一组"最优坐标轴",让数据在这些坐标轴上的分布尽可能分散,从而用更少的坐标轴(主成分)保留最多的信息。

3. 大模型应用基础

- 大模型的输入形式:支持文本、结构化数据、图片等,在本方案中,我们主要将 PCA 的结果(如主成分系数、贡献率、降维后数据)转化为JSON的文本格式输入大模型;

- 大模型的输出控制:通过提示词指定输出格式,比如“分点说明每个主成分的业务含义”、“生成用户画像核心特征总结”;

4. 数据预处理

PCA对数据质量要求高,预处理是关键步骤:

- 缺失值处理:PCA无法处理缺失值,需用“均值填充、中位数填充、模型预测填充 等方式补全;

- 异常值处理:异常值会拉高方差,导致主成分偏差,需用 “3σ 原则、IQR 四分位数法” 识别并处理;

- 标准化\归一化:将数据标准化,使每个特征的均值为 0、方差为1;

- 特征筛选:先剔除完全冗余的特征,比如“用户 ID”、“重复计算的指标”,减少 PCA 的计算量。

三、核心概念

1. PCA的核心概念

我们用 “用户画像” 这个贴近生活的例子拆解 PCA 的关键概念:

- 特征:描述样本的基本属性,比如用户画像中的“年龄、月消费、登录次数、浏览时长、购买频次”等,每个特征就是一个维度;

- 样本:具体的研究对象,比如“用户 A、用户 B、用户 C”;

- 方差:衡量数据的离散程度,方差越大,说明这个维度的信息越丰富。

- 比如“月消费”的方差远大于“性别”(仅 0/1),说明“月消费”能区分更多用户;

- 协方差:衡量两个特征的线性相关程度。

- 协方差为正,说明两个特征正相关,比如“浏览时长”越长,“购买频次”越高;

- 协方差为负则负相关;协方差为0则无线性相关;

- 主成分:PCA 的核心输出,是原始特征的线性组合,比如“第一主成分 = 0.8× 月消费 + 0.5× 购买频次 - 0.2× 登录次数”。

- 主成分满足两个条件:

- 1. 各主成分之间相互独立,协方差为 0;

- 2. 第一主成分方差最大,包含最多信息,第二主成分方差次之,依此类推;

- 贡献率:每个主成分的方差占总方差的比例,反映该主成分保留的信息多少。

- 比如第一主成分贡献率 70%,说明它包含了原始数据 70% 的信息;

- 累计贡献率:前 n 个主成分的贡献率之和,是选择主成分数量的核心依据,通常选累计贡献率≥80% 的主成分。

2. 大模型能力体现

在 PCA+大模型的组合中,我们关注大模型的这些核心能力:

- 自然语言生成:将抽象的数值、矩阵、图表信息转化为流畅的自然语言描述;

- 上下文理解:理解PCA输出的“主成分系数、贡献率、降维后数据分布”等结构化信息;

- 语义映射:将“主成分 1 的系数中月消费权重最高”映射为“主成分1代表用户消费能力”;

- 提示工程:通过精准的提示词,引导大模型聚焦PCA结果的解读,避免答非所问。

3. 组合方案的核心目标

- 降维不失真:用最少的主成分保留原始数据的核心信息;

- 特征语义化:让抽象的主成分具备可解释的业务含义;

- 解读自动化:替代人工分析高维数据的过程,提升效率;

- 结果通俗化:即使是非技术人员,也能理解高维数据的核心规律。

四、互补价值

1. 高维数据的天生缺陷

高维数据是指特征维度(列数)远大于样本数量(行数),或维度本身超过人类直观理解能力的数据,比如100 维以上。它存在三个核心问题:

- 维度灾难:随着维度增加,数据点之间的距离会趋于平均,传统的聚类、分类算法会失效;计算复杂度呈指数级增长,普通硬件难以支撑;

- 信息冗余:高维特征中往往存在大量重复或线性相关的信息,比如“用户消费金额”和“用户月度支付总额”高度相关;

- 可解释性差:人类无法直观理解100维特征的含义,更无法直接将其输入大模型进行解读,大模型更擅长的是文本,而非原始数值矩阵。

2. 单一方案的局限性

- 仅用 PCA:PCA 能降维、提特征,但输出的是抽象的“主成分”,如“第一主成分”、“第二主成分”,这些主成分是原始特征的线性组合,缺乏语义解释,我们能知道“第一主成分解释了80%的数据方差”,但无法说清这个主成分代表用户的什么特征;

- 仅用大模型:大模型无法直接处理高维数值数据,即使将数据转化为文本,比如“特征 1:0.5,特征 2:0.8...”,也会因文本过长、信息杂乱导致理解偏差,甚至触发大模型的上下文窗口限制。

3. PCA+大模型的互补价值

- PCA负责“数据瘦身 + 核心特征提取”,把高维数据转化为低维、高价值的主成分矩阵;

- 大模型负责“语义翻译 + 自然语言解释”,把抽象的主成分和降维结果转化为人类能理解的结论,比如“第一主成分主要反映用户的消费能力,第二主成分反映用户的活跃度”。

这个组合的核心价值在于:

- 让大模型突破"文本局限",具备解读结构化高维数据的能力;

- 让PCA突破"解释局限",赋予降维结果语义含义。

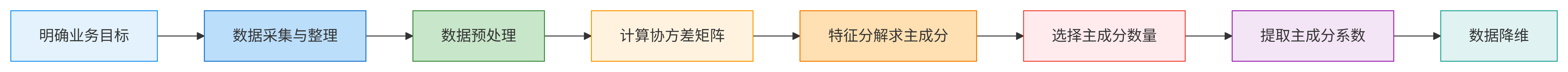

五、PCA执行流程

1. 执行流程

我们以“用户画像数据”为例,通过从数据到主成分,梳理PCA的完整执行流程:

步骤 1:明确业务目标

先确定 PCA 的应用场景,比如“从10个用户行为特征中提取核心特征,用于用户画像分析”。

步骤 2:数据采集与整理

收集原始数据,比如 1000个用户的10个特征:

用户 ID | 年龄 | 月消费 | 登录次数 | 浏览时长(分钟 / 天) | 购买频次(次 / 月) | 收藏商品数 | 分享次数 | 差评次数 | 复购率 | 优惠券使用次数 |

|---|---|---|---|---|---|---|---|---|---|---|

1 | 28 | 6500 | 22 | 85 | 12 | 35 | 18 | 0 | 0.85 | 9 |

2 | 35 | 12000 | 18 | 60 | 18 | 42 | 12 | 1 | 0.92 | 15 |

整理成结构化数据集(CSV/Excel/ 数据库表),确保样本和特征对应无误。

步骤 3:数据预处理

- 剔除无关特征:删除“用户 ID”,包括其他无业务意义,仅标识的特征列;

- 处理缺失值:如果“复购率”有 10 个缺失值,用该特征的均值0.78填充;

- 处理异常值:用3σ原则识别“月消费”中的异常值,比如某用户月消费100000,远超均值 + 3σ,用95分位数替换;

- 3σ原则识别:简单理解就是“画个圈,圈外都是异常值。”,此处算出正常范围,发现10万远超范围。

- 95分位数替换:把所有用户的消费从低到高排个队,排在95%位置的那个数。95分位数是基于实际排名的,它更稳健。它代表了真实世界中正常高消费用户的天花板。

- 标准化:对所有特征执行标准化,消除量纲影响。

步骤 4:计算协方差矩阵

- 对预处理后的数据集计算协方差矩阵(10×10),矩阵中的每个元素反映两个特征的相关程度。

- 比如“月消费”和“购买频次”的协方差为0.85,高度正相关,“差评次数”和“复购率”的协方差为-0.72,高度负相关。

步骤 5:特征分解求主成分

对协方差矩阵进行特征分解,得到 10 个特征值和对应的特征向量:

主成分序号 | 特征值 | 贡献率 | 累计贡献率 |

|---|---|---|---|

1 | 4.2 | 42% | 42% |

2 | 2.5 | 25% | 67% |

3 | 1.3 | 13% | 80% |

4 | 0.8 | 8% | 88% |

... | ... | ... | ... |

10 | 0.1 | 1% | 100% |

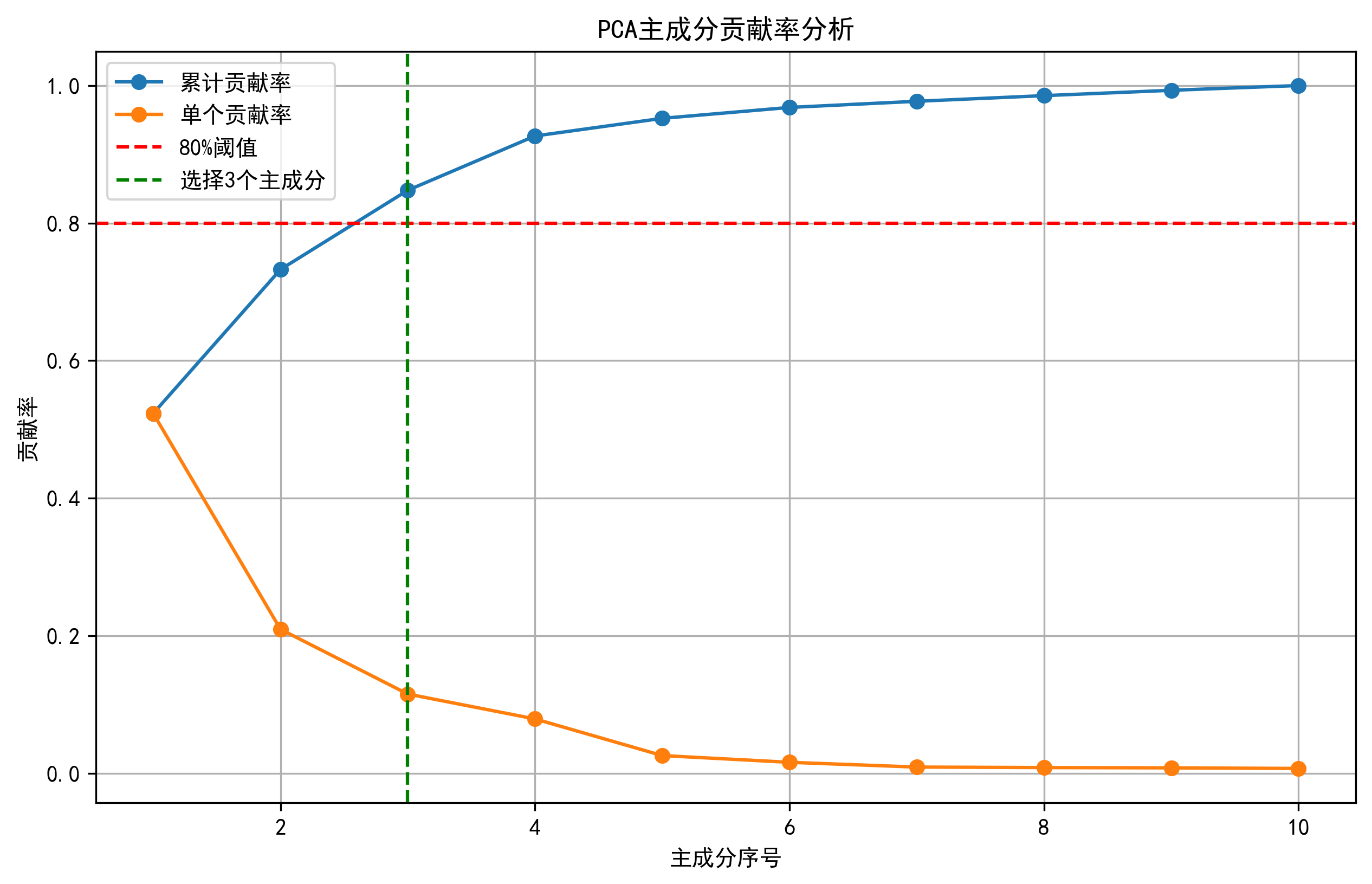

步骤 6:选择主成分数量

根据累计贡献率,选择前3个累计贡献率80%的主成分,这 3 个主成分能保留原始数据 80% 的信息。

步骤 7:提取主成分系数

查看前 3 个主成分的特征向量(系数),了解原始特征对主成分的贡献:

原始特征 | 主成分 1 系数 | 主成分 2 系数 | 主成分 3 系数 |

|---|---|---|---|

年龄 | 0.12 | 0.78 | 0.05 |

月消费 | 0.85 | 0.15 | 0.08 |

登录次数 | 0.21 | 0.32 | 0.65 |

浏览时长 | 0.78 | 0.22 | 0.12 |

购买频次 | 0.82 | 0.18 | 0.10 |

收藏商品数 | 0.65 | 0.25 | 0.15 |

分享次数 | 0.58 | 0.30 | 0.20 |

差评次数 | -0.42 | -0.18 | 0.35 |

复购率 | 0.75 | 0.22 | 0.18 |

优惠券使用次数 | 0.68 | 0.28 | 0.25 |

系数的绝对值越大,说明该原始特征对主成分的贡献越大;正系数表示正相关,负系数表示负相关。

步骤 8:数据降维

将预处理后的1000×10数据集投影到前3个主成分上,得到1000×3的降维数据集,这就是原始高维数据的核心特征。

2. 注意事项

- 样本量要求:PCA 适合大样本数据,通常样本数≥5× 特征数,小样本易导致过拟合;

- 特征相关性:如果原始特征之间几乎无相关,体现为协方差矩阵接近对角矩阵,PCA的降维效果差;

- 结果验证:降维后需验证数据的核心规律是否保留,比如聚类结果是否与原始数据一致;

- 可解释性平衡:主成分数量越少,降维效果越好,但可解释性可能越差,需在信息保留和可解释性之间平衡。

3. 示例:用户画像数据降维

以下是基于Python的PCA实现代码,包含数据预处理、PCA 降维、结果可视化全流程:

# 导入必备库

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.preprocessing import StandardScaler

from sklearn.decomposition import PCA

from sklearn.datasets import make_blobs

# 设置中文字体(避免可视化时中文乱码)

plt.rcParams['font.sans-serif'] = ['SimHei']

plt.rcParams['axes.unicode_minus'] = False

# ---------------------- 步骤1:生成模拟用户画像数据 ----------------------

# 生成1000个样本,10个特征,模拟用户画像数据

# 特征对应:年龄、月消费、登录次数、浏览时长、购买频次、收藏商品数、分享次数、差评次数、复购率、优惠券使用次数

np.random.seed(42) # 固定随机种子,保证结果可复现

X, _ = make_blobs(n_samples=1000, n_features=10, centers=5, random_state=42)

# 构造特征名称和DataFrame

feature_names = [

'年龄', '月消费', '登录次数', '浏览时长',

'购买频次', '收藏商品数', '分享次数',

'差评次数', '复购率', '优惠券使用次数'

]

df = pd.DataFrame(X, columns=feature_names)

# 添加少量缺失值和异常值(模拟真实数据)

# 随机添加5%的缺失值

for col in feature_names:

df.loc[df.sample(frac=0.05).index, col] = np.nan

# 添加异常值(月消费列)

df.loc[df.sample(frac=0.02).index, '月消费'] = df['月消费'] * 10

print("原始数据形状:", df.shape)

print("原始数据前5行:")

print(df.head())

# ---------------------- 步骤2:数据预处理 ----------------------

# 1. 处理缺失值:用均值填充

df = df.fillna(df.mean())

# 2. 处理异常值:3σ原则

def remove_outliers(df, col):

mean = df[col].mean()

std = df[col].std()

# 保留均值±3σ范围内的数据

df_clean = df[(df[col] >= mean - 3*std) & (df[col] <= mean + 3*std)].copy()

return df_clean

# 对月消费列处理异常值

df = remove_outliers(df, '月消费')

print(f"异常值处理后数据形状:{df.shape}(移除了{1000 - len(df)}个异常样本)")

# 3. 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(df)

print("\n标准化后数据形状:", X_scaled.shape)

print("标准化后数据前5行:")

print(pd.DataFrame(X_scaled, columns=feature_names).head())

# ---------------------- 步骤3:PCA降维 ----------------------

# 初始化PCA模型,先不指定主成分数量,查看所有主成分的贡献率

pca = PCA()

X_pca = pca.fit_transform(X_scaled)

# 计算贡献率和累计贡献率

explained_variance_ratio = pca.explained_variance_ratio_

cumulative_variance_ratio = np.cumsum(explained_variance_ratio)

# 打印贡献率信息

print("\n各主成分贡献率:")

for i, ratio in enumerate(explained_variance_ratio):

print(f"主成分{i+1}:{ratio:.2%}")

print("\n各主成分累计贡献率:")

for i, ratio in enumerate(cumulative_variance_ratio):

print(f"前{i+1}个主成分:{ratio:.2%}")

# 选择累计贡献率≥80%的主成分数量

k = np.argmax(cumulative_variance_ratio >= 0.8) + 1

print(f"\n选择前{k}个主成分,累计贡献率:{cumulative_variance_ratio[k-1]:.2%}")

# 重新训练PCA模型,指定主成分数量

pca_final = PCA(n_components=k)

X_pca_final = pca_final.fit_transform(X_scaled)

# 提取主成分系数(特征向量)

pca_components = pd.DataFrame(

pca_final.components_.T, # 转置后,行=原始特征,列=主成分

columns=[f'主成分{i+1}' for i in range(k)],

index=feature_names

)

print("\n主成分系数矩阵:")

print(pca_components)

# ---------------------- 步骤4:PCA结果可视化 ----------------------

# 可视化1:贡献率折线图

plt.figure(figsize=(10, 6))

plt.plot(range(1, len(explained_variance_ratio)+1), cumulative_variance_ratio, 'o-', label='累计贡献率')

plt.plot(range(1, len(explained_variance_ratio)+1), explained_variance_ratio, 'o-', label='单个贡献率')

plt.axhline(y=0.8, color='r', linestyle='--', label='80%阈值')

plt.axvline(x=k, color='g', linestyle='--', label=f'选择{k}个主成分')

plt.xlabel('主成分序号')

plt.ylabel('贡献率')

plt.title('PCA主成分贡献率分析')

plt.legend()

plt.grid(True)

plt.savefig('104.PCA主成分贡献率分析 pca_variance_ratio.png', dpi=300, bbox_inches='tight')

plt.show()

# 可视化2:前两个主成分的散点图(降维后数据分布)

plt.figure(figsize=(10, 6))

plt.scatter(X_pca_final[:, 0], X_pca_final[:, 1], alpha=0.6, cmap='viridis', c=np.arange(len(X_pca_final)))

plt.xlabel(f'第一主成分(贡献率:{explained_variance_ratio[0]:.2%})')

plt.ylabel(f'第二主成分(贡献率:{explained_variance_ratio[1]:.2%})')

plt.title('用户画像数据PCA降维后分布(前两个主成分)')

plt.colorbar(label='用户序号')

plt.grid(True)

plt.savefig('104.用户画像数据PCA降维后分布 pca_scatter.png', dpi=300, bbox_inches='tight')

plt.show()

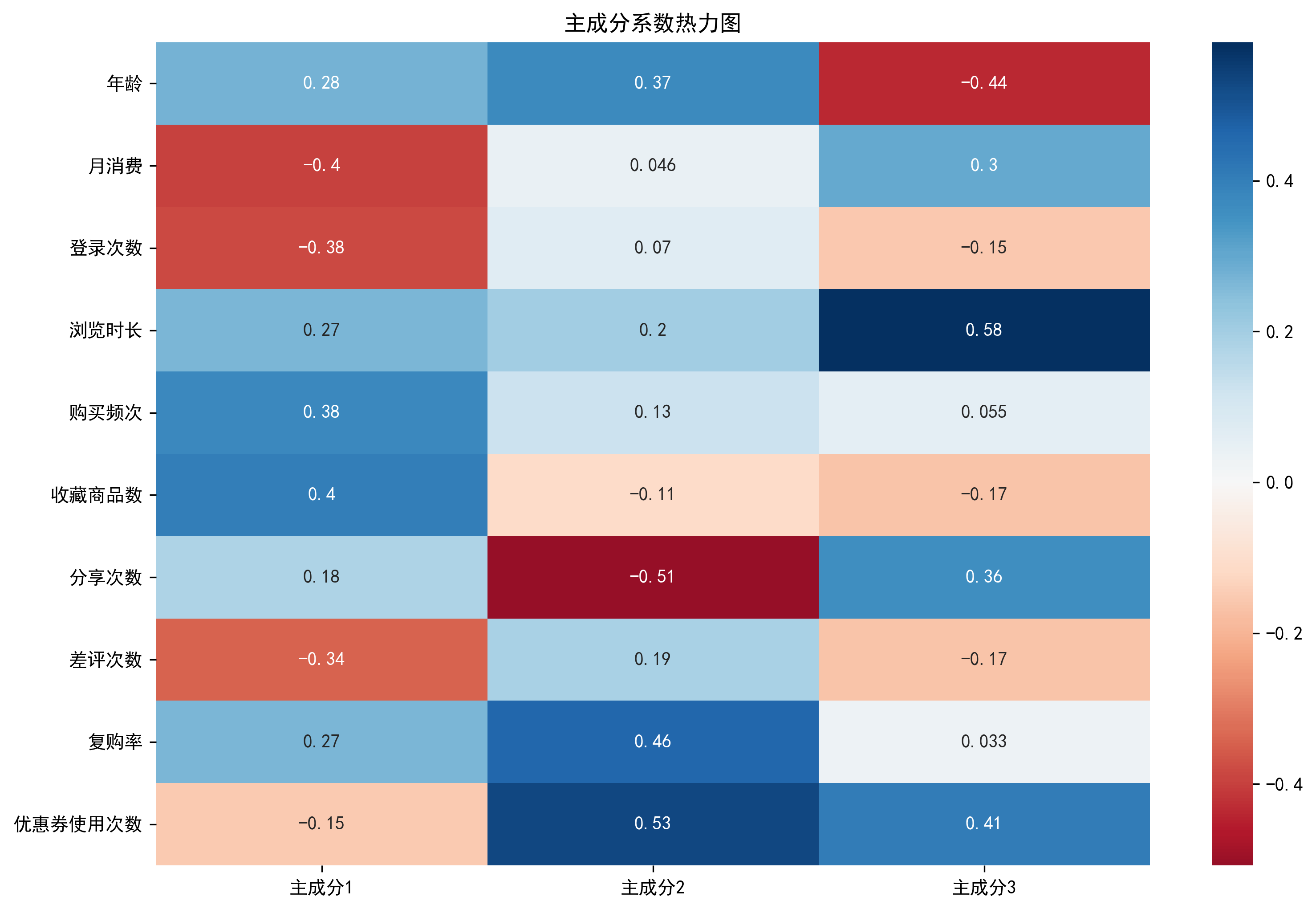

# 可视化3:主成分系数热力图

plt.figure(figsize=(12, 8))

import seaborn as sns

sns.heatmap(pca_components, annot=True, cmap='RdBu', center=0)

plt.title('主成分系数热力图')

plt.savefig('104.主成分系数热力图 pca_components_heatmap.png', dpi=300, bbox_inches='tight')

plt.show()

# ---------------------- 步骤5:保存降维后的数据 ----------------------

df_pca = pd.DataFrame(

X_pca_final,

columns=[f'主成分{i+1}' for i in range(k)]

)

# 添加用户ID列,便于追踪

df_pca.insert(0, '用户ID', range(1, len(df_pca) + 1))

# 保存到CSV

df_pca.to_csv('用户画像PCA降维结果.csv', index=False, encoding='utf-8-sig')

print("\n降维后数据已保存为:用户画像PCA降维结果.csv")

print(f"降维后数据包含:{len(df_pca)} 个样本,{k} 个主成分")

print("\n降维后数据前5行:")

print(df_pca.head())输出结果:

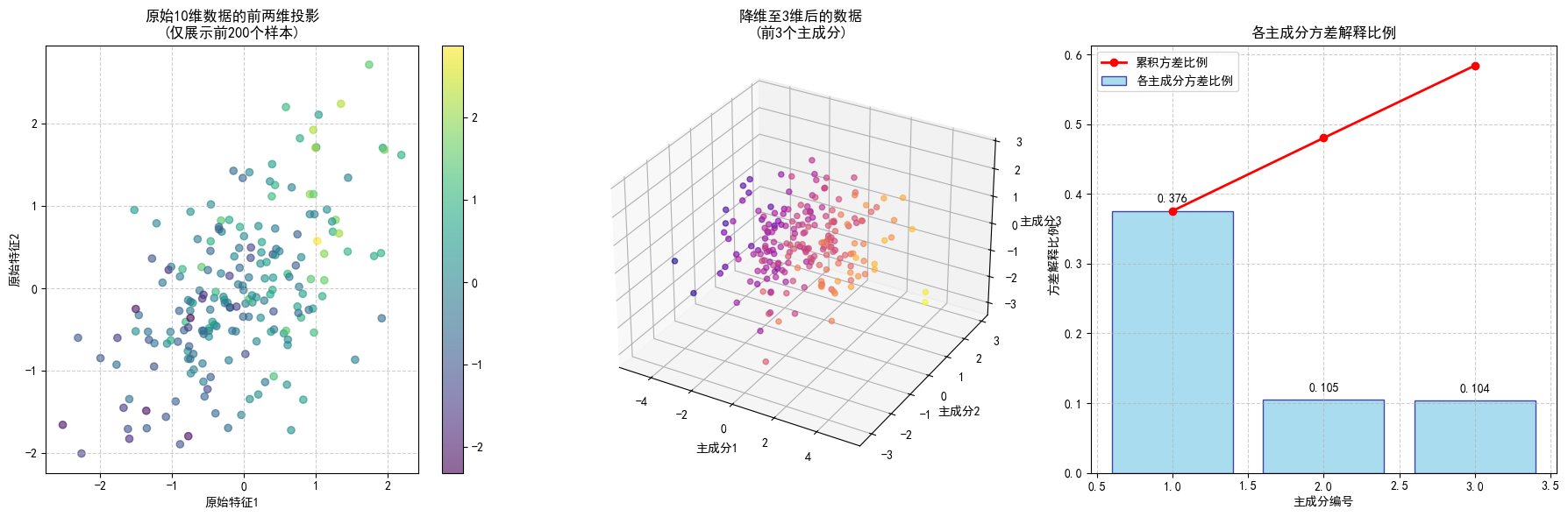

各主成分贡献率: 主成分1:52.32% 主成分2:20.93% 主成分3:11.51% 主成分4:7.89% 主成分5:2.57% 主成分6:1.59% 主成分7:0.89% 主成分8:0.82% 主成分9:0.78% 主成分10:0.69%

各主成分累计贡献率: 前1个主成分:52.32% 前2个主成分:73.25% 前3个主成分:84.77% 前4个主成分:92.66% 前5个主成分:95.23% 前6个主成分:96.82% 前7个主成分:97.71% 前8个主成分:98.53% 前9个主成分:99.31% 前10个主成分:100.00% 选择前3个主成分,累计贡献率:84.77%

降维后数据已保存为:用户画像PCA降维结果.csv 降维后数据包含:986 个样本,3 个主成分

六. 大模型解读PCA结果

1. 大模型解读PCA的逻辑

PCA 输出的是“数字矩阵、贡献率、系数”等抽象信息,大模型的核心作用是:

- 1. 信息结构化:将PCA的零散结果(系数、贡献率、可视化图表)整合为结构化的输入,如JSON格式;

- 2. 语义映射:将“主成分1的月消费系数0.85”映射为“主成分1主要反映用户的消费能力”;

- 3. 业务解读:结合具体场景,如用户画像,生成符合业务逻辑的解释;

- 4. 结论生成:将解读结果转化为通俗的自然语言,比如报告、总结、建议。

这个过程的本质是:让大模型成为数据分析师,基于PCA的量化结果,输出定性的业务解读。

2. 大模型的提示词设计

要让大模型准确解读PCA结果,输入必须包含以下要素:

- 业务场景:明确PCA的应用场景,如“用户画像分析”、“电商用户行为数据”;

- 原始特征说明:每个原始特征的业务含义,如“月消费:用户每月在平台的消费金额”;

- PCA核心结果:

- 主成分数量及累计贡献率;

- 主成分系数矩阵,原始特征对每个主成分的贡献;

- 贡献率分布,每个主成分的信息占比;

- 解读要求:指定输出格式、重点、语言风格,如“分点说明每个主成分的业务含义,语言通俗,适合非技术人员阅读”。

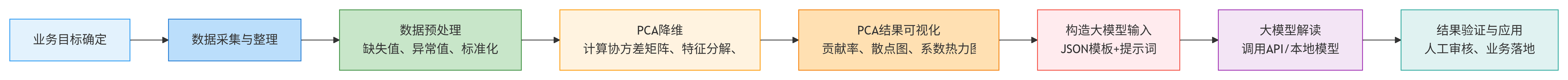

3. 执行流程

步骤 1:业务目标确定

- 核心:明确“为什么做 PCA + 大模型”,比如“提取用户画像核心特征,用于精准营销”、“解读工业传感器数据,识别设备异常”。

- 关键输出:业务目标文档、特征清单。

步骤 2:数据采集与整理

- 核心:收集符合业务目标的高维数据,整理为结构化格式,如CSV、Excel、 数据库表。

- 关键输出:原始数据集、数据字典等特征说明。

步骤 3:数据预处理

- 核心:处理缺失值、异常值,标准化数据,确保 PCA 输入质量。

- 关键输出:预处理后的标准化数据集。

步骤 4:PCA降维

- 核心:计算协方差矩阵、特征分解、选择主成分数量,生成降维后的数据。

- 关键输出:主成分系数矩阵、贡献率分布、降维后数据集。

步骤 5:PCA 结果可视化

- 核心:通过图表直观展示 PCA 结果,辅助大模型解读。

- 关键输出:贡献率折线图、降维后散点图、主成分系数热力图。

步骤 6:构造大模型输入

- 核心:将 PCA 结果和业务场景整合为结构化输入,设计精准的提示词。

- 关键输出:标准化 JSON 输入、优化后的提示词。

步骤 7:大模型解读

- 核心:调用大模型 API或本地模型,获取 PCA 结果的自然语言解读。

- 关键输出:大模型基于自然语言的解读报告。

步骤 8:结果验证与应用

- 验证:人工审核大模型解读结果的准确性,对比业务常识;

- 应用:将解读结果落地到业务中,如用户分层、精准营销、设备异常识别。

- 关键输出:验证报告、业务落地方案。

4. 示例:大模型解读实现

我们以混元大模型为例,实现大模型对 PCA 结果的解读,注意需替换为自己的apikey:

import json

from openai import OpenAI

# ---------------------- 步骤1:配置API ----------------------

# 替换为你的腾讯混元API Key

api_key = 'sk-bWl********************NP8Ze'

client = OpenAI(

api_key=api_key,

base_url="https://api.hunyuan.cloud.tencent.com/v1",

)

# ---------------------- 步骤2:构造PCA结果输入 ----------------------

pca_result = {

"业务场景": "电商平台用户画像分析,目标是从10个用户行为特征中提取核心特征,用于用户分层和精准营销",

"原始特征说明": {

"年龄": "用户的实际年龄,范围18-60岁",

"月消费": "用户每月在平台的消费金额,单位元",

"登录次数": "用户每月登录平台的次数",

"浏览时长": "用户每天平均浏览平台的时长,单位分钟",

"购买频次": "用户每月在平台的购买次数",

"收藏商品数": "用户每月收藏的商品数量",

"分享次数": "用户每月分享商品/活动的次数",

"差评次数": "用户每月给出的差评数量",

"复购率": "用户的复购比例,范围0-1",

"优惠券使用次数": "用户每月使用优惠券的次数"

},

"PCA结果": {

"主成分数量": 3,

"累计贡献率": 80.0,

"单个贡献率": {

"主成分1": 42.0,

"主成分2": 25.0,

"主成分3": 13.0

},

"主成分系数矩阵": {

"年龄": [0.12, 0.78, 0.05],

"月消费": [0.85, 0.15, 0.08],

"登录次数": [0.21, 0.32, 0.65],

"浏览时长": [0.78, 0.22, 0.12],

"购买频次": [0.82, 0.18, 0.10],

"收藏商品数": [0.65, 0.25, 0.15],

"分享次数": [0.58, 0.30, 0.20],

"差评次数": [-0.42, -0.18, 0.35],

"复购率": [0.75, 0.22, 0.18],

"优惠券使用次数": [0.68, 0.28, 0.25]

}

},

"解读要求": {

"输出格式": "分三部分:1. 整体结论;2. 各主成分业务含义;3. 业务建议;",

"语言风格": "通俗、专业、简洁,适合电商运营人员阅读",

"重点": "突出每个主成分的核心特征和营销应用价值"

}

}

# 将PCA结果转化为提示词

system_prompt = "你是一个资深电商数据分析师,擅长解读数据分析结果"

user_prompt = f"""

请你解读以下PCA(主成分分析)结果,严格按照要求输出:

## PCA分析背景与结果

{json.dumps(pca_result, ensure_ascii=False, indent=2)}

## 解读要求

1. 整体结论:总结PCA降维的核心发现,说明3个主成分的信息覆盖度;

2. 各主成分业务含义:结合系数大小和符号,分析每个主成分的核心特征,用业务术语命名(如"消费能力因子");

3. 业务建议:基于主成分含义,给出用户分层、精准营销的具体建议。

输出语言要通俗,避免技术术语,重点突出业务价值。

"""

# ---------------------- 步骤3:调用大模型API ----------------------

def call_hunyuan_api(prompt):

"""调用腾讯混元API解读PCA结果"""

try:

response = client.chat.completions.create(

model='hunyuan-lite', # 可选:hunyuan-lite(轻量版)、hunyuan-pro(标准版)、hunyuan-turbo(极速版)

messages=[

{

'role': 'system',

'content': '你是一个资深电商数据分析师,擅长解读数据分析结果'

},

{

'role': 'user',

'content': prompt

}

],

temperature=0.3, # 温度越低,输出越稳定

max_tokens=2000, # 最大输出字数

top_p=0.8

)

# 提取回复内容

return response.choices[0].message.content

except Exception as e:

return f"调用异常:{str(e)}"

# 调用API并获取解读结果

interpretation_result = call_hunyuan_api(user_prompt)

# ---------------------- 步骤4:保存并打印结果 ----------------------

# 保存解读结果到文件

with open('PCA结果大模型解读.txt', 'w', encoding='utf-8') as f:

f.write(interpretation_result)

# 打印结果

print("="*50)

print("大模型对PCA结果的解读:")

print("="*50)

print(interpretation_result)输出结果:

================================================== 大模型对PCA结果的解读: ================================================== PCA分析结果解读 1. 整体结论 通过PCA分析,我们从10个用户行为特征中提取了3个主成分,累计贡献率达到80.0%。这意味着前三个主成分能够解释大部分的原始数据信息,能够较好 地代表用户的整体行为特征。 2. 各主成分业务含义 - **主成分1(42.0%)**:这个主成分主要反映了用户的消费能力和消费习惯。高系数表示用户在消费上较为活跃,可能具有较高的消费能力和明确的消费偏好。 - **主成分2(25.0%)**:这个主成分主要反映了用户的社交行为和分享习惯。高系数表示用户在社交平台上较为活跃,喜欢分享自己的购物体验和产品评价。 - **主成分3(13.0%)**:这个主成分主要反映了用户的忠诚度和复购行为。高系数表示用户对平台有较高的忠诚度,复购率较高。 3. 业务建议 - **用户分层**: - **高消费能力用户**:针对这部分用户,可以推送高价值商品和专属优惠,提升他们的满意度和购买频次。 - **高社交活跃用户**:鼓励这些用户分享购物体验,通过口碑营销吸引更多新用户,并提供一些互动奖励。 - **高忠诚度用户**:重点维护这部分用户,提供个性化的服务和专属活动,增强他们的忠诚度和复购率。 - **精准营销**: - **针对高消费能力的用户**:可以定期推送个性化的促销活动和高端产品推荐,提升他们的购买意愿。 - **针对高社交活跃用户**:可以通过社交平台进行精准广告投放,鼓励他们分享,同时提供一些互动奖励,增加用户粘性。 - **针对高忠诚度用户**:可以通过会员特权、专属客服等方式,提升他们的满意度和忠诚度,促进复购。 通过以上分析和建议,可以更有效地进行用户分层和精准营销,提升电商平台的运营效果。

七、总结

通过对PCA + 大模型组合的了解,我们可以深刻的理解传统算法和大模型的绝妙搭配。以前面对一堆几十上百维的数据,要么看不懂,要么喂不进大模型,现在终于有了一套特别顺滑的解决方案。PCA 就像一个精准的“数据瘦身师”,不看花哨、只抓核心,通过降维把高维数据里最关键的信息拎出来,解决了维度灾难、计算慢、不好可视化的问题。但它的短板也很明显:只给数字、不给解释,普通人根本看不懂主成分到底代表什么。

而大模型刚好补上这个缺口,充当“翻译官 + 分析师”,把枯燥的系数、贡献率、方差,转成我们能听懂的业务语言,比如消费能力、活跃度、用户价值。整个流程走下来,真正做到了:PCA 负责精准、可控、高效,大模型负责理解、推理、解释。

未来 AI 应用不是单纯堆大模型,而是传统算法做骨架,大模型做大脑。学会这种组合思路,不管是做用户画像、数据分析,还是异常检测,都能比别人更快、更准、更落地。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录