请问网友学习AI大模型 “自建” or "订阅" 给点意见--老登学AI

请问网友学习AI大模型 “自建” or "订阅" 给点意见--老登学AI

AustinDatabases

发布于 2026-05-12 10:39:12

发布于 2026-05-12 10:39:12

咱们新开了一个系列,叫老登学AI,我会把我在单位,在家,以及在社会上关于AI的事情,与数据库有关的事情都写到这个系列里面,今天是这个系列的第一集。题目很贴切,老登,对就是我,我就是一个老登,往50age走了,还有工作,还能写字,还能和大家欢笑着,学习着,这本身就是幸福的。

最近听说豆包都要收费了,所有问题就出来了,AI 要用怎么用!!

今天是第一集,我们说点嘛呢? 我们今天先说硬件,这个事情我特别想和大家讨论一下,咱们玩AI的是自己弄一个机器来部署大模型,还是购买云上各个厂商的提供的订阅来玩AI。

首先我想到的是通过购买硬件来进行AI的学习和训练,和友人沟通和学习后,有的老师购买了苹果.我想购买的是 MAC M5 MAX 128G 2T的笔记本。

超强的mac M5 MAX电脑

现说说为什么是这款,而不是别的,运行大模型非常吃显存,而苹果电脑和其他电脑最大的不同是Unified memory CPU 和 GPU 共享128G,这意味着我可以运行 70B的参数模型,如Llama 3 70B的大模型,这个是当前可以个人够到的流畅运行4-bit 5-bit量化版本的大模型的专家级别的门槛了。很多人问为什么不是 M5 PRO而是 M5 MAX 这个我也研究了一下,因为M5 PRO最大内存64G,只能跑33B这个级别的模型,虽然也很不错,但是这两个笔记本的差价大家可以看看,都不少钱,我为什么不一步到位。两个电脑的差价在1万7.

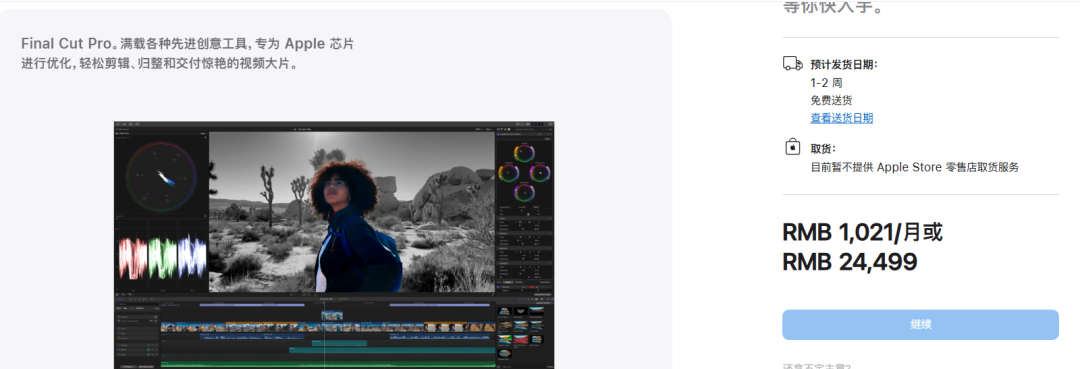

超强的mac M5 PRO电脑

但是2万4花了只能跑33B,你甘心吗,4万1就能跑70B,听说可能稍微慢一点,但是他能跑。所以我就开始纠结了。

然后我还看了几个其他的可以运行大模型的设备,联想为AI运行大模型定制的主机,只有手那么大,但是宣称可以跑70B主流的大模型,他采用的技术是联想定制的,内存划分给显存用的手段,将大型的显卡的内存加大,最大可以到96G的显存,来跑大模型。

比如联想为跑AI大模型专业定制的小型主机

价格比苹果的128 MAX5要便宜一些,但是跑出的成绩可能要比苹果的好一些,终究显存超大还有大显卡作为计算的支持。不过他虽然小,还是不如笔记本方便。

所以我现在找到的可以跑70B的主机花钱就能买的,是这两款。

然后就出事了,和家人说了想法,被回,你都买了多少笔记本了,你自己数数,每次都说提高生产力能把钱赚回来,这次人家说什么都不信了,问我要投出产出分析表,为投入后什么时候能产生效益,什么时候回本,什么时候能盈亏平衡,顺便还问了之前的投入产出比的问题。

这里有人问了,家里有必要买一个这样的祖宗,我个人觉得有这个必要,这样学习大模型从开始部署到使用你的整个链路是齐全的,70B的大模型基本可以和大部分咱们使用的大模型的智能程度相比了。

如果你不想为TOKEN焦虑那么就需要这么一个来支持的后续AI的研究工作。但是我实在是提出不了投入产出比这个报告给家里的领导。

随后我调研了可以购买的大模型订阅的模式,这里可以根据实际的使用模式来订阅不同的大模型,通过互联网将你的信息上传到大模型中,大模型将结果反馈给你,特别适合在各种AI变成工具中使用。但需要注意一些AI模型是不支持外部的模型的,比如qoder。但Trae是支持的,不过一些如minmax的大模型的高级版本,还是不能被选择。

阿里百炼

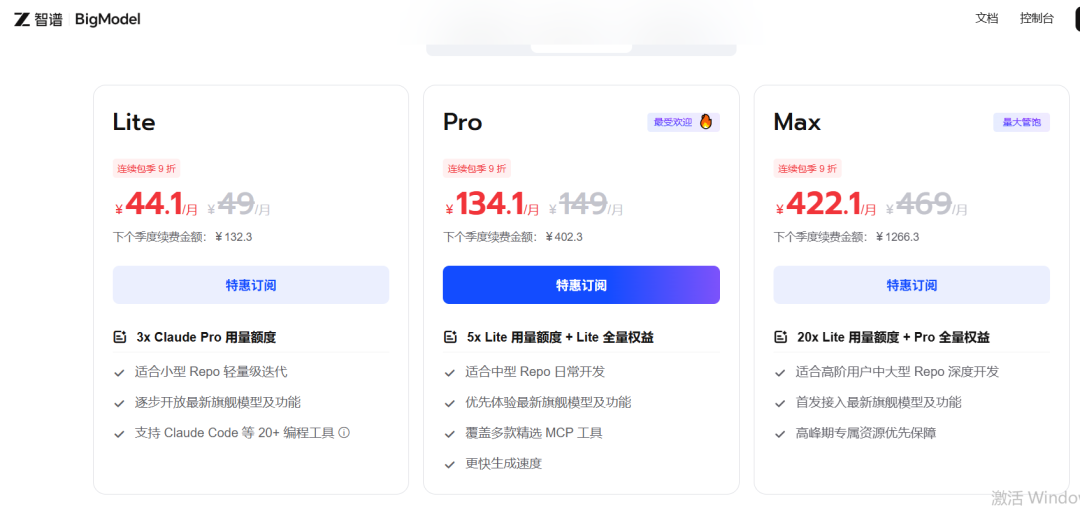

智谱大模型

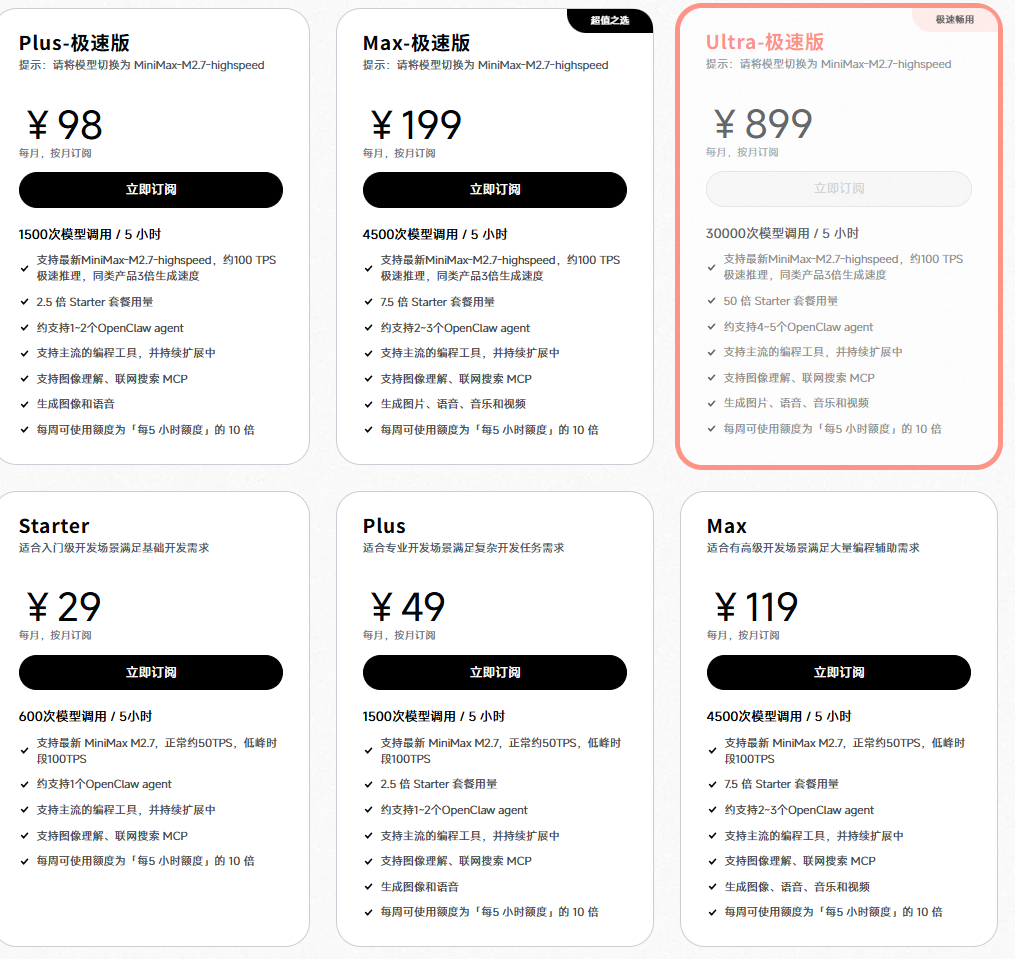

minmax

所以到目前为止,我个人还是希望能通过自己购买物理主机运行70B大模型的方式来进行AI的使用,这样比较稳定,虽然一次性投入比较高,但后期的费用低,只有电费和电脑的折旧,但大模型可以换,可以7*24小时的进行token的产出,而不用担心费用。

在我使用minxmax最便宜的那个版本的订阅时,有几次在下午基本都用不了,一直在卡。

所以万能的网友,你是支持自建大模型,一次性投入,还是支持购买网上的大模型。或者我们可以软硬相结合的方式,期待您在评论区给出更好的方式,帮助迷茫的人,感谢

最后说一句为什么不考虑MAC MIN

1 网上有测试,Mac min的价格贵,而且都是 M4 PRO,性能和M5 PRO的AI计算比差了一半。

2 没有屏幕

mac min

下期咱们说说怎么评判你现在的电脑能跑什么样的大模型

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-05-06,如有侵权请联系 cloudcommunity@tencent.com 删除

本文分享自 AustinDatabases 微信公众号,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文参与 腾讯云自媒体同步曝光计划 ,欢迎热爱写作的你一起参与!

评论

登录后参与评论

推荐阅读