【编者按】随着机器学习算法的流行,Amazon、Google,、IBM和Microsoft等公司在机器学习云服务市场接连出手,并提供许多的API来吸引用户。本文中,Janet Wagner,ProgrammableWeb的data journalist、developer和contributor,根据互联网上的活跃度盘点了机器学习API的Top 10,并介绍了它们的功能特色。Janet Wagner同时认为,Project Oxford等少数API虽然没有上榜,但仍值得称道。 如今,机器学习无处不在。它可以

会话粘性(Session Affinity):也称为会话持久性(Session Persistence)或会话坚持(Session Stickiness),是一种负载均衡策略,其中来自同一客户端的所有请求都被路由到相同的后端服务器。这样做的目的是确保在多个服务器之间保持用户的会话数据或状态的一致性。通常,会话粘性通过客户端的标识信息来实现,最常见的标识信息是客户端的 IP 地址或Cookie。

ip_hash使用源地址哈希算法,将同一客户端的请求总是发往同一个后端服务器,除非该服务器不可用。

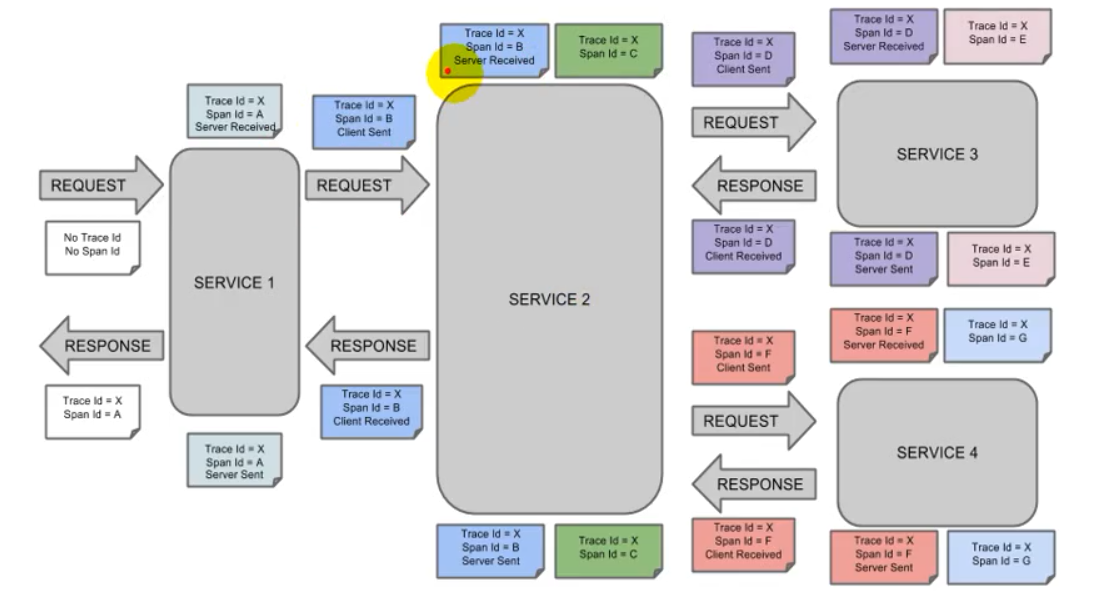

在微服务框架中,一个由客户端发起的请求在后端系统中会经过多个不同的的服务节点调用来协同产生最后的请求结果,每一个前段请求都会形成一条复杂的分布式服务调用链路,链路中的任何一环出现高延时或错误都会引起整个请求最后的失败。在微服务比较少的时候,某一个服务出现问题我们可以很快排查出来。现在一个项目中微服务很多而且调用关系复杂,某一个服务出现问题我们很难能够排查出来。Spring Cloud Sleuth 为 Spring Cloud 实现了分布式跟踪解决方案,它大量借用了 Google Dapper、Twitter Zipkin 和 Apache HTrace 的设计。

本文讲述了一名乌拉圭17岁高中生,因对信息安全感兴趣,通过学习研究,独立发现谷歌云平台漏洞并获得$7500美金(此前,他曾发现了价值$10000美金的谷歌主机头泄露漏洞)。在谈论该漏洞的具体细节之前,希望读者对谷歌云服务和API机制相关能有所了解,可以先来熟悉几个相关概念。 先导概念 谷歌运行有一个名为Google Service Management的管理服务,谷歌通过它来管理各种应用谷歌系统的内外部接口和用户自行创建的云端服务。在Google Service Management下,用户可以在自己的

如果你是谷歌云客户,并且正在使用该公司的AI套件来进行文字转语音或语音转文本服务,这有个好消息:谷歌今天宣布了这些方面的重大更新,包括云文本到语音的普遍可用性,优化声音以便在不同设备上播放的新音频配置文件,多声道识别的增强功能等等。

gRPC 1.0于2016年8月发布,现已发展成为应用通信的首选技术解决方案之一。它已被全球的初创公司、企业公司和开源项目采用。它对多语言环境的支持、关注性能、类型安全性和开发者生产力已经改变了开发者设计架构的方式。

负载均衡策略是实现负载均衡器的关键,而负载均衡器又是分布式系统中不可或缺的重要组件。使用它有助于提高系统的整体性能、可用性、可靠性和安全性,同时支持系统的扩展和故障容忍性。对于处理大量请求的应用程序和微服务架构来说,负载均衡器是不可或缺的重要工具。

Spring Cloud Security提供了许多安全性组件,其中包括Cloud OAuth2 Client,该组件是Spring Security的OAuth2客户端支持。

今天看了The Google File System的论文,我们简称其为GFS。GFS是谷歌的分布式文件存储系统,这篇论文是现代分布式软件系统入门的经典论文,并由此诞生了Hadoop生态中HDFS的开源实现。

我有一个关于使用断点续传到Google Cloud Storage的上传速度的问题。我已经编写了一个Python客户端,用于将大文件上传到GCS(它具有一些特殊功能,这就是为什么gsutil对我公司不适用的原因)。在大约2个月前运行的测试中,它很好地利用了可用的连接带宽,其中25Mbps连接中大约有20Mbps。该项目被冻结了将近2个月,现在,当重新打开该项目时,同一客户端以非常慢的速度上载,速度约为25Mbps的1.4Mbps。我已经编写了简单的Python脚本来检查它是否也会遇到相同的问题,并且速度稍快一些,但仍约为2Mbps。Gsutil工具的执行效果几乎与我的Python脚本相同。我还以超过50Mbps的上传速度在不同的网络基础架构上运行了该测试,效果非常好。

上一篇文章我们介绍了nginx的基础应用,其中讲到了nginx作为代理服务器的使用,但是漏了一个重要的,也是使用非常普遍的特性——负载均衡。今天,我们将这段内容补上。

传统JavaIO是面向流的I/O。流I/O一次处理一个字节。NIO则是面向块的I/O,每次操作都是以数据块为单位。它们的差距就好象两个人吃饭,一个人一粒一粒的吃,另一个人狼吞虎咽,快慢显而易见。NIO中引入了缓冲区(Buffer)的概念,缓冲区作为传输数据的基本单位:块。Buffer缓冲区的引入,是NIO与传统IO的一个重要区别.在传统IO中,都是针对流数据的操作,在NIO中是针对缓冲区数据操作。 缓冲区的实质是一个数组,最常用的是ByteBuffer.事实上每一种java基本类型都对应一种缓冲区类型.

最近工作中遇到一个场景,商家在商家后台需要实时的获取到有没有新订单,有的话是几个;这个需求类似与日常中使用QQ或者微信时的新信息提醒一样,只要有新信息就需要提醒;商家基本在PC上使用,各式浏览器都有:如 IE系列(7.0,8.0,9.0及以上),chrome内核,firefox等;功能所属的部署在Tomcat 6.0上,如果技术需要可以部署到 Tomcat 7.0上; 我们先做做技术调研,这种浏览器与服务器实时通信的方式有哪些方式。 AJAX轮询 这是我们最自然想到的。 采用常规AJAX轮询的方式,每10s

摘要 深度学习的概念源于人工神经网络的研究,含多隐层的多层感知器就是一种深度学习结构。深度学习通过组合低层特征形成更加抽象的高层表示属性类别或特征,以发现数据的分布式特征表示。 机器学习与深度学习应用

最近工作中遇到一个场景,商家在商家后台需要实时的获取到有没有新订单,有的话是几个;这个需求类似与日常中使用QQ或者微信时的新信息提醒一样,只要有新信息就需要提醒;商家基本在PC上使用,各式浏览器都有:如 IE系列(7.0,8.0,9.0及以上),chrome内核,firefox等;功能所属的部署在Tomcat 6.0上,如果技术需要可以部署到 Tomcat 7.0上;

gRPC 和 HTTP 是两种常见的网络通信协议,用于在客户端和服务器之间进行通信。它们具有不同的特点和适用场景,下面对它们进行详细比较。

简单来说,Chatbot是一种模拟人类对话(以文本和音频形式)的计算机程序,我们将其视为智能和有用的。他们最重要的应用是个人或企业虚拟助手。聊天机器人可以挖掘大量数据,为客户挑选最好的金块,无论是故障排除解决方案还是推荐新产品。此外,它们还为你的企业和客户提供了非常直观的界面。根据具体情况,聊天机器人可以从用户所说的内容中了解个性化交互并构建以前的交互,从而提供令人满意和未来的客户体验。

ngx_http_limit_req_module 用来限制单位时间内的请求数,即速率限制,采用的漏桶算法 “leaky bucket” ngx_http_limit_conn_module 用来限制同一时间连接数,即并发限制 limit_rate和limit_rate_after 下载速度设置

原题:When to Use What: REST, GraphQL, Webhooks, & gRPC

轮循均衡(Round Robin):每一次来自网络的请求轮流分配给内部中的服务器,从1至N然后重新开始。此种均衡算法适合于服务器组中的所有服务器都有相同的软硬件配置并且平均服务请求相对均衡的情况。

微服务架构是一个分布式架构,它按业务划分服务单元,一个分布式系统往往有很多个服务单元。由于服务单元数量众多,业务的复杂性,如果出现了错误和异常,很难去定位。主要体现在,一个请求可能需要调用很多个服务,而内部服务的调用复杂性,决定了问题难以定位。所以微服务架构中,必须实现分布式链路追踪,去跟进一个请求到底有哪些服务参与,参与的顺序又是怎样的,从而达到每个请求的步骤清晰可见,出了问题,很快定位。

配套资料,免费下载 链接:https://pan.baidu.com/s/1la_3-HW-UvliDRJzfBcP_w 提取码:lxfx 复制这段内容后打开百度网盘手机App,操作更方便哦

Nginx是一款常用的网站管理程序,在Windows系统服务器和Linux系统服务器中都可以安装。在Nginx使用过程中,为了避免一些网站占用过多资源,出现分配不均的现象,就需要限制访问频率、下载速率和并发连接数。下面是具体教程:

BFF全称是Backends For Frontends(服务于前端的后端),Sam Newman曾在他的博客中写了一篇相关的文章——Pattern: Backends For Frontends,在文章中Sam Newman详细地说明了BFF。

Turbinia是一款专门用于部署、管理和运行分布式取证任务流的开源框架。该工具可以自动化运行常见的数据取整处理工具,例如Plaso、TSK和strings等等,可帮助研究人员对云端环境以及大量账号下的数字证据进行处理,并尽可能地通过并行处理方式来减少响应时间。

大家好,这是一期社区专题 FAQ。我们整理了近期社区中关注度较高的问题,在这里进行统一汇总解答。

笔者在前文《Azure AI 服务之文本翻译》中简单介绍了 Azure 认知服务中的文本翻译 API,通过这些简单的 REST API 调用就可以轻松地进行机器翻译。如果能在程序中简单的集成语音转文本

官方文档:https://cloud.spring.io/spring-cloud-static/spring-cloud-sleuth/2.1.3.RELEASE/single/spring-cloud-sleuth.html

1.1 传统的应用 1.1.1 单体应用 在此之前,笔者所在公司开发Java程序,大都使用Struts、Spring、Hibernate(MyBatis)等技术框架,每一个项目都会发布一个单体应用。例如开发一个进销存系统,将会开发一个war包部署到Tomcat中,每一次需要开发新的模块或添加新功能时,都会在原来的基础上不断的添加。若干年后,这个war包不断的膨胀,程序员在进 行调试时,服务器也可能需要启动半天,维护这个系统的效率极为低下。这样一个war包,涵盖了库存、销售、会员、报表等模块,如图1-1。

在此之前,笔者所在公司开发Java程序,大都使用SSM等技术框架,每一个项目都会发布一个单体应用。例如开发一个进销存系统,将会开发一个war包部署到Tomcat中,每一次需要开发新的模块或添加新功能时,都会在原来的基础上不断的添加。若干年后,这个war包不断的膨胀,程序员在进行调试时,服务器也可能需要启动半天,维护这个系统的效率极为低下。这样一个war包,涵盖了库存、销售、会员、报表等模块,如图1-1。

微服务架构是一种分布式架构,微服务系统按照业务划分服务单元,一个微服务往往会有很多个服务单元,一个请求往往会有很多个单元参与,一旦请求出现异常,想要去定位问题点真心不容易,因此需要有个东西去跟踪请求链路,记录一个请求都调用了哪些服务单元,调用顺序是怎么样的以及在各个服务单元处理的时间长短。常见的服务链路追踪组件有google的dapper、twitter的zipkin、阿里的鹰眼等,它们都是出众的开源链路追踪组件。

11 月,EMQX 开源版和企业版分别发布了多个迭代版本,在安全性保障和生态集成方面又有了新的提升。

了 springboot 微服务框架后会有很多微服务,每次都到单个微服务自己的日志海洋里去找需要很大经理, 日志跟踪就会成为一个麻烦。我们尝试来寻找一个简化方案

最近读微软一篇比较早的论文,Windows Azure Storage:A Highly Available Cloud Storage Service with Strong Consistency(一个带强一致性能力的高可用云存储服务。) windows azure storag 后面简称 WAS。WAS 支持多模存储,包括 Blobs(用户文件)、Tables(结构化数据)、Queues(消息传输)。 一、下面是 WAS 的架构,主要分三层: 从下到上分别讲: 1、Stream Layer: 这一

从上周六 7 号到今天的 11 号,我都在医院,小孩因肺炎已经住院了,我白天和晚上的时间需要照顾娃,只能在娃睡觉的时候肝文了。对了,医院没有宽带和 WiFi,我用的手机开的热点~

有关深度学习或机器学习方面的文章层出不穷,涵盖了数据收集,数据整理,网络/算法选择,训练,验证和评估等主题。

原文地址:https://dzone.com/articles/internet-things-mqtt-quality

当一个jsp页面第一次被访问的时候,jsp将执行以下三个步骤,之后的访问速度会因为class文件已经生成而大大提高,当jsp引擎发送一个客户端请求的时候,首先判断请求的jsp页面是否比对应生成的servlet文件,如果不同,对应的jsp需要重新编译。

我们很高兴地告诉大家,EMQX Enterprise 4.4.11 版本正式发布!

我印象中负载均衡其实是个硬件设备。其实一开始确实是的,然而现在已经不同了。尤其是云厂商提供的负载均衡方案几乎全部是靠软件。现在的负载均衡不仅是网络流量复杂均衡,几乎所有的平衡多个计算资源负载的方案都可以叫做负载均衡。在云计算背景下,负载均衡其实有一个软件实体--proxy。准确说,他们其实是不一样的,但是不能否认他们的功能其实重叠,proxy将网络转发作为主要功能。并且在所有的service mesh、cloud的资料中,这两个词指的就是同一个东西。

经过以上简单的配置,nginx -s reload后,nginx即可作为反向代理服务器。这段配置的关键在于server配置端,nginx中使用localtion匹配uri,proxy_pass来指定上游服务器,proxy_set_header设置发送到上游服务器的请求头部。当我们请求本机的80端口,nginx将会把请求转发到8000端口,然后将响应返回给客户端。

会话(Session)跟踪是Web程序中常用的技术,用来跟踪用户的整个会话。常用的会话跟踪技术是Cookie与Session。 Cookie通过在客户端记录信息确定用户身份 Session通过在服务器端记录信息确定用户身份 本章将系统地讲述Cookie与Session机制,并比较说明什么时候不能用Cookie,什么时候不能用Session。 1.1 Cookie机制 在程序中,会话跟踪是很重要的事情。理论上,一个用户的所有请求操作都应该属于同一个会话,而另一个用户的所有请求操作则应该属于另一个会话,二

领取专属 10元无门槛券

手把手带您无忧上云