当算力遇上情感:用顶级显卡复现B站IndexTTS2声音魔法

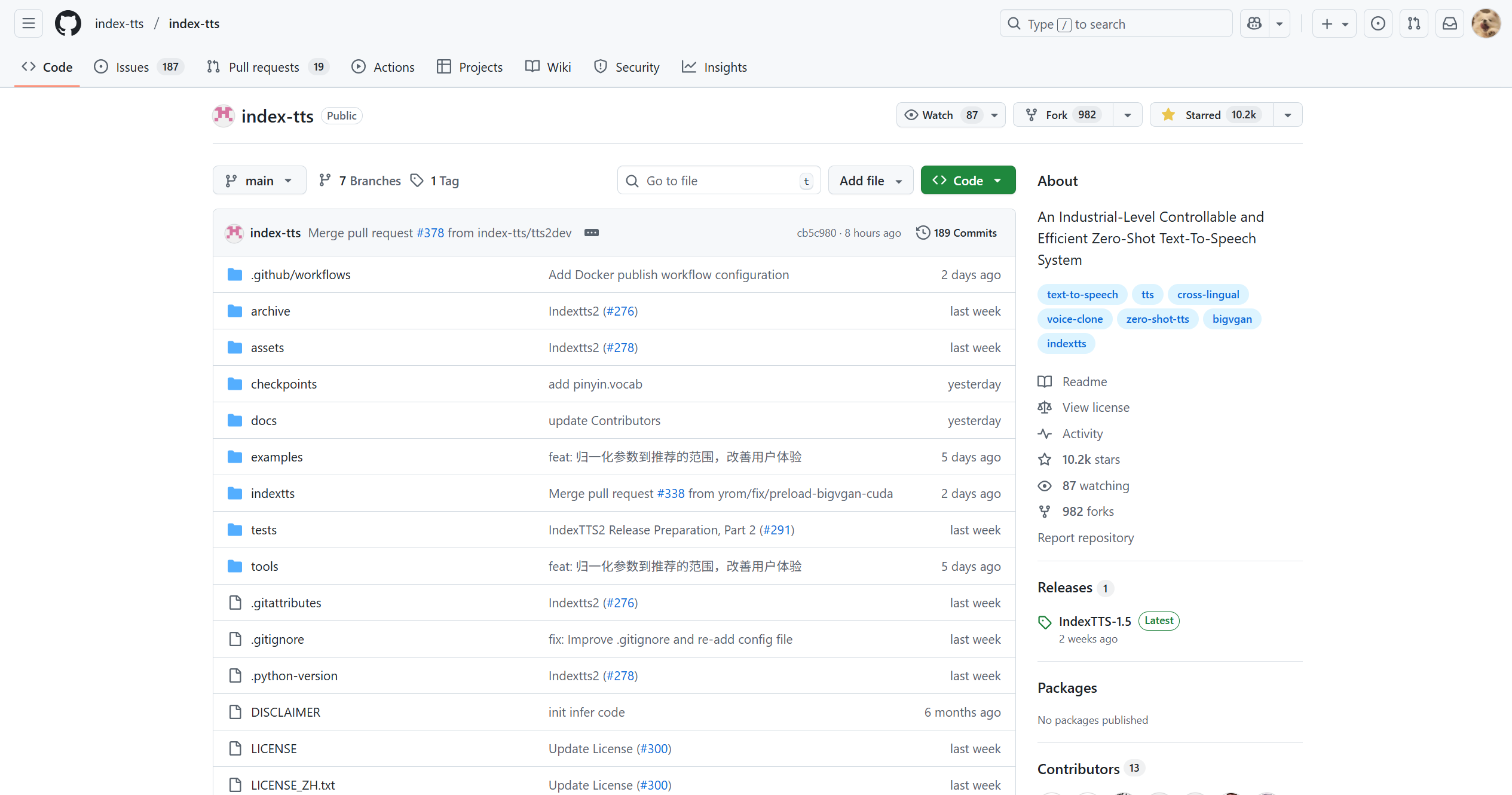

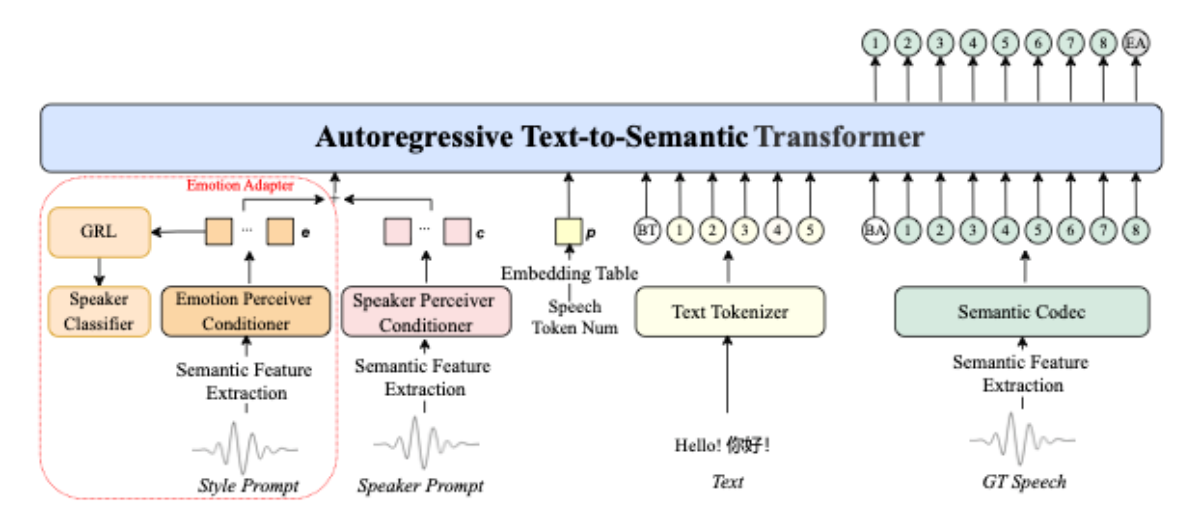

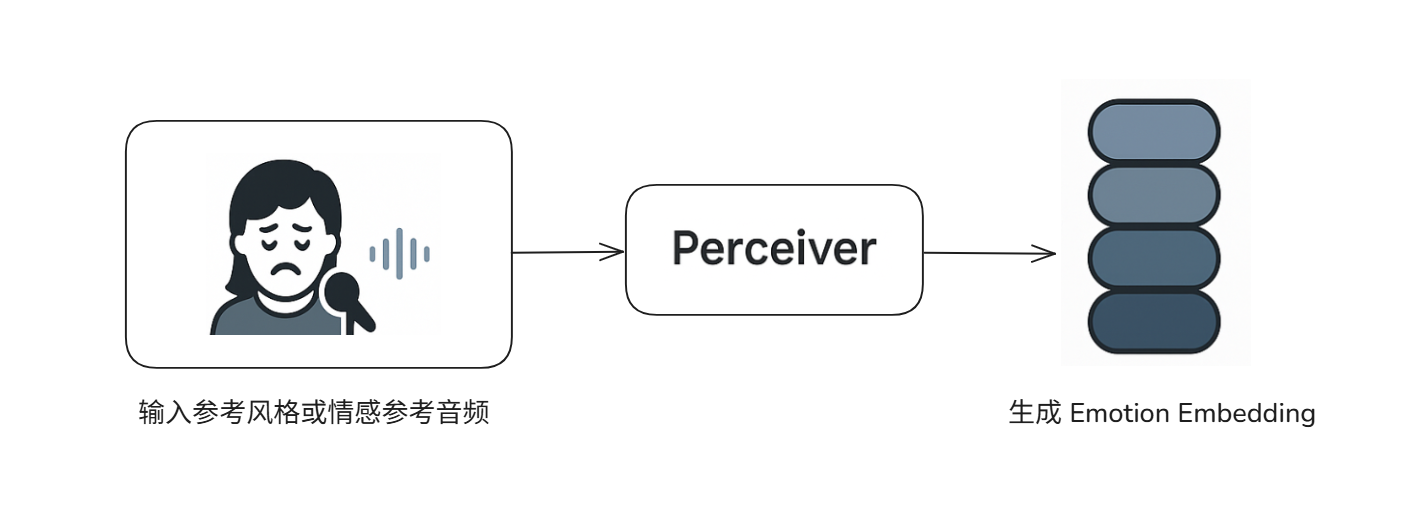

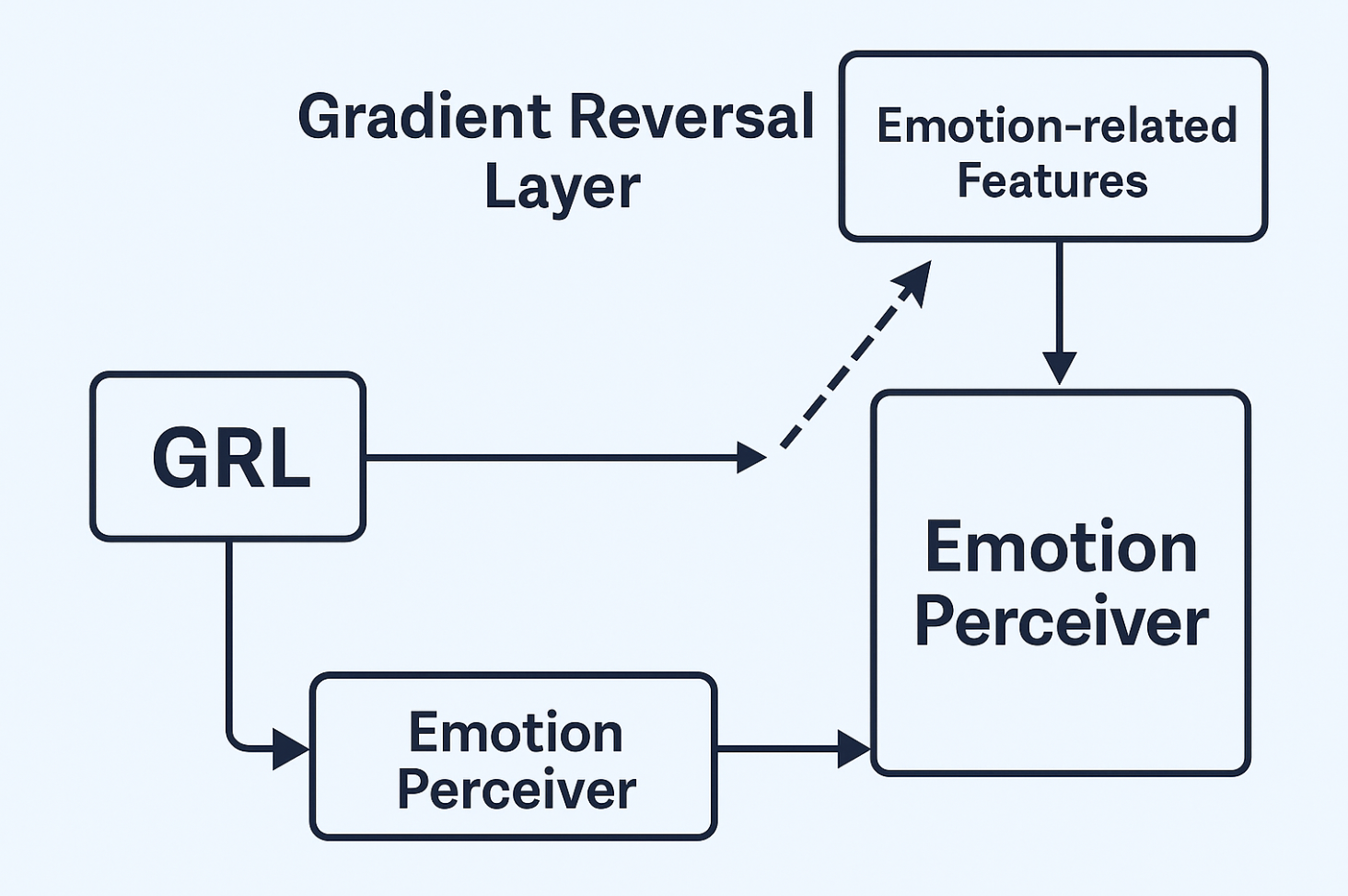

## <font color="navy">引言:AI创世纪的桌面革命</font> 我们正处在一个<font color="purple">激动人心</font>的时代。曾经<font color="teal">束之高阁</font>、仅存于<font color="brown">顶尖实验室</font>和<font color="darkgreen">庞大服务器集群</font>中的<font color="darkred">人工智能技术</font>,正以前所未有的<font color="navy">速度</font>飞入寻常百姓家。这场<font color="olive">AI民主化</font>的浪潮中,顶级显卡<font color="darkcyan">不仅仅是</font>一块游戏显卡,它更像一把<font color="saddlebrown">钥匙</font>,为<font color="darkmagenta">广大的开发者、创作者和技术爱好者</font>打开了通往<font color="firebrick">专业级AI应用</font>的大门。技术的浪潮瞬息万变,就在我们惊叹于基础声音合成时,Bilibili Index团队<font color="darkslategray">开源</font>了其<font color="indigo">突破性</font>的 **IndexTTS2** 模型,将<font color="blue">情感表现力</font>和<font color="red">时长控制</font>这两个长期以来的<font color="green">行业难题</font>,带入了Zero-Shot语音合成领域。 ## <font color="navy">一、 解锁潜能的关键:为什么顶级显卡是IndexTTS2的理想伴侣?</font> 高质量的TTS模型,特别是<font color="firebrick">结构复杂</font>的<font color="darkslategray">自回归 (Auto-Regressive)</font> 模型如IndexTTS2,对硬件的要求<font color="indigo">极为苛刻</font>。选择顶级显卡并非单纯追求极致性能,而是其<font color="blue">多项关键特性</font>共同构成了<font color="red">运行此类前沿模型</font>的<font color="green">坚实基础</font>。  <font color="darkblue">**顶级显卡 核心优势一览表**</font> | 核心特性 | 价值摘要 | 关键影响 | | :--- | :--- | :--- | | **24GB GDDR6X海量显存** | <font color="orange">**硬性门槛**</font> | 允许<font color="purple">更大的Batch Size</font>,<font color="teal">避免OOM</font>,加速收敛。 | | **第四代Tensor Cores** | <font color="brown">**效率核心**</font> | <font color="darkgreen">硬件加速</font>混合精度训练,<font color="darkred">数倍提升</font>训练速度。 | | **16384个CUDA核心** | <font color="navy">**通用算力**</font> | <font color="olive">保障</font>数据预处理等<font color="darkcyan">非核心</font>计算任务<font color="saddlebrown">不拖后腿</font>。 | | **DLSS 3 & 光流加速器** | <font color="darkmagenta">**未来潜力**</font> | 为<font color="firebrick">实时</font>语音驱动<font color="darkslategray">数字人</font>等<font color="indigo">多模态</font>应用<font color="blue">铺路</font>。 | **监控硬件性能:`nvidia-smi`** 在整个训练和推理过程中,<font color="red">持续监控</font>顶级显卡的状态<font color="green">至关重要</font>。 ```bash # 持续监控GPU状态,每2秒刷新一次 watch -n 2 nvidia-smi ``` 通过 `nvidia-smi` 的输出,我们可以<font color="orange">实时看到</font>: > `Fan`: 风扇转速,判断散热是否正常。 `Temp`: GPU核心温度,<font color="purple">长时间高负载</font>下应保持在85°C以下。 `Pwr:Usage/Cap`: 功耗,顶级显卡在训练时<font color="teal">功耗会</font>非常高。 `Memory-Usage`: **最重要的指标**。可以<font color="brown">直观看到</font>24GB显存的<font color="darkgreen">占用情况</font>。 `GPU-Util`: GPU<font color="darkred">利用率</font>,应尽可能<font color="navy">接近100%</font>,表示算力被<font color="olive">充分利用</font>。 ## <font color="navy">**二、 项目解析:Bilibili IndexTTS2的革命性突破**</font> 根据其GitHub仓库 (`https://github.com/index-tts/index-tts`) 和官方介绍,IndexTTS2是一个在<font color="darkcyan">情感表现力</font>和<font color="saddlebrown">时长控制</font>上取得<font color="darkmagenta">突破</font>的<font color="firebrick">自回归、零样本</font>TTS模型。  **核心亮点解读:** > **零样本**:<font color="darkslategray">无需</font>为每个新声音都<font color="indigo">重新训练</font>。只需<font color="blue">一小段</font>参考音频,模型就能<font color="red">立即模仿</font>其音色。 **情感表现力**:<font color="green">最大的进步</font>。不仅合成音色,更能<font color="orange">捕捉并复现</font>参考音频中的<font color="purple">情感、韵律和停顿</font>。 **时长控制**:允许用户在<font color="teal">一定程度上</font>控制<font color="brown">合成语音</font>的<font color="darkgreen">语速</font>,对<font color="darkred">视频配音</font>等场景<font color="navy">非常实用</font>。 **情感与音色解耦**:可以<font color="olive">独立控制</font>音色和情感,使用A的音色,却<font color="darkcyan">表现出</font>B的情感。  ### <font color="darkblue">**IndexTTS2 核心架构组件深度解析**</font> <font color="darkmagenta">**1.Speaker Prompt / Speaker Perceiver**</font> 这个组件的任务是**识别说话人是谁** 它会分析你提供的一段<font color="saddlebrown">音色参考</font>音频,然后从中<font color="darkmagenta">提取</font>出这个人的声音特质。它背后使用的技术叫 Perceiver,这是一种很厉害的<font color="firebrick">注意力机制</font>变体,特别擅长<font color="darkslategray">处理</font>像音频这样很长的信息流。它的最终目标是把一段<font color="indigo">可变长度</font>的音频信号<font color="blue">压缩</font>成一个<font color="red">固定维度</font>的声音身份证,也就是<font color="green">说话人嵌入向量 (Speaker Embedding)</font>。这个向量<font color="orange">包含了</font>音色最<font color="purple">核心的信息</font>,是整个模型<font color="teal">实现音色</font>模仿的<font color="brown">基础</font>。  <font color="darkmagenta">**2.Style Prompt / Emotion Perceiver**</font> 这个组件的任务是**识别说话人用的是什么情绪/风格** 它的工作方式和上面那个很像,但关注点不同。它会分析你提供的<font color="darkgreen">风格/情感</font>参考音频,但它不会去关心说话人是谁,而是专注于<font color="navy">专注于</font>捕捉声音里的<font color="olive">韵律、语速、音高变化</font>这些<font color="darkcyan">超语言学特征</font>。最后,它会生成一个代表情绪的“风格说明书”,也就是<font color="saddlebrown">情感嵌入向量 (Emotion Embedding)</font>。这是让合成语音<font color="darkmagenta">实现情感</font>表达的<font color="firebrick">关键</font>。  <font color="darkmagenta">**3. GRL**</font> 这个组件是一个非常聪明的“训练小技巧”,它的全称是<font color="darkslategray">梯度反转层</font> 在训练模型时,我们希望 Emotion Perceiver 只学习情感,不要学到音色。GRL 就在这里发挥作用。它会<font color="indigo">反转</font>一部分<font color="blue">梯度</font>信号,这是一种叫做<font color="red">领域对抗训练</font>的技术。你可以把它想象成一个“捣蛋鬼”:当 Emotion Perceiver 试图根据音色去区分说话人时,GRL 就会给它一个错误的、相反的信号来<font color="purple">“惩罚”</font>它。这样一来,就<font color="brown">迫使</font> Emotion Perceiver 不得不放弃学习音色特征,从而<font color="darkgreen">只学习</font>那些纯粹与情感相关、与<font color="darkred">音色无关</font>的特征,最终<font color="navy">实现</font>了<font color="olive">情感与音色</font>的<font color="darkcyan">有效解耦</font>。  <font color="darkmagenta">**4. Emotion Adapter**</font> 这个组件像一个转接头或调味包,它的作用是把<font color="darkmagenta">情感特征</font>优雅地<font color="firebrick">融入</font>主模型 它是一种<font color="darkslategray">轻量级</font>的<font color="indigo">神经网络模块</font>,被巧妙地<font color="blue">插入</font>到核心Transformer模型的<font color="red">层与层之间</font>。这样做的好处是,它<font color="green">允许</font>情感信息<font color="orange">以一种</font>温和且非侵入性的<font color="purple">方式</font>“注入”到<font color="teal">语义生成</font>的过程中, subtly <font color="brown">影响</font>最终<font color="darkgreen">语音的</font>风格,而不会破坏模型原有的文本理解能力。 <font color="darkmagenta">**5.Autoregressive Text-to-Semantic Transformer**</font> 这是整个系统的**大脑和引擎**,是<font color="darkred">自回归的Transformer</font> 它<font color="navy">接收</font>所有的输入信息:文本内容、前面提取的音色特征和情感特征。然后,利用强大的<font color="darkmagenta">自注意力机制</font>来<font color="firebrick">捕捉</font>文本中的<font color="darkslategray">长距离依赖</font>关系(理解上下文)。“自回归”的意思是它会<font color="darkcyan">逐个</font>地生成<font color="saddlebrown">语义Token</font>(一种代表声音含义的中间代码),并且<font color="indigo">当前Token</font>的生成<font color="blue">依赖于</font>之前<font color="red">所有已生成</font>的Token。这保证了<font color="green">生成的语音</font>在<font color="orange">语义上</font>是连贯和自然的,但缺点是逐字生成,所以<font color="purple">也是其</font>计算量<font color="teal">巨大</font>的<font color="brown">原因</font>。 <font color="darkmagenta">**6. Semantic Codec**</font> 这是最后一步,负责**发声**的组件 它接收 Transformer 生成的<font color="darkgreen">语义Token</font>,并将这些抽象的代码解码成<font color="darkred">最终的</font>、我们可以听到的<font color="navy">音频波形</font>。这个组件通常是一个高效的<font color="olive">声码器 (Vocoder)</font>,它是一个<font color="darkcyan">独立训练</font>的<font color="saddlebrown">神经网络</font>,专门负责将<font color="darkmagenta">高级的声学</font>特征<font color="firebrick">高效地</font>转换成<font color="darkslategray">高质量</font>的<font color="indigo">原始音频</font>。 --- | 组件 | 核心功能| 技术关键词 | | :--- | :--- | :--- | | **Speaker Perceiver** | 从参考音频中提取**我是谁** (音色特征) | <font color="firebrick">注意力机制</font>, <font color="green">说话人嵌入向量</font> | | **Emotion Perceiver** | 从参考音频中提取**我什么心情** (情感风格) | <font color="darkcyan">超语言学特征</font>, <font color="saddlebrown">情感嵌入向量</font> | | **GRL** | 训练时的“纠错员”,确保情感和音色**不混淆**。 | <font color="darkslategray">梯度反转层</font>, <font color="red">领域对抗训练</font>, <font color="darkcyan">解耦</font> | | **Emotion Adapter** | 像“调味包”一样,将**情感特征注入**到主模型中。 | <font color="darkslategray">轻量级</font>, <font color="blue">插入</font>模块, <font color="purple">非侵入性</font> | | **Transformer (核心)** | **“大脑”**,结合所有信息,逐字生成声音的语义蓝图。 | <font color="darkred">自回归</font>, <font color="darkmagenta">自注意力机制</font>, <font color="saddlebrown">语义Token</font> | | **Semantic Codec** | **“声带”**,将语义蓝图转换成真实可听的音频。 | <font color="olive">声码器 (Vocoder)</font>, <font color="indigo">原始音频</font>波形 | ## <font color="navy">三、 实战工作流:在顶级显卡上复现IndexTTS2的声音魔法</font> 以下是我<font color="blue">严格按照</font>官方文档,借助顶级显卡完成个性化语音合成的完整流程。 ### <font color="red">**步骤一:环境配置**</font> 官方<font color="green">强烈推荐</font>使用 `uv` 包管理器,以<font color="orange">保证依赖</font>环境的<font color="purple">可靠性</font>。 1. **安装 Git-LFS 并下载代码**: `git-lfs` 用于<font color="teal">处理</font>GitHub仓库中的<font color="brown">大文件</font> (如模型权重)。 ```bash # (确保已安装 git 和 git-lfs) git lfs install git clone https://github.com/index-tts/index-tts.git cd index-tts git lfs pull ``` 2. **安装 `uv` 包管理器**: `uv` 是一个<font color="darkgreen">极快</font>的Python<font color="darkred">包安装</font>和<font color="navy">虚拟环境</font>管理器。 ```bash pip install -U uv ``` 3. **使用 `uv` 安装依赖**: `uv` 会自动创建 `.venv` 虚拟环境并安装所有依赖,<font color="olive">确保环境</font>的<font color="darkcyan">纯净和可复现</font>。 ```bash # 使用国内镜像加速 uv sync --all-extras --default-index "https://mirrors.aliyun.com/pypi/simple" ``` * `--all-extras`: 安装<font color="saddlebrown">全部可选</font>功能,包括 WebUI 和 DeepSpeed 加速。 4. **下载预训练模型**: ```bash # 安装 huggingface-cli uv tool install "huggingface_hub[cli]" # 设置镜像端点 (可选,用于加速) export HF_ENDPOINT="https://hf-mirror.com" # 下载 IndexTTS-2 模型到 checkpoints 目录 hf download IndexTeam/IndexTTS-2 --local-dir=checkpoints ``` 5. **PyTorch GPU 加速检测**: 运行官方提供的脚本,<font color="darkmagenta">确保</font> PyTorch <font color="firebrick">能正确识别</font>并<font color="darkslategray">使用</font> 顶级显卡。 ```bash uv run tools/gpu_check.py ``` <font color="indigo">预期输出</font>应明确指出<font color="blue">找到了CUDA设备</font>且PyTorch<font color="red">版本支持GPU</font>。 ### <font color="green">**步骤二:数据准备——高质量音频的艺术**</font> 这是<font color="orange">决定合成效果上限</font>的关键一步,也是<font color="purple">最考验耐心</font>的环节。 1. **录制参考音频**:我使用<font color="teal">高质量麦克风</font>录制了<font color="brown">约10分钟</font>的个人朗读音频,<font color="darkgreen">刻意包含了</font>高兴、平静、疑问等<font color="darkred">多种情感</font>。 2. **音频处理**:对录音进行<font color="navy">降噪</font>,并切分成<font color="olive">5-15秒</font>的短音频片段。所有音频必须转换为**单声道、22050Hz采样率的WAV格式**。 3. **文本标注**:为<font color="darkcyan">每一个</font>音频片段<font color="saddlebrown">精确标注</font>对应的文本,并保存为项目要求的格式 (通常是 `list.txt`)。 ```bash ./dataset/my_voice/001.wav|这是第一个音频片段的文本,要带有感情。 ./dataset/my_voice/002.wav|这是第二个片段。 ... ``` ### <font color="darkmagenta">**步骤三:模型训练——释放顶级显卡的全部力量**</font> 这是<font color="firebrick">整个流程</font>中<font color="darkslategray">对硬件性能</font>的<font color="indigo">终极考验</font>。 1. **预处理**:运行项目提供的脚本,将音频和文本转换为模型训练所需的特征。 ```bash uv run python preprocess.py ``` 2. **开始训练**:执行训练命令。 ```bash uv run python train.py -c configs/config.json -m indextts2 ``` 在训练期间,顶级显卡的<font color="blue">强大之处</font>显露无遗: * **显存占用**:通过 `nvidia-smi` 监控,显存占用<font color="red">峰值接近22GB</font>。这再次证明了<font color="green">24GB显存</font>对于运行此类SOTA (State-of-the-art) 模型是<font color="orange">多么重要</font>。 * **训练效率**:<font color="purple">第四代Tensor Cores</font>的加持,使得训练过程中的<font color="teal">迭代速度</font>非常快。在这款显卡上,我只用了<font color="brown">几个小时</font>就得到了一个<font color="darkgreen">效果相当不错</font>的模型检查点,这在<font color="darkred">旧款显卡</font>上是<font color="navy">难以想象</font>的。 * **稳定性**:长时间的<font color="olive">高强度计算</font>下,顶级显卡的<font color="darkcyan">散热系统</font>表现出色,<font color="saddlebrown">核心温度</font>始终在<font color="darkmagenta">可控范围</font>内,确保了<font color="firebrick">训练的顺利</font>完成。 ### <font color="darkslategray">**步骤四:IndexTTS2 快速体验与推理**</font> 训练完成后,或<font color="indigo">直接使用</font>下载的<font color="blue">预训练模型</font>,我们可以<font color="red">通过多种</font>方式<font color="green">进行推理</font>。 **1. Web 演示 (WebUI)**: 官方<font color="orange">提供了</font>一个<font color="purple">非常直观</font>的 Web 界面。 ```bash uv run webui.py ``` 浏览器访问 `http://127.0.0.1:7860` 即可<font color="teal">打开演示</font>页面。在这个界面上,可以<font color="brown">方便地</font>上传参考音频、输入文本、<font color="darkgreen">调整各种</font>参数并<font color="darkred">实时生成</font>语音。 **2. Python 脚本调用与参数调优**: IndexTTS2 <font color="navy">提供了</font>极其<font color="olive">丰富</font>的<font color="darkcyan">推理参数</font>,顶级显卡 的<font color="saddlebrown">强大算力</font>让我们<font color="darkmagenta">可以从容</font>地<font color="firebrick">尝试</font>各种组合。 <font color="darkblue">**IndexTTS2 核心推理参数调优表**</font> | 参数 (Parameter) | 类型 (Type) | 作用与调优建议 | | :--- | :--- | :--- | | `spk_audio_prompt` | String (path) | **必需**。指定<font color="darkslategray">音色参考</font>。 | | `emo_audio_prompt` | String (path) | 指定<font color="indigo">情感参考</font>,实现<font color="blue">情感与音色</font>分离。 | | `emo_alpha` | Float | 情感参考的<font color="red">权重</font> (0.0 - 1.0)。 | | `use_emo_text` | Boolean | `True`则<font color="green">根据文本</font>自动<font color="orange">推断情感</font>。 | | `emo_text` | String | 提供<font color="purple">独立</font>的<font color="teal">情感描述</font>文本。 | | `emo_vector` | List[Float] | <font color="brown">精确控制</font>8维情感向量。 | | `use_fp16` | Boolean | <font color="darkgreen">半精度推理</font>,<font color="darkred">降低显存</font>占用。 | | `use_deepspeed` | Boolean | <font color="navy">DeepSpeed加速</font>,提升推理速度。 | **代码示例:指定情感参考音频**```python from indextts.infer_v2 import IndexTTS2 use_fp16=True 在 顶级显卡 上是很好的选择 tts = IndexTTS2(cfg_path="checkpoints/config.yaml", model_dir="checkpoints", use_fp16=True) text = "酒楼丧尽天良,开始借机竞拍房间,哎,一群蠢货。" 使用我自己的音色,但模仿一个悲伤语调的音频 tts.infer(spk_audio_prompt='examples/my_voice.wav', text=text, output_path="gen_sad.wav", emo_audio_prompt="examples/emo_sad.wav", emo_alpha=0.8) # 稍微降低情感强度 ## <font color="navy">四、工作流重塑与未来展望</font> 顶级显卡与IndexTTS2的结合,<font color="olive">彻底重塑</font>了我的<font color="darkcyan">创意工作流</font>: **内容创作**:可以为视频、播客<font color="saddlebrown">生成带有情感</font>的旁白,<font color="darkmagenta">大大提升</font>了内容的<font color="firebrick">感染力</font>。  **游戏开发**:独立游戏开发者<font color="darkslategray">可以</font>为NPC<font color="indigo">生成</font>大量<font color="blue">高质量、带情感</font>的<font color="red">对话</font>,而<font color="green">无需</font>昂贵的<font color="orange">配音预算</font>。  **个性化体验**:为<font color="purple">个人AI助手</font>、<font color="teal">有声读物</font>,甚至<font color="brown">虚拟数字人</font>,<font color="darkgreen">注入</font>独特且<font color="darkred">富有情感</font>的<font color="navy">声音灵魂</font>。  展望未来,随着顶级显卡级别算力的<font color="olive">进一步普及</font>,以及IndexTTS这类<font color="darkcyan">优秀开源模型</font>的<font color="saddlebrown">不断涌现</font>,我们有理由相信,<font color="darkmagenta">实时情感语音转换</font>、<font color="firebrick">多语种声音合成</-s>等<font color="darkslategray">更前沿</font>的技术,将<font color="indigo">很快</font>从实验室<font color="blue">走进</font>我们<font color="red">每个人的</font>创作工具箱。 ## <font color="navy">五、结论</font> 这次通过顶级显卡复现Bilibili IndexTTS2的实践,是一次<font color="green">技术与创意</font>的<font color="orange">完美融合</font>。顶级显卡的<font color="purple">海量显存</font>和<font color="teal">澎湃算力</font>,是<font color="brown">驾驭</font>此类<font color="darkgreen">前沿AI模型</font>的<font color="darkred">坚实后盾</font>。它<font color="navy">不仅是</font>性能的<font color="olive">一次飞跃</font>,更是<font color="darkcyan">赋予了</font>开发者和<font color="saddlebrown">创作者</font>将<font color="darkmagenta">最疯狂</font>的<font color="firebrick">想法</font>变为<font color="darkslategray">现实</font>的<font color="indigo">能力</font>。对于每一个<font color="blue">投身于AI浪潮</font>的技术爱好者来说,这无疑是<font color="red">最激动人心</font>的时代。