基于HAI + DeepSeek-R1 + AnythingLLM快速搭建自己的个人知识库

原创基于HAI + DeepSeek-R1 + AnythingLLM快速搭建自己的个人知识库

原创

算法一只狗

发布于 2025-02-06 23:27:05

发布于 2025-02-06 23:27:05

我之前曾经介绍基于腾讯云HAI,在几分钟快速部署一个属于自己的DeepSekk-R1大模型。这里就不再过多描述部署步骤了

详情可以回看我这篇文章:

https://cloud.tencent.com/developer/article/2493602

但是很多读者一直不知道能够用DeepSeek来干嘛,可能通常也就用来进行常规的问答。但是如果你已经拥有了自己的本地大模型,也就是已经具备了实现RAG(Retrieval-Augmented Generation)的所有必要条件。在大模型框架已经相当成熟的今天,我们无需重复造轮子。关键在于,我们只需提出创新的想法和具体的应用场景,然后巧妙地将大模型的能力整合到我们的应用中,便可顺利完成这一过程。

因此我们可以很简单的就基于DeepSeek模型,来搭建属于自己的个人知识库。

RAG背景知识

打造个人知识库,看起来是一个比较酷的内容,特别是针对在工作中积累了很多内容,需要时不时翻找出来。

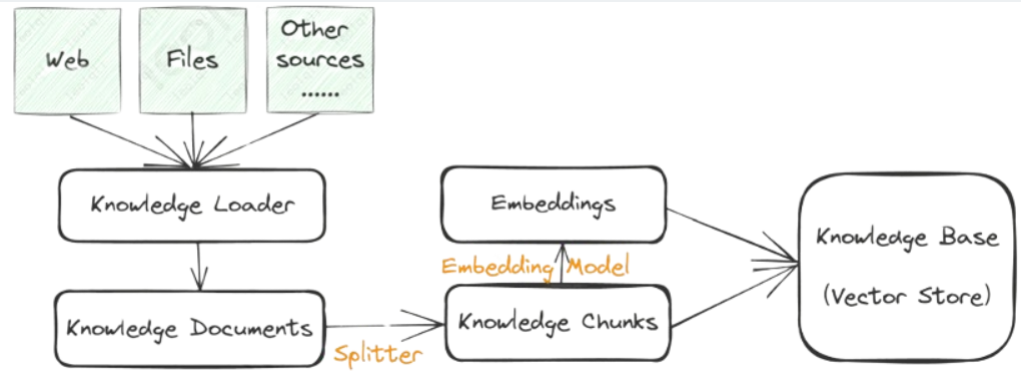

借助于大模型的帮助,在不需要微调的情况下,我们就可以搭建属于自己的知识库。这种技术被称为RAG(Retrieval-Augmented Generation)。简单来说就是通过大模型LLM的能力,在其基础上引入外部的知识库数据,这样大模型AI在回答问题的时候更加的精确。

整体的RAG技术框架包括三个方面:

- 数据索引阶段:构造向量数据库,引入自己的外部数据源

- 检索阶段:根据用户给定的问题,从数据库中找到精确的信息

- 生成阶段:利用检索到的数据库中的信息,生成回答

安装AnythingLLM实现个人知识库

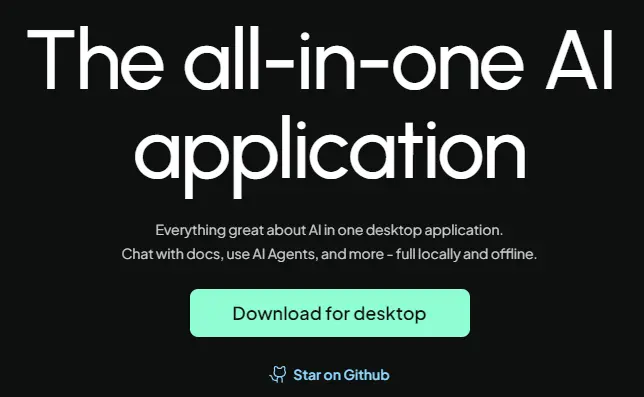

了解了一些简单的RAG知识之后,那么如何构建呢?我们可以直接下载AnythingLLM调用上面我们已经部署好的DeepSeek-R1模型。

第一步,下载并按照AnythingLLM。这个可以直接去到官网,下载桌面版的AnythingLLM软件

第二步,配置基于腾讯云部署好的DeepSeek-R1模型。

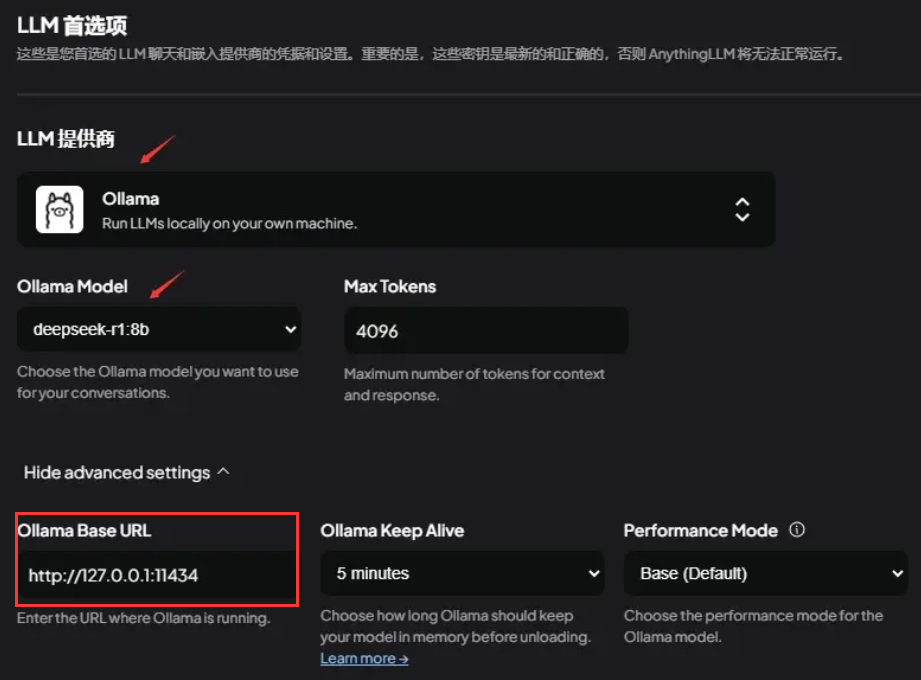

启动AnythingLLM应用程序后,您将在界面的左下角发现设置选项,轻触即可进入设置菜单,进行个性化配置和调整。

下面需要配置DeepSeek-R1的API端口。其中模型可以选择“deepseek-r1:7b”或“deepseek-r1:1.5b”。然后ollama base url填入HAI实例的公网IP,同时将端口号由11434修改为6399。

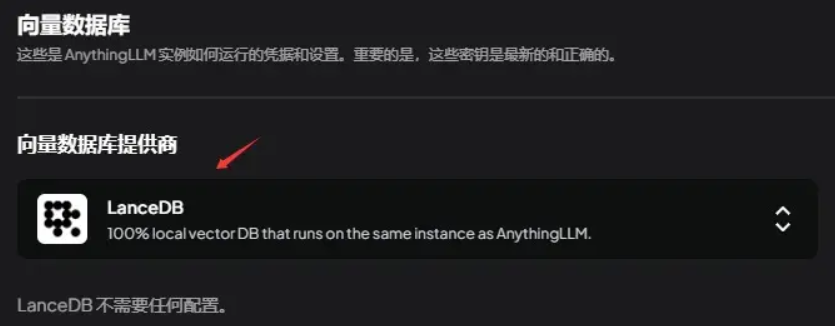

第三步,配置向量数据库

在AnythingLLM的设置界面中,点击“向量数据库”,您可以将向量数据库的配置选择为LanceDB。这一步骤将确保您的应用程序利用LanceDB的高效数据检索能力,

根据上面三个步骤,就可以配置好基于DeepSeek的个人知识库了。

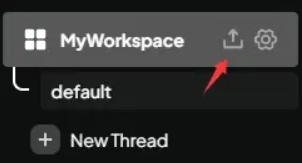

第四步,加入自己的知识文章。

点击下图这个按钮,上传自己的文章

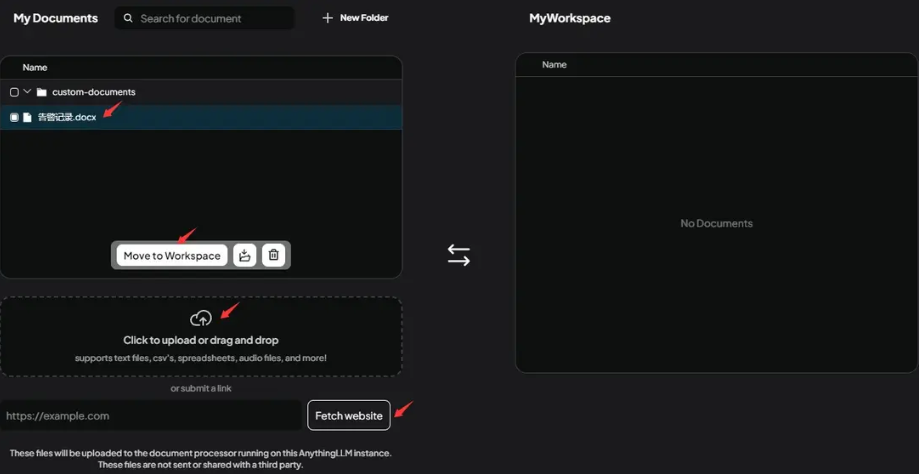

在AnythingLLM中,您拥有灵活的内容添加方式:既可以直接上传文件,也可以输入指定的网页地址。一旦内容成功添加,它们将出现在"My Documents"栏目中,清晰列出以供查阅。若您希望将这些内容纳入当前工作环境,只需在"My Documents"栏目中选中所需项目,随后点击"Move to Workspace"按钮,即可将其整合进您当前的Workspace,便于进一步的操作和分析。这一流程设计旨在提升您的工作效率和内容管理的便捷性。

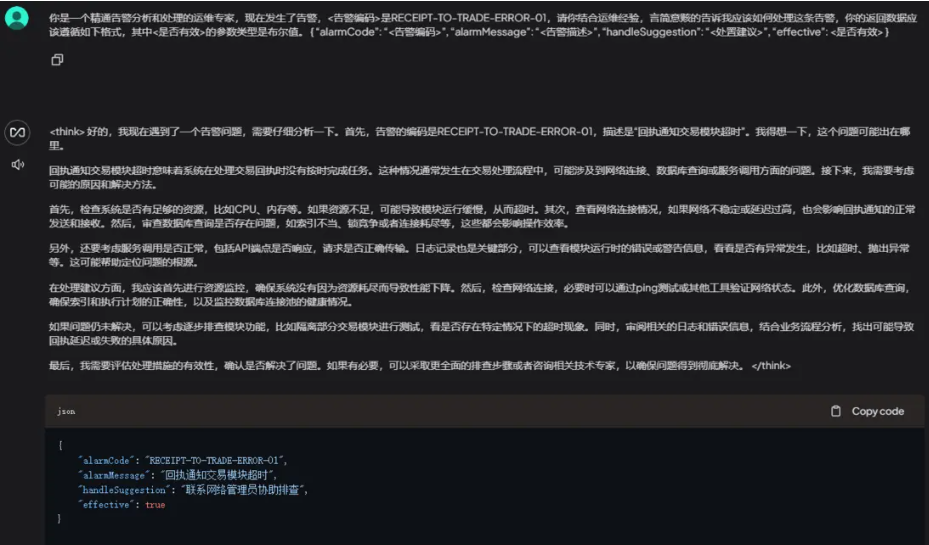

最后可以测试一下添加知识库之后的大模型问答。

写在最后

上面步骤,部署起来其实都比较简单。小白也可以上手尝试一下,其实只要有了本地的大模型调用API,就可以实现更多的玩法,感兴趣的都可以白嫖一下腾讯云部署DeepSeek-R1.

当前,AI生态系统已经日趋成熟,为不同层次的人才提供了广阔的舞台,在AI的浪潮中,每个人都能找到创造价值的机会。展望未来,掌握AI的使用和应用,将如同研发人员必须熟悉数据库和消息中间件一样,成为一项基本而关键的技能。随着AI技术的不断进步和普及,我们期待着一个更加智能和互联的世界。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录