一文带你搞懂AI大模型技术版图

从2022年11月ChatGPT的问世,到现在已经两年有余,AI大模型相关技术在不断的发展,相关的AI智能产品也在不断走向成熟。

不论你是想开发更智能的App辅助自身工作,还是希望不被技术浪潮淘汰,学习AI都像学用电脑一样正在变成必备技能。别被“人工智能”四个字吓到,其实它就像学做菜:掌握几样核心原料(数据),了解常用厨具(算法),再练几道招牌菜(应用场景),你也能用AI做出让人惊叹的“数字料理”。

这篇文章我们就一起来梳理一下AI大模型技术发展至今都出现了哪些相关的技术?这些技术都可以分为哪几类?它们的关系如何?我们如何定位自己想要开发的产品?

AI领域技术栈分类

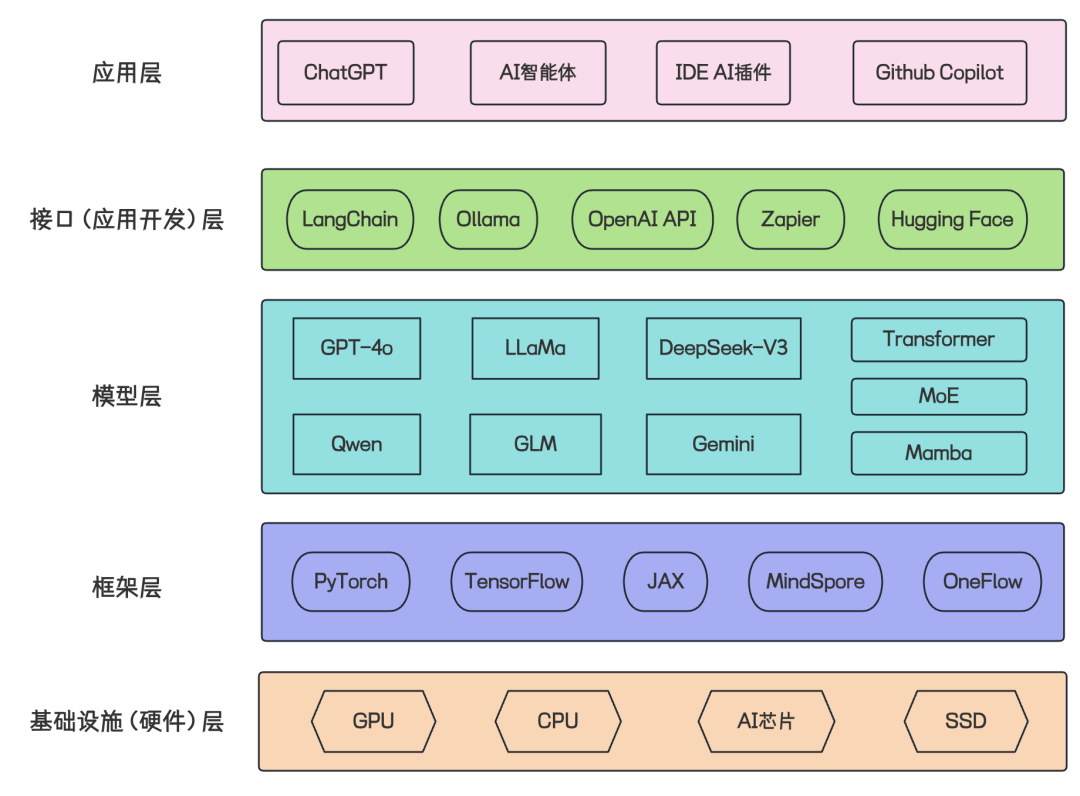

在我明确了相关问题后,与DeepSeek的对话中简要梳理出来了一些AI领域相关技术栈的分类(不完全),并把它梳理成了一张图:

然后我来由下向上解释一下这张图:

1)基础设施层(硬件支撑)

这是AI世界的“钢筋水泥”,提供最底层的算力和存储支持。如果把AI比作一辆跑车,基础设施层就是发动机和油箱——没有它们,再好的算法也跑不起来。

核心组件:GPU(如NVIDIA的A100显卡)、AI专用芯片、高速存储设备(如NVMe SSD)。

这些工具的作用,就像发电厂为城市供电,这些硬件为模型训练和推理提供“动力”。例如,训练GPT-4需要上万块GPU协同工作,而手机人脸识别则依赖芯片的实时计算能力。

2)框架层(开发工具集)

这是开发者的“工具箱”,把复杂的数学计算包装成简单易用的接口。

代表工具:PyTorch、TensorFlow。

核心功能:自动微分(自动计算梯度)、分布式训练(拆分大模型到多卡运行)、模型导出(将训练好的模型变成可部署的文件)。 开发者用PyTorch写几行代码就能构建神经网络,就像用乐高积木搭房子,无需从零制造每个零件。

3)模型层(算法核心)

AI的“大脑”所在,决定了系统能做什么、做多好。 我们还可以进一步做出分类:

- 通用大模型:如GPT-4(聊天、写作全能选手)

- 垂直模型:如DeepSeek-V3(专注数学推理)

- 创新架构:如Mamba(用新方法处理长文本)、MoE(混合专家系统,像多个专业顾问组队工作)

这些预训练好的模型就像“预制菜”——开发者不需要从零训练,下载调整即可使用。例如用Qwen模型快速搭建一个中文客服机器人。

4)接口层(连接桥梁)

让AI能力“接地气”的关键转换层,把复杂的模型变成人人可用的服务。

典型形态:

- 开发接口:OpenAI API(用HTTP调用GPT)、LangChain(串联多个AI工具)

- 本地化工具:Ollama(在个人电脑运行大模型)

- 自动化平台:Zapier(连接AI与日常办公软件)

实际作用:就像手机充电器的转换头——把模型层的“高压电”转换成应用层需要的“安全电压”。例如通过Hugging Face接口,5行代码就能给图片添加AI滤镜。

5)应用层(用户触点)

普通人直接感知的AI形态,把技术转化为实际价值。

典型应用:

- 开发者工具:Github Copilot(写代码时自动补全)

- 生产力增强:IDE插件(用AI检查代码错误)

- 消费级产品:ChatGPT(直接对话的智能助手)

创新趋势:

- AI智能体:能自主完成复杂任务(如自动订机票+规划行程)

- 硬件融合:AI加持的智能眼镜、翻译机等实体设备

这种分层设计让每个环节专注核心能力——就像餐厅后厨分工,有人专攻火候(硬件层),有人负责调味(模型层),最后服务员(应用层)把美味菜肴呈现给食客。

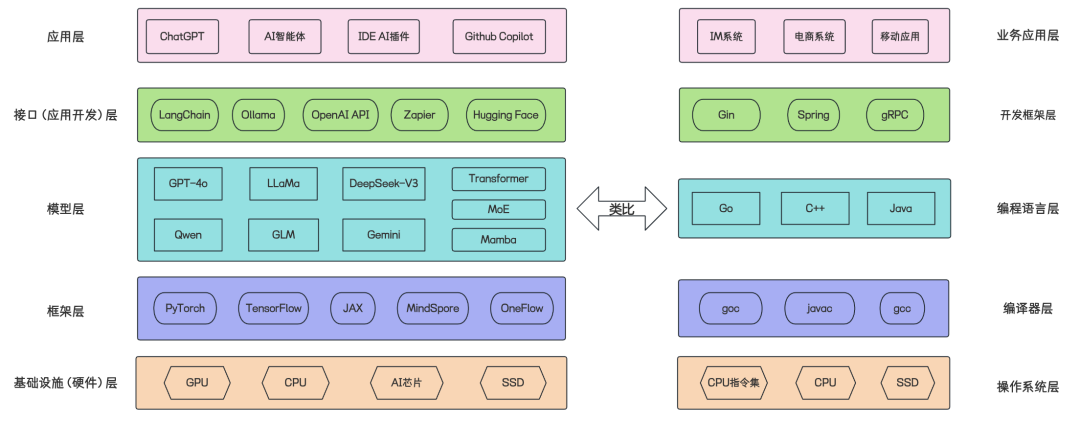

AI技术栈与编程技术栈"类比"

如果对AI技术栈不太了解,但是对编程技术栈有一定了解的同学,下面这张图你理解起来可能会更容易一些:

基础设施层 vs 操作系统层

首先是基础设施上都非常类似,因为计算机硬件、操作系统和CPU指令集往往代表着最高级别的抽象。

框架层 vs 编译器层

往上看,AI大模型技术栈的框架层对应编程技术栈的编译器层,编译器层的第一作用就是,将高级语言转换为机器可执行的底层代码。其次是在编译阶段进行代码优化。

而AI框架层的主要作用就是将用户定义的高层模型转换为底层计算图(如TensorFlow的静态图、PyTorch的动态图)。还有就是在运行时优化计算图执行(如算子融合、内存复用、自动选择最佳硬件后端)。

两者均承担了“将高层逻辑映射到底层执行”的核心职能。编译器是静态代码到机器码的“翻译器”,而AI框架是动态模型到硬件指令的“映射器”。

编程语言层 vs 模型层

编程技术栈的编程语言层,提供开发者编写程序的基础语法和核心能力,并能够通过语言特性(如面向对象、垃圾回收)封装底层复杂性,使开发者专注于逻辑实现。

相对应AI的模型层(GPT-4o、DeepSeek-V3),则主要提供预训练的知识与推理能力(如自然语言理解、代码生成),可直接用于任务解决。通过模型架构(如Transformer)封装海量数据和复杂计算,使开发者无需从头训练模型。两者均为各自技术栈的核心能力提供者。

编程语言是开发者表达逻辑的“工具”,而预训练模型是AI开发者调用智能的“工具”。

接口层 vs 开发框架层

编程领域的开发框架层主要是提供模块化组件、通信协议支持,将底层技术细节(如TCP连接、线程池)抽象为高层API,让开发者聚焦业务逻辑。

而相对的AI的接口层主要就是将模型能力封装,将底层模型的计算复杂性抽象为开发者友好的接口。

应用层 vs 应用层

AI大模型技术栈的应用层与传统编程技术栈的业务应用层在目标上高度一致:直接解决用户需求。

编程领域的业务应用层主要就是基于底层框架(如Spring、Gin)构建,封装业务逻辑。

而AI应用层主要就是基于模型接口层(如OpenAI API、LangChain)构建,封装AI能力,并依赖大模型推理、向量数据库、RAG(检索增强生成)等技术。

通过分层类比,AI大模型技术栈可视为一种以数据为中心、计算密集型的垂直技术栈,而传统编程技术栈是以逻辑为中心、通用化的横向技术栈。两者的融合(如AI原生应用开发)正在成为趋势,例如用LangChain编排业务逻辑,同时调用LLM API实现智能化功能。

分层定位与学习路径

在理解AI大模型技术栈的分层逻辑后,学习和开发过程中需要根据技术栈的分层特点,明确目标定位、选择合适工具并制定针对性策略。

应用层

应用层需要直接面对客户使用,所以重点的能力就是场景适配,即提示工程(Prompt Engineering)和AI智能体的工作流设计。在用户体验方面,需要处理模型输出的不确定性。

接口层

这一层的重点在于模型服务化,比如OpenAI API的流式响应、LangChain的Chain/Agent设计模式。甚至可以使用Ollama工具将AI大模型进行本地化部署。

模型层

从这一层开始,就需要有一些AI的专业能力作为铺垫了,因为可能会涉及到模型架构的概念,比如Transformer的Self-Attention、MoE(混合专家)的路由机制,以及模型训练技术等等。

框架层

在这一层主要的工具就有PyTorch、TensorFlow等,主要用来做张量操作、自动微分(Autograd)、计算图(静态图 vs 动态图)。

此外还有高级封装库,比如Hugging Face Transformers的预训练模型调用、Keras的高层API。

基础层

基础层的内容可能大多数人都不太需要关注到,可以仅作为了解,比如理解GPU/TPU的并行计算原理(如CUDA核心、张量加速),了解cuDNN、OneDNN等加速库的使用场景和DeepSpeed、Megatron的分布式策略(数据并行、模型并行)等等。

小总结

在阅读完这篇文章之后,你是否已经对AI领域的相关技术栈分类有初步的认识?在明确了这些工具之后,后续我们无论是为了个人开发还是团队提效,都可以先做出对自己想要开发的产品作出基本的定位,有了定位之后就可以依照流程做出设计和开发。

对文章内容有哪些疑问,可以在留言区一起讨论。