厉害了!中国科学家最新研究成果,打破中美人工智能硬件差距

厉害了!中国科学家最新研究成果,打破中美人工智能硬件差距

通信行业搬砖工

发布于 2026-03-17 15:02:59

发布于 2026-03-17 15:02:59

这几天,这个小伙伴在谈论咱们东方大国的DeepSeek创始人梁文峰的科学家团队在2026年1月12日晚发表了最新研究成果,DeepSeek的科学家团队和北大的研究人员提出了一种新的模型训练方法。他们表示,该技术通过绕过GPU内存限制,能够实现“激进的参数扩展”,通俗的说“将简单查询从昂贵的GPU算力推理转移到CPU,从而极大减少大模型对GPU推理算力的需求”,他们用技术突破再次震撼了全球科技圈。

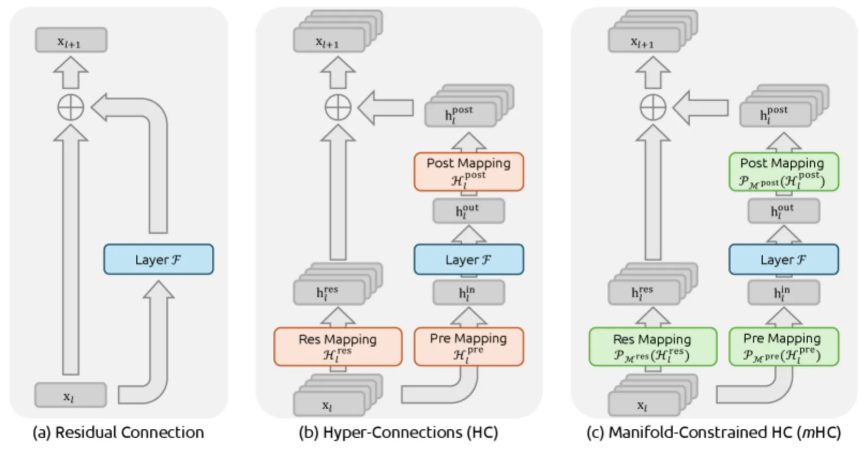

说起咱们东方大国的科学家团队在短短的一年内,凭借其在人工智能大模型领域的创新,一次次打破国外巨头的技术壁垒,展示了咱们国家的科学家们在高科技领域崭露头角的实力。他们在2026年元旦在外网发表名称为《mHC: Manifold-Constrained Hyper-Connections》的技术论文,该文章的核心观点是提出一种名为“mHC”(直译为“流形约束超连接”)的框架,该框架改进了此前大模型训练中一种名为“HC(Hyper-Connections,超连接)”的范式,对大规模模型训练提供了切实的性能改进。

北京时间2026年1月1日,DeepSeek团队在arXiv(预印本)网站和Hugging Face上同步发布了最新论文,名为《mHC: Manifold-Constrained Hyper-Connections》,论文的核心观点是提出一种名为“mHC”(直译为“流形约束超连接”)的框架,该框架改进了此前大模型训练中一种名为“HC(Hyper-Connections,超连接)”的范式,对大规模模型训练提供了切实的性能改进。 新京报官微

DeepSeek在创始人梁文锋的带领下,这家公司极其低调,科学家团队一直潜心学术,未做过多的商业化尝试,一心扑在基础模型理论研发之上,梁文锋还在近期入选了《自然》2025年影响科学发展十大人物。

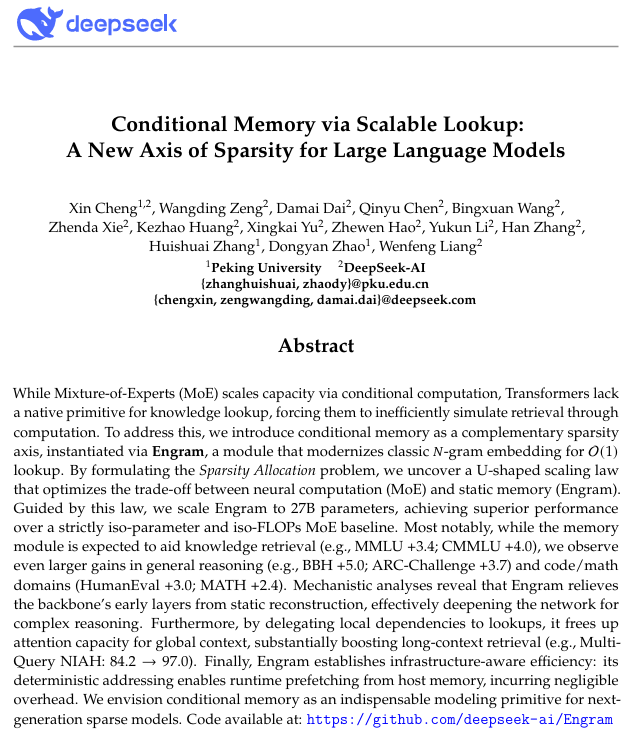

“百尺竿头更进一步”他们在2026年1月12日晚发布的论文《Conditional Memory via Scalable Lookup: A New Axis of Sparsity for Large Language Models》更是为AI大模型领域带来了前所未有的突破。什么是“条件记忆”?它如何解决现有大模型的“内存瓶颈”?这项技术又如何在DeepSeek的创新之路上构建出“真正中国自主创新”的技术框架?

从2025年DeepSeek强势发布以后,当我们面对全球AI大模型发展态势时,显然人工智能这个领域已经不再是欧美巨头一手独大的格局了。2026年DeepSeek凭借其“条件记忆”技术,已经向世界证明,世界东方这个伟大民族的科学家们不仅能够“追赶”欧美先进技术,更能“引领”未来人工智能的技术创新。就在这篇论文发布之后,全球AI技术大厂的研发团队和很多研究机构或许都感受到了来自咱们国家科技进步的巨大的压力,特别是在大模型内存优化和计算架构上,DeepSeek的“条件记忆”技术,可以“将简单查询从昂贵的GPU算力推理转移到CPU,从而极大减少大模型对GPU推理算力的需求”,通过对软件架构创新来降低对算力需求,可以有效降低对GPU算力网卡的需求,打破传统推理架构受到美国英伟达高性能GPU硬件算力“卡脖子”的困局。

在这篇文章里,我们将详细剖析DeepSeek的最新突破,看看这项技术如何打破传统架构的束缚,如何通过条件记忆的设计,彻底颠覆我们对大模型的理解。同时,我们也将对比全球领先的AI技术,尤其是OpenAI的ChatGPT、Google的Gemini系列以及国内顶尖的大模型阿里Qwen的技术参数和架构,看看DeepSeek如何在竞争中找到了自己的独特优势。

咱们说到DeepSeek的成功并非偶然。从一开始,梁文峰的科学家团队就以技术为核心,瞄准了我们国内目前大模型面临老美“卡脖子”限制高端GPU显卡出口给咱们国家,带来的“内存管理与计算能力”的最大瓶颈。特别是在国外GPU内存不断趋于饱和的今天,国内的GPU硬件对标美国的同行提升空间非常之大的困境之下,DeepSeek的科学家们发挥咱们民族的聪明智慧,通过独创的条件记忆技术,成功让简单的知识查找不再依赖于高性能的GPU,而是通过CPU内存来实现。这一创新不仅让大模型的训练和推理效率提升,更为硬件GPU节省算力性能,为大模型受制于大漂亮的“高性能GPU芯片”带来了新的解决方案。

说到这里,很多读者会好奇的说:什么是“条件记忆”?

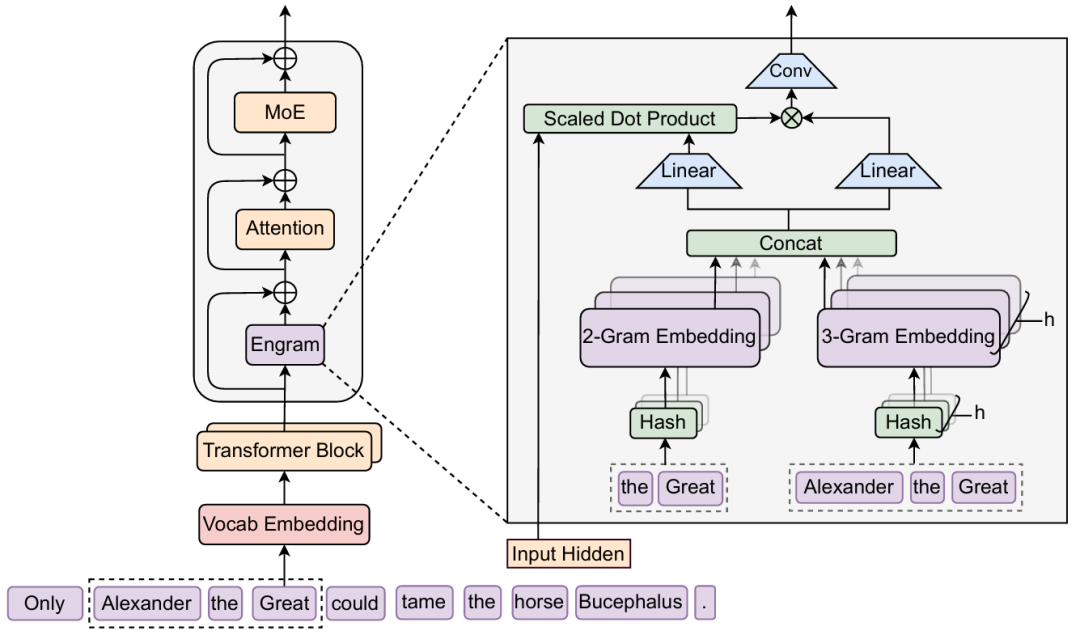

咱们就来说说这项技术,在传统的Transformer架构中,静态信息的检索通常是通过计算来实现的,这种方式不仅浪费了大量的计算资源,还使得模型在处理长时间依赖的上下文时,面临着GPU内存性能瓶颈。DeepSeek通过“条件记忆”技术,将静态知识的查找从GPU内存转移到更为廉价的CPU内存上,极大地缓解了内存压力,更重要的是,这一技术打破了GPU内存的局限,使得大模型可以在不牺牲计算能力的前提下,大幅提升模型参数的规模,进而实现更强大的推理能力。

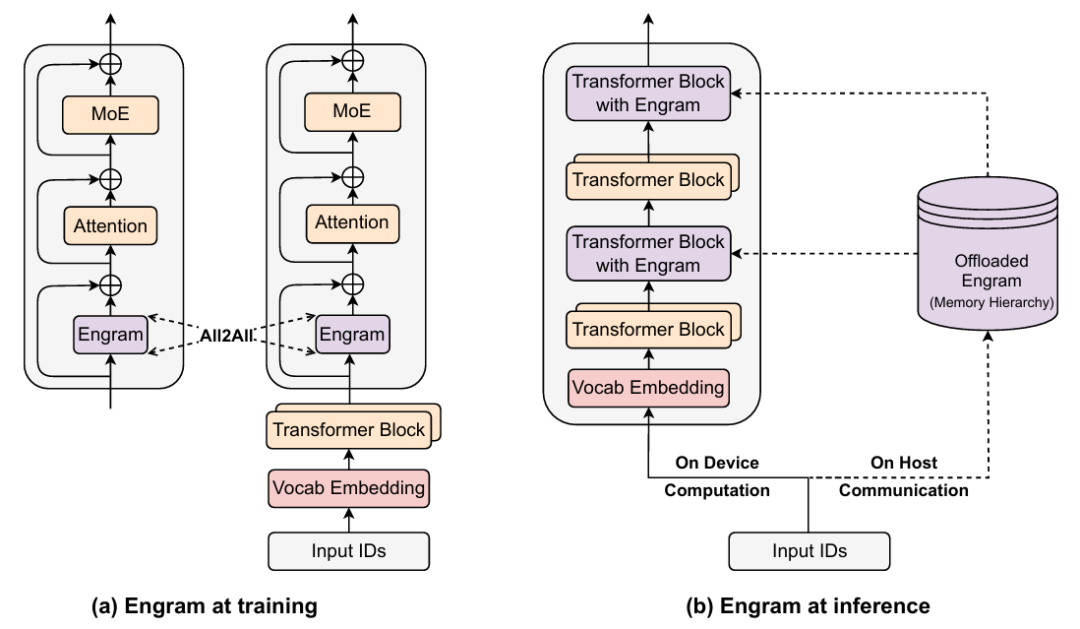

(如图,DeepSeek科学家团队提出的Engram架构)

DeepSeek提出的Engram架构,正是这一技术的具体体现。与Mixture of Experts(MoE)架构相结合,Engram通过条件记忆的方式,为每个模型输入提供快速的静态知识检索。通过这种“稀疏”技术的引入,DeepSeek成功优化了GPU内存的使用,将大量静态信息从GPU中剥离,转而利用更为低成本的CPU内存进行存储和查找,这就像一把锋利的刀,切割开了传统大模型计算中难以绕过的GPU内存瓶颈。

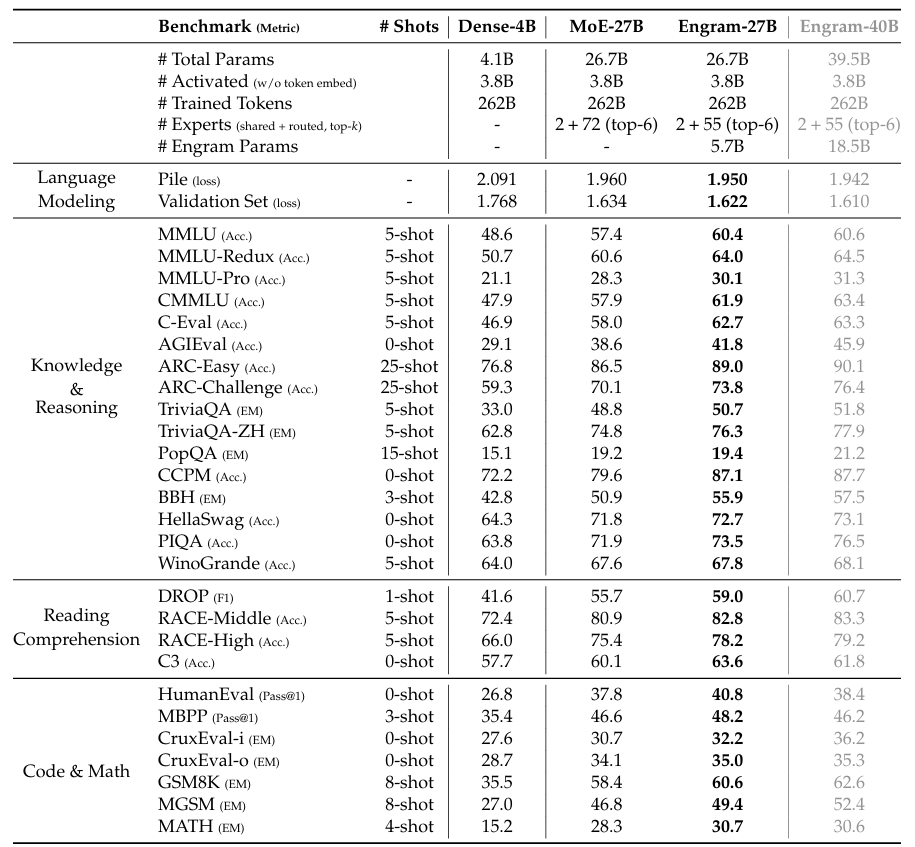

咱们再来看一下这项技术的实际表现。DeepSeek的研究团队在27B参数的模型上进行验证时,发现通过引入Engram模块,模型的长时效性推理和复杂推理任务的性能得到了显著提升。例如,在MMLU和CMMLU等多个基准测试中,模型的准确率分别提升了3.4和4.0个百分点,而在代码推理和数学推理任务中,DeepSeek的模型也展现出了明显的优势,HumanEval和MATH测试中的成绩提升幅度达到3.0和2.4个百分点。

这些成绩,足以证明条件记忆在提升大语言模型推理能力方面的巨大潜力。

与传统的MoE架构相比,DeepSeek的条件记忆技术不仅突破了GPU内存瓶颈,还通过解耦计算和存储,降低了训练和推理的成本。这种创新不仅让大模型可以在硬件资源有限的情况下继续扩展参数规模,还通过合理的稀疏计算和内存管理,最大化了硬件的使用效率,更重要的是这一技术的应用并非局限于中国市场,它已经开始对全球AI行业产生深远的影响,尤其是在低成本、高效能的技术创新上,DeepSeek已经超越了很多欧美同行。

与漂亮国OpenAI的ChatGPT相比,DeepSeek的条件记忆技术在内存管理和推理效率上有着明显的优势。

- ChatGPT作为一个经典的Transformer模型,虽然在参数规模和模型能力上处于领先地位,但它在长时间依赖的上下文推理中,依然面临着巨大的内存压力,每一次推理任务都需要消耗大量的GPU内存,这无形中增加了计算成本。

- DeepSeek通过条件记忆的设计,让大模型能够更有效地处理长时效性任务,在不增加计算负担的情况下,提升推理性能,这也让DeepSeek在成本控制上展现出了更强的优势。

与Google的Gemini模型相比,DeepSeek的条件记忆技术则更具“硬核”优势。

- Gemini采用了类似MoE的架构,并且在处理多模态任务时有着不错的表现。但在纯文本推理和大规模上下文推理时,Gemini面临的内存瓶颈问题与DeepSeek不相上下。

- DeepSeek的条件记忆设计通过将静态信息查找和动态推理解耦,不仅有效提升了推理能力,还实现了内存管理的最优解。这使得DeepSeek在未来的大规模模型训练和推理中,能够以更低的成本,提供更强大的推理能力。

至于阿里Qwen,这款国内领先的大语言模型,在中文语境下的表现堪称顶尖。但与DeepSeek相比,Qwen的技术架构更多依赖于强大的GPU硬件支持和高性能的内存系统。Qwen虽然在训练和推理速度上具备优势,但在内存扩展性和模型规模扩展上,可能受到硬件限制。DeepSeek通过条件记忆的创新设计,打破了这种硬件限制,展现了中国AI技术在低成本、高效能领域的独特优势。

所以说DeepSeek的创新不仅改变了大模型的架构设计,更是在全球AI竞争中为我们伟大的国家赢得了话语权。在面对“卡脖子”带来的硬件资源受限、内存成本飙升的背景下,DeepSeek通过条件记忆技术,成功实现了低成本、高性能的大模型训练和推理,不仅为国内AI技术发展提供了全新的思路,也为全球AI技术格局的变革带来了新的可能。

如果我们将目光投向未来,DeepSeek的条件记忆技术无疑将成为AI领域的新标杆。随着条件记忆模块的进一步发展,我们有理由相信,AI技术将进入一个全新的阶段。在这一阶段,硬件和软件将更加紧密地结合,模型将更加高效、灵活,人工智能也将迎来更为广泛的应用。

所以说DeepSeek的崛起,不仅是咱们伟大的国家在人工智能领域长期深耕带来了AI技术大发展的缩影,更是为全球科技创新中“后发国家”如何突破“硬件封锁限制”的条件下,如何打破“先发国家”封锁的一股强劲力量。在未来,DeepSeek将继续用技术突破来屏蔽东方大国与漂亮国在硬件差异带来的影响,用创新成果来引领国内AI大模型行业的发展,这场AI领域的“技术革命”,无疑将改变全球科技版图,DeepSeek,或许正是夜空中最亮的那一颗星。

参考资料:

1、Conditional Memory via Scalable Lookup:ANewAxisofSparsity for Large Language Models

https://github.com/deepseek-ai/Engram/blob/main/Engram_paper.pdf

2、DeepSeek开源大模型记忆模块!梁文锋署名新论文,下一代稀疏模型提前剧透

https://www.thepaper.cn/newsDetail_forward_32374372

全文完,感谢阅读,如果喜欢请三连。

#deepseek #MOE架构 #梁文峰 #大模型 #deepseek最新突破

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读