让机器学习 Pipeline 更稳的 5 个 Python 装饰器代码

让机器学习 Pipeline 更稳的 5 个 Python 装饰器代码

deephub

发布于 2026-05-15 20:54:00

发布于 2026-05-15 20:54:00

AI 项目的代码膨胀速度很快。跑通原型后过几周就会塞满 API 调用、模型 Pipeline、重试、日志、缓存和各种校验逻辑。

函数被各种边角任务塞满,反而不再专注于核心的逻辑。所以有经验的 Python 工程师会大量使用装饰器老解决这个问题

装饰器让代码可复用、可扩展,写出来的 AI 应用也更整洁,不必把同样的逻辑在每个函数里再抄一遍。

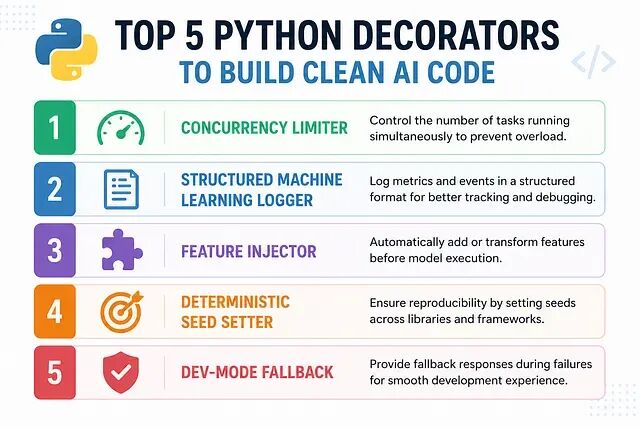

下面介绍 5 个适合现代 AI 开发流程的 Python 装饰器。

为什么 Python 装饰器在 AI 开发里值得重视

AI 系统里常见的错误有以下几种:LLM 调用失败时的 API 重试、模型性能指标的日志、并发 AI 请求的限流、ML Pipeline 的特征注入、开发阶段的 Fallback 处理。

把这些行为集中到可复用的装饰器里,比每个函数都写一份要省事得多。带来的好处也有很多,比如在生产环境里更容易横向扩展;调试机器学习实验时更省力;面对复杂的分布式 AI 架构也更好维护;遇到不稳定的基础设施负载时表现更稳。

1、并发限制器(Concurrency Limiter)

AI 应用经常需要并行处理多个请求。没有限流的话,GPU、API 或者推理服务很容易被打爆。

并发限制器的作用是限制同时执行的任务数量,让系统更稳,也减少基础设施侧的故障。

实现思路是用信号量(Semaphore)卡一个上限,只允许固定数量的任务同时运行,剩下的排队等待。

import threading

import time

semaphore = threading.Semaphore(3)

def concurrency_limit(func):

def wrapper(*args, **kwargs):

with semaphore:

print(f"Running {func.__name__}")

return func(*args, **kwargs)

return wrapper

@concurrency_limit

def process_ai_task(task):

print(f"Task {task} started")

time.sleep(2)

print(f"Task {task} completed")为什么重要

- 在多请求并发的大型推理负载下,避免 GPU 显存被压爆

- 减少因不受控的并行请求导致的 API 速率限制失败

- AI 聊天机器人或推荐系统在高峰流量时更不容易出问题

2、结构化机器学习日志器(Structured Machine Learning Logger)

机器学习项目的日志量很大。规模一上去,散落各处的 print() 就基本不可维护了。

结构化日志器把训练和推理的数据整理成机器可读的格式,比如 JSON。结构化日志在 AI Pipeline 上能直接改善调试、监控和可观测性。

import time

import json

from functools import wraps

def ml_logger(func):

@wraps(func)

def wrapper(*args, **kwargs):

start = time.time()

result = func(*args, **kwargs)

log = {

"function": func.__name__,

"execution_time": round(time.time() - start, 2),

"status": "success"

}

print(json.dumps(log, indent=4))

return result

return wrapper

@ml_logger

def train_model():

time.sleep(2)

return "Training Complete"为什么重要

- 分布式训练和推理过程中,调试机器学习工作流会轻松不少

- 性能瓶颈更容易被看见,生产环境 AI 系统的可靠性和响应一致性更好把控

- 适配企业级 AI 基础设施里那种可扩展的可观测性 Pipeline

3、 特征注入器(Feature Injector)

机器学习系统里直接用原始数据通常效果一般。模型一般要求先做一层特征工程或者补充字段,再进预测。

特征注入器在模型执行前自动加上这些衍生数据。把特征工程和预测逻辑拆开,可维护性会好很多。

from functools import wraps

def feature_injector(func):

@wraps(func)

def wrapper(data):

data["salary_per_age"] = (

data["salary"] / data["age"]

)

data["is_high_income"] = (

data["salary"] > 100000

)

return func(data)

return wrapper

@feature_injector

def predict(data):

print(data)

predict({

"age": 25,

"salary": 50000

})为什么重要

- 把特征工程从核心预测逻辑里剥离出来

- 多个 AI 模型 Pipeline 间重复出现的预处理代码会少很多

- 推荐系统、欺诈检测引擎以及预测分析架构的扩展工作更直接

4、 确定性种子设置器(Deterministic Seed Setter)

机器学习里最让人头痛的事情之一,是模型行为不一致——同一份训练代码,因为随机性可能跑出不同的结果。

确定性种子设置器跨多个库统一控制随机性,让结果可复现。基准测试、问题定位以及可信的机器学习实验,都建立在可复现这个前提上。

import random

import numpy as np

from functools import wraps

def deterministic_seed(seed=42):

def decorator(func):

@wraps(func)

def wrapper(*args, **kwargs):

random.seed(seed)

np.random.seed(seed)

return func(*args, **kwargs)

return wrapper

return decorator

@deterministic_seed(seed=42)

def train_model():

print(random.randint(1, 100))

print(np.random.rand())为什么重要

- 多次训练、不同测试环境之间的机器学习实验结果保持一致

- 超参数搜索和基准评估时,模型之间的比较更公平

- 因为随机初始化不受控制而出现的神经网络异常,调试起来更省事

5、开发模式 Fallback(Dev-Mode Fallback)

AI 系统经常依赖外部 API 和云基础设施。开发期间这些服务时不时会挂掉。

开发模式 Fallback 在调用失败时返回一个安全的 Mock 响应,避免应用直接崩溃。开发环境有这种韧性,效率提升相当明显。

from functools import wraps

DEV_MODE = True

def dev_fallback(mock_response):

def decorator(func):

@wraps(func)

def wrapper(*args, **kwargs):

try:

return func(*args, **kwargs)

except Exception as e:

if DEV_MODE:

print(f"Fallback activated: {e}")

return mock_response

raise e

return wrapper

return decorator

@dev_fallback(

mock_response="Mock AI response"

)

def call_llm():

raise Exception("API unavailable")为什么重要

- 外部 AI API 或基础设施不稳定时,开发流程不会被打断

- 后端 AI 系统没完全就绪,前端团队也能照常测试

- 离线开发、临时停机以及实验性 ML 部署流程下都更稳

总结

本文涉及的五个装饰器——Concurrency Limiter、Structured Machine、Feature Injector、Deterministic Seed Setter 以及 Dev-Mode Fallback,是现代 AI 工程里相当实用的几种模式。

Python 装饰器让整个系统仍然可维护,把基础设施层的关注点从机器学习逻辑里剥离出来。无论是搭 LLM 应用、推荐系统、AI Agent,还是预测分析 Pipeline,装饰器都能在架构层面带来明显改善。

by Ajaymaurya

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-05-13,如有侵权请联系 cloudcommunity@tencent.com 删除

本文分享自 DeepHub IMBA 微信公众号,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文参与 腾讯云自媒体同步曝光计划 ,欢迎热爱写作的你一起参与!

评论

登录后参与评论

推荐阅读

目录