在Elastic AI Assistant 中使用本地部署的 LLM(Llama3)

原创在Elastic AI Assistant 中使用本地部署的 LLM(Llama3)

原创

在现代企业中,人工智能和机器学习的应用越来越广泛。Elastic AI Assistant 是一个强大的工具,能够通过连接大语言模型(LLM)来集成人工智能技术,帮助企业提升数据处理能力,简化操作流程,实现智能化的决策支持。目前,Elastic AI Assistant 支持通过连接器连接到 Amazon Bedrock 和 OpenAI。

然而,对于大多数企业而言,在处理敏感或保密数据时,对数据的绝对控制权至关重要。使用公共LLM服务可能意味着您的数据必须离开您的网络,并通过互联网传输到第三方供应商。这可能会增加数据泄漏或被非法访问的风险。因此,将LLM部署在自己的环境中,通过本地的 LLM 来达成 AI 应用的目的,成为不少企业的主要诉求。

本文将主要介绍如何使用 Elastic AI Assistant 与本地部署的 LLM(Llama3)进行集成。

什么是 Elastic AI Assistant?

Elastic AI Assistant 是一个智能助手,旨在增强 Elastic Stack 的功能。通过连接外部的 LLM,Elastic AI Assistant 可以直接读取 Elasticsearch 索引中或 Kibana 界面上正在分析的数据,提供更智能的搜索结果、自动化分析和数据处理能力。它通过连接器(Connectors)与各种 LLM 提供商集成,用户可以轻松地选择和切换不同的模型。

如何使用本地部署的 LLM(Llama3)

尽管默认情况下,Elastic AI Assistant 只支持 Amazon Bedrock 和 OpenAI,但由于大多数 LLM 都兼容 OpenAI 的 API,我们可以利用 Ollama 工具在本地部署 Llama3 模型,并通过 API 访问它。

部署 Llama3

- 安装 Ollama 工具:

下载并安装 Ollama 工具,确保可以在命令行中运行

ollama命令。 - 运行 Llama3 模型: 通过以下命令在本地运行 Llama3 模型:ollama run llama3

- 配置 Ollama 监听所有接口: 使 Ollama 在所有网络接口上监听,确保可以通过网络访问:OLLAMA_HOST=0.0.0.0 ollama serve

配置 Elastic AI Assistant

在 Kibana 中配置连接器

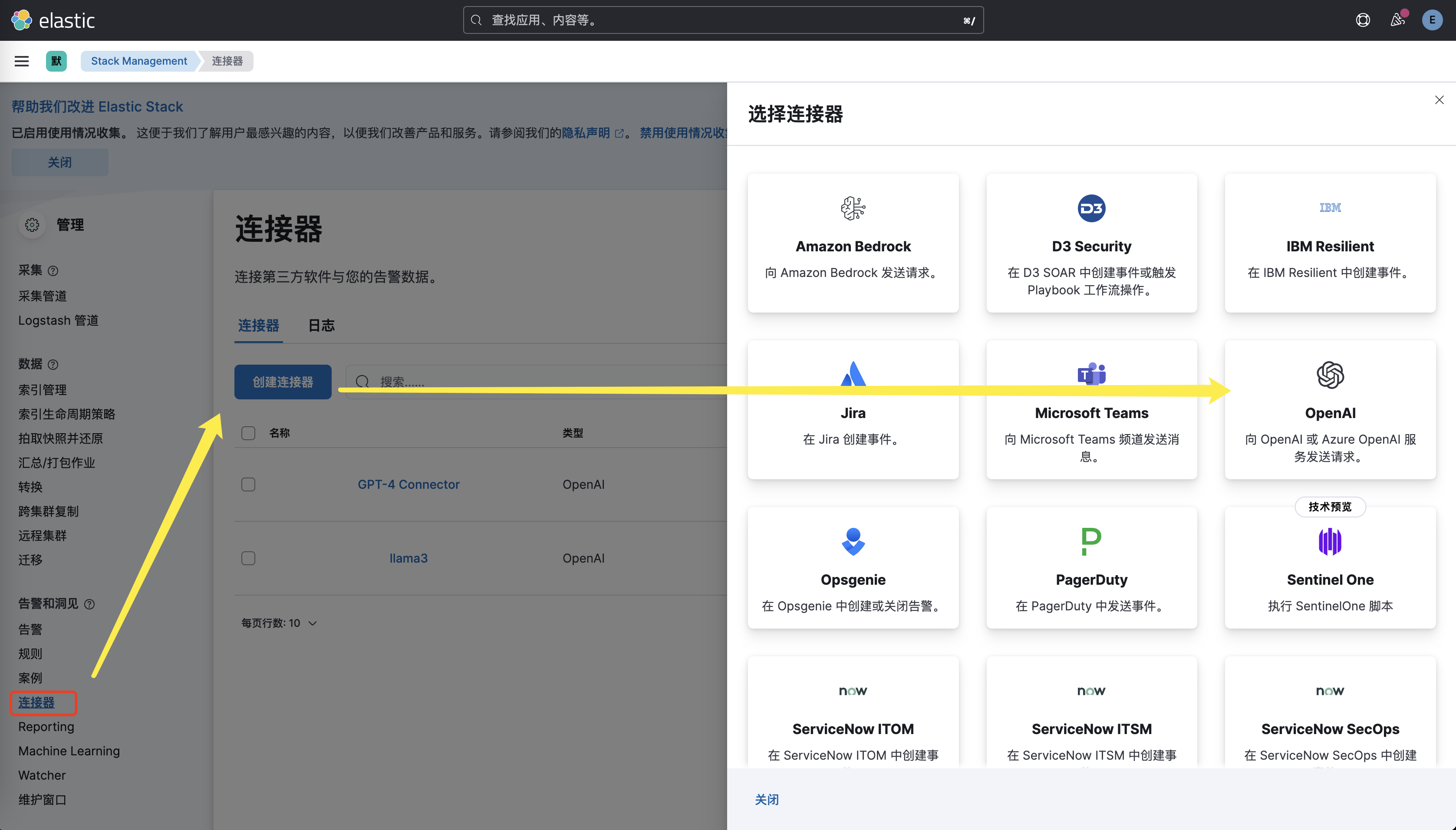

- 创建连接器: 打开 Kibana 的管理界面,进入 "Management" -> "Alerts and Insights" -> "Connectors"。点击 "Create connector"。

- 选择 OpenAI 连接器: 在弹出的窗口中,选择 OpenAI 连接器。

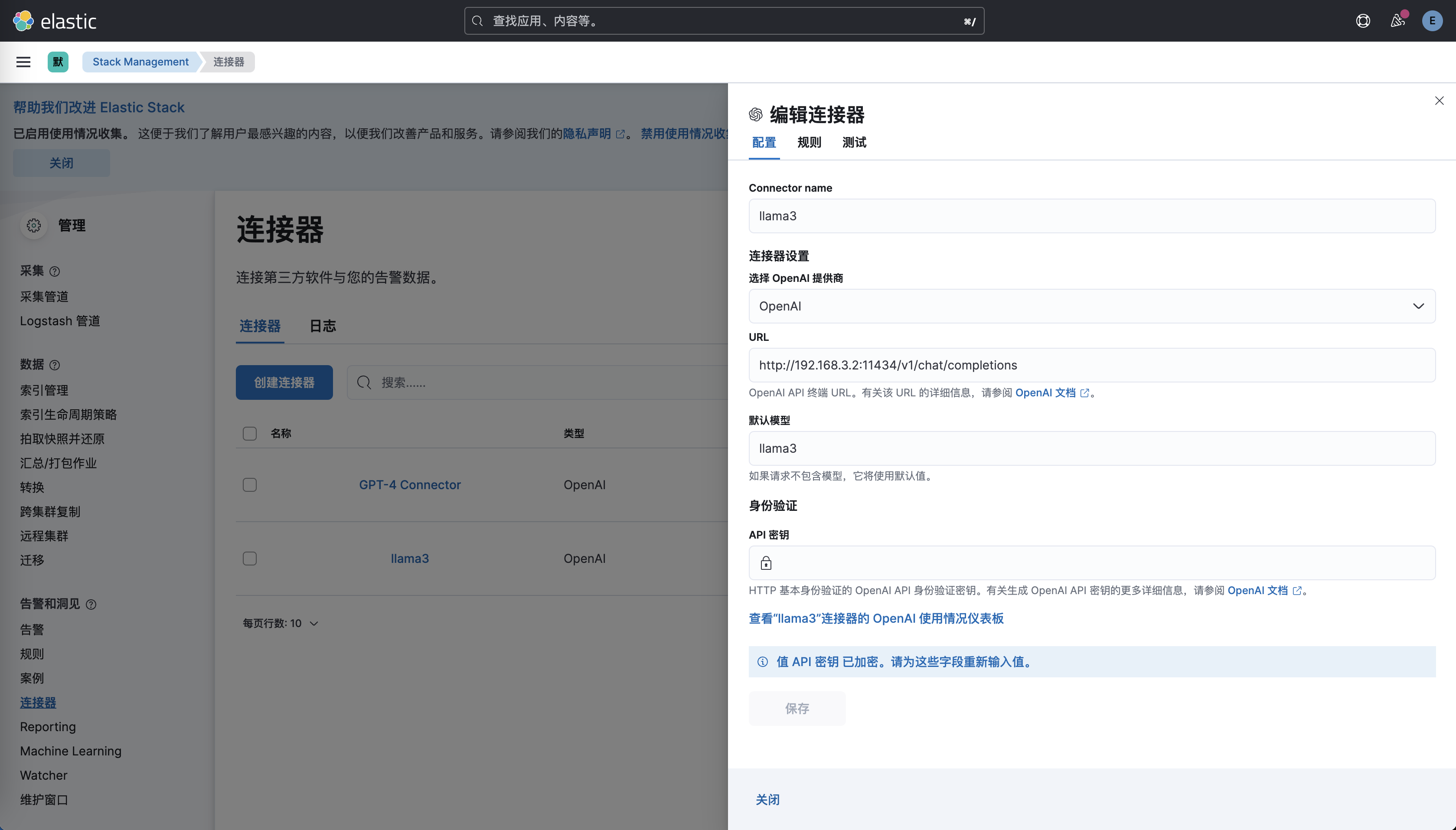

- 配置连接器:

填写连接器信息,包括名称和 API URL。对于本地部署的 Llama3,配置如下:

- URL:

http://192.168.3.2:11434/v1/chat/completions - 默认模型:

llama3(填入你通过 ollama 启动的模型)

- URL:

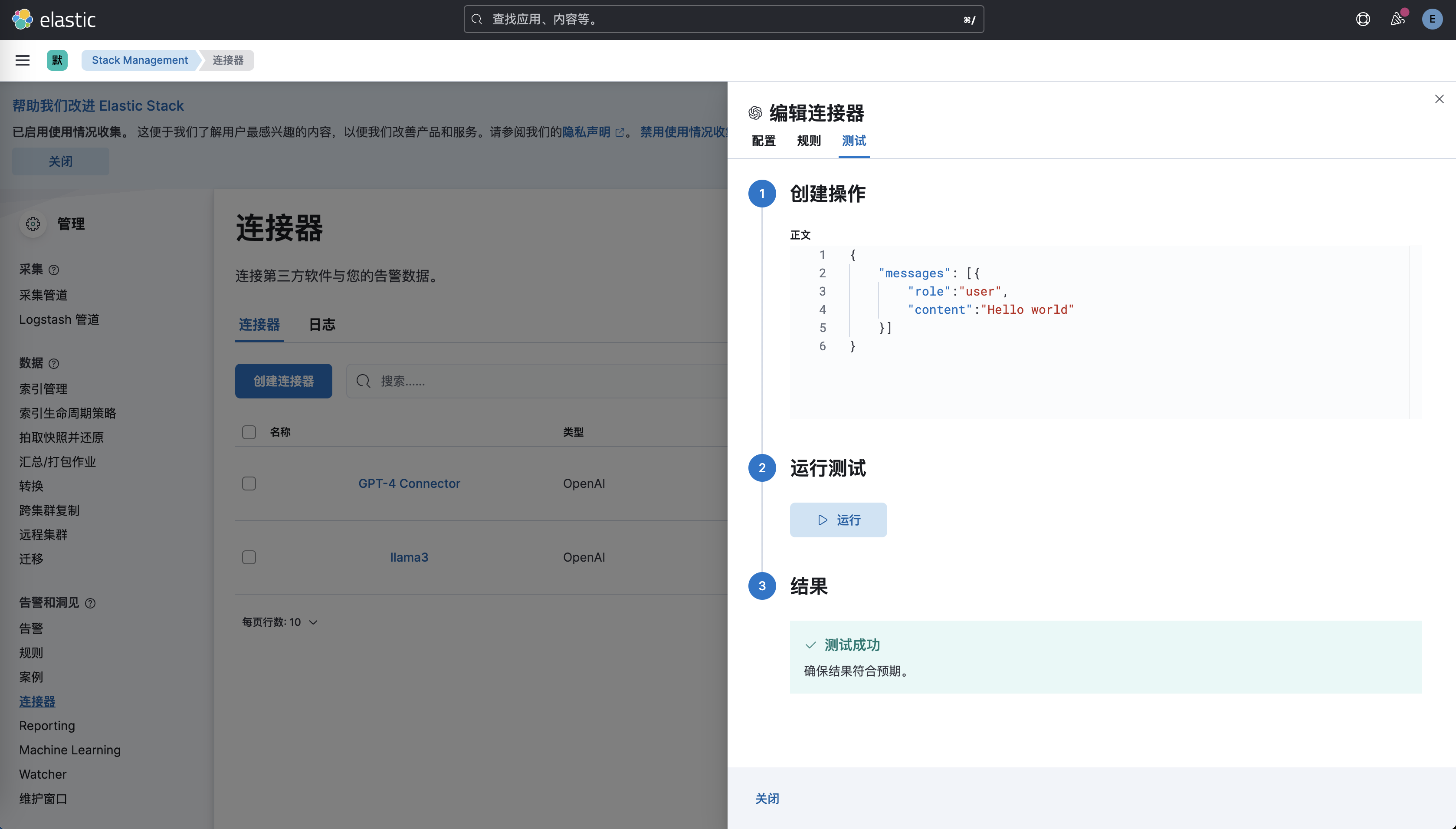

- 保存连接器: 输入任意 API 密钥,然后保存连接器配置。并可进行测试验证联通性:

在 AI Assistant 中选择本地连接器

在配置完成后,你可以在 Elastic AI Assistant 中选择刚刚配置的本地连接器,以便使用本地部署的 Llama3 模型处理数据请求。

总结

通过以上步骤,你可以将本地部署的 LLM(Llama3)与 Elastic AI Assistant 集成,充分利用本地计算资源和自定义模型的优势。这种方法不仅提供了更灵活的部署选项,还能确保数据隐私和安全性。希望这篇博客能帮助你更好地理解和使用 Elastic AI Assistant 与本地 LLM 的集成。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。