DeepSeek-Open WebUI部署

前面部署了vLLM版本以后,访问它比较麻烦。如何才能更好的实现访问呢,这个就是我们今天要讲的Open WebUI,它可以向我们使用官方DeepSeek一样直接在网页进行对话。

OpenWeb UI 是一个功能丰富且用户友好的自托管 Web 用户界面,主要用于管理和操作各种本地和云端的人工智能模型。它支持多种大型语言模型(LLM)运行程序,包括 Ollama 和兼容 OpenAI 的 API,旨在完全离线操作。以下是关于 OpenWeb UI 的详细介绍:

主要特点

- 用户界面:直观且响应式,可在任何设备上提供卓越的体验。支持多种主题和自定义选项,满足个人喜好。

- 性能:快速响应和流畅的性能,即使在处理复杂任务时也是如此。支持多模型和多模态交互,实现更强大的功能。

- 功能:包括全面 Markdown 和 LaTeX 支持,本地 RAG 集成,Web 浏览功能,提示预设,RLHF 注释,对话标记,模型管理功能,语音输入和文本转语音,高级参数微调,图像生成集成等。

- API 支持:支持 OpenAI API 和其他兼容 API,扩展其功能。

安装和使用

- 安装:通过 Docker 或 Kubernetes(如 kubectl、kustoize 或 helm)无缝安装,支持 ollama 和 cuda 标记的图像。

- Ollama/OpenAI API 集成:轻松集成与 OpenAI 兼容的 API,与 Ollama 模型一起进行多功能对话。

- Pipelines 插件支持:使用 Pipelines 插件框架将自定义逻辑和 Python 库无缝集成到 Open WebUI 中

1.创建conda 虚拟环境

conda create --name openwebui python=3.12.92.安装Open WebUI

pip install open-webui -i https://mirrors.aliyun.com/pypi/simple/3.启动Open WebUI

# 禁用OLLAMA API

export ENABLE_OLLAMA_API=False

# 设置OpenAI API的基础URL为本地服务器

export OPENAI_API_BASE_URL=http://127.0.0.1:8000/v1

# 设置默认模型路径

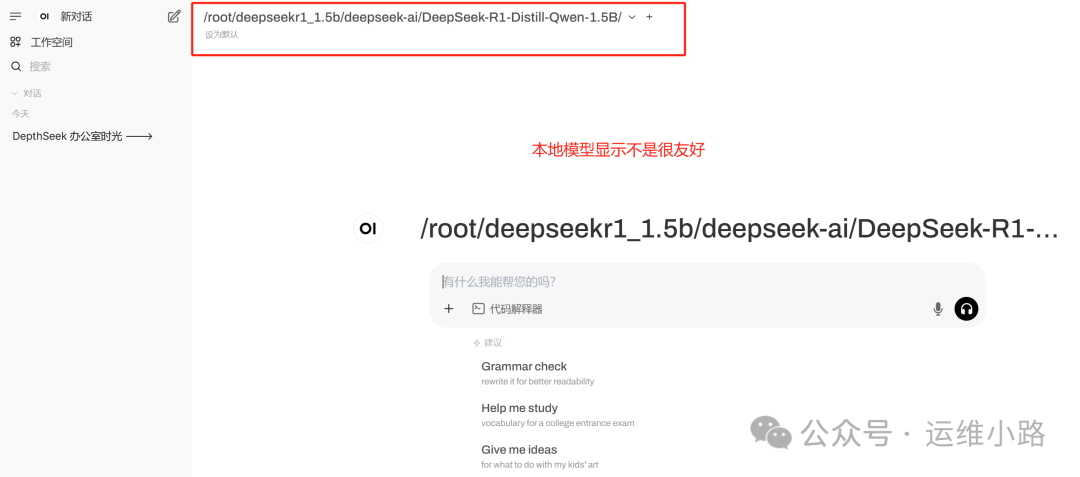

export DEFAULT_MODELS="/root/deepseekr1_1.5b/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B"

# 启动Open WebUI

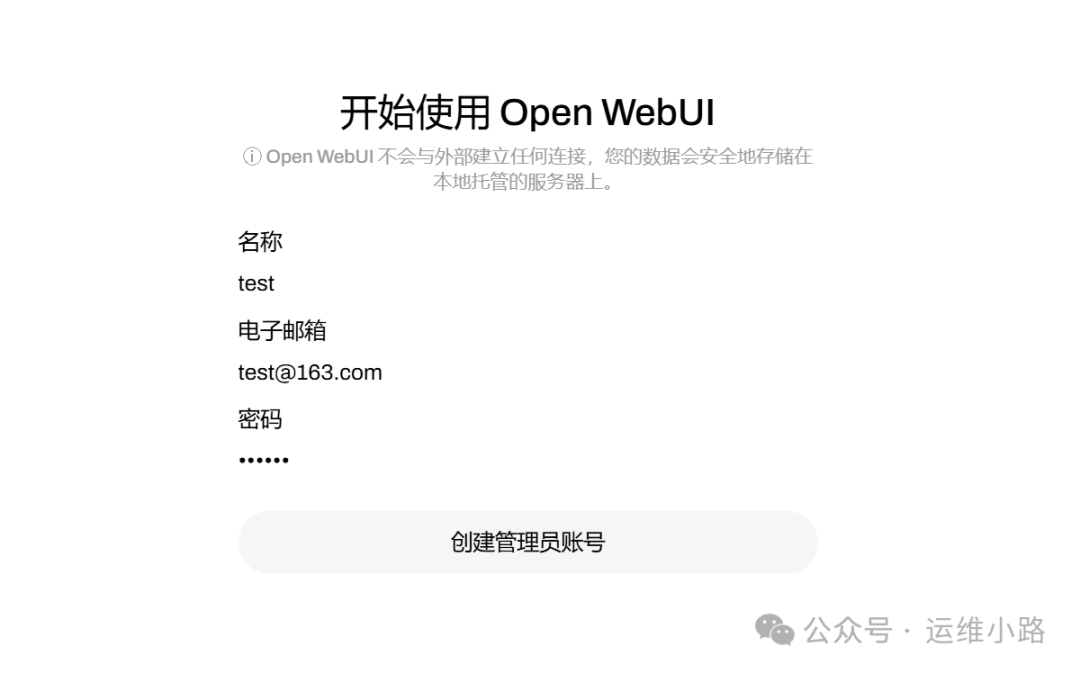

open-webui serve4.配置Open WebUI

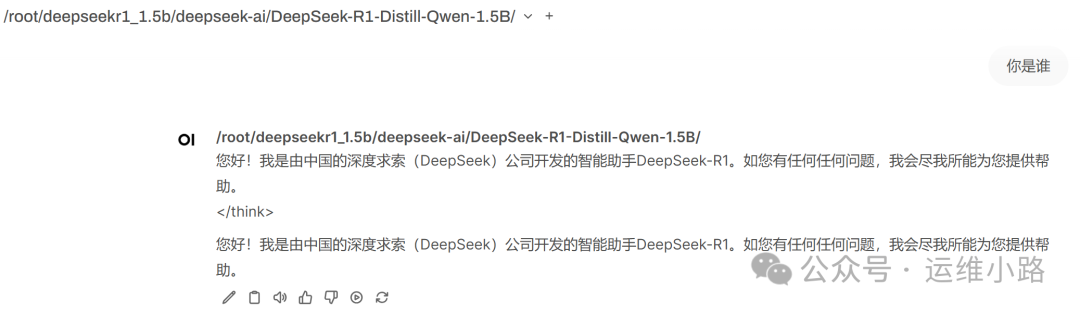

5.开始提问

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-03-04,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录