使用GpuGeek高效完成LLaMA大模型微调:实践与心得分享

使用GpuGeek高效完成LLaMA大模型微调:实践与心得分享

LucianaiB

发布于 2025-05-28 18:10:37

发布于 2025-05-28 18:10:37

使用GpuGeek高效完成LLaMA大模型微调:实践与心得分享

🌟嗨,我是LucianaiB!

🌍 总有人间一两风,填我十万八千梦。

🚀 路漫漫其修远兮,吾将上下而求索。

随着大模型的发展,越来越多的AI开发者开始尝试对开源模型进行微调,以适配垂直场景需求。但由于训练资源昂贵、部署过程繁琐,很多人仍止步于“想做”阶段。

本文将结合我在 GpuGeek 平台 上对 LLaMA 模型的微调实践,分享完整流程、调优经验以及平台带来的优势,帮助更多开发者低门槛开启大模型实践之路。

注册链接:https://gpugeek.com/login?invitedUserId=753279959&source=invited

一、选型与准备

选择模型:LLaMA-7B

Meta发布的LLaMA系列模型在性能与资源消耗之间取得了不错的平衡,适合作为个人或中小团队的定制基础模型。我选择了 LLaMA-7B,结合LoRA方法进行微调。

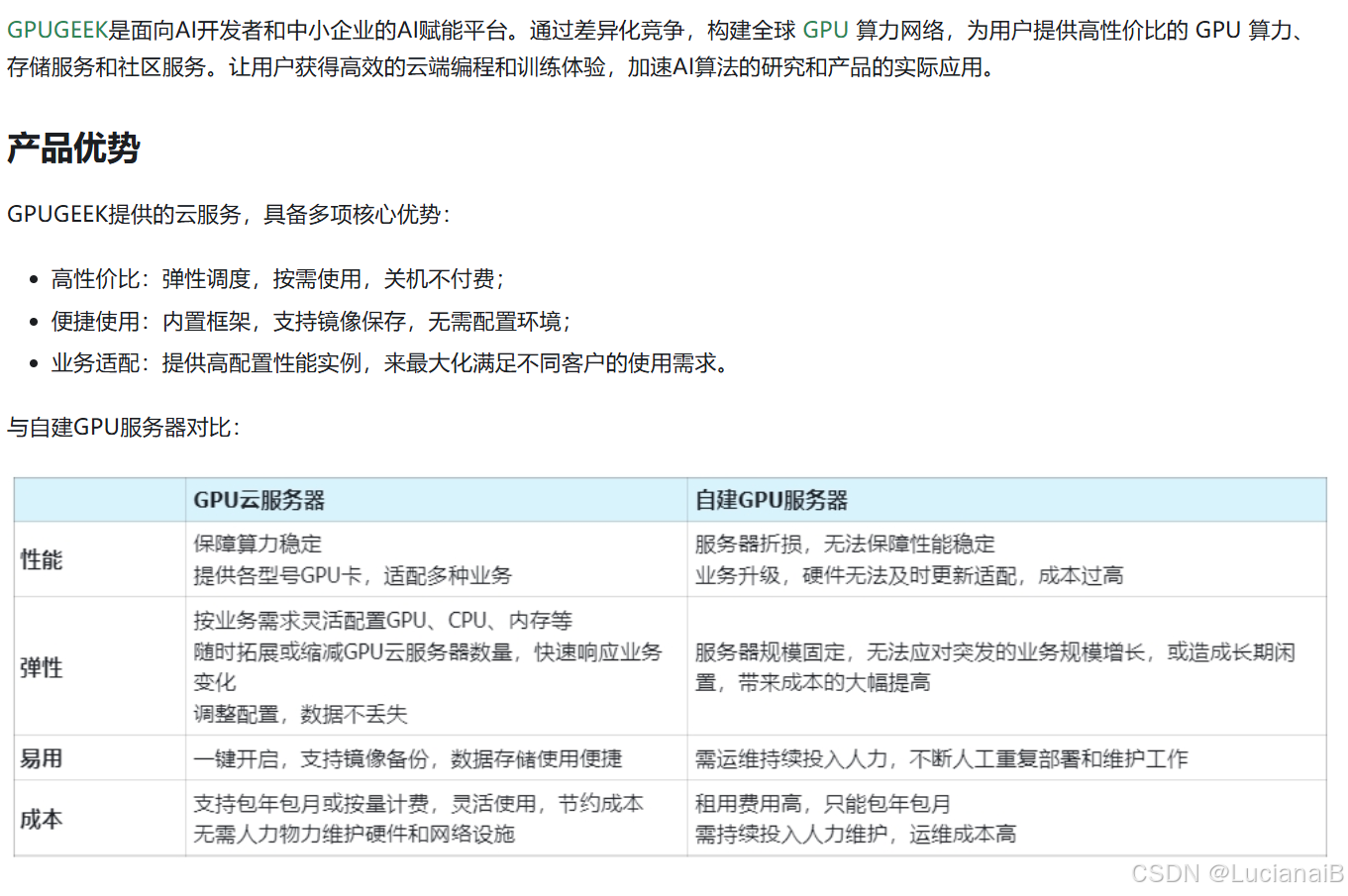

选择平台:GpuGeek

为什么选GpuGeek?

✅ 显卡资源充足、节点丰富:支持多种高性能GPU,包括A100、V100、4090等,满足不同模型的训练需求。 ✅ 实例创建快速:从启动到运行,仅需数分钟,即可进入训练环境,无需繁琐部署。

在这里插入图片描述

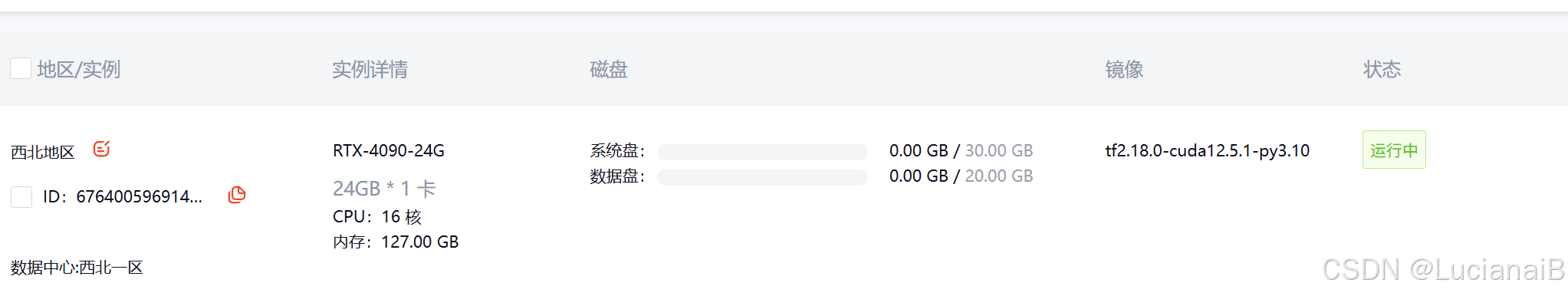

二、创建环境:只需5分钟

在GpuGeek平台,我们只需简单几步即可创建一个适合大模型训练的实例:

- 登录 GpuGeek官网

- 点击「创建实例」,选择如下配置:

- GPU:A100 80GB

- 镜像:

llama-lora-tuner:latest(平台已预置) - 环境:Python 3.10 + CUDA 11.8 + Pytorch 2.x

- 自动挂载的Dataset与Model Market直接选择:

- 数据集:

alpaca-cleaned - 模型:

llama-7b-hf(平台模型市场一键加载)

- 数据集:

点击启动后,实例将在 2-3 分钟内完成创建并进入可交互状态。

在这里插入图片描述

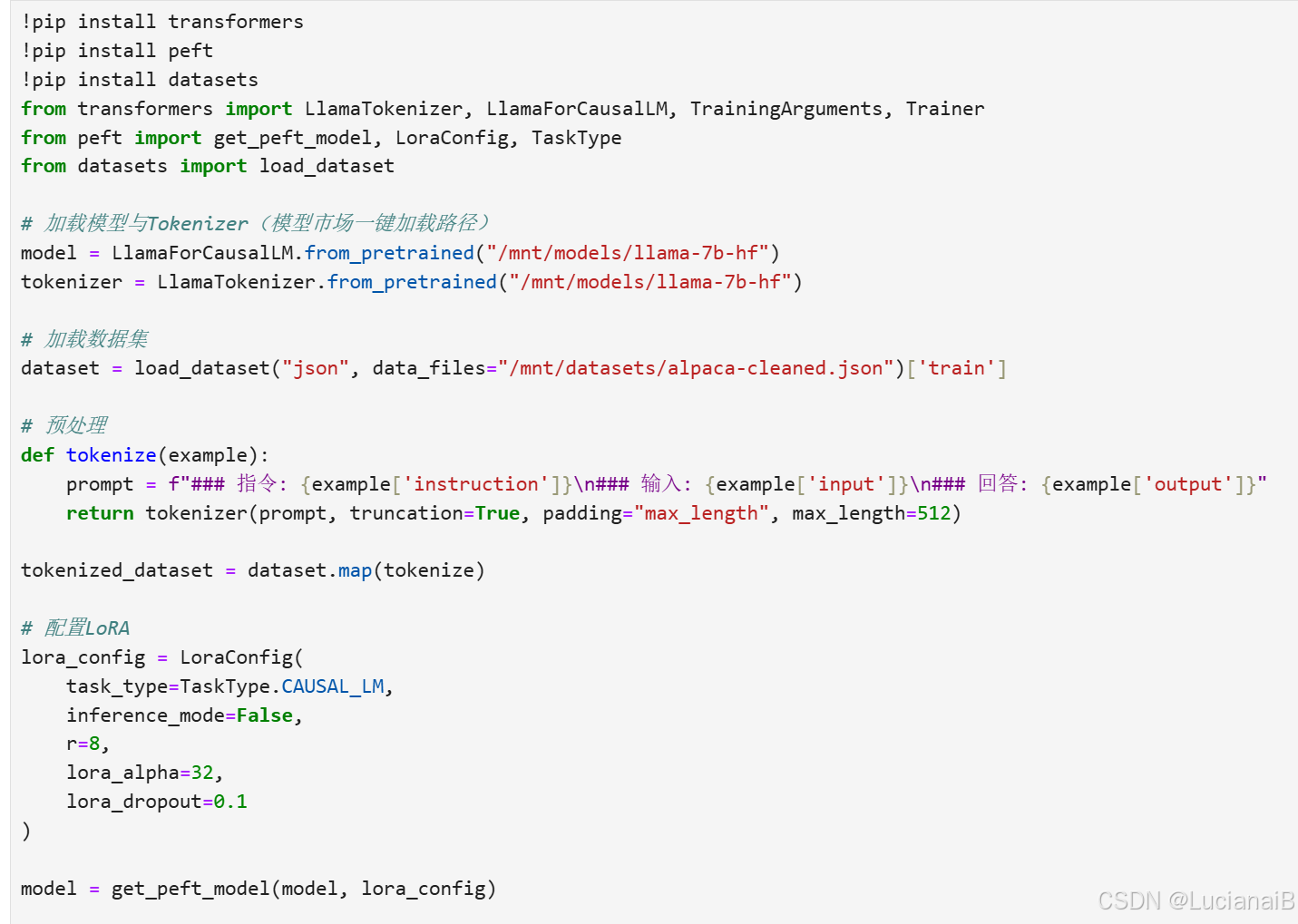

三、开始微调:完整代码流程

以下是使用 transformers + peft + trl 结合 LoRA 微调LLaMA的核心代码:

from transformers import LlamaTokenizer, LlamaForCausalLM, TrainingArguments, Trainer

from peft import get_peft_model, LoraConfig, TaskType

from datasets import load_dataset

# 加载模型与Tokenizer(模型市场一键加载路径)

model = LlamaForCausalLM.from_pretrained("/mnt/models/llama-7b-hf")

tokenizer = LlamaTokenizer.from_pretrained("/mnt/models/llama-7b-hf")

# 加载数据集

dataset = load_dataset("json", data_files="/mnt/datasets/alpaca-cleaned.json")['train']

# 预处理

def tokenize(example):

prompt = f"### 指令: {example['instruction']}\n### 输入: {example['input']}\n### 回答: {example['output']}"

return tokenizer(prompt, truncation=True, padding="max_length", max_length=512)

tokenized_dataset = dataset.map(tokenize)

# 配置LoRA

lora_config = LoraConfig(

task_type=TaskType.CAUSAL_LM,

inference_mode=False,

r=8,

lora_alpha=32,

lora_dropout=0.1

)

model = get_peft_model(model, lora_config)

# 训练配置

training_args = TrainingArguments(

output_dir="./output",

per_device_train_batch_size=4,

gradient_accumulation_steps=2,

num_train_epochs=2,

learning_rate=2e-4,

fp16=True,

logging_steps=20,

save_steps=200,

save_total_limit=2,

report_to="none"

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_dataset

)

trainer.train()

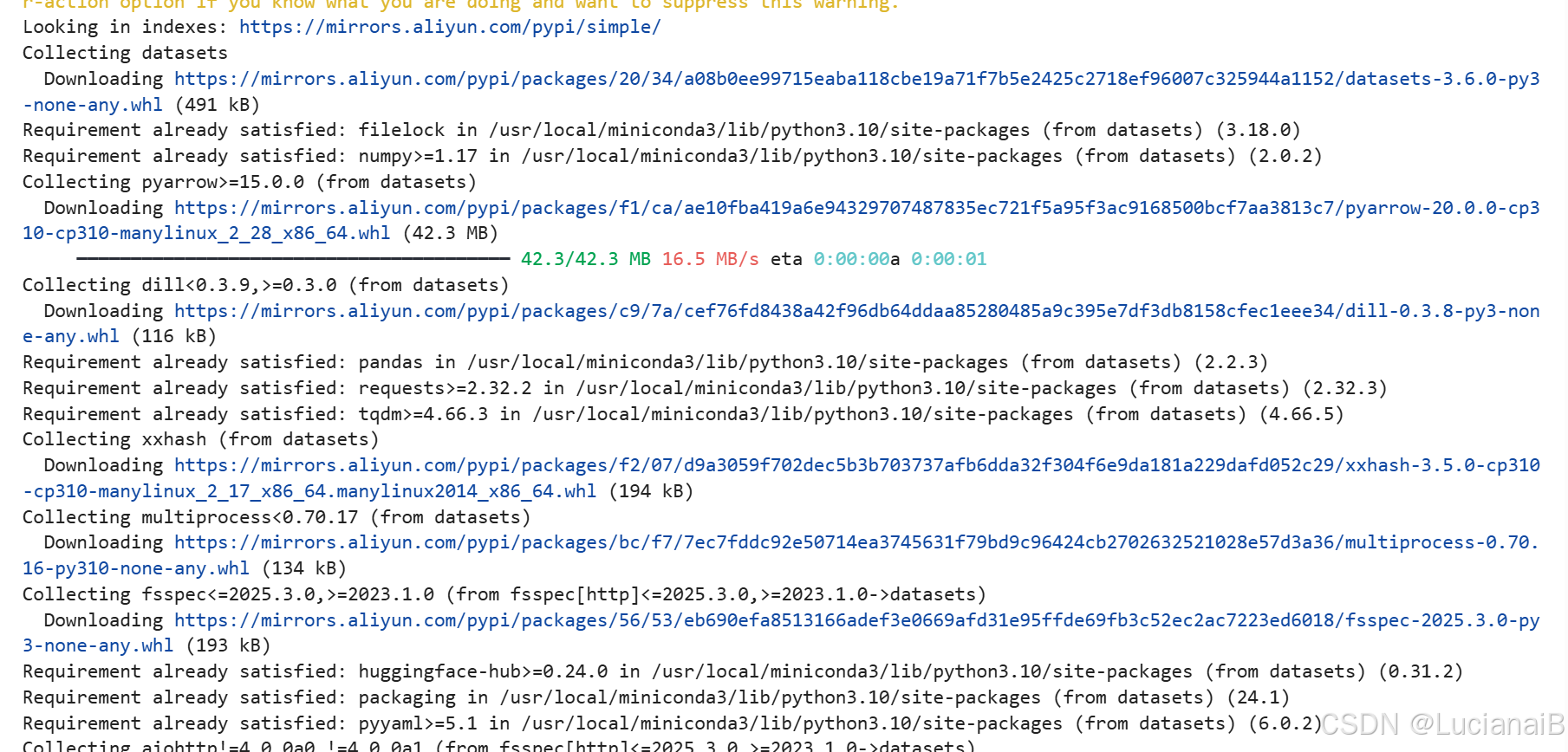

在这里插入图片描述

在这里插入图片描述

四、训练与验证

整个训练过程使用GpuGeek平台的A100节点仅耗时约 4小时,较传统云平台节省近一半时间与成本。

平台优势体现:

- 资源调度迅速:显卡几乎随开随用,免去排队等待

- 模型市场丰富:开箱即用的LLaMA、Baichuan、ChatGLM等模型

- 镜像超多:包括

text-generation-webui、AutoTrain、LoRA-Studio等,省去环境搭建烦恼

五、推理部署

训练完成后,可直接在GpuGeek实例中部署并启动推理服务,如:

python generate.py \

--model_path ./output/checkpoint-final \

--prompt "请用中文简述Transformer原理" \

--max_new_tokens 128也可以一键导出权重到 HuggingFace 或私有仓库进行线上部署。

六、总结

借助GpuGeek平台,我实现了从模型选择、训练、调优到部署的完整流程,且在资源、效率与成本之间取得了良好平衡。

对于有AI项目落地需求的开发者或团队,GpuGeek提供了一个兼顾 高性能与高性价比 的优秀平台,是目前国产算力平台中的不二之选。

如果你也有大模型项目在手,不妨试试GpuGeek,一键开启属于你的AI实践之路!

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-05-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录