知识驱动的模仿学习:让机器人模仿学习更智能、更泛化

知识驱动的模仿学习:让机器人模仿学习更智能、更泛化

一点人工一点智能

发布于 2025-11-26 15:51:05

发布于 2025-11-26 15:51:05

编辑:陈萍萍的公主@一点人工一点智能

导读:模仿学习已成为机器人操作中的重要范式,通过模仿人类专家的演示行为,机器人能够在多种操作任务中表现出卓越的性能。然而,现有的模仿学习方法在面对新物体、新背景或新光照条件时往往表现不佳,其泛化能力受限于训练数据中对象的具体特征和有限的环境变化。

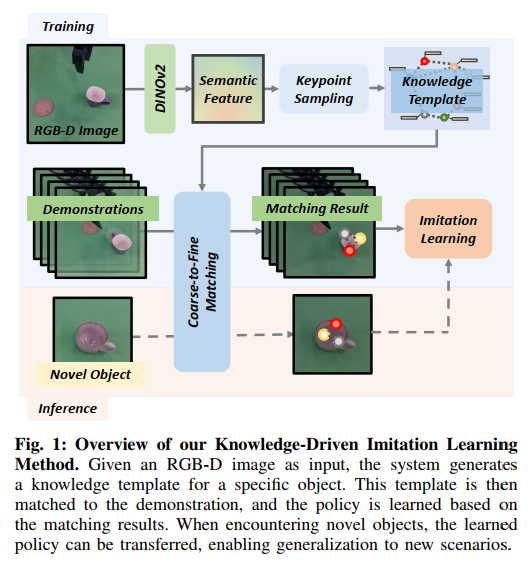

为了解决这一问题,上海交通大学的研究团队提出了一种名为“知识驱动的模仿学习”(Knowledge-Driven Imitation Learning)的新方法,通过引入外部的结构化语义知识,将同一类别中的对象表示为统一的语义关键点图,从而实现了对多样化条件的高效泛化。

论文地址:https://arxiv.org/pdf/2506.21057

项目地址:https://knowledge-driven.github.io/

引言

近年来,机器人学习领域在模仿学习方面取得了显著进展。通过从人类演示中学习,机器人已经能够在多种操作任务中实现出色的表现。然而,模仿策略往往难以泛化到训练环境之外,尤其是在遇到新物体时性能会显著下降。常见的解决方案是通过增加训练演示的数量来提高策略的泛化能力,但这种方法需要大量的数据收集和计算资源,成本高昂且效率低下。

与之相反,人类能够轻松地将已学习的技能泛化到不同的条件中。这是因为人类在学习过程中并不会记忆针对单一物体的具体动作,而是将物体抽象为一种能够捕捉对象中心知识和语义信息的表示形式,同时忽略无关的细节。这种表示使人类能够理解和内化任务的基本逻辑,从而在根本上掌握操作技能。当遇到新物体时,人类能够建立新物体与已学习的抽象表示之间的联系,进而将已学习的操作技能迁移到新物体和新条件中。

基于这一认知启示,研究团队提出了两个技术需求:

(1)开发结构化的对象中心知识模板以提高模仿学习的效率;

(2)设计鲁棒的模板匹配算法,能够跨对象实例进行泛化。

受此启发,他们提出了一个知识驱动的模仿学习系统,利用视觉基础模型将任务相关对象抽象为语义知识模板,并通过一种粗到细的模板匹配算法实现对新条件的泛化。

相关工作

模仿学习使机器人能够通过模仿专家演示来获取操作技能。行为克隆(BC)是一种基本方法,它将模仿学习视为监督学习问题,智能体直接从专家数据中学习从观测到动作的映射。近年来,BC在各种操作任务中表现出强大的学习能力。机器人操作的模仿策略通常依赖于视觉观测,如2D图像或3D点云,以生成机器人动作。为了提高泛化能力,一种常见的方法是通过在大型机器人数据集上进行预训练来扩展演示规模。然而,本文采取了一种不同的途径,通过将结构化知识集成到模仿学习流程中,引入归纳偏置以提高策略的泛化和样本效率。

在知识驱动的模仿学习中,定义并将知识嵌入学习过程至关重要。一些方法利用视觉基础模型作为视觉编码器,生成可泛化的场景级表示。这些表示编码了从互联网规模预训练中学到的丰富语义和结构知识。然而,这些方法中的知识是隐式定义的,缺乏显式结构,难以解释、控制或适应不同的操作任务。另一种方法是显式地定义和集成结构化知识。对象姿态是最基本的知识类型之一,通过将姿态信息融入模仿学习,一些方法能够通过演示重放实现跨不同对象姿态的泛化。然而,这种简单知识无法携带更丰富的信息,限制了其在复杂操作任务和跨新物体泛化中的应用。

一些研究者选择使用语义关键点来表示物体,以捕捉更丰富和详细的信息。这些语义关键点被用作模仿策略的输入,提高了任务性能和跨场景的泛化能力。尽管语义关键点在编码对象中心知识方面有效,但关键点检测仍然具有挑战性,常常受到自遮挡等因素的影响,从而降低观测的一致性并影响策略性能。为此,本文提出使用关键点图来表示物体,确保更鲁棒的关键点匹配,并通过提供稳定的结构化表示来增强知识驱动的策略学习。

方法

3.1 概述

本文提出了一种新的知识驱动模仿学习方法,利用对象的语义特征和结构信息实现鲁棒、可泛化且样本高效的机器人学习。该方法首先从单张图像中提取目标对象的知识模板,然后通过将该模板与对象进行匹配来描述同一类别中的不同对象。最后,基于获取的对象语义知识训练知识驱动的模仿策略,使策略能够适应不同的条件。整个流程如图1所示。

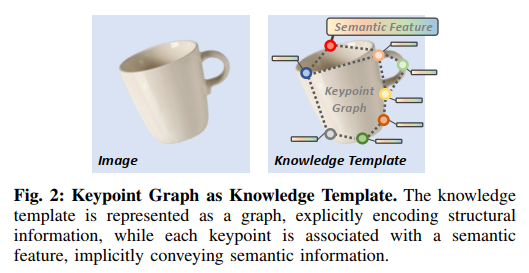

3.2 类别级知识模板

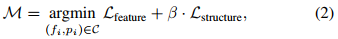

给定一个类别𝒞和与该类别关联的对象𝒪,系统通过对对象的单次观测定义一个类别级知识模板𝒯𝒞,以抽象该类别中对象共享的共同结构和语义信息。具体而言,模板包含K个语义关键点:

其中,

表示语义特征,N为特征维度,

表示第k个关键点的位置。在实践中,将关键点集合视为图,并在匹配过程中考虑关键点之间的空间关系,以确保更有效的模板匹配,如图2所示。

3.3 粗到细的模板匹配

尽管预训练模型提供的语义特征具有强大的泛化能力,但直接使用最近点匹配仍存在局限性。例如,当所选关键点的特征相似时,最近特征匹配可能导致顺序错误;或在测试过程中关键点被遮挡时,最近特征匹配将失效。尽管基于知识的策略可能学习处理不确定性,但这种不确定性本质上增加了对训练数据的需求并使模型训练复杂化。

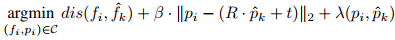

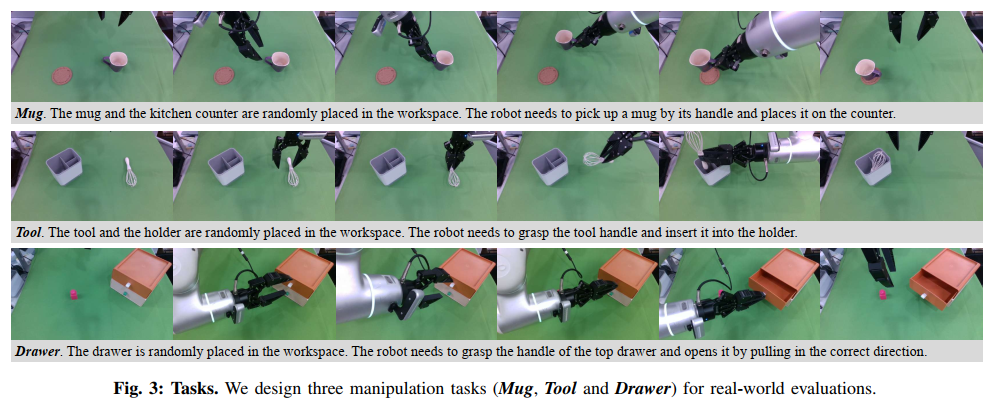

为了消除关键点匹配的歧义,本文提出的方法将关键点组织为模板以提供结构信息,并执行模板匹配而不是逐点匹配,以实现更鲁棒的匹配。在模板匹配过程中,除了简单搜索最近关键点外,还需要保持检测到的关键点与标注关键点之间的结构一致性。形式上,目标是找到一个最优模板匹配

,使得:

其中:

R、t和s分别表示旋转、平移和缩放,β是权重系数。

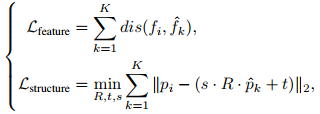

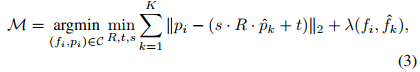

为实现这一目标,本文引入了一种粗到细的模板匹配流程,将优化问题分为两部分。粗模板匹配负责高效地估计知识模板𝒯𝒞与语义点云𝒫之间的变换。这是一个带缩放的刚性点集配准问题。如果点对应关系可用,可以使用Umeyama算法求解。在粗匹配过程中,系统需要确保匹配的关键点具有相似的语义特征。具体而言,设置一个阈值δf,将特征距离低于δf的点对视为对应关系。目标函数可以估计为:

其中

是对不匹配的惩罚:

考虑到遮挡的存在,一些关键点可能始终无法匹配。为此,在匹配过程中采用RANSAC策略,使算法能够依赖少量准确匹配的关键点推断被遮挡关键点的位置,从而实现更鲁棒的模板匹配。

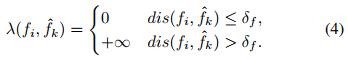

细模板匹配针对形状不同的未见物体设计。同一类别的物体通常具有相似的结构,但关键点的精确位置仍存在差异。粗模板匹配提供了近似变换,但过度简化了特征距离,不足以捕捉变形。在获得近似变换后,需要进一步优化

以捕捉变形。为此,在获得近似变换后,进一步细化关键点位置。对每个点,在邻域内搜索更好的点。具体而言,解决以下优化问题:

其中惩罚λ定义为:

δp是细匹配过程中的位置距离阈值。通过粗到细的模板匹配流程,最终找到公式(2)的近似匹配。

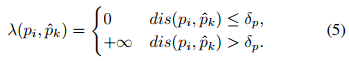

3.4 知识驱动策略

为了通过模仿训练知识驱动策略,所提出的流程首先为演示中的相关对象生成知识模板,并对整个演示数据集执行知识模板匹配。一旦获得模板对应关系ℳ,策略将基于这些匹配结果进行训练,将匹配结果作为输入。在实践中,将知识模板的匹配结果视为特征向量,直接输入扩散模型以生成动作:

其中π是扩散策略,oother包含其他必要观测,如机器人本体感知信息和夹爪宽度。当策略在新条件下(如新物体)部署时,知识模板将与新物体匹配。这些匹配的关键点可以作为锚点,将当前场景中的物体变形为训练集中的模板物体。此时,在模板物体上训练的策略将新物体视为模板的变形,从而使从模板学习的动作能够泛化到新物体。

实验

4.1 实验设置

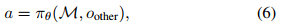

实验平台采用Flexiv Rizon 4机械臂和Robotiq 2F-85夹爪,夹爪手指替换为TPU软UMI手指。使用两个第三方Intel RealSense D435i RGB-D相机进行视觉感知,一个位于机器人前方面向工作空间,另一个位于机器人侧面以辅助捕捉被遮挡区域。为评估知识驱动模仿学习方法的性能,设计了三个需要精确定位的真实世界任务(图3):杯子任务要求准确的姿态估计,即使1厘米的偏差也可能导致失败;工具任务要求策略正确确定工具方向并精确抓取其中心;抽屉任务涉及学习复杂而精确的轨迹以成功打开抽屉。

人类演示通过使用Force Dimension sigma 7触觉设备进行遥操作收集。所有数据,包括来自两个相机的RGB-D图像、机器人本体感知信息和夹爪宽度,以10Hz的频率记录。为每个任务收集不同数量的专家演示:杯子任务45条,工具和抽屉任务各20条,每个任务使用单一对象以方便后续的泛化评估。

基线方法选择了两类:

(a)基于2D图像的扩散策略(Diffusion Policy),利用扩散模型根据图像观测生成机器人动作;

(b)P3-PO,一种使用语义对应生成关键点作为观测的新策略。

为公平比较,将P3-PO中使用的BAKU架构替换为扩散策略进行策略学习。深度信息直接使用RealSense相机获取。对每个相机捕获的图像,手动选择相似数量的关键点。尽管P3-PO使用Co-tracker跟踪关键点以实现闭环控制,但由于机械臂在大运动过程中经常遮挡关键点导致跟踪失败,未采用该方法。与本文方法一致,将关键点坐标、机器人状态和当前任务进度作为观测输入扩散策略,并对观测和动作应用空间增强。

每个策略在每个任务中通过多次连续试验进行评估。为确保一致性,同一试验中物体的初始状态在前相机视图中对齐。使用成功率作为评估指标,成功标准根据任务特定 criteria 确定:

· 杯子任务要求杯子被握把手抓起并最终直立与杯垫接触;

· 工具任务要求工具插入支架且手柄朝下;

· 抽屉任务要求抽屉打开超过3厘米。

允许策略执行直到达到长期静止状态或遇到不可逆问题(如杯子翻倒)。

4.2 实现细节

使用DINOv2 ViT-S/14作为语义特征编码器生成语义特征。来自多个相机的原始语义特征使用相机标定结果投影到机器人坐标系中。为专注于任务相关区域,仅考虑预定义工作空间内的点。对每个对象类别,建立一个包含3-20个代表关键点的模板,通过手动标注或最远点采样选择。具体点数取决于对象的复杂性。

策略实现遵循扩散策略框架,使用U-Net主干网络。策略输入包括复合观测

,其中

表示机器人基坐标系中的关键点,orobot是机器人状态,oprogress表示任务进度。为明确提供时间感知,将当前任务进度定义为oprogress=当前步数/总步数。

在推理过程中,总步数是训练集中的近似平均步数。机器人状态和动作空间由末端执行器的3D位置、6D旋转表示和夹爪宽度定义。策略预测20步动作轨迹。在训练过程中,对关键点坐标和末端执行器姿态应用±0.2米平移和±30度旋转的空间增强以增加数据多样性。策略训练2000轮,批量大小为60,使用100步扩散训练和20步DDIM调度器推理。

在任务执行过程中,夹爪和机械臂可能遮挡部分物体,降低模板匹配性能。为保持一致的策略执行并提高速度,使用“开环”控制策略,其中机器人状态是实时的,而关键点观测otemplate从第一帧获取。尽管是开环,实验表明该方法无需闭环校正即可提供良好的结果。

4.3 结果分析

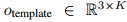

表I报告了本文方法和基线在已见对象上的成功率。与扩散策略相比,本文方法和P3-PO在所有任务中均显示出更高的成功率,证明了引入知识的有效性。尽管任务复杂,本文方法仅用少量专家演示就实现了高成功率。虽然P3-PO提供了有效的图像编码方法,但其对top-1匹配的依赖可能导致关键点不匹配,特别是在物体姿态发生变化时。通过选择更多关键点或收集更多专家演示,策略可能学习纠正噪声关键点的错误。相比之下,本文的模板匹配算法提供了更干净的关键点,使策略在训练中表现出更优的性能。

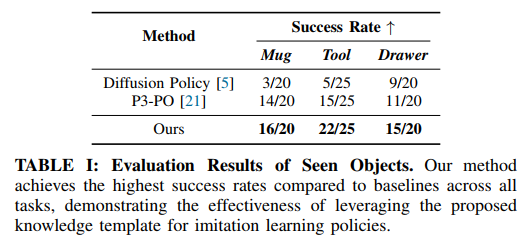

为研究引入知识所获得的数据效率,为杯子任务额外收集了45条专家演示。分别使用24、45和90条演示训练扩散策略和本文方法。图4显示了扩散策略随着专家演示数量增加的性能提升。使用约四倍的专家演示数量后,基于图像的扩散策略开始学习物体方向,并达到与本文方法使用24条演示相当的成功率。这一结果进一步证实了在有限专家演示下实施模仿学习时先验知识的关键作用。

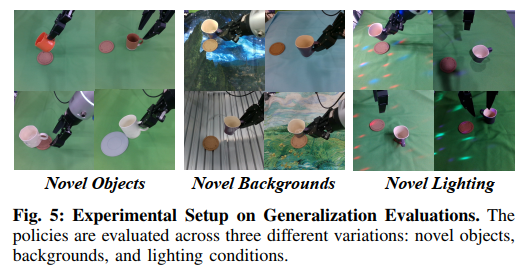

4.4 泛化评估

为评估方法在新物体和环境下的泛化能力,在评估中引入了物体类型和环境条件的变化(图5)。对杯子任务测试了5个未见杯子和3个杯垫;对工具任务评估了4个未见工具,包括勺子、叉子和刮刀;对抽屉任务使用另一个新抽屉评估方法。为进一步测试环境变化下的泛化能力,以杯子任务为例,在评估中应用了四种不同背景和几种动态光照条件。

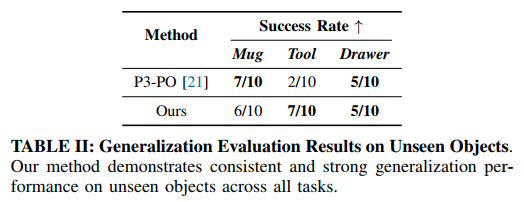

表II显示了未见对象的评估结果。对于杯子任务,由于45条专家演示已覆盖杯子的多数姿态,P3-PO和本文方法均能良好泛化到未见对象。P3-PO在工具任务上泛化能力较差,可能源于其对top-1匹配方法的依赖。当应用于工具时,手柄上的关键点在不同位置具有相似形状。Top-1匹配难以提供与训练集中位置分布和顺序一致的关键点,导致动作生成性能较差。此外,DIFT特征在不同物体和姿态下可能无法提供正确的对应关系。相比之下,本文方法利用语义特征有效定位手柄的前后部分,基于结构信息的关键点匹配能够更准确地估计物体姿态。此外,结构信息确保匹配关键点的位置分布和顺序与训练集紧密对齐,有助于提高动作生成的鲁棒性。

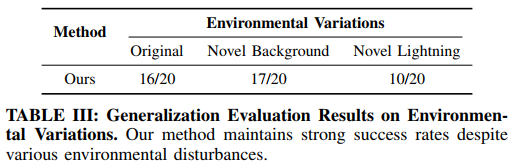

表III展示了杯子任务在新背景和光照条件下的成功率,表明本文方法保持了高成功率。这种强大的泛化能力可归因于该方法建立在预训练语义特征编码器基础上,使其能够适应多样环境。

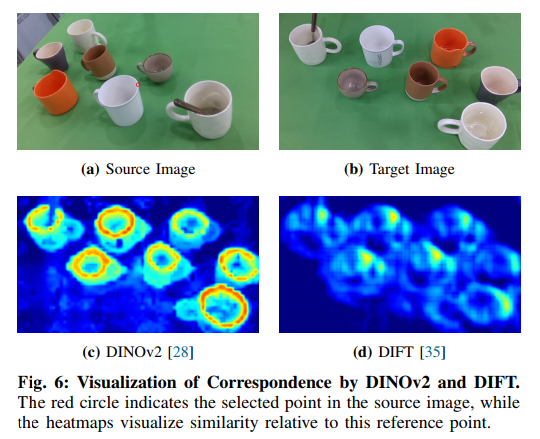

4.5 消融实验

本节研究了方法中各组件的贡献。预训练语义特征提取器是知识驱动模仿学习的关键部分。不同特征提取器可能为同一选定点提供不同的对应关系。图6展示了不同语义图像编码器的点对应结果。红圈表示源图像中的选定点,热力图可视化相对于该参考点的相似性。如图6所示,与DINOv2相比,DIFT更强调局部形状特征,为具有不同方向的区域(如杯缘)分配区分性特征值。而DINOv2表现出更均匀的特征分布。这种均匀性意味着DINOv2可能更适合模板匹配以提高对应准确性。

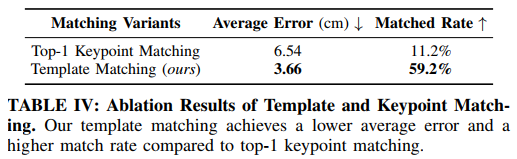

为评估模板和关键点匹配的有效性,通过Blender渲染了Google Scanned Objects中不同姿态的各种物体。比较使用不同匹配方法匹配的关键点之间的平均L2误差。如表IV所示,本文匹配方法实现了比top-1匹配更低的平均误差。为最小化提取特征与深度图之间错位的潜在干扰,本实验中手动移除了对应桌面的点云。为进一步研究模板匹配对策略学习的影响,评估了匹配过程是否保持关键点的结构完整性。具体而言,将匹配误差小于3厘米的关键点定义为“匹配”。表IV表明,本文模板匹配算法显著提高了匹配率,确保关键点顺序与模板一致。

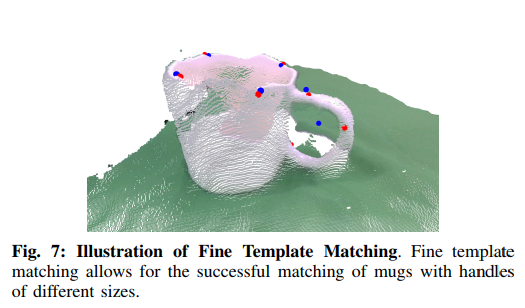

细模板匹配专为形状不同的未见物体设计。图7显示了将小把手杯子匹配到大把手杯子的结果,其中蓝点通过粗模板匹配获得,红点是变形结果。粗模板匹配提供了未见物体的6D姿态估计,而细模板匹配通过特征对齐实现更精确的抓取位置定位。

结论

本文介绍了知识驱动模仿学习系统,一种更高效和可泛化的机器人操作学习方法。定义了一种新的知识模板格式,并提出了粗到细的模板匹配算法,同时考虑结构和语义信息。在三个任务上评估了知识驱动模仿学习方法。实验表明,知识的引入使扩散策略的平均成功率提高了54%。本文方法仅用约1/4的演示数量就超越了扩散策略。该方法对未见物体、新背景和新光照条件也表现出鲁棒性。

通过引入结构化语义知识和高效的模板匹配算法,知识驱动模仿学习为在真实世界环境中实现数据高效的机器人学习提供了新的思路和方法。该方法不仅提高了模仿学习的样本效率和泛化能力,还为未来研究提供了可扩展的框架。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-09-12,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读