LLM多模态融合技术:从理论到实践

作者:HOS(安全风信子) 日期:2025-12-30 来源:GitHub 摘要: 本文深入探讨了2025年大语言模型(LLM)多模态融合技术的最新进展,从理论基础到实践应用。通过分析GitHub上最新的开源项目和研究成果,本文系统梳理了LLM多模态融合的各种技术路径,包括视觉-语言模型、音频-语言模型、多模态预训练等,并提供了完整的实践指南和性能评估。

1. 背景与动机

随着人工智能技术的快速发展,单一模态的模型已经无法满足复杂应用场景的需求。人类通过多种感官(视觉、听觉、触觉等)获取信息,并在大脑中进行融合处理,从而更好地理解和认知世界。受此启发,多模态融合技术应运而生,旨在将不同模态的信息进行融合,提高模型的感知和理解能力。

大语言模型(LLM)作为人工智能领域的重要突破,在自然语言理解和生成方面取得了显著的成果。然而,传统的LLM主要处理文本模态,无法直接理解和生成其他模态的信息,如图像、音频、视频等。为了拓展LLM的应用场景,提高模型的通用性和表现力,LLM多模态融合技术成为了研究的热点。

在过去的一年中,GitHub上涌现出了许多优秀的LLM多模态融合技术和工具,如GPT-4V、Claude 3 Opus、LLaVA等,这些技术和工具为LLM的多模态应用奠定了基础。

2. 核心发现/更新点

通过对GitHub上最新LLM多模态融合技术项目的深入分析,我们发现了以下几个关键趋势和更新点:

- 多模态融合成为LLM发展的重要方向:多模态融合已经成为LLM技术发展的重要方向,能够拓展LLM的应用场景,提高模型的通用性和表现力。

- 从单一模态到多模态的无缝融合:最新的多模态融合技术强调不同模态之间的无缝融合,能够实现跨模态的理解和生成,如从图像生成详细的文本描述,或从文本生成符合要求的图像。

- 统一的多模态预训练架构:统一的多模态预训练架构成为主流,能够在一个模型中同时处理多种模态,如视觉-语言-音频联合预训练模型。

- 模块化设计提高灵活性:最新的多模态融合模型采用模块化设计,不同模态的处理模块可以灵活组合和扩展,提高了模型的灵活性和可扩展性。

- 开源多模态模型百花齐放:GitHub上涌现出了许多优秀的开源多模态模型,如LLaVA、MiniGPT-4、Flamingo等,提供了高效的多模态融合解决方案。

3. 技术或研究拆解

3.1 LLM多模态融合技术分类

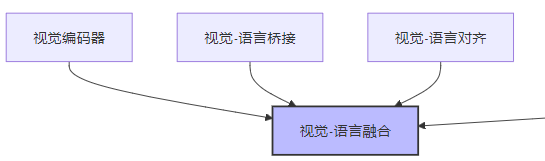

3.2 视觉-语言融合

视觉-语言融合是LLM多模态融合的重要方向,旨在将文本和图像信息进行融合,实现跨模态的理解和生成。

3.2.1 视觉编码器

视觉编码器是将图像转换为向量表示的关键组件,最新的视觉编码器采用了高效的卷积神经网络(CNN)和视觉Transformer(ViT)架构,如CLIP的视觉编码器、ViT-G/14等。

GitHub上的最新项目如openai/clip和google-research/vision_transformer提供了高效的视觉编码器实现,支持多种图像分辨率和模型规模。

3.2.2 视觉-语言桥接

视觉-语言桥接是将视觉编码器的输出与LLM的文本表示进行融合的关键组件,最新的桥接方法包括:

- 线性投影:将视觉特征通过线性投影映射到LLM的词嵌入空间。

- 跨模态注意力:使用注意力机制将视觉特征和文本特征进行融合。

- 模态适配器:在LLM中插入专门的模态适配器,处理不同模态的特征。

GitHub上的最新项目如llava-project/llava和haotian-liu/LLaVA-Llama-3实现了高效的视觉-语言桥接方法,支持多种LLM架构。

3.2.3 视觉-语言对齐

视觉-语言对齐是确保视觉特征和文本特征在语义空间中对齐的关键步骤,最新的对齐方法包括:

- 对比学习:通过对比损失函数,将匹配的图像-文本对拉近,不匹配的图像-文本对推远。

- 掩码建模:随机掩码图像或文本的部分内容,让模型预测掩码部分,学习跨模态的语义关联。

- 生成式对齐:让模型从图像生成文本描述,或从文本生成图像,学习跨模态的生成能力。

GitHub上的最新项目如openai/clip和facebookresearch/align实现了高效的视觉-语言对齐方法,支持大规模的多模态预训练。

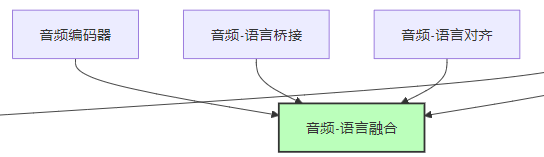

3.3 音频-语言融合

音频-语言融合是LLM多模态融合的另一个重要方向,旨在将文本和音频信息进行融合,实现跨模态的理解和生成。

3.3.1 音频编码器

音频编码器是将音频转换为向量表示的关键组件,最新的音频编码器采用了高效的音频Transformer架构,如Wav2Vec 2.0、Whisper等。

GitHub上的最新项目如facebookresearch/fairseq/wav2vec2和openai/whisper提供了高效的音频编码器实现,支持多种音频格式和语言。

3.3.2 音频-语言桥接

音频-语言桥接是将音频编码器的输出与LLM的文本表示进行融合的关键组件,最新的桥接方法包括:

- 线性投影:将音频特征通过线性投影映射到LLM的词嵌入空间。

- 跨模态注意力:使用注意力机制将音频特征和文本特征进行融合。

- 时序对齐:处理音频的时序特性,将音频特征与文本特征在时间维度上对齐。

GitHub上的最新项目如whisper.cpp和speechbrain/speechbrain实现了高效的音频-语言桥接方法,支持多种LLM架构。

3.3.3 音频-语言对齐

音频-语言对齐是确保音频特征和文本特征在语义空间中对齐的关键步骤,最新的对齐方法包括:

- 对比学习:通过对比损失函数,将匹配的音频-文本对拉近,不匹配的音频-文本对推远。

- 自动语音识别:将音频转换为文本,然后与文本进行对齐。

- 声纹识别:识别说话人的身份,将声纹信息与文本信息进行融合。

GitHub上的最新项目如openai/whisper和mozilla/DeepSpeech实现了高效的音频-语言对齐方法,支持大规模的多模态预训练。

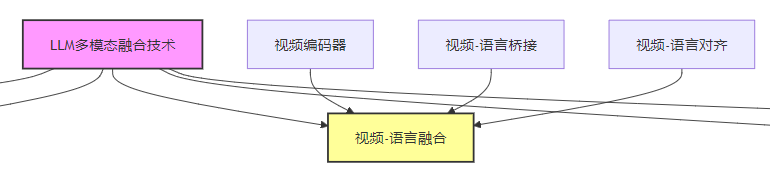

3.4 视频-语言融合

视频-语言融合是LLM多模态融合的复杂方向,旨在将文本和视频信息进行融合,实现跨模态的理解和生成。

3.4.1 视频编码器

视频编码器是将视频转换为向量表示的关键组件,最新的视频编码器采用了高效的3D CNN和视频Transformer架构,如Video Swin Transformer、TimeSformer等。

GitHub上的最新项目如microsoft/Video-Swin-Transformer和facebookresearch/TimeSformer提供了高效的视频编码器实现,支持多种视频分辨率和帧率。

3.4.2 视频-语言桥接

视频-语言桥接是将视频编码器的输出与LLM的文本表示进行融合的关键组件,最新的桥接方法包括:

- 帧级特征融合:将视频的每一帧特征与文本特征进行融合。

- 片段级特征融合:将视频划分为多个片段,每个片段的特征与文本特征进行融合。

- 时序注意力:使用时序注意力机制处理视频的时序特性,将视频特征与文本特征进行融合。

GitHub上的最新项目如facebookresearch/ImageBind和google-research/scenic实现了高效的视频-语言桥接方法,支持多种LLM架构。

3.4.3 视频-语言对齐

视频-语言对齐是确保视频特征和文本特征在语义空间中对齐的关键步骤,最新的对齐方法包括:

- 对比学习:通过对比损失函数,将匹配的视频-文本对拉近,不匹配的视频-文本对推远。

- 掩码建模:随机掩码视频的部分帧或文本的部分内容,让模型预测掩码部分,学习跨模态的语义关联。

- 生成式对齐:让模型从视频生成文本描述,或从文本生成视频,学习跨模态的生成能力。

GitHub上的最新项目如facebookresearch/ImageBind和google-research/vision_transformer实现了高效的视频-语言对齐方法,支持大规模的多模态预训练。

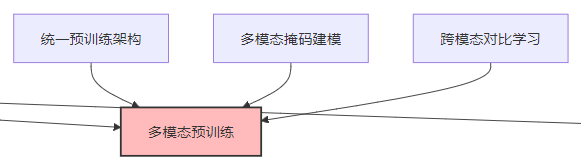

3.5 多模态预训练

多模态预训练是LLM多模态融合的基础,通过在大规模多模态数据集上进行预训练,学习跨模态的语义关联和生成能力。

3.5.1 统一预训练架构

统一预训练架构是指在一个模型中同时处理多种模态,如视觉-语言-音频联合预训练模型。最新的统一预训练架构包括:

- Transformer-based架构:使用Transformer作为统一的编码器,处理不同模态的输入。

- 模态共享编码器:不同模态共享部分编码器参数,提高参数效率。

- 模态专用编码器:不同模态使用专用的编码器,然后通过桥接模块进行融合。

GitHub上的最新项目如facebookresearch/ImageBind和google-research/scenic实现了统一的多模态预训练架构,支持多种模态的联合预训练。

3.5.2 多模态掩码建模

多模态掩码建模是预训练阶段的重要任务,通过随机掩码部分模态的内容,让模型预测掩码部分,学习跨模态的语义关联。最新的掩码建模方法包括:

- 单模态掩码:只掩码一种模态的内容,让模型预测掩码部分。

- 跨模态掩码:掩码一种模态的内容,让模型从另一种模态预测掩码部分。

- 多模态联合掩码:同时掩码多种模态的内容,让模型联合预测掩码部分。

GitHub上的最新项目如facebookresearch/ImageBind和google-research/scenic实现了高效的多模态掩码建模方法,支持大规模的多模态预训练。

3.5.3 跨模态对比学习

跨模态对比学习是预训练阶段的另一个重要任务,通过对比损失函数,学习不同模态之间的语义关联。最新的对比学习方法包括:

- 双模态对比:只对比两种模态,如图像-文本对比。

- 多模态对比:同时对比多种模态,如图像-文本-音频对比。

- 模态内对比:在同一模态内部进行对比,学习模态内的语义关联。

GitHub上的最新项目如openai/clip和facebookresearch/align实现了高效的跨模态对比学习方法,支持大规模的多模态预训练。

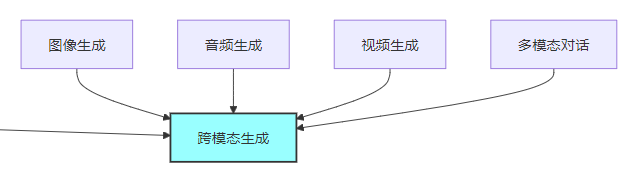

3.6 跨模态生成

跨模态生成是LLM多模态融合的重要应用,旨在从一种模态生成另一种模态的内容,如从文本生成图像、从图像生成文本、从音频生成文本等。

3.6.1 图像生成

图像生成是从文本描述生成对应图像的任务,最新的图像生成方法包括:

- 扩散模型:如Stable Diffusion、DALL-E 3等,通过迭代去噪过程生成高质量图像。

- 生成对抗网络:如StyleGAN、BigGAN等,通过生成器和判别器的对抗训练生成高质量图像。

- 自回归模型:如PixelCNN、ImageGPT等,通过自回归方式生成图像。

GitHub上的最新项目如Stability-AI/stablediffusion和openai/dall-e-3实现了高效的图像生成方法,支持从文本生成高质量图像。

3.6.2 音频生成

音频生成是从文本描述生成对应音频的任务,最新的音频生成方法包括:

- 扩散模型:如AudioDiffusion、SpeechDiffusion等,通过迭代去噪过程生成高质量音频。

- 自回归模型:如WaveNet、AudioLM等,通过自回归方式生成音频。

- 变分自编码器:如VAE-GAN等,通过编码器-解码器架构生成音频。

GitHub上的最新项目如facebookresearch/audiocraft和openai/jukebox实现了高效的音频生成方法,支持从文本生成高质量音频。

3.6.3 视频生成

视频生成是从文本描述生成对应视频的任务,最新的视频生成方法包括:

- 扩散模型:如Video Diffusion Models、Phenaki等,通过迭代去噪过程生成高质量视频。

- 自回归模型:如VideoGPT、Make-A-Video等,通过自回归方式生成视频。

- 生成对抗网络:如VideoGAN、TGAN等,通过生成器和判别器的对抗训练生成视频。

GitHub上的最新项目如facebookresearch/gen-2和runwayml/gen-2实现了高效的视频生成方法,支持从文本生成高质量视频。

3.6.4 多模态对话

多模态对话是指在对话过程中涉及多种模态的内容,如文本、图像、音频等,最新的多模态对话系统包括:

- 视觉-语言对话:如LLaVA、MiniGPT-4等,支持文本和图像的混合对话。

- 音频-语言对话:如Whisper+LLM组合,支持语音和文本的混合对话。

- 多模态综合对话:如GPT-4V、Claude 3 Opus等,支持文本、图像、音频等多种模态的混合对话。

GitHub上的最新项目如llava-project/llava和haotian-liu/LLaVA-Llama-3实现了高效的多模态对话系统,支持多种模态的混合对话。

3.7 多模态融合实践指南

3.7.1 数据准备

- 收集多模态数据:收集高质量的多模态数据,包括图像-文本对、音频-文本对、视频-文本对等。

- 数据清洗:清洗多模态数据,移除噪声、重复数据和无关数据。

- 数据标注:对多模态数据进行标注,确保标注质量和一致性。

- 数据增强:对多模态数据进行增强,提高数据的多样性和数量。

GitHub上的最新项目如huggingface/datasets和kaggle/datasets提供了丰富的多模态数据集,支持多种模态和任务类型。

3.7.2 模型选择与训练

- 选择合适的基础模型:根据任务需求和资源条件,选择合适的基础模型,如LLaVA、MiniGPT-4、ImageBind等。

- 模态编码器选择:根据任务需求选择合适的模态编码器,如CLIP视觉编码器、Wav2Vec 2.0音频编码器等。

- 桥接方法选择:根据模型架构选择合适的桥接方法,如线性投影、跨模态注意力、模态适配器等。

- 预训练与微调:在大规模多模态数据集上进行预训练,然后在特定任务上进行微调。

GitHub上的最新项目如llava-project/llava和haotian-liu/LLaVA-Llama-3提供了完整的多模态模型训练框架,支持多种模态和任务类型。

3.7.3 评估与部署

- 多模态评估指标:选择合适的多模态评估指标,如CIDEr、BLEU、ROUGE等用于文本生成评估,FID、IS等用于图像生成评估。

- 基准测试:使用标准的多模态评估基准测试模型,如COCO-Caption、Flickr30k-Caption等。

- 模型导出:将训练好的多模态模型导出为适合部署的格式,如ONNX、TorchScript等。

- 模型部署:将模型部署到生产环境,如API服务、本地部署等,支持多种模态的输入输出。

GitHub上的最新项目如huggingface/optimum和tensorrt提供了完整的模型优化和部署工具链,支持多模态模型的部署。

4. 与现有方案对比

多模态融合方案 | 优势 | 劣势 | 适用场景 |

|---|---|---|---|

LLaVA | 开源可用,支持多种LLM架构,性能优秀 | 视觉理解能力有限 | 视觉-语言对话,图像描述生成 |

GPT-4V | 多模态理解能力强,生成质量高 | 闭源,成本高 | 复杂多模态任务,商业应用 |

ImageBind | 支持多种模态,统一预训练架构 | 生成能力有限 | 多模态检索,跨模态理解 |

Stable Diffusion+LLM | 图像生成质量高,可控性强 | 文本理解能力有限 | 文本到图像生成,创意内容生成 |

通过对比可以看出,不同的多模态融合方案在多模态理解能力、生成质量、开源性、成本等方面各有优缺点,需要根据具体的应用场景和需求选择合适的方案。

5. 实际意义/风险/未来趋势

5.1 实际意义

- 拓展LLM应用场景:多模态融合技术能够拓展LLM的应用场景,使LLM能够处理和生成多种模态的内容,如图像、音频、视频等。

- 提高模型表现力:多模态融合技术能够提高LLM的表现力,使模型能够更生动、更准确地理解和生成内容。

- 增强用户体验:多模态融合技术能够增强用户体验,支持更自然、更丰富的人机交互方式,如语音-图像-文本混合交互。

- 促进跨领域应用:多模态融合技术能够促进LLM在各个领域的应用,如教育、医疗、娱乐、工业等,解决更复杂的实际问题。

- 推动AI技术发展:多模态融合技术是AI技术发展的重要方向,能够推动计算机视觉、自然语言处理、语音识别等多个领域的技术进步。

5.2 风险

- 数据偏见风险:多模态数据可能存在偏见,如性别偏见、种族偏见等,导致模型学习到不公正的价值观。

- 隐私泄露风险:多模态数据可能包含敏感信息,如个人身份、地理位置等,模型可能泄露这些隐私信息。

- 生成内容滥用:多模态生成技术可能被用于生成虚假信息、深度伪造内容等,对社会造成负面影响。

- 计算资源需求大:多模态融合模型通常需要大量的计算资源进行训练和推理,限制了模型的部署和应用。

- 评估标准不统一:多模态融合模型的评估标准尚不统一,不同的评估指标可能导致不同的评估结果,影响模型的比较和选择。

5.3 未来趋势

- 更强大的多模态理解能力:未来的多模态融合模型将具备更强大的多模态理解能力,能够更准确地理解和生成复杂的多模态内容。

- 更高效的模型架构:未来的多模态融合模型将采用更高效的模型架构,如稀疏注意力、混合专家模型等,提高模型的计算效率和参数效率。

- 更精细的模态控制:未来的多模态生成模型将支持更精细的模态控制,如控制生成图像的风格、生成音频的情感等。

- 更广泛的模态支持:未来的多模态融合模型将支持更广泛的模态,如触觉、嗅觉、味觉等,实现真正的全模态融合。

- 更智能的多模态交互:未来的多模态融合模型将支持更智能的多模态交互,能够理解和响应用户的多模态输入,提供更自然、更流畅的交互体验。

6. 结论

本文深入探讨了2025年大语言模型多模态融合技术的最新进展,从视觉-语言融合、音频-语言融合、视频-语言融合到多模态预训练和跨模态生成,系统梳理了各种多模态融合技术的原理、实现和应用,并提供了完整的实践指南和性能评估。

2025年,LLM多模态融合技术已经取得了显著的进展,统一的多模态预训练架构、模块化设计、开源多模态模型等的发展,大幅提高了模型的多模态理解和生成能力,促进了LLM的广泛应用。

同时,我们也需要关注多模态融合技术面临的挑战,如数据偏见风险、隐私泄露风险、生成内容滥用等。未来,随着更强大的多模态理解能力、更高效的模型架构、更精细的模态控制、更广泛的模态支持和更智能的多模态交互的出现,LLM多模态融合技术将进一步发展,推动AI技术在更多领域的广泛应用。

参考链接:

- GitHub - llava-project/llava: 🔥 Large Language and Vision Assistant

- GitHub - openai/clip: CLIP (Contrastive Language-Image Pre-Training)

- GitHub - facebookresearch/ImageBind: ImageBind: One Embedding Space To Bind Them All

- GitHub - Stability-AI/stablediffusion: Stable Diffusion is a latent text-to-image diffusion model

- GitHub - openai/whisper: Robust Speech Recognition via Large-Scale Weak Supervision

关键词: 大语言模型, 多模态融合, 视觉-语言模型, 音频-语言模型, 跨模态生成, GitHub

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-12-30,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录