Micron:多场景推理SSD-带宽/IO表征

Micron:多场景推理SSD-带宽/IO表征

数据存储前沿技术

发布于 2026-01-13 15:48:06

发布于 2026-01-13 15:48:06

阅读收获

- I/O模式优化优先于硬件堆砌: 掌握Ollama等框架如何通过多流顺序读取(而非随机读取)最大化SSD带宽,指导你在开发或选择AI运行时框架时,将I/O模式优化置于首位。

- SSD读取带宽是多模型切换的核心指标: 理解“丢弃并重载”策略如何将模型切换延迟完全转化为SSD的纯读取时间,为AI PC的存储选型提供明确的性能指导。

- RAG场景对SSD提出“全能”要求: 识别RAG工作流中带宽敏感型(加载)和延迟敏感型(检索)I/O的动态切换,帮助你评估和配置满足复杂AI工作负载的存储系统。

全文概览

随着大模型从云端走向PC和边缘设备,我们对“AI PC”的性能期待日益提高。但你是否曾疑惑,为什么升级了最新的GPU和内存,模型加载和切换速度依然不尽如人意?传统观点认为AI推理是计算密集型或内存IO密集型任务,但最新的存储I/O分析揭示了一个被忽视的关键瓶颈:SSD。

本文将深入剖析AI推理(包括模型加载、多模态处理和RAG)在PC端产生的真实I/O流量特征。通过Ollama等优化框架的案例,量化展示软件I/O策略如何比单纯的硬件升级更能决定你的AI体验。高性能SSD真的是AI PC的“刚需”吗?软件优化在多大程度上能弥补硬件的不足?一起揭开AI推理存储I/O的神秘面纱。

👉 划线高亮 观点批注

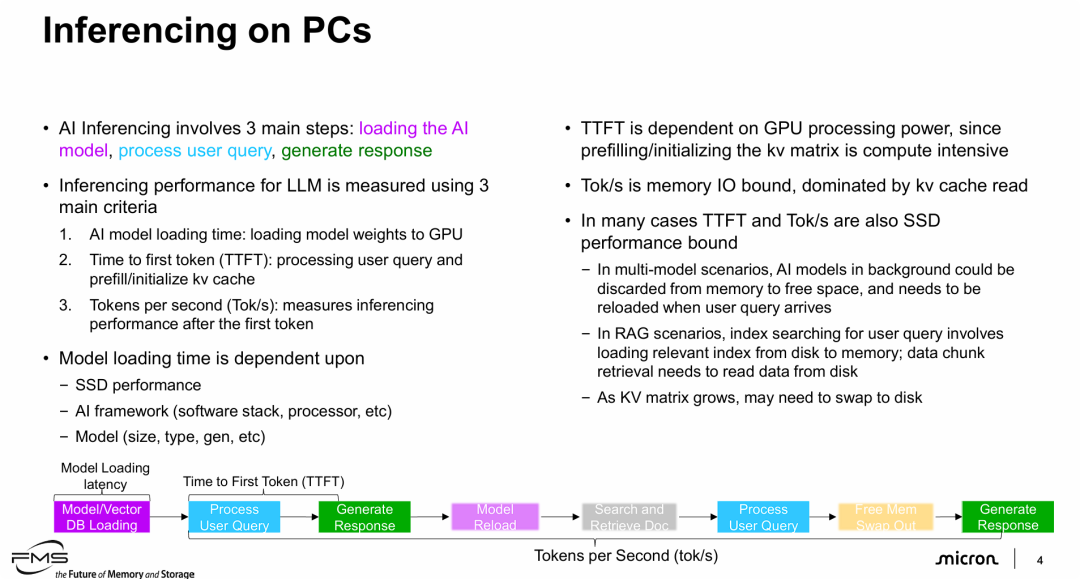

在个人电脑上进行(AI)推理

在个人电脑上进行(AI)推理

在PC上进行AI推理时,SSD性能不再仅仅影响初始的模型加载时间,而是对整个推理过程的关键性能指标(包括TTFT和Tok/s)都产生至关重要的影响。

- 性能三要素:PC上的AI推理性能由三个核心指标定义:模型加载时间、首个令牌生成时间(TTFT)和每秒令牌数(Tok/s)。

性能指标 | 依赖因素 | 关键特性 |

|---|---|---|

模型加载时间 | SSD performance(SSD性能) | 直接影响从磁盘读取模型文件的速度 |

AI framework(AI框架) | 包括软件栈、处理器等 | |

Model(模型本身) | 包括模型的大小、类型、代际等 | |

TTFT | GPU processing power(GPU处理能力) | 预填充/初始化KV矩阵是计算密集型操作 |

Tok/s | memory IO bound(受限于内存IO) | 主要瓶颈在于KV缓存的读取 |

- SSD是关键瓶颈:传统观念认为推理主要受GPU(计算)和内存(IO)限制,但此PPT明确指出,SSD性能是PC端AI应用体验的一个关键且常常被忽视的瓶颈。

- 现代AI场景加剧了存储依赖:在多模型切换、RAG(检索增强生成)以及长对话导致KV缓存增长等现代复杂AI应用场景中,系统需要频繁地与磁盘进行数据交换(模型重载、索引/文档检索、内存换页)。这些操作直接冲击TTFT和Tok/s,使得高速SSD成为流畅体验的必要条件。

- 对PC硬件的启示:为了在PC上获得高效、流畅的AI推理体验,用户不仅需要强大的GPU和充足的内存,还必须配备高性能的SSD来避免存储I/O成为整个系统的短板。

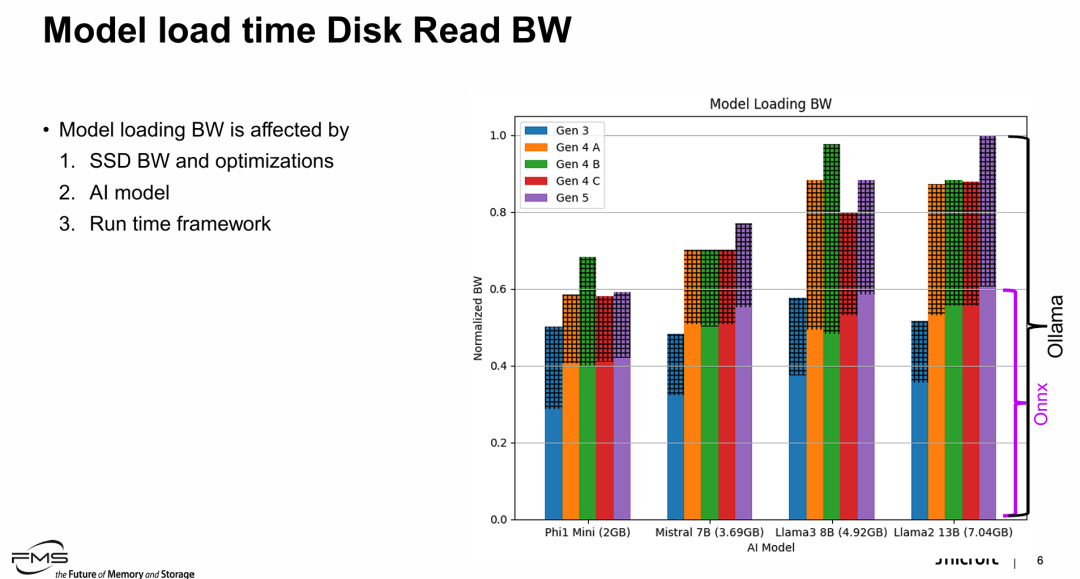

模型加载过程磁盘读写带宽

模型加载过程磁盘读写带宽

AI模型的加载性能是一个由硬件(SSD)、模型本身和软件(运行时框架)共同决定的复杂系统,其中,软件框架的优化程度对性能的影响可能与硬件换代同样重要,甚至更为关键。

- 软件优化是性能倍增器:图表最引人注目的信息是,选择一个如Ollama这样经过优化的运行时框架,其带来的模型加载带宽提升(网格部分),在某些情况下甚至超过了将SSD从PCIe Gen3升级到Gen5所带来的硬件性能提升。

- 硬件是基础,但非唯一:虽然更快的SSD(如Gen 5)确实能提供更高的加载带宽,但如果软件框架无法有效利用硬件性能,那么硬件的优势将大打折扣。

- 性能需系统性考量:要实现最快的模型加载速度,必须采取系统性的优化方法,即不仅要采用高性能的SSD,还必须选择或开发能够充分挖掘硬件潜力的AI运行时框架。单纯堆砌硬件并不能保证最佳性能。

模型推理运行时对硬件性能发挥有明显影响

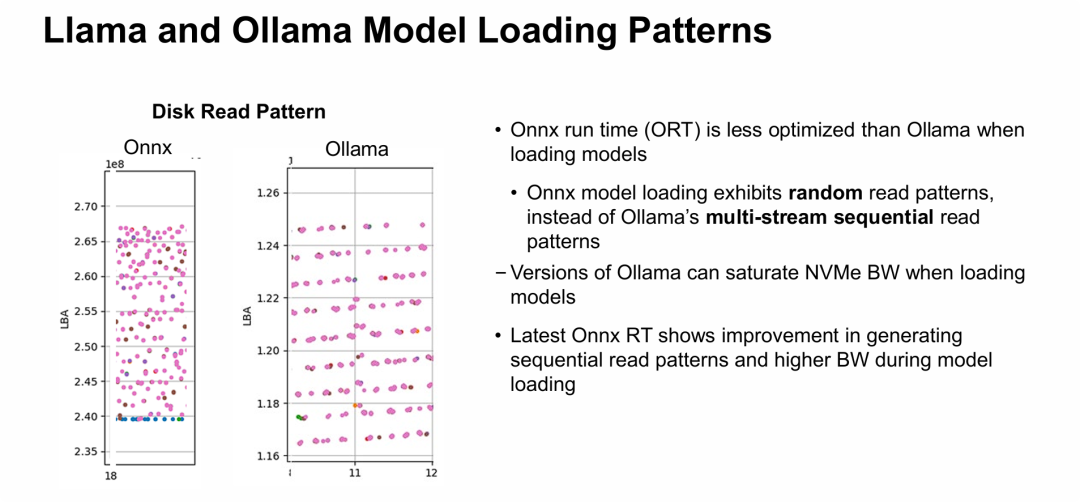

Ollama框架加载llama模型的磁盘LBA分析

Ollama框架加载llama模型的磁盘LBA分析

AI运行时框架对磁盘I/O模式的优化,是决定模型加载速度的关键因素,其重要性甚至不亚于硬件本身。

- I/O模式决定性能:模型加载速度的瓶颈不仅在于SSD的峰值带宽,更在于软件框架如何利用这些带宽。Ollama的顺序读取模式能够最大化硬件性能,而Onnx(旧版)的随机读取模式则会造成严重的性能瓶颈。

- 可视化证据:通过LBA散点图,PPT直观地展示了“坏”的I/O模式(随机)和“好”的I/O模式(多流顺序)之间的天壤之别,为上一张PPT中Ollama性能远超Onnx的现象提供了根本性的技术解释。

- 软件优化的价值:这有力地证明了在存储性能领域,上层应用和框架的软件优化至关重要。一个精心设计的软件可以解锁硬件的全部潜力,而一个未经优化的软件则会让高端硬件的投资回报大打折扣。

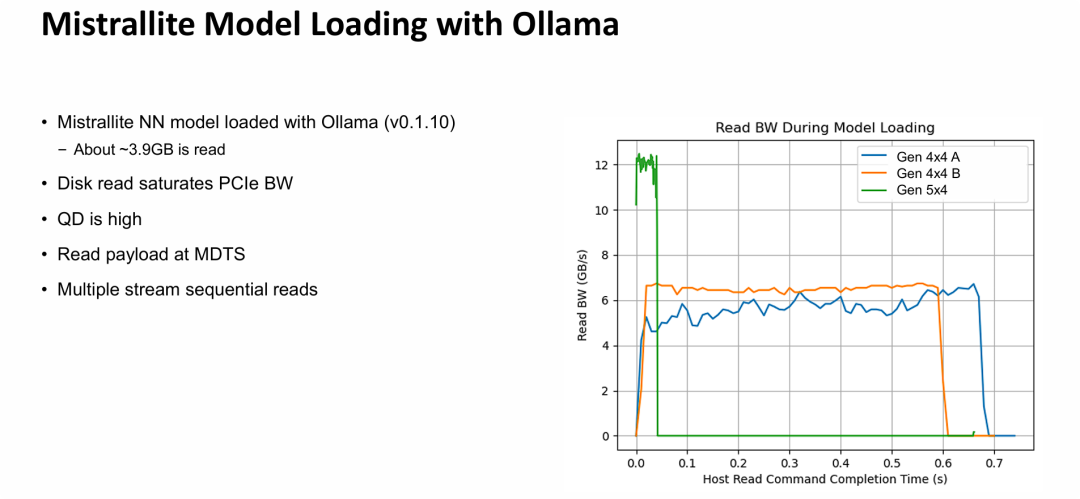

使用Ollama框架加载Mistrallite模型

使用Ollama框架加载Mistrallite模型

Ollama框架通过采用高度优化的I/O策略,能够将现代高性能NVMe SSD的硬件潜力压榨到极致,从而实现闪电般的AI模型加载速度。

- 理论成为现实:通过具体的Mistrallite模型加载测试,为之前幻灯片中“Ollama优化出色”的论点提供了强有力的量化数据支撑。

- 最佳实践的典范:左侧列出的I/O特性(高QD、大Payload、多流顺序读取)是存储性能优化的“黄金法则”。

- 硬件与软件的完美协同:图表清晰地显示,无论是面对Gen4还是Gen5的SSD,Ollama都能迅速将带宽“打满”,证明了软件与硬件之间不存在明显的短板,实现了高效协同工作。这使得模型加载时间从秒级(对于大模型而言)缩短到了亚秒级甚至毫秒级。

- 对未来AI PC的启示:随着AI模型越来越大,快速加载成为提升用户体验的关键。这张PPT证明,通过软件框架的深度优化,结合最新一代的存储硬件,可以有效解决模型加载的耗时问题。

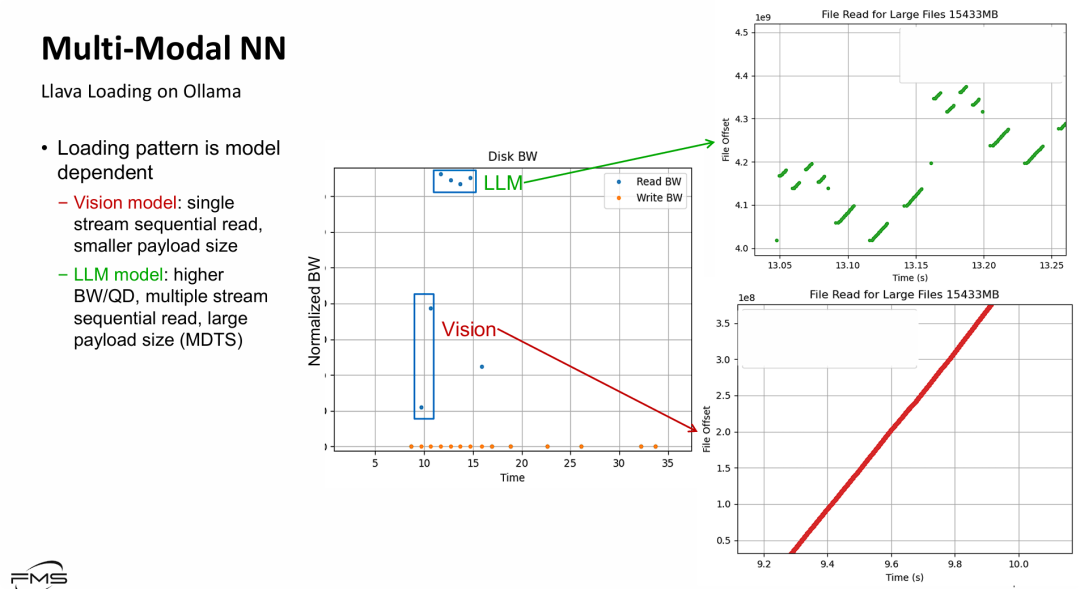

Multi-Modal NN(多模态神经网络)的IO读取行为

Multi-Modal NN(多模态神经网络)的IO读取行为

Ollama运行时框架,加载不同模态部分(视觉和语言)时,其底层的读取模式是截然不同的。

- LLM model(大语言模型) 的加载特性:

- 具有更高的带宽和队列深度(QD)。

- 采用多数据流的顺序读取。

- 采用系统允许的最大数据传输尺寸(MDTS)进行读取。

右上图 (对应LLM加载):

- 图中的绿色数据点形成了多条断续的、倾斜的短线,分布在不同的文件偏移量区间。

- Vision model(视觉模型) 的加载特性:

- 采用单数据流的顺序读取。

- 每次I/O请求的数据块较小。

右下图 (对应Vision加载):

- 图中的红色数据点汇成了一条完整、连续、笔直的对角线。

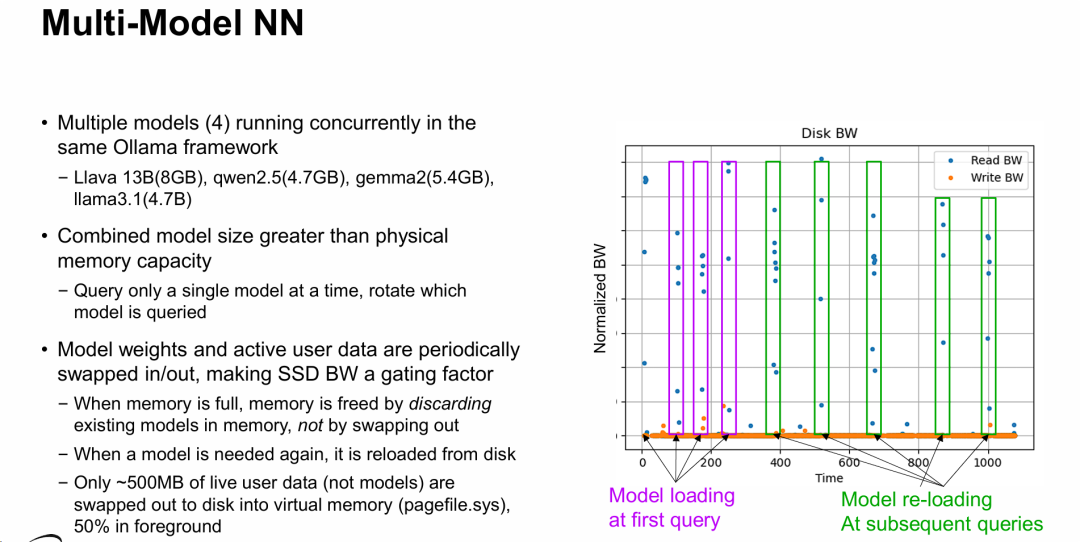

多个模型并行的神经网络,IO行为

多个模型并行的神经网络,IO行为

在内存受限的PC上运行多个大型AI模型时,Ollama框架通过一种高效的“丢弃并重载”(Discard-and-Reload)策略来管理内存,这使得SSD的读取性能成为决定模型切换速度和用户体验流畅度的决定性因素。

- 智能内存管理:Ollama避免了传统操作系统对大型应用的低效内存交换(Swap)。它不去“交换”整个模型(既读又写),而是直接“丢弃”不用的模型(无写操作),在需要时再“重载”(纯读操作)。

- 写操作最小化:这种策略将模型切换的I/O开销从“读+写”变为了“纯读”,极大地减轻了SSD的负担,并显著提升了效率,因为避免了GB级别的大文件写入。

- SSD读取带宽是关键:在这种“丢弃并重载”的模式下,用户每次切换模型的等待时间,几乎完全等同于从SSD重新加载模型所需的时间。因此,SSD的读取带宽直接决定了多模型应用场景下的系统响应能力。

- 对硬件配置的启示:对于希望在PC上流畅运行和切换多个本地大模型的用户而言,投资一块高带宽的NVMe SSD,其重要性不亚于GPU和内存,因为它直接影响了交互过程中的核心体验——切换等待时间。

Note

Micron 对PC侧高性能存储的关注,区别于其他厂商现阶段都在卷数据中心场景。猜测有几个方面的原因:

- 数据中心最终是超级大模型的竞争场,有HBM和HBF等重量级解决方案,未来的核心课题是不断降低推理成本,高性能SSD综合性价比可能有限;

- 端侧,如PC、手机由于成本和功耗限制,短时间无法跟进“超级玩家”方案,但DRAM又价格很高,所以战略上押注端侧小模型的推理场景,此时SSD就有市场空间了;

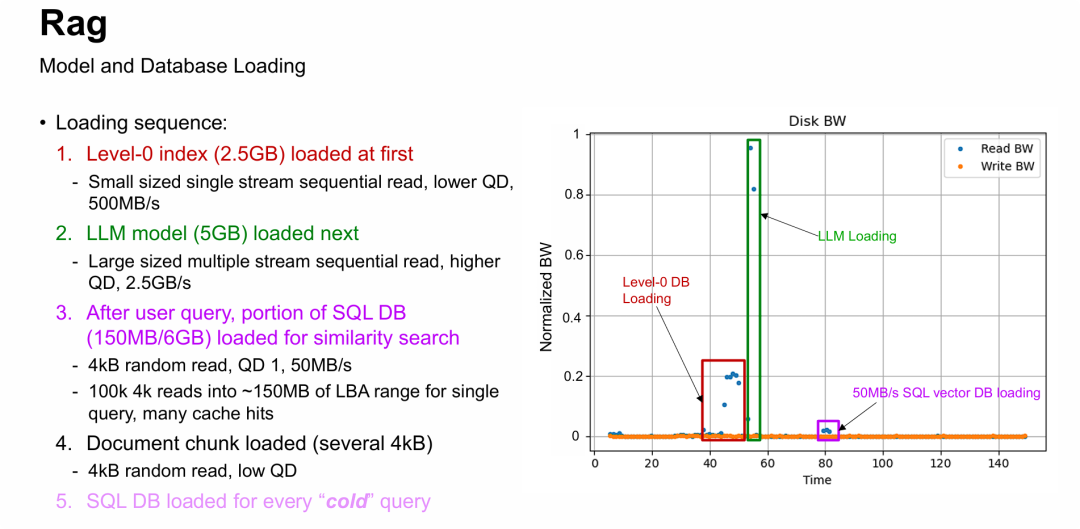

RAG 过程的IO行为及带宽分析

RAG 过程的IO行为及带宽分析

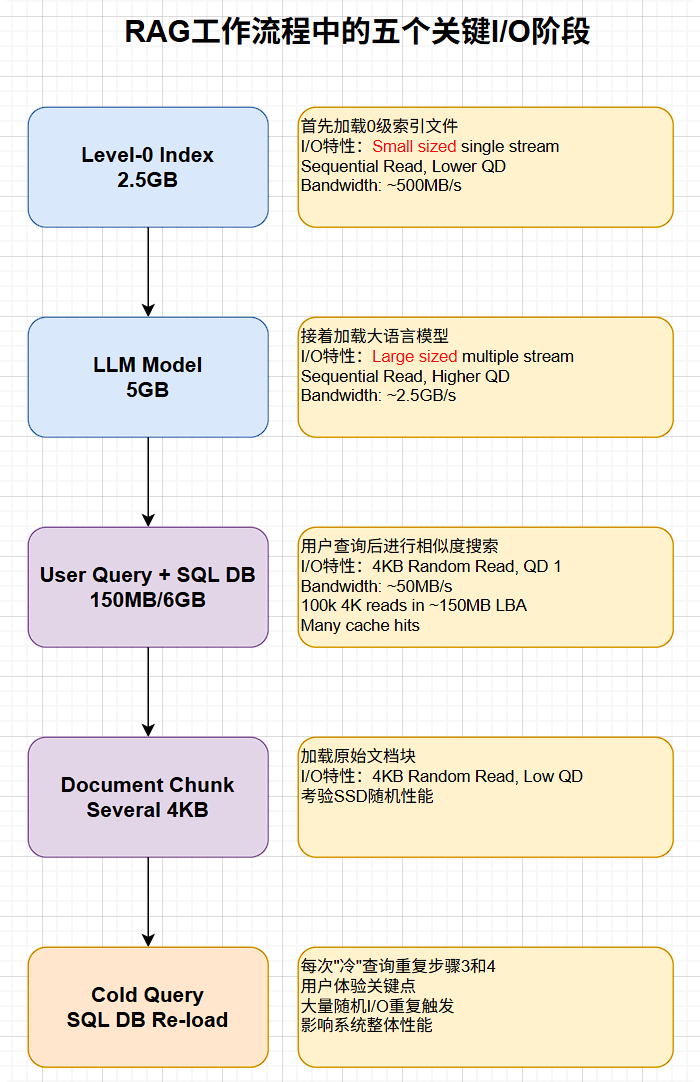

RAG 工作流程中的5个阶段IO特征

RAG 工作流程中的5个阶段IO特征

RAG工作负载对存储系统的要求是复合型的,它不仅需要在初始阶段具备极高的顺序读取带宽(用于快速加载模型和索引),更需要在用户交互阶段提供出色的随机读取性能(低延迟和高IOPS),以确保查询和检索过程的瞬时响应。

- I/O模式的动态切换:RAG的工作流程完美展示了从 “带宽敏感型”(加载模型)到 “延迟/IOPS敏感型”(数据库检索)的I/O模式转换。

- 随机读取是性能关键:虽然加载LLM时的带宽峰值非常壮观,但决定用户每次查询体验的,恰恰是那个看起来毫不起眼的、低带宽的随机读取阶段。这个阶段的延迟直接影响着RAG系统“思考”和“查找资料”的速度。

- 对SSD的“全能”要求:要流畅地运行本地RAG应用,PC需要配备一块“全能型”SSD。它既要有能快速加载GB级文件的吞吐能力,也要有能瞬时处理成千上万次小文件请求的响应能力。

Note

作者尝试从PC推理、RAG等多个阶段,来表征过程中的IO行为,最终定义端侧SSD的负载特征。

拆解了多个场景,有模型加载过程、单个模型、多模态模型、多个LLM模型,RAG过程,核心表征指标的名义带宽(BW)、文件偏移区间(file offset)给想理解推理IO行为提供了入门视角。

延伸思考

这次分享的内容就到这里了,或许以下几个问题,能够启发你更多的思考,欢迎留言,说说你的想法~

- 如果未来模型大小持续膨胀,SSD的“丢弃并重载”策略是否会因功耗或寿命问题而面临挑战?数据中心和边缘侧的存储策略应如何差异化发展?

- 针对RAG工作负载中随机读取的低延迟需求,NVMe协议中的ZNS(Zoned Namespace)或KV SSD等新兴技术,能否比传统块存储提供更本质的性能提升?

- 在AI PC的成本和功耗约束下,如何平衡GPU、DRAM和高性能SSD的投资比例,以实现最佳的AI推理性价比?

原文标题:AI Inferencing Storage IO Traffic Profiling and Analysis[1]

Notice:Human's prompt, Datasets by Gemini-2.5-Pro

#FMS25 #AI推理的IO特征

---【本文完】---

👇阅读原文,搜索🔍更多历史文章。

- https://files.futurememorystorage.com/proceedings/2025/20250807_AIML-303-1_Tang-2025-07-15-18.53.35.pdf ↩

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-26,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读