从人体视频到机器人动作部署 (Sim2Real) 技术方案

原创从人体视频到机器人动作部署 (Sim2Real) 技术方案

原创

buzzfrog

修改于 2026-02-26 20:53:01

修改于 2026-02-26 20:53:01

本方案旨在通过单目视频捕获人体动作,并将其转化为可在真实机器人上稳定运行的动力学控制策略。整个流程涵盖感知、数据处理、重定向、仿真学习和硬件部署,结合最新的计算机视觉与强化学习技术,实现高效的 Sim2Real 迁移。

1. 整体管线架构

整体管线

2. 核心环节详解

2.1 运动捕捉:GVHMR (Generalizable Video-based Human Mesh Recovery)

基于GVHMR的人体网络重建

- 输入:单目 RGB 视频(普通手机拍摄即可)。

- 核心功能:利用 GVHMR 开源库从视频中重建人体的 SMPL 序列。相比传统 HMR,GVHMR 在复杂场景下的泛化能力更强,能提供更平滑、更符合物理逻辑的根节点位移(Root Trajectory)。

- 输出:包含关节旋转(Rotation)和根节点平移(Translation)的 3D 动作序列,通常以 30fps 左右的频率输出,格式为 .npy 或 .pkl。

2.2 数据处理:帧率对齐与平滑

GVHMR 输出的原始动作序列可能包含噪声,且频率较低(如 30fps),无法直接用于高频控制(通常需要 100Hz 以上)。此阶段进行以下处理:

- 插值对齐:将动作序列的时间分辨率通过样条插值(如 Cubic Spline)提升至目标控制频率(如 100Hz 或 200Hz),确保机器人能够平滑跟踪。

- 滤波平滑:使用低通滤波器(如 Butterworth 滤波器)去除高频抖动,同时保留动作的关键特征。这有助于减少后续强化学习训练的难度,并提高 Sim2Real 的迁移效果。

- 输出:经过插值和平滑后的高频动作轨迹,作为重定向模块的输入。

2.3 动作翻译:GMR (General Motion Retargeting)

- 核心功能:解决人与机器人身材比例不一致的问题。

- 技术重点:通过 YanjieZe/GMR 的非均匀局部缩放算法,将人体的动作“翻译”给机器人。算法自动修正因腿长不同导致的“穿地”或“浮空”现象。

- 关键配置:

- URDF 文件:提供机器人的物理模型描述(连杆、关节、质量等)。

- 关节映射表:手动定义人体关节(如 left_elbow)与机器人电机(如 L_arm_joint2)的对应关系。

- 输出:重定向后的机器人关节轨迹序列(位置、速度),可直接用于仿真中的跟踪目标。

2.4 稳健性训练:BeyondMimic (Whole Body Tracking)

- 核心功能:将“动作轨迹”变成“肌肉记忆”。单纯模仿轨迹在现实中会摔倒,BeyondMimic 通过强化学习让机器人学会如何自主维持平衡。

- 环境支持:基于 NVIDIA Isaac Gym 仿真平台,利用 GPU 开启成千上万个并行环境进行极速训练。

- 训练输出:一个神经网络模型(Control Policy),它实时接收机器人传感器数据(关节角度、IMU读数等),并输出电机转矩指令。

- 关键设置:

- Reward 函数:需设计兼顾跟踪精度与稳定性的奖励项(如关节角度误差惩罚、身体高度保持、能耗惩罚等)。

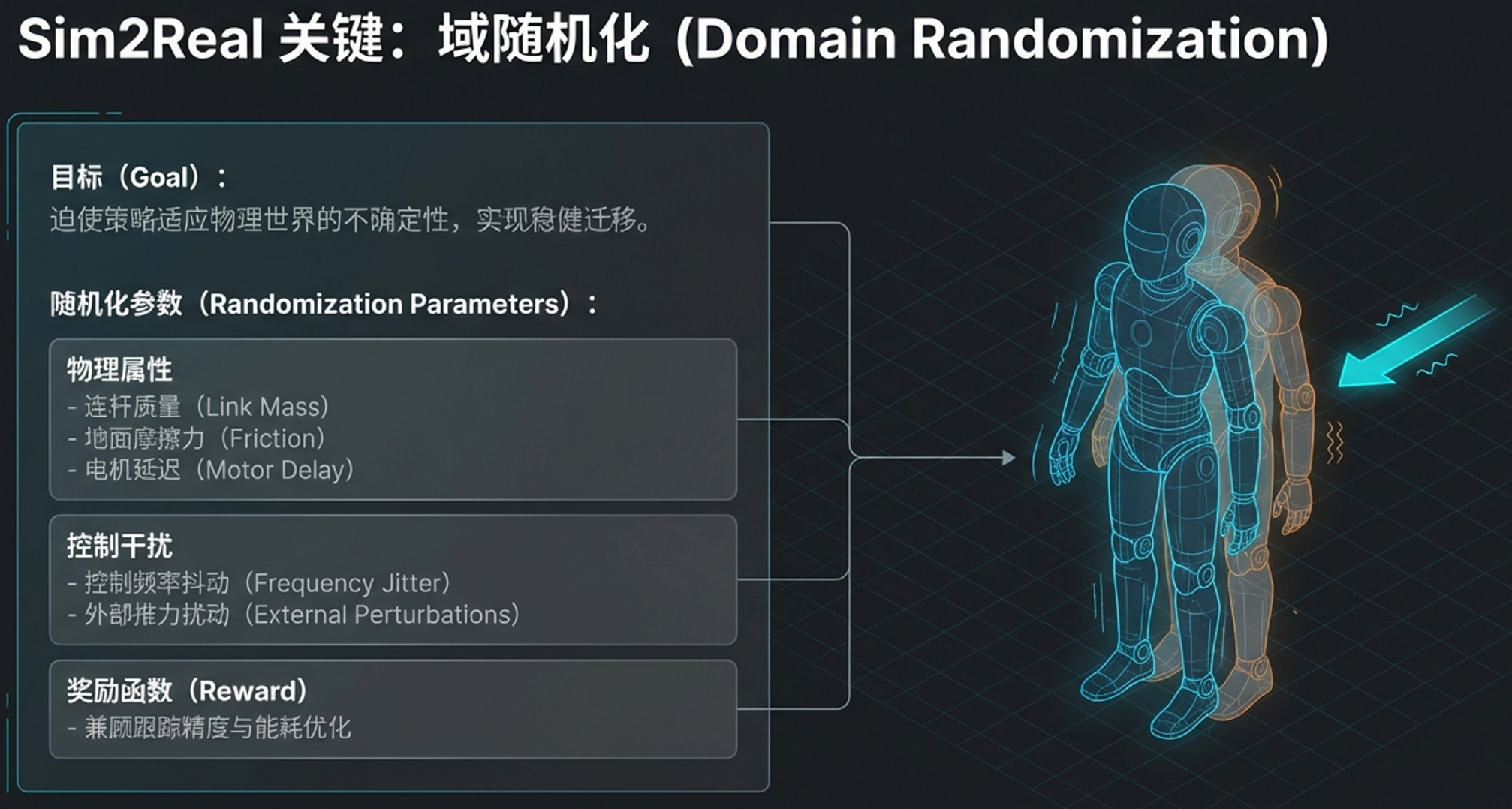

- Domain Randomization(领域随机化):在仿真中随机化环境与机器人参数(如地面摩擦力、电机延迟、连杆质量、控制频率抖动等),迫使策略学习适应真实世界的不确定性。这是 Sim2Real 成功的关键。

- 训练加速:利用 Isaac Gym 的大规模并行能力,通常只需数小时即可收敛。

2.5 部署集成:状态估计与通讯框架

训练好的策略需要与真实机器人硬件无缝集成。部署层包含两个关键组件:

- 状态估计器 (State Estimator) 机器人需要通过板载传感器实时估计自身状态,作为策略的输入。常用方法包括:

IMU 与足端编码器融合:利用扩展卡尔曼滤波(EKF)或非线性观测器计算机器人身体在世界坐标系中的位姿、速度。

关节编码器:提供实时的关节角度和角速度。

接触传感器(可选):检测足端与地面的接触,用于修正估计误差。

- 通讯与执行框架 策略输出的转矩指令必须可靠地发送至底层电机驱动器。推荐使用以下中间件:

ROS2:提供节点间通信、硬件驱动接口和工具链,支持实时性要求。

LCM (Lightweight Communications and Marshalling):低延迟的发布/订阅通信库,适用于高速控制循环。

硬件抽象层:封装电机驱动、IMU 读取等操作,使策略模型与具体硬件解耦。

3. 快速启动建议

按照以下步骤逐步推进项目,可降低集成风险:

- 运动捕捉测试 使用 GVHMR 跑通本地视频测试,导出一份 .npy 或 .pkl 格式的 3D 动作文件。

- 数据处理验证 编写脚本对动作文件进行插值和平滑,可视化检查结果是否自然,并输出为目标频率的轨迹。

- 重定向验证 将机器人 URDF 导入 GMR,观察重定向后的可视化效果(如 Mesh 或简易模型),确认关节映射合理且无穿地现象。

- 仿真训练准备 将 GMR 导出的轨迹作为目标,在 BeyondMimic 环境中配置该机器人的 Reward 函数,并开始训练。建议先在小规模并行环境下调试 Reward,再扩展至大规模训练。同时开启 Domain Randomization 以提升鲁棒性。

- 硬件集成 训练完成后,导出策略模型,通过 ROS2 节点加载模型并接收传感器数据,最终将输出指令发送至底层电机控制器。

通过以上管线,即可实现从人体视频到机器人动作的完整部署,为具身智能、遥操作等应用提供高效的技术路径。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录