重做视频本地化:OmniVoice Studio 与 VideoLingo,到底谁更适合你?

重做视频本地化:OmniVoice Studio 与 VideoLingo,到底谁更适合你?

山行AI

发布于 2026-05-06 10:07:24

发布于 2026-05-06 10:07:24

这两个开源项目正在重做视频本地化

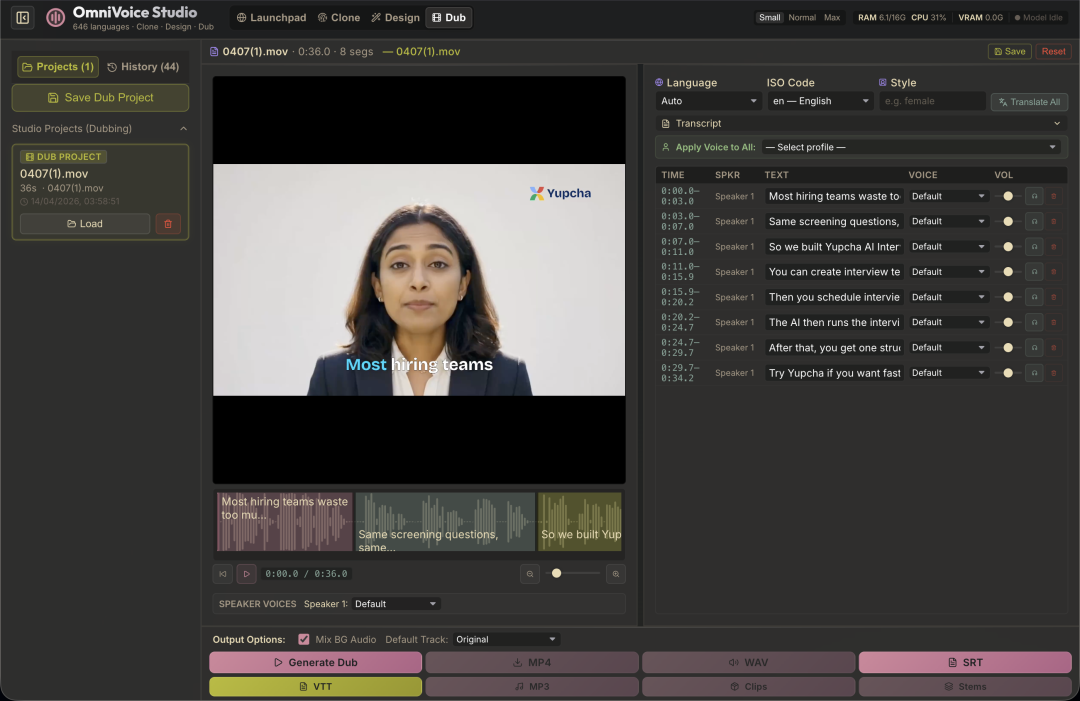

OmniVoice Studio 项目预览图

最近和视频内容相关的开源项目里,有一条很清晰的主线正在变强:不是只做“语音生成”,也不是只做“字幕翻译”,而是开始把视频本地化整条链路重新打通。

今天想放在一起聊的两个项目,分别是 OmniVoice Studio 和 VideoLingo。

它们都指向同一类需求:让一段原始视频,经过转写、翻译、字幕处理、配音与混音之后,变成更适合跨语言传播的成品内容。但两者的重点完全不同:

•OmniVoice Studio 更偏向“本地可控的电影级 AI 配音工作台”

•VideoLingo 更偏向“面向字幕质量与视频搬运场景的一站式自动化本地化流水线”

如果你只把它们都理解成“视频配音工具”,其实会低估这两个项目的价值。它们真正有意思的地方,在于分别代表了视频 AI 工作流里的两个方向:

•一个在强调声音生产能力本身

•一个在强调跨语言内容交付链路的完整性

下面我们展开看。

一、为什么现在这类工具值得关注?

过去做视频跨语种传播,往往要拆成很多段:

•先识别字幕

•再人工翻译或机翻润色

•再做时间轴对齐

•再考虑是否需要配音

•最后再处理背景音、混音和导出

问题是,这条链路里每一步都可能掉质量:

•识别不准,后面全错

•翻译太硬,字幕读起来像机器

•切句不好,观感很差

•配音和原视频氛围不匹配

•背景音丢失,成片感立刻下降

所以新一代工具开始不再只解决某个点,而是试图同时解决:

•语言理解

•字幕切分

•时间轴对齐

•配音生成

•音轨融合

•最终视频交付

OmniVoice Studio 与 VideoLingo,正是这条演进路径里的两个代表。

二、OmniVoice Studio 在做什么?

如果只用一句话概括,OmniVoice Studio 是一个本地运行、强调声音生成质量和配音掌控力的 AI 配音工作台。

它建立在开源的 OmniVoice 600 语言 zero-shot diffusion 模型之上,主打的是:

•本地运行

•无需 API Key

•无云依赖

•支持视频配音、声音克隆、声音设计与音轨处理

1)OmniVoice Studio 的核心作用

OmniVoice Studio 并不是只给你一个 TTS 面板,而是在试图把“视频配音工作室”的感觉做出来。

从项目说明看,它的核心能力主要包括:

•视频配音:支持转写、翻译、重新配音,并重新封装回 MP4

•人声分离:内置 demucs,可把人声与背景音乐拆开,尽量保留原始背景氛围

•声音克隆:只需约 3 秒音频片段,就可以克隆特定声音

•声音设计:可以直接生成新的声音角色与风格画像

•分段混音:支持逐段调整音量与增益,适合更精细的广播级音频平衡

•跨平台硬件加速:可自动识别 Apple Silicon、NVIDIA、AMD 与 CPU 环境

•实时模型遥测:能看到 CPU / RAM / VRAM 状态与模型预热进度

这意味着它的核心不是“把文字念出来”,而是围绕视频配音这件事,提供一整套更接近制作端的能力集合。

2)OmniVoice Studio 最突出的价值:可控的声音生产

很多视频翻译工具会把“配音”当作最后一步附加能力,但 OmniVoice Studio 显然不是这个思路。

它更像从一开始就站在“声音制作”视角来设计系统。

它的价值主要体现在三点:

第一,强调本地闭环

对很多创作者、工作室、媒体团队来说,本地运行意味着几件很现实的事:

•更低的隐私风险

•更可控的成本结构

•更稳定的批量生产能力

•不被外部 API 调价、限额或服务波动卡住

第二,强调声音相似度与风格塑造

声音克隆和声音设计能力,决定了它不只是“读稿器”,而更像“角色声音引擎”。

这对于以下场景非常关键:

•需要保持频道声音风格统一

•想做固定 narrator 角色

•想复制特定说话质感

•需要不同语言版本但保持品牌听感

第三,强调成片音频质量

人声分离与逐段混音能力说明,OmniVoice Studio 并不满足于“能出声”,而是更在意最终视频听起来是不是完整、自然、保留原视频氛围。

这一点会直接影响成品是否像“正式内容”,还是只是“AI 处理过的素材”。

3)OmniVoice Studio 更适合谁?

如果你更在意下面这些事情,OmniVoice Studio 会很有吸引力:

•想在本地搭一个高质量 AI 配音工作台

•很在意声音克隆、声音设计与风格控制

•需要对音轨进行更精细的后期调节

•希望保留原视频背景音氛围

•更偏向内容制作端,而不是单纯字幕生产端

一句话概括:OmniVoice Studio 偏“音频与配音制作中枢”。

OmniVoice Studio 工作台界面

三、VideoLingo 在做什么?

如果说 OmniVoice Studio 更像“声音工作台”,那么 VideoLingo 更像“视频本地化流水线总包工具”。

它的目标很明确:以接近 Netflix 级别的字幕切割、翻译、对齐和配音效果,把视频跨语言处理做成一条一键式自动化流程。

项目描述里最值得注意的关键词有几个:

•Netflix-level subtitle cutting

•translation

•alignment

•dubbing

•one-click fully automated

这意味着 VideoLingo 的重心不是声音本身,而是视频本地化交付质量。

1)VideoLingo 的核心作用

从 README 给出的能力看,VideoLingo 主要覆盖了以下链路:

•视频下载:支持通过 yt-dlp 拉取视频

•逐词级识别:基于 WhisperX 做词级字幕识别

•字幕切分:使用 NLP 与 AI 做更适合阅读的字幕分段

•术语体系管理:支持自定义术语与 AI 生成术语,保证翻译一致性

•三段式翻译流程:Translate → Reflect → Adaptation,目标是提升成片语言自然度

•字幕标准化:强调单行字幕与更接近 Netflix 标准的呈现

•多引擎配音:可接入 GPT-SoVITS、Azure、OpenAI 等配音方案

•一键式启动:通过 Streamlit 提供较低门槛的操作体验

这套能力说明,VideoLingo 实际上想解决的是:

如何把“识别、翻译、切句、对齐、配音”这些本来碎片化的工序,整合成一条稳定、可复用的视频翻译与搬运流水线。

2)VideoLingo 最突出的价值:字幕与翻译质量优先

和很多只重视“语音听起来像不像”的工具相比,VideoLingo 更重视一个常被低估的问题:

观众首先看到的,往往不是配音效果,而是字幕是否顺、是否准、是否像专业成片。

它强调的“Netflix 级字幕切割”,背后其实是很专业的本地化要求:

•切句不能太碎

•每行信息量要适中

•字幕节奏要跟观看节奏一致

•语义单位不能乱断

•翻译要自然,不要一股直译味

再加上术语管理和三段式翻译流程,它明显不是只追求“能翻出来”,而是追求更像专业字幕组做出来的效果。

3)VideoLingo 更适合谁?

如果你的核心问题是这些,VideoLingo 会更对路:

•想把外语视频高效转成适合中文受众消费的内容

•很在意字幕切割、翻译自然度与时间轴对齐

•做视频搬运、本地化二创或知识跨语种传播

•希望流程尽量自动化、门槛尽量低

•希望一条链路内就把下载、识别、翻译、字幕、配音都做完

一句话概括:VideoLingo 偏“视频本地化交付流水线”。

VideoLingo 项目标识

四、OmniVoice Studio 与 VideoLingo 的专业对比

把这两个项目放在一起看,最重要的不是比谁功能更多,而是看清楚它们各自优化的核心目标。

1)定位不同:一个偏声音制作,一个偏视频本地化

•OmniVoice Studio 的中心是“声音生产能力”,尤其是本地配音、声音克隆和音频后期控制。

•VideoLingo 的中心是“视频翻译交付能力”,尤其是字幕质量、翻译流程、对齐和自动化处理。

所以它们不是简单替代关系,而更像是在视频跨语种链路上覆盖了不同重点。

2)能力重心不同:OmniVoice Studio 强在声音,VideoLingo 强在字幕链路

从专业角度看:

•OmniVoice Studio 更像“audio-first”

•VideoLingo 更像“subtitle-and-localization-first”

前者的核心竞争力来自:

•声音克隆

•新声音设计

•本地推理

•人声分离

•分段混音

后者的核心竞争力来自:

•词级识别

•更专业的字幕切分

•术语一致性管理

•更自然的翻译流程

•自动化一体化交付

3)交付对象不同:创作团队 vs 本地化流水线团队

•OmniVoice Studio 更适合那些把“声音本身”当成产品质量关键变量的团队。

•VideoLingo 更适合那些把“跨语言视频转换效率与标准化交付”当成核心目标的团队。

如果你是做:

•角色讲述

•品牌 narrator

•视频重配音

•强调声音统一性的内容产品

那么 OmniVoice Studio 更有吸引力。

如果你是做:

•外语视频字幕翻译

•海外内容本地化搬运

•教学、知识、资讯视频跨语传播

•强调自动化批处理的视频团队

那么 VideoLingo 更像更直接的生产工具。

4)本地化理念不同:OmniVoice Studio 重“音色与沉浸感”,VideoLingo 重“字幕与叙事可读性”

这是我觉得最关键的一层差异。

OmniVoice Studio

它更在意:

•这个声音像不像真人

•声音风格能不能复制

•原视频的氛围能不能保住

•混音后是不是更像正式制作

VideoLingo

它更在意:

•字幕是不是足够专业

•翻译是不是足够自然

•切句是不是足够适合观看

•多语言传播时信息有没有失真

这意味着:

•OmniVoice Studio 更接近“声音导演工具”

•VideoLingo 更接近“AI 字幕组 + 本地化总控工具”

5)自动化程度与可控性取舍不同

•OmniVoice Studio 更强调制作环节的细颗粒度掌控

•VideoLingo 更强调端到端的一键式自动化

这背后其实是两种典型取舍:

•想要更强可控性,通常会牺牲一点流程极简

•想要更强自动化,通常会牺牲一部分精细制作自由度

所以选型时,关键不是谁“更先进”,而是你到底更需要:

•制作控制权

•还是 流水线效率

五、如果只能先选一个,应该怎么判断?

可以用一个很简单的判断方式。

优先选 OmniVoice Studio,如果你更在意:

•配音质量

•声音克隆

•音色设计

•本地部署与隐私可控

•背景音保留与混音质量

•更像工作室而不是流水线

优先选 VideoLingo,如果你更在意:

•字幕切分质量

•翻译自然度

•视频本地化全流程自动化

•一键处理与批量搬运效率

•多语言内容快速改造与交付

•更像“自动化字幕组”而不是单点配音器

六、这两个项目透露了什么趋势?

我觉得它们一起出现,透露出一个非常明确的行业信号:

视频 AI 工具正在从“单点生成能力”走向“完整交付工作流”。

以前大家更关注:

•谁的 TTS 更像人

•谁的翻译模型更强

•谁的字幕识别更准

但现在真正竞争的焦点,正在变成:

•谁能把整条视频本地化流程打通

•谁能把中间损耗降到最低

•谁能让普通团队也获得接近专业制作的结果

•谁能在成本、隐私、自动化和质量之间给出更好的平衡

从这个角度看:

•OmniVoice Studio 代表的是“本地可控的 AI 配音制作台”

•VideoLingo 代表的是“高质量字幕驱动的视频本地化流水线”

两者都不是简单工具,而是在往“AI 原生视频后期系统”演化。

七、最后总结

如果要做一个简洁总结,我会这样概括:

•OmniVoice Studio:更适合把视频配音、声音克隆、音轨处理这件事做深做细,重点在声音质量与本地制作掌控力。

•VideoLingo:更适合把字幕识别、翻译、切分、对齐和配音整合成一条自动化本地化链路,重点在交付效率与字幕专业度。

它们分别优化的是视频跨语言生产里的两个核心维度:

•一个优化 “声音像不像、稳不稳、可不可控”

•一个优化 “字幕顺不顺、翻译准不准、流水线通不通”

如果你正在做视频国际化、知识视频跨语传播、内容搬运本地化,或者想搭建属于自己的 AI 视频制作栈,这两个项目都非常值得认真看。

参考来源

•OmniVoice Studio:https://github.com/debpalash/OmniVoice-Studio[1]

•VideoLingo:https://github.com/Huanshere/VideoLingo[2]

声明

本文由山行整理自:https://github.com/debpalash/OmniVoice-Studio 和 https://github.com/Huanshere/VideoLingo ,如果对您有帮助,请帮忙点赞、关注、收藏,谢谢~

参考链接

[1] https://github.com/debpalash/OmniVoice-Studio: https://github.com/debpalash/OmniVoice-Studio

[2] https://github.com/Huanshere/VideoLingo: https://github.com/Huanshere/VideoLingo

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录