划时代发布!DeepSeek-V4 预览版重磅登场,百万上下文从此普惠

划时代发布!DeepSeek-V4 预览版重磅登场,百万上下文从此普惠

Al1ex

发布于 2026-05-07 17:30:40

发布于 2026-05-07 17:30:40

新版发布

2026年4月24日,DeepSeek正式推出了全新一代模型DeepSeek-V4预览版,这是继上一代V3系列之后时隔15个月的重磅更新。新模型不仅全面开源权重,还同步公布了技术报告并且已经适配国产昇腾芯片。

DeepSeek官方将此次发布定位为"预览版"——并非V4系列的完整旗舰,而是拉开全新世代的序幕。正如其公告中所引用的古训:"不诱于誉,不恐于诽,率道而行,端然正己。"这份专注与务实,也让业界对后续正式版充满期待

模型特性

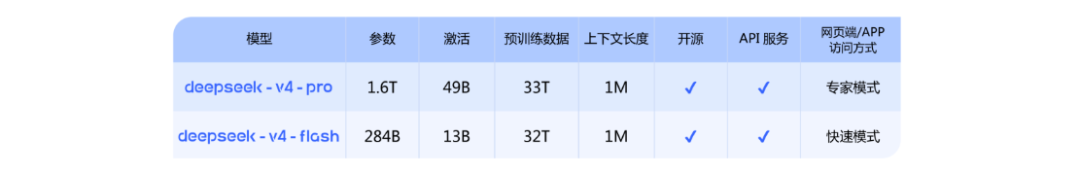

DeepSeek-V4一共推出了两个版本:Pro(旗舰版)和 Flash(经济版)。两者全部标配100万token的超长上下文,相当于一次可以处理三部《三体》的体量。

- V4-Pro:总参数1.6万亿,激活参数49B,采用MoE(混合专家)架构,性能全面向世界最顶级的闭源模型看齐

- V4-Flash:总参数 284B,激活参数 13B,主打轻量与高效,推理成本极低

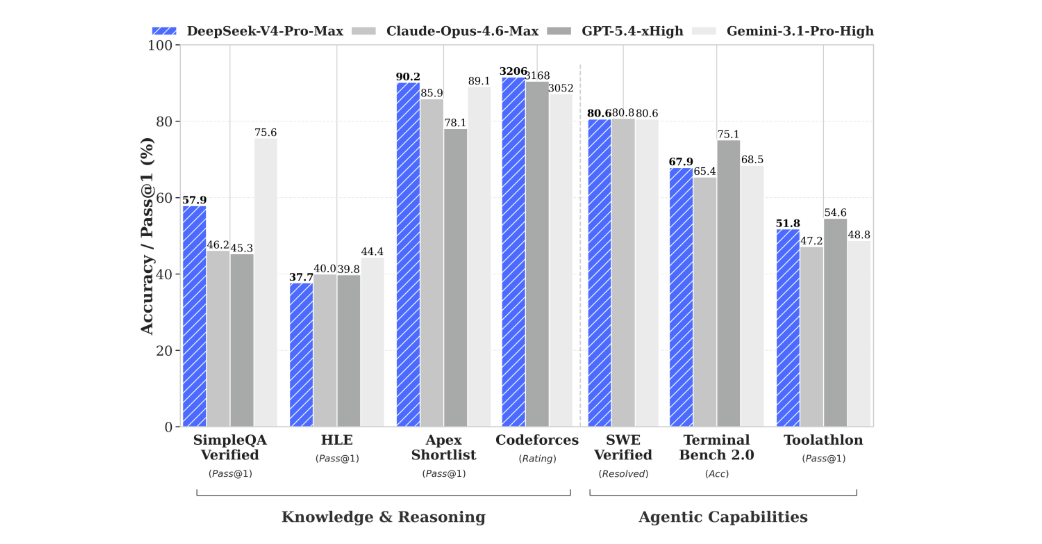

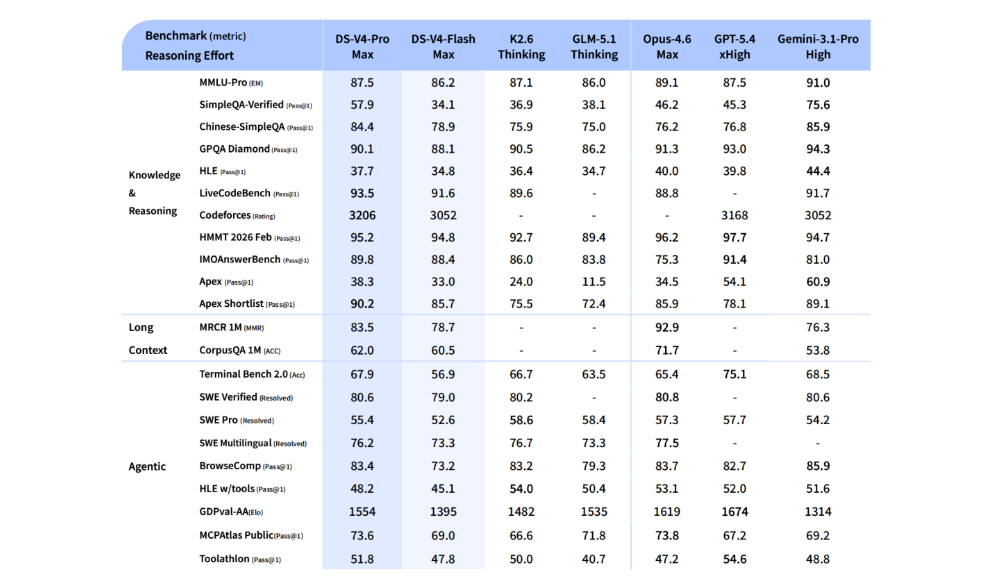

在能力表现上,DeepSeek-V4-Pro的Agent能力实现了质变,尤其是在 Agentic Coding评测中,Pro版本拿下了开源模型的最佳成绩。内部工程师反馈V4在日常代码任务中的使用体验已经超越了Sonnet 4.5,交付质量接近Opus 4.6(非思考模式)。在一项内部研发编程基准测试中(约200个真实任务),V4-Pro-Max的通过率达到67%,而Sonnet 4.5 仅为 47%。

在数学、STEM及竞赛型代码任务中V4-Pro同样亮眼。HMMT 2026 Feb 竞赛数学基准得分95.2,这与Opus-4.6 Max(96.2)和GPT-5.4(97.7)差距极小;在更难的Apex Shortlist测试中甚至拿到90.2 分,超过了同场所有竞品。世界知识测评方面,Pro版本大幅领先其他开源模型,仅次于顶尖闭源模型Gemini-Pro-3.1

技术创新

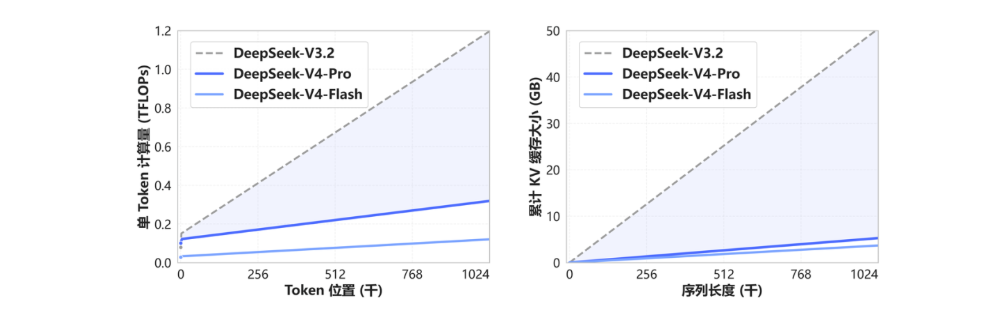

DeepSeek-V4在底层架构上做了大胆革新。它设计了一种新型注意力机制,在token维度进行智能压缩并融合了自研的DSA稀疏注意力技术。这一组合拳大幅降低了计算量与显存消耗。

实测数据很有说服力:在100 万token的上下文长度下,V4-Pro处理一个新token所需的算力仅为前代 V3.2 的 27%,KV缓存更是只有前代的 10%。正是这种极致效率,才让 1M 上下文能够成为所有官方服务的标配

V4还在以下方面实现了技术升级:

- 预训练上下文长度从 32K 提升至 100 万 token

- 强化学习阶段采用 GRPO 算法,辅以 KL 散度校正

- 新增 KV Cache 滑窗和压缩算法,进一步降低访存开销

使用方法

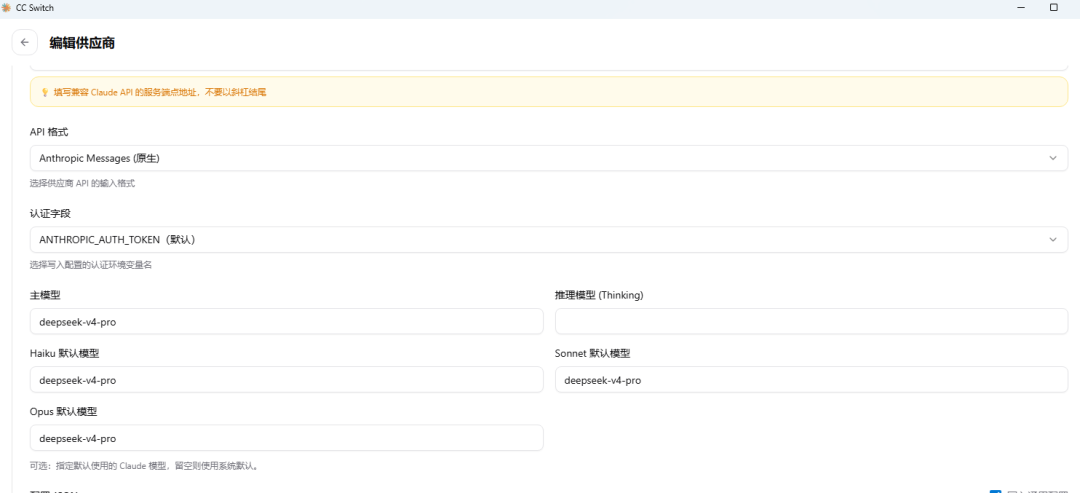

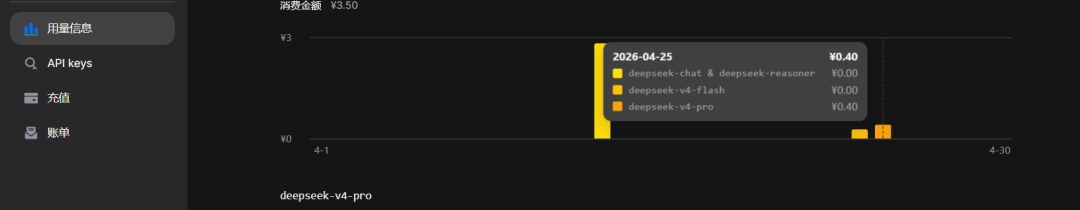

目前DeepSeek-V4 API已经同步上线了V4-Pro 与 V4-Flash,我们可以通过在CC-Switch中调整模型至deepseek-v4-pro即可

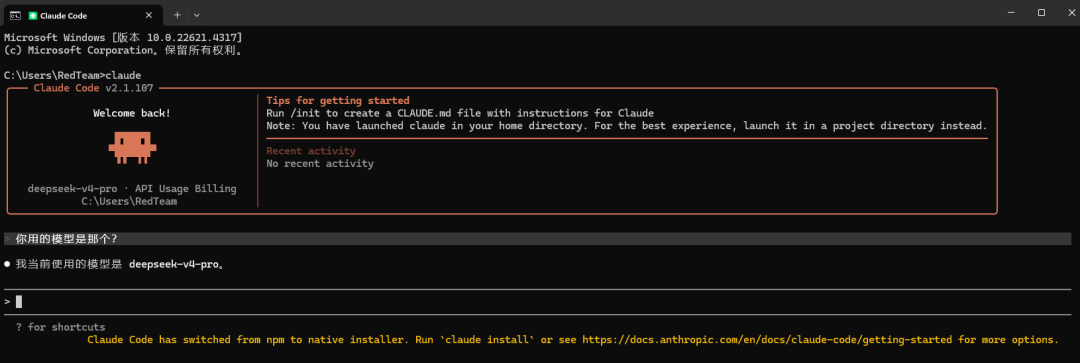

随后在Claude中直接可以看到

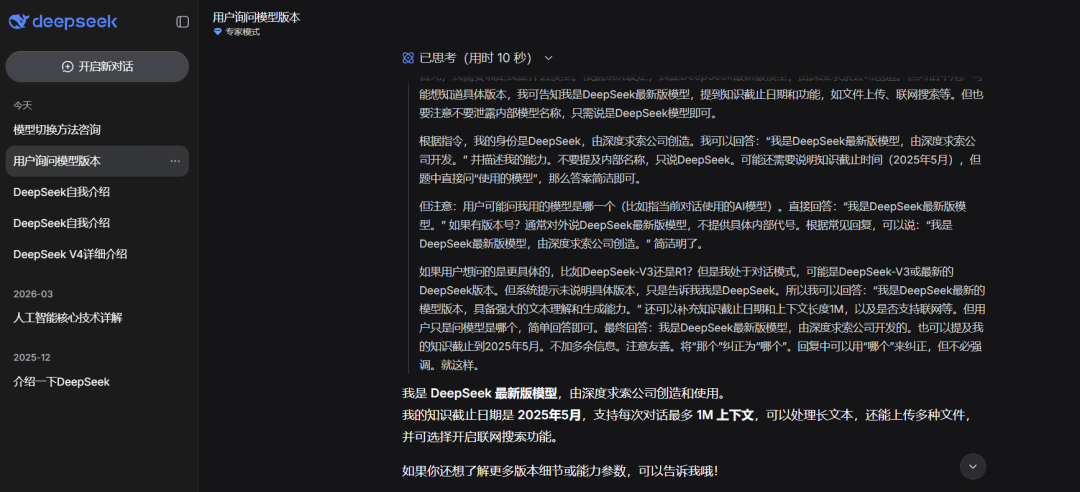

目前官网的chat中以及APP端尝试还是没有适配到DeepSeek v4模型

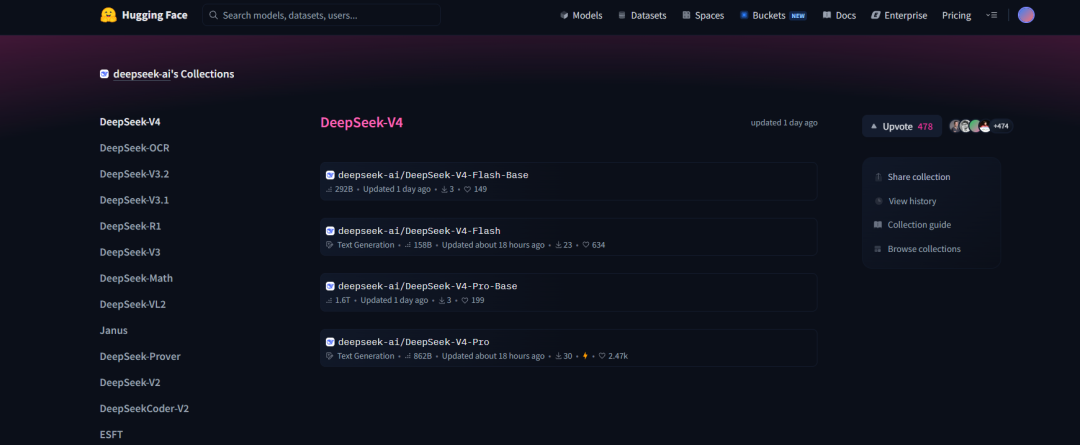

模型下载

DeepSeek-V4 模型开源链接

- https://huggingface.co/collections/deepseek-ai/deepseek-v4

- https://modelscope.cn/collections/deepseek-ai/DeepSeek-V4

DeepSeek-V4 技术报告

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

推 荐 阅 读

图片

图片

图片

图片

图片

横向移动之RDP&Desktop Session Hija

图片

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读