YOLO精准定位+云端大模型诊断,才是工业质检的终极答案

原创YOLO精准定位+云端大模型诊断,才是工业质检的终极答案

原创

AI小怪兽

发布于 2026-05-08 17:11:07

发布于 2026-05-08 17:11:07

工业检测的真相:产线离不开YOLO,VLM只能躲在云端“非实时” —— WeldLLM带来的协同范式

大家好,我是AI小怪兽。

走进任何一家工厂的质检车间,控制器里十有八九跑的是YOLO。而你在论文里看到的各种惊艳的视觉大模型(VLM),几乎找不到一台部署在生产线上。这不是技术保守,而是工业的物理规律使然。今天,我将结合WeldLLM这篇顶刊论文,深度拆解:YOLO在工业应用中还有哪些硬骨头?为什么Qwen-VL这类大模型还无法“下放”到边缘?云端非实时处理为什么是当前最靠谱的路线?

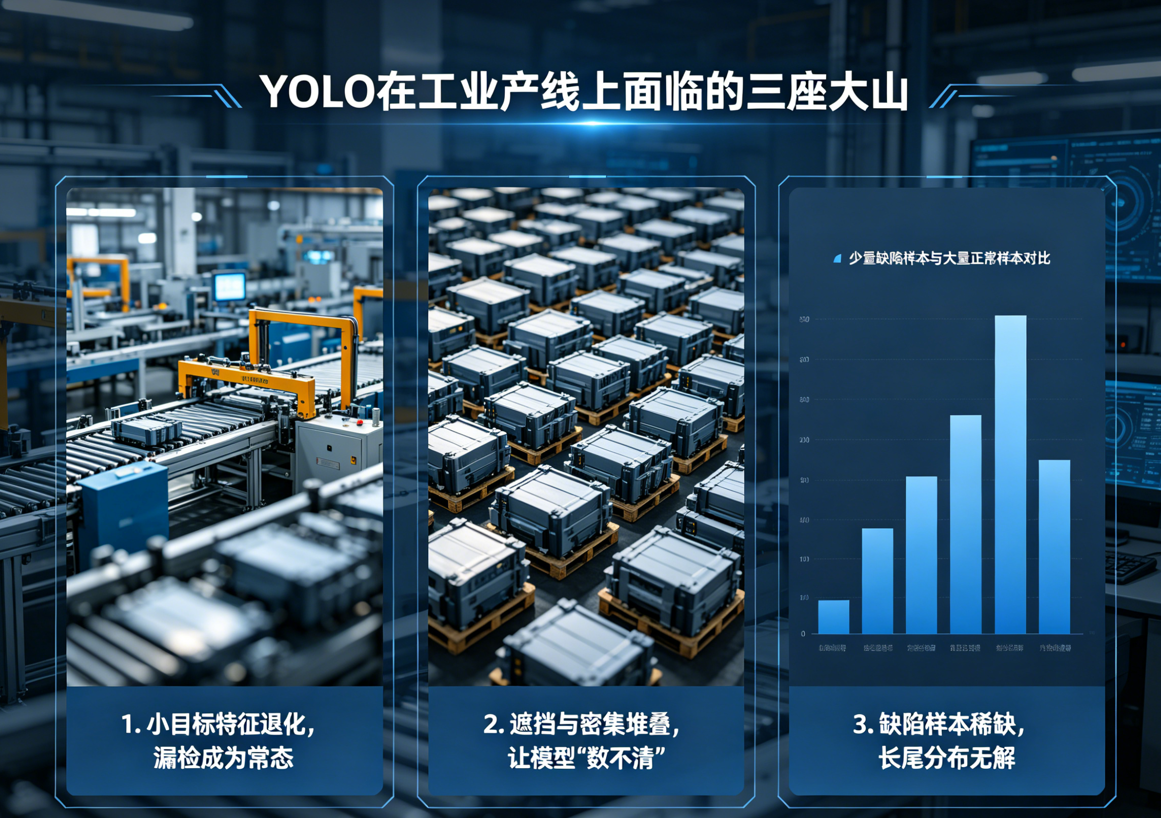

一、YOLO在工业产线上面临的三座大山

YOLO作为目标检测的“万金油”,在工业场景中被广泛应用,但产线上的真实痛点远比实验室复杂。

1. 小目标特征退化,漏检成为常态。 工业缺陷往往微小:划痕宽度仅几个像素、电子元件焊点仅几十个像素。经过YOLO骨干网络的多层卷积下采样,这些微小信号极易被深层特征图“淹没”。以PCB板上的虚焊检测为例,默认YOLOv8模型在10倍放大图像下的漏检率高达35%。这正是为什么许多工业项目最终不得不采用分割模型,因为只有像素级的掩码才能捕获微小缺陷的完整形态。

2. 遮挡与密集堆叠,让模型“数不清”。 在仓储物流或装配线上,物体相互遮挡、紧密排列是常态。标准YOLO的NMS后处理在重叠目标面前经常“打架”:要么把两个物体误判为一个,要么漏掉被遮挡的那个。我曾在一个螺丝分拣项目中看到,YOLOv8把三个重叠的螺丝识别成两个,导致后续机械手抓取失败。

3. 缺陷样本稀缺,长尾分布无解。 工业场景追求“零缺陷”,缺陷品本来就少。一个新出现的缺陷类型可能只有3-5张真实图像。有监督YOLO需要大量标注数据,面对这种极端不平衡,要么过拟合,要么根本学不到。这也是为什么工业界一直对有监督分割“又爱又恨”——它能给出精确的缺陷类别和边界,但标注成本高得吓人。

我的总结:YOLO在工业落地中的痛点,本质上可以归结为“看不清”(小目标/遮挡)和“认不全”(缺样本/类别不平衡)。而纯检测模型的另一个致命短板是:它只会输出一个类别标签,不会告诉你“为什么是这个缺陷”“该怎么修”。

二、YOLO26的架构进化:边缘原生,但仍缺“大脑”

2025年底发布的YOLO26,在边缘部署上做了大量减法,正是为了回应工业场景的严苛要求。

- 无NMS推理:彻底移除非极大值抑制后处理,模型直接输出最终结果,消除了动态内存分配和延迟抖动。在工控机上推理速度提升明显,稳定性大幅增强。

- 移除DFL模块:简化导出流程,ONNX/TensorRT量化无障碍,INT8部署后参数量和计算量进一步压缩。

- STAL小目标感知标签分配:在训练阶段就为微小目标分配更精细的采样点,避免小目标被大目标覆盖。实测在Jetson Orin上,YOLO26n对微小裂纹的分割mAP比YOLO11高出4个百分点。

- 极致轻量:YOLO26n仅1.4M参数,2.1G FLOPs,CPU推理速度比YOLO11n快43%。

但是,YOLO26再强,它依然只是一个“检测器”。它能告诉你“这里有一个气孔缺陷”,却说不出来“这个气孔可能是焊接电流过大导致的,建议调整参数”。工业质检的终点不是检测,而是诊断和决策。这恰恰是YOLO的盲区。

我实验后得出的结论:YOLO26已经把边缘端的实时性、准确性和轻量化推到了极致,但它需要一个“大脑”来赋予它语义理解的能力。

三、VLM为什么下不了产线?边缘端的死结

视觉大模型(如Qwen-VL)在零样本检测和开放词汇识别上确实惊艳,但为什么工厂里看不到?我们直接算一笔账。

算力死结:8B模型需要16GB显存,而工业工控机普遍无独显。

Qwen2.5-VL-7B模型,仅BF16权重就占用16GB显存。工业现场最常见的工控机配置是Intel i5/i7 CPU + 8GB/16GB共享内存,根本没有独立显卡。即便是高端的Jetson AGX Orin,虽有32GB共享内存,但运行7B模型时,推理延迟轻松超过200ms。

延迟死结:产线要求≤50ms,VLM动辄数百毫秒。

在一条节拍为每秒2个产品的产线上,每个检测环节的端到端延迟必须控制在50ms以内。VLM的单图推理时间在这个量级面前完全不达标。你可以优化模型、做量化、剪枝,但无论如何压缩,一个7B参数的模型在边缘设备上的推理速度都远无法满足实时性。

成本死结:批量部署VLM的硬件投入是天文数字。

一条产线需要几十台工控机,如果每台都要配备高端GPU,硬件成本直接翻5-10倍。再加上模型更新、环境维护、故障排查的隐性成本,任何企业都无法承受。

实际案例:某汽车零部件制造商曾尝试在边缘部署Qwen-VL-4B(FP16量化版),结果单次推理耗时380ms,导致产线频繁停线等待。最终他们不得不将模型撤回云端,仅用于离线抽检。

我的总结:VLM的边缘化部署,在当前硬件条件下几乎不可能。这不是算法问题,而是物理极限。工业界必须接受这个现实,并为VLM寻找更合适的定位。

四、可行的出路:云端非实时处理,YOLO+VLM协同

既然边缘跑不动VLM,那就不跑。工业场景中存在大量非实时需求,正是VLM的用武之地。

什么是非实时需求?

- 离线抽检:每批次随机抽取几个样品,做深度分析。

- 新品导入:新品类上线前,用零样本VLM快速评估可能出现的缺陷类型,不需要训练。

- 质量审计:每天/每周汇总检测结果,由VLM生成诊断报告,分析缺陷趋势和根本原因。

- 知识库构建:将历史缺陷图像和检测结果喂给VLM,自动生成缺陷分类标准和维修建议。

WeldLLM框架的启示:YOLO精准定位 + Qwen-VL云端推理。

2026年初发表在IEEE TII上的WeldLLM,正是这条路径的典范。焊接缺陷检测(裂纹、气孔、夹渣等)对比度低、形态多变,传统纯视觉方法精度和可解释性都不足。WeldLLM的做法是:

- 边缘端:部署定制的WTDWR-YOLO检测网络。该网络引入了膨胀加权残差分割模块和小波变换卷积模块,显著提升了对低对比度缺陷的识别能力。它实时运行在工控机上,完成像素级缺陷定位和分类。

- 云端:检测输出的区域视觉特征和结构化属性,通过轻量级模态对齐模块编码为令牌序列,送入Qwen-VL大模型。Qwen-VL采用LoRA高效微调,具备焊接领域的专家级诊断能力,能自动生成缺陷原因分析和维修建议的可视化报告。

- 协同流程:边缘YOLO每帧实时检测,将疑似缺陷的ROI图像和特征异步上传至云端;云端VLM以离线方式批量处理,生成诊断结论供质量工程师参考。整个过程不干扰生产线节拍。

实验结果证明,WeldLLM在检测精度和可解释性上显著优于现有方法。更重要的是,这套架构已经在真实焊接产线中落地,云端推理成本可控,边缘实时性不受影响。

我的建议:对于绝大多数工业质检场景,都应该采用这种“边缘检测+云端诊断”的协同模式。YOLO负责毫秒级响应、高精度定位;VLM负责秒级到分钟级的语义分析和报告生成。两者各司其职,优势互补。

五、工业应用的未来:从“检出来”到“讲清楚”

2026年,YOLO论文的方向已经从“加个注意力模块”转向了垂直场景的深度优化和与VLM的协同。做工业应用的工程师,应该关注以下趋势:

趋势1:YOLO继续精进边缘性能。 YOLO26的无NMS、轻量化设计只是开始。未来骨干网络会更大程度引入大核卷积和门控机制,在保持低FLOPs的前提下提升感受野和表达力。

趋势2:VLM云端服务化成为标配。 随着FP8量化、PagedAttention等技术的成熟,VLM的云端推理成本将进一步下降。企业可以轻松搭建私有化大模型服务,用于非实时的缺陷诊断和质量分析。

趋势3:检测与诊断的闭环数据流。 YOLO检测出的缺陷图像和特征,将持续喂给VLM,让大模型不断学习新缺陷类型,反哺检测器的训练和优化。这是一个正向循环。

我实验后得出的结论:工业检测的终极形态,不是某个单一模型包打天下,而是“检测模型(实时、轻量、高精度)”与“大语言模型(离线、深度、可解释)”的协同体。YOLO负责“看见”,VLM负责“看懂”。

写在最后

回到最初的问题:现在还能用YOLO做工业项目吗?不但能,而且大有可为。但切忌闭门造车。下次你设计工业质检系统时,请这样思考:

- 实时检测、高帧率、边缘部署 → 选YOLO26,针对你的缺陷特点定制模块(如小波变换、可变形卷积)。

- 缺陷分类后,需要诊断原因和生成报告 → 搭建云端VLM服务(Qwen-VL或类似),用LoRA微调你的领域知识,进行非实时推理。

- 将YOLO的检测结果和ROI图像自动上传,VLM定期生成分析报告,指导工艺改进。

我的总结:工业检测的“最后一公里”,不是单纯提高检测精度,而是打通“感知→理解→决策”的完整链路。YOLO和VLM的握手,正是这条链路的关键锁扣。

让每一行代码都有温度,我们产线下期见!🚀

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录