Swin + YOLO26:层级 ViT 的多尺度优势

Swin + YOLO26:层级 ViT 的多尺度优势

javpower

发布于 2026-05-08 18:49:20

发布于 2026-05-08 18:49:20

Swin + YOLO26:层级 ViT 的多尺度优势

Swin Transformer 出来有一段时间了,但一直没在工业检测项目里用过。最近试了一下 Swin + YOLO26 的组合,体验不错。

Swin Transformer 层级架构:4 级特征金字塔,Shifted Window 注意力机制

Swin Transformer 层级架构:4 级特征金字塔,Shifted Window 注意力机制

Swin Transformer 是什么

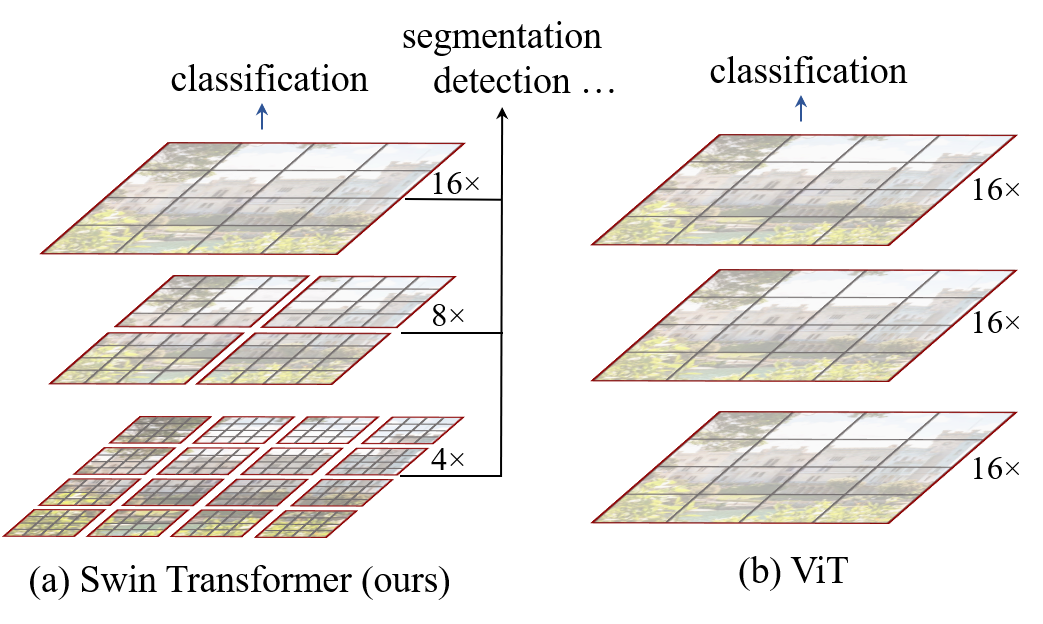

Swin Transformer 是 Microsoft 在 2021 年提出的 Vision Transformer 变体,核心特点是层级设计和 Shifted Window 注意力。

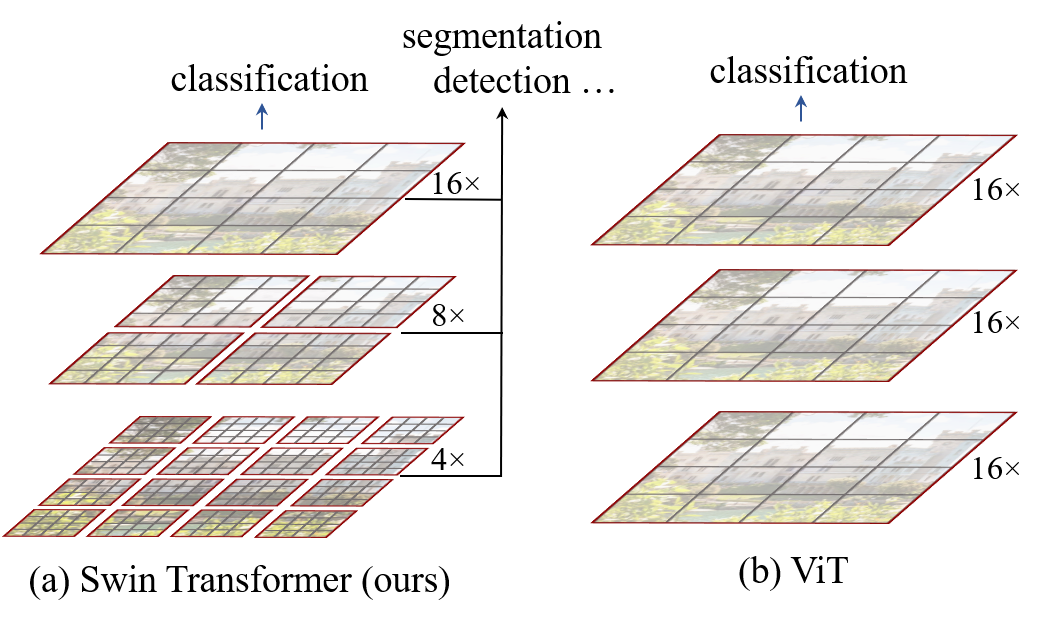

层级设计:和 CNN 类似,Swin 有 4 个 stage,每个 stage 的特征图尺寸减半、通道数翻倍。这种结构天然适合多尺度检测任务。

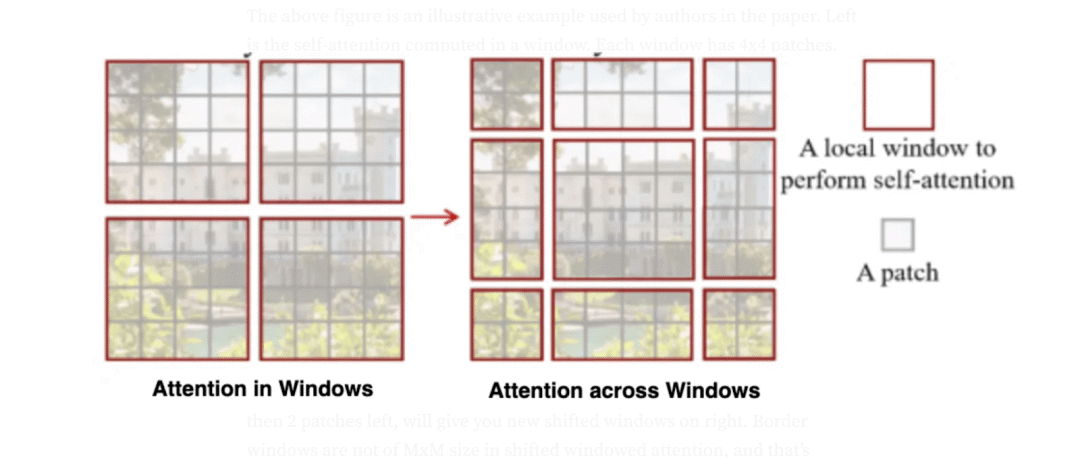

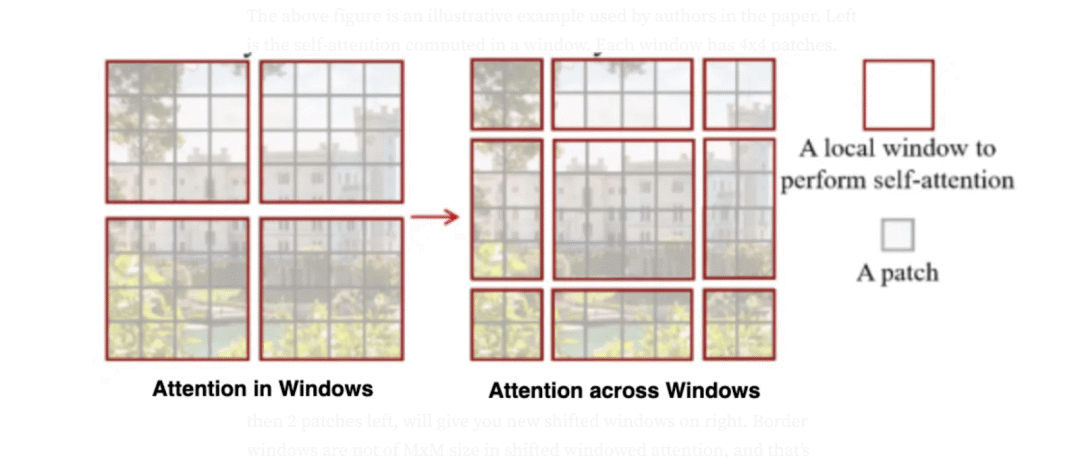

Shifted Window:传统 ViT 用全局自注意力,计算量是 O(N²)。Swin 把注意力限制在局部窗口内(比如 7×7 patch),再用 shifted 机制让不同窗口之间有信息交互。兼顾了效率和效果。

以下是优化后的文章,所有 ASCII 流程图已替换为 Mermaid 图表,并配上了相关技术插图,排版更精致直观:

Swin + YOLO26:层级 ViT 的多尺度优势

Swin Transformer 出来有一段时间了,但一直没在工业检测项目里用过。最近试了一下 Swin + YOLO26 的组合,体验不错。

Swin Transformer 层级架构:4 级特征金字塔,Shifted Window 注意力机制

Swin Transformer 层级架构:4 级特征金字塔,Shifted Window 注意力机制

Swin Transformer 是什么

Swin Transformer 是 Microsoft 在 2021 年提出的 Vision Transformer 变体,核心特点是层级设计和 Shifted Window 注意力。

层级设计:和 CNN 类似,Swin 有 4 个 stage,每个 stage 的特征图尺寸减半、通道数翻倍。这种结构天然适合多尺度检测任务。

Shifted Window:传统 ViT 用全局自注意力,计算量是 O(N²)。Swin 把注意力限制在局部窗口内(比如 7×7 patch),再用 shifted 机制让不同窗口之间有信息交互。兼顾了效率和效果。

ImageNet 结果:

模型 | 参数量 | Top-1 |

|---|---|---|

Swin-T | 28M | 81.3% |

Swin-S | 50M | 83.0% |

Swin-B | 88M | 83.5% |

Swin-L | 197M | 84.0% |

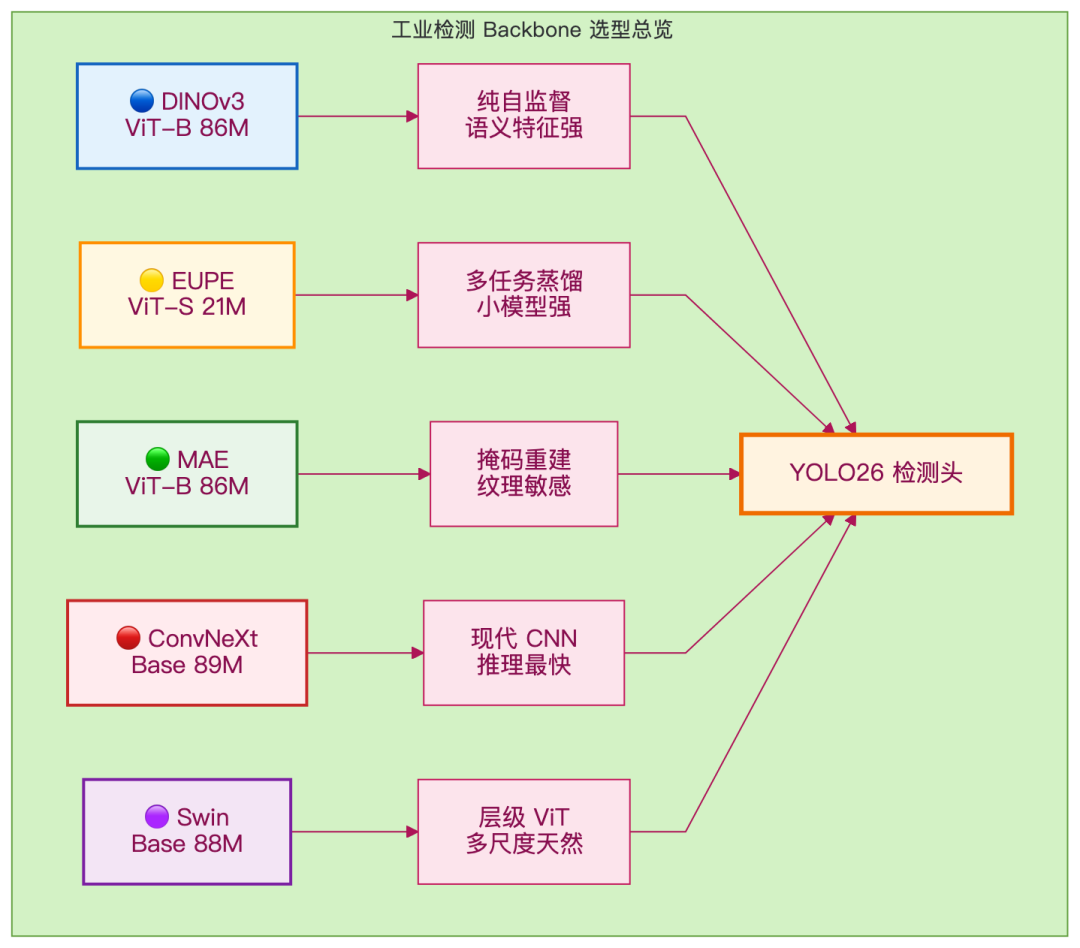

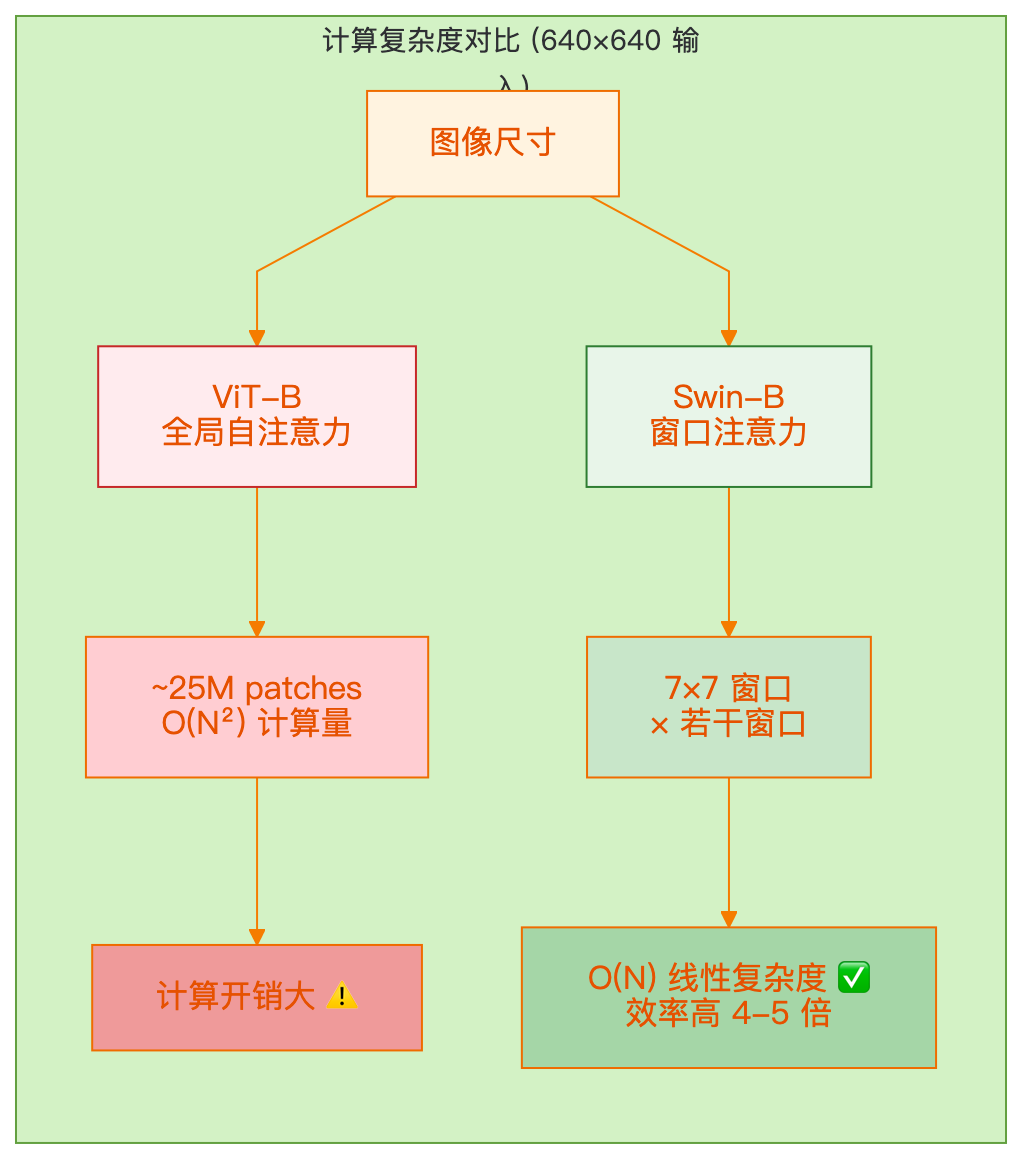

为什么考虑 Swin 而不是 ViT

和标准的 ViT (比如 DINOv3/EUPE) 相比,Swin 有几个特点:

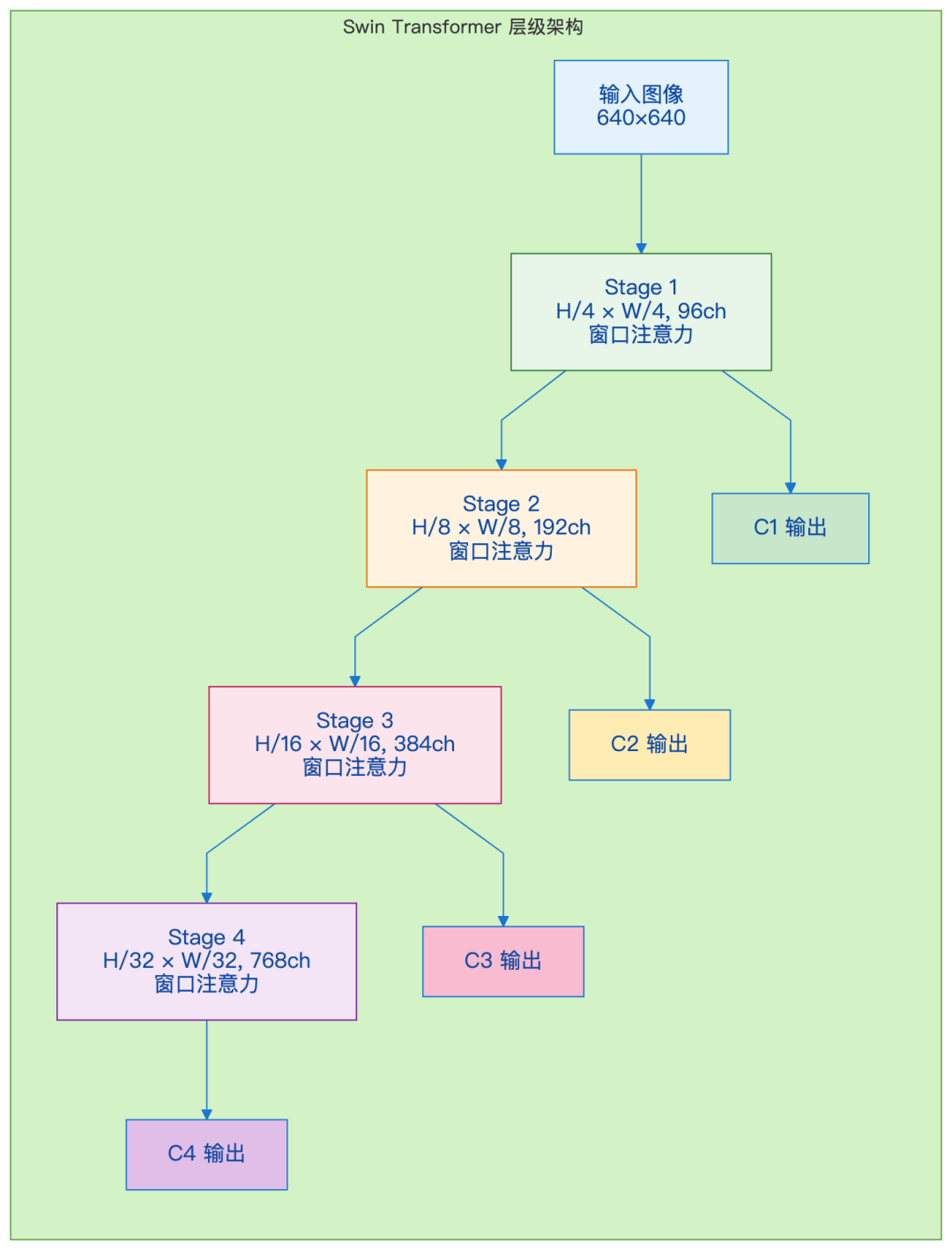

1. 计算效率更高

全局自注意力的计算量随图像尺寸平方增长。Swin 的窗口注意力把计算量降到了线性:

- ViT-B (640×640): ~25M patches,全局注意力开销大

- Swin-B (640×640): 7×7 窗口 × 若干个 window,效率高 4-5 倍

2. 多尺度特征更自然

CNN 的多尺度设计已经非常成熟。Swin 通过层级结构做到了类似的效果:

- Stage 1-4 的输出直接对应 P3/P4/P5 (H/8、H/16、H/32)

- 不需要像 ViT 那样从单尺度特征做多尺度融合

Swin Transformer Shifted Window:局部窗口注意力 + 跨窗口信息交互

Swin Transformer Shifted Window:局部窗口注意力 + 跨窗口信息交互

3. 预训练权重好找

Swin 在 ImageNet-22k 上预训练的权重很常见,timm 库里直接有。不用像 DINOv3 那样走特殊申请流程。

Swin 特征怎么用到 YOLO26

Swin 用 timm 的 features_only 模式获取多尺度输出:

self.swin = timm.create_model(

"swin_base_patch4_window7_224.ms_in22k_ft_in1k",

pretrained=False,

features_only=True,

out_indices=(0, 1, 2, 3)

)

def forward(self, x):

features = self.swin(x)

# features: [C1/4, C2/8, C3/16, C4/32]

# 通道: [96, 192, 384, 768]

c0 = features[0].permute(0, 3, 1, 2) # HWC -> CHW

c1 = features[1].permute(0, 3, 1, 2)

c2 = features[2].permute(0, 3, 1, 2)

c3 = features[3].permute(0, 3, 1, 2)

# FPN 风格融合

f8 = self.proj8(c0) # 96 -> 256

f16 = self.proj16(c1) # 192 -> 512

down_8to16 = avg_pool2d(f8, kernel_size=2, stride=2)

n16 = self.fuse16(cat([f16, down_8to16]))

f32 = self.proj32(c2) # 384 -> 512

down_16to32 = avg_pool2d(n16, kernel_size=2, stride=2)

n32 = self.fuse32(cat([f32, down_16to32]))

return [f8, n16, n32] # P3, P4, P5

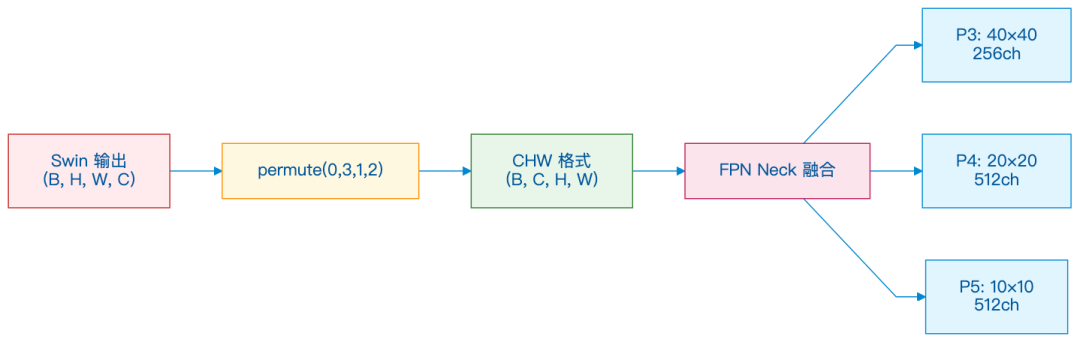

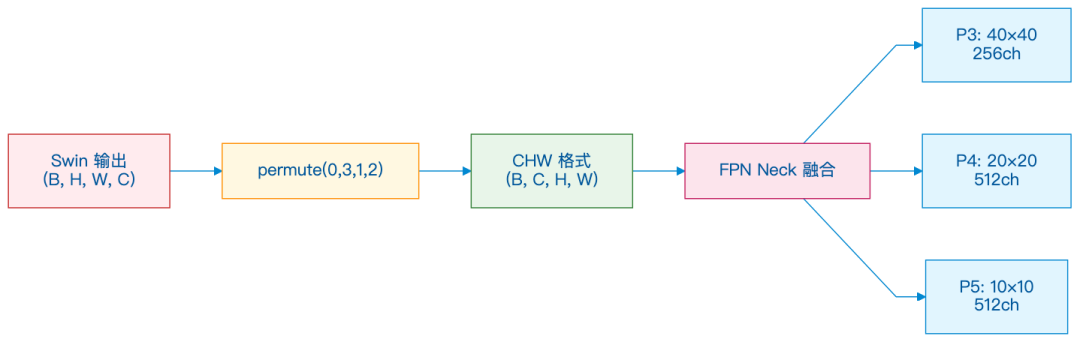

有个细节:Swin 输出的特征是 (B, H, W, C) 格式,需要 permute 转成 (B, C, H, W) 才能用卷积。

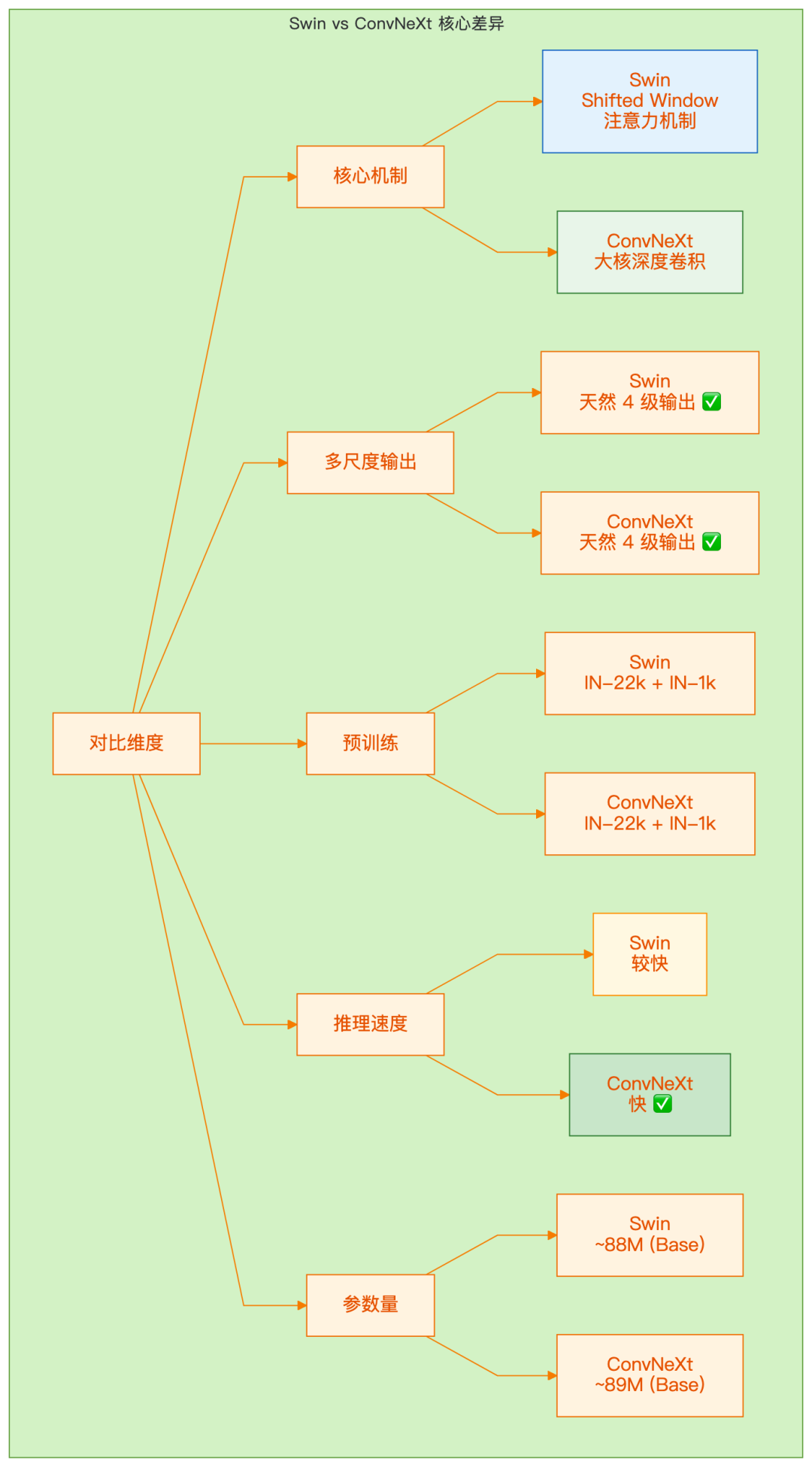

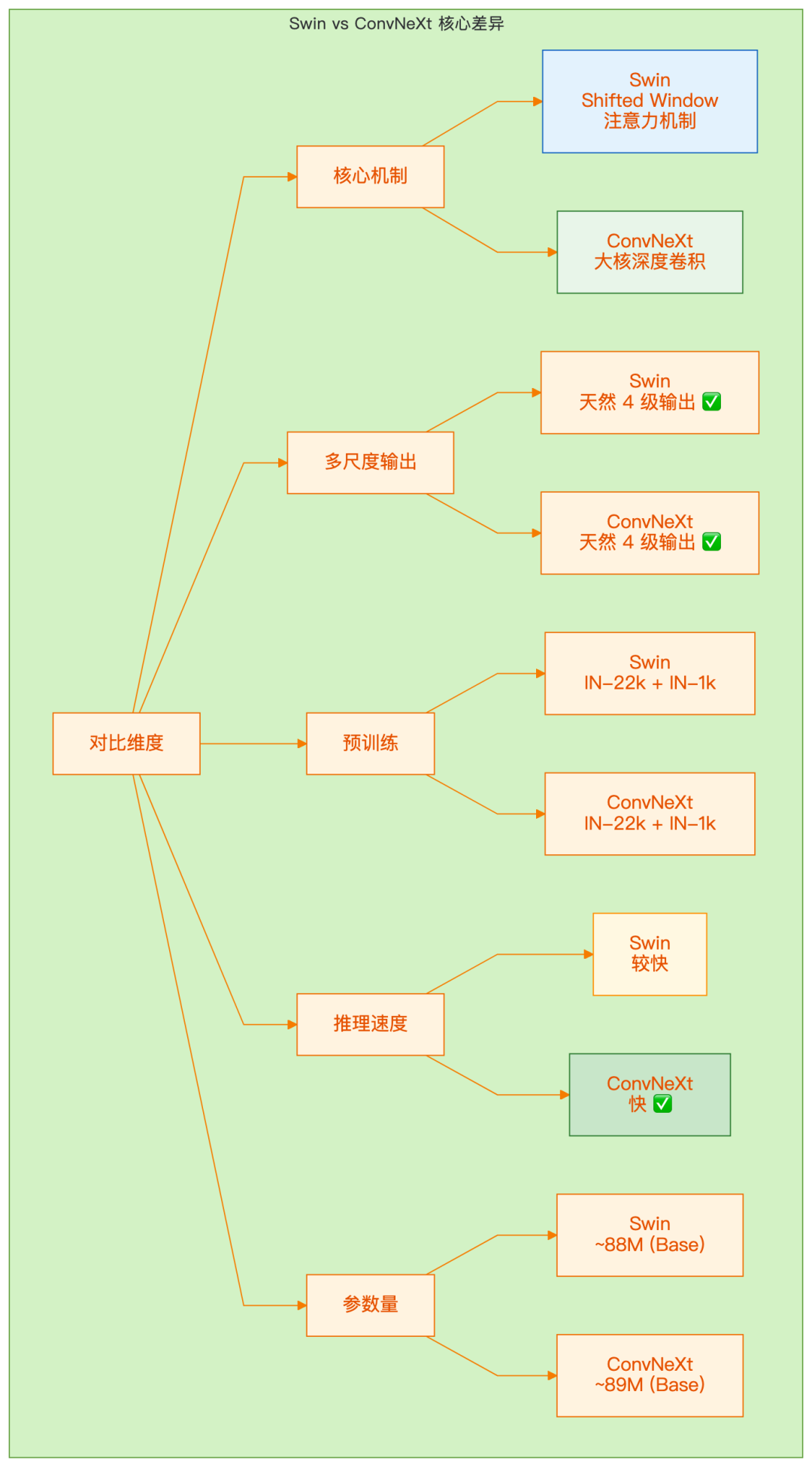

和 ConvNeXt + YOLO26 的对比

两者都是"现代化 CNN/Transformer",但设计思路不同:

维度 | Swin + YOLO26 | ConvNeXt + YOLO26 |

|---|---|---|

核心机制 | Shifted Window Attention | 大核深度卷积 |

多尺度 | 天然 4 级输出 | 天然 4 级输出 |

预训练 | IN-22k + IN-1k | IN-22k + IN-1k |

推理速度 | 较快 | 快 |

参数量 | ~88M (Base) | ~88M (Base) |

Swin 的优势:注意力机制让模型能捕捉不同窗口之间的交互,对全局信息的建模更强。

ConvNeXt 的优势:纯卷积实现,推理更稳定,没有窗口边界的复杂度。

两者在检测任务上都能达到不错的效果,具体用哪个可以看团队对哪个更熟悉。

Swin Transformer vs ConvNeXt:工业检测场景下的多尺度特征重建对比

Swin Transformer vs ConvNeXt:工业检测场景下的多尺度特征重建对比

训练配置

# 默认配置

swin_type: "swin_base_patch4_window7_224.ms_in22k_ft_in1k"

freeze_swin: 0 # 数据少时冻结

lr0: 0.0005

weight_decay: 0.0005

cos_lr: true

mosaic: 0.8

mixup: 0.1

Swin 的特征质量已经很高,冻结策略可以更激进一些(比如冻结前 4 层)。

部署

ONNX 导出是标准操作:

model.export(

format='onnx',

imgsz=[640, 640],

dynamic=False,

half=True

)

Swin 的 CNN-friendly 结构让 ONNX 导出和推理都比较顺畅。

ONNX 跨平台部署:Swin 的层次化结构对推理引擎友好

ONNX 跨平台部署:Swin 的层次化结构对推理引擎友好

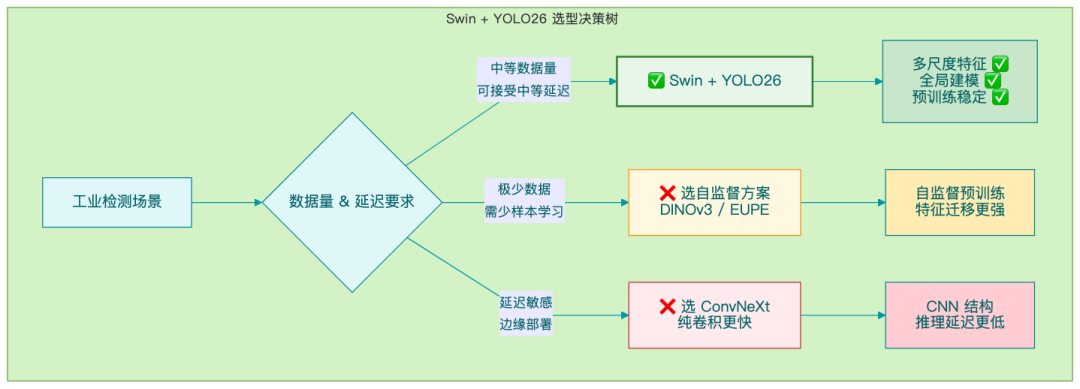

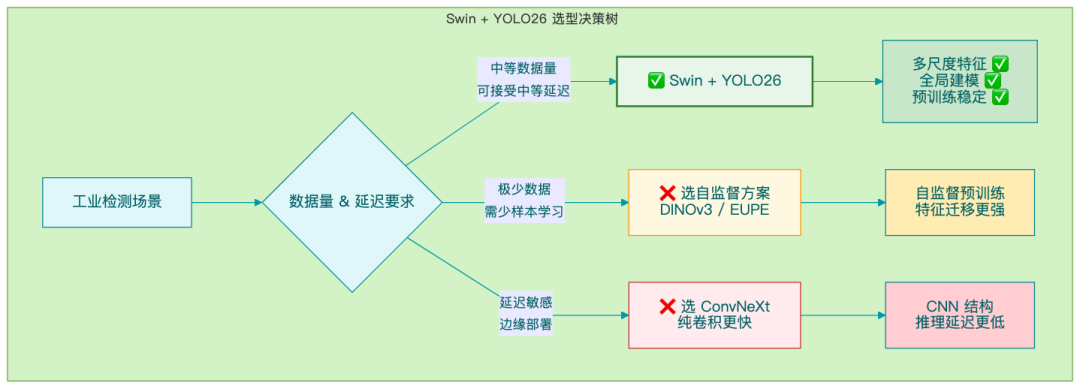

什么时候用 Swin + YOLO26

适合的场景:

- 需要多尺度特征融合的检测任务

- 团队对 Transformer 更熟悉

- 想要更快的推理速度(相比全局注意力 ViT)

- 需要 ImageNet 监督预训练的稳定性

不适合的场景:

- 对延迟要求极高(还是 ConvNeXt 更快)

- 数据量极少(自监督预训练可能更好)

- 极端小目标(需要更大分辨率输入)

具体还是看实际场景。建议在小数据集上先做个对比实验。

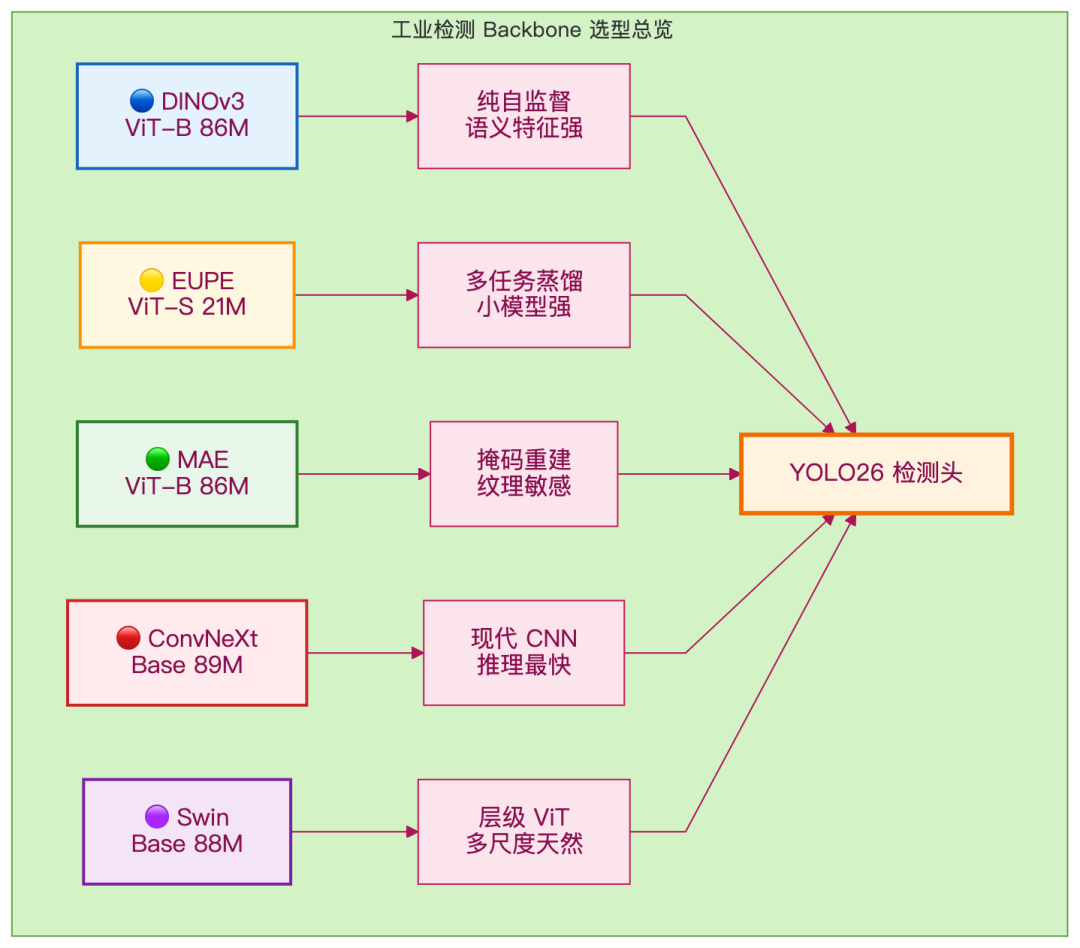

五种 Backbone 方案对比总结

以上是 Swin + YOLO26 方案的一些整理。如果有具体问题可以讨论,但不一定能及时回复。

ImageNet 结果:

模型 | 参数量 | Top-1 |

|---|---|---|

Swin-T | 28M | 81.3% |

Swin-S | 50M | 83.0% |

Swin-B | 88M | 83.5% |

Swin-L | 197M | 84.0% |

为什么考虑 Swin 而不是 ViT

和标准的 ViT (比如 DINOv3/EUPE) 相比,Swin 有几个特点:

1. 计算效率更高

全局自注意力的计算量随图像尺寸平方增长。Swin 的窗口注意力把计算量降到了线性:

- ViT-B (640×640): ~25M patches,全局注意力开销大

- Swin-B (640×640): 7×7 窗口 × 若干个 window,效率高 4-5 倍

2. 多尺度特征更自然

CNN 的多尺度设计已经非常成熟。Swin 通过层级结构做到了类似的效果:

- Stage 1-4 的输出直接对应 P3/P4/P5 (H/8、H/16、H/32)

- 不需要像 ViT 那样从单尺度特征做多尺度融合

Swin Transformer Shifted Window:局部窗口注意力 + 跨窗口信息交互

Swin Transformer Shifted Window:局部窗口注意力 + 跨窗口信息交互

3. 预训练权重好找

Swin 在 ImageNet-22k 上预训练的权重很常见,timm 库里直接有。不用像 DINOv3 那样走特殊申请流程。

Swin 特征怎么用到 YOLO26

Swin 用 timm 的 features_only 模式获取多尺度输出:

self.swin = timm.create_model(

"swin_base_patch4_window7_224.ms_in22k_ft_in1k",

pretrained=False,

features_only=True,

out_indices=(0, 1, 2, 3)

)

def forward(self, x):

features = self.swin(x)

# features: [C1/4, C2/8, C3/16, C4/32]

# 通道: [96, 192, 384, 768]

c0 = features[0].permute(0, 3, 1, 2) # HWC -> CHW

c1 = features[1].permute(0, 3, 1, 2)

c2 = features[2].permute(0, 3, 1, 2)

c3 = features[3].permute(0, 3, 1, 2)

# FPN 风格融合

f8 = self.proj8(c0) # 96 -> 256

f16 = self.proj16(c1) # 192 -> 512

down_8to16 = avg_pool2d(f8, kernel_size=2, stride=2)

n16 = self.fuse16(cat([f16, down_8to16]))

f32 = self.proj32(c2) # 384 -> 512

down_16to32 = avg_pool2d(n16, kernel_size=2, stride=2)

n32 = self.fuse32(cat([f32, down_16to32]))

return [f8, n16, n32] # P3, P4, P5

有个细节:Swin 输出的特征是 (B, H, W, C) 格式,需要 permute 转成 (B, C, H, W) 才能用卷积。

和 ConvNeXt + YOLO26 的对比

两者都是"现代化 CNN/Transformer",但设计思路不同:

维度 | Swin + YOLO26 | ConvNeXt + YOLO26 |

|---|---|---|

核心机制 | Shifted Window Attention | 大核深度卷积 |

多尺度 | 天然 4 级输出 | 天然 4 级输出 |

预训练 | IN-22k + IN-1k | IN-22k + IN-1k |

推理速度 | 较快 | 快 |

参数量 | ~88M (Base) | ~88M (Base) |

Swin 的优势:注意力机制让模型能捕捉不同窗口之间的交互,对全局信息的建模更强。

ConvNeXt 的优势:纯卷积实现,推理更稳定,没有窗口边界的复杂度。

两者在检测任务上都能达到不错的效果,具体用哪个可以看团队对哪个更熟悉。

Swin Transformer vs ConvNeXt:工业检测场景下的多尺度特征重建对比

Swin Transformer vs ConvNeXt:工业检测场景下的多尺度特征重建对比

训练配置

# 默认配置

swin_type: "swin_base_patch4_window7_224.ms_in22k_ft_in1k"

freeze_swin: 0 # 数据少时冻结

lr0: 0.0005

weight_decay: 0.0005

cos_lr: true

mosaic: 0.8

mixup: 0.1

Swin 的特征质量已经很高,冻结策略可以更激进一些(比如冻结前 4 层)。

部署

ONNX 导出是标准操作:

model.export(

format='onnx',

imgsz=[640, 640],

dynamic=False,

half=True

)

Swin 的 CNN-friendly 结构让 ONNX 导出和推理都比较顺畅。

ONNX 跨平台部署:Swin 的层次化结构对推理引擎友好

ONNX 跨平台部署:Swin 的层次化结构对推理引擎友好

什么时候用 Swin + YOLO26

适合的场景:

- 需要多尺度特征融合的检测任务

- 团队对 Transformer 更熟悉

- 想要更快的推理速度(相比全局注意力 ViT)

- 需要 ImageNet 监督预训练的稳定性

不适合的场景:

- 对延迟要求极高(还是 ConvNeXt 更快)

- 数据量极少(自监督预训练可能更好)

- 极端小目标(需要更大分辨率输入)

具体还是看实际场景。建议在小数据集上先做个对比实验。

五种 Backbone 方案对比总结

以上是 Swin + YOLO26 方案的一些整理。如果有具体问题可以讨论,但不一定能及时回复。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录