ollama v0.14.3发布:新增图像生成API、引入多款新模型、性能与稳定性全面升级!

ollama v0.14.3发布:新增图像生成API、引入多款新模型、性能与稳定性全面升级!

福大大架构师每日一题

发布于 2026-01-28 10:30:11

发布于 2026-01-28 10:30:11

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

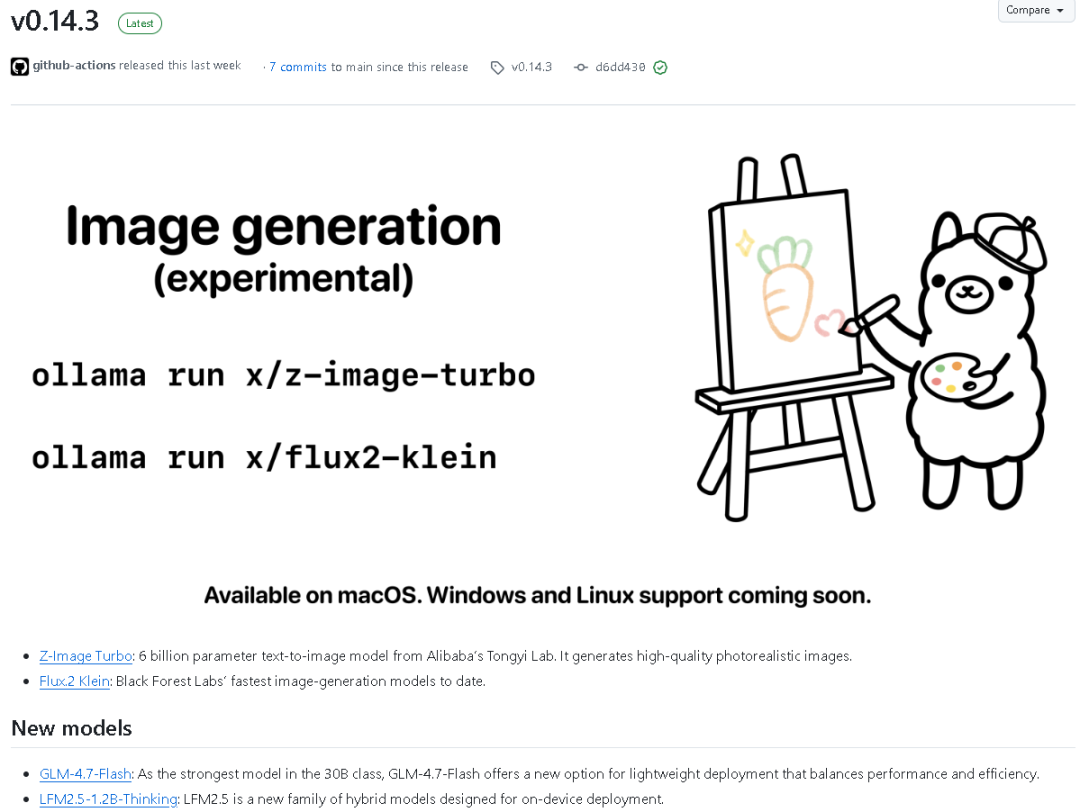

2026年1月22日,Ollama正式发布了最新版本 v0.14.3。这一版本在功能、模型与系统稳定性方面迎来了多项重大更新。其中最引人注目的亮点之一,是 /api/generate 接口正式支持图像生成,并且集成了多款全新高性能模型,进一步夯实了Ollama在AI多模态领域的技术地位。

一、全新模型阵容上线

1. Z-Image Turbo 来自阿里巴巴通义实验室的 Z-Image Turbo,是一款拥有 60亿参数 的文本到图像生成模型。它能够生成高质量、逼真的照片级图像,为创意设计、视觉内容生成等领域带来强大助力。

2. Flux.2 Klein 由 Black Forest Labs 推出的 Flux.2 Klein 系列,是迄今为止该团队最快的图像生成模型,优化了生成速度与渲染精度。

3. GLM-4.7-Flash 作为 30B级别模型中的性能冠军,GLM-4.7-Flash 在性能和资源效率之间找到了完美平衡,为轻量级部署提供了全新方案。

4. LFM2.5-1.2B-Thinking LFM2.5 系列是新一代混合型模型,专为 端侧部署(on-device) 打造,支持在设备本地高效运行,提升隐私和低延迟体验。

二、系统与功能更新

1. Ollama macOS 应用体验优化 修复了此前 macOS 应用在系统关机时会被中断的问题。现在,应用能够在系统关机或重启时自动允许终止,保证用户体验流畅。

2. 命令行增强

- • 修复了

ollama create与ollama show对实验性模型(experimental models)的支持问题。 - • 优化了

ollama rm命令,使模型删除逻辑更加稳定,不再仅停止列表中第一个运行模型。

3. API功能扩展

/api/generate 接口现已正式支持 图像生成。开发者不仅可进行文本生成,还能通过统一API生成图片内容,为多模态应用提供直接接口支持。

4. 解析器优化

修复了 Nemotron-3-Nano 工具解析中的细微问题,并引入代码复用优化,提升了工具调用的稳定性。

5. 模型删除性能改进 解决了图像生成模型在被移除时会被误加载的问题,避免了无效加载占用内存资源。

三、开发与构建层面优化

1. Dockerfile 改进

- • 增加对

MLX CUDA 13的构建支持; - • 动态加载

mlx-c以提升灵活性; - • 构建时支持

mlx标签,通过cmake与go build进行优化编译,生成支持 MLX 实验特性的ollama-mlx二进制文件。

2. 新增 MLX_VERSION 文件

记录当前 MLX 组件版本号:v0.4.1,确保版本一致性与可追溯性。

3. README 更新

文档补充了构建 ollama-mlx 的详细流程,清晰说明了如何通过 -tags mlx 标识启用图像生成功能。

四、API结构变更与新增字段

在 types.go 文件中,GenerateRequest 和 GenerateResponse 均新增了图像生成相关字段,进一步拓展了 API 功能边界:

新字段包括:

- •

Width:输出图像宽度(像素) - •

Height:输出图像高度(像素) - •

Steps:图像生成的扩散步数(Diffusion Steps) - •

Image:Base64编码的生成图像 - •

Completed:图像生成过程的已完成步数 - •

Total:生成过程的总步数

此外,ShowResponse 中的 ModelInfo 字段默认值从可选项改为非空,进一步规范了API返回结构。

五、App层面改进

在 macOS 客户端中,新增系统关机监听机制:

- • 当系统即将关机或重启时,应用自动接收

NSWorkspaceWillPowerOffNotification通知; - • 标志位

systemShutdownInProgress启用后,允许应用在applicationShouldTerminate阶段优雅关闭,避免错误拦截系统行为。

六、综合性能与开发体验提升

- • 支持 FP4 量化(quantization),进一步压缩模型体积,提升运行速度;

- • 改进了 OLLAMA_MODELS 环境变量 对模型清单与二进制文件的加载机制;

- • 新增自动化测试用例,覆盖图像生成模型、LFM2.5 思维模型的多场景测试。

七、总结

代码地址:github.com/ollama/ollama

Ollama v0.14.3 不仅带来了全新的图像生成能力与API扩展,更在模型体系、构建流程、系统稳定性上迈出了关键一步。 从 Z-Image Turbo 到 LFM2.5-1.2B-Thinking,从 API增强 到 macOS 体验优化,这一版本无疑为 Ollama 的多模态智能生态注入了全新动力。

无论是开发者、研究者还是企业用户,v0.14.3 都将成为下一代AI应用开发的高效基座。

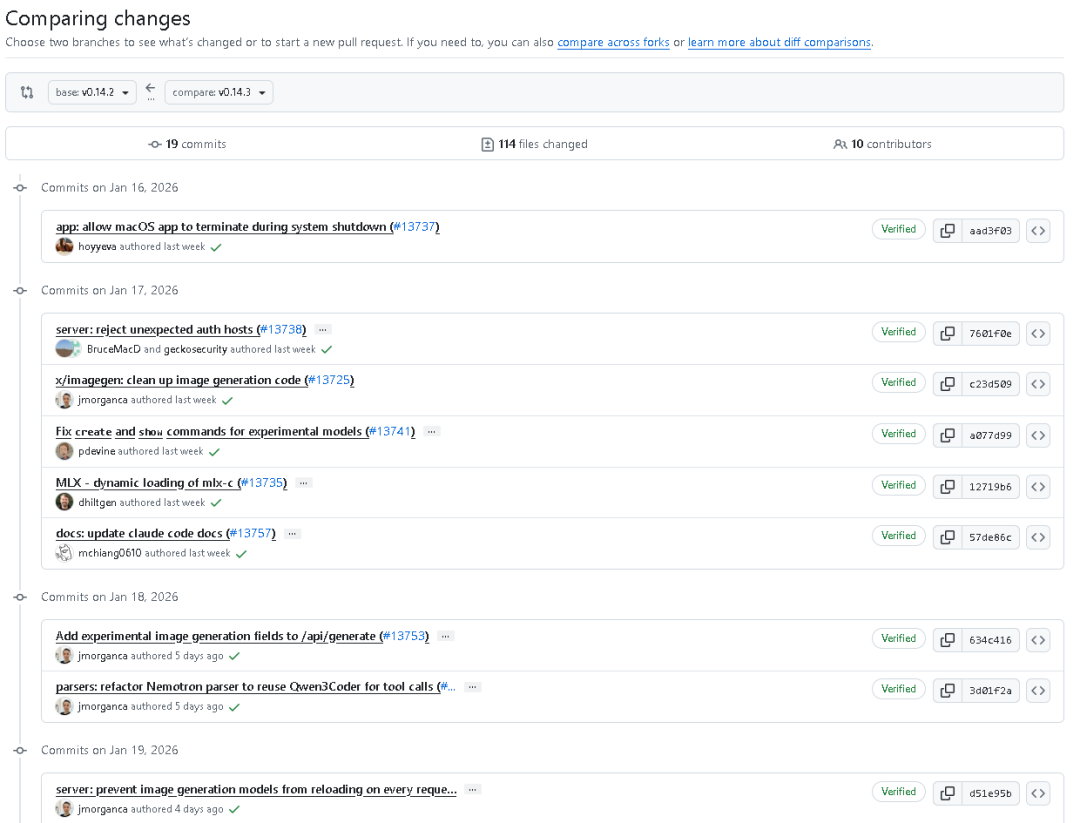

版本信息: 发布日期:2026年1月22日 版本号:v0.14.3 变更概要:19次提交,114个文件修改,含22455行新增与1913行删除。

我们相信人工智能为普通人提供了一种“增强工具”,并致力于分享全方位的AI知识。在这里,您可以找到最新的AI科普文章、工具评测、提升效率的秘籍以及行业洞察。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录