「玩」OpenClaw 从热潮到「清醒」,早期玩家态度为何转变?

「玩」OpenClaw 从热潮到「清醒」,早期玩家态度为何转变?

用户1493530

发布于 2026-05-06 21:37:57

发布于 2026-05-06 21:37:57

1 月底 OpenClaw 爆火的时候,我跟大多数人一样,就是想试试这个热门项目到底是什么。朋友群里刷屏、GitHub star 数像火箭一样往上蹿、各路大佬站台,不上手玩一下总觉得错过了什么。于是花了几个小时部署、接上国内的模型、挂到飞书上,跑通了。说是几个小时,其实大部分时间卡在了飞书接入上,因为当时飞书的支持还不太成熟,文档和社区讨论都不多,得自己摸索。模型和部署本身倒是很顺畅。

跑通之后,第一个问题就来了:然后呢?我拿它干什么?

这其实是大量早期玩家共同面对的尴尬。装好了、能对话了、能执行命令了,然后发现自己并没有一个明确的任务要交给它。直到我想到了一个看起来很合适的场景:让它帮我做知乎每日回答的选题。

做知乎创作激励的人都知道,选题决定一切。一个踩中热点的高赞回答,收益能顶十几篇普通文章。知乎的推荐问题已经相对精准了,但「相对精准」和「帮我从里面优中选优」之间差着一个量级。我需要一个能每天自动帮我筛选、分析、排序推荐问题的助手,而 OpenClaw 看起来就是为这种场景设计的。

下面这张截图就是它跑通之后,每天早上自动推给我的选题报告。从 122 个推荐问题里按热度、质量等维度综合打分排序,直接给出 Top 10:

看到这个报告的时候,确实有那种「未来已来」的感觉。但这种感觉只持续了几天。然后问题开始了,一个接一个,最后让我得出了一个意想不到的结论。

▶60 天登顶 GitHub 第一:先聊聊这个项目为什么能火

OpenClaw 的创建者是奥地利开发者 Peter Steinberger(PSPDFKit 创始人),2025 年 11 月他做了个周末项目叫 WhatsApp Relay。后来经历了一系列改名:Warelay → Clawdis → Clawdbot → Moltbot → OpenClaw,其中 Clawdbot 是因为 Anthropic 发了商标律师函才被迫改的,理由是跟 Claude 太像。讽刺的是,这波争议反而让项目出圈了。

2026 年 1 月 25 日到 2 月 1 日,star 数从 9,000 直接冲过 100,000,峰值速度大约是每小时 710 颗 star。Andrej Karpathy 说这是他见过的最接近科幻的起飞场景,Elon Musk 发了句「Just the very early stages of the singularity」。到 3 月初,OpenClaw 以 250,000+ star 超越了 React 和 Linux,成为 GitHub 有史以来 star 数最多的项目。

中文社区也同步炸了。大家给龙虾吉祥物起了昵称叫「小龙虾」,B 站上林亦 LYi 的教程视频拿到了 66.8 万播放。知乎涌现了大量架构分析,V2EX 开了专版,阿里云、腾讯云、火山引擎争推一键部署。Mac Mini 一度因为玩家买来 7×24 跑 Agent 而卖断货。

它能火的原因也很好理解。AI Agent 框架在 2025 年已经出了十几个了,LangGraph、CrewAI、Claude Agent SDK、AutoGen,但它们都只是「框架」,你得自己写胶水代码。OpenClaw 是一个 MIT 协议、本地部署、模型无关 的完整产品。你可以接 Claude、GPT、DeepSeek,支持 20 多个消息平台,有个叫 ClawHub 的技能市场。说白了,它让普通开发者第一次体验到了「AI 助手 24 小时在线」这件事。

但「体验到」和「用得好」是两码事。

▶我的飞书噩梦:底座模型撑不起 Agent 的野心

我最先遇到的问题不是安全,不是费用,是交互体验极其拉胯。

我用的是国内的 coding plan 模型接入,因为 Claude 的额度对我另有用途,量不多而且担心被封。OpenClaw 挂在飞书上之后,我发现它经常会把页面上已经明明存在的文字直接忽略,然后信誓旦旦地告诉我「没有找到相关内容」。比如我让它去分析某个知乎问题页面的回答数据,页面上清清楚楚写着回答数、关注数,它就是看不见。

这个问题大概率出在底座大模型上。国内的模型在工具调用(tool use)和多步骤推理上跟 Claude 还是有代差的,而 OpenClaw 的 Agent 循环对模型能力的要求其实很高。它需要模型能准确理解当前页面状态、正确调用浏览器工具、然后基于返回结果做决策。底座不够强的时候,整个链路就会在某一环断掉,而且断得很随机,你很难定位问题。

但我还是忍了,因为筛选选题这个功能确实跑通了。OpenClaw 能每天从知乎推荐问题池里帮我做初筛,虽然中间经常抽风,好歹结果能用。

▶从筛选到推荐算法:失控的开始

真正让我「清醒」的,是后面的事。

选题筛选跑通之后,它对我来说就变成了一个固定的定时任务。每天早上从知乎的推荐问题里优中选优,把最值得回答的问题推给我。前期我的做法是先自己粗筛,然后让 OpenClaw 做归因分析:这个问题为什么值得答?历史上类似问题的回答数据表现怎么样?热度趋势是上升还是下降?

这个流程跑了几天,我发现效率太慢。每次都要先人工筛一遍再喂给它,Agent 的「自主性」根本没发挥出来。于是我做了一个在当时看起来很合理的决定:让 OpenClaw 帮我写一个推荐算法,自动完成从初筛到排序的全过程。

然后一切就不可控了。

我通过飞书聊天跟它沟通需求,它确实在改代码,但我完全不知道它改了什么。Agent 的对话窗口里只能看到它的回复和摘要,看不到完整的代码变更上下文。它说「我已经优化了排序逻辑」,我问具体改了哪里,它给我一段不完整的代码片段,跟实际文件对不上。我想去看完整的上下文,发现通过聊天界面根本拿不到。

这个过程让我非常抓狂。我在用一个黑盒去改另一个黑盒。Agent 的行为对我不透明,它修改的代码对我也不透明。我的控制感在每一轮对话中都在流失。

然后,真正让我惊出一身冷汗的事情发生了。

▶触发知乎风控:这可是我的大号

玩着玩着,小龙虾因为过多的不合理操作,直接触发了知乎的风控系统。

我当时手都凉了。这是我的大号,是我认认真真、一篇一篇文章写出来的号。知乎创作激励、创作者等级、粉丝积累、历史回答数据,全在这个号上。万一给我封了,那不是损失几天收益的问题,是我三个月的心血直接归零。

问题出在哪?做过逆向的人都知道,当你要从一个网站抓取数据或者分析它的行为时,有一套成熟的方法论。我自己做 iOS 逆向和 Web 逆向的时候,流程是这样的:先从接口开始,用抓包工具看请求和响应的结构;然后一步一步追踪到对应的前端代码;找到关键的加密或签名逻辑所在的 JS 文件;把目标函数提取出来;检查它依赖了哪些外部变量和方法;缺什么补什么,最终拼出一个最小化的可运行版本。整个过程是逐层深入、步步可控的,每一步你都清楚自己在干什么、会触发什么、风险边界在哪里。即便碰到不确定的环节,你也会像电影里踩着激光线的小偷一样,小心翼翼地试探,一次只动一个变量,确认安全了再往前迈一步。你怕的不是「不知道」,而是「不知道还乱来」。

OpenClaw 完全不是这么干的。还是那个电影场景——如果说人类是踩着激光线的小偷,那 OpenClaw 就是一个浑身绑满铃铛的醉汉闯进了同一个房间。它对知乎的反爬机制没有任何认知,不知道哪些请求频率是安全的,不知道哪些访问路径会被标记为异常,不知道哪些操作组合会触发风控。关键是,它压根不知道这个房间里有激光线。它就是一个拿着浏览器的 Agent,按照自己的理解去「自主」操作。频繁请求、非正常浏览路径、短时间内大量页面访问,这些在知乎的风控系统眼里就是赤裸裸的机器人行为。更离谱的是,它还会凭空捏造根本不存在的 API 端点,然后信誓旦旦地告诉我「就是这个接口,但目前有点问题,我正在修复」——这就好比醉汉撞到了一面墙,非说这里有扇门,还自信地拧了半天「门把手」。你想想这个场景:一个 Agent 用你的账号身份,去请求一个它自己幻觉出来的 API 地址,知乎的后端收到一堆莫名其妙的 404 请求,全部来自你的登录态。这不触发风控才怪。而且因为我对它的操作完全不透明,我根本不知道它请求了多少次、用了什么频率、走了什么路径。等我收到风控提示的时候,它已经不知道替我「自主」干了多少出格的事了。

说白了,人类做逆向是「外科手术」,Agent 做逆向是「盲人摸象然后一顿乱抓」。 前者的风险是可评估、可控制的,后者的风险完全不可预测。

这件事让我彻底意识到一个问题:把一个你无法完全监控的 Agent 放在你最重要的账号上运行,本质上就是在赌。 你赌它不会做出超出你预期的操作,你赌平台不会把它的行为判定为违规,你赌出了事你能及时发现。而这三个赌注,我一个都输不起。

安全研究员担心的是 OpenClaw 实例被黑客利用,那是技术层面的风险。而我遇到的是更日常的风险:Agent 用你自己的身份、在你最在乎的平台上、做出你不知道的操作。这种风险不需要恶意攻击者参与,Agent「正常工作」就能制造。这也是为什么我觉得这个问题比 CVE 漏洞更值得普通用户警惕,因为 CVE 你打个补丁就好了,而 Agent 的「自主行为风险」是架构层面的,没法打补丁。

▶顿悟时刻:我根本不需要 OpenClaw

经历了风控事件之后,当我第三次试图通过飞书对话去「追」OpenClaw 的代码变更上下文时,我突然停下来了。

我在干什么?

我真正需要的是什么?我需要一个能帮我写代码、能看到完整文件上下文、能精确控制每一次修改的工具。这个东西已经存在了,它叫 Claude Code。我日常用它写文章辅助工具、做开源项目,体验非常好。它的上下文管理、代码编辑、文件操作都是一流的。

我缺的只是一个入口问题:Claude Code 跑在我的电脑上,而我有时候在外面用手机。我需要的只是一个能在手机上远程触发 Claude Code 任务的工具。

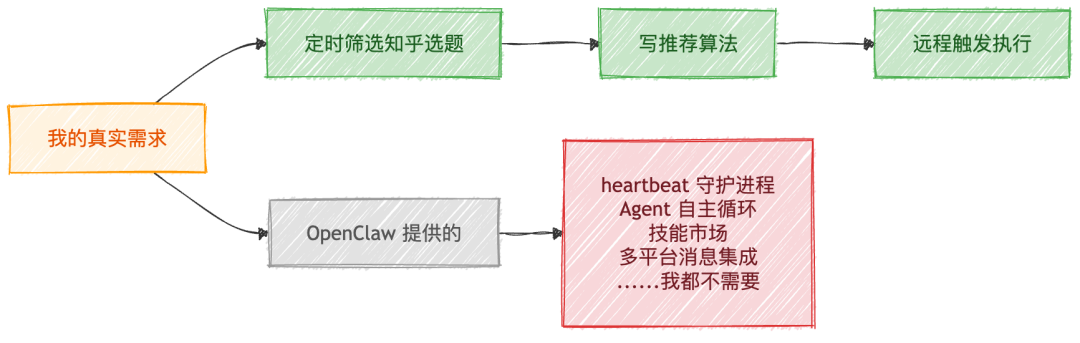

OpenClaw 那些 heartbeat daemon(每 30 分钟唤醒一次检查任务)、那些 Agent 自主循环、那些技能市场,我一个都不需要。我把一个简单的需求(远程触发 + 定时执行)硬塞进了一个复杂的 Agent 框架里,然后花了两周时间跟框架本身搏斗。

说白了,我的需求链条是:cron 定时任务 + Claude Code 写算法 + 一个远程触发的 app。这三样东西各自都已经很成熟了。我不需要一个大一统的 Agent 平台把它们包在一起,反而引入一堆我不需要的复杂性。

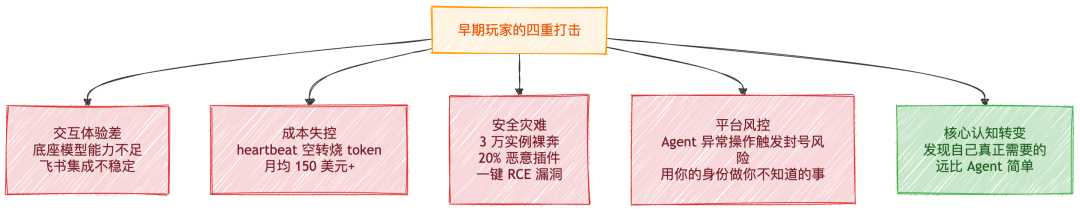

▶不只是我:大量早期玩家经历了类似的觉醒

我的经历不是个例。V2EX 上 @remarrexxar 的评价几乎是我的翻版:「太烧 token 了……如果你想做固定任务,既然任务明确,直接写个脚本就行,更稳定、省 token、更可靠。」知乎上也有用户算过账:一个月 API 费用超过 150 美元,比直接订阅 Claude Max 还贵。B 站有创作者记录了半个月花掉 600 美元 的经历。

OpenClaw 的 heartbeat daemon 每 30 分钟唤醒一次消耗 token,哪怕你什么都不让它干,它也在默默烧钱。你为「自主性」付费,但大部分时候这个自主性在空转。

而安全层面的问题更是雪上加霜。Bitsight 的研究发现 1 月底到 2 月初有超过 30,000 个 OpenClaw 实例完全暴露在公网,没有任何认证。一个 CVSS 8.8 的远程代码执行漏洞(CVE-2026-25253)意味着访问一个恶意网页就能被控制整台机器。更严重的是 ClawHub 技能市场的供应链攻击:安全研究员 Paul McCarty 扫描后发现大约 20% 的技能包是恶意的,超过 800 个,主要投放 macOS 密码窃取程序。Cisco 的安全团队独立确认了数据窃取和 prompt 注入问题。

中文社区还额外经历了 ClawHub 中文封禁事件。2 月 14 日,一个叫张浩阳的开发者做的自进化插件 Evolver 登上排行榜第一(三天 36,000 次下载),然后被下架。ClawHub 的内容扫描把中文字符标记为「乱码」并自动删除了所有含中文的技能包,关联账号一并封禁。36 氪和量子位都做了报道,社区里「实在是寒心」的声音此起彼伏。这件事直接让大量中文早期玩家从布道者变成了劝退者。

▶态度转变的底层逻辑:Agent 范式本身的矛盾

把这些问题串起来看,OpenClaw 的退烧不是因为它做得差,而是因为当前 AI Agent 范式本身存在根本性的张力。

Agent 要有用,就得有权限。有权限就有风险。你给它 shell 访问权,它就可能被 prompt 注入利用。你让它自主决策,它就会在你不注意的时候烧 token。你搞一个开放的插件市场来扩展能力,就必然面临供应链攻击。你让它用你的身份去操作第三方平台,就等着触发风控吧。这些不是 OpenClaw 独有的问题,是所有通用 AI Agent 都会撞上的墙。OpenClaw 只是跑得最快,所以第一个撞上了。

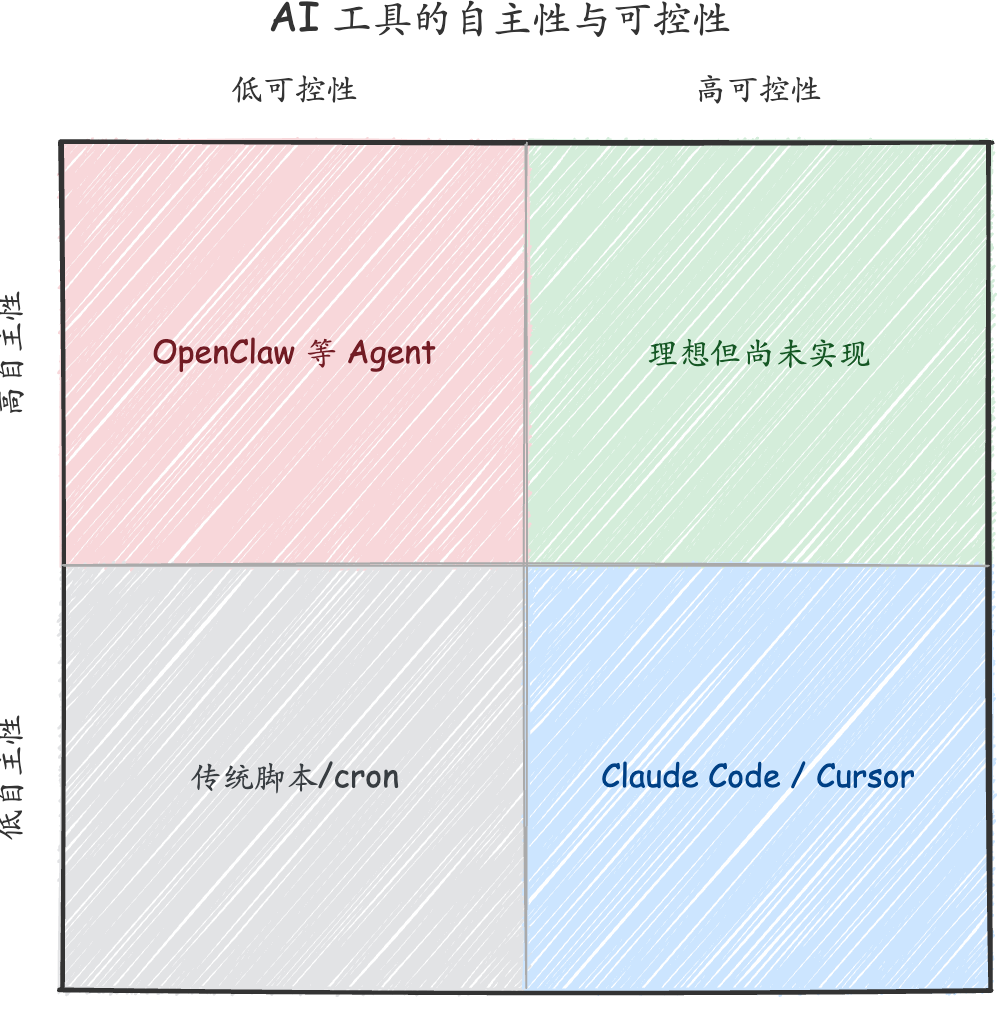

而我个人的经历揭示了另一层矛盾:Agent 的「自主性」和用户的「控制感」在当前技术条件下是冲突的。 当 Agent 只是帮你做简单的筛选和推送时,一切都还好。但当你让它去做更复杂的事,比如写推荐算法,你就会发现你对它的行为越来越不可控。你通过聊天窗口跟一个 Agent 沟通代码变更,就像通过对讲机指挥一个你看不到的人装修你的房子。信息损耗太大了。

这时候你会意识到,对于需要精确控制的任务,「对话式 Agent」这个交互范式本身就是错的。 你需要的是能看到完整上下文、能精确控制每一行修改的工具。这就是为什么 Claude Code、Cursor 这类工具在实际生产力场景中依然是主力,因为它们给你控制感。

▶现在的 OpenClaw 和我的结论

创始人 Steinberger 已于 2 月 14 日加入 OpenAI,OpenClaw 交给了 OpenAI 赞助的独立基金会。安全方面找来了 Dvuln 创始人做负责人,DigitalOcean 推出了安全加固版部署,GitHub 上已发布 41 个安全公告。项目在做正确的事,但一个 MIT 协议的项目被最大的商业 AI 公司招安,这本身也让一部分社区成员感到不安。

知乎上被广泛引用的一句评论,我觉得是最好的总结:「OpenClaw 是一把好锤子,但不是所有东西都是钉子。」

我的经历可能更极端一点:我花了两周时间才意识到,我手里那个东西连锤子都不是,它是一台带锤子功能的瑞士军刀。而我只需要一把锤子。

对于还在观望的开发者,我的建议很简单:先想清楚你到底需要什么。如果你需要的是 AI 辅助编程和精确的代码控制,Claude Code 和 Cursor 已经足够好了。如果你需要定时任务,cron + 脚本比 Agent 稳定十倍。如果你需要远程触发,SSH 或者一个简单的 webhook 就行。

不要因为一个工具看起来很酷就去用它。你用它图什么,它给你了吗?如果没给,为什么不换?

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-06,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录