马虾Agent的驾驭实践(四)-- 框架/模式和场景的“三角”选择

马虾Agent的驾驭实践(四)-- 框架/模式和场景的“三角”选择

企业架构师思维

发布于 2026-05-08 10:38:30

发布于 2026-05-08 10:38:30

2026年苏超开幕式上,徐州的一首“百鸟朝凤”,让无数淮海人唤醒了开席密语“俺奶,给俺叨马虾”,马虾究竟是何方神物,先上图:

如此神物,当如何驾驭,今天就来念叨念叨,希望对大家能够领略马虾驾驭之乐。在AI领域,此处我用“马虾”代指基于HermesAgent(爱马仕)和OpenClaw(龙虾)之类的 Agent框架构建的马虾Agent。】

2026年4月26日,在腾讯云长沙同盟和上海同盟联合举办的一场沙龙上,我分享了个人总结的一套训练马虾Agent的方法和驾驭经验,以及理论思考,以下是基于分享内容的整理,希望对大家有所启发。

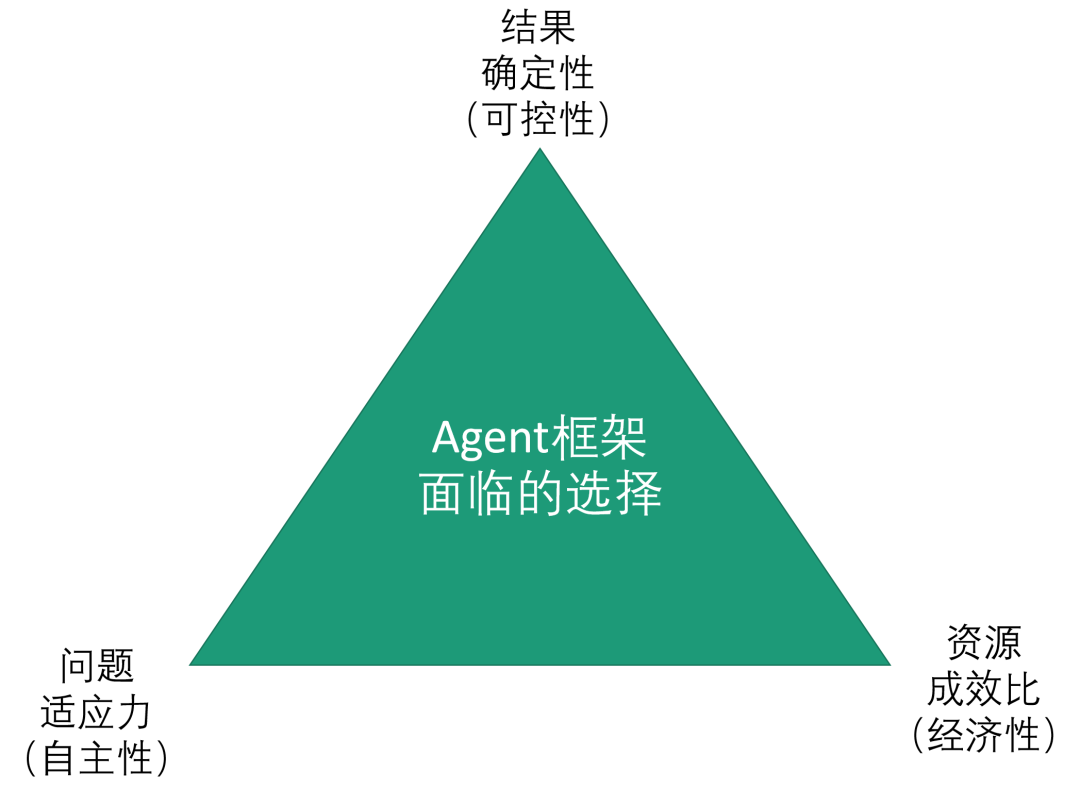

第一篇讲了马虾Agent的驾驭方法;第二篇讲讲马虾驯化的一些踩坑经历以及一些实践中总结的经验,这些经验可以让Agent的训练过程快速收敛;第三篇讲了智能体Agent框架的不可能三角;本篇将基于不可能三角对现在的一些框架/模式和场景进行分析,看看如何才能选择或设计一款适合自己场景的智能体?

智能体Agent框架的不可能三角

不同Agent框架/模式,实际上是有着不同的取舍

冒险家:AutoGPT / BabyAGI

自主性:很高。你只要给一个模糊的目标,比如“研究一下太空旅游的市场”,它就会自己规划步骤、查资料、写报告。

可控性:中等偏低。有时候它会钻牛角尖,反复做同一件事,或者跑偏方向。

经济性:很低。因为要反复调用AI模型,很容易“烧”掉不少API费用。

典型场景:开放域的探索任务,比如科研灵感、新奇想法的实验。

老实人:确定性工作流 + 规则引擎(比如RPA)

自主性:极低。它没有自己的“想法”,完全按照你画好的流程图一步一步执行。

可控性:很高。每个环节都是可预测、可测试的,绝不会乱来。

经济性:很高。执行速度快,消耗资源少,非常省钱。

典型场景:批量数据处理、表单自动填写、财务对账这类重复性、规则明确的工作。

快枪手:单次LLM调用(无约束)

自主性:很低。它只回答你这一句话,不会主动追问或者做后续动作。

可控性:极低。同样的问法可能得到完全不同的答案,还可能输出乱七八糟的内容。

经济性:很高。一次调用就结束,成本最低。

典型场景:简单的文本翻译、分类、摘要,不需要长期记忆或复杂推理。

稳健派:ReAct + 人工断点

自主性:中等。它能自己推理和行动,但在关键步骤会停下来请示你。

可控性:很高。你可以在重要节点审核或修改它的决策。

经济性:中低。比纯手动快,但比全自动多了一些等待和审批的成本。

典型场景:需要安全审核的自动化,比如自动发邮件前让你确认内容。

议会制:多智能体辩论/共识

自主性:很高。多个AI互相讨论、辩论,最终达成一致结论。

可控性:中高。结果经过“集体决策”,但仍然无法100%保证正确。

经济性:极低。每次任务要启动好几个AI模型来回对话,资源消耗巨大。

典型场景:高可靠性要求的研究场景,比如医疗诊断辅助、法律条文分析。

做AI Agent,就像组队打游戏:你总得放弃一样

前面我们聊了,想让一个AI智能体同时具备高自主性(自己会动)、高可控性(你能管得住它)、高效率(省时省钱)——这几乎是不可能的,就像打游戏时你不能同时点上所有天赋。

那在实际项目中,怎么选?放弃哪个“天赋点”呢?下面用四个真实场景告诉你,设计师们是怎么做取舍的。

场景一:股票自动交易 —— 我选“管得住”和“跑得快”,放弃“让它自己想”

最怕什么:AI自己瞎操作,或者决策不透明,亏了钱都找不到原因。

所以优先保住:可控性(每一步都能解释、回滚) +效率(毫秒级响应)

愿意牺牲:自主性(AI不能自己发明新策略)

怎么做:

写死交易规则,加上各种“护栏”——比如禁止买入预算超标的股票、每笔交易都要记录。AI只是严格执行策略的工具,而不是“股神”。

这个场景下,AI的角色就是一个精准的士兵,而不是一个自由的将军。

场景二:科研探索AI —— 我选“让它想”和“能管住它”,不怕花时间

最怕什么:AI为了快而答错,或者乱编数据无法回溯。

所以优先保住:自主性(能自己设计实验步骤) +可控性(每一步都能审计)

愿意牺牲:效率(可以算几个小时甚至几天)

怎么做:

允许AI长时间推理、翻阅大量论文,但每一次搜索、每一个结论都要记录在案。如果出了错,能像回放录像一样找到问题。

这个场景下的AI像一个严谨的研究生,可以慢慢想,但每一步都要能写进实验报告。

场景三:实时客服机器人 —— 我选“快”和“灵活”,可以忍受偶尔“胡言乱语”

最怕什么:用户问一句,等十秒才回复,或者只会说“我听不懂”。

所以优先保住:效率(秒回) +自主性(能处理各种奇葩问题)

愿意牺牲:可控性(可能会给出不太准确的答案)

怎么做:

模型快速生成回复,不做过多的校验和重试。同时,后台加一个简单的敏感词过滤器,把明显违规的内容拦下来。偶尔答得不对,就靠人工兜底或让用户点“踩”。

这个AI像一个热情但有点马虎的实习生,速度快、态度好,偶尔说错话也可以接受。

场景四:航天器故障诊断 —— 我选“快”和“让它自己想”,但必须接受它“不那么透明”

最怕什么:在太空中慢吞吞地算,或者因为规则写死了而漏掉异常。

所以优先保住:效率(必须在几秒内决策) +自主性(能适应未知故障)

愿意牺牲:可控性(你很难完全预测它会怎么做)

怎么做:

使用轻量级的模型,在有限的算力下快速推理。同时,用冗余设计——三个不同的AI模块各自独立判断,如果答案一致就执行,不一致就进入人工/备用模式。这样即使单个AI的行为不可预测,整体仍能安全。

这个AI像一个经验老道但凭直觉决策的老飞行员——你不完全懂他为什么那么做,但相信他能在紧急时刻快速救场。

总结一下

没有完美的AI Agent,只有最适合你当前场景的取舍。在做设计之前,先问自己三个问题:

这事能不能出错?(要确定性就牺牲自主性或效率)

这事急不急?(要速度就牺牲可控性或自主性)

这事复杂不复杂?(要通用就牺牲效率或可控性)

想明白这三点,你就知道该放弃哪一个角了。这,就是AI驾驭工程里的“不可能三角”给我们的最大启发。

好了,智能体框架和场景的三角选择就说到这,如何想了解前面的内容可以点击下面链接阅读。

马虾Agent的驾驭实践(一)-- 驾驭方法

马虾Agent的驾驭实践(二)-- 踩坑实践

后续几篇将会讲讲现在流行的几个Agent框架的架构设计关注点,分析一下Agent未来的演进分化和行业应用趋势。

图片

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-05-05,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录