SIGGRAPH Asia 2023 | Im4D:动态场景的高保真实时新视角合成

SIGGRAPH Asia 2023 | Im4D:动态场景的高保真实时新视角合成

用户1324186

发布于 2023-12-28 15:10:02

发布于 2023-12-28 15:10:02

作者:Haotong Lin, Zhen Xu, Sida Peng 等 来源:SIGGRAPH Asia 2023 Conference 论文题目:Im4D: High-Fidelity and Real-Time Novel View Synthesis for Dynamic Scenes 论文链接:https://arxiv.org/abs/2310.08585 内容整理:梁焕雄

引言

动态视图合成是在给定输入视频的情况下渲染出真实动态场景的新视图,这是计算机视觉和图形学中一个长期存在的研究问题。这个问题的关键在于从多视角视频中有效地重建动态场景的 4D 表示,并允许在任意视点和时间上保持高保真度和实时渲染。

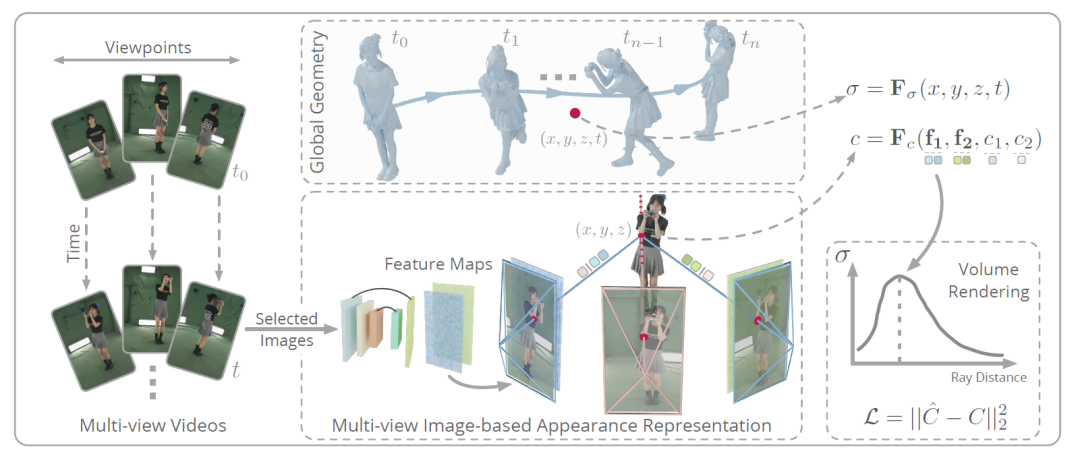

在本文中,作者提出了一种新的动态场景表示方法,称为 Im4D。实验表明,Im4D 实现了更快的训练和更好的渲染质量。论文的创新在于建立了基于网格的 4D 几何表示和基于多视角图像的外观表示的混合模型。具体而言,对于几何表征,作者从显式时空特征平面提取相应的特征,并用浅层 MLP 网络回归密度。对于外观模型,CNN 网络从同一帧的视图中提取特征图,随后将空间点投影到特征图上,以获得像素对齐的特征,再利用浅层 MLP网络来预测颜色。最后作者采用体渲染技术对新视角进行渲染。

算法

论文的目标是给定一个动态场景的多视角视频,重构随时间变化的 3D 模型,并且能够渲染任意视角和任意时间上的高质量图像。Im4D 包含两部分:基于全局网格的动态几何表示和基于多视角图像的外观表示。

图 1 模型的整体流程示意图

基于网格的动态几何表示

作者利用基于网格的模型来表征场景的几何特征。为了能够连续表征动态的几何特征,作者将静态几何函数扩展为 4D 矢量函数,即输入为 3D 坐标

和时间

:

为了实现

,作者首先在 4D 体积场中插值

得到

, 随后输入到一个浅层 MLP 网络

映射为标量密度

。同时为了保持高效的存储,4D 体积场被分解为 6 个正交平面

。最终的动态几何模型可以简化成公式:

作者提出的基于网格动态几何模型在时空上是全局和连续的。该模型从本质上保证了跨视图渲染的一致性。

基于多视角图像的外观表示

作者的目标是预测时空点

沿视图方向

的辐射值,于是作者提出了一种基于多视角图像的外观模型。和将外观表示为 4D 显式结构的 MLP 网络不同,作者将 4D 时空点映射到多视角图像的特征图上,并利用这些特征预测 4D 时空点的颜色。如此一来,外观模型只需要学会推断,而不需要记住空间和时间上沿每个视点的每个点的辐射值。

具体来说,为了从新的视角中渲染一张图像,作者首先选择

个相同帧的相邻图像,随后使用 2D UNet 方法从这些图像中抽取特征,得到

,其中

是从

视图中提取的特征图,

,

,

分别表示特征图的通道数、高度和宽度。空间邻近度定义为相机位置之间的距离。随后 3D 点

映射到

个视角中得到相对应的 2D 坐标

,其中

是映射到第

个视角的 2D 坐标。通过在映射的坐标

上双线性采样特征图

,得到映射的特征

和像素的颜色

。对投影的特征

进行聚合得到融合后的特征

。为简单起见,作者使用方差和均值作为聚合函数,其表达式为:

最后作者使用一种与点云网络类似的结构来预测点

的颜色:

其中,

表示第

个相机视角位置到点

的视角方向,

是方向

与

的归一化角度差。

高效的训练和渲染

高效的训练

实验表明,在100K的迭代次数下,基于图像的外观模型的方法比没有基于图像的外观模型训练的方法在480K的迭代次数下获得了更高的渲染质量。为了进一步提高训练速度,作者利用了基于多视点图像的外观模型的特性,设计了专门的训练策略。其基本思想是,外观模型可以被快速训练,因为它是一个推理模型,停止外观模型的训练,可以减少梯度下降的时间,从而加速了一次训练迭代。具体地说,首先迭代

次的几何模型联合训练图像特征网络,然后在每

次迭代时对图像特征网络进行微调。在实际应用中,所有实验的

被设置为5000,将

设置为20。

高效的渲染

作者计算了一个二进制场,该场指示每个体素是被占用还是为空。然后,该二进制场可以用于指导采样,跳过空区域中的采样,从而加快渲染过程。这个二进制场的存储非常小。例如,在ZJU MoCap数据集中存储一个大小为64x64x128的300帧的二进制场只需要18.75MB,并且可以无损地进一步压缩到1.1MB。这种加速技术可能比ENeRF更高效,因为只需要计算一次粗略的几何体(全局二进制场),而ENeRF需要估计每次渲染的粗略几何体(每个视图深度)。

实验

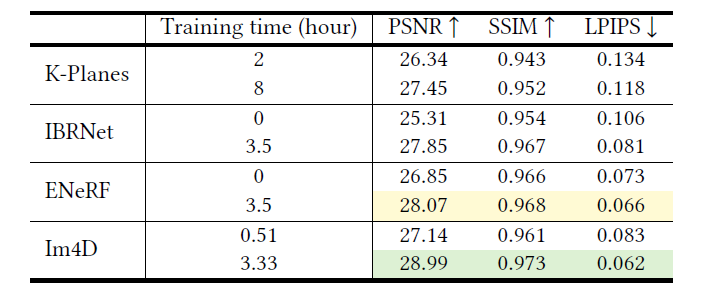

对比实验

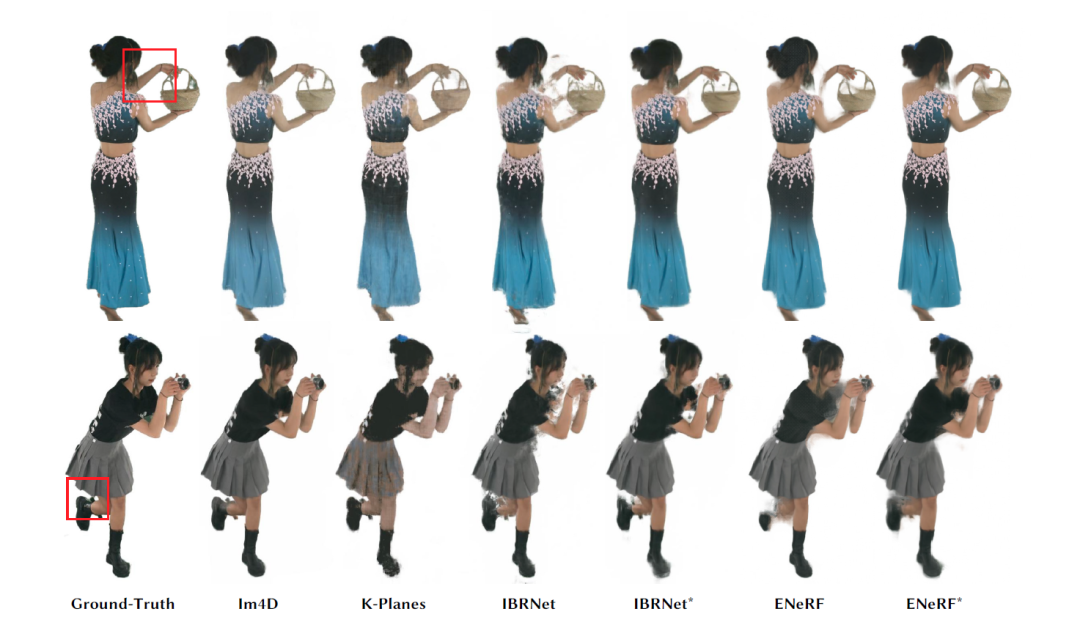

图 2

图 3

作者在4个数据集上进行了评估,包括DNA Rendering、ZJU MoCap、NHR和DyNeRF。其中,DNA Rendering包含动态对象。它的视频以15帧/秒的速度录制,每个片段持续10秒。由于视频中的人物具有复杂的服装纹理和动作,DNA Rendering非常具有挑战性。

消融实验

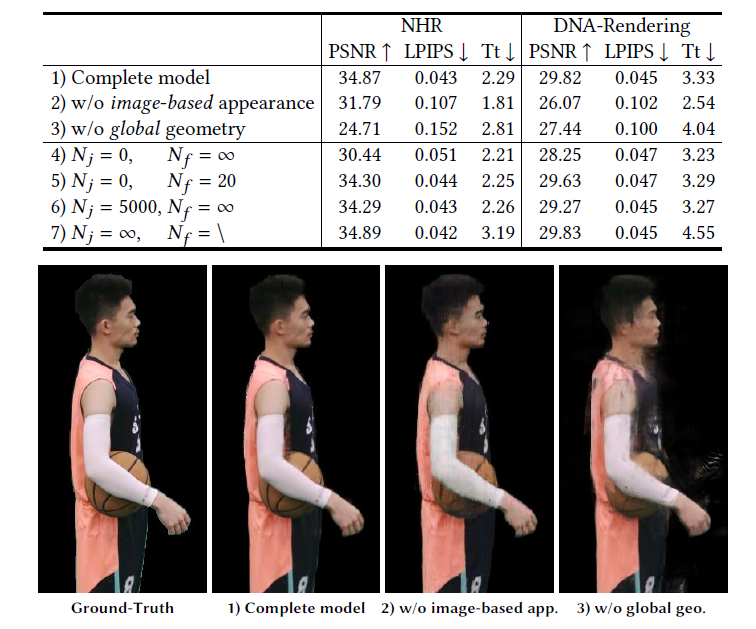

图4

作者对来自NHR和DNA Rendering数据集的2个序列进行了定性和定量消融研究。如图4所示,作者首先研究了所提出方法的核心组成部分,即基于多视角图像的外观模型和基于网格的全局几何模型的作用。图 4 表中的 2) 类似于K-Planes,而 3) 类似于没有IBRNet中提出的射线变换器的IBRNet。定量结果表明,缺乏基于多视图图像的外观模型和全局几何模型会导致性能极差。这一点在主观质量上变得更加明显。5)缺乏基于多视图图像的外观模型会导致图像细节丢失,而缺乏基于网格的全局几何会导致大量漂浮的伪影。此外,作者还探讨了其他组成部分的效果,包括所提出的有效训练策略。最初,不训练基于图像的外观模型,如表中的4),会导致较差的性能。不采用所提出的训练策略,如表中的7),会导致训练时间更长(大约多出一个小时)。最后,没有联合训练(

)或未微调图像特征网络(

)会导致稍差的结果。

评价

优势

作者所提出的方法在动态视图合成的各种baseline(包括 DyNeRF、NHR、ZJU-MoCap 和 DNA-Rendering 数据集)上表现出卓越的性能,在几个小时的训练内实现了最先进的渲染质量。此外,所提出的场景表示可以实时渲染,并处理各种场景中的复杂运动,包括室外场景,证明了其鲁棒性。

不足

对于某些视角中遮挡的物体,渲染质量差。尽管作者所提出的方法显着减少了先前基于多视图图像的渲染方法的渲染伪影,但它具有天然的局限性,即某些区域可能在输入视图中被遮挡,这可能导致不正确的外观预测。

训练时间较长。相比于K-Planes和ENeRF等工作,作者提出的方法训练时间有了很大的提升,但是训练时间仍然是以小时计,比不上ReRF等SOTA工作。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2023-12-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录