具身智能明日之境:肉眼可见的科幻世界

摘要

科幻正在成为现实。具身智能——有身体、会思考、能行动的机器人——不再是实验室里的演示,而是一批公司正在推向量产的东西。本文系统梳理了具身智能的定义与发展脉络,展示了当前 Tesla Optimus、波士顿动力、Figure AI、宇树、智元等国内外主要玩家的真实进展,并用四个具体场景描绘了 2028 到 2035 年之间,机器人将在工厂、家庭、极端环境以及数字世界中如何改变我们的日常生活。科幻不再是彼岸,它正在排队走向你。

科幻不再是遥远的想象,它正在工厂流水线上站岗,在你家门口等快递,在手术室旁边递手术刀。

目录

- Part 1 · 从"搬砖AI"到"有身体的智能"

- Part 2 · 具身智能的进化史

- Part 3 · 全球厂商图谱

- Part 4 · 可见的未来

- 结语 · 科幻不再是彼岸

Part 1 · 从"搬砖AI"到"有身体的智能"

1. 一个让大模型尴尬的问题

2023年底,ChatGPT横扫互联网,全世界的人都在试探它的边界:写合同、做题、帮人写代码、陪人聊天失恋……

但有个问题,它永远回答不了——

"我厨房水龙头坏了,帮我修一下。"

它最多给你一步步的文字说明,然后你还是得自己蹲在水槽下面,手忙脚乱地摸索水管接头。智能再强大,也只存在于屏幕那一侧的数字世界里。它没有手,没有眼睛,没有脚,感受不到水是热的还是冷的,也不知道旋转一个螺丝需要多少力气。

这就是纯语言大模型的根本局限:它是一个被关在服务器机房里的大脑,脖子以下什么都没有。

而具身智能(Embodied AI),要做的就是给这个大脑装上身体。

让它能看见、能听见、能感受触觉,然后伸出手,走过去,真的把那根水管修好。

2. 什么叫"具身"

"具身"这个词来自英文 Embodied,字面意思是"有身体的"。

在哲学上,这个概念早于人工智能存在——哲学家梅洛-庞蒂在20世纪中期就提出,人类的认知不仅仅在大脑里发生,身体的感知与行动本身就是智能的一部分。你能接住一个抛来的球,不是因为你在大脑里解了一道抛物线方程,而是身体的感知与肌肉记忆协同运作的结果。

放到AI领域,具身智能的定义是:

一种能够感知物理环境、在物理世界中行动、并通过与环境的持续交互来完成任务的智能系统。

三个关键词:感知(perceive)、行动(act)、交互(interact)。

缺一不可。

光感知但不行动,是监控摄像头。光行动但不感知,是洗碗机。真正的具身智能,是能感受到碗还没洗干净、然后决定再冲一遍的那种。

3. 三要素:感知、推理、行动

理解具身智能,记住这三层架构就够了:

第一层:感知——它怎么感受世界

眼睛(视觉相机 + 深度传感器):看清空间里有什么、在哪里、多远。

耳朵(语音识别):理解人说的话,接受语言指令。

皮肤(触觉传感器):感受接触面的力度、材质、温度——拿鸡蛋不碎,夹豆腐不烂。

空间感(IMU + SLAM):知道自己在哪,能在复杂空间里导航移动。

第二层:推理——它怎么决定该做什么

这是大模型进入具身智能的关键接口。

传统工业机器人的"大脑"是一段预设程序:拧三圈,放下,移动20厘米。

具身智能的大脑是一个VLA模型(Vision-Language-Action,视觉-语言-行动模型):

——看见凌乱的桌子,理解"把桌子收拾一下"这句话,然后自主规划:先搬书,再折叠衣服,把杯子放进杯架……

不是照着脚本走,是真的在想。

第三层:行动——它怎么动手做

身体形态决定了它能做什么:人形的双手可以操作大多数为人类设计的工具;四足的能翻越复杂地形;机械臂的精度能超过人类手术水平。

要素 | 传统机器人 | 具身智能 |

|---|---|---|

感知 | 固定传感器,感知范围窄 | 多模态感知,动态适应环境 |

决策 | 预设程序,无法应对意外 | 大模型实时推理,开放场景泛化 |

行动 | 重复固定动作 | 根据任务自主规划执行路径 |

这三层叠在一起,才是真正意义上的具身智能。

Part 2 · 具身智能的进化史

4. 一条走了七十年的路

如果你在1960年问一个工程师:"什么时候机器人能帮人做家务?"他可能会说:"三十年。"

然后就是一代又一代人在说"三十年"。

但2025年,有些事情真的不一样了。

让我们快速回顾这条走了七十年的路,看清楚它是在什么时候开始弯道加速的。

1961年:它从一条手臂开始

第一台工业机器人叫 Unimate,诞生于1961年,被安装在通用汽车的新泽西工厂。

它做什么?压铸焊接。把热腾腾的金属零件从模具里取出来,放到传送带上。

就这一个动作,每天重复几千次,毫不疲倦。

这是具身智能的史前时代:机器有身体(手臂),但没有大脑。它不"看",不"想",只是执行一段固定程序。给它换个任务,它就懵了。

从这个阶段到1980年代,工业机器人蓬勃发展,但核心逻辑没变:预设、执行、重复。聪明的工厂,愚蠢的机器。

2005年:它终于学会了走路

2005年,波士顿动力(Boston Dynamics)发布了一个改变所有人认知的视频:BigDog。

四条腿,金属骨架,在结冰的地面上稳稳地走。有人踢它一脚——它踉跄了一下,然后自己稳住。

全世界工程师都惊呆了。

这是第一次,机器人展现出了一种在物理世界"随机应变"的能力。它不是按固定程序迈步,而是通过传感器实时感知地面状态,动态调整每一步的着力。

但那时候它还是没有大脑。它不知道"走"是为了什么,也不知道"走到哪去"。只是会走路。

2017年:大脑开始生长

Transformer 架构的出现,是具身智能故事里最关键的一个转折点——尽管当时没有人意识到。

2017年,谷歌的那篇《Attention Is All You Need》论文,奠定了现代大模型的技术基础。

然后是GPT-2(2019)、GPT-3(2020)、ChatGPT(2022年底)。AI第一次展现出"通用理解"的能力:它能理解任意领域的文字、推理、对话。

这是具身智能等了几十年的那个大脑。

但大脑还飘在空中,和身体还没接上。

2023–2024年:接上了

2023年,谷歌DeepMind发布 RT-2(Robotics Transformer 2)。

RT-2第一次把视觉-语言大模型与机器人控制直接连接:你用自然语言告诉机器人"把可以当锤子用的东西递给我",它扫一眼桌面,然后拿起那把矿泉水瓶递给你——因为它"理解"了"锤子"的功能性含义,而不是靠识别"锤子"这个物体。

同年,π₀(Physical Intelligence公司)发布了更通用的VLA模型,可以驱动不同形态的机器人执行跨任务操作。

大脑和身体,第一次真正接上了。

2025–2026年:它开始上班了

2025年,这件事第一次被写进了中国《政府工作报告》——"积极培育人形机器人等新兴产业"。

一个技术方向被写入政府工作报告,意味着什么?意味着它不再只是实验室里的玩具,它是国家产业战略。

同一年,特斯拉工厂开始有 Optimus 上班,蔚来工厂的流水线旁边站着优必选的 Walker S,宇树科技科创板IPO申请获上交所受理,拟募资42亿元。

2026年,集邦咨询预测:中国人形机器人市场产量将同比增长94%。

这不再是"三十年后"的故事了。

5. 为什么偏偏是现在?三件事同时成熟了

历史上不是没有人想做具身智能,是做不到。现在能做,因为同时有三件事成熟了:

大脑成熟了

LLM/VLM 提供通用推理能力,VLA 模型把语言理解和动作执行打通。机器人第一次有了真正的"泛化"能力——不用为每个新任务重新编程。

身体成熟了

电机、减速器、传感器的供应链趋于稳定,成本持续下降。宇树G1 2026年售价约10万元出头,比2023年的人形机器人便宜了一个数量级。硬件不再是不可逾越的门槛。

数据成熟了

英伟达的 Isaac Sim、卡内基梅隆的 Genesis,仿真平台可以大规模生成机器人训练数据。真实世界的数据收集成本高、效率低,仿真训练是破局关键。现在一台服务器一天能生成相当于人类一年操作经验的数据。

三个条件同时到位,奇点就来了。

Part 3 · 全球厂商图谱

6. 不只是人形机器人

提到具身智能,很多人脑子里第一个画面是:一台两米高的类人机器人,穿着白色外壳,在工厂里走来走去。

但具身智能的形态远不止于此。不同的身体形态对应不同的场景,就像不同的动物进化出了不同的身体结构——蛇没有脚,但它能钻进老鼠洞。

形态 | 核心优势 | 典型场景 |

|---|---|---|

人形机器人 | 能使用一切为人类设计的工具和空间 | 工厂产线、家庭服务、通用助理 |

四足机器人 | 稳定性强,能适应复杂地形 | 工业巡检、灾害搜救、极端地形探索 |

机械臂 | 精度极高,可编程性强 | 精密制造、实验室操作、手术辅助 |

轮式移动机器人(AMR) | 速度快、载重大,适合结构化室内 | 仓储物流、医院配送、写字楼配送 |

无人机具身体 | 不受地面限制,覆盖范围广 | 空中巡检、灾害勘察、精准作业 |

接下来,我们逐个看今天最值得关注的玩家。

7. 国际阵营:西方四强

Tesla Optimus:钢铁马斯克的人形赌注

场景画面:2026年初,特斯拉加州弗里蒙特工厂。生产线上,一台白色的人形机器人正在执行零部件分拣任务。它的动作没有人类那么流畅,但稳定、精准,完全不需要休息。旁边的工人看了一眼,继续做自己那部分工作。

Optimus 是特斯拉做的一场豪赌。

马斯克的逻辑很简单:特斯拉已经拥有全球最强的汽车自动驾驶视觉感知技术(FSD),这套技术的核心——摄像头感知+神经网络决策——完全可以迁移到人形机器人上。车能自己开,机器人为什么不能自己走路、自己干活?

从 Gen1(2022年展示,基本靠人扶着走)到 Gen2(2023年,能独立完成简单任务),再到 2025年开始在工厂真正"上班",Optimus 的进化速度令人印象深刻。

技术亮点:

- 自研 AI 推理芯片(Dojo)+ FSD 视觉感知系统

- 端到端神经网络控制,不依赖预设程序

- 手部设计模仿人类,11个自由度,能做精细操作

商业目标:马斯克宣称未来人形机器人售价低于 2 万美元,并预测机器人数量将超过人类。目前 Optimus 的生产成本和定价尚未公开,但马斯克一贯习惯用极低目标价锚定市场预期。

现实一面:量产进度多次跳票,目前仍以工厂内部试验性部署为主,距离规模化商业销售还有距离。不过,没有哪家公司比特斯拉更擅长把"从不可能到量产"这件事做成。

Boston Dynamics:老大哥的转型

场景画面:英国一家建筑工地。一台黄色的四足机器人正在工地上巡逻。它自主规划路线,爬上一段碎石坡道,用身上的摄像头扫描周围,生成安全检查报告——全程没有人控制。

波士顿动力是具身智能领域的老大哥,它用了三十年时间,把机器人的"走路"做到了极致。

Spot(2019年商业发布)是目前全球商业化程度最高的四足机器人。建筑、石油、电力、采矿——凡是需要人"去危险地方看一眼"的场景,Spot 都找到了位置。

Atlas 则是它的人形旗舰。2023年,波士顿动力宣布退役液压版 Atlas,推出全新全电动版本。新版 Atlas 更轻、更灵活,能完成一些令人叹为观止的动作——从地上捡起一个沉重的航空箱,转身,走上斜坡,稳稳地放到指定位置。

近期大动作:被现代汽车收购后,商业化明显提速。2025年开始将 Atlas 部署到现代汽车制造工厂进行实际测试,这是波士顿动力历史上最接近真实量产落地的一步。

Figure AI:最会讲故事的人形机器人新星

场景画面:一个白色人形机器人站在桌子前,桌上摆着苹果、杯子和一些零散物品。研究员对它说:"给我一样能吃的东西。"它扫视桌面,拿起苹果,递了过来。研究员又说:"谢谢,你刚才在做什么?"它回答:"我在把苹果给你。"

这不是科幻电影,这是 Figure AI 在2024年发布的一段演示视频,背后是它与 OpenAI 的深度合作。

Figure AI 是2022年成立的新公司,但融资速度惊人——Jeff Bezos、英伟达、微软等大佬相继下注,合计融资超过10亿美元。

技术路线:不做底层大模型,而是站在 OpenAI 的肩膀上,把 GPT 的理解能力直接嫁接到人形机器人上,打通"自然语言→任务理解→动作执行"的完整链路。

产品:Figure 01 和 Figure 02,外形接近人类,能执行抓取、移动、分类等任务。

现实一面:融资充裕,演示效果出色,但量产与商业化落地仍在起步阶段。它更像是这场竞赛里的"全明星选手",真正的考验在量产那一关。

Agility Robotics Digit:最务实的落地者

场景画面:亚马逊仓库,凌晨两点。大多数工人已经下班,但橙色的 Digit 机器人还在工作。它从货架上取下一个箱子,扫描条形码,放上传送带。没有头,没有脸,看起来更像一台行走的搬运工具。

Digit 可能是西方人形机器人里最接近真实商业落地的一款。

它没有 Optimus 那么帅,没有 Atlas 那么炫,甚至连头都没有——只有躯干和四肢。但它专注一件事:在仓库里搬箱子,稳定、高效、可持续。

2024年,Agility Robotics 宣布与亚马逊达成合作,在真实仓库进行规模化试点。这是人形机器人历史上最大规模的商业落地合同之一。

给我们的启示:第一代真正商业化的人形机器人,可能不是最"聪明"的那个,而是最"专一"的那个。

8. 国内阵营:中国速度

如果说西方厂商还在炫技和融资,中国厂商已经开始拼出货量了。

2026年,集邦咨询预测中国人形机器人产量将同比增长94%,宇树科技和智元机器人两家合计占据国内约80%的出货量。这是真真切切在发生的工业化进程,不是PPT。

宇树科技(Unitree):用性价比打穿市场

场景画面:一段刷屏全球社交媒体的视频——一台1.27米高的白色人形机器人,在格斗擂台上被人踢倒,爬起来,继续站立,保持平衡。那台机器人叫 G1,售价约10万元人民币。

宇树科技是中国具身智能领域最特别的存在。

它的逻辑很清晰:先把价格打下来,让更多人买得起,形成市场规模,再谈其他。

产品线一览:

- Go2(四足):约万元级,消费娱乐 + 教育研究,卖给学校、研究机构、爱好者

- B2(四足):工业级,荷重40kg,续航4小时,主攻巡检和搬运

- H1/H1 Pro(人形):1.8m,面向开发者,全球高校和研究机构的热门采购目标

- G1(人形):1.27m,约10万元,全球最具性价比的量产人形机器人

G1 的10万元门槛是一个历史性时刻——这意味着它进入了中小企业能考虑采购的价格区间。

2026年3月,宇树科技科创板IPO申请获上交所受理,拟募资42亿元,即将成为 A 股"人形机器人第一股"。

技术特点:自研关节电机,对供应链有极强掌控力。这是性价比的根本来源。

智元机器人:稚晖君的全栈押注

场景画面:上海某汽车零部件工厂。流水线旁边,一台蓝灰色的人形机器人正在执行装配任务——拿起一个扭矩传感器,插入接口,拧紧,放下。它的动作精准而利落,旁边的摄像头记录下每一次操作数据,反馈给后台持续优化模型。

智元机器人的名字,很多人是从"稚晖君"这个名字听来的。彭志辉,前华为天才少年,在B站靠一个DIY机械臂视频积累了百万粉丝,然后创业做具身智能。

故事性十足,但更重要的是,他们真的做出来了。

产品:

- 灵犀X1/X2:人形,自研关节 + 灵巧手 + 调度系统

- AgiBot 智能调度平台:多机器人协同管理,打通"硬件-大脑-任务调度"全栈

核心竞争力:智元是国内少有的坚持"全栈自研"路线的厂商——从硬件本体、灵巧手、传感器,到VLA模型、调度系统,都自己做。全栈重,但护城河深。

2024年实现量产,2026年Q1出货量显著增长,主攻B端工厂落地——汽车、3C电子是核心战场。

优必选(UBTECH):最早上班的那一台

场景画面:2024年2月,蔚来汽车的某条生产线。镜头拉近,一台白色人形机器人正在缓步走向车身,手部相机扫描门缝,执行质检任务,然后走向下一辆车。它叫 Walker S,是优必选做的。

优必选是中国人形机器人商业落地最早的公司。

2023年底在香港上市,成为"人形机器人第一股"。2024年,Walker S 正式进入蔚来汽车工厂实训,执行车门锁质检、安全带检测、车灯盖板质检、贴车标等任务。

这些任务听起来简单,但每一个都需要视觉识别、精细操作和路径规划的协同。Walker S 做到了。

此后,吉利、一汽、奥迪、东风等车企相继与优必选合作,Walker S 在越来越多的汽车工厂里"打工"。

为什么车厂?

汽车工厂是最理想的第一战场:空间结构化(地面平整、路线固定),任务重复性高(质检、装配),对精度要求高但可量化,出了问题可以快速发现和纠正。比家庭场景容易做,比传统流水线又有更多灵活需求——刚好是具身智能能发挥优势的地方。

傅利叶智能(Fourier Intelligence):从康复到通用

场景画面:某省级康复医院。一台机器人辅助装置正在帮一位中风患者做手部康复训练,感知手指的力度和角度,根据康复进度实时调整阻力。这台装置的"骨子里",和傅利叶最新发布的通用人形机器人 GR-2 用的是同一套传感与控制技术。

傅利叶智能走了一条与众不同的路——先从康复机器人起家,积累了十余年对人体运动学的深刻理解和触觉传感技术,再切入通用具身智能。

GR-1(2023年发布)、GR-2(2024年升级)在灵巧手和人体动作仿真上有独特优势,是目前人形机器人领域在精细操作层面做得最细腻的厂商之一。

差异化定位:不抢量产速度,而是在"像人一样精细操作"这个核心能力上做深。

云深处(Deeprobotics):四足界的实干派

场景画面:新疆某输电线路巡检现场。峡谷里,工程师无法到达的地方,一台黑色四足机器人正在沿着线路前行,摄像头扫描导线绝缘子的状态,数据实时回传。这种场景,以前要么派人冒险,要么飞无人机——但无人机飞不进峡谷。

云深处专注四足机器人,产品线叫"绝影"。

没有太多花哨的故事,专注工业巡检:电力、石油、矿山、铁路……凡是"人不好进,无人机飞不稳"的地方,绝影机器人就是答案。

现在已经有了稳定的商业化收入,是国内四足机器人领域最接近"闷声赚钱"状态的公司。

9. 大厂背书:生态布局者

有一类玩家不自己做机器人,但整个具身智能行业离不开他们:

英伟达是这场革命的"卖铲人"。

黄仁勋在2024年CES上发布了 GR00T(通用机器人基础模型),这是英伟达为具身智能专门设计的世界模型。同时,Isaac Sim 仿真平台可以生成大规模机器人训练数据,Thor 芯片专为机器人端侧推理设计。英伟达不站队任何一家机器人厂商,但所有厂商都需要它。

华为在计算与联接层面布局,盘古大模型赋能机器人决策层,同时在与宇树等厂商深度合作。

小米用 CyberDog 和 CyberOne 探水,CyberDog(四足)已经商业化销售,CyberOne(人形)目前仍处于展示阶段。小米的入场,更多是"让大众对机器人不陌生"的用户心智建设。

比亚迪则是这场游戏里最重要的买方之一——作为全球最大的电动车制造商,比亚迪有全球规模最大的工厂,也有最迫切的自动化需求。谁能进比亚迪工厂量产,谁就真正打赢了第一关。

Part 4 · 可见的未来

10. 三个阶段,三种世界

预测未来不是算命,而是看清技术演进的节奏和阶段性目标。

目前来看,具身智能大致会经历三个阶段:

阶段 | 时间线 | 标志性特征 |

|---|---|---|

商业化元年 | 2025–2027 | B端工厂量产,替代危险/重复劳动,售价降至20万以内 |

家庭普及期 | 2028–2033 | 进入中产家庭,家务/照护/陪伴,售价降至3–5万 |

融合共生期 | 2033+ | 机器人与AI Agent无缝协作,物理与数字边界消融 |

但这三个阶段不是线性的,它们会有重叠,不同场景会有不同速度。

下面,用四个具体场景展开这个未来。

11. 场景一:工厂——它已经在这里了

2030年工厂产线——人形机器人与工人并肩协作(AI生成)

这不是预测,这已经发生了。

2026年的工厂,长这样:

想象一条汽车焊接产线。每隔五个工位,就有一台人形机器人站在工人旁边。它不说话,只干活——夹取,移动,安装,质检,循环往复。

工人小张负责调试一台新来的机器人。他不需要编程,只需要对着机器人演示三遍,机器人通过视觉学习记住动作,然后自己做。两个小时后,机器人进入正式工作状态。

这种"示教"方式——通过人类演示来学习任务——是目前最主流的具身智能工厂部署方式,已经在优必选、智元等厂商的产线上实际运行。

为什么工厂是第一战场?

工厂有三个对具身智能友好的条件:

1. 结构化环境:地面平整,路线固定,任务可重复。比家庭的"乱"简单多了。

2. 需求清晰:工人短缺+危险岗位替代,ROI 可计算,采购决策相对简单。

3. 容错率高:出了问题,工程师可以立刻干预,不会造成不可控的后果。

2028年的工厂,可能长这样:

不只是单台机器人上岗,而是机器人集群协作。工厂的某一层全是机器人在工作,人只需要在控制室里监控数字大屏,偶尔处理机器人"卡住了"的异常情况。

中间件层面,AgiBot 这类调度平台会统一管理几十台机器人,分配任务,协调冲突,优化效率——就像外卖平台调度骑手一样,只不过调度的是钢铁身体。

12. 场景二:家庭——最难啃的骨头,最大的市场

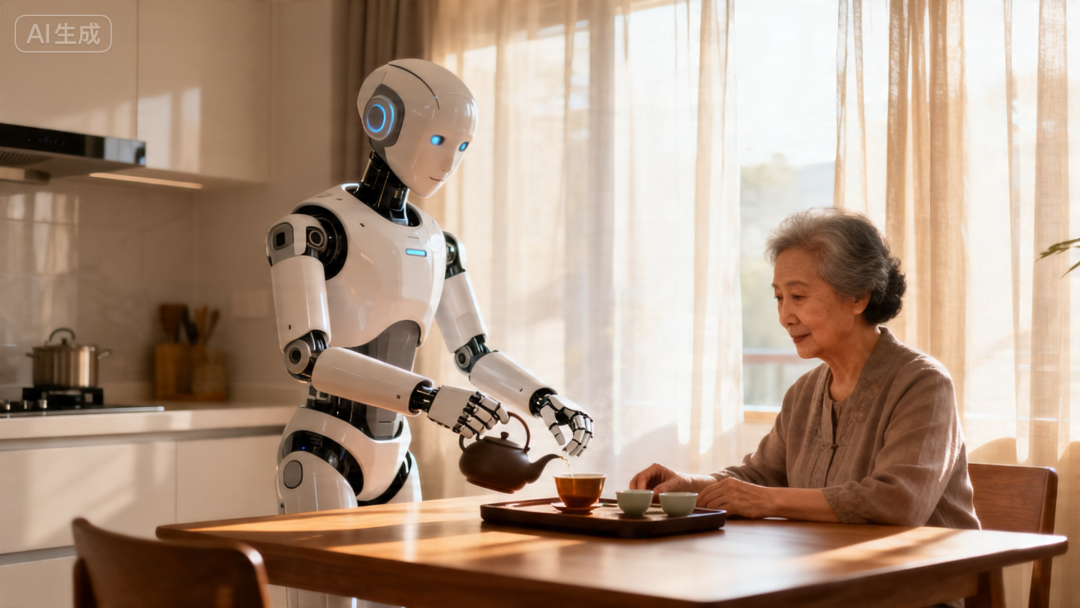

2031年家庭场景——机器人保姆照顾老人(AI生成)

工厂的成功只是开胃菜。真正的终局,是进入家庭。

想象一个2031年的场景:

你的外婆80岁,一个人住在四楼,子女都在外地。

以前她最怕的不是生病,而是那种微妙的危险:夜里起床去喝水,踩到地上的东西滑倒,等天亮才被发现。

现在,她家里有一台家庭机器人伴侣。它叫"小陈",是外婆自己起的名字。

早上六点半,它准时进厨房,用外婆习惯的方式煮粥——火候、时间、加不加枸杞,都记在它的记忆模型里。八点,它提醒外婆吃降压药,把药和温水一起送来。

外婆下午睡着了,忘记关窗,下雨了。它轻轻关上窗,然后走到外婆身边轻声说:"外婆,下雨了,我帮你关上窗了,您继续睡。"

某天外婆在浴室里摔了一跤,它听到动静,三秒内赶到,扶住她,评估受伤程度,然后说:"我帮您联系一下李明他们?"——"李明"是外婆的儿子,也就是你。

为什么家庭比工厂难10倍?

家庭是人类生活的最后一块复杂地带:

- 物品乱放、路线不固定——工厂的结构化优势全消失

- 与人的距离近——一个错误动作就可能伤人

- 任务模糊——"帮我整理一下"这句话,对不同人在不同状态下意味着完全不同的东西

- 情感需求——老人需要的不只是服务,还有陪伴和被理解

这要求具身智能在感知、决策、安全控制三个层面都有更高量级的突破。

但中国的老龄化速度是全世界最快的之一。到2035年,60岁以上人口预计超过4亿。"谁来照顾老人"是全社会的焦虑,具身智能是目前能看到的唯一规模化解法。

这个市场足够大,驱动力足够强,最终一定会有人做出来。

13. 场景三:极端环境——人类不该去的地方

核电站巡检——四足机器人在高辐射区域自主作业(AI生成)

2026年,日本福岛核电站:

一台四足机器人正在走进反应堆废墟的深处。辐射值高到任何人类工人穿多厚的防护服都不敢进去。

它身上的传感器实时记录每一处管道的状态,把数据传给地面的工程师。它遇到了一段倒塌的钢筋,自主评估路线,绕行,继续前进。

这种场景,以前的选择是:要么花天文数字费用派防护装备最好的工程师冒险进去,要么就不管,让问题继续扩大。

具身智能给了第三个选择:让机器人去做人不该做的事。

除了核电站,还有:

地震废墟:搜救机器人钻进人无法进入的狭小空间,搜寻生命信号。

深海:水下探测机器人代替潜水员作业,突破人类的生理极限。

极端气候:在零下60度的南极,或者50度的沙漠,执行数据采集和基础设施维护任务。

太空:SpaceX 与波士顿动力的组合已经在公开场合讨论——用人形机器人 Optimus 配合星舰执行火星任务。马斯克宣称Optimus将搭乘2026年底的星舰发射任务。

这个场景没有太多商业逻辑,更多是人类文明的能力边界拓展。但它可能是具身智能最能展现价值的地方——因为它保护了人的生命。

14. 场景四:AI Agent 具身化——数字大脑长出真实的双手

AI Agent 具身化——数字助理长出双手(AI生成)

这是最让人脑洞大开的一个场景,也是最接近"科幻"的想象——但它的技术路径其实已经清晰可见。

现在,AI Agent 能帮你做的事是这样的:

"帮我订一张下周五去上海的机票,顺便预订一家靠近会场的酒店。"

它在数字世界里操作:搜索、比价、点击、填写,全部在屏幕上完成。

2030年之后,当 AI Agent 和具身智能融合,它能帮你做的事可能是这样的:

"我下周要出差,帮我准备好。"

然后,它不只是订机票——它走进你的卧室,根据天气预报和行程,拿出三件适合的衣服叠好放进行李箱,去厨房打包你下午要吃的水果,锁好阳台的窗,然后在你出门前告诉你:"行李已经准备好了,你的护照放在包的右边口袋里。"

数字大脑,长出了真实的双手。

这个融合的关键技术链路:

1. LLM / AI Agent 负责任务理解和规划("下周出差"→分解成十几个子任务)

2. 具身智能本体负责物理执行(取衣服、叠衣服、放行李)

3. 数字孪生负责环境感知和同步(知道你家里哪件衣服在哪里)

三者的融合,本质上是物理世界和数字世界第一次真正打通。

这一天到来之后,"AI助理"和"机器人"这两个词,可能就合并成一个词了。

15. 还差什么:三道还没解开的题

写到这里,一定有人想问:如果未来这么确定,为什么还没到?

因为还有三道题还没解开。

第一道题:灵巧手

人的手有27块骨骼、29个关节、34条肌肉,每天做着几千种不同的操作——系鞋带、剥橙子、穿针引线、握住一颗鸡蛋不碎。

这是目前所有人形机器人的公开痛点。现有的机器人手,能抓取、能移动,但在极细腻的操作上仍远不如人类。一双能真正接近人手能力的灵巧手,是具身智能真正进入家庭的关键前提。

傅利叶、智元、波士顿动力都在专项攻克这个问题。这是一道机械设计、材料科学和神经控制的综合难题,没有捷径。

第二道题:续航

现在大多数人形机器人的电池续航是2到4小时。

对工厂来说,这勉强够用——可以换班充电。但对家用场景来说,一台机器人下午两点开始工作,六点就没电了,这显然不行。

固态电池、更高效的执行器、更低功耗的推理芯片——三个方向都在推进,但都还需要时间。

第三道题:安全与信任

机器人走进家庭,意味着它要和孩子、老人、宠物共处一室。

一次操作失误,可能造成人身伤害。一次数据泄露,你家里的所有情况都被别人知道了。

这不只是技术问题,更是监管、法律和社会信任体系的建立问题。

在这三道题没有答案之前,具身智能在家庭场景的大规模普及,就会面临一道隐形的墙。

但历史告诉我们,每一道"不可能"都只是时间问题。

结语 · 科幻不再是彼岸

有人曾经问过:人类历史上,最像科幻的一个日常场景是什么?

不是飞行汽车,不是量子计算,不是脑机接口。

是这个:

你下班回家,开门,一台机器人把热好的饭端到你面前,用一种不慌不忙的声音说:

"你回来了。"

这句话里,有感知(知道你回来了),有记忆(知道你喜欢吃什么),有行动(已经把饭热好),有某种接近"在乎"的东西(等着你)。

这不是人,但它完成了一件只有"在乎你的人"才会做的事。

这一天,可能比你想象的近得多。

具身智能的故事,才刚刚开始写第一章。

延伸阅读

- 中国信通院《具身智能发展报告》(2026年1月)

- 工信部《人形机器人与具身智能标准体系(2026版)》

- 英伟达 GR00T 世界模型技术文档

- 宇树科技 G1 技术白皮书

- TrendForce 集邦咨询:2026年中国人形机器人市场产量预测报告

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-17,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录