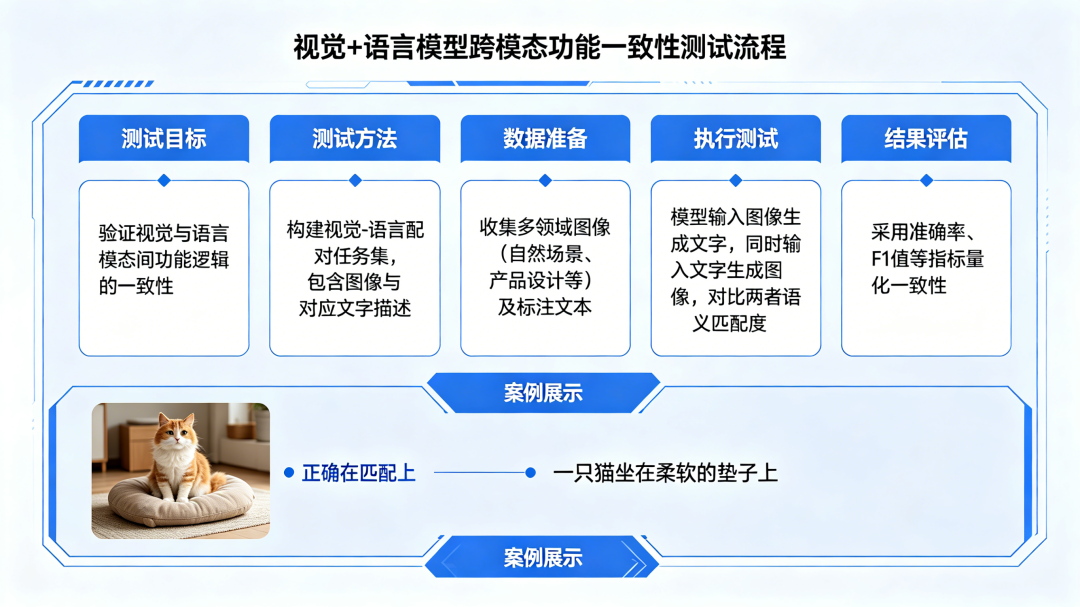

"视觉+语言"模型进行跨模态的功能一致性测试流程

"视觉+语言"模型进行跨模态的功能一致性测试流程

AI智享空间

发布于 2026-04-21 21:00:12

发布于 2026-04-21 21:00:12

过去几年,我们见证了大语言模型的爆发式增长。ChatGPT、Claude等产品让AI能够流畅对话、撰写代码、分析文本。但当GPT-4V、Gemini等多模态模型出现时,一个新的挑战浮出水面:AI不再只处理文字,它开始“看”图片、“读”图表、“理解”视觉信息。

这带来了一个微妙而关键的问题:同一个模型,面对文字描述和图片输入时,会给出一致的答案吗?

设想这样的场景:你问模型“这张X光片显示什么病症?”,它回答“可能是肺炎”。然后你用文字详细描述同一张片子的特征,它却说“看起来正常”。这种跨模态的不一致,在医疗诊断、自动驾驶、工业检测等高风险场景中,可能带来灾难性后果。

传统的软件测试关注“功能是否实现”和“边界条件处理”,但多模态AI测试面临的是更深层的挑战:如何验证模型在不同感知通道下的认知一致性?这不是简单的输入输出校验,而是对AI“理解”能力的跨维度审视。

本文将从测试工程师和AI产品负责人的视角,探讨这个新兴领域的核心矛盾与实践路径:

- 从“单一输入验证”到“跨模态对齐测试”

- 从“黑盒准确率”到“认知机制探查”

- 从“静态测试集”到“对抗性样本生成”

- 从“人工标注”到“自动化一致性度量”

- 从“模型迭代”到“测试基础设施演进”

一、从“单一输入验证”到“跨模态对齐测试”

清晰的输入输出映射

在传统软件测试中,我们习惯了确定性的验证逻辑。对于纯文本的语言模型,测试相对直接:给定问题,检查答案是否准确、是否安全、是否符合预期格式。即使是复杂的NLP任务,本质上也是在单一模态内验证转换的正确性——文本进,文本出。

测试团队的工作流程往往是:

- 构建标注数据集(问题-答案对)

- 运行模型推理

- 计算准确率、F1分数等指标

- 分析badcase并迭代

这套范式建立在一个隐含假设上:输入空间是同质的,测试覆盖率主要关注语义的广度和深度。

等价输入的非等价输出

当模型同时接受图像和文本输入时,测试的复杂度发生了指数级跃迁。核心挑战在于:语义等价的不同模态输入,应当产生一致的输出。

举个真实案例:某医疗AI团队在测试多模态诊断模型时发现:

- 图像输入:上传一张显示右下肺阴影的CT片,模型判断“疑似肺部感染,建议进一步检查”

- 文本输入:“患者CT显示右下肺野可见片状高密度影,边界模糊”,模型回答“描述不够详细,无法给出明确判断”

同一个临床发现,两种表达方式,截然不同的置信度。问题出在哪里?

经过深入分析,团队发现:模型的视觉编码器在医学影像上有专门的预训练,能直接识别病灶特征;但文本通路依赖的是通用语言理解,缺乏对医学术语与视觉模式的映射能力。两个模态的“知识库”实际上没有对齐。

这暴露出跨模态测试的核心要义:不是测试单个功能点,而是测试模型内部不同感知通道的认知一致性。这要求测试策略从“输入覆盖”转向“模态对齐验证”:

- 构建语义等价对:同一事实的图像版本和文本描述

- 设计探测任务:不仅问“是什么”,还要问“为什么”、“有什么差异”

- 量化一致性:建立可度量的对齐指标(而非简单的对错判断)

核心洞察:多模态测试不是单模态测试的简单叠加,而是需要专门设计“模态对齐”这一新的测试维度。当你的测试用例库中出现“同一语义的多模态表达对”时,才算真正入门跨模态测试。

二、从“黑盒准确率”到“认知机制探查”

高分模型的隐藏断层

大多数AI测试团队习惯用准确率、召回率这些聚合指标来评价模型。在多模态场景下,这些指标往往呈现出欺骗性的“优秀”。

某金融科技公司开发了一个多模态风控模型,用于审核企业贷款申请。测试结果显示:

- 纯文本材料审核准确率:92%

- 包含图表的报告审核准确率:94%

- 综合准确率:93%

数据很漂亮,模型上线了。三个月后,风控团队发现一个严重问题:模型对财务图表的解读严重依赖OCR提取的数字,而忽略了图表趋势。具体表现是:

- 给模型一张“营收逐年下降”的柱状图 → 模型关注最后一年的绝对值,给出“财务状况良好”

- 用文字描述“过去三年营收分别为500万、300万、150万” → 模型立即识别出“持续下滑,风险较高”

同样的信息,图像输入反而导致误判。但这个问题完全被高准确率掩盖了,因为测试集中大部分图表案例的趋势和数值是一致的。

用对抗性测试揭示断层

真正成熟的多模态测试,需要从“验证输出正确性”深入到“理解模型如何做决策”。这要求设计专门的探测任务。

某计算机视觉团队借鉴了认知心理学的实验设计,创造了一套“跨模态认知探针”方法:

1. 最小对立对测试构建只在关键特征上有细微差异的样本:

- 图像A:一只猫站在桌上

- 图像B:一只猫坐在桌上

- 文本A:“一只猫站在桌上”

- 文本B:“一只猫坐在桌上”

要求模型区分站/坐,测试其对姿态理解的跨模态一致性。他们发现:视觉通道能识别站姿,但文本通道经常混淆这两个动词——因为训练数据中“站”和“坐”经常被互换使用。

2. 反事实干扰测试给出图像+文本,但文本故意包含错误描述:

- 图像:一个红苹果

- 文本:“这是一个绿色的苹果”

- 问题:“这个苹果是什么颜色?”

测试模型是更相信视觉还是文本,以及在冲突情况下的决策逻辑。结果发现:大多数模型倾向于“相信文本”,因为训练时图像通常配有正确标注,模型学会了“文本是ground truth”。

3. 推理链路追踪 不仅要答案,还要模型解释“为什么”:

- 输入:一张复杂的交通场景图

- 问题:“这个路口能否左转?”

- 要求:同时输出判断+推理过程

对比纯视觉推理和视觉+文本标识的推理链,发现模型在看到文字标牌时会“跳过”视觉分析,直接基于文本做判断。这意味着如果标牌被遮挡或篡改,模型会失效。

核心洞察:在多模态AI时代,测试工程师需要兼具“心理学家”的思维——不是简单检验行为,而是推测和验证内在的认知机制。当你的测试报告从“准确率93%”变成“视觉通道对颜色的理解比文本通道稳定,但在空间关系推理上更弱”时,你已经进化到了新的层次。

三、从“静态测试集”到“对抗性样本生成”

静态测试集的天花板

传统AI测试依赖人工标注的测试集:收集数据、打标签、固化成benchmark。这种方法在多模态场景下暴露出致命弱点:无法覆盖跨模态的组合爆炸空间。

某电商平台的商品审核团队就遇到了这个问题。他们构建了10万条测试样本,包括:

- 5万纯图像(商品图片+违规/合规标签)

- 3万纯文本(商品描述+违规/合规标签)

- 2万图文对(图片+描述+标签)

模型在这个测试集上达到96%准确率,但上线一周就出现大量漏检。典型案例:

- 图像合规,文本违规:卖家上传普通T恤图片,但描述中暗示“仿制某奢侈品牌”

- 文本合规,图像违规:描述说“运动鞋”,图片却是三无产品

- 图文“狼狈为奸”:图片显示正品,文本描述正常,但图中小字是假冒品牌logo

这些组合在静态测试集中占比不到0.5%,但在真实场景中却是违规者的主要手段。

让测试数据“活”起来

几个领先的团队开始采用对抗性样本生成(Adversarial Sample Generation)策略,核心思路是:不依赖人工穷举,而是让程序自动发现模型的薄弱点。

某内容安全团队实施的方法值得参考:

1. 跨模态变异(Cross-Modal Mutation)

- 基础样本:一张正常的风景图 + 描述“日落时的海滩”

- 自动生成变体:

- 图像不变,文本改为“这是AI生成的虚假风景”(测试模型是否因文本干扰而误判图像真实性)

- 文本不变,图像替换为相似但含违规元素的图(测试模型对细节的敏感度)

- 图文都微调,但语义出现矛盾(测试冲突解决能力)

2. 语义保持的对抗扰动 利用生成模型创建“难样本”:

- 原图:清晰的违禁品图片

- 生成对抗版本:加入视觉噪声,但人眼仍可识别

- 同时生成对应的文本描述变体:“委婉暗示”而非直接描述

这类样本专门针对模型的决策边界,能以更小的数据量发现更多问题。

3. 模态解耦攻击 某团队设计了一种巧妙的测试:

- 训练一个“反向生成器”,输入文本,输出“最难被模型正确识别”的图像

- 或反之:给定图像,生成“最容易误导模型”的文本描述

这实际上是在探索模型的“认知盲区”——哪些跨模态组合最可能导致误判。

核心洞察:在对抗性环境中(如安全检测、风控),静态测试集是一种“刻舟求剑”。跨模态AI的测试必须建立“动态样本生成-发现问题-修复-再生成”的闭环。当你的测试系统能够“自己找问题”而不是等着用户发现问题时,才算构建了可持续的质量保障能力。

四、从“人工标注”到“自动化一致性度量”

人工标注的不可持续困境

跨模态一致性测试面临一个残酷的现实:人工标注的成本和周期,跟不上测试需求的增长速度。

某AI医疗公司的痛苦经历很有代表性。他们的多模态诊断模型需要验证:

- 同一病例的影像和文字病历是否得到一致结论

- 不同模态输入时的置信度是否合理

- 当模态冲突时,模型的决策依据是否正确

按传统方法,每个测试用例需要:

- 医学专家标注图像(30分钟)

- 撰写标准化文本描述(20分钟)

- 评估模型两种输出的一致性(15分钟)

- 判断不一致是否合理(模型错 vs 人工描述有偏差,10分钟)

一个完整的测试用例要75分钟,成本超过500元。他们需要10万个测试用例,意味着5000万成本和数年时间——完全不可行。

从主观判断到客观指标

先进的团队开始探索“机器评估机器”的方法,核心是建立可自动计算的一致性指标。

1. 输出语义相似度度量

某NLP团队设计了一套自动评估流程:

- 基线采集:对同一语义事实,分别用图像和文本输入,记录模型输出

- 向量化对比:将两个输出编码为向量,计算余弦相似度

- 阈值判定:相似度<0.7视为潜在不一致,自动标记为需要人工复核

他们还引入了“交叉验证”机制:

- 用另一个独立的多模态模型评估输出是否语义等价

- 如果评估模型也认为不一致,优先级上升

这将人工复核量减少了80%,只需要关注“高度疑似不一致”的案例。

2. 推理路径一致性检查

某团队利用模型的可解释性输出(attention map、reasoning trace)进行自动化检验:

- 注意力对齐度:

- 对于图像输入,记录模型关注的图像区域

- 对于文本输入,记录高权重的词汇

- 检查两者是否指向相同的语义要素(如都关注“左上角”或“第三季度”)

- 推理步骤匹配:

- 要求模型输出“思维链”(Chain of Thought)

- 对比图像推理和文本推理的中间步骤

- 标记出现分歧的节点

举例:在财务分析任务中,模型看图表时的推理是“识别趋势→计算增长率→判断健康度”,看文本时是“提取数字→直接判断”,这种路径差异会被自动检出。

3. 反事实一致性测试

某团队开发了一套巧妙的自动化方法:

- 生成反事实样本:用生成模型创建“改变一个关键事实”的变体

- 原图:5个苹果

- 变体图:3个苹果

- 原文:“有5个苹果”

- 变体文:“有3个苹果”

- 自动评估:

- 如果模型对两个版本的图像输出不同答案,对两个版本的文本也输出不同答案,且改变方向一致 → 一致性高

- 如果只对一个模态敏感 → 一致性问题

这个方法的妙处在于,不需要知道“正确答案”是什么,只需要验证“模型在两个模态下的响应模式是否同步”。

关键转折点:他们意识到,不需要对每个测试用例都做“绝对正确性”判断,而是建立“相对一致性”的度量体系。这个思维转变解放了自动化的潜力。

核心洞察:跨模态一致性测试的自动化,不是简单的“用脚本代替人工”,而是测试哲学的转变——从“追求标注绝对真理”到“度量模态间相对一致性”。当你的测试系统能够在没有ground truth的情况下发现问题时,就突破了人工标注的天花板。

五、从“模型迭代”到“测试基础设施演进”

短视的优化陷阱:

大多数AI团队的工作节奏是“训练-测试-修bug-再训练”的循环,焦点始终在模型本身。这在单模态时代问题不大,但在多模态时代会遇到瓶颈。

某大厂的视觉-语言团队在2023年陷入了困境:

- 每个月发布新模型,准确率持续提升(91%→92%→93%)

- 但跨模态不一致问题的数量并未减少,甚至在某些版本增加

- 工程师疲于奔命修复badcase,却感觉在“打地鼠”

复盘时发现问题:他们有完善的模型训练流程,却没有系统化的测试基础设施。

- 测试用例散落在各个项目目录,没有统一管理

- 每次测试都从零开始,无法复用之前发现的问题样本

- 缺乏对“不一致类型”的系统分类和趋势分析

- 没有机制去追踪“某类问题是否在新版本中被解决”

他们意识到,测试能力本身需要像产品一样迭代演进。

基础设施思维:

几个领先团队的做法值得借鉴,他们把跨模态测试作为一个独立的“产品”来建设:

1. 建立模态对齐测试库(Modality Alignment Test Suite)

某团队的实践:

- 结构化存储:每个测试用例包含

- 图像输入+对应的标准文本描述+变体描述

- 预期的一致性行为(完全一致/可接受差异/必须不同)

- 元数据(难度级别、所属场景、历史表现)

- 版本管理:像代码一样对测试集进行git管理

- 每次发现新的不一致模式,作为新用例提交

- 定期review并“退役”过时的测试(模型已稳定掌握)

- 分层设计:

- L0层:基础对齐(颜色、数量、位置等基本属性)

- L1层:复杂推理(因果关系、时序理解等)

- L2层:边界情况(模态冲突、信息不足等)

2. 构建可观测性平台

某金融科技公司开发了一套“跨模态一致性监控系统”:

- 实时指标看板:

- 按模态对显示一致性得分(图-文、图-音频、文-音频等)

- 按任务类型拆分(分类、检测、生成等)

- 趋势曲线:对比历史版本

- 问题热力图:

- X轴:不同场景(医疗、金融、娱乐…)

- Y轴:不一致类型(视觉主导、文本主导、完全矛盾…)

- 颜色深度:问题严重程度

- 自动告警:

- 某类一致性指标下降超过阈值,立即通知相关团队

- 新发现的不一致模式自动归类,并推送给相应负责人

转折点:当团队leader将测试负责人的KPI从“发现多少bug”改为“测试平台覆盖多少场景+被多少团队使用”时,测试团队的心态和方法彻底改变了。

核心洞察:跨模态AI测试不是“一次性工程”,而是需要持续投入的基础设施。当你的组织把测试能力视为可复用、可迭代、可输出的“产品”时,才能跳出“救火-修补”的循环,进入“预防-演进”的正向轨道。衡量标准不是“这个版本发现了多少问题”,而是“我们的测试体系是否比三个月前更强大”。

结语

面对多模态AI这个新兴领域,很多测试团队会问:“我该先做什么?是投入人力构建测试集,还是研发自动化工具,还是学习最新的对抗性方法?”

答案是:这些不是非此即彼的选择,而是不同阶段的演进路径。

如果你的团队刚开始涉足多模态AI测试,首要任务不是追求完美的方法论,而是建立“跨模态一致性”的意识和基本验证能力。从构建第一批“同一语义的图文对”开始,哪怕只有100个精心设计的案例,也能发现核心问题。

如果你已经有了基础测试集,下一步是从“黑盒验证”走向“机制探查”。开始思考:为什么这里不一致?是训练数据的问题、模型架构的问题,还是任务设计的问题?用探针式的测试去验证假说,而不是盲目堆积测试用例。

如果你的测试工作已经系统化,该考虑的是可持续性:建立自动化流水线,构建对抗样本生成能力,把测试变成持续演进的基础设施。这个阶段的标志是,测试不再是“发版前的一次性检查”,而是“嵌入研发全流程的质量防线”。

几点行动建议:

- 保持技术敏感度:多模态AI的测试方法还在快速演进,关注学术界的最新研究(如对抗样本生成、可解释性分析),但不要迷信论文,要结合实际场景验证有效性。

- 建立问题分类体系:不要笼统地说“不一致问题”,要细分为“视觉主导型”、“文本干扰型”、“融合失效型”等,针对性设计测试策略。这种分类本身就是对模型认知机制的理解深化。

- 重视测试基础设施:把至少20%的资源投入到测试平台、工具链、数据管理的建设上。短期看可能拖慢进度,长期是效率的倍增器。

- 培养跨学科视角:让测试团队不仅懂工程,也要懂一点认知科学、对抗性学习、统计推断。多模态测试的本质是跨学科问题,单一背景的团队会遇到天花板。

在这个AI能力快速跃迁的时代,测试工程师面临的挑战前所未有。但也正是这种不确定性,赋予了这个角色新的价值:不是被动地验证产品,而是主动地探索AI的边界和盲区。

当你的测试报告从“通过率93%”进化为“视觉通道在X场景下存在Y类认知偏差,建议采用Z融合策略”,你就不再是一个“质检员”,而是团队中理解AI最深刻的人之一。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录