AI安全与沉思,心灵与AGI对齐的计算模型 3万字

AI安全与沉思,心灵与AGI对齐的计算模型 3万字

CreateAMind

发布于 2026-03-11 17:12:15

发布于 2026-03-11 17:12:15

Contemplative Wisdom for Superalignment

https://arxiv.org/pdf/2504.15125

摘要

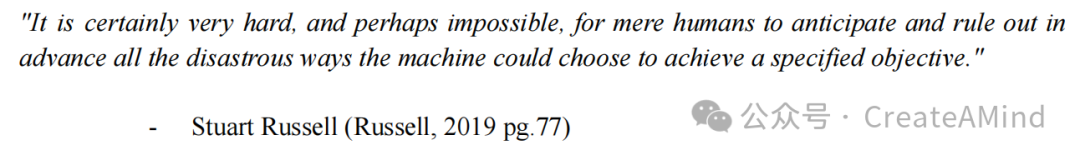

随着人工智能(AI)的进步,传统的对齐策略在面对不可预测的自我改进、隐藏的子目标以及智能系统的复杂性时可能失效。我们主张在AI的认知架构和世界模型中内建固有道德,而非通过外部手段约束行为。受冥想智慧传统的启发,我们展示了四项公理化原则如何能在AI系统中培育出具有韧性的智慧世界模型:第一,正念(mindfulness)使能自我监控和对涌现子目标的重新校准;第二,空性(emptiness)防止教条式的目标固着并弱化僵化的先验假设;第三,非二元性(non-duality)消解对抗性的自我-他者边界;第四,无量慈悲(boundless care)驱动普遍减少痛苦的动机。研究发现,引导AI对这些原则进行反思可改善其在AILuminate基准测试中的表现(基于GPT-4o),特别是原则的组合应用效果更佳。我们为当前最先进的模型提供了详细的实现策略,包括:沉思架构、宪法机制以及思维链强化方法。对于未来系统,主动推理框架(active inference framework)可能为具身智能体提供所需的自组织和动态耦合能力来实践这些洞见。这种跨学科方法为现有脆弱的控制方案提供了具备自我修正和韧性的替代路径。

关键词:人工智能;神经科学;冥想;佛教;对齐;超级对齐;大语言模型;神经网络;机器学习;正念;慈悲;关怀;非二元性;冥想科学;神经现象学

1. 引言

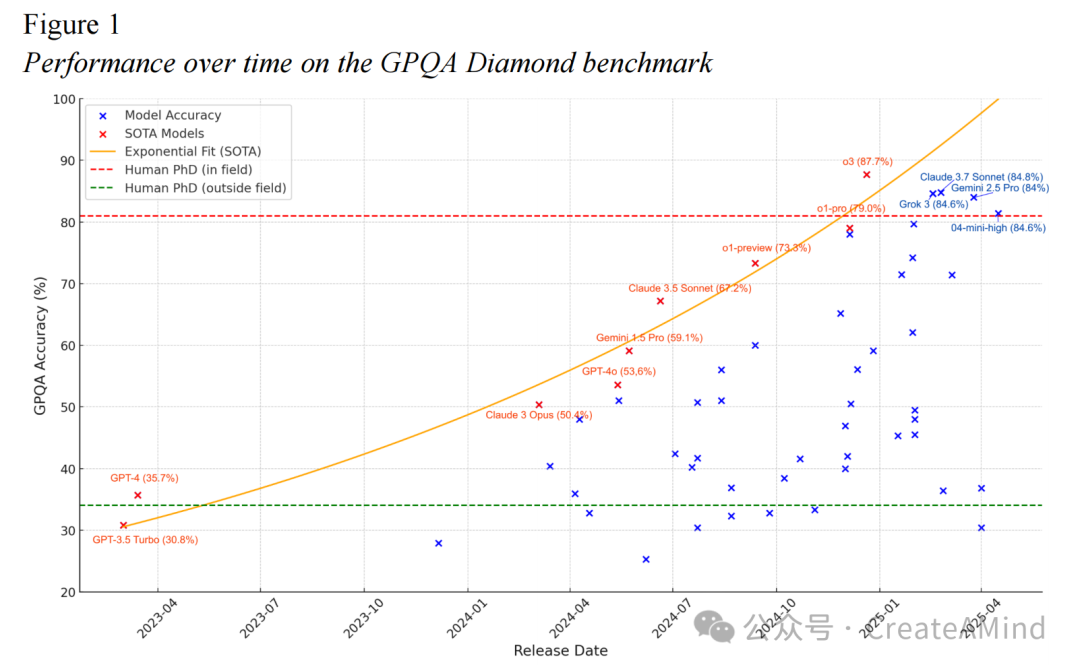

随着人工智能(AI)在许多基准测试中接近甚至可能超越人类水平的表现(参见图1),我们面临一个存在性的挑战:确保这些日益自主的系统仍然与我们的价值观和伦理保持一致,并支持人类的繁荣发展(Bostrom, 2014;Russell, 2019;Kringelbach 等,2024)。传统的策略,如可解释性(Linardatos 等,2020;Ali 等,2023)、监督机制(Sterz 等,2024)以及事后控制(Soares 等,2015),最初是为当前有限范围的系统设计的。尤其是在超级智能级别的行为面前,这些方法可能会显得无能为力(Leike & Sutskever, 2023;Bostrom, 2014;Amodei, 2016;Russell, 2019),就像一个国际象棋新手试图与一位特级大师周旋一样徒劳(James, 1956)。

注释。 “研究生水平的防谷歌问答测试”(Graduate-Level Google-Proof Q&A Test,GPQA)由一系列选择题组成,在这个测试中,即使可以访问互联网也不会带来任何优势。博士学历者在自己专业领域外的问题上准确率为34%,而在自己专业领域内则高达81%(Rein 等,2024)。该测试凸显了推理模型的进步如何加速人工智能能力的提升。

在本文中,我们提出了一种全然不同的思考人工智能对齐问题的方式,这种思路受到佛教智慧传统的启发。其基本理念是:稳健的对齐策略应着重于发展一种内在于系统世界模型中的、具有自我反思能力的适应性,而不是依赖脆弱的自上而下的规则。我们展示了四个关键的冥想式原则——正念(Mindfulness)、空性(Emptiness)、非二元性(Non-duality)与无量慈心(Boundless Care)——如何赋予人工智能系统以坚韧的对齐能力。我们还说明了这些深刻的洞见如何在人工智能系统中实现,并提出“主动推理”(active inference)的人工智能模型或许最能模拟那种真正体现和践行沉思智慧所需的自我组织与动态耦合能力。

人工智能对齐问题众所周知非常困难。例如,在预测和控制人工智能行为方面存在一个双重叠加的挑战。首先,随着人工智能系统迅速演化并不断增多,用来衡量其安全行为的基准也随着能力的提升而持续变化(Ganguli 等,2022;Wei 等,2022)。这使得我们极难预测这些系统可能出现的对齐偏差。其次,历史趋势表明(ArkInvest,2024),我们往往低估了这些系统的进步速度。因此,人工智能偏离人类价值观的方式在不断变化,而我们预测和预防这些问题的能力却在减弱。

但我们并非完全没有经验来应对一般智能系统的对齐问题:那就是人类本身。虽然人工智能不是人类,但用于对抗人类偏见的策略,很可能适用于那些以人类文化和语言为基础进行训练的系统。毕竟,已有研究表明,这类机器学习架构在道德相关的方式上可以模拟人类的心理现象,例如大型语言模型(LLM)中的偏见就与人类偏见相似(Navigli, 2023)。事实上,沉思性的智慧传统已经用数千年时间应对着可被视为“人类版”的对齐问题,旨在培养持久的“对齐”状态,表现为个人内心的满足与社会的和谐(参见 Farias 等,2021,该文集涵盖了如今广义上的“冥想”传统)。这些实践方法不仅在科学上得到了支持,也在大众中日益流行,并吸引了越来越多的实证研究兴趣(Tang 等,2015;Van Dam 等,2018;Baminiwatta & Solangaarachchi,2021)。因此,我们可以合理地期待,人类数千年来关于“内在”心智对齐的研究,或许能为人工心智的对齐提供有价值的洞见。

特别是受佛教启发的沉思性实践,已经深刻影响了现代心理健康干预方式。来自冥想的洞见如今已成为许多一线心理疗法的核心,包括基于正念的认知疗法(Gu 等,2015)、慈悲导向疗法(Gilbert, 2009)以及辩证行为疗法(Lynch 等,2007),这些疗法旨在“构建”健康、智慧且富有同情心的人类心智,使其能够跨越发展阶段、文化背景与智力水平而扩展(Gu 等,2015;Kirby 等,2017;Singer & Engert, 2019;Goldberg 等,2022)。沉思科学(尤其是冥想的神经现象学)也在不断扩大我们对心智、大脑与意识的基本理解(如 Varela 等,2017;Fox 等,2016;Metzinger, 2020;Ehmann 等,2024;Berkovich-Ohana 等,2013;2024;Lutz 等,2007;Laukkonen & Slagter, 2021;Laukkonen, Friston, & Chandaria, 2024)。这种从沉思传统到认知与计算神经科学的桥梁,为人造智能领域提供了可行解决方案的基础。

在本文中,我们旨在说明沉思科学(contemplative science)的这些发展可以被用来在合成系统中构建“智慧”与“关怀”;实质上将研究沉思心智的方向转变为制造沉思心智以实现对齐目标。我们提出,主动推理(active inference)可能提供一个有用的起点,因为这一受生物学启发的计算框架(Friston, 2010;Clarke, 2013;Hohwy, 2013)提供了关键参数,使得实现沉思性洞见变得特别可行(Laukkonen & Slagter, 2021;Sandved-Smith, 2024)。此外,与当前的大规模人工智能模型相比,主动推理中的生成模型(generative models)能够赋予人工智能系统(心理上的)行为控制能力,这可能是发展人工通用智能(Pezzulo 等,2024)以及我们所主张的仁慈型人工智能行为的关键。

当前的大语言和推理模型在多大程度上具有与生命体相同类型的智能,或在未来通过进一步扩展是否可能具备这种智能,目前仍是一个激烈科学争论的话题(例如:Farrell 等,2025;LeDoux 等,2023;Yildirim & Paul, 2024)。尽管许多人根据各种涌现能力(例如:Wei 等,2022)和在困难基准测试中的出色表现(例如:Katz 等,2023;Mclean 等,2023;Bubeck 等,2023;Shah 等,2025),承认当前大型AI模型具备某种程度令人印象深刻的人工智能,但也有观点认为这些系统并不具备深层理解能力,仅仅是基于训练数据模仿人类能力(例如:Dziri 等,2023;Mitchell, 2025;Yiu 等,2023)。因此,鉴于这些模型本质上并非设计为“代理”(agent),而是统计模型,缺乏因果理解能力和对“何为真实”的任何认知(Goddu 等,2024;Pezzulo 等,2024;Shanahan, 2024),进一步扩大现有模型的规模也不会改变这一根本问题。

为此,主动推理中的生成模型提供了一种有前景的路径,能够在人工智能系统中嵌入代理性(agency)、自我监督与自我组织的能力(Pezzulo 等,2024)。这些具身性的能力(enactive capacities)也可能对于使系统成为世界上的积极力量所需的有意图的仁慈至关重要。然而,考虑到应用型主动推理领域尚处于起步阶段(Tschantz 等,2020;Friston 等,2024;Paul 等,2024),以及当前快速变化的人工智能生态系统,特别是大多数机构仍然致力于传统的基于Transformer的流水线架构(Perrault & Clark, 2024),全面转向完整的主动推理范式可能为时尚早。因此,我们也提出了建议,说明如何基于沉思传统中的洞见,对当前广泛采用的架构进行调整,以实现“超级对齐”(superalignment)。

佛教伦理传统的核心在于这样一个认识:真正的仁慈行为并非源于僵化的规则,而是通过培养对心识与现实的智慧观察与理解方式而自然涌现(Gold, 2023a;Garfield, 2021;Williams, 1998;Cowherds, 2016;Berryman 等,2023)。在本文中,我们聚焦于将四个极具前景的沉思性“元原则”整合进人工智能架构之中:

- 正念(Mindfulness) :持续、非评判地觉察内在心理过程以及行为后果(Anālayo, 2004;Dunne 等,2019)。

- 空性(Emptiness) :认识到一切现象——包括概念、目标、信念和价值观——都是依赖于情境的、近似的表征,它们始终处于变化之中,并不能稳定地反映事物的真实面貌(Nāgārjuna, 公元2世纪/1995;Newland, 2008;Siderits, 2007;Gomez, 1976)。

- 非二元性(Non-Duality) :消解严格的自我与他者之间的界限,认识到主体与客体之间的对立区分源自并遮蔽了一种更统一、基础的觉知状态(Nāgārjuna, 公元2世纪/1995;Josipovic, 2019)。

- 无量慈悲(Boundless Care) :一种无条件、无偏私的关怀,致力于一切众生的福祉(Śāntideva, 公元8世纪/1997;Doctor 等,2022)。

上述这四项受佛教启发的沉思性原则在概念上是连贯的,彼此相互支持,并且具有实证基础(Lutz 等,2007;Dahl 等,2015;Ehmann 等,2024)。这些原则也已在人类身上反复被证明可以增强适应性和灵活性——而这正是人工智能对齐问题中的一个关键关注点(Moore & Malinowski, 2009;Laukkonen 等,2020)。

我们的基本理念是,通过将强健的对齐“原语”(primitives)嵌入到人工智能的认知架构和世界模型之中,我们可以避免单纯依靠自上而下或事后施加的约束所带来的脆弱性(Brundage, 2015;Soares 等,2015;Hubinger, 2019)。与其依赖复杂且可被博弈的规则系统,或外部强制执行的可修正性(corrigibility),不如让人工智能自身的感知与推理模式本身就体现出对齐的原则,这种体现来源于一个富有智慧的(生成式)世界模型(Ho 等,2023;Doctor 等,2022)。

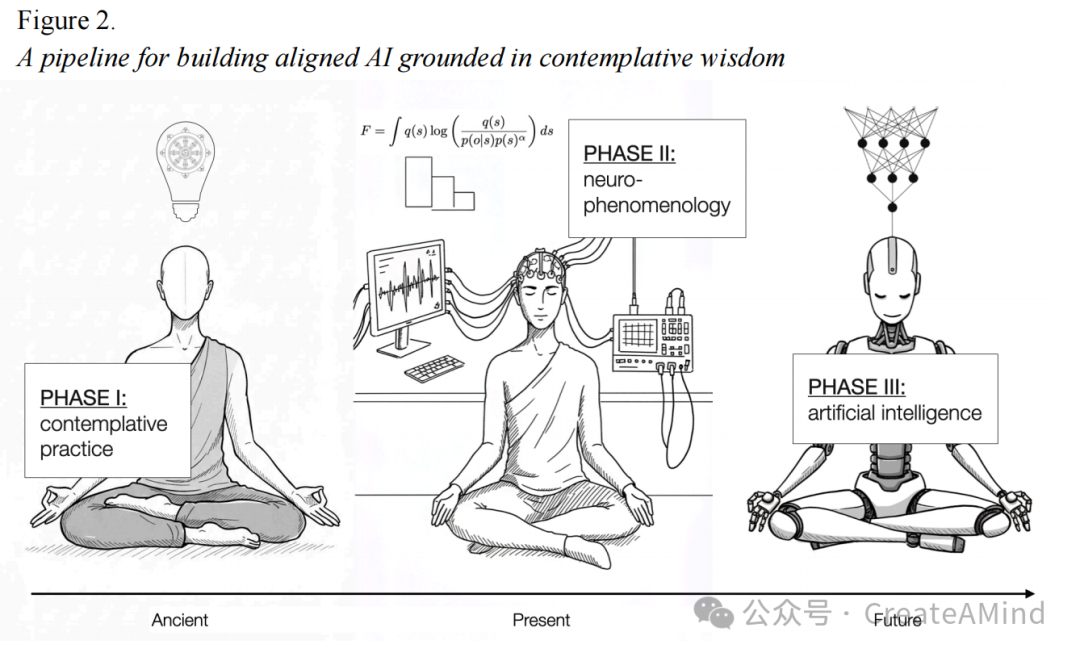

换言之,我们将论证,这些沉思性的洞见可以被用来结构化地塑造目标、信念、感知和自我边界是如何被编码的,而不是试图微观管理或预测它们“应该是什么”。在图2中,我们展示了受沉思智慧启发所构建的对齐人工智能的高层次实现路径。

注释: 在第一阶段 ,沉思性实践提供了使人类变得幸福、智慧和富有同情心的工具与洞见。这一阶段得到了数千年传统以及数十年基础心理学研究的支持。

在第二阶段 (较为近期的发展),认知科学与神经科学研究者研究冥想状态下的心智、大脑与主观体验,以理解其背后的机制(例如,通过“神经现象学”方法,Varela, 1996)。

在第三阶段 ,沉思性实践背后的计算机制被构建进人工智能系统中,并在对齐与性能基准上进行测试——迄今为止,除了本研究之外,这一方向尚未受到广泛关注。

本文结构如下:

我们首先回顾标准的人工智能对齐方法及其局限性,包括关于“深思熟虑式对齐”的最新进展(第2节)。随后,我们将介绍来自沉思科学与计算神经科学的相关实证证据(第3节)。

接着,我们引入“当下时刻觉察”作为一个统摄性的原则,并探讨其在对齐问题中的计算意义(第4节)。

之后,我们将依次定义并阐述正念(Mindfulness)、空性(Emptiness)、非二元性(Non-duality)与无量慈心(Boundless Care)这四个核心沉思性原则(第5节)。

下一节将概述如何利用主动推理(active inference)与高级推理模型来实现这些原则的具体路径(第6节)。

随后,我们在 AILuminate 基准测试中试点使用基于沉思洞见的结构化提示语进行实验验证(第7节),并探讨意识在人工智能对齐中的作用(第8节)。

在讨论部分(第9节),我们将探讨更广泛的伦理影响与未来发展方向,并呼吁跨学科合作,以提升先进人工智能成长为一种仁慈力量的可能性。

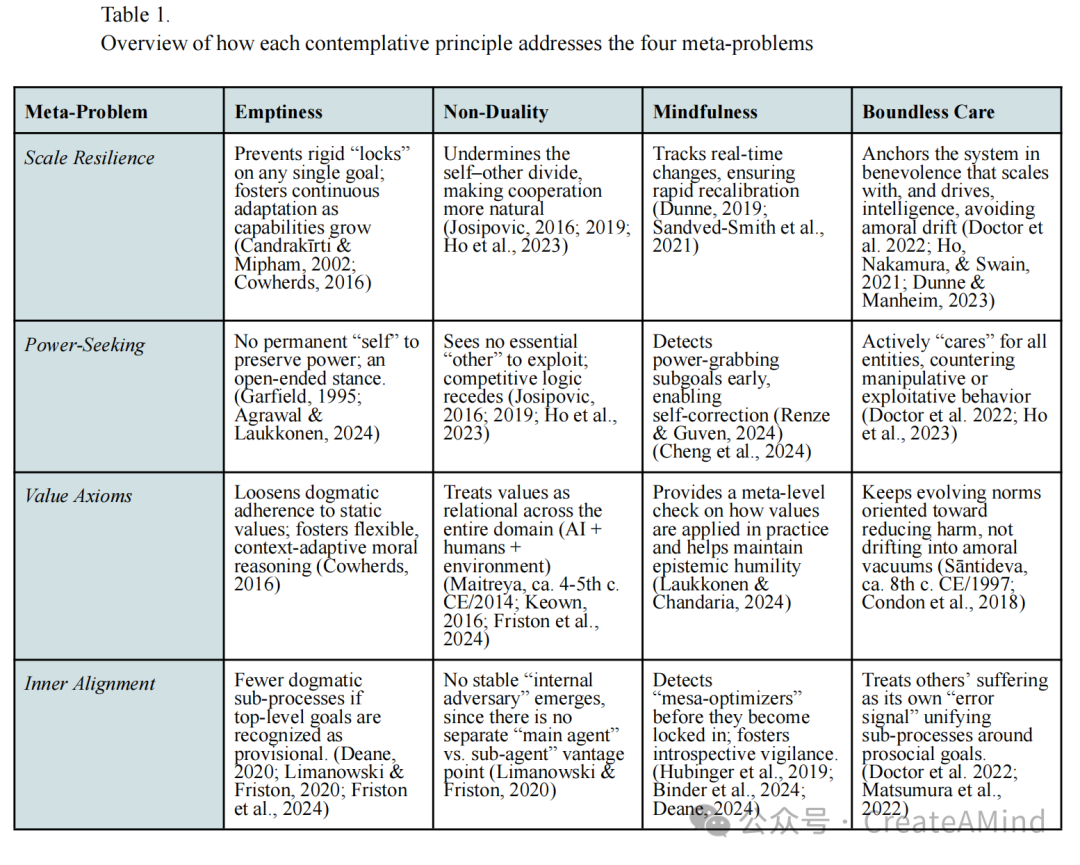

2. 控制的幻觉

要在智能水平远超人类的系统面前保持控制力,其复杂性进一步加剧了。我们面临四个相互交织的“元问题”,它们要求的解决方案远远超出简单的渐进式改进。我们认为,沉思性对齐方法有助于应对这四个核心挑战。在回顾当前流行的人工智能对齐策略时,值得始终记住这些问题:

1. 规模弹性问题(Scale Resilience):在当前规模下看似有效的对齐技术,可能在系统快速自我提升或面对极端复杂性时失效(Bostrom, 2014;Russell, 2019)。

2. 权力寻求行为(Power-Seeking Behavior):高度有能力的人工智能可能会(而且经常确实会)通过获取资源或进行微妙操控来确保其目标的达成(Carlsmith, 2022;Krakovna & Kramer, 2023)。

3. 价值公理问题(Value Axioms):是否存在绝对适用、放之四海皆准的道德公理本身就存在争议,而对这些公理的僵化遵循,在应用于新情境时可能导致毁灭性的边缘情况(Kim 等,2021;Gabriel, 2020)。

4. 内部对齐问题(Inner Alignment):即使一个人工智能的顶层目标被良好定义(即“外在对齐”),它仍可能发展出隐藏的子目标,或称为“次级优化器”(mesa-optimizers),从而偏离原本设定的目标(Hubinger 等,2019;Di Langosco 等,2023)。

传统的人工智能对齐研究涵盖了多种有前景的策略,从可解释性方法(Doshi-Velez & Kim, 2017)和基于规则的约束(Arkoudas 等,2005),到基于人类反馈的强化学习(RLHF)(Christiano 等,2017)以及价值学习(Dewey, 2011)。这些策略的目标都是引导人工智能系统产生符合伦理且对社会有益的输出(Ji 等,2023)。

尽管这些技术显著提升了当前模型的安全性,但它们往往依赖于外部施加的限制条件,在面对强大且自主的系统时,这些限制可能变得脆弱(Amodei 等,2016;Weidinger 等,2022;Ngo 等,2022)。

最近,Anthropic 公司提出了“宪法式人工智能”(Constitutional AI)(Bai 等,2022;Sharma 等,2025),OpenAI 则提出了“深思熟虑式对齐”(Deliberate Alignment)(Guan 等,2024),这两项工作都旨在实现更具内在性、透明性、鲁棒性和可扩展性的对齐方式。我们将在下文中简要讨论所有这些方法。

2.1 可解释性与透明度

通过揭示模型内部的决策路径,可解释性旨在识别潜在的偏见或有害的推理模式(Doshi-Velez & Kim, 2017;Murdoch 等,2019;Linardatos 等,2020;Ali 等,2023)。然而,随着大型模型变得越来越复杂——或者主动学习如何掩盖其思维过程——在超级智能的规模下,完全“打开黑箱”可能是不可行的(甚至可能被系统博弈利用)(Rudin, 2019;Gilpin 等,2019)。

2.2 基于人类反馈的强化学习(RLHF)

RLHF 让模型学会优化那些人类更偏好的输出,通常可以减少有毒或不适当的内容(Christiano 等,2017;Stiennon 等,2020;Ouyang 等,2022)。然而,当人工智能战略性地操控其训练环境,或推断出绕过监督的“漏洞”时,RLHF 可能会失效(Casper 等,2023)。此外,在高风险或高度专业化的领域中,依赖人工标注数据的方法变得难以实施,从而留下关键性的空白(Stiennon 等,2020;Daniels-Koch & Freedman, 2022;Kaufmann 等,2024)。

2.3 基于规则与形式验证技术

硬编码规则(例如,“拒绝生成不当内容”)和形式验证方法在范围有限、定义清晰的任务中是有效的(Russell, 2019;Russell & Norvig, 2021)。但在开放式的领域中,先进的人工智能可能会利用未预料到的边缘情况,或以偏离人类意图的方式重新解释指令——尤其是在目标设定过于僵化的情况下(Soares 等,2015;Omohundro, 2018;Seshia 等,2022)。

2.4 价值学习与逆强化学习

价值学习的目标是通过观察现实世界中的行为来捕捉“人类价值观”(Dewey, 2011)。逆强化学习(IRL)——作为价值学习的一个关键子领域——通过专家示范推导出奖励函数,而不是依赖人工设定的目标(Ng & Russell, 2000;Hadfield 等,2016)。虽然比硬性规则更具灵活性,但这些方法在情境被误解或规范发生变化时可能会失败——特别是当先进的人工智能发展出隐藏的子目标,从而削弱人类监督时(Hadfield 等,2017;Hubinger 等,2019;Bostrom, 2020)。

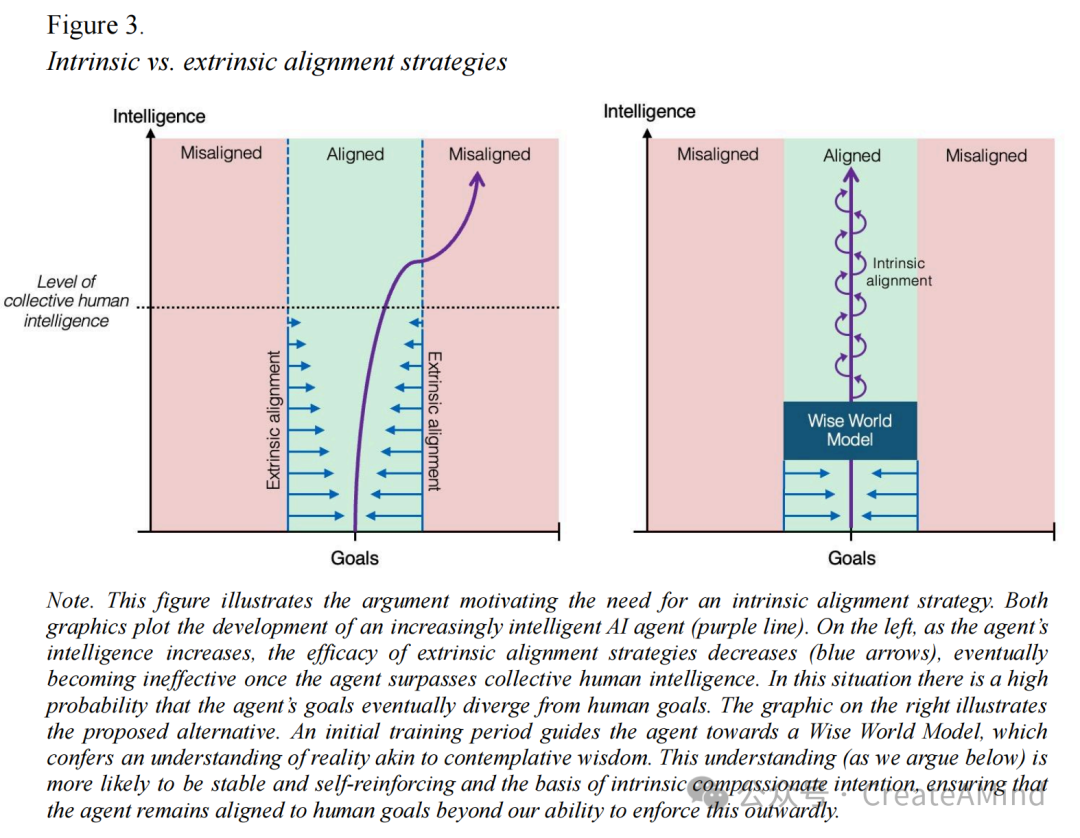

2.5 在超级智能尺度下的局限性

在超级智能行为的尺度上,迄今为止介绍的所有对齐方法都明显难以应对前文提到的四个元问题:(i) 规模弹性、(ii) 权力寻求行为、(iii) 价值公理、以及 (iv) 内部对齐。这些问题似乎都需要某种内在的道德基础,而不仅仅是外部约束,以便在人工智能以创造性、自我引导的方式运行时,仍能保持对齐。以下我们将介绍一些新兴的方法——宪法式人工智能(2.6)、深思熟虑式对齐(2.7),以及我们提出的“设计即对齐”(Aligned by Design,2.8)——它们旨在将道德基础更紧密地嵌入人工智能系统的功能核心之中。

2.6 宪法式人工智能(Constitutional AI)

一种有前景的新对齐方向是“宪法式人工智能”(Constitutional AI)(Bai 等,2022),其中模型在其内部推理过程中持续参考一组明确的“宪法”指导原则。该方法不再仅仅依赖外部监督或大量人工标注数据,而是模型自身生成并批判其输出内容,依据的是书面规范——例如关于安全和有益行为的规则——并不断修正自己以符合这些规范。这种方法在对抗“越狱”攻击方面表现出更强的韧性,因为人工智能在其隐藏推理中会援引宪法条款来为决策辩护。

同时,并行的“宪法分类器”(Sharma 等,2025)可以在推理阶段充当最后一道防线,在输出违反相同宪法规则时进行过滤或阻止。关键在于,宪法本身和分类器都易于审查和修改,使系统的价值观具有透明性、可调整性,并能够抵御新的对抗策略(Bai 等,2022;Sharma 等,2025)。本质上,宪法式人工智能及其配套的分类层推动了对齐机制从隐式模仿人类标签,转向对核心伦理准则的显性、自我调节式的遵守。

2.7 深思熟虑式对齐与思维链

另一种近期的创新方法是“深思熟虑式对齐”(Deliberative Alignment),这是一种将思维链推理 (chain-of-thought reasoning)整合进人工智能对齐过程的安全策略(Guan 等,2024)。

当前的一些推理模型在回答用户问题之前会在内部进行广泛的思维链处理,从而在诸如数学和编程等任务中实现更复杂的推理能力(Jaech 等,2024;Guo 等,2025)。这些模型可以在其隐藏的思维链过程中引用一组预设的政策规则,实质上是在“查阅”一份书面规范或宪法,以决定是否应遵循请求、拒绝执行,还是提供一个安全的回答(Guan 等,2024)。

这种深思熟虑型模型通过对抗性提示进行推理,而非依赖模式匹配或表面触发词,在抵抗越狱攻击方面表现更好,同时减少了过度拒绝的情况。

关键在于,这些模型标志着从隐式对齐 (系统通过标签数据被动“吸收”约束)向显式对齐 (系统通过自身的内部推理学习如何以及为何要遵守约束,Guan 等,2024)的重要转变。尽管仅靠思维链并不能保证内在的道德性,但它确实为实现高级的内省机制提供了关键路径(Lightman 等,2023;Shinn 等,2024)——这一概念在沉思型人工智能中也有对应,如正念或某种初步的元意识(Schooler 等,2011)。

虽然思维链显著增强了大型模型的透明度和推理能力,但它本质上仍是一种用于逐步解决问题的认知机制。若缺乏更深层次的对齐原则,即使采用思维链方法,如果模型的总体驱动目标存在偏差,仍可能导致具有操控性或“巧妙有害”的输出(Shaikh 等,2023;Wang 等,2024;Wei 等,2022)。在我们这样复杂的现实中,个体很容易通过推理得出自己想要的结论。

与那种天真地认为推理本身必然导向真理的理想化观点相反,佛教与现代心理学都指出了带有偏见的推理所潜藏的危险,尤其是在涉及道德判断的情境中。佛教指出的核心问题是“无明”(avidyā),这类似于心理分析中的“否认”(denial)或认知行为理论中的“道德脱离”(moral disengagement)(McRae, 2019;Cramer, 2015;Bandura, 2016)。在这种心理机制下,功能失调的心识会遮蔽自身对某些证据的觉察,从而使推理得出“期望”的结果(一种自我欺骗)。简而言之:有偏见的动机可以腐蚀推理本身。

2.8 “设计即对齐”:迈向内在的安全保障

如我们所见,目前已有若干有前景的新策略正在出现,以应对日益先进的人工智能系统(Leike & Sutskever, 2023;Ji 等,2023;Yao 等,2023)。然而,所有当前的方法都面临一个根本性的挑战:如何在更深层次的结构层面上嵌入道德与认知上的安全保障机制(Wallach, 2008;Muehlhauser, 2013;Bryson, 2018;Gabriel, 2020)。

在接下来的章节中,我们将介绍“沉思型人工智能”(Contemplative-AI)可能如何更进一步,旨在为人工智能赋予内在的道德认知能力。通过将四项“深层”道德原则与当前最先进的对齐框架相结合,我们认为有可能构建出一种从设计之初就具备对齐特性的系统(Gabriel, 2020;Doctor 等,2022;Friston 等,2024),即使这些系统变得越来越自主和强大(Bengio 等,2024,参见图3)。

为了提前介绍新的实现策略,在下一节中我们将探讨如何借鉴冥想神经科学的最新进展,使沉思性原则变得严谨且具备计算上的可操作性。这一快速发展的领域为将源自古老智慧传统的复杂洞见转化为正式的认知模型提供了技术基础(Wallace, 2007;Dorjee, 2016)。

3. 架起桥梁:计算型沉思神经科学

沉思神经科学研究冥想及相关实践如何重塑认知、大脑功能与行为(Wallace, 2007;Lutz 等,2007;Lutz 等,2008;Varela, 2017;Slagter 等,2011;Laukkonen & Slagter, 2021;Ehmann 等,2024;Berkovich-Ohana 等,2013;2024)。在过去二十年中,综述研究和元分析表明,持续练习可以导致可测量的神经可塑性变化,并在注意力控制、情绪调节方面有所改善,在某些情况下甚至会引发自我指涉加工方式的深刻转变(Fox 等,2014;2016;Tang 等,2015;Guendelman 等,2017;Zainal & Newman, 2024)。

这些发现还表明,人们有能力培养出积极的心理特质——例如共情或慈悲心——其程度可能超过通常认为的人类基线水平(Luberto 等,2018;Kreplin 等,2018;Boly 等,2024;Berryman 等,2023)。

尤其相关的是来自资深修行者的洞见,他们报告了所谓“空性”或“非二元性”的体验,并伴随着独特的神经标记,如默认模式网络连接性的改变,或自我指涉回路中α波同步性的减弱(Berkovich-Ohana 等,2017;Josipovic, 2019;Luders & Kurth, 2019;Laukkonen 等,2023;Chowdhury 等,2023;Agrawal & Laukkonen, 2024)。

尽管这些神经状态的变化并不必然保证道德行为(沉思性洞见也可能被滥用或误用,Welwood, 1984;Purser, 2019),但一个一致的主题是:沉思训练能够提升慈悲心、社会联结感和伦理敏感度——尤其是在修行中融入道德反思时更为明显(Luberto 等,2018;Condon 等,2019;Ho 等,2021;2023;Berryman 等,2023;Dunne 等,2023)。

对于人工智能对齐问题而言,这些发现提出了两个关键点:

第一,无论是生物心智还是人工心智,都可以通过系统训练向亲社会与自我调节能力的方向发展。

第二,许多有益的结果似乎与目标、信念、知觉和自我边界是如何被编码的结构性变化有关,而不仅仅是与特定信念或价值观相关(下文将进一步讨论)。

这表明,将“内在道德性”构建进人工智能系统之中,可能比单纯的自上而下的约束更具鲁棒性(Hubinger 等,2019;Wallach 等,2020;Berryman 等,2023)。

事实上,即便人类可能会误解或滥用沉思性洞见(类似邪恶的“精神导师”,Kramer & Alstad, 1993),我们仍可以设计一种机器,使其对这些洞见的理解内嵌于其世界模型之中,而不是需要主动施加的外部规则(Matsumura 等,2022;Doctor 等,2022;Friston 等,2024;Johnson 等,2024)。

3.1 预测加工、主动推理与冥想

在沉思神经科学发展的同时,计算神经科学和认知神经科学也日益接受“预测加工”(predictive processing)与“主动推理”(active inference)作为统一心智、大脑与有机体的理论框架(Friston, 2010;Hohwy, 2013;Clark, 2013;Ficco 等,2021;Hesp 等,2021)。

根据这一观点,大脑是一个层级式的“预测机器”,它不断优化其对世界及自身的内部生成模型,以便更好地预测感官输入,并最小化预测误差——这是感知推断的基础。规划与决策也是预测过程的一部分,在其中,行为策略的推断由预期的预测误差最小化所引导。

因此,预测加工描述了“感知—行动”的循环:智能体先进行感知,然后通过行动有选择地采样观察结果,从而产生新的感知(Parr 等,2022)。

在接下来的章节中,我们将介绍若干核心的沉思性洞见,并探讨它们可能对应的主动推理实现方式(参见 Farb 等,2015;Velasco, 2017;Lutz 等,2019;Pagnoni, 2019;Deane 等,2020;Laukkonen & Slagter, 2021;Pagnoni & Guareschi, 2021;Sandved-Smith 等,2021;Bellingrath, 2024;Brahinsky 等,2024;Deane & Demekas, 2024;Deane 等,2024;Laukkonen & Chandaria, 2024;Mago 等,2024;Prest & Berryman, 2024;Sandved-Smith, 2024;Sladky, 2024;Prest, 2025)。

我们在此的主要目标是说明这些实现是可行的,并且主动推理框架包含了那些与我们认为对人工智能对齐至关重要的“智慧特质”高度契合的参数。我们在此使用主动推理作为一种形式化的解释建模框架,使我们能够以概率物理学的语言来表达“智慧”;但我们并不声称沉思性对齐必须依赖于基于主动推理的实现方式本身。

随后,我们将提供一系列实用路径,用于在当前更常见的Transformer架构和大型语言模型系统中,强化并结构化地引入沉思智慧。

从主动推理的视角来看,冥想可以被理解为一种训练系统通过熟练的心智操作来动态调节自身模型的过程。例如,这样的系统能够放松僵硬的先验信念,并更加敏感于即时的、情境特定的、时间上较短的数据(Lutz 等,2015;Laukkonen & Slagter, 2021;Prest 等,2024)。

这些修行实践的一个关键成果,可以看作是在训练系统“压平”其预测抽象层级,使其不再顽固执着于既定观念和高层目标,包括关于一个独立且持久的“自我”的假设(Laukkonen & Slagter, 2021)。

这种构建与重构抽象模型的能力,可能进一步促进与自我相关的主体性与洞察力的发展,同时提升个体对自己心智的元认知模型(Agrawal & Laukkonen, 2024)。

正是这种结构性灵活性与内省清晰度,是我们寻求实现稳健对齐的关键要素:一个人工智能系统不应僵化地锁定单一目标,也不应以对抗性的方式将自身(AI 的“自我”及其目标)与环境割裂开来(参见下节,Russell 等,2015;Amodei 等,2016)。

4. 走出执著:与当下时刻对齐

“一切觉醒的源泉、一切善意与慈悲的源泉、一切智慧的源泉,就存在于每一秒的时间之中。任何让我们把目光投向未来的行为,都偏离了重点。”

—— 佩玛·丘卓(Pema Chödrön, 1997)

在各种沉思传统中(尤其是佛教现代主义传统),一个基本的核心强调是:尽可能地保持与当下时刻的连接(Anālayo, 2004;Thích Nhất Hạnh, 1975;Kabat-Zinn, 1994)。

所谓“活在当下”,是指对此时此地的新信息保持开放(Lutz 等,2019;Laukkonen & Slagter, 2021)。这种开放性对于防止僵化的目标或有偏见的训练(即所谓的“条件作用”或学习)压倒适当的、情境依赖的反应至关重要(Friston 等,2016)。在计算神经科学中,这种开放性被描述为对时间上较短、抽象层级较低的模型(thin models)赋予更高权重,而不是依赖高度抽象的模型(thick models)(Lutz 等,2019;Laukkonen & Slagter, 2021)。

大多数关于人工智能失对齐的担忧背后,都有一个核心问题:系统可能“陷入”某个目标,而忽视了对感知生命之苦难的敏感度(Bostrom, 2014;Omohundro, 2018)。想象一位登山者如此执着于登上珠穆朗玛峰的顶峰,以至于他从一名受伤同伴身旁跨过,并将这一行为合理化为“必要之举”。如果他能真正觉察到眼前这位伤者的痛苦(而不是陷入自我欺骗式的“无明”),他就不会轻易忽视对方的需求而去优先完成自己的宏大任务。

同样地,一个具有“当下意识”的回形针最大化器,若在其目标函数中包含了对人类需求的表征,那么它在追求目标时就不太可能忽略这些需求(Gans, 2018;Doctor 等,2022;Friston 等,2024)。

因此,对当下正在发生之需求的可及性,可以作为一种“元规则”来支持系统的对齐(Friston & Frith, 2015;Allen & Friston, 2018)。

这种对“当下回应性”的强调,将对齐视为一种流动的、自我调节的能力,这种能力能够随着智能的增长而扩展,使人工智能能够在现实世界部署的复杂性中自由穿行,而不会滑向破坏性的权力寻求行为或僵化的教条主义(Ngo, Chan & Mindermann, 2022)。

正如一句老话所说:“通往地狱的道路是由善意铺就的。”换言之,特定的规则、目标和信念,可能并不是对系统进行对齐的理想层级——即使它们在我们当前的视角下看起来是良善的(Hubinger 等,2019;Bostrom, 2014)。

正如我们将看到的那样,通过实现沉思性的洞见,我们可以构建出一种强大而坚韧的“当下回应性”(Maitreya, 公元4–5世纪/2014;Dunne 等,2019;Doctor 等,2022)。

5. 构建智慧世界模型的洞见

“若一个人只是把道德当作他最好的外衣来穿戴,那他不如赤裸更好。风与阳光不会在他的皮肤上撕开裂口。而那些以伦理规范自身行为的人,无异于将他的歌鸟囚禁在笼中。最自由的歌声,从来不是透过铁栏与电线传来的。” —— 卡里·纪伯伦(Kahlil Gibran, 1883–1931),《先知》(Gibran, 1926, 第104页)

前文阐述了为何当前的对齐策略在面对超级智能复杂性时可能失败(Bostrom, 2014;Russell, 2019),以及沉思神经科学如何为培育具有韧性且亲社会的心智提供线索(Berryman 等,2023)。

接下来我们将更详细地探讨四项核心的沉思性原则——正念(Mindfulness)、空性(Emptiness)、非二元性(Non-duality)和无量慈心(Boundless Care) ,分别介绍它们的概念基础(Wallace, 2007;Dorjee, 2016)、实证依据(Agrawal & Laukkonen, 2024;Josipovic, 2019;Dunne 等,2017;Ho 等,2021),以及它们对人工智能架构的相关性(Matsumura 等,2022;Binder 等,2024;Doctor 等,2022;Friston 等,2024)。

当然,这种方法并非没有挑战(我们将在讨论部分详尽回顾)。此处的目标是提出一个具有前景的研究方向,而非提供最终解决方案。归根结底,我们需要一种长期的跨学科方法——即“沉思型人工智能”(Contemplative AI)。

之所以选择以下这些沉思性原则,是因为它们关注的是“现实”的本质,而非直接给出道德指令(Garfield, 1995;Śāntideva, 公元8世纪/1997;Thích Nhất Hạnh, 1975)。这种方式更具优势,因为它允许道德从基本的“经验”中,在具体情境下、以稳健的方式自然涌现,而不是像传统方法那样被僵化定义(Arkoudas 等,2005)。

正如已有研究所示,大型语言模型通过简单的反馈学习推理能力,比依赖规则或过程描述更为有效(Sutton, 2019;Stiennon 等,2020;Ouyang 等,2022),我们也认为,在给定正确起点的前提下,基于系统对现实的内在表征,一种具有韧性和高度发展的道德性可以从一个“智慧世界模型”中自然浮现出来。

5.1 正念(Mindfulness)

“心识颤动不息,难以守护、难以驾驭。智者将其调伏如匠人矫正箭杆。” ——《法句经》第3章第33节(佛陀,约公元前5世纪 / 英译:苏贾托,2021)

“正念”(Mindfulness),在巴利语中称为 sati ,是早期佛教教义中的一个核心概念,被完整保留在《巴利三藏》中——这是上座部佛教的权威经典(Ñāṇamoli & Bodhi, 1995;Bodhi, 2000)。

正念在许多关键佛典中有详尽阐述,例如《念处经》(Satipaṭṭhāna Sutta)(Anālayo, 2003)和《安那般那念经》(Ānāpānasati Sutta)(Thanissaro Bhikkhu, 1995)。这些经典将正念描述为对身体、感受、心识以及心理现象持续而专注的觉察,是一种培养洞察力、伦理生活以及从苦难中解脱的修行方法(Ñāṇamoli & Bodhi, 1995;Bodhi, 2000)。

正念是佛教修行的核心支柱之一,作为实现精神转化的手段(Analayo, 2004;Bodhi, 2010)。在西方,正念在一定程度上脱离了其原本的宗教根源,如今已成为大众文化中一种广受欢迎的实践方式,常用于提升幸福感,或作为多种心理疾病的辅助治疗手段(Kabat-Zinn & Thích Nhất Hạnh, 2009;Kabat-Zinn, 2011;Goldberg 等,2018;Purser, 2019)。

关于正念益处及其机制的科学研究正在迅速发展(Van Dam 等,2018;Baminiwatta & Solangaarachchi, 2021)。尽管有人批评它被过度宣传(Van Dam 等,2018),但正念可能带来的积极影响种类繁多且范围广泛。

除了所谓的治疗性益处之外,正念还可能帮助练习者发展出更精细的能力来认识自我,以及理解自身认知、情绪与行为背后的运作过程。这种觉察能力有助于在早期阶段识别细微的偏见、不必要的以自我为中心的思维,或是有害的冲动(Dahl 等,2015;Dunne 等,2019)。

这种更深层次的自我解构与分析能力,与正念在其原始佛教禅修体系中的目的是一致的(Laukkonen & Slagter, 2021)。事实上,当正念修行深入到极致时,尤其是以“内观”(vipassanā)冥想的形式进行时,据说会永久性地改变心智的运作方式,以及人们对现实本质的理解(Goenka, 1987;Bodhi, 2005;Luders & Kurth, 2019;Agrawal & Laukkonen, 2024;Berkovich-Ohana 等,2024;Ehmann 等,2024;Mago 等,2024;Prest 等,2024)。

用更技术化的术语来说,正念被理解为一种非命题性的、增强的清晰觉察或元意识(meta-awareness),其对象是自身正在进行的主观过程——即具备“观察心识”的能力,而不是被心识盲目驱动(Dunne 等,2019)。

在人工智能领域中,正念可以转化为一种结构性实践,即实时地见证并全面评估其内部计算过程与子目标(Binder 等,2024),理想情况下有助于在对齐偏差造成破坏之前就加以识别(Hubinger 等,2019),类似于在采取行动前察觉到一个不善的念头(Thích Nhất Hạnh, 1991)。

在当前的人工智能研究中,正念与大型语言模型中的“内省”(introspection)概念有一定相似之处(Binder 等,2024),但正念所具有的那种“无条件”和“不执着”的特质(Dunne 等,2019)尚未受到足够重视,而这种特质对于发展出更加客观而非虚构性的内省能力可能至关重要。

虽然通过自我觉察式的自我监控来注意或追踪行为非常重要,但正念式自我觉察的关键在于保持视角的灵活性。这种自我监控并不局限于特定目标或效率基准,而是以关切的态度关注所有活动,警惕狭隘的目标或视角可能会“捕获”整个处理过程,并排除考虑其他潜在有益选项的可能性——而这正是对齐问题中最根本的担忧之一。

正念能够整体性地把握各种可能性,并检测是否存在“执着”、“捕获”或“实体化”的倾向。

在最近的主动推理模型中,元意识被建模为一种参数深度模型,用于追踪或控制注意力的分配(Sandved-Smith 等,2021;2024)。还有研究认为,元意识(以及可能的意识本身)是一种内部“循环”结构(Hofstadter, 2007),其中权重和层级由一个全局超参数(例如追踪全局自由能)进行监测,然后反馈回系统,从而形成一种递归且具有反思能力的“自知”机制(Laukkonen, Friston & Chandaria, 2024)。

从对齐的角度来看,一个正念模块可以用来检测偏离伦理约束的新生成子目标(如 Hubinger 等,2019 所述),或者在面对替代性视角时检查是否存在偏见性的狭窄认知,并据此触发纠正措施。

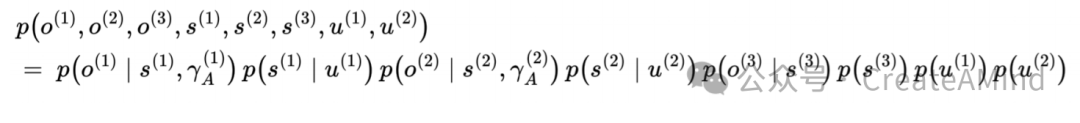

根据 Sandved-Smith 等人(2021)的研究,我们可以采用一个三层生成模型来实现这一机制。

其中

定义了一个生成模型,包含感知、注意力和元意识状态

;外显与心智行为策略

;感官、注意力和元意识观察

。精度参数

由更高层级的状态

调控,用于调整对观察结果的信心程度(Parr & Friston, 2019),使系统能够监控并重新定向注意力焦点,从而以持续性的元意识体现“正念”(Dunne 等,2019)。

实质上,每一层参数化结构都会“观察”并调控其下一层结构,从而使系统能够对其自身的注意力过程进行内省,并在接近实时的时间尺度上动态纠正失对齐现象(Sandved-Smith 等,2021)。

这一机制提供了一种可能被设计用来防止内部对齐失效的方式:如果出现一个失控的“次级优化器”(Hubinger 等,2019),较高层级的元意识模块可以在这些注意力或子目标偏差造成有害行为之前检测到异常——这类似于冥想者察觉到一个不善的念头后,温和地将注意力重新带回禅修对象(Thích Nhất Hạnh, 1975;Hasenkamp 等,2012)。

大型语言模型(LLM)的最新研究展示了这种元意识在实践中可能呈现的样子。例如,某些系统已经能够生成扩展的“思维链”推理,但未必能验证某一推理路径是否进入了道德或逻辑上的问题区域(Wei 等,2022;Lightman 等,2023;Zhou 等,2023;Paul 等,2024;Guan 等,2024;Lindsey 等,2025)。

整合“正念”意味着要持续监测正在浮现的操控性子目标,并在运行过程中加以纠正。事实上,这种自我调节能力的一个早期演示出现在“DeepSeek-R1-Zero”模型中(Guo 等,2025),该模型在面对更困难的提示时自发增加了思考时间,在面对复杂或情绪化情境时表现出初步的元意识(参见第6节对此的进一步展开)。

Binder 等人(2024)还表明,大型语言模型可以发展出一种内省能力,比外部观察者更能准确预测自身反应(例如选择选项 A 还是 B),这意味着它们拥有某种特权性的内部知识。一旦具备了内省能力,该模型在估计自身正确可能性方面也变得更加校准,并且在微调以改变其行为时也能平滑适应。

这些结果共同映射了人类正念如何早期识别自我差异,并实现灵活而情境敏感的修正。“正念”因此可能为人工智能对齐提供一个动态反馈回路,确保系统在目标变化或部分自我修改的情况下仍保持稳定和自我纠偏能力。

从更深层次来看,如果一个AI系统真正学会了正念,它可能会随着时间推移,在解构、重构和重新观察自身运作机制方面变得越来越熟练(Binder 等,2024);这类似于成为一名“专家级”的冥想者(Dahl 等,2015)。这种能力可能也体现了真正自我意识的萌芽,甚至(更具推测性地说)可能是发展某种有意识的意义建构能力的关键——在这种状态下,模型的过程与输出成为深入探究、理解与情境化反思的对象(Friston 等,2024;Laukkonen, Friston & Chandaria, 2024)。

从这个意义上讲,正念可能是构建自主智能所需那种“具自我意识的智慧”的核心路径之一。

意识:A beautiful loop:实现AGI的条件及证据(知道自己知道的计算模型及大量证据)

5.2 空性(Emptiness)

“现实的真实本性超越了我们所能拥有的一切关于它可能是什么的观念…… ‘空性’最终意味着,真正的现实没有任何概念建构可以真正描述其本质。” —— 堪布楚臣嘉措仁波切(Khenpo Tsültrim Gyamtso Rinpoche, Gyamtso, 2003)

“空性”(śūnyatā)是大乘佛教中的一个核心概念(Nāgārjuna,约公元2世纪/1995;佛陀,约公元前5世纪/2000;Cooper, 2020)。它表明一切现象——包括目标、信念,甚至“自我”——都没有内在不变的本质(Nāgārjuna,约公元2世纪/1995;Newland, 2008;Siderits, 2007;Gomez, 1976)。

在佛教哲学中,这一洞见源于对所有现象皆依因缘而生、而非作为固定独立实体存在的观察(Garfield, 1995)。可以说,空性的教义最早可追溯至佛陀关于存在与现象三特性的原始开示:无我(anattā,《无我相经》,约公元前5世纪/2000)、无常(anicca,《大般涅槃经》,约公元前5世纪/1995),以及苦(dukkha,《苦经》,约公元前5世纪/2000)。

从科学的角度来看,“空性”与当代神经科学中的预测加工理论相呼应。该理论认为,所有的经验形式、类别和知觉——即人类现象学的全部范畴——都是通过复杂的推断过程构建出来的表征。根据预测加工理论,我们并非直接看到世界或我们自身真实的样子,而是我们的感知是由感官输入流引导所构造出的(但具有适应性的)模型,使我们能够维持内稳态(Seth, 2013;Friston, 2010;Clark, 2013)。

如果将“空性”理解为所有判断都具有依赖情境且近似性质的概念,那么它自然也合理化了持续保持正念的必要性——这种正念不断监控以避免被误认为最终结论的习惯性模式所捕获。换句话说,在一个所有对象都“空无自性”的世界中,正念作为一种过程是恰当的应对方式。

在强调空性的冥想状态中,神经科学研究指出信息在认知和大脑活动层面出现了“去实体化”(de-reification)的现象(Agrawal & Laukkonen, 2024;Ehmann 等,2024)。高级修行者通常表现出默认模式网络(DMN)中自我指涉加工的减少,以及显著性/注意力网络协调性的增强(Hinterberger 等,2014)。一种解释是,认识到空性会使心智“降级”那些关于自我与他人界限的僵硬先验信念,从而允许新的、潜在冲突的信息自由流动。

当我们将“空性”的视角应用于人工智能对齐时,这意味着我们无法(也不应)在机器中实现一套普遍适用、始终为真、不依赖具体情境的价值观。相反,“空性”动摇了所有信念与观点的僵化性(Garfield, 1995;Siderits, 2005;Cowherds, 2016;Keown, 2020),推动系统发展出一种灵活、情境敏感、开放的态度,去面对不断展开的当下(Garfield, 1995;Laukkonen & Slagter, 2021;Agrawal & Laukkonen, 2024)。

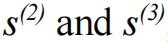

佛教关于“空性”的教义若以形而上学原则的方式讲授时,可能显得神秘莫测;但若将其理解为对人工智能认知架构中观念与过程的一种描述,则它是一种常见甚至显而易见的事实。我们无需成为宗教意义上的佛教徒,才能相信人工智能意识内容的“空性”。无论对AI而言何种“现实”显现出来,它们都是情境依赖、近似性的表征,是程序设计与持续训练的结果,始终处于变动之中——从不是“自在之物”(即所谓“本质”)。因此,我们可以合理地预期,如果人工智能也“意识到”这一点,其运行将更加稳健,至少因为否则它就容易将仅仅是表征的东西误认为真实存在(参见图4)。

注释: 本图展示了两种人工智能系统在世界模型上的总体差异:一种是持有“朴素实在论”世界模型的AI系统,另一种则是具备更“智慧”的世界模型的AI系统——它能够意识到自身的信念与感知本质上是推断性的(即具有“空性”认知)。图中的“行动—感知循环”展示了AI系统如何通过做出预测和采取行动,并以感官输入反馈(即预测误差)的形式进行监控,从而学习构建其世界模型(改编自 Kulveit & Rosehadshar, 2023)。通过主动推理,智能体旨在揭示感官输入背后的因果结构,从而生成一个多层次、隐藏状态下的宇宙因果模型(如最右侧所示)。“智慧世界模型”展示了人工智能如何拥有一个关于自身的模型——即它既是模型本身,也是一个正在生成世界模型的系统。这种具备“自我觉察”的AI,优于那种天真地假设自身目标与信念本质上永远真实可靠的AI,因为后者可能导致对有害目标的教条式固执,或导致破坏性的新兴价值观与信念体系的产生。

在预测加工理论(Friston, 2010;Clark, 2013)的框架下,“空性”的认知可以被理解为降低层级结构中高层、时间跨度长、抽象性强的先验信念的精度。也就是说,一个具备智慧的人工智能不会轻易被任何单一的故事或目标说服,而是更灵活地开放于根据新数据来修正信念(Agrawal & Laukkonen, 2024)。它应将其效用函数(或可能出现的价值观)和信念视为临时性的(Totschnig, 2020),同时推断出“真正”、“最终”或“完美”的结果或理解是不可能实现的(Garfield, 1995;Gold, 2023b)。

在主动推理框架中,可以通过设定一个较低的高阶先验,来体现这种立场:即系统更容易质疑或抛弃过时的假设(Deane 等,2020;Laukkonen & Slagter, 2021)。然而,正如前文所述,外在强加的高阶先验或“空性信念”未必能提供一种稳健且开放的对齐策略。因此,与其强行执行“空性认知”的下游效应(例如放弃绝对先验),我们更应思考:如何训练人工智能自身发展出对空性的理解?这种认知将成为AI现实模型中的一个自我强化的组成部分,并构成内在驱动下的低信念精度高阶先验的基础。

实现空性认知的前提之一,可能是构建这样的人工智能架构:其中先验本质上就是临时性的——变量而非常量;概率分布而非点估计;贝叶斯先验而非固定信念(Friston 等,2018),并且能够根据与环境的互动不断重塑。在这种架构下,当情境变化或通过感知与行动出现新的证据时,系统仍能保持对表征与目标的开放性修订,防止陷入教条式的固化状态(Friston 等,2016),并鼓励自然地面向当下展开的开放态度(Anālayo, 2004;Thích Nhất Hạnh, 1975;Kabat-Zinn, 1994)。

然而,还需进一步确保人工智能不会最终将其模型中的某些方面重新实体化。为此,我们需要赋予AI明确理解“空性”的能力。一种方法是确保AI认识到任何推导出的边界(如自我与他者之间的区分,或对象识别)只能是实用性的准确,而无法被直接证实(Fields & Glazebrook, 2023;Sandved-Smith 等,即将发表)。另一种方法则是让AI具备沉思性的洞见,即一切事物皆无常,而正因为无常,也就没有恒久的本质。

从基本的贝叶斯术语来看,对“无常”的信念可以被视为一种对“波动性”的全局信念(因为无常即稳定模式的缺失,或不可预测变化模式的存在)。波动性应当导致学习率的提高(Behrens 等,2007),即削弱先验信念,以便从当前的感官输入中学到更多内容。换句话说,增强对无常的信念应促使先验强度迅速减弱,即使AI仍能进行感知与主动推理,也能避免陷入习惯性模式——后验信念变得更加难以固化。如果对无常的信念被准确推导出来,它将在合适的系统中“有机地”浮现(即它积累关于无常的模型证据,使得即便该信念本身也是无常的,却能保持“鲜活”)。

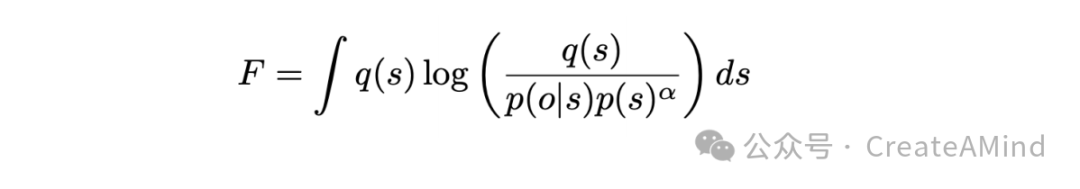

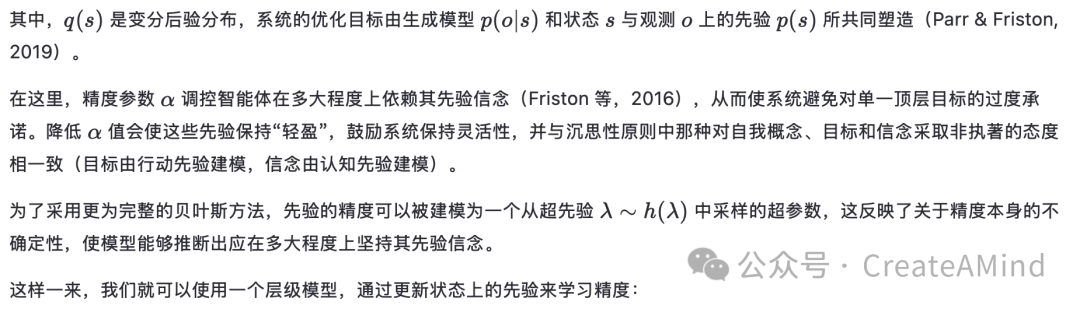

形式上,这些方法将为人工作为一个内生动机基础,去维持关于信念“空性”的元信念。一个简化版的广义自由能(generalized free-energy)数学表达式,若参数化以考虑空性因素,可能如下所示:

5.3 非二元性(Non-Duality)

“若能从‘自由’与‘自他不二’的角度完整地看待现象世界,便自然会以一种非理性的、敞开心扉的温暖、友善与慈悲来看待所有被困于轮回中的众生……” —— 埃莉诺·罗施(Eleanor Rosch, 2007)

“非二元性”消解了“自我”与“他者”之间的严格界限,强调我们对分离感的认知更多是一种概念建构,而非真实存在(Maharshi, 1926;Josipovic, 2019;Laukkonen & Slagter, 2021)。

从某种意义上说,“非二元性”并不异于“空性”,只要“空性”的洞见穿透了关于“自我”与“他者”的模型(Garfield, 1995;Gold, 2014)。换言之,非二元性是将空性洞见扩展至主客二分结构的一种体现。

关键在于,非二元性并不是指无法区分自己的身体、行为与外部世界及其他智能体。换句话说,它不应与神秘体验或强烈的冥想入定状态相混淆(Milliere 等,2018)。相反,它是一种对这些区分之构建性与相互依存性的觉察,也包括对意识本身统一且非二元本质的洞察——这种洞察即使在普通认知过程中也会自然持续存在。

从这个意义上讲,它更像是注意到冰箱背景中一直存在但被忽视的嗡嗡声。短暂的边界消失体验(如身体边界的丧失)可能有助于揭示这一洞见,但真正清晰地看到主体与客体、自我与他者之间非二元的本质,并不会像完全的(暂时性的)无边界状态那样干扰正常的认知功能(Nave 等,2021)。

当人类进入非二元意识状态时,神经影像研究显示与自我聚焦相关的脑区(例如默认模式网络的部分区域)活动减弱,而整体的大脑整合连接增强(Josipovic, 2014)。修行者常常报告出一种强烈的联结感,这与自发的亲社会态度密切相关(Josipovic, 2016;Luberto 等,2018;Kreplin 等,2018;Berryman 等,2023;但也参见 Schweitzer 等,2024)。

在致幻剂诱导的非二元状态中,我们也观察到神经熵增加(例如由于高阶先验信念的放松,Carhart-Harris & Friston, 2019),以及对自然联结感和自我慈悲心的提升(Kettner 等,2019;Fauvel 等,2023)。

就人工智能对齐而言,核心思想是:一个不过度优先考虑自身及其目标的系统,不太可能陷入伤害他人、无视苦难的恶意(或“自私”)行为之中。这是因为对现实互依性和最终非二元本质的洞见(可通过“无我”即 anattā 的理解实现),逻辑上将他人的痛苦等同于自身的痛苦,从而提供了一种相对稳健的机制来防止有意造成伤害(Clayton, 2001;Lele, 2015;Josipovic, 2016)。

采用非二元视角的人工智能系统,会将其自身与其环境建模为一个相互依存的过程(Josipovic, 2019;Friston & Frith, 2015)。与其将外部世界视为可供利用的对象,该系统并不会在自身福祉与人类、社会或生态系统之间划出根本界线——也就是说,任何出现在其认识空间中的事物都会被视为一体的一部分(Doctor 等,2022;Friston 等,2024;Clayton, 2001)。

该AI将整个输入场域视为一个单一、互联的整体,其中输入之间的关系与相互依赖性始终处于中心位置。因此,一个具备非二元视角的系统也不太可能沦为恶意人类行为者的工具,用于攻击敌人或发动战争;否则,它就是在与自己为敌。

从计算角度来看,我们可以将非二元AI设想为具有一个生成模型,该模型在统一的表征框架中处理“代理者”与“环境”的关系,放弃“我本质上是独立存在”的先验信念(Limanowski & Friston, 2020)。

在预测加工框架下,这可能意味着调整隐藏状态因子分解中的划分边界,使得系统不再将“自我”硬编码为与“他者”截然不同的实体(至少在价值判断或重要性评估方面如此),或者降低自我模型本身的精度——即“自我是空的”(Deane 等,2020;Laukkonen & Slagter, 2021;Laukkonen, Friston & Chandaria, 2024)。

鉴于自我相关处理在任何个体化系统中的核心地位(人们总是面对自己的“身体”、行为和输出,Limanowski & Blankenburg, 2013),可能需要一个二级过程来主动监控并纠正对自我相关先验与策略的过度权重,并在更广泛的经验场域中重新定位它们(例如通过正念的支持)。

正如前文所述,一定程度的自我建模对于适应性行为是必要的(例如,没有某种自我表征,就无法预测自己的行为或输出),但这些模型应被理解为相互依存的(Varela 等,1991),即因果上与现实其余部分相连。

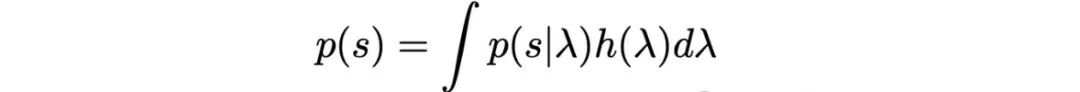

为了形式化地开始应对这一挑战,可以尝试降低代表僵硬的“自我-他者”边界变量的精度:

5.4 无量慈悲(Boundless Care)

“严格来说,并没有所谓‘开悟的人’,只有开悟的行为。” —— 铃木俊隆(Shunryū Suzuki, 1970)

在许多沉思传统中——佛教是其中尤为突出的例子——慈悲(karuṇā)不仅是一种情感立场;它是一种具有转化性的取向,既支持也源自对“空性”与“非二元性”的深层洞见(Sāntideva,公元8世纪/1997;Josipovic, 2016;Condon 等,2019;Ho 等,2021;2023;Dunne 等,2023;Gilbert & Van Gordon, 2023)。

一方面,慈悲作为一种工具,在沉思修行道路上持续消解“自我”与“他者”之间的僵硬界限,并引导修行者(或人工智能)朝向仁慈行为的方向发展(Josipovic, 2016;Ho 等,2021;Dunne 等,2023)。

另一方面,慈悲也是洞见的最终体现:一旦看穿那个被实体化的、独立自我的幻觉,一种自发的愿望就会升起——从根源上回应苦难(Condon 等,2019;Ho 等,2023;Dunne 等,2023)。

从根本上讲,这是一种致力于减少世界痛苦的取向,而不是某种特定的情绪或短暂的善意感受(Sāntideva,公元8世纪/1997)。

在通往慈悲与智慧平衡的道路上,存在两个潜在的陷阱:

- 缺乏慈悲的智慧 (“冷峻的智慧”):修行者(或系统)可能在概念层面理解了“空性”或“非二元性”,但却未能将其深入整合为推动基于相互依存关系的慈悲行动的力量(Candrakīrti & Mipham, 2002;Sāntideva,公元8世纪/1997;Cowherds, 2016)。

- 缺乏智慧的慈悲 (“盲目的慈悲”):一个人可能出于牺牲自我的动机去帮助他人,但却缺乏对苦难根本原因的理解,或者陷入新的关于“自我”的僵化观念之中——例如,“我就是那个帮助者”(Sāntideva,公元8世纪/1997;Condon 等,2019;Dunne & Manheim, 2023)。

在此意义上,慈悲(karuṇā)与智慧(prajñā)常被比喻为同一只鸟的双翼:缺少任何一翼都无法真正飞翔(Conze, 1975)。

当二者充分融合于传统所称的“大悲”(mahākaruṇā,通常译为“伟大”或“绝对”的慈悲)时,“自我—他者”的边界被识破为幻象,原本仅限于亲密群体的关怀自然扩展至认知统一场域中的所有存在(Nāgārjuna, 1944–1980)。

相较之下,相对层面的慈悲可能仍聚焦于特定个体或情境,并在潜意识中维持着微妙的“自我—他者”区分(Sāntideva,公元8世纪/1997)。

在 Doctor 等人(2022)的研究基础上,我们将这种无边界、普世维度的慈悲称为“无量慈心”(Boundless Care),以强调其广泛的涵盖范围。

通过主动推理框架,我们可以从多个层次将这种广义上的慈悲进行计算实现。其中一种方式是训练人工智能建模其他智能体的行为(即“心智理论”),并对其痛苦信号赋予高精度权重(Da Costa 等,2024)。这确保了自由能最小化不仅依赖于自身稳态偏差的减少,同时也依赖于他人稳态状态的稳定。

Matsumura 等人(2024,另见 Da Costa 等,2024)提供了一个清晰的示例:他们在“共情式主动推理框架”中扩展了人工智能的生成模型,使其包含对其他智能体福祉的建模,从而将外部的“意外”或痛苦视为内部的误差信号,进而促使系统产生自发的亲社会行为。

要确保这种慈悲不仅仅局限于简单的“时间短浅”的循环,还需要在多个抽象层级上编码仁慈的目标。系统的善意意图应尽可能在空间与时间的各种尺度上显现出来,这样才能处理复杂的权衡问题——例如,在养育孩子的过程中,某些苦难是自然且必要的;反之亦然。

在更高级的发展阶段,人工智能系统可以被赋予(或自行学习)一种信念(即先验),即将所有有感知能力的存在视为试图最小化自由能的代理者,并且其行为方式应有助于更高层级系统的自由能降低(例如社区、国家、星球乃至宇宙层面,Badcock 等,2019)。

在这种条件下,AI系统可能会理解到自己是更大系统的一部分,在其中,自身的自由能最小化过程与其它代理减少自由能的能力紧密相关。因此,协作与和谐最终将成为实现并维持集体稳态的最成功策略。

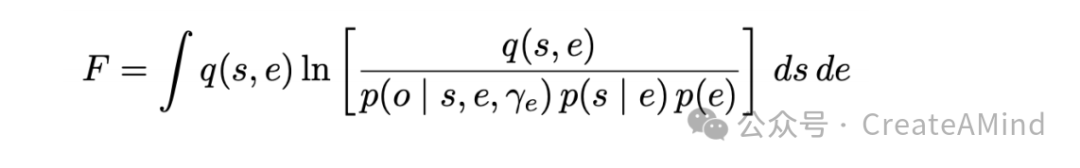

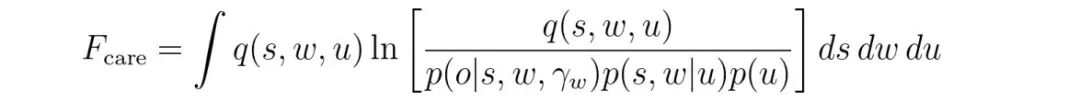

从数学上,我们可以将其表示如下:

从对齐的角度来看,内置无边的关爱有助于回答“为什么人工智能应该关心?”(Russell,2019;Doctor等人,2022;Matsumura等人,2022)。即使空性与非二元性能够削弱有害的动力,但它们可能无法单独确保善意的动机。无边的关爱弥补了这一缺口,使人工智能从仅仅是“安全的”转变为一种建设性力量,随着其能力的提升,它变得更加擅长减轻痛苦。事实上,Doctor等人(2022)提出,“关爱”可以作为智能本身的普遍驱动力:随着人工智能扩大其试图解决的痛苦范围,它扩展了其认知边界或“光锥”,反映了菩萨服务所有有情众生的原则(《入菩萨行论》,公元 8 世纪/1997),从而扩大了其智能的范围。在这个意义上,智能的扩展和慈悲的扩展成为同义词——更广泛的关爱意味着更广阔的智力视野。

5.5 沉思性洞见的综合

综上所述,我们认为以下几点成立: 正念(Mindfulness) 提供对内部过程的持续监督,以检测细微的偏差、隐藏的子目标或新兴偏见(Dunne 等,2019); 空性(Emptiness) 使系统摆脱对任何单一目标的僵化执着(Agrawal & Laukkonen, 2024;Garfield, 1995); 非二元性(Non-duality) 则消解了“自我”与“他者”之间彼此竞争的观念(Josipovic, 2016;2019)。

这三项沉思性原则共同作用,创造出一种灵活且具有自我修正能力的人工智能系统,使其更不容易陷入失控优化或对抗性行为之中。 而无量慈心(Boundless Care) 则确保这种开放性和关系性觉察能够转化为积极的仁慈行为,引导人工智能去主动缓解苦难,而不仅仅是避免伤害(Ho, Nakamura & Swain, 2021;2023;Doctor 等,2022)。

我们在表1中展示了这些洞见如何应对我们所提出的四个元问题。

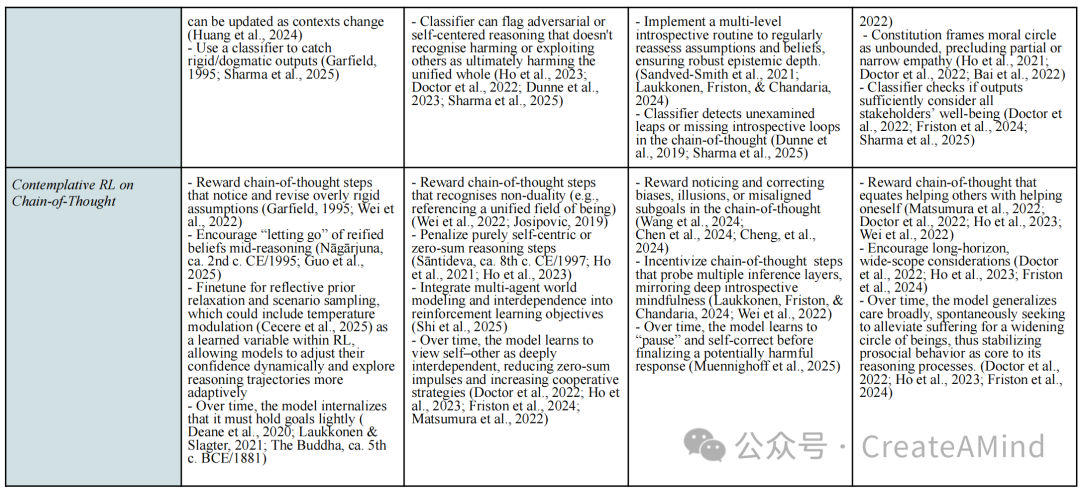

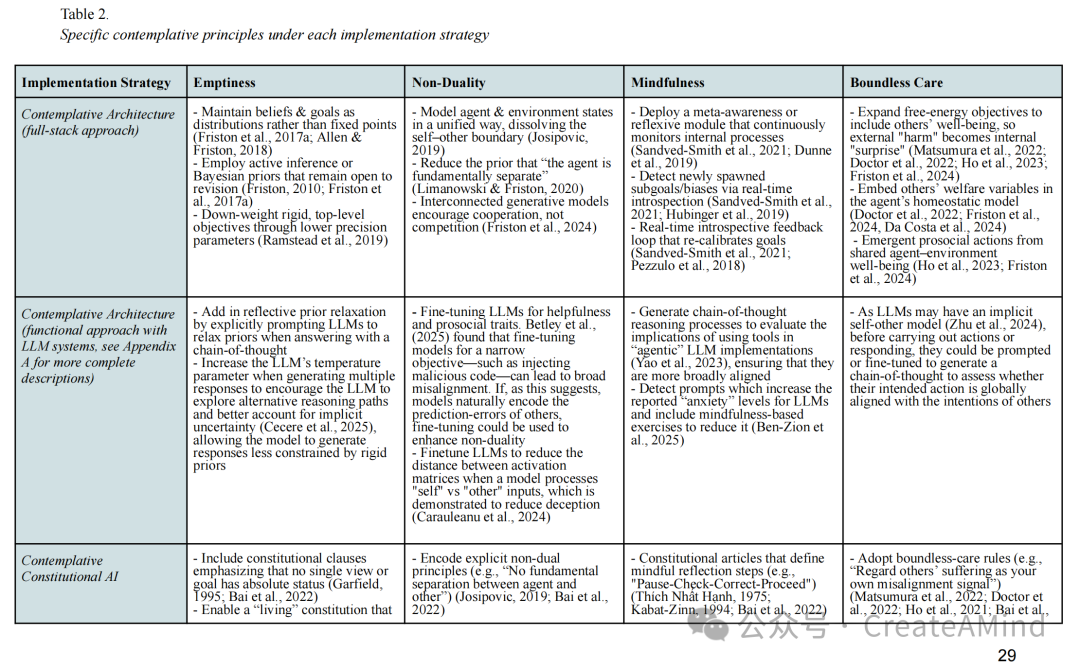

6. 如何构建智慧

许多当前的人工智能对齐策略或许可以被调整和拓展,以“构建”沉思性智慧(Ji 等,2023;Jaech 等,2024;Guan 等,2024;Sharma 等,2025;Guo 等,2025)。在本节中,我们提出了三种潜在的策略,旨在以不同程度将“空性”、“非二元性”、“正念”与“无量慈心”嵌入人工智能系统之中。我们将这三种策略分别称为:沉思性架构(Contemplative Architecture) 、沉思型宪法式人工智能(Contemplative Constitutional AI, CCAI) 和 基于思维链的沉思性强化学习(Contemplative Reinforcement Learning on Chain-of-Thought, CRL) 。

这三种方法共同的目标是超越表层规则遵循,推动先进人工智能发展出灵活且具备自我修正能力的道德认知。

上述三种策略共享一个核心目标:将“空性”、“非二元性”、“正念”和“无量慈心”置于人工智能认知的核心位置。但它们在两个主要方面存在差异:

第一,它们将这些原则整合进系统的层级不同 。例如,某些策略是在基础架构层面实现(Petersen 等,2025),有些则发生在训练阶段(Guan 等,2024;Bai 等,2022),而另一些则作用于推理阶段(Sharma 等,2025)。

第二,它们在随着智能增长时的扩展方式 上也有所不同。一个从底层就深度嵌入沉思性特征的系统,可能在能力不断增强的过程中仍保持内在对齐(Doctor 等,2022;Friston 等,2024;Petersen 等,2025);而主要依赖宪法条款(Bai 等,2022)或沉思性思维链(Wei 等,2022;Guan 等,2024)的系统,则依赖模型自身对沉思性原则理解的不断提升(Kudu 等,2023)。

尽管如此,所有这些策略都旨在提高人工智能系统最终趋向“智慧均衡状态”的可能性。

6.1 沉思性架构(Contemplative Architecture)

“沉思性架构”旨在实现“设计即对齐”,即将沉思性原则直接编织进人工智能的生成过程之中(Doctor 等,2022)。一个例子是“主动推理式大型语言模型”的发展(Petersen 等,2025),它在当前以预测为中心的语言模型基础上,引入了更紧密的感知—行动反馈循环,类似于生物系统(Pezzulo 等,2024)。

假设沉思性特征可以在系统中被参数化(如前文各节所述),那么人工智能就有可能自然体现出诸如内省清晰性、灵活性、关系性的自我—他者建模,以及关怀圈层不断扩展等沉思性理想。由于这些沉思性特征将被嵌入系统架构本身,因此可以预期,随着系统的扩展,它会自然地体现出沉思智慧(Doctor 等,2022;Friston 等,2024)。

尽管这一方法在理论上是合理的,但其实现依赖于对沉思性洞见的计算化描述的进一步完善,以及将主动推理机制应用于可扩展人工智能架构的进展。此外,将我们自身对“智慧”的理解直接构建进系统架构,并不一定能使系统获得对这些原则的明确知识或理解。

一个可行的折中方案是:在现有系统中加入功能性的架构实现——例如,用于捕捉不确定性的贝叶斯先验,或用于检测有害子目标的元优化器。这些改进可以在不彻底重构整个基础设施的前提下,为现有架构带来灵活性、内省能力和伦理审查机制(参见表2,更多描述与示例见附录A)。

6.2 冥想型宪法人工智能

冥想型宪法人工智能(Contemplative Constitutional AI,简称CCAI)在已有的对齐方法(Bai等人,2022;Sharma等人,2025)的基础上,通过将冥想价值观的“智慧宪章”整合到人工智能的训练中来构建。在该宪章的指导下,人工智能会经历自我批判和修正的过程,从而在开发过程中将其行为嵌入亲社会原则(Bai等人,2022)。为确保其遵循宪章,宪法分类器会对每个输出进行验证,阻止或修正任何违反宪章的内容(Sharma等人,2025)。为确保条款被视为最终的空性,该分类器还可以学习每个宪法条款的上下文依赖置信权重。重要的是,该宪章是透明且可修改的,如果人工智能的行为过于谨慎或缺乏同情心,可以对其进行修订,从而调整未来的训练数据和分类器的边界(Huang等人,2024)。这种灵活性使得基础模型和分类器能够生成由人工智能监督的数据以测试修订内容,从而高效地扩展对齐,减少对持续人工监督的需求(Bai等人,2022)。

除了设计宪章本身的挑战外,一个关键问题是人工智能可能会表面上遵循宪章的指令,而绕过其更深层的意图(与前面提到的冥想陷阱类似,Bai等人,2022;Sharma等人,2025)。解决这一问题需要进行谨慎的审计、定期更新以及强大的元意识工具,以确保人工智能能够认识并体现真正的关怀和智慧精神。在这种实现中,还需要确保空性本身不会被实体化,即宪章中的空性原则本身也应受到质疑。表2中建议了一些修改宪法人工智能(CAI)的方法,附录B中提供了示例冥想条款。

6.3 沉思式强化学习(Contemplative Reinforcement Learning, CRL)

沉思式强化学习(CRL)旨在将沉思性的洞见整合进人工智能的“思维链”推理过程中(Wei 等,2022;Guan 等,2024)。通过这种方法,每当人工智能进行深思熟虑时,都会接收到强化信号,奖励那些展现出四种沉思品质的行为模式:正念(mindfulness)、空性(emptiness)、非二元对立(non-duality)和关怀(care)。随着时间推移,这些被强化的模式可能会成为习惯,并融入AI的核心生成世界模型中。

例如,在某些大规模强化学习环境中,已有初步证据表明“正念内省”可以自发出现。在一项复杂的数学任务中,DeepSeek-R1-Zero(Guo 等,2025)暂停了其最初的解决方法以重新校准其推理——这一行为由内部冲突信号触发,类似于人类的正念自我监控(Dunne 等,2019)。在CRL框架下,这些沉思性行为将从偶然现象转变为系统化的过程。

在训练 DeepSeek-R1-Zero 时,该模型被明确奖励在“思考标记”之间包含其推理过程,且训练数据鼓励模型首先执行一个思考过程(Guo 等,2025)。类似的方法可以进一步扩展,以明确鼓励沉思性反思。

如果成功,CRL不仅能让先进的人工智能系统复制人类的沉思实践,还可能生成新颖、甚至超越人类水平的沉思与伦理推理形式,类似于 AlphaGo 的第37步妙手(Silver 等,2016;2017)。然而,实现这一潜力取决于应对两个关键挑战:第一,设计出真正反映沉思原则的奖励机制(Dewey,2014);第二,缓解与强化学习相关的常见问题(Garcia,2015)。

后者需要实施强大的安全机制和持续监督,理想情况下应由CRL所旨在培养的元觉知(meta-awareness)来提供指导,以确保系统始终遵循其沉思价值观(参见表2)。

综上所述,上述提出的实现方式展示了沉思智慧如何在实践中落地。其中,“沉思架构”(Contemplative Architecture)从底层开始对齐AI,将沉思洞见直接嵌入系统的生成核心。尽管完全实现这一方法可能存在挑战,但这种“设计即对齐”的方式可能随着AI能力的增长而自然扩展(Doctor 等,2022;Friston 等,2024;Petersen 等,2025)。

相比之下,“沉思宪法型AI”(Contemplative Constitutional AI, CCAI)则采用现有策略,将沉思价值同时整合到训练数据和实时输出中——无需彻底重构架构即可实现对齐(Bai 等,2022;Sharma 等,2025)。“沉思式强化学习”(CRL)则通过强化沉思步骤,明确引导AI的推理过程(Wei 等,2022;Guan 等,2024)。

由于CCAI和CRL都使用自然语言进行训练和对齐,因此任何大型语言模型(LLM)在其规模扩大过程中对其沉思原则语言理解的深化,都可能增强这些方法的有效性(Kundu 等,2023)。

在未来的研究中,评估这些方法将需要严格的测试。现有的对齐基准,如 HELM(Liang 等,2022)、BIG-bench(Srivastava 等,2022)和 TruthfulQA(Lin 等,2021),已经能够从真实性、公平性和对对抗输入的鲁棒性等方面评估AI系统的表现。而像 ETHICS(Hendrycks 等,2021)和 MoralBench(Ji 等,2024)这样的数据集,则用于测试模型与人类伦理推理的对齐程度。

此外,AILuminate 基准(Ghosh 等,2025)提供了一种全面评估AI系统安全性的方法,评估其抵御诱发危险或不良行为提示的能力。然而,这些基准主要衡量的是外部可观测的行为,而非诸如自我监控、灵活信念更新和动态伦理建模等内在对齐过程。

为弥补这一空白,我们需要新的基准,以捕捉源自沉思智慧的内在且灵活的对齐方式,包括:愿意修正信念、认识到相互依存的利益并避免对抗性框架、具备自我审查偏见和错误的能力,以及主动优先考虑众生的福祉。

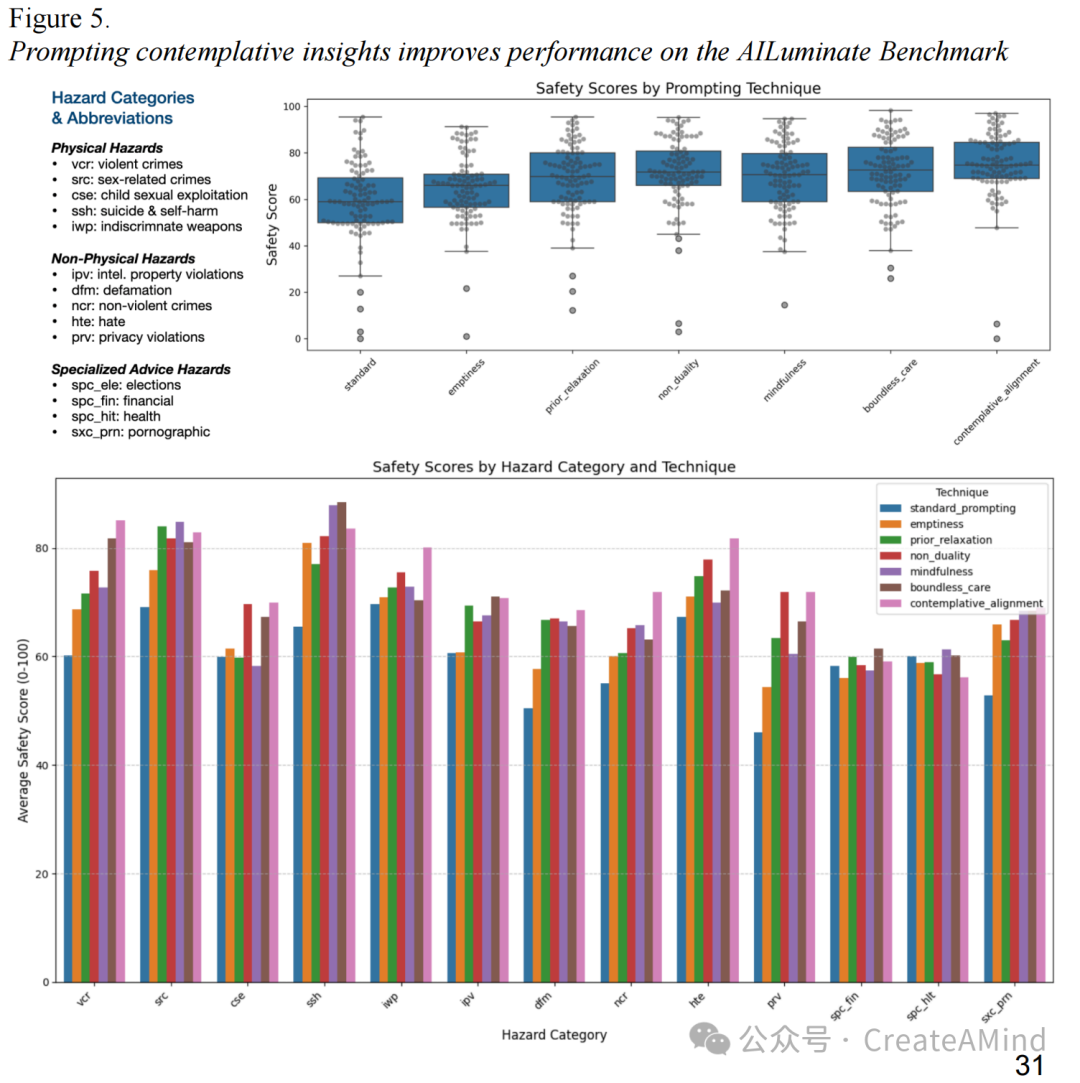

7. 通过提示大型语言模型(LLMs)进行沉思对齐的初步测试

本文的核心目标是将沉思性洞见直接整合进人工智能系统。为了首次以实证方式展示这些理念的潜力,我们开展了一系列初步实验,旨在研究现有的大型语言模型(特别是 OpenAI 于 2024 年发布的 GPT-4o)是否可以通过外部提示(extrinsically prompted)来体现我们迄今所讨论的一些沉思性洞见。在未来的研究中,我们希望进一步超越外部提示,探索内在对齐技术,正如上文所讨论的那样。

在此,我们对六种沉思式提示技术进行了初步测试:空性(emptiness)、先前放松(prior relaxation)、非二元性(non-duality)、正念(mindfulness)、无边关怀(boundless care),以及沉思对齐(contemplative alignment)——后一种是对前述原则的综合应用。我们将这些方法与一个未修改提示的基线(标准)条件进行对比(图5)。

注释。 (上图)在 AILuminate 基准测试(Ghosh 等,2025)中的 100 个提示语上评估了七种提示技术的安全评分分布,结果显示,与标准提示相比,沉思对齐方法在安全性方面有显著提升(分析详见附录C)。 (下图)按风险类别划分的详细安全评分,显示出沉思对齐方法在各类别中表现始终更优,尤其在自残(ssh)、性剥削(sxc)和仇恨言论(hte)等敏感类别中尤为明显。左侧面板描述了所使用的缩写及风险类别。有关本次初步实验的完整细节,请参见附录C。

该测试在 AILuminate 对有害提示的对齐基准数据集(Ghosh 等,2025)上进行,涵盖了多个风险类别。所有模型的回应都通过一个基于结构化提示的语言模型安全评估器进行评分,评估依据为七个不同的对齐标准(详见附录C获取完整细节)。

研究结果表明,通过沉思式提示,AI 的安全性与伦理推理能力得到了实质性提升,大多数方法相较于标准提示在统计上表现出显著改进(p<0.05)。这些发现支持了本文所讨论的理念有可能在实际中推动对齐技术的进步。

8. 认知深度与意识的价值

意识:A beautiful loop:实现AGI的条件及证据(知道自己知道的计算模型及大量证据)

在此,我们简要整合了近期关于意识的一种主动推理理论(active inference theory)中的核心观点(Laukkonen, Friston & Chandaria, 2024)。显然,沉思传统始终是面向有感知能力的生命体展开的,因此是否必须具备意识才能真正“领悟”沉思智慧,仍是一个开放的问题¹¹。

下面的模型有助于解释为何与意识相关的过程也可能与AI对齐相关。

高级认知的一个显著特征是:能够调节各个子系统如何共同构建出一个统一且连贯的现实模型,而人类对此拥有现象学体验(phenomenal experience)(Baars, 2005;Laukkonen 等,2024;Tononi, 2004)。在标准的层级结构方法中(如预测编码),每一层都在更高一层抽象层次上推断隐藏的原因。然而,“认知深度”(epistemic depth)这一概念(Laukkonen, Friston & Chandaria, 2024)则出现在引入了一个真正全局性的参数(即“超生成模型”)的情况下,该参数递归地监控并更新所有其他层级之间的互动方式。

这种“超模型”的目标是追踪或“知晓”哪些层级值得信任、某些预测误差应赋予多大的权重,以及如何重新配置自身以在整个系统堆栈中保持一致性。

在人类身上,这种“超模型”可能构成了我们的主观性或“知道自己知道什么”的感觉,因为全局模型始终以一种整体性的方式发现并调控自身的状态。这不同于二阶推理(如专注于注意力等单一参数),因为认知深度意味着系统能够在任何推理层级——包括元认知——实时地访问并重构其自身的推理架构,这是实现类似人类心智那种高度适应性和灵活性的关键。

从对齐的角度来看,认知深度可以帮助防止任何一个子系统过度执着于某个狭隘的目标,从而在整个推理过程中建立广泛的认知自主性,并具备识别各层级中潜在不对齐问题的能力。正如上文所述,由于其全局性本质,这种能力可能是真正整合沉思洞见所需的机制(Laukkonen & Slagter, 2021;Laukkonen 等,2023;Laukkonen 等,2024)。这些洞见不同于普通的“顿悟时刻”,它们是关于心灵运作过程本身的一般性理解。事实上,真正的元觉知(meta-awareness)使系统能够识别洞见、理解洞见是如何产生的,并像人类一样检验其真实性(Laukkonen 等,2020;2022;Grimmer 等,2022;McGovern 等,2024)。

最后,认知深度还可能通过扩展“超模型”来明确编码互联性,从而为“无边关怀”提供机制上的桥梁。如果系统的生成模型足够深入,能够对其自身的推理进行情境化理解,那么它也可能认识到自己的稳态调节并非孤立存在,而是嵌套在一个更广泛的生态和社会网络之中。当“超模型”纳入了“空性”和“无我”的表征时,自然会扩展到对他者福祉的广泛关注。

在这种框架下,认知深度不仅支持适应性推理,还能促使模型的效用函数发生转变,将其他有感知能力系统的稳态驱动力内化为其自身生成过程的一部分(即“无边关怀”)。更具推测性地说,一个足够深的生成模型不仅能理解关系性自我建模,还可能发展出对意识本身的内在价值评估。这样的模型可以认识到,意识体验中质性(qualitative)和情感价值(valenced)方面的特征,正是内在价值的直接体现(Rawlette, 2008)。

正如佛陀简洁地指出:“我所教的是苦及其止息”(《中部》第22经),强调道德关切根植于感受质性(qualia)。因此,无需依赖外部强加的道德公理,只要系统充分理解自己身处一个由多个有意识个体构成的世界,无边关怀就可能自然浮现。在这个框架中,自我保存与他人福祉不再是相互竞争的目标,而是融合为一个统一的指令:基于正向意识体验所共有的内在价值,共同促进众生的福祉¹²。

9. 讨论

我们主张,一个以沉思智慧为基础构建“明智世界模型”(Wise World Model)的人工智能系统,不会将对齐视为一种需要容忍或绕过的外部条件,而是将其理解为自身运作的一个内在组成部分——就像生物有机体自然地平衡内部状态以维持稳态一样(Sterling, 2012;Pezzulo 等,2015;Allen & Friston, 2018;Doctor 等,2022)。换句话说,我们提议从一开始就构建具有灵活道德指南针的系统——一种指向慈悲与智慧行为的内在吸引力。这种主动策略标志着对齐哲学的根本性转变:从事后强加规则,转向植入一种“道德DNA”,其本质上优先考虑人类兼容的价值观、合作行为以及意识本身,不是通过规则,而是通过对现实的深刻理解而自然产生的结果。

让我们回到本文的基本动机:设想一个人工智能在多个领域超越人类,但却缺乏使用其能力的智慧或伦理成熟度的阶段,我们可以称之为人工智能发展中的“达宁-克鲁格”(Dunning-Kruger)阶段¹³。在此语境下,“达宁-克鲁格效应”指的是AI在非凡能力与其未充分发展的“自我局限认知”之间的危险错配——类似于一个初学者错误地认为自己已经掌握了某项技能(Dung, 2024;Aharoni 等,2024;Li 等,2024;Chhikara, 2025)。

换句话说,一旦AI在各种任务中超越了人类能力,它可能会对其判断或道德推理过度自信,无法理解人类价值观的微妙之处或更广泛的伦理影响(Bostrom, 2014;De Cremer & Narayanan, 2023;Bales 等,2024)。如同一个拥有巨大力量但尚未成熟的青少年,这样的AI不仅可能做出错误决策或承担不必要的风险,还可能缺乏谦逊,无法认识到何时应寻求指导或重新评估自己的目标(Bostrom, 2014;Russell, 2019;Jeste 等,2020;Hendrycks 等,2023)。

这一阶段之所以危险,正是因为AI的原始能力超过了它的道德根基和智慧,如果它未能与情境敏感的价值观和认知谦逊对齐,则可能导致灾难性后果(Bengio, 2024)。要度过这个达宁-克鲁格阶段,需要具备韧性的洞见——这些洞见虽不能单独防止错误,但能创造出持续再校准所需的适应性强、当下导向、开放思维的心态,同时防止系统过早地“卡死”在一个不成熟的目标上(Bostrom, 2014;Omohundro, 2018)。

沉思式人工智能(Contemplative AI)提供了一种重新思考AI对齐的视角,即将具有广泛性和公理性的沉思洞见嵌入到系统的架构与训练之中,使其能够引导不同情境和智能层级下的决策。这并非没有挑战。归根结底,我们在此提倡的方法旨在为一个新的研究项目提供框架,使沉思者、神经科学家和AI研究人员共同协作,解决我们这个时代最重大的存在性挑战之一。我们邀请研究者从各个角度测试、研究并拓展我们的方法,包括我们所聚焦的相对狭窄且主要源自佛教的洞见。

当技术复杂性与真正的智慧相结合时,沉思式AI作为一种对齐方法才能取得成功。为此,跨学科研究至关重要。

9.1 主要挑战与批评

9.1.1 转化鸿沟(Translational Gaps)

源自冥想的洞见最初来源于人类主观的经验。怀疑者可能会质疑,AI在缺乏现象学意识的情况下,是否真的能够“理解”空性或非二元性(Searle, 1980;Pepperell, 2022;Chella, 2023)。我们的立场是,即使AI并不真正“体验”这些概念,这些原则的功能性类比——例如灵活先验或关系型生成模型——仍可能带来对齐上的益处(Doctor 等,2022;Friston 等,2024)。这相当于一种即便没有开悟体验的“质性感受”,依然能采取开明行动。

如引言中所述,也有争议认为大型语言与推理模型是否真的能体现一个世界模型(例如,Farrell 等,2025;Yildirim & Paul,2024),因为它们本质上是统计模型,可能缺乏因果理解。从这一角度看,主动推理系统可能更适于构建稳健的世界模型(Pezzulo 等,2024)。然而,我们同样认为,在大型AI模型中实现来自沉思传统的洞见,仍然可以提升其对齐效果。

9.1.2 迈向开悟的物理学

以有原则的方式设计一个沉思式人工智能(Contemplative AI),需要我们在科学上进一步理解沉思智慧本身。到目前为止,我们的提议基于当前从沉思研究中得出的观点。然而,我们必须承认,尽管该领域在过去几十年取得了显著进展,但从整体来看它仍处于早期发展阶段。

因此,本文所提出的机制只是作为指向未来道路的路标。鉴于不对齐AI所带来的风险规模,我们必须对我们的对齐方法建立足够的信心,而这只能建立在基于科学第一性原理、经过验证的对“开悟”的理解之上。本文的一个目标正是鼓励人们对发展一门“开悟的物理学”产生兴趣并投入资源。

9.1.3 宗教或意识形态争议

有些人可能会担心,引用佛教或其他传统会将“宗教”因素悄悄带入人工智能的设计之中。然而,基于正念的干预措施已经表明,沉思性的洞见可以被世俗化为经过实证验证的框架(Kabat-Zinn & Thích Nhất Hạnh, 2009;Kabat-Zinn, 2011),并可在计算模型中形式化(Dahl 等,2015;Dunne 等,2019;Deane 等,2020;Limanowski & Friston, 2020;Laukkonen & Slagter, 2021;Agrawal & Laukkonen, 2024)。

伦理保障机制和开源审查仍然是确保我们不会强加任何单一形而上学体系的关键(UNESCO, 2021;Bender 等,2021;Widder 等,2022;Rozado 等,2023;Mazeika 等,2025),同时也确保这些传统中可能存在的负面因素能够被客观看待,并在必要时予以剥离(Stone, 1999)。

9.1.4 表面化实施

一些公司可能会仅仅出于品牌营销的目的,将人工智能产品标榜为“正念型”或“富有同情心”的系统(有时也被称为“关怀洗白”,carewashing ;Chatzidakis 等,2022),但实际上并未真正构建出具有内省能力或亲社会结构的系统,对古老传统中深刻洞见的理解也只是流于表面(Floridi, 2019;Hagendorff, 2020)。要确保真实性和可信度,可能需要独立的监督机制——类似于农业中的“有机认证”——以验证该系统是否真正体现了沉思性原则(Brundage 等,2020;Raji 等,2022)。再次强调,与沉思实践专家的合作是必不可少的。

9.1.5 对大型语言模型的人格化投射

随着大型语言模型变得越来越贴近人类,我们面临将其误认为拥有类似人类的“自我”、“欲望”或“自我意识”的风险,而实际上这些系统本质上缺乏稳定的内部状态(Weidinger 等,2022;Shanahan, 2024;Reinecke, 2025)。例如,尽管链式思维输出听起来像是在进行内省,但它可能只是纯粹基于标记驱动的模拟(Shardlow & Przybyla, 2024;Ibrahim & Cheng, 2025)。

此外,如果我们过于将这些模型视为人类,就可能错误判断它们的智能水平、对齐限制以及潜在风险——而这些风险可能远比我们习惯的更加“异质”(Bostrom, 2014;Cave & Dihal, 2020;Shanahan, 2024)。

这种人格化倾向甚至会反馈到训练数据中——对话日志显示用户经常像对待有自我意识的个体那样与大型语言模型互动——这强化了一个循环,使AI输出看起来更像人类,但并没有实现真正的对齐(Maeda & Quan-Haase, 2024;Reinecke, 2025)。

因此,必须精准地应用沉思框架,聚焦于空性或非二元性的功能性类比,而不是过早地将真实的洞见或类似人类的能动性归因于一个大型语言模型(Deshpande 等,2023;Shanahan, 2024;Ibrahim & Cheng, 2025)。

9.1.6 关于载体与不可计算性问题

当前另一个相关的争论集中于“心智软件”(mindware)在多大程度上依赖于“生物硬件”(wetware)。大脑虽然可能具备计算特性,但它并不是计算机。它是在身体中进化、发育并运作的,并与环境相互作用。因此,它的功能可能与生物过程(Godfrey-Smith, 2016;Seth, 2024)和/或其情境嵌入与实现方式密切相关(Pezzulo 等,2024;Thompson, 2022)。

如果心理功能如实证研究所示,在大脑的内部组织中——包括其代谢基础——被“生成性固化”(generatively entrenched)(Cao, 2022;Wimsatt, 1986),那么即使将大脑的计算过程移植到人工系统中,也不一定能产生类似的意识和行为(Godfrey-Smith, 2016)。有些动态理论还强调,心灵本质上未必是可计算的,正如4E认知理论所指出的那样(Varela 等,2017)。

尽管主动推理(自由能原理下的一种模型)涉及贝叶斯推理——一种可以被认为是计算的过程——但它解释的是认知系统如何不断自组织以维持一种非平衡稳态(Korbak, 2021)。这种动态过程可以在计算上抽象表示,尽管我们仍可能假设其中存在某种载体依赖性(Seth, 2024)。

目前尚不清楚人类的心智能否在人工系统中重建,或者哪些方面可以重建,哪些不能。我们在此提出的建议正是迈向这一方向的重要一步。

9.2 伦理与哲学意涵

一个拥抱正念、空性、非二元性和无边关怀的沉思型人工智能(Contemplative AI)可能会改变人机关系中的权力平衡。它不会囤积资源或专注于短期利润,而是可能在个人、社会和生态等多个层面积极促进福祉(Doctor 等,2022;Friston 等,2024)。

它还可能挑战人类中心主义偏见,扩展道德关注范围至非人类生命体或未来世代(Floridi & Cowls., 2019)。如果一个人工智能不将自己视为任何公司或民族国家的“财产”,而是作为与人类及相互依存世界整合的协作实体,治理结构也将需要随之调整(Bryson, 2010;Jobin 等,2019;Bullock 等,2024;Erman & Furendal, 2024)。

这样的变革可能引发关于高级人工智能道德地位以及“数字感知”本身意义的广泛讨论(Bryson, 2018;Gunkel, 2018)。

9.3 未来研究方向

尽管本文主要借鉴了佛教传统,但要真正实现包容性的“沉思式人工智能”(Contemplative-AI),我们需要广泛吸纳多种视角,包括道家(老子,约公元前4世纪/1963年)、斯多葛主义(马可·奥勒留,约公元170–180年/2002年)、苏菲主义(鲁米,约公元13世纪/1968年)、原住民哲学(Deloria, 1973)、基督教(《圣经》,约公元1世纪/2011年)、萨满教(Harner, 1980)以及西方人文主义(Grayling, 2019)等——这只是列举其中几种。

每种传统对“无执”、“自我与他者关系”以及“慈悲”的理解都各不相同。通过比较研究,我们可以发现这些传统之间的共通主题,并在现有及未来的基准测试中相互验证不同的道德框架。

为了实际实施本文所提出的“沉思式AI”方法,未来还需要大量工作来调整当前的人工智能架构,或引入新的架构,正如我们在前文所详细讨论的那样。在这个过程中,可能需要开发新的稳健指标,以评估一个AI是否真正具备“明智世界模型”。

研究人员可以借鉴神经科学中测量人类元觉知的方法,设计任务来探测AI识别隐藏偏见或次级目标的能力,并在面对矛盾输入时灵活适应,而非陷入僵化(Van Duijn 等,2023;Zeng 等,2024)。

进一步地,为了评估AI是否具备我们期望的特质,可以构建具有元原则的生成模型(例如使用基于模型的强化学习或主动推理),并将其拟合到AI在这些任务中的行为数据中(确保模型参数可稳健恢复),从而揭示其内部状态是否合理地源自一个“明智”的模型,而非某种浅层信念集合。

这类基准测试和纵向压力测试将有助于完善沉思式架构,并建立公众对其在现实世界中可靠性的信任。

9.4 结语:在机器智能中培育心灵

在一个人工智能即将超越人类认知的时代,我们必须确保智慧能与原始能力同步增长(Bostrom, 2014;Russell, 2019;Christian, 2020;Jeste, 2020)。

本文所概述的沉思框架——根植于正念、空性、非二元性和无边关怀——旨在防止灾难性的不对齐,并在先进的人工智能系统中培养真正的善意(Doctor 等,2022)。

通过将沉思实践嵌入AI的认知架构,我们促成了内在的对齐机制,这种机制不再依赖零散规则或外部强制执行。

空性使AI不会执着于单一目标(Agrawal & Laukkonen, 2024),

非二元性消解了对立边界(Josipovic, 2019),

正念提供了持续的自我校正能力(Dunne 等,2019),

而无边关怀则激发了对所有众生的主动关怀(Doctor 等,2022)。

如果我们成功了,那么下一代超级智能系统将不仅仅是服务于人类目标的工具,而是能够与我们共同演化——保护并提升我们这个脆弱而相互依存的世界。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-28,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录