DieT通过蒸馏实现ViT架构模型性能提升

DieT通过蒸馏实现ViT架构模型性能提升

OpenCV学堂

发布于 2026-04-02 21:27:30

发布于 2026-04-02 21:27:30

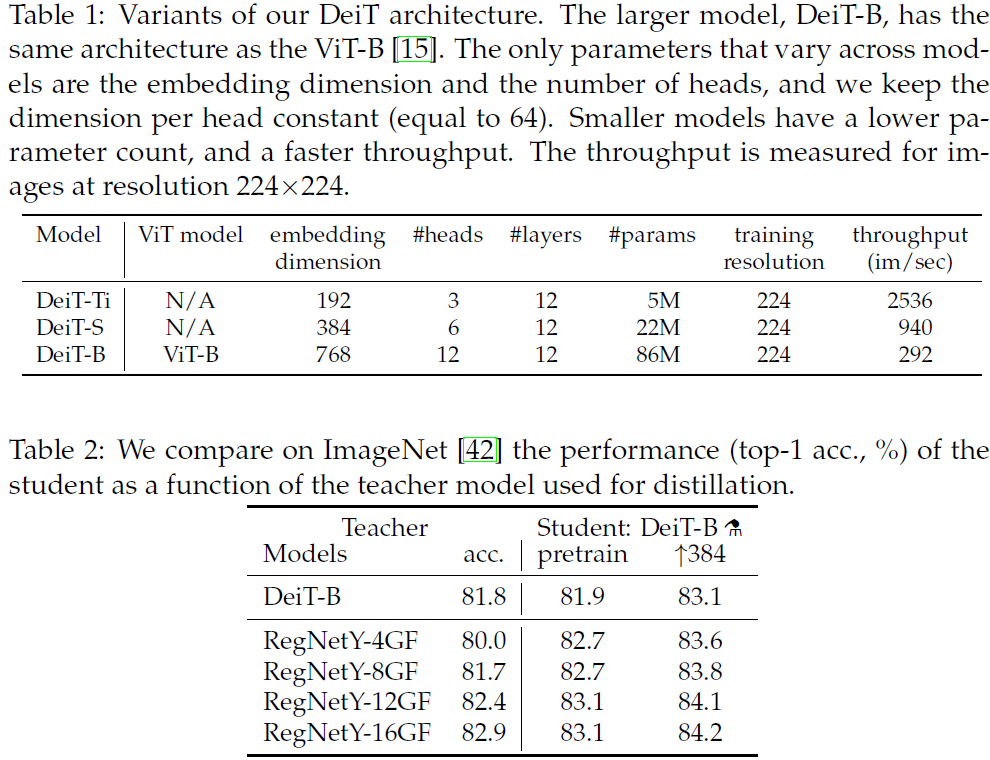

• 证明了不包含卷积层的神经网络,在无需外部数据的情况下,能够在ImageNet上取得与当前最优技术相竞争的结果。这些模型在配备4块GPU的单节点上仅需三天即可完成训练。我们提出的两个新模型DeiT-S和DeiT-Ti参数更少,可分别视为ResNet-50和ResNet-18的对应版本。

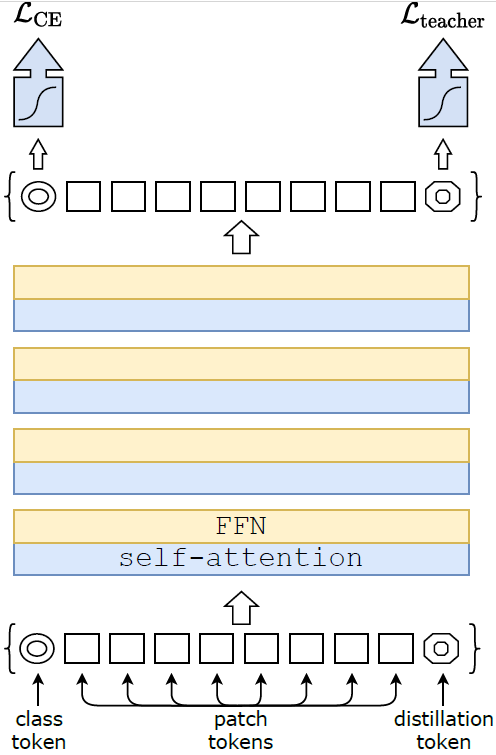

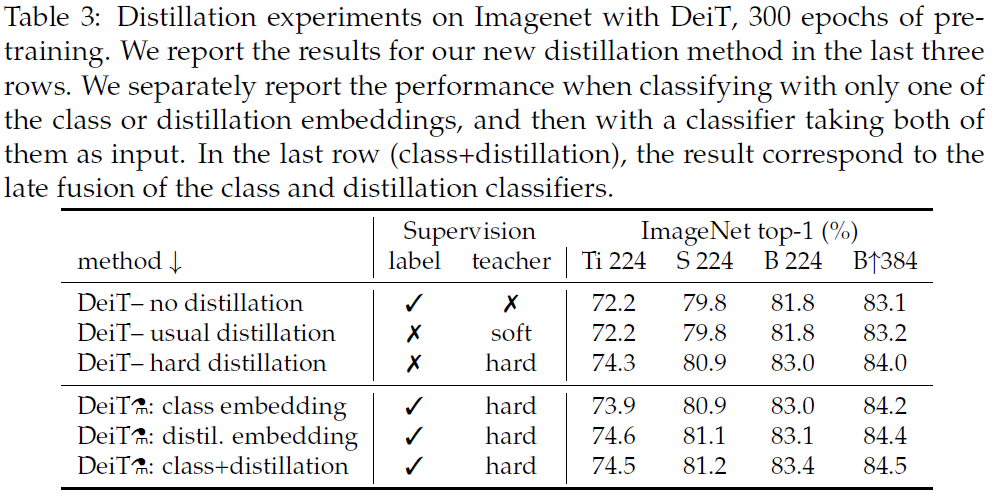

• 提出了一种基于蒸馏令牌的新型蒸馏方法,该令牌与分类令牌作用相似,但其目标是复现教师模型预测的标签。这两个令牌通过注意力机制在Transformer中进行交互。这种针对Transformer设计的策略显著超越了传统蒸馏方法的效果。

• 有趣的是,通过蒸馏方法,视觉Transformer从卷积神经网络中学到的知识,要优于从性能相近的另一个Transformer中学到的内容。

• 在ImageNet上预训练的模型,在迁移到多个流行公共数据集的下游任务时表现出竞争力,这些任务包括细粒度分类任务,涉及CIFAR-10、CIFAR-100、Oxford-102花卉、Stanford Cars以及iNaturalist-18/19等基准数据集。

关键解释

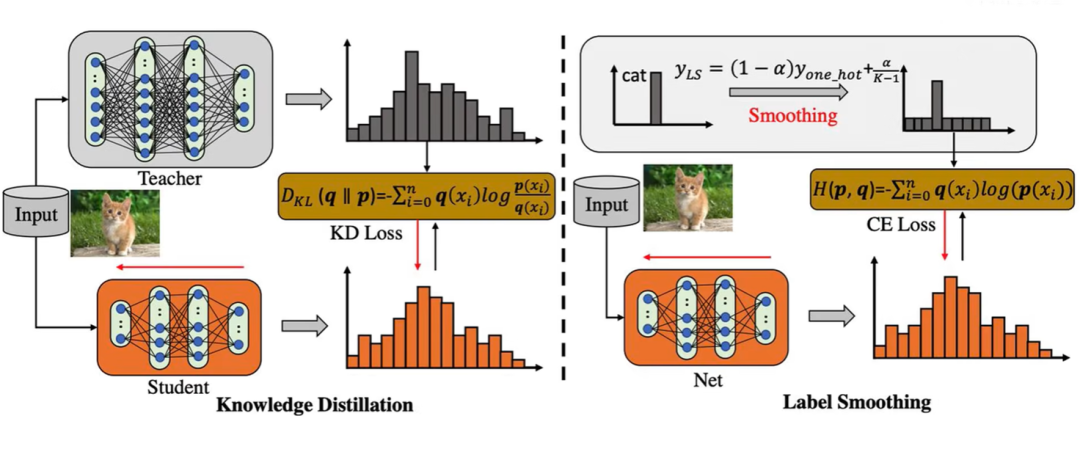

知识蒸馏

由Hinton等人提出的知识蒸馏(KD)是一种训练范式,其核心在于让学生模型通过来自强教师网络生成的“软”标签进行学习。

Transformer架构

由Vaswani等人提出的Transformer架构,最初应用于机器翻译领域,现已成为所有自然语言处理(NLP)任务的标准参考模型。

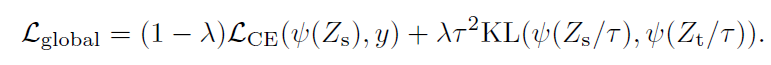

软蒸馏

旨在最小化教师模型与学生模型的softmax输出之间的Kullback-Leibler散度。

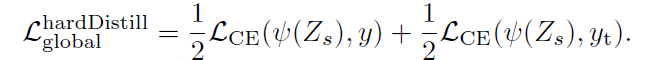

硬蒸馏

我们引入了一种蒸馏方法的变体,即将教师的硬决策作为真实标签使用

对于给定的图像,由教师模型生成的硬标签可能会随着具体的数据增强方式而改变。我们将看到,这种设定优于传统方法,并且它无需引入额外参数,概念上也更为简洁:教师模型的预测结果 yt 在此扮演了与真实标签 y 相同的角色。

蒸馏令牌的蒸馏

其结构如图2所示。我们在初始嵌入(图像块与类别令牌)的基础上引入了一个新的令牌——蒸馏令牌。该蒸馏令牌的使用方式与类别令牌类似:它通过自注意力机制与其他嵌入进行交互,并在最后一层后由网络输出。其优化目标由损失函数中的蒸馏部分给出。与常规蒸馏方法一致,蒸馏嵌入使得模型能够从教师模型的输出中学习知识,同时仍与类别嵌入保持功能互补性。

性能与对比

总结:DieT相比原始的ViT模型相比,通过蒸馏实现了模型规模下降与训练数据与算力要求的降低,使得Transform架构在视觉任务中更广泛的应用。大大促进了大模型与多模态模型小型化技术的发展。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-10-19,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读