西西嘛呦

作者相关精选

hadoop之为什么不能一直格式化namenode

前往小程序,Get更优阅读体验!

立即前往

hadoop之为什么不能一直格式化namenode

西西嘛呦

发布于 2020-08-26 02:00:50

发布于 2020-08-26 02:00:50

7680

举报

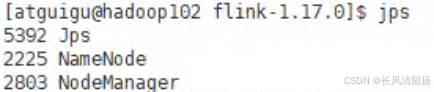

格式化NameNode会产生新的集群id,导致NameNode和DataNode的集群id不一致,集群找不到以往数据,所以,格式化NameNode前,先关闭掉NameNode和DataNode,然后一定要删除data数据和log日志。最后再进行格式化。

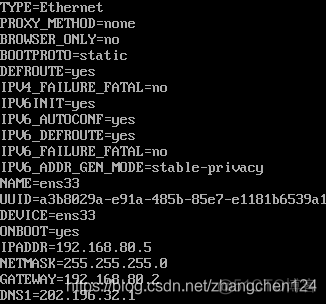

在hadoop-2.9.2/data/tmp/dfs/name/current/VERSION中可查到NameNode标识id

在hadoop-2.9.2/data/tmp/dfs/data/current/VERSION中可查到DataNode标识id

可以看出它们的集群Id是要保持一致的。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2020-03-01 ,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

暂无评论

登录 后参与评论

推荐阅读

编辑精选文章

换一批

推荐阅读

一次误格式化引发的hdfs集群不可用

1.6K0

Hadoop hdfs配置

1260

Hadoop伪分布式配置

7420

hadoop之旅1

2650

hadoop运行环境搭建

1.8K0

Hadoop部署配置及运行调试(上)

1.1K0

如何禁止Namenode格式化

1.7K0

相关推荐

hadoop伪分布式之启动HDFS并运行MR程序(WordCount)

更多 >领券

社区富文本编辑器全新改版!诚邀体验~

全新交互,全新视觉,新增快捷键、悬浮工具栏、高亮块等功能并同时优化现有功能,全面提升创作效率和体验

腾讯云开发者

扫码关注腾讯云开发者

领取腾讯云代金券

Copyright © 2013 - 2025 Tencent Cloud. All Rights Reserved. 腾讯云 版权所有

深圳市腾讯计算机系统有限公司 ICP备案/许可证号:粤B2-20090059 深公网安备号 44030502008569

腾讯云计算(北京)有限责任公司 京ICP证150476号 | 京ICP备11018762号 | 京公网安备号11010802020287

Copyright © 2013 - 2025 Tencent Cloud.

All Rights Reserved. 腾讯云 版权所有

登录 后参与评论

3